Există ceva cu adevărat „old school” în a deschide terminalul, a scrie o singură comandă și a vedea cum îți vin datele brute de pe web, de parcă ai fi intrat direct în Matrix. Pentru developeri și utilizatori tehnici, e genul ăla de baghetă magică: un utilitar discret de linie de comandă care rulează pe miliarde de device-uri, de la servere din cloud până la frigiderul tău smart. Și chiar și în 2026, cu toate tool-urile no-code și soluțiile AI de scraping apărute, web scraping cu curl (web scraping cu curl, curl web scraping, site curl) rămâne o opțiune de bază pentru cei care vor viteză, control și automatizare prin scripturi.

Am petrecut ani construind instrumente de automatizare și ajutând echipe să „îmblânzească” datele de pe web, și tot la cURL ajung când trebuie să descarc rapid o pagină, să depanez un API sau să schițez un flux de scraping. În ghidul ăsta, îți dau un curl web scraping tutorial care acoperă atât baza, cât și trucuri mai avansate—cu exemple reale de comenzi, tips practice și o privire sinceră asupra momentelor în care cURL strălucește (și unde își arată limitele). Iar dacă ești mai mult pe zona de business și nu vrei să te atingi de linia de comandă, îți arăt cum , Web Scraper-ul nostru bazat pe AI, te duce de la „am nevoie de datele astea” la „uite spreadsheet-ul” în două clickuri—fără cod.

Hai să intrăm în pâine: de ce cURL rămâne relevant pentru web scraping în 2025, cum îl folosești eficient și când e cazul să treci la ceva și mai puternic.

Ce este cURL? Baza pentru web-scraping-with-curl

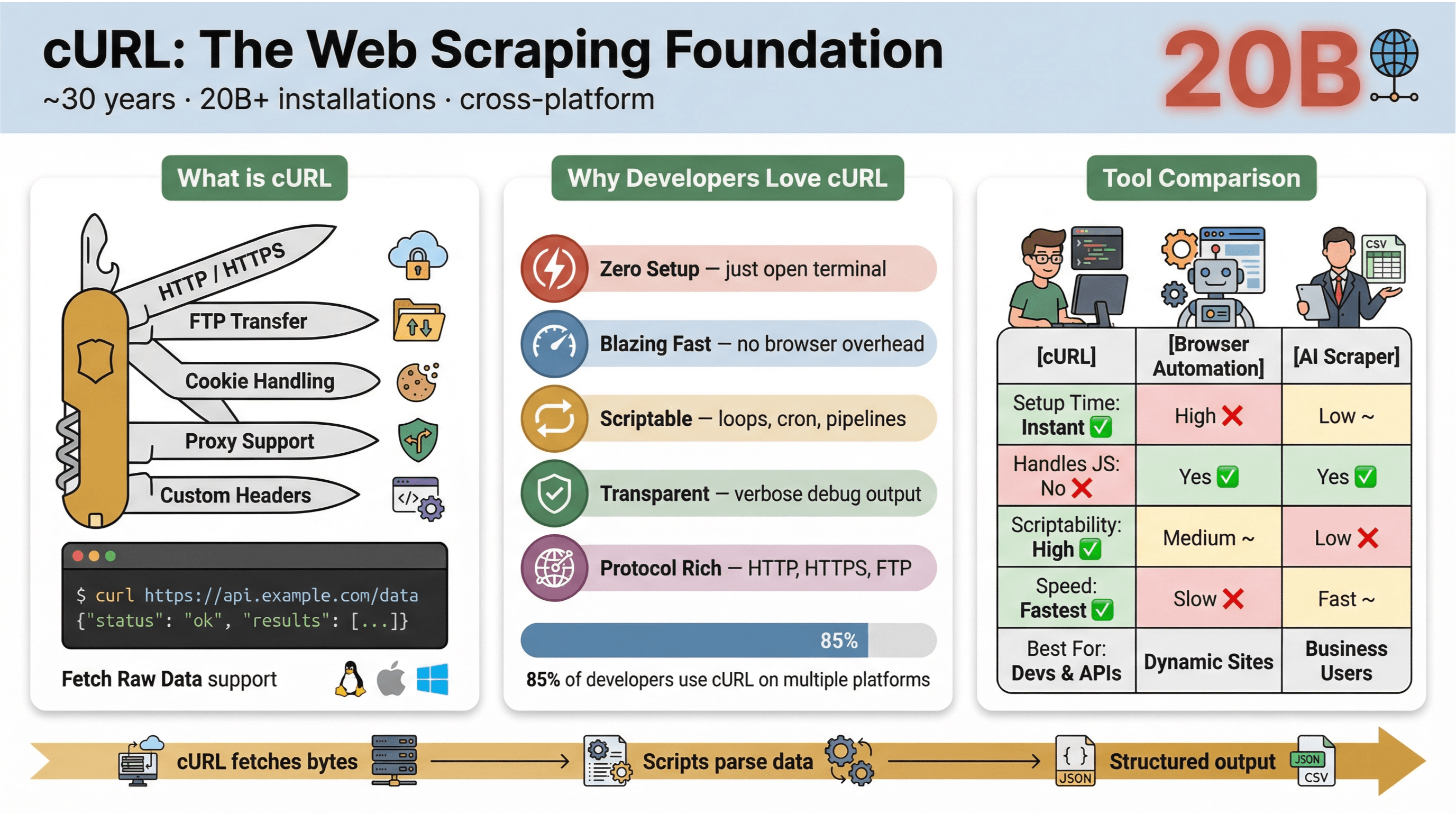

În esență, este un tool și o bibliotecă de linie de comandă pentru transfer de date prin URL-uri. Există de aproape 30 de ani (da, pe bune) și e peste tot—integrat în sisteme de operare, folosit în scripturi și rulând „în fundal” în peste . Dacă ai rulat vreodată o comandă rapidă ca să descarci o pagină web, să testezi un API sau să iei un fișier, sunt șanse mari să fi folosit cURL.

Iată de ce cURL e atât de popular pentru web scraping:

- Ușor și multi-platformă: merge pe Linux, macOS, Windows și chiar pe device-uri embedded.

- Suport pentru protocoale: știe HTTP, HTTPS, FTP și altele.

- Ușor de automatizat: perfect pentru automatizări, cron job-uri și „glue code”.

- Fără interacțiune cu utilizatorul: gândit pentru rulare non-interactivă—ideal pentru batch-uri și pipeline-uri.

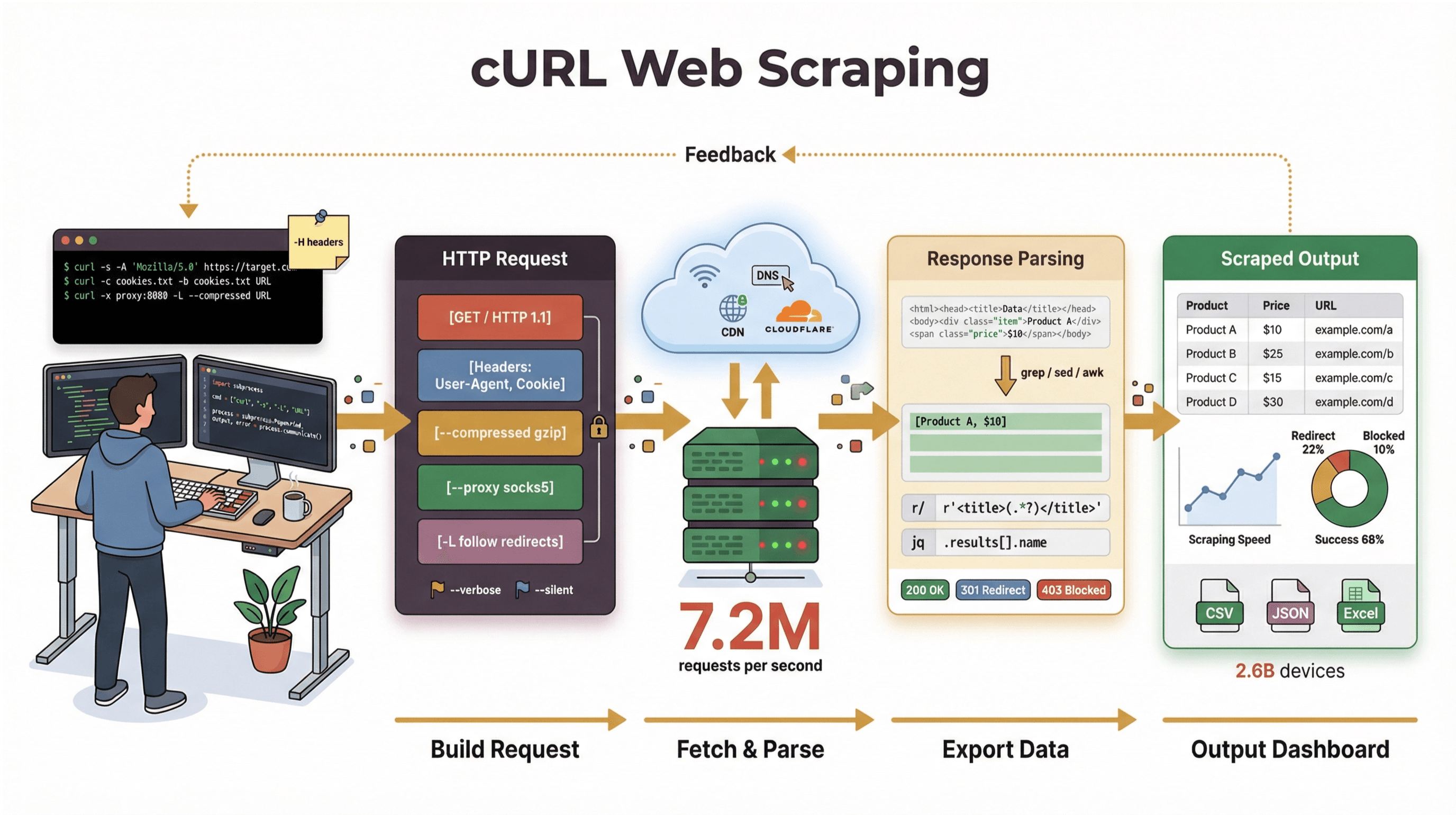

Dar să fim clari: jobul principal al cURL e să-ți aducă date brute—HTML, JSON, imagini, orice. Nu îți parsează, nu îți „randează” și nu îți structurează datele. Gândește-te la cURL ca la „primul kilometru” din web scraping: îți aduce bytes-ii, dar ai nevoie de alte unelte (scripturi Python, grep/sed/awk sau un AI web scraper) ca să transformi totul în informație structurată.

Dacă vrei documentația oficială, vezi .

De ce să folosești cURL pentru web scraping? (curl web scraping tutorial)

De ce se întorc developerii și utilizatorii tehnici la cURL pentru web scraping, chiar și cu atâtea tool-uri noi? Uite ce îl face special:

- Configurare minimă: fără instalări, fără dependențe—deschizi terminalul și îi dai drumul.

- Viteză: descarci date instant, fără să aștepți să se încarce un browser.

- Automatizare prin scripturi: poți itera ușor prin URL-uri, automatiza request-uri și lega comenzi între ele.

- Suport bogat de funcții: cookie-uri, proxy-uri, redirect-uri, headere custom și multe altele.

- Transparență: vezi exact ce se întâmplă cu output verbose/debug.

În , peste 85% dintre respondenți au spus că folosesc utilitarul cURL din linia de comandă, iar aproape toți au raportat utilizare pe mai multe platforme. Rămâne „briceagul elvețian” pentru cereri HTTP, extrageri rapide de date și troubleshooting.

Iată o comparație rapidă între cURL și alte metode de scraping:

| Funcționalitate | cURL | Automatizare browser (ex. Selenium) | AI Web Scraper (ex. Thunderbit) |

|---|---|---|---|

| Timp de configurare | Instant | Mare | Mic |

| Automatizare prin script | Mare | Mediu | Mic (fără cod) |

| JavaScript | Nu | Da | Da (Thunderbit: prin browser) |

| Cookie/Sesiuni | Manual | Automat | Automat |

| Structurare date | Manual (parsezi după) | Manual (parsezi după) | AI/pe bază de template |

| Cel mai potrivit pentru | Devs, extrageri rapide | Site-uri dinamice, complexe | Business, export structurat |

Pe scurt: cURL e beton pentru extrageri rapide și automatizabile—mai ales pentru pagini statice, API-uri sau fluxuri simple. Dar când ai nevoie să parsezi HTML complicat, să gestionezi JavaScript sau să exporți date structurate, îți trebuie ceva mai specializat.

Începe rapid: exemple de comenzi de bază pentru cURL web scraping

Hai pe practică. Uite cum folosești cURL pentru sarcini de web scraping, pas cu pas.

Descărcarea HTML-ului brut cu cURL

Cel mai simplu scenariu: iei HTML-ul unei pagini.

1curl https://books.toscrape.com/Comanda descarcă pagina principală de pe , un site demo public pentru web scraping. Vei vedea HTML-ul brut în terminal—caută tag-uri precum <title> sau fragmente ca „In stock.”

Salvarea rezultatului într-un fișier

Vrei să păstrezi HTML-ul pentru parsare mai târziu? Folosește -o:

1curl -o page.html https://books.toscrape.com/Acum ai un fișier page.html cu tot conținutul. E perfect pentru analiză sau parsare cu alte unelte.

Trimiterea de cereri POST cu cURL

Ai nevoie să trimiți un formular sau să interacționezi cu un API? Folosește -d pentru POST. Exemplu cu , un site pentru testare HTTP:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Vei primi un răspuns JSON care îți „oglindește” datele trimise—super util pentru testare și prototipare.

Inspectarea headerelor și depanare

Uneori vrei să vezi headerele răspunsului sau să depanezi cererea:

-

Doar headere (cerere HEAD):

1curl -I https://books.toscrape.com/ -

Headere + body:

1curl -i https://httpbin.org/get -

Output verbose/debug:

1curl -v https://books.toscrape.com/

Opțiunile astea te ajută să înțelegi ce se întâmplă „sub capotă”—esențial pentru troubleshooting.

Tabel de referință rapidă:

| Sarcină | Exemplu comandă | Note |

|---|---|---|

| Descarcă HTML | curl URL | Afișează HTML în terminal |

| Salvează în fișier | curl -o file.html URL | Scrie output-ul în fișier |

| Inspectează headere | curl -I URL sau curl -i URL | -I doar HEAD, -i include headerele cu body-ul |

| POST date formular | curl -d "a=1&b=2" URL | Trimite date form-encoded |

| Depanare request/response | curl -v URL | Afișează detalii complete despre request/response |

Pentru mai multe exemple, vezi .

Treci la nivelul următor: web scraping avansat cu cURL (web-scraping-with-curl)

După ce stăpânești baza, cURL îți dă și funcții avansate pentru scenarii mai „grele”.

Gestionarea cookie-urilor și a sesiunilor

Multe site-uri cer cookie-uri pentru sesiuni de login sau tracking. Cu cURL poți salva și refolosi cookie-uri între cereri:

1# Salvează cookie-urile după login

2curl -c cookies.txt https://example.com/login

3# Folosește cookie-urile la cereri ulterioare

4curl -b cookies.txt https://example.com/accountAsta te ajută să imiți o sesiune de browser și să accesezi pagini după autentificare (atâta timp cât nu există un challenge JavaScript).

Imitarea User-Agent-ului și headere personalizate

Unele site-uri livrează conținut diferit în funcție de User-Agent sau headere. Implicit, cURL se identifică drept „curl/VERSION”, ceea ce poate declanșa blocări sau conținut alternativ. Ca să semeni cu un browser:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Poți seta și headere custom, de exemplu preferințe de limbă:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/Așa obții conținutul pe care l-ar vedea un browser real.

Folosirea proxy-urilor pentru web scraping

Vrei să treci cererile printr-un proxy (pentru geo-testing sau ca să reduci riscul de ban pe IP)? Folosește -x:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Folosește proxy-urile responsabil și în limitele termenilor site-ului.

Automatizarea scraping-ului pe mai multe pagini

Vrei să extragi mai multe pagini—de exemplu listări paginate? Un loop simplu în shell:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneAsta descarcă paginile 2–5 din catalogul Books to Scrape și le salvează separat. (Pagina 1 este homepage-ul.)

Limitările web-scraping-with-curl: ce trebuie să știi

Oricât de mult îmi place cURL, nu e un „one size fits all”. Uite unde se împotmolește:

- Fără execuție JavaScript: cURL nu poate gestiona pagini care au nevoie de JavaScript ca să randeze conținutul sau ca să treacă de provocări anti-bot ().

- Parsare manuală: primești HTML sau JSON brut, dar trebuie să le parsezi tu—de obicei cu scripturi sau unelte extra.

- Gestionare limitată a sesiunilor: login-uri complexe, token-uri sau formulare în mai mulți pași devin rapid greu de ținut sub control.

- Fără structurare integrată: cURL nu îți transformă paginile în rânduri, tabele sau spreadsheet-uri.

- Vulnerabil la detecție anti-bot: multe site-uri folosesc protecții avansate (JavaScript, fingerprinting, CAPTCHA) pe care cURL nu le poate ocoli ().

Comparație rapidă:

| Limitare | Doar cURL | Unelte moderne (ex. Thunderbit) |

|---|---|---|

| Suport JavaScript | Nu | Da |

| Structurare date | Manual | Automat (AI/Template) |

| Gestionare sesiuni | Manual | Automat |

| Ocolire anti-bot | Limitat | Avansat (browser/AI) |

| Ușurință în utilizare | Tehnic | Non-tehnic |

Pentru pagini statice și API-uri, cURL e excelent. Pentru site-uri dinamice sau protejate, ai nevoie de un nivel superior de instrumente.

Thunderbit vs. cURL: cea mai bună abordare pentru utilizatori non-tehnici

Acum despre , extensia noastră Chrome de Web Scraper bazată pe AI. Dacă ești în vânzări, marketing sau operațiuni și vrei doar să duci datele dintr-un site în Excel, Google Sheets sau Notion—fără linie de comandă—Thunderbit e fix pentru tine.

Comparație Thunderbit vs cURL:

| Funcționalitate | cURL | Thunderbit |

|---|---|---|

| Interfață | Linie de comandă | Point-and-click (extensie Chrome) |

| Sugestie câmpuri cu AI | Nu | Da (AI citește pagina, propune coloane) |

| Paginare/Subpagini | Scriptare manuală | Automat (AI detectează și extrage) |

| Export date | Manual (parse + salvare) | Direct în Excel, Google Sheets, Notion, Airtable |

| Pagini cu JS/Protejate | Nu | Da (scraping în browser) |

| Fără cod | Nu (necesită scripturi) | Da (poate folosi oricine) |

| Plan gratuit | Mereu gratuit | Gratuit până la 6 pagini (10 cu trial boost) |

Cu Thunderbit, deschizi extensia, apeși „AI Suggest Fields”, iar AI-ul își dă seama ce merită extras. Poți extrage tabele, liste, detalii de produs și chiar vizita subpagini automat. Apoi exporți direct în tool-urile tale—fără parsare, fără bătăi de cap.

Thunderbit este folosit de peste și e foarte popular în echipe de vânzări, ecommerce și imobiliare care au nevoie de date structurate rapid.

Vrei să o testezi? .

Combină cURL cu Thunderbit: strategii flexibile de web scraping

Dacă ești utilizator tehnic, nu trebuie să alegi un singur tool. De fapt, multe echipe folosesc cURL și Thunderbit împreună ca să aibă flexibilitate maximă:

- Prototipează cu cURL: testezi rapid endpoint-uri, verifici headere și înțelegi cum răspunde site-ul.

- Scalează cu Thunderbit: când ai nevoie de date structurate, scraping pe mai multe pagini sau un flux repetabil, treci la Thunderbit pentru extragere point-and-click și export direct.

Exemplu de flux pentru research de piață:

- Folosești cURL ca să descarci câteva pagini și să inspectezi structura HTML.

- Identifici câmpurile dorite (ex.: nume produse, prețuri, recenzii).

- Deschizi Thunderbit, apeși „AI Suggest Fields”, iar AI-ul configurează extractorul.

- Extragi toate paginile (inclusiv subpagini sau liste paginate) și exporți în Google Sheets.

- Analizezi, distribui și acționezi pe baza datelor—fără parsare manuală.

Tabel de decizie rapidă:

| Scenariu | Folosește cURL | Folosește Thunderbit | Folosește ambele |

|---|---|---|---|

| Fetch rapid API/pagină statică | ✅ | ||

| Date structurate într-un spreadsheet | ✅ | ||

| Depanare headere/cookie-uri | ✅ | ||

| Pagini dinamice/încărcate cu JS | ✅ | ||

| Flux repetabil, fără cod | ✅ | ||

| Prototipare, apoi scalare | ✅ | ✅ | Flux hibrid |

Provocări și capcane frecvente în web scraping cu cURL

Înainte să te arunci prea tare cu cURL, iată provocările reale pe care aproape sigur le vei întâlni:

- Sisteme anti-bot: multe site-uri folosesc protecții avansate (provocări JavaScript, CAPTCHA, fingerprinting) pe care cURL nu le poate trece ().

- Probleme de calitate a datelor: schimbări în HTML, câmpuri lipsă sau layout-uri inconsistente îți pot rupe scripturile.

- Cost de mentenanță: de fiecare dată când site-ul se schimbă, trebuie să actualizezi logica de parsare.

- Riscuri legale și de conformitate: verifică mereu termenii site-ului, robots.txt și legislația relevantă înainte de scraping. Faptul că datele sunt publice nu înseamnă automat că le poți folosi oricum (, ).

- Limitări la scalare: cURL e excelent pentru joburi mici, dar la scraping la scară mare trebuie să gestionezi proxy-uri, rate limits și erori.

Sfaturi pentru troubleshooting și conformitate:

- Începe cu site-uri demo sau cu permisiune (precum ).

- Respectă rate limit-urile—nu „bombarda” endpoint-urile.

- Evită colectarea de date personale dacă nu ai o bază legală.

- Dacă te lovești de JavaScript sau CAPTCHA, ia în calcul un instrument bazat pe browser precum Thunderbit.

Rezumat pas cu pas: cum extragi date de pe site-uri cu cURL

Checklist rapid pentru web-scraping-with-curl:

- Alege URL-ul/URL-urile țintă: începe cu o pagină statică sau un endpoint API.

- Descarcă pagina:

curl URL - Salvează output-ul într-un fișier:

curl -o file.html URL - Inspectează headere/depanează:

curl -I URL,curl -v URL - Trimite date POST:

curl -d "a=1&b=2" URL - Gestionează cookie-uri/sesiuni:

curl -c cookies.txt ...,curl -b cookies.txt ... - Setează headere/User-Agent:

curl -A "..." -H "..." URL - Urmează redirect-uri:

curl -L URL - Folosește proxy-uri (dacă e nevoie):

curl -x proxy:port URL - Automatizează scraping-ul pe mai multe pagini: loop-uri sau scripturi shell.

- Parsează și structurează datele: cu unelte/scripturi suplimentare.

- Treci la Thunderbit pentru scraping structurat, fără cod, sau pentru pagini dinamice.

Concluzie & idei-cheie: cum alegi instrumentul potrivit pentru web scraping

Web-scraping-with-curl rămâne o abilitate valoroasă pentru utilizatorii tehnici în 2026—mai ales pentru extrageri rapide, prototipare și automatizare. Viteza, controlul prin scripturi și faptul că e peste tot îl fac pe cURL indispensabil în trusa oricărui developer. Dar pe măsură ce web-ul devine mai dinamic și mai protejat, iar utilizatorii de business vor date structurate fără cod, instrumente precum schimbă regulile jocului.

Idei-cheie:

- Folosește cURL pentru pagini statice, API-uri și prototipare rapidă—mai ales când vrei control total.

- Treci la Thunderbit (sau alte AI web scrapers) când ai nevoie de date structurate, pagini dinamice/încărcate cu JavaScript sau un flux no-code, prietenos pentru business.

- Combină-le pentru flexibilitate maximă: prototipezi cu cURL, apoi scalezi și structurezi cu Thunderbit.

- Fă scraping responsabil—respectă termenii site-ului, rate limit-urile și limitele legale.

Vrei să vezi cât de simplu poate fi web scraping-ul? și testează pe cont propriu extragerea de date cu AI. Iar dacă vrei să aprofundezi, intră pe pentru mai multe tutoriale, sfaturi și perspective din industrie. S-ar putea să-ți placă și:

Spor la scraping—și fie ca datele tale să fie mereu curate, structurate și la un singur command (sau click) distanță.

Întrebări frecvente (FAQs)

1. Poate cURL gestiona pagini web randate cu JavaScript?

Nu. cURL nu execută JavaScript. El descarcă HTML-ul brut livrat de server. Dacă o pagină are nevoie de JavaScript ca să afișeze conținutul sau ca să treacă de provocări anti-bot, cURL nu va putea accesa datele. În astfel de cazuri, folosește unelte bazate pe browser precum .

2. Cum salvez direct output-ul cURL într-un fișier?

Folosește opțiunea -o: curl -o filename.html URL. Astfel, corpul răspunsului este scris într-un fișier, nu afișat în terminal.

3. Care e diferența dintre cURL și Thunderbit pentru web scraping?

cURL este un instrument de linie de comandă pentru a descărca date web brute—excelent pentru utilizatori tehnici și automatizare. Thunderbit este o extensie Chrome bazată pe AI, gândită pentru utilizatori de business care vor să extragă date structurate de pe orice site, să gestioneze pagini dinamice și să exporte direct în Excel sau Google Sheets—fără cod.

4. Este legal să faci scraping cu cURL?

Scraping-ul de date publice este, în general, legal în SUA după decizii recente, însă verifică întotdeauna termenii site-ului, robots.txt și legislația relevantă. Evită colectarea de date personale sau protejate fără permisiune și respectă rate limit-urile și bunele practici etice (, ).

5. Când ar trebui să trec de la cURL la un instrument mai avansat precum Thunderbit?

Dacă ai nevoie să extragi pagini dinamice/încărcate cu JavaScript, vrei date structurate într-un spreadsheet sau preferi un flux no-code, Thunderbit este alegerea mai bună. Folosește cURL pentru sarcini rapide și tehnice; folosește Thunderbit pentru extragere repetabilă, prietenoasă pentru business.

Pentru mai multe sfaturi și tutoriale despre web scraping, vizitează sau intră pe .