Dacă ai încercat vreodată să-ți construiești o listă de vânzări foarte bine țintită, să intri pe piețe noi sau să compari concurența, știi deja ce adevărată mină de aur este Google Maps. Și partea și mai importantă: cu peste 1,5 miliarde de căutări „lângă mine” în fiecare lună și cu 76% dintre utilizatorii care caută local și ajung să viziteze o afacere în 24 de ore (), cererea pentru date de business actualizate și bazate pe locație nu a fost niciodată mai mare.

Indiferent dacă lucrezi în vânzări, marketing sau operațiuni, extragerea de date structurate din Google Maps poate face diferența dintre un apel la rece și un lead cald, cu rată mare de conversie.

Am petrecut ani în SaaS și automatizare și am văzut direct cum echipele folosesc Python (și acum, instrumente cu AI precum ) ca să transforme Google Maps într-un activ strategic. În acest ghid, îți arăt exact cum să extragi date din Google Maps cu Python în 2026 — pas cu pas, cu exemple de cod, sfaturi de conformitate și o comparație cu soluțiile no-code. Fie că ești un utilizator avansat de Python sau doar cauți cea mai rapidă cale către date utile, ești unde trebuie.

Ce înseamnă să extragi date din Google Maps cu Python?

Să începem cu baza: extragerea datelor din Google Maps cu Python înseamnă să preiei programatic informații despre afaceri — cum ar fi numele, adresa, ratingul, recenziile, numărul de telefon și coordonatele — din Google Maps, ca apoi să le poți analiza, filtra și exporta pentru uz de business.

Există două metode principale:

- Google Maps Places API: varianta oficială, licențiată. Folosești o cheie API ca să interoghezi serverele Google și să primești date JSON structurate. Este stabilă, previzibilă și, în mare parte, conformă cu regulile, dar vine cu limite și costuri.

- Web scraping din HTML: automatizezi un browser (cu instrumente precum Playwright sau Selenium) ca să încarce Google Maps, să facă căutări și să extragi datele din pagina randată. Este mai flexibilă, dar mai fragilă — Google își schimbă des structura site-ului, iar scraping-ul HTML poate încălca termenii Google.

Câmpuri de date pe care le poți extrage de obicei:

- Numele afacerii

- Categoria/tipul

- Adresa completă (plus oraș, stat, cod poștal, țară)

- Latitudine și longitudine

- Număr de telefon

- URL-ul site-ului

- Rating și număr de recenzii

- Nivelul de preț

- Statusul afacerii (deschis/închis)

- Programul de funcționare

- Place ID (identificatorul unic Google)

- URL Google Maps

De ce contează asta? Pentru că aceste câmpuri alimentează totul, de la generarea de leaduri și planificarea teritoriilor până la analiza concurenței și cercetarea pieței. Cheia este să targetezi datele potrivite pentru obiectivele tale — nu să extragi la întâmplare.

De ce echipele de vânzări și marketing extrag date din Google Maps folosind Python

Hai să vorbim concret. De ce sunt atât de multe echipe de vânzări și marketing obsedate de datele din Google Maps în 2026?

- Generare de leaduri: construiești liste hiper-țintite cu afaceri locale, complete cu date de contact și ratinguri, pentru campanii de outreach.

- Planificarea teritoriilor: cartografiezi teritorii de vânzări, zone de livrare sau arii de servicii pe baza densității reale a afacerilor și a tipurilor acestora.

- Monitorizarea concurenței: urmărești în timp locațiile, ratingurile și recenziile competitorilor pentru a identifica tendințe și oportunități.

- Cercetare de piață: analizezi categoriile de afaceri, programul de funcționare și sentimentul din recenzii pentru a-ți ghida strategia de go-to-market.

- Alegerea locației: pentru real estate și retail, evaluezi locații potențiale în funcție de facilitățile din apropiere, traficul pietonal și competiție.

Impact în lumea reală: potrivit , 92% dintre organizațiile de vânzări plănuiesc să crească investițiile în AI/date, iar echipele care folosesc date locale, bine segmentate, obțin rate de conversie de până la 8× mai mari decât cele care se bazează pe liste generice la rece (). Un studiu despre lead generation pentru francize a arătat chiar 15 dolari venit nou pentru fiecare 1 dolar cheltuit pe liste de leaduri bazate pe Google Maps.

Corelarea obiectivelor de business cu câmpurile Google Maps:

| Obiectiv de business | Câmpuri Google Maps necesare |

|---|---|

| Listă locală de leaduri | nume, adresă, telefon, site, categorie |

| Planificarea teritoriilor | nume, lat/lng, business_status, opening_hours |

| Compararea concurenței | nume, rating, userRatingCount, priceLevel, recenzii |

| Alegerea locației | categorie, lat/lng, densitatea recenziilor, openingDate |

| Informații despre sentiment/meniuri | recenzii, editorialSummary, fotografii, types |

| Outreach prin email/telefon | nationalPhoneNumber, websiteUri (apoi îmbogățești datele, dacă e nevoie) |

Cum îți setezi un Google Maps scraper în Python: instrumente și cerințe

Înainte să începi scraping-ul, trebuie să-ți pregătești mediul Python și să aduni instrumentele potrivite. Iată ce ai nevoie în 2026:

1. Instalează Python și bibliotecile necesare

Versiunea recomandată de Python: 3.10 sau mai nouă.

Instalează bibliotecile cheie:

1pip install \

2 requests==2.33.1 httpx==0.28.1 \

3 beautifulsoup4==4.14.3 lxml==6.0.3 \

4 pandas==2.3.3 \

5 selenium==4.43.0 playwright==1.58.0 \

6 googlemaps==4.10.0 google-maps-places==0.8.0 \

7 schedule==1.2.2 APScheduler==3.11.2 \

8 python-dotenv==1.2.2 tenacity==9.1.4

9playwright install chromiumLa ce folosesc:

requests,httpx: cereri HTTP (apeluri API)beautifulsoup4,lxml: parsare HTML (pentru web scraping)pandas: curățare, analiză și export de dateselenium,playwright: automatizare de browser (pentru scraping HTML)googlemaps,google-maps-places: clienți API pentru Google Mapsschedule,APScheduler: programarea sarcinilorpython-dotenv: încărcarea în siguranță a cheilor API din fișiere.envtenacity: logică de retry pentru gestionarea erorilor

2. Obține o cheie API Google Maps (pentru scraping bazat pe API)

- Intră în .

- Creează sau selectează un proiect.

- Activează billing-ul (obligatoriu, chiar și pentru nivelul gratuit).

- Activează „Places API (New)” din APIs & Services > Library.

- Mergi la Credentials > Create Credentials > API Key.

- Restricționează cheia la API-uri și IP-uri specifice, pentru securitate.

- Salvează cheia într-un fișier

.env(nu o pune niciodată direct în cod):

1GOOGLE_MAPS_API_KEY=your_actual_api_key_hereNotă: Din martie 2025, Google nu mai oferă un credit universal gratuit de 200 USD/lună. În schimb, există praguri lunare gratuite, în funcție de nivelul API-ului (vezi ).

Cum extragi date din Google Maps cu Python: ghid pas cu pas

Hai să descompunem cele două abordări principale — bazată pe API și scraping HTML — ca să poți alege ce ți se potrivește.

Abordarea 1: folosind Google Maps Places API (recomandat)

Pasul 1: instalează și importă bibliotecile necesare

1import os

2import httpx

3import pandas as pd

4from dotenv import load_dotenvPasul 2: încarcă în siguranță cheia API

1load_dotenv()

2API_KEY = os.environ["GOOGLE_MAPS_API_KEY"]Pasul 3: construiește interogarea de căutare

Vei folosi endpoint-ul Text Search pentru a găsi afaceri care corespund criteriilor tale.

1URL = "https://places.googleapis.com/v1/places:searchText"

2FIELD_MASK = ",".join([

3 "places.id", "places.displayName", "places.formattedAddress",

4 "places.location", "places.rating", "places.userRatingCount",

5 "places.priceLevel", "places.types",

6 "places.nationalPhoneNumber", "places.websiteUri",

7 "nextPageToken",

8])Pasul 4: fă cererea API

1def text_search(query, lat, lng, radius=3000, min_rating=4.0):

2 body = {

3 "textQuery": query,

4 "minRating": min_rating, # filtru aplicat pe server

5 "includedType": "restaurant",

6 "openNow": False,

7 "pageSize": 20,

8 "locationBias": {

9 "circle": {

10 "center": {"latitude": lat, "longitude": lng},

11 "radius": radius,

12 }

13 },

14 }

15 headers = {

16 "Content-Type": "application/json",

17 "X-Goog-Api-Key": API_KEY,

18 "X-Goog-FieldMask": FIELD_MASK, # setează mereu asta!

19 }

20 r = httpx.post(URL, json=body, headers=headers, timeout=30)

21 r.raise_for_status()

22 return r.json()Pasul 5: gestionează paginarea și colectează rezultatele

1def collect_all_results(query, lat, lng, radius=3000, min_rating=4.0):

2 results = []

3 next_page_token = None

4 while True:

5 data = text_search(query, lat, lng, radius, min_rating)

6 places = data.get('places', [])

7 results.extend(places)

8 next_page_token = data.get('nextPageToken')

9 if not next_page_token:

10 break

11 return resultsPasul 6: exportă datele cu Pandas

1df = pd.DataFrame(collect_all_results("coffee shops in Brooklyn", 40.6782, -73.9442))

2df.to_csv("brooklyn_coffee_shops.csv", index=False)Sfaturi utile:

- Setează mereu header-ul

X-Goog-FieldMaskca să controlezi costurile. Dacă ceri recenzii sau fotografii, prețul per 1.000 de cereri poate urca de la 5 USD la 25 USD (). - Folosește filtre pe server (cum ar fi

minRating,includedType,locationBias) ca să nu irosești credite pe rezultate irelevante. - Cache-uiește valorile

place_idpentru deduplicare și actualizări viitoare.

Abordarea 2: web scraping din HTML-ul Google Maps (pentru uz educațional sau ocazional)

Atenție: Google Maps este o aplicație single-page. Trebuie să folosești automatizare de browser (Playwright sau Selenium), iar scraping-ul HTML poate încălca termenii Google. Folosește-l pentru cercetare, nu în producție.

Pasul 1: instalează Playwright și lansează browserul

1from playwright.sync_api import sync_playwright

2import time, re

3def scrape_maps(query, max_results=100):

4 with sync_playwright() as pw:

5 browser = pw.chromium.launch(headless=True)

6 ctx = browser.new_context(

7 user_agent="Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

8 locale="en-US",

9 )

10 page = ctx.new_page()

11 page.goto("https://www.google.com/maps", timeout=60_000)

12 page.fill("#searchboxinput", query)

13 page.click('button[aria-label="Search"]')

14 page.wait_for_selector('div[role="feed"]')

15 feed = page.locator('div[role="feed"]')

16 prev = 0

17 while True:

18 feed.evaluate("el => el.scrollBy(0, el.scrollHeight)")

19 time.sleep(2)

20 count = page.locator('div[role="feed"] > div > div[jsaction]').count()

21 if count == prev or count >= max_results:

22 break

23 prev = count

24 if page.locator("text=You've reached the end of the list").count():

25 break

26 rows = []

27 cards = page.locator('div[role="feed"] > div > div[jsaction]')

28 for i in range(cards.count()):

29 c = cards.nth(i)

30 name = c.locator("div.fontHeadlineSmall").inner_text() if c.locator("div.fontHeadlineSmall").count() else ""

31 rating_el = c.locator('span[role="img"]').first

32 raw = rating_el.get_attribute("aria-label") if rating_el.count() else ""

33 m = re.search(r"([\d.]+)\s+stars?\s+([\d,]+)\s+Reviews", raw or "")

34 rating = float(m.group(1)) if m else None

35 reviews = int(m.group(2).replace(",", "")) if m else None

36 rows.append({"name": name, "rating": rating, "reviews": reviews})

37 browser.close()

38 return rowsSfaturi:

- Google randomizează clasele CSS la câteva săptămâni, așa că acest cod va avea nevoie de actualizări periodice.

- Folosește pauze naturale, ca ale unui om, și nu extrage prea rapid, ca să reduci riscul de blocare.

- Nu încerca niciodată să ocolești CAPTCHA-urile sau sistemul SearchGuard al Google — acest lucru te poate expune la riscuri legale.

Evită scraping-ul oarb: cum să targetezi precis datele de care ai nevoie

Să extragi totul este o rețetă pentru timp pierdut și seturi de date umflate inutil. Iată cum să targetezi doar datele relevante:

- Generează liste de URL-uri țintite: folosește filtrele de căutare din Google Maps (categorie, locație, rating, open now) pentru a restrânge rezultatele înainte de scraping.

- Folosește potrivirea expresiilor: caută tipuri exacte de afaceri sau cuvinte-cheie (de exemplu, „vegan bakery in Austin”).

- Filtre de locație: specifică orașul, cartierul sau chiar coordonate și rază pentru precizie maximă.

- Filtrare pe server (API): folosește

minRating,includedTypeșilocationBiasîn corpul cererii API. - Filtrare în Python, pe client: după scraping, folosește pandas ca să păstrezi doar afacerile cu rating peste 4,0, peste 50 de recenzii sau anumite categorii.

Exemplu: filtrarea doar a restaurantelor din Manhattan cu rating peste 4,0

1df = pd.DataFrame(results)

2filtered = df[(df['rating'] >= 4.0) & (df['types'].apply(lambda x: 'restaurant' in x))]

3filtered.to_csv("manhattan_top_restaurants.csv", index=False)Folosirea bibliotecilor Python pentru organizarea și exportul datelor din Google Maps

După ce ai extras datele, e momentul să le cureți, să le analizezi și să le exporți pentru echipă.

Curățarea și structurarea datelor cu Pandas

1import pandas as pd

2df = pd.read_json("brooklyn_restaurants.json")

3df = (

4 df.dropna(subset=["name", "address"])

5 .drop_duplicates(subset=["place_id"])

6 .assign(

7 name=lambda d: d["name"].str.strip(),

8 phone=lambda d: d["phone"].astype(str)

9 .str.replace(r"\D", "", regex=True)

10 .str.replace(r"^1?(\d{10})$", r"+1\1", regex=True),

11 rating=lambda d: pd.to_numeric(d["rating"], errors="coerce"),

12 user_ratings_total=lambda d: pd.to_numeric(

13 d["user_ratings_total"], errors="coerce"

14 ).fillna(0).astype("int32"),

15 )

16)Analizarea și sintetizarea datelor

Exemplu: rating mediu pe cartier

1by_neighborhood = (

2 df.groupby("neighborhood", as_index=False)

3 .agg(avg_rating=("rating", "mean"),

4 n_places=("place_id", "nunique"),

5 median_reviews=("user_ratings_total", "median"))

6 .sort_values("avg_rating", ascending=False)

7)Exportul în Excel sau CSV

1df.to_csv("brooklyn_top.csv", index=False)

2df.to_excel("brooklyn_top.xlsx", index=False, sheet_name="Top Rated")Seturi mari de date? Folosește formatul Parquet pentru viteză și eficiență de spațiu:

1df.to_parquet("brooklyn_top.parquet", compression="zstd")Thunderbit: alternativă cu AI la scraperul Python pentru Google Maps

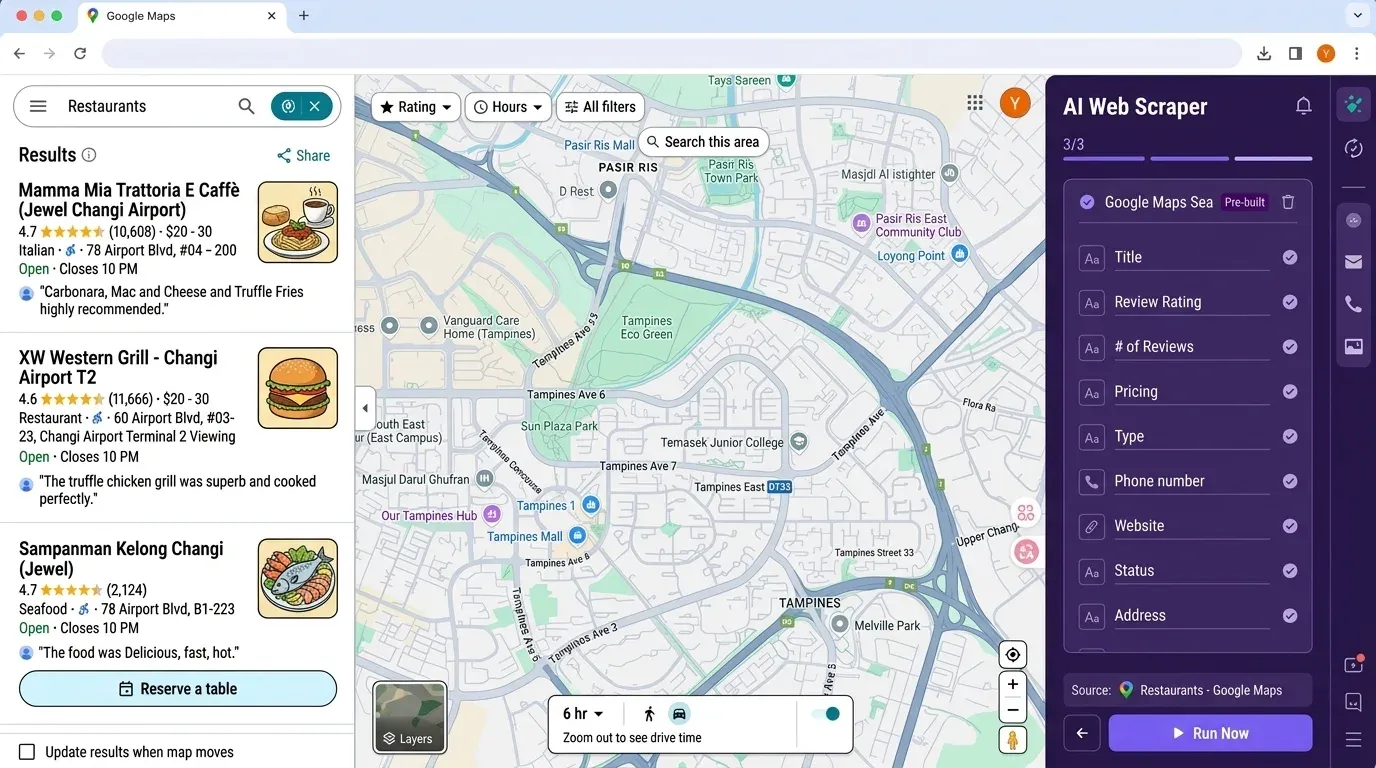

Acum, dacă te gândești „așa multă configurare doar pentru o listă de leaduri?”, nu ești singur. Tocmai de aceea am construit — un web scraper no-code, alimentat de AI, care face extragerea datelor din Google Maps (și nu numai) la fel de simplă ca două clickuri.

De ce Thunderbit?

- Nu ai nevoie de cod sau chei API: deschizi , mergi în Google Maps și apeși „AI Suggest Fields”.

- Detecție AI a câmpurilor: AI-ul Thunderbit citește pagina și îți sugerează coloanele potrivite — nume, adresă, rating, telefon, site și altele.

- Scraping pe subpagini: vrei să îmbogățești tabelul cu date de pe site-ul fiecărei afaceri? Thunderbit poate vizita automat fiecare subpagină și extrage informații suplimentare.

- Export în Excel, Google Sheets, Airtable sau Notion: gata cu manipularea prin pandas — apeși „Export” și datele sunt pregătite pentru echipă.

- Scraping programat: setezi joburi recurente ca să monitorizezi concurența sau să reîmprospătezi automat lista de leaduri.

- Întreținere zero: AI-ul Thunderbit se adaptează la schimbările site-ului, deci nu mai repari constant scripturi care s-au stricat.

Thunderbit vs workflow-ul Python:

| Pas | Scraper Python | Thunderbit |

|---|---|---|

| Instalarea instrumentelor | 30–60 min (Python, pip, biblioteci) | 2 min (Chrome Extension) |

| Configurarea cheii API | 10–30 min (Cloud Console) | Nu este necesară |

| Selectarea câmpurilor | Cod manual, field masks | AI Suggest Fields (1 click) |

| Extragerea datelor | Scrii/rulezi scripturi, gestionezi erorile | Click pe „Scrape” |

| Export | pandas către CSV/Excel | Export către Excel/Sheets/Notion |

| Întreținere | Actualizări manuale când se schimbă site-ul | AI se adaptează automat |

Bonus: Thunderbit are încrederea a peste , iar planul gratuit îți permite să extragi până la 6 pagini (sau 10 cu un boost de trial) fără costuri.

Rămâi conform: termenii Google Maps și etica scraping-ului

Aici e partea pe care multe tutoriale de Python o prezintă deja învechit. Iată ce trebuie să știi în 2026:

- Google Maps Platform ToS §3.2.3 interzice strict scraping-ul, cache-uirea sau exportul de date în afara API-urilor oficiale (). Singura excepție: valorile de latitudine/longitudine pot fi păstrate în cache până la 30 de zile; Place ID-urile pot fi stocate la nesfârșit.

- Utilizatorii API sunt legați prin contract: dacă folosești o cheie API, ai acceptat termenii Google — chiar dacă extragi doar date publice.

- Ocolirea barierelor tehnice (CAPTCHA, SearchGuard) poate deveni acum o posibilă încălcare DMCA §1201, cu potențiale sancțiuni penale ().

- GDPR și legile privind confidențialitatea: dacă colectezi date personale (emailuri, telefoane, nume de recenzori) din Google Maps, trebuie să ai un temei legal și să respecți cererile de ștergere. Autoritatea franceză CNIL a amendat KASPR cu 200.000 € în 2024 pentru scraping de contacte LinkedIn ().

- Cele mai bune practici:

- Folosește, în mod implicit, Places API atunci când se poate.

- Limitează ritmul cererilor (≤10 QPS pentru API, 1–2 req/s pentru scraping HTML).

- Nu ocoli niciodată CAPTCHA-urile sau blocajele tehnice.

- Nu redistribui date personale extrase.

- Respectă cererile de opt-out și ștergere.

- Verifică mereu legile locale — GDPR, CCPA și altele sunt aplicate activ.

Concluzia: dacă te preocupă conformitatea, rămâi la API și colectează cât mai puține date posibil. Pentru majoritatea utilizatorilor de business, un instrument no-code precum Thunderbit reduce semnificativ riscul (fără cheie API, fără redistribuire).

Programarea și automatizarea extragerii datelor din Google Maps cu Python

Dacă trebuie să-ți menții datele proaspete — de exemplu pentru monitorizarea săptămânală a concurenței sau actualizarea lunară a listei de leaduri — automatizarea este prietenul tău.

Programare simplă cu schedule

1import schedule, time

2from my_scraper import run_job

3schedule.every().day.at("03:00").do(run_job, query="restaurants in Brooklyn")

4schedule.every(6).hours.do(run_job, query="coffee shops in Manhattan")

5while True:

6 schedule.run_pending()

7 time.sleep(30)Programare robustă, de producție, cu APScheduler

1from apscheduler.schedulers.background import BackgroundScheduler

2from apscheduler.triggers.cron import CronTrigger

3sched = BackgroundScheduler(timezone="America/New_York")

4sched.add_job(

5 run_job,

6 CronTrigger(hour=3, minute=15, jitter=600), # 3:15 AM ± 10 min

7 kwargs={"query": "restaurants in Brooklyn"},

8 id="brooklyn_daily",

9 max_instances=1,

10 coalesce=True,

11 misfire_grace_time=3600,

12)

13sched.start()Sfaturi pentru automatizare sigură

- Adaugă un jitter aleator în programare, ca să eviți tiparele previzibile.

- Pentru scraping HTML, nu depăși niciodată 1–2 cereri pe secundă.

- Pentru folosirea API, monitorizează cota și setează alerte de billing.

- Loghează mereu erorile și păstrează un fișier „dead-letter” pentru cererile eșuate.

Bonus Thunderbit: cu Thunderbit, poți programa direct în interfață scraping-uri recurente — fără cod, fără cron jobs, fără configurare de server.

Idei principale: extragere eficientă, țintită și conformă a datelor din Google Maps

Să recapitulăm esențialul:

- Google Maps este sursa #1 pentru date despre locațiile afacerilor, alimentând totul, de la generarea de leaduri la cercetarea de piață.

- Scraping-ul cu Python oferă flexibilitate și control, dar vine cu configurare, mentenanță și obligații de conformitate — mai ales pe măsură ce cresc măsurile anti-bot și aplicarea legii de către Google.

- Extragerea prin API este cea mai sigură și cea mai scalabilă opțiune pentru majoritatea echipelor. Folosește mereu field masks și filtre pe server pentru a controla costurile.

- Scraping-ul HTML este fragil și riscant — folosește-l doar pentru cercetări punctuale și nu ocoli barierele tehnice.

- Țintește datele potrivite: folosește potrivirea expresiilor, filtrele de locație și fluxurile de lucru în pandas ca să extragi doar ce ai nevoie.

- Thunderbit este cea mai rapidă soluție pentru non-programatori: bazat pe AI, fără configurare, export instant și programare integrată.

- Conformitatea contează: respectă termenii Google, legile privind confidențialitatea și limitele de rată ca să eviți problemele legale.

Pentru mai multe tutoriale și sfaturi, vezi și .

FAQ

1. Este legal să extragi date din Google Maps cu Python în 2026?

Extragerea datelor din Google Maps prin API-ul oficial este permisă în limitele termenilor Google, atâta timp cât respecți cotele și nu redistribui datele restricționate. Scraping-ul HTML din Google Maps este interzis explicit de termenii Google și implică riscuri legale, mai ales dacă ocolești barierele tehnice sau colectezi date personale fără consimțământ. Verifică întotdeauna legile locale (GDPR, CCPA etc.) și urmează bunele practici de conformitate.

2. Care este diferența dintre folosirea Google Maps API și web scraping-ul HTML?

API-ul este stabil, licențiat și creat pentru extragerea datelor, dar necesită cheie API și este supus cotelor și costurilor. Scraping-ul HTML folosește automatizare de browser pentru a extrage date din pagina randată, dar este fragil (site-ul se schimbă des), poate încălca termenii și este mai riscant din punct de vedere legal. Pentru majoritatea utilizărilor de business, API-ul este calea recomandată.

3. Cât costă să extragi date din Google Maps folosind Python în 2026?

Prețurile Google Places API sunt calculate per 1.000 de cereri și variază de la 5 USD (Essentials) până la 25 USD (Enterprise+Atmosphere), în funcție de câmpurile cerute. Există praguri lunare gratuite (10.000 pentru Essentials, 5.000 pentru Pro, 1.000 pentru Enterprise), dar scraping-ul la scară mare poate deveni rapid costisitor. Folosește mereu field masks și filtre pe server pentru a controla costurile.

4. Cum se compară Thunderbit cu scrapers-ii Google Maps bazați pe Python?

Thunderbit este un web scraper no-code, alimentat de AI, care îți permite să extragi date din Google Maps (și multe altele) fără programare, chei API sau mentenanță. Este ideal pentru echipele de vânzări și marketing care vor exporturi rapide și fiabile către Excel, Google Sheets, Airtable sau Notion. Pentru utilizatorii tehnici care au nevoie de logică personalizată, Python oferă mai multă flexibilitate, dar necesită mai multă configurare și gestionare a conformității.

5. Cum pot automatiza extrageri recurente de date din Google Maps?

Cu Python, folosește biblioteci de programare precum schedule sau APScheduler ca să rulezi scraperul la intervale fixe (zilnic, săptămânal etc.). Adaugă un jitter aleator ca să reduci riscul de detectare și monitorizează cota API. Cu Thunderbit, poți programa direct din interfață scraping-uri recurente — fără cod și fără configurare de server.

Ești gata să transformi Google Maps în superputerea ta pentru vânzări și marketing? Fie că ești pasionat de Python sau cauți cea mai rapidă soluție no-code, instrumentele există deja în 2026. Încearcă pentru scraping instant, alimentat de AI — sau suflecă-ți mânecile și intră în API. În ambele cazuri, sperăm ca listele tale de leaduri să fie mereu proaspete, exporturile curate, iar campaniile pline de prospecți locali cu potențial mare de conversie. Spor la scraping!

Află mai mult