Airbnb găzduiește peste în peste 220 de țări — și nu oferă niciun acces public la API pentru date de piață. Dacă vrei informații despre prețuri, comparații cu concurența sau seturi de date pentru cercetare, scraping-ul este, practic, singura opțiune.

Problema? Airbnb este unul dintre cele mai dificile site-uri de extras date de pe web-ul modern. Rulează un WAF personalizat susținut de Akamai Bot Manager, redă totul pe partea de client cu React și rotește numele claselor CSS așa cum un lăcătuș paranoic schimbă cheile. Am petrecut mult timp testând diferite abordări pentru scraping-ul Airbnb — de la biblioteci HTTP ușoare, la automatizare completă în browser, până la instrumente AI no-code — iar realitatea este că nicio metodă nu funcționează perfect în orice scenariu.

Acest ghid parcurge toate cele cinci abordări viabile, cu cod real, compromisuri oneste și sfaturi practice ca să nu-ți ajungă IP-ul blocat definitiv. Fie că ești dezvoltator Python, analist de date sau investitor imobiliar care vrea doar un spreadsheet, există o soluție și pentru tine.

De ce să extragi date din Airbnb? Cazuri reale de utilizare

Nimeni nu face scraping pe Airbnb doar de dragul de a parsa HTML imbricat. Oamenii au proiecte și obiective de business specifice — iată cele mai comune șase:

| Caz de utilizare | Ce extragi | Cine face asta |

|---|---|---|

| Strategie de prețuri dinamice | Tarifele pe noapte ale concurenței într-un anumit radius | Gazde, administratori de proprietăți |

| Analiză de investiții | Indicatori de ocupare (frecvența recenziilor, disponibilitatea în calendar), ADR, RevPAR | Investitori imobiliari |

| Benchmark pentru taxa de curățenie | Taxele de curățenie pentru diferite tipuri de proprietăți (media variază de la $81–$335 în marile orașe din SUA) | Gazde, consultanți de prețuri |

| Analiza sentimentului recenziilor | Recenziile oaspeților pentru NLP/scorare a sentimentului | Data scientists, echipe din ospitalitate |

| Cercetare academică | Seturi de date la nivel de piață pentru politici de locuire, turism, economie urbană | Cercetători (48,7% din 1.021 de lucrări academice despre Airbnb au folosit date extrase) |

| Urmărirea concurenței | Anunțuri noi, modificări de preț, disponibilitate în timp | Operatori STR, analiști de piață |

Pentru cazuri de utilizare continue, cum ar fi monitorizarea prețurilor sau urmărirea concurenței, scraping-ul programat sau automatizat este deosebit de valoros — ai nevoie de date proaspete, nu de un instantaneu de moment.

Piața închirierilor pe termen scurt crește mai repede decât hotelurile tradiționale: cererea STR în timp ce cererea hotelieră a scăzut cu 0,3%. Dacă activezi în acest domeniu, datele sunt avantajul tău.

Ce face Airbnb dificil de extras

Înainte să scrii o singură linie de cod, ajută să înțelegi de ce Airbnb este evaluat ca dificultate de scraping. Trei probleme se suprapun una peste alta.

Apărările anti-bot ale Airbnb

Airbnb folosește un WAF personalizat combinat cu , un sistem enterprise de detectare a boților care evaluează fiecare cerere pe mai multe dimensiuni simultan. Nu e doar rate limiting — e fingerprinting condus de AI.

Pachetul de detecție, în ordinea riscului:

- TLS Fingerprinting (RIDICAT): biblioteca Python

requestsare o semnătură TLS handshake unică, care nu se potrivește cu niciun browser real. Akamai analizează suitele de cifrare, extensiile și ordinea ALPN folosind metodele JA3/JA4.requestsstandard are aproximativ față de 92% pentru biblioteci care falsifică fingerprint-ul TLS al browserului. - Execuția JavaScript (RIDICAT): Akamai implementează scripturi pe partea de client care colectează „date de senzori” — proprietăți ale dispozitivului, capabilități hardware, detalii despre sistemul de operare. Din asta rezultă cookie-ul

_abck. Fără executarea acestui JavaScript, cererile sunt blocate. - Browser Fingerprinting (RIDICAT): analiza Canvas, WebGL și a fonturilor detectează instrumentele de automatizare. Browserele headless expun flag-ul

navigator.webdriver, pluginuri lipsă și valori hardware inconsistente. - Analiza headerelor HTTP (RIDICAT): lipsa headerelor

Sec-Fetch-*este o pe Airbnb. - Reputația IP-ului (MEDIU): IP-urile din datacenter sunt blocate imediat. Proxy-urile rezidențiale sunt obligatorii la scară.

- Analiza comportamentală (MEDIU): timp perfect regulat, fără mișcări de mouse, fără scroll — toate sunt semnale clare.

Când ești blocat, vei vedea: 403 Forbidden (eșec de fingerprint), 429 Too Many Requests (limită de rată), 503 Service Unavailable (pagina de challenge Akamai) sau o pagină CAPTCHA.

Pagini dinamice, cu mult JavaScript, la Airbnb

Un simplu requests.get() către Airbnb returnează un shell React cu HTML placeholder — nu datele reale ale anunțurilor. După cum a spus : „Cereri HTTP simple pur și simplu nu funcționează, iar fără proxy-uri adecvate și randare JavaScript reală, nu extragi date din Airbnb, ci doar placeholder-e.”

Datele reale sunt preluate pe partea de client prin apeluri interne GraphQL (/api/v3/StaysSearch pentru rezultatele căutării, /api/v3/PdpPlatformSections pentru detaliile anunțului). Asta înseamnă că majoritatea datelor utile necesită fie un browser complet, fie interceptarea API-ului.

DOM-ul se schimbă permanent

Airbnb folosește CSS-in-JS cu nume de clase hash-uite care se schimbă la fiecare deployment. Exemple documentate includ _tyxjp1, lxq01kf, atm_mk_h2mmj6, t1jojoys și _8s3ctt. După cum explică : „Aceste clase nu sunt concepute să fie stabile și se pot schimba oricând, adesea fără nicio modificare vizibilă a paginii.”

Comunitatea de dezvoltatori a documentat pe larg această problemă. că „clasele CSS se schimbă tot timpul, iar bazarea pe ele este o cale rapidă să-ți strici scraperul.” Un dezvoltator cu experiență din DEV Community a rezumat foarte bine: „Un scraper care rulează cu 50% mai lent, dar nu se strică niciodată, este infinit mai valoros decât unul rapid care moare săptămânal.”

Estimările din industrie sugerează că din cauza schimbărilor de DOM, actualizărilor de fingerprinting sau throttling-ului endpointurilor.

Alege abordarea: 5 moduri de a extrage date din Airbnb

Înainte de orice cod, iată comparația. Fiecare abordare are compromisuri reale — nu există o metodă universal „cea mai bună”.

| Abordare | Efort de configurare | Viteză | Rezistență anti-bot | Întreținere | Cel mai potrivit pentru |

|---|---|---|---|---|---|

HTTP pur (requests / pyairbnb) | Redus | Rapid | Medie (vulnerabil la schimbări de API) | Medie | Cercetare rapidă, seturi mici de date |

| Automatizare în browser (Selenium) | Mare | Lent | Medie | Mare (se rupe din cauza DOM-ului) | Conținut dinamic, prețuri dependente de dată |

| Automatizare în browser (Playwright) | Mediu | Medie | Medie-ridicată | Medie | Alternativă modernă la Selenium |

| API de scraping (ScrapingBee, Bright Data) | Redus | Rapid | Ridicată (cu rotire de proxy inclusă) | Redusă | Scraping la scară, utilizare în producție |

| No-code (Thunderbit) | Minim | Rapid | Ridicată (AI-ul se adaptează la schimbările de layout) | Niciuna | Non-dezvoltatori, analiză punctuală |

Restul articolului parcurge abordările Python pas cu pas, iar la final există o secțiune no-code pentru cei care preferă să sară complet peste cod.

Pas cu pas: extragerea datelor din Airbnb cu Python folosind Requests (abordarea HTTP-first)

Aceasta este opțiunea ușoară, bună pentru pornire rapidă — nu ai nevoie de browser, nici de bătăi de cap cu chromedriver. Compromisul: funcționează pentru unele date, dar nu pentru toate.

Configurarea mediului Python

Creează un folder de proiect și configurează un mediu virtual:

1mkdir airbnb-scraper && cd airbnb-scraper

2python -m venv venv

3source venv/bin/activate # Windows: venv\Scripts\activate

4pip install requests beautifulsoup4 pandas pyairbnbpyairbnb este o bibliotecă ușoară (, ultima lansare în februarie 2026) care interceptează API-ul intern GraphQL StaysSearch al Airbnb. Nu extrage deloc HTML, ceea ce o face rezistentă la schimbările claselor CSS. Modelul cu un singur maintainer este un factor de risc, dar biblioteca este actualizată activ.

Opțiunea A: folosirea pyairbnb pentru rezultate rapide din căutare

Cel mai rapid drum către date structurate din Airbnb:

1import pyairbnb

2import pandas as pd

3# Caută după locație și date

4results = pyairbnb.search_all(

5 query="Austin, TX",

6 checkin="2025-08-01",

7 checkout="2025-08-03",

8 adults=2,

9 currency="USD"

10)

11# Convertește în DataFrame

12df = pd.DataFrame(results)

13print(df[['name', 'price', 'rating', 'reviewsCount', 'url']].head())

14df.to_csv("airbnb_austin.csv", index=False)pyairbnb suportă și get_details(), get_price(), get_reviews(), get_calendar() și get_listings_from_user(). Toate funcțiile acceptă un parametru pentru URL-ul proxy-ului, util la rotire.

Opțiunea B: cereri HTTP manuale cu BeautifulSoup

Dacă preferi să nu depinzi de o bibliotecă terță, poți trimite cereri direct. Atenție: requests simplu este blocat rapid din cauza TLS fingerprinting-ului. Folosirea curl_cffi (care falsifică fingerprint-urile TLS ale browserului) îmbunătățește semnificativ rata de succes.

1from curl_cffi import requests as cffi_requests

2from bs4 import BeautifulSoup

3import json

4url = "https://www.airbnb.com/s/Austin--TX/homes?checkin=2025-08-01&checkout=2025-08-03&adults=2"

5headers = {

6 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/131.0.0.0 Safari/537.36",

7 "Accept-Language": "en-US,en;q=0.9",

8 "Sec-Fetch-Dest": "document",

9 "Sec-Fetch-Mode": "navigate",

10 "Sec-Fetch-Site": "none",

11 "Sec-Fetch-User": "?1",

12}

13response = cffi_requests.get(url, headers=headers, impersonate="chrome131")

14soup = BeautifulSoup(response.text, "html.parser")Extragerea datelor din microdate Schema.org

Airbnb încorporează microdate schema.org direct în markup-ul HTML — iar aceste taguri semantice sunt . Caută containerele itemprop="itemListElement":

1listings = soup.find_all("div", itemprop="itemListElement")

2data = []

3for listing in listings:

4 name_tag = listing.find("meta", itemprop="name")

5 url_tag = listing.find("meta", itemprop="url")

6 position_tag = listing.find("meta", itemprop="position")

7 data.append({

8 "name": name_tag["content"] if name_tag else None,

9 "url": url_tag["content"] if url_tag else None,

10 "position": position_tag["content"] if position_tag else None,

11 })

12df = pd.DataFrame(data)

13df.to_csv("airbnb_listings.csv", index=False)Limitarea: tagurile schema.org îți oferă numele anunțului, URL-urile și pozițiile — dar nu și prețurile, evaluările sau facilitățile. Pentru date mai bogate, ai nevoie de automatizare în browser sau de interceptarea API-ului.

Pas cu pas: extragerea datelor din Airbnb cu Python folosind Selenium sau Playwright

Când ai nevoie de conținut dinamic — prețuri dependente de dată, facilități ascunse în spatele butoanelor „Show more”, text complet al recenziilor — automatizarea în browser este instrumentul potrivit.

Când să folosești automatizarea în browser

- Pagini care cer selectarea datelor pentru a afișa prețul real

- Facilități și recenzii ascunse în spatele elementelor interactive

- Orice date care se încarcă doar după executarea JavaScript

- Când trebuie să interacționezi cu pagina (scroll, click)

Selenium vs. Playwright: Playwright a câștigat (în mare parte)

Playwright a depășit Selenium ca instrument preferat pentru automatizare în browser. Este mai rapid, are suport asincron integrat, instalează automat binarele browserului și gestionează mai bine aplicațiile web moderne. Problema persistentă a Selenium cu — când ChromeDriver rămâne în urmă față de actualizările Chrome — rămâne o bătaie de cap constantă.

Totuși, Selenium are un ecosistem mai mare de tutoriale și răspunsuri pe StackOverflow — așa că folosește ce îți este mai confortabil.

Configurarea Playwright

1pip install playwright playwright-stealth

2playwright install chromiumNavigarea către Airbnb și extragerea anunțurilor

1import asyncio

2from playwright.async_api import async_playwright

3from playwright_stealth import stealth_async

4import json

5async def scrape_airbnb():

6 async with async_playwright() as p:

7 browser = await p.chromium.launch(headless=False) # headless=True este mai riscant

8 context = await browser.new_context(

9 viewport={"width": 1920, "height": 1080},

10 user_agent="Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/131.0.0.0 Safari/537.36"

11 )

12 page = await context.new_page()

13 await stealth_async(page)

14 url = "https://www.airbnb.com/s/Austin--TX/homes?checkin=2025-08-01&checkout=2025-08-03&adults=2"

15 await page.goto(url, wait_until="networkidle")

16 # Așteaptă apariția cardurilor de anunț folosind data-testid (mai stabil decât clasele)

17 await page.wait_for_selector('[data-testid="card-container"]', timeout=15000)

18 # Extrage datele despre anunțuri

19 listings = await page.query_selector_all('[data-testid="card-container"]')

20 results = []

21 for listing in listings:

22 title_el = await listing.query_selector('[data-testid="listing-card-title"]')

23 subtitle_el = await listing.query_selector('[data-testid="listing-card-subtitle"]')

24 title = await title_el.inner_text() if title_el else None

25 subtitle = await subtitle_el.inner_text() if subtitle_el else None

26 results.append({"title": title, "subtitle": subtitle})

27 await browser.close()

28 return results

29data = asyncio.run(scrape_airbnb())Interceptarea API-ului GraphQL (cea mai fiabilă metodă DIY)

În loc să parsezi elemente DOM care se strică mereu, poți intercepta apelurile interne ale Airbnb către API. Asta returnează JSON curat, structurat:

1api_responses = []

2async def handle_response(response):

3 if "StaysSearch" in response.url:

4 try:

5 data = await response.json()

6 api_responses.append(data)

7 except:

8 pass

9page.on("response", handle_response)

10await page.goto(url, wait_until="networkidle")

11# Parsează răspunsul API

12if api_responses:

13 search_results = api_responses[0]["data"]["presentation"]["staysSearch"]["results"]["searchResults"]

14 for result in search_results:

15 listing = result.get("listing", {})

16 pricing = result.get("pricingQuote", {})

17 print(f"{listing.get('name')} — {pricing.get('price', {}).get('total')}")Răspunsul StaysSearch include id, name, roomTypeCategory, bedrooms, bathrooms, personCapacity, avgRating, reviewsCount, isSuperhost și detalii complete despre prețuri. Aceasta este aceeași dată pe care frontend-ul Airbnb o folosește pentru a reda pagina.

Gestionarea paginării

Airbnb afișează aproximativ 18 anunțuri pe pagină și folosește parametrul URL items_offset. Maximul este de aproximativ 17 pagini (~300 de anunțuri per căutare).

1import time

2import random

3base_url = "https://www.airbnb.com/s/Austin--TX/homes?checkin=2025-08-01&checkout=2025-08-03&adults=2"

4all_results = []

5for page_num in range(17): # Max ~17 pagini

6 offset = page_num * 18

7 paginated_url = f"{base_url}&items_offset={offset}"

8 # ... navighează și extrage datele ca mai sus ...

9 time.sleep(random.uniform(3, 7)) # Pauză aleatorie între paginiCum extragi prețurile Airbnb cu Python (rezolvarea problemei prețurilor dependente de dată)

Aceasta este secțiunea pe care cele mai multe tutoriale o sar — și este cea mai importantă pentru analiza prețurilor.

De ce prețurile Airbnb nu apar fără date

În aproximativ 90% din cazuri, Airbnb cere datele de check-in/check-out înainte să afișeze un preț real. Fără date, obții doar un interval vag de „preț pe noapte” (sau uneori deloc preț). După cum notează : „Dacă un anunț nu afișează un preț (de exemplu, dacă Airbnb vrea să ajustezi datele sau numărul de oaspeți), funcția returnează pur și simplu None.”

Veste bună: din aprilie 2025, Airbnb pentru toți oaspeții din lume. Înainte exista un comutator „Display Total Price” — aproape 17 milioane de oaspeți l-au folosit înainte să devină setarea implicită.

Transmiterea datelor prin parametrii URL

Include mereu checkin și checkout în URL-ul de căutare:

1https://www.airbnb.com/s/Austin--TX/homes?checkin=2025-08-01&checkout=2025-08-03&adults=2Asta determină Airbnb să returneze prețurile reale pe noapte și totale în pagină și în răspunsurile API.

Iterarea pe intervale de date pentru analiza prețurilor

Pentru gazde și investitori care au nevoie de date despre prețuri pe parcursul sezonului:

1from datetime import datetime, timedelta

2start_date = datetime(2025, 7, 1)

3end_date = datetime(2025, 12, 31)

4stay_length = 2 # nopți

5current = start_date

6date_ranges = []

7while current + timedelta(days=stay_length) <= end_date:

8 checkin = current.strftime("%Y-%m-%d")

9 checkout = (current + timedelta(days=stay_length)).strftime("%Y-%m-%d")

10 date_ranges.append((checkin, checkout))

11 current += timedelta(days=7) # Intervale săptămânale

12for checkin, checkout in date_ranges:

13 url = f"https://www.airbnb.com/s/Austin--TX/homes?checkin={checkin}&checkout={checkout}&adults=2"

14 # ... extrage datele despre preț ...

15 time.sleep(random.uniform(5, 10)) # Fii rezonabil cu ritmulCând parsezi prețul din răspunsul API GraphQL, caută obiectul pricingQuote, care conține price.total, price.priceItems (elemente separate, precum taxa de curățenie, taxa de serviciu) și rate.amount (tariful pe noapte).

Cum să faci scraperul Python de Airbnb să reziste redesignurilor site-ului

Aceasta este secțiunea de întreținere pe care nimeni nu vrea s-o scrie — dar este, probabil, cea mai importantă parte a oricărui proiect de scraping Airbnb.

Selectori fragili vs. selectori rezistenți

| Strategie de selectare | Risc de rupere | Efort de cod | Exemplu |

|---|---|---|---|

Nume de clase CSS (de ex. .t1jojoys) | 🔴 Mare — se schimbă frecvent | Redus | soup.select('.t1jojoys') |

Atribute data-testid | 🟡 Mediu — mai stabile | Redus | soup.select('[data-testid="listing-card-title"]') |

| Microdate Schema.org în HTML | 🟢 Mic — standard structural | Mediu | soup.find("meta", itemprop="name") |

| Interceptarea API-ului GraphQL | 🟢 Mic — JSON structurat | Mediu | response.json()["data"]["presentation"] |

| Extracție bazată pe AI (Thunderbit) | 🟢 Zero — se adaptează automat | Niciunul | UI în 2 clickuri, fără cod |

Folosirea atributelor data-testid

Valorile data-testid documentate în prezent pe Airbnb includ card-container, listing-card-title, listing-card-subtitle și listing-card-name. Acestea sunt legate de framework-ul intern de testare al Airbnb, nu de stilul vizual, deci se schimbă mai rar decât clasele CSS. Totuși, se pot schimba — doar mai rar.

1# Mai rezistent decât selectoarele bazate pe clase

2title = await page.query_selector('[data-testid="listing-card-title"]')Folosirea microdatelor Schema.org

Airbnb folosește atribute itemprop direct în markup-ul HTML. Acestea respectă standardele web și se schimbă mult mai rar decât clasele CSS vizuale:

1# Extrage toate elementele de anunț folosind markup-ul schema.org

2listings = soup.find_all("div", itemprop="itemListElement")

3for listing in listings:

4 name = listing.find("meta", itemprop="name")["content"]

5 url = listing.find("meta", itemprop="url")["content"]Interceptarea API-ului GraphQL

Cea mai fiabilă abordare DIY. API-ul intern al Airbnb returnează JSON curat, structurat pentru a fi consumat de frontend. Formatul răspunsului se schimbă mai rar decât DOM-ul, pentru că și echipa frontend depinde de el.

De ce extracția bazată pe AI elimină complet întreținerea

Chiar și cele mai bune strategii de selectare se strică în cele din urmă. Valorile data-testid sunt redenumite. Structurile de răspuns API primesc versiuni noi. Singura abordare care elimină cu adevărat întreținerea este una care citește pagina proaspăt de fiecare dată folosind AI — fără niciun selector hardcodat. Mai multe despre asta în secțiunea Thunderbit de mai jos.

Cum eviți blocarea când faci scraping pe Airbnb

Sfaturi practice din experiență și din consensul comunității.

Rotește proxy-urile (rezidențial este obligatoriu)

IP-urile din datacenter sunt blocate imediat de Airbnb. Proxy-urile rezidențiale sunt necesare la orice scară relevantă. Cei mai buni furnizori după performanță și preț:

| Furnizor | Preț (per GB) | Rată de succes | Observații |

|---|---|---|---|

| Decodo (fost Smartproxy) | ~2,20 USD/GB la 100 GB | 99,68% | Cel mai rapid măsurat (răspuns 0,54s) |

| Bright Data | ~5,04 USD/GB la 100 GB | 99%+ | Cel mai mare pool, cele mai multe funcții |

| Oxylabs | ~4 USD/GB la 100 GB | 99%+ | Bun pentru e-commerce |

O observație importantă de la un dezvoltator cu experiență: „Rotirea IP-ului la fiecare cerere este, de fapt, un semnal de alarmă. Utilizatorii reali păstrează același IP pe durata unei sesiuni.” Recomandarea este să folosești sesiuni sticky de 5–10 minute, cu rotire la fiecare 20–30 de cereri.

1proxies = {

2 "http": "http://user:pass@residential-proxy:port",

3 "https": "http://user:pass@residential-proxy:port",

4}

5response = cffi_requests.get(url, headers=headers, proxies=proxies, impersonate="chrome131")Limitează ritmul cererilor

Consensul comunității asupra pragurilor sigure:

- Maxim pagini pe oră: ≤100 (~1,6/min)

- Pauză între cereri: 3–10 secunde (aleatoriu, preferabil distribuție Gaussiană)

- Pauze de sesiune: La fiecare 20 de cereri, ia o pauză de 30–60 de secunde

- Fereastra optimă de scraping: Orele de vârf reduse (~2 AM, ora locală)

- La erori 429: backoff exponențial cu jitter

1import random

2import time

3delay = random.gauss(5, 1.5) # Medie 5 secunde, deviație standard 1,5

4delay = max(2, min(delay, 10)) # Limitează între 2 și 10 secunde

5time.sleep(delay)Folosește headere complete și coerente

Lipsa headerelor Sec-Fetch-* este o . Fiecare header trebuie să fie coerent intern — dacă User-Agent-ul tău pretinde Chrome 131 pe Windows, toate celelalte headere trebuie să se potrivească acelei identități.

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/131.0.0.0 Safari/537.36",

3 "Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8",

4 "Accept-Language": "en-US,en;q=0.9",

5 "Accept-Encoding": "gzip, deflate, br",

6 "Sec-Fetch-Dest": "document",

7 "Sec-Fetch-Mode": "navigate",

8 "Sec-Fetch-Site": "none",

9 "Sec-Fetch-User": "?1",

10 "Sec-CH-UA": '"Google Chrome";v="131", "Chromium";v="131", "Not_A Brand";v="24"',

11 "Sec-CH-UA-Platform": '"Windows"',

12}Folosește cu grijă browserele headless

Pentru Playwright, pachetul playwright-stealth corectează aproximativ 17 module de evitare (navigator.webdriver, plugins, languages, WebGL). Dar sistemele moderne anti-bot verifică peste 40 de proprietăți, față de aproximativ 12 care sunt patch-uite. Rularea în mod non-headless (headless=False) este mai sigură, dar mai lentă.

Pentru Selenium, undetected-chromedriver modifică binarul ChromeDriver pentru a elimina indicatorii de automatizare, însă modul headless rămâne instabil.

Ia în calcul un API de scraping pentru scară mare

Dacă extragi mii de pagini, un API de scraping se ocupă pentru tine de rotirea proxy-urilor, rezolvarea CAPTCHA și randarea JS. Într-un , Bright Data a obținut o rată de succes de 99% cu 48 de câmpuri per anunț. Compromisul este costul — modul stealth proxy al ScrapingBee consumă , astfel încât un plan de 49 USD/lună produce doar aproximativ 3.333 de cereri stealth.

Extrage date din Airbnb fără Python: alternativa no-code cu Thunderbit

Nu toți cei care fac scraping pe Airbnb sunt dezvoltatori. Gazdele vor comparații de preț. Investitorii vor date de piață. Analiștii vor un spreadsheet. Dacă ai citit secțiunile despre Python și te-ai gândit „asta înseamnă mai multă întreținere decât am vrut”, această secțiune este pentru tine.

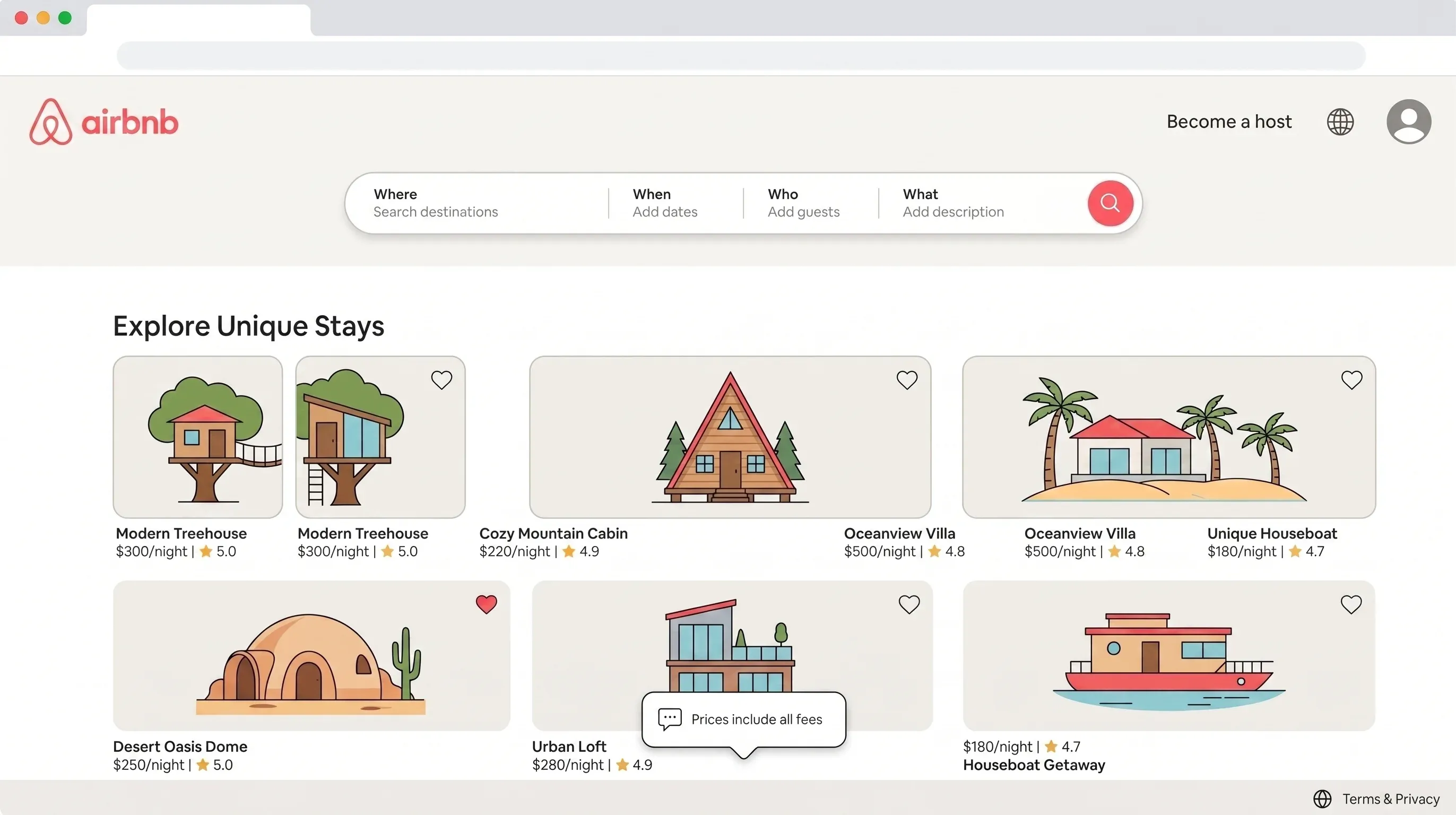

Cum extrage Thunderbit date din Airbnb în câteva clickuri

este un AI web scraper care rulează ca . Iată fluxul:

- Instalezi extensia din Chrome Web Store

- Accesezi o pagină de rezultate Airbnb — include datele în URL pentru prețuri exacte (de ex.

?checkin=2025-08-01&checkout=2025-08-03) - Dai click pe „AI Suggest Fields” — Thunderbit scanează pagina și detectează automat coloane precum numele anunțului, prețul, ratingul, locația și URL-ul

- Dai click pe „Scrape” — datele se completează într-un tabel structurat

- Folosești „Scrape Subpages” pentru a vizita fiecare pagină de detalii a anunțului și a extrage facilități, recenzii, informații despre gazdă și detalii complete despre prețuri — fără nicio configurare suplimentară

- Exporți în Google Sheets, Excel, Airtable sau Notion

Funcția de scraping a subpaginilor contează mult aici. În abordările Python, extragerea paginilor de detalii înseamnă să scrii logică de parsare separată, să gestionezi paginarea din recenzii și să administrezi cereri paralele. Cu Thunderbit, este un singur click.

De ce Thunderbit rezolvă cele mai mari trei probleme ale scrapingului Airbnb

Cele trei probleme descrise mai sus — apărări anti-bot, randarea JavaScript și ruperea DOM-ului — sunt exact motivele pentru care scraper-ele Python au costuri mari de întreținere. Thunderbit le rezolvă pe toate trei:

- Fără griji legate de blocarea IP-ului: modul Cloud Scraping al Thunderbit gestionează intern rotirea proxy-urilor

- Fără rupere de selectoare: AI-ul citește pagina proaspăt de fiecare dată — fără selectori CSS de întreținut, fără cod de actualizat când Airbnb face redesign

- Fără bătăi de cap la configurare: fără drivere Selenium, fără mediu Python, fără conflicte de dependențe

- Scraping programat: descrii intervalul de timp în limbaj natural pentru monitorizarea continuă a prețurilor — excelent pentru cazurile de strategie de prețuri dinamice și urmărirea concurenței

Când să folosești Python și când să folosești Thunderbit

Nu este o alegere de tipul fie/sau — depinde de ce ai nevoie:

| Nevoie | Python | Thunderbit |

|---|---|---|

| Control complet asupra logicii de scraping | ✅ Da | ❌ Nu |

| Funcționează fără abilități de programare | ❌ Nu | ✅ Da |

| Gestionează automat modificările DOM | ❌ Nu | ✅ Da (bazat pe AI) |

| Scraping pe subpagini (paginile de detalii) | Configurare complexă | 1 click |

| Scraping programat / recurent | Cron job personalizat | Scheduler integrat |

| Export în Sheets/Excel/Airtable | Cod manual | Integrat |

| Integrare în pipeline-uri de date | ✅ Da | Limitat |

| Cost la scară mare (10K+ pagini) | Costuri de server + proxy | Prețurile Thunderbit |

Dacă ai nevoie de control la nivel de cod, logică personalizată sau integrare într-un pipeline de date existent, folosește Python. Dacă ai nevoie de date rapid, fără întreținere, Thunderbit este alegerea pragmatică.

Sfaturi legale și etice pentru scraping-ul Airbnb

Păstrăm această secțiune scurtă și practică — nu sunt avocat și asta nu este consultanță juridică.

Ce spune legea (în linii mari):

- Hotărârea a stabilit că scraping-ul datelor publice de pe site-uri care nu necesită autentificare nu încalcă CFAA

- (ianuarie 2024): un judecător a decis că Terms of Service nu sunt obligatorii pentru scraper-ele neautentificate

- Cazul (2025) introduce o teorie nouă conform căreia ocolirea CAPTCHA-urilor și a limitelor de rată poate încălca prevederile DMCA privind anti-circumvention — nu este testată, dar merită urmărită

Ce spune Airbnb: interzic explicit colectarea automată a datelor. Totuși, Airbnb nu a dat niciodată în judecată public un scraper. funcționează de peste 11 ani fără provocări legale, deși Airbnb îl numește „gunoi”.

Ghid practic:

- Extrage doar date disponibile public (nu ocoli ecranele de login)

- Respectă indicațiile din

robots.txt - Nu suprasolicita serverele cu rate agresive de cereri

- Tratează cu atenție datele personale conform GDPR/CCPA

- Pentru utilizare comercială, consultă un consilier juridic

Concluzie și idei-cheie

Scraping-ul Airbnb variază de la „rapid și improvizat” la „nivel de producție”. Idei-cheie:

- Include mereu datele în URL (

checkinșicheckout) — fără ele, datele despre preț sunt inutile - Nu te baza pe nume de clase CSS. Folosește în schimb atribute

data-testid, microdate schema.org sau interceptarea API-ului GraphQL - Proxy-urile rezidențiale sunt obligatorii la scară. IP-urile din datacenter sunt blocate imediat

- Limitează ritmul cererilor — întârzieri aleatorii de 3–10 secunde, sesiuni sticky și backoff exponențial la erori

- Pentru scraping fără întreținere, instrumente bazate pe AI precum elimină complet ruperea selectoarelor — exact problema care face scraper-ele Python costisitoare de întreținut

- Potrivește instrumentul cu proiectul. Cercetare rapidă?

pyairbnb. Analiză de prețuri dinamice? Playwright cu interceptare API. Monitorizare continuă fără cod? Thunderbit. Scară de producție? Un API de scraping.

Pentru a încerca varianta no-code, — îl poți testa pe câteva pagini de căutare Airbnb în aproximativ două minute. Pentru abordarea Python, toate tiparele de cod din acest articol sunt gata să fie adaptate la cazul tău specific.

Pentru mai multe informații despre abordări și instrumente de web scraping, consultă ghidurile noastre despre , și . Poți urmări și tutoriale pe .

Întrebări frecvente

Poate Airbnb să te blocheze pentru scraping?

Da. Airbnb folosește Akamai Bot Manager cu TLS fingerprinting, provocări JavaScript, browser fingerprinting și evaluarea reputației IP-ului. Dacă este detectat, vei primi răspunsuri 403, 429 sau CAPTCHA. Rotirea proxy-urilor, headerele realiste și limitarea ritmului cererilor reduc riscul, dar nu există o metodă garantată de a evita detectarea la volume mari.

Este legal să extragi date din Airbnb?

Extracția datelor disponibile public este, în general, permisă conform jurisprudenței din SUA (hiQ v. LinkedIn, Meta v. Bright Data), dar Termenii de utilizare Airbnb o interzic explicit. Peisajul juridic diferă în funcție de jurisdicție, iar teoria emergentă DMCA anti-circumvention (Reddit v. Perplexity) ar putea afecta scraper-ele care ocolesc măsurile anti-bot. Pentru utilizare comercială, consultă un consilier juridic.

Ce date poți extrage din Airbnb?

Din rezultatele căutării: numele anunțului, prețul (cu date), ratingul, numărul de recenzii, locația, tipul proprietății și URL-ul. Din paginile de detalii: descriere completă, facilități, informații despre gazdă, toate recenziile, fotografii, disponibilitatea în calendar, taxele de curățenie și detalierea prețului. Profunzimea depinde de faptul că extragi doar paginile de căutare sau vizitezi și paginile individuale ale anunțurilor.

Am nevoie de proxy-uri ca să extrag Airbnb cu Python?

Pentru câteva pagini, s-ar putea să reușești fără proxy-uri. Pentru orice depășește 20–30 de cereri, rotirea proxy-urilor rezidențiale este puternic recomandată. IP-urile din datacenter sunt blocate instant. Consensul comunității sugerează un maxim de aproximativ 100 de pagini pe oră de pe un singur IP, cu întârzieri aleatorii de 3–10 secunde între cereri.

Care este cea mai ușoară metodă de a extrage Airbnb fără cod?

îți permite să extragi rezultatele căutării Airbnb și paginile de detalii ale anunțurilor cu detectare de câmpuri bazată pe AI — fără selectori de configurat, fără cod de scris. Gestionează scraping-ul subpaginilor (pentru facilități, recenzii și informații despre gazdă), exportă în Google Sheets, Excel, Airtable sau Notion și oferă scraping programat pentru monitorizarea continuă a prețurilor.

Află mai multe