Angajarea unui dezvoltator de web scraping era, până nu demult, o decizie de nișă—ceva rezervat data scientist-ilor sau, ocazional, unui marketer mai tehnic. În 2025, însă, aproape fiecare echipă de vânzări, operațiuni sau marketing cu care vorbesc caută să angajează dezvoltator web scraping, fie un expert web scraping freelance, fie un specialist în extragerea datelor web. De ce? Pentru că webul e cea mai mare și mai dezordonată bază de date din lume, iar presiunea de a transforma haosul în insight-uri acționabile tot crește. Am văzut pe pielea mea cum angajarea potrivită (sau nepotrivită) poate face un proiect să reușească sau să eșueze—uneori chiar spectaculos.

Piața de web scraping și data extraction e în plină explozie, iar cheltuielile globale sunt estimate să se quadrupleze în următorul deceniu (). Dar, cum site-urile se schimbă constant, protecțiile anti-bot devin tot mai deștepte, iar utilizatorii de business vor date mai curate și mai rapide, alegerea omului potrivit (sau a instrumentului potrivit) e mai importantă ca oricând. Așadar, fie că ești fondator, team lead sau „omul cu datele” care a tras paiul scurt, hai să vedem cum angajează dezvoltator web scraping—și când s-ar putea să nu ai nevoie de unul.

Ce face, de fapt, un dezvoltator de web scraping?

Un dezvoltator de web scraping e puntea dintre „vestul sălbatic” al internetului și foile de calcul frumos aliniate de care echipa chiar are nevoie. Practic, transformă pagini web instabile și dezordonate în seturi de date structurate și de încredere—CSV, JSON sau fluxuri directe către baze de date. Dar nu e doar „scriu repede un script și gata”. Munca adevărată înseamnă să te asiguri că scripturile rămân funcționale când site-urile își schimbă layout-ul, să gestionezi paginarea, subpaginile, blocajele anti-bot și toate ciudățeniile webului modern ().

Responsabilități tipice:

- Analizarea paginilor web ca să aleagă metoda optimă de extragere (scraping HTML, apeluri API, browsere headless)

- Gestionarea conținutului dinamic, randării JavaScript și a fluxurilor de autentificare

- Administrarea paginării și îmbogățirea prin subpagini (de exemplu: extragi o listă de produse, apoi intri pe fiecare pagină de produs pentru detalii)

- Exportul datelor curate, gata de analiză (CSV, JSON, bază de date sau integrare directă)

- Configurarea monitorizării, a reîncercărilor și a alertelor când lucrurile se strică (pentru că se vor strica)

- Documentarea specificațiilor de date, a definițiilor câmpurilor și a programului de actualizare

Experții web scraping freelance sunt chemați des pentru proiecte punctuale, ținte de nișă sau prototipuri rapide. Specialiștii in-house în extragerea datelor web devin esențiali când extragerea datelor e o componentă centrală și continuă a businessului—de exemplu monitorizare zilnică de prețuri, generare de lead-uri sau alimentarea unui dashboard intern ().

Pentru echipele non-tehnice, rolurile astea sunt aur curat: transformă orele de copy-paste manual în fluxuri automatizate, iar analiștii și oamenii de vânzări pot să se concentreze pe ce contează cu adevărat.

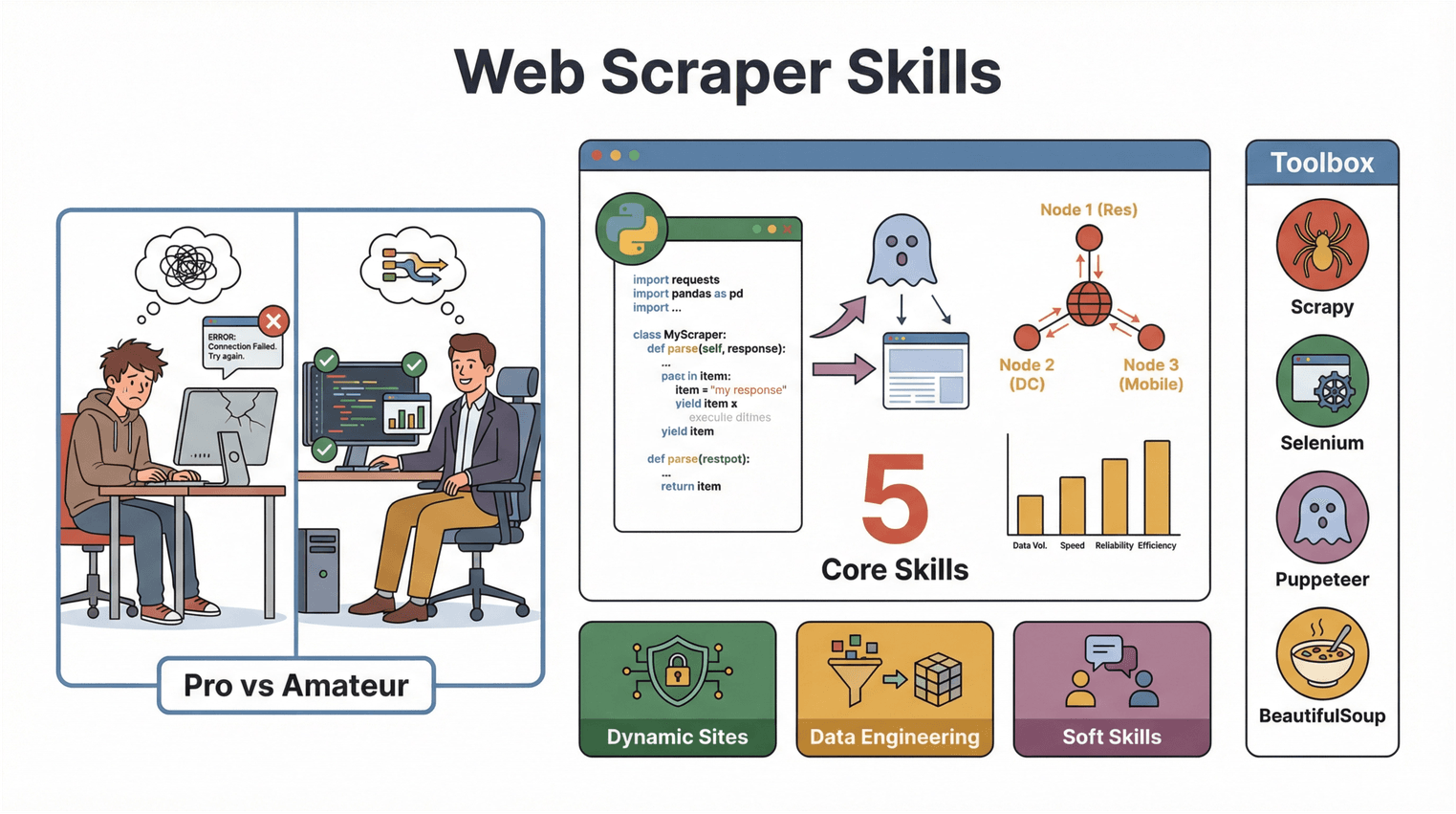

Competențe și experiență esențiale când angajezi un dezvoltator de web scraping

Nu toți „scraperii” sunt făcuți la fel. De-a lungul anilor, am întâlnit dezvoltatori care pot scrie un script într-o după-amiază—dar nu îl pot ține în viață nici măcar o săptămână. Iată ce îi separă pe profesioniști de amatori:

- Abilități avansate de programare: Python e standardul, dar JavaScript, Node.js sau chiar Go apar des. Caută experiență cu librării precum BeautifulSoup, Scrapy, Selenium sau Puppeteer.

- Experiență cu instrumente de web scraping: Familiaritatea atât cu soluții pe cod, cât și cu no-code (precum ) e un mare plus. Cei buni știu când să folosească un tool și când să construiască de la zero.

- Gestionarea site-urilor dinamice și protejate: Site-urile moderne sunt pline de JavaScript și protecții anti-bot. Dezvoltatorul tău ar trebui să fie confortabil cu browsere headless, proxy-uri, CAPTCHA și management de sesiune.

- Mentalitate de data engineering: Nu e doar extragere—curățarea, deduplicarea, validarea și structurarea datelor sunt la fel de importante.

- Soft skills: Comunicare, atenție la detalii și orientare spre rezolvare de probleme. Vrei pe cineva care pune întrebări de clarificare, nu doar pe cineva care zice „da, boss, se face”.

Checklist de competențe tehnice

Iată un checklist rapid pe care îl poți folosi la trierea candidaților:

| Competențe obligatorii | Competențe „nice-to-have” |

|---|---|

| Python (sau JS/Node) | Experiență cu platforme cloud de scraping |

| Parsare HTML/CSS/DOM | Familiaritate cu containerizare (Docker) |

| Gestionarea paginării și a subpaginilor | Configurare monitorizare, logging și alerte |

| Strategii anti-bot (proxy, throttling) | Integrare în pipeline-uri de date (ETL, API-uri) |

| Validare date & QA | Conștientizare compliance și confidențialitate |

| Experiență cu tool-uri precum Thunderbit, Octoparse | Experiență cu extragere asistată de AI |

Un bonus: candidații care pot folosi instrumente precum livrează adesea mai repede și cu mai puțină mentenanță, mai ales pentru sarcini de business uzuale.

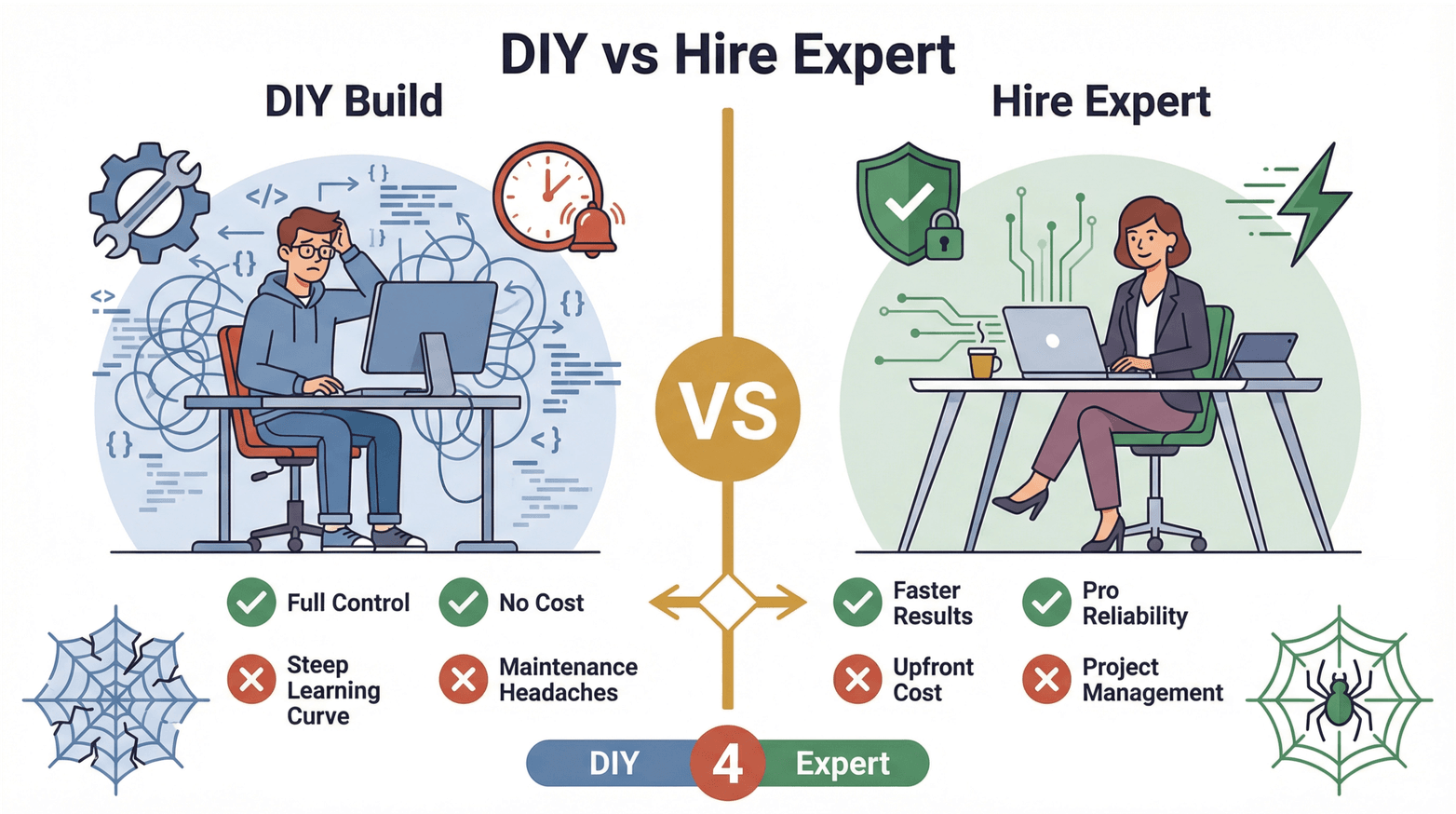

DIY vs. angajarea unui expert în web scraping: comparație de cost și eficiență

Bun, deci: îți sufleci mânecile și îți faci propriul scraper sau aduci un expert web scraping freelance? Hai să le punem cap la cap.

DIY (Do It Yourself):

- Pro: Control total, fără costuri externe, bun pentru învățare.

- Contra: Curba de învățare e abruptă, mănâncă timp, mentenanța e o bătaie de cap, iar complexitatea e ușor de subestimat.

Angajarea unui expert web scraping freelance:

- Pro: Rezultate mai rapide, fiabilitate de nivel profesionist, risc mai mic să „pice” când se schimbă site-urile, acces la expertiză de nișă.

- Contra: Cost inițial, trebuie să gestionezi proiectul, pot apărea goluri de comunicare.

Tabel comparativ de costuri:

| Abordare | Cost tipic | Timp până la livrare | Mentenanță |

|---|---|---|---|

| DIY | Timpul tău (cost de oportunitate) | Zile până la săptămâni (dacă înveți) | Tu gestionezi toate reparațiile |

| Freelance (orar) | $20–$40/oră (upwork.com) | 1–2 săptămâni pentru majoritatea proiectelor | Poți negocia suport continuu |

| Freelance (preț fix) | $500–$5,000+ (upwork.com) | 1–4 săptămâni, în funcție de scop | Mentenanța poate costa extra |

| Angajare in-house | $100k+/an (glassdoor.com) | Continuu | Proprietate completă (și cost complet) |

Când are sens DIY? Dacă ai background tehnic, proiectul e simplu și nu te deranjează să testezi și să iterezi. Pentru orice e critic pentru business, cu volum mare sau cu schimbări frecvente, un specialist își amortizează rapid costul.

Când să alegi un specialist în extragerea datelor web

Ia în calcul angajarea unui specialist în extragerea datelor web când:

- Ai nevoie de scraping pe site-uri complexe, dinamice sau protejate

- Datele sunt critice pentru business sau trebuie reîmprospătate regulat

- Ai nevoie de integrare cu alte sisteme (CRM, baze de date, API-uri)

- Există cerințe de compliance, confidențialitate sau aspecte legale

- Vrei să eviți durerea mentenanței și a depanării continue

Pentru extrageri rapide, punctuale sau pentru liste simple, un instrument precum poate fi suficient.

Unde găsești și cum angajezi dezvoltatori de web scraping și experți freelance

Nu ducem lipsă de locuri unde poți găsi talent în web scraping, dar fiecare platformă vine cu „regulile” ei.

- : Cel mai mare bazin, de la juniori la profesioniști cu experiență. Poți lucra pe oră sau la preț fix și poți folosi milestone-uri ca să ții riscul sub control.

- : Bun pentru proiecte sensibile la preț, cu livrabile clare. Folosește plăți pe milestone ca să te asiguri că se vede progresul.

- : Talent premium, pre-verificat. Ideal dacă vrei să externalizezi selecția și accepți un cost mai mare.

- Fiverr: Potrivit pentru sarcini mici, bine definite („gigs”). Fii atent la proiecte complexe sau de durată.

Sfaturi pentru filtrarea candidaților:

- Caută profiluri cu experiență specifică în web scraping (nu doar „Python developer”)

- Verifică experiența relevantă pe industrie (ex.: ecommerce, imobiliare, lead-uri B2B)

- Cere portofolii și exemple de proiecte sau fragmente de cod

- Citește atent recenziile și ratingurile

Sfaturi pentru selecție și interviu

Nu te baza doar pe promisiuni. Așa îmi place mie să evaluez candidații:

Întrebări cheie:

- Îmi poți descrie un proiect recent de web scraping livrat? Care au fost provocările?

- Cum abordezi site-urile care folosesc JavaScript sau au protecții anti-bot?

- Care este procesul tău pentru a asigura calitatea și fiabilitatea datelor?

- Cum îți documentezi munca pentru predare sau mentenanță ulterioară?

- Care este checklist-ul tău de compliance înainte să începi un proiect nou?

Teste practice:

- Oferă un site exemplu cu structură listă + pagină de detaliu. Cere un CSV cu date îmbogățite.

- Cere un scurt „contract de date” (definiții de câmp, obligatoriu/opțional, program de refresh) înainte să înceapă să codeze.

- Cere un demo scurt pentru extragerea unui tabel încărcat puternic cu JavaScript.

Cum reduce Thunderbit dependența de dezvoltatori de web scraping

Un mic secret: majoritatea utilizatorilor de business nu au nevoie de un scraper custom pentru fiecare proiect. Instrumente precum au schimbat jocul pentru echipele non-tehnice.

Thunderbit este o care îți permite să extragi date structurate din aproape orice site în doar câteva clickuri. Spui ce vrei, apeși „AI Suggest Fields”, iar AI-ul Thunderbit se ocupă de restul. Include și scraping pe subpagini, paginare și export direct în Excel, Google Sheets, Airtable sau Notion.

De ce contează asta pentru angajare? Pentru că Thunderbit reduce numărul proiectelor care chiar necesită un dezvoltator. Pentru echipe de vânzări, ecommerce și research, de multe ori e mai rapid (și mai ieftin) să folosești Thunderbit pentru extrageri de rutină, liste de lead-uri sau monitorizare de prețuri. Păstrează ingineria „grea” pentru cazurile cu adevărat complicate.

Thunderbit vs. abordările tradiționale de web scraping

Să comparăm fluxul de lucru Thunderbit cu angajarea unui expert web scraping freelance:

| Factor | Thunderbit | Expert freelance |

|---|---|---|

| Timp de setare | Minute (fără cod) | Zile până la săptămâni |

| Cost | Plan gratuit, apoi $15–$249/lună (Thunderbit Pricing) | $500–$5,000+ per proiect |

| Mentenanță | AI se adaptează la schimbările site-ului | Necesită actualizări manuale |

| Opțiuni de export | Excel, Sheets, Airtable, Notion, CSV, JSON | Variază (adesea CSV/JSON) |

| Subpagini/Paginare | Integrat, în 2 clickuri | Necesită cod custom |

| Cel mai potrivit pentru | Sarcini rapide, frecvente, ușoare | Cazuri complexe, volum mare, integrări custom |

Când merită totuși să angajezi un dezvoltator? Pentru pipeline-uri critice, „ținte dificile” (site-uri cu login sau protecții puternice) ori când ai nevoie de integrări și monitorizare personalizate.

Cum gestionezi proiecte de web scraping externalizate cu succes

Angajarea persoanei potrivite e doar începutul. Managementul bun al proiectului e ceea ce ține lucrurile pe șine (și te scapă de momentele „unde sunt datele?”).

Bune practici:

- Definește din start un „contract de date” clar: Enumeră câmpurile necesare, tipurile de date, frecvența de actualizare și criteriile de acceptare ().

- Folosește milestone-uri și escrow: Împarte proiectul în etape (set de date eșantion, rulare completă, rulare programată, monitorizare) și eliberează plata doar după livrarea fiecărei etape ().

- Pune porți de QA: Asigură-te că datele sunt deduplicate, validate și potrivite pentru cazul tău de utilizare.

- Planifică mentenanța: Scraper-ele se strică. Dacă datele sunt critice, agreați un retainer sau un plan de mentenanță.

- Documentează tot: Cere un README, un runbook și moduri de eșec cunoscute. Documentația bună te ferește de surprize costisitoare.

Sfaturi de comunicare și colaborare

- Check-in-uri regulate: Update-uri săptămânale sau demo-uri mențin alinierea.

- Instrumente comune de project management: Folosește Trello, Asana sau Google Docs pentru progres și feedback.

- Căi clare de escaladare: Stabiliți din timp cum se gestionează blocajele sau problemele.

- Încurajează întrebările: Cei mai buni freelanceri cer clarificări devreme și des.

Aspecte legale, etice și de compliance când angajezi un dezvoltator de web scraping

Web scraping-ul nu mai e „vestul sălbatic” ca pe vremuri. Există implicații legale și etice reale—mai ales în jurul datelor personale, termenilor de utilizare și protecțiilor anti-bot.

Puncte cheie:

- Date publice ≠ fără reguli: Chiar și extragerea datelor publice poate avea riscuri legale, mai ales dacă ocolești bariere tehnice sau ignori termenii de utilizare ().

- Legile de confidențialitate contează: GDPR, CCPA și alte reglementări cer justificarea colectării, minimizarea impactului și respectarea opțiunilor de opt-out ().

- Checklist de compliance: Limitează scraping-ul la site-uri și tipuri de date aprobate, evită date sensibile/personale dacă nu e permis explicit, documentează procesul și folosește gestionarea sigură a credențialelor ().

- Transparență: Spune-i clar dezvoltatorului cerințele de compliance și include-le în statement of work.

Instrumente precum Thunderbit ajută prin focus pe date publice relevante pentru business și prin faptul că fac mai ușoară documentarea a ceea ce colectezi și de ce.

Ghid pas cu pas: cum angajezi un dezvoltator de web scraping

Gata să începi? Iată un proces simplu și aplicabil:

- Definește nevoile: Ce date îți trebuie? De pe ce site-uri? Cât de des? În ce format?

- Redactează un „contract de date”: Listează câmpurile, tipurile de date, frecvența de refresh și criteriile de acceptare.

- Alege platforma de angajare: Upwork, Freelancer, Toptal sau Fiverr—în funcție de buget, termen și nivelul de verificare dorit.

- Publică proiectul: Fii specific despre livrabile, termene și cerințe de compliance.

- Evaluează candidații: Folosește checklist-ul și întrebările de mai sus. Cere exemple sau un test mic plătit.

- Negociază milestone-uri: Împarte proiectul în etape logice cu rezultate clare.

- Gestionează proiectul: Check-in-uri regulate, porți de QA și instrumente comune pentru urmărirea progresului.

- Planifică mentenanța: Stabiliți cum se vor gestiona update-urile, fix-urile și schimbările.

- Documentează tot: Cere README, runbook și un proces clar de predare.

Și nu uita: pentru multe sarcini de rutină, s-ar putea să nu fie nevoie să angajezi deloc—încearcă mai întâi și vezi dacă îți acoperă nevoile.

Concluzie și idei principale

Angajarea unui dezvoltator de web scraping nu mai e doar pentru giganții tech—e o necesitate pentru orice echipă care vrea să transforme datele de pe web în valoare de business. Dar, cu piața de web scraping și data extraction crescând cu peste , miza (și complexitatea) sunt mai mari ca oricând.

Ce contează cel mai mult:

- Caută dezvoltatori cu abilități solide de programare, experiență reală de scraping și mentalitate de data engineering.

- Folosește platforme precum Upwork, Freelancer și Toptal pentru a găsi și valida talent—dar gestionează proiectul cu contracte clare, milestone-uri și porți de QA.

- Pentru sarcini de rutină, cu livrare rapidă, instrumente precum îți economisesc timp, bani și bătăi de cap—fără cod.

- Ține mereu în prim-plan compliance-ul, confidențialitatea și documentația.

- Cele mai bune rezultate vin din așteptări clare, comunicare constantă și flexibilitate, pe măsură ce site-urile (inevitabil) se schimbă.

Înainte să angajezi, întreabă-te: e o nevoie punctuală, recurentă sau un pipeline critic pentru business? Uneori, cea mai inteligentă mișcare e să-ți echipezi echipa cu instrumente ușor de folosit—și să păstrezi „munca grea” pentru când chiar ai nevoie.

Vrei să vezi cât poți face fără să angajezi un dezvoltator? și testeaz-o. Iar dacă vrei mai multe sfaturi despre web scraping, automatizare de date sau construirea unui data stack modern, aruncă un ochi pe .

Întrebări frecvente (FAQs)

1. Care este diferența dintre un expert web scraping freelance și un specialist in-house în extragerea datelor web?

Un expert freelance este, de regulă, angajat pentru proiecte specifice, pe termen scurt sau pentru ținte de nișă, în timp ce un specialist in-house gestionează pipeline-uri și integrări continue, critice pentru business.

2. Cât costă să angajezi un dezvoltator de web scraping?

Freelancerii cer de obicei $20–$40 pe oră sau $500–$5,000+ per proiect, în funcție de complexitate. Rolurile in-house pot depăși $100k/an. Instrumente precum Thunderbit au abonamente care pornesc de la $15/lună.

3. Ce competențe ar trebui să caut când angajez un dezvoltator de web scraping?

Caută abilități solide de programare (Python, JS), experiență cu site-uri dinamice și strategii anti-bot, know-how de data engineering și familiaritate atât cu soluții pe cod, cât și cu no-code precum Thunderbit.

4. Când ar trebui să folosesc un instrument precum Thunderbit în loc să angajez un dezvoltator?

Thunderbit este ideal pentru extrageri rapide, frecvente sau punctuale, generare de lead-uri ori monitorizare de prețuri—mai ales când ai nevoie de exporturi structurate și setare minimă. Angajează un dezvoltator pentru proiecte complexe, critice sau foarte personalizate.

5. Ce probleme legale sau de compliance ar trebui să iau în calcul când angajez pentru web scraping?

Respectă întotdeauna termenii de utilizare ai site-urilor, legile de confidențialitate (precum GDPR/CCPA) și evită colectarea datelor sensibile sau personale fără permisiune explicită. Documentează procesul și asigură-te că dezvoltatorul urmează bune practici de compliance.

Vrei ca următorul tău proiect de date să iasă bine? Începe cu planul potrivit, oamenii potriviți și instrumentele potrivite—și vei fi surprins cât de mult poți realiza.

Află mai multe