Să fim sinceri — Amazon e, practic, mallul, supermarketul și magazinul de electronice al internetului. Dacă lucrezi în sales, e-commerce sau operations, știi deja că ce se întâmplă pe Amazon nu rămâne doar pe Amazon: îți influențează prețurile, stocurile și chiar următorul lansament important de produs. Dar iată problema: toate detaliile acelea valoroase despre produse, prețuri, evaluări și recenzii sunt blocate în spatele unei interfețe web gândite pentru cumpărători, nu pentru echipele care au nevoie de date. Așadar, cum pui mâna pe ele fără să-ți petreci weekendurile dând copy-paste ca în 1999?

Aici intră în scenă web scrapingul. În acest ghid, îți voi arăta două moduri de a extrage date despre produsele Amazon: abordarea clasică, „îți sufleci mânecile și scrii cod în Python”, și varianta modernă, „lasă AI să facă munca grea”, cu un web scraper no code precum . Vom trece prin cod Python real (cu toate capcanele și soluțiile de ocolire), apoi îți voi arăta cum Thunderbit poate scoate aceleași date în doar câteva clicuri — fără cod. Fie că ești developer, business analyst sau doar cineva sătul de introducerea manuală a datelor, am ceva pentru tine.

De ce să extragi date despre produsele Amazon? (amazon scraper python, web scraping with python)

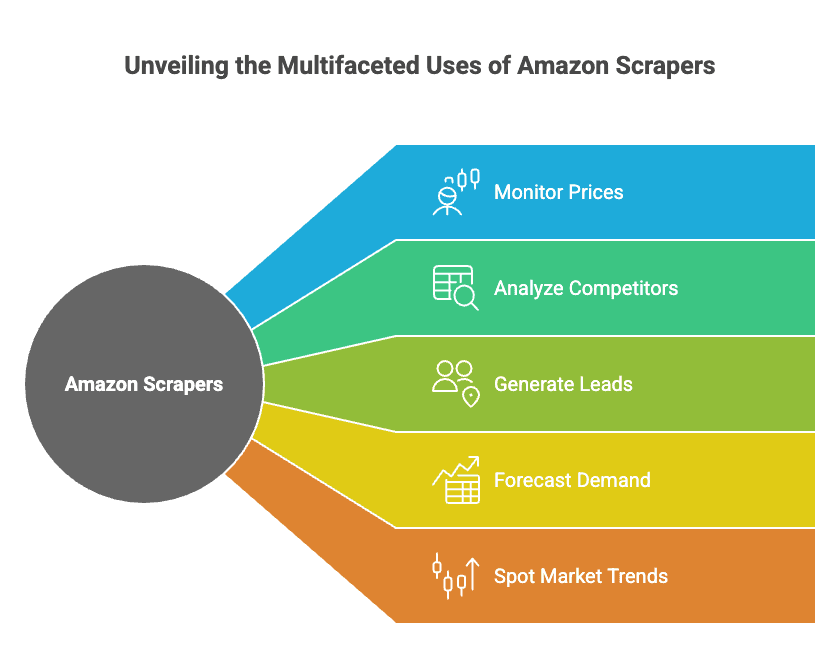

Amazon nu este doar cel mai mare retailer online din lume — este și cea mai mare piață la vedere pentru competitive intelligence. Cu și , Amazon e o mină de aur pentru oricine vrea să:

- Monitorizeze prețurile (și să le ajusteze în timp real)

- Analizeze concurența (urmărind lansările noi, ratingurile și recenziile)

- Genereze leaduri (găsind selleri, furnizori sau chiar potențiali parteneri)

- Previzioneze cererea (urmărind nivelurile de stoc și rankurile de vânzare)

- Identifice tendințe de piață (analizând recenziile și rezultatele din căutare)

Și nu e doar teorie — firme reale obțin rezultate reale. De exemplu, un retailer de electronice a folosit datele de preț extrase de pe Amazon pentru a , iar un alt brand a înregistrat după automatizarea urmăririi prețurilor concurenței.

Iată un tabel rapid cu exemple de utilizare și tipul de ROI la care te poți aștepta:

| Caz de utilizare | Cine îl folosește | ROI / beneficiu tipic |

|---|---|---|

| Monitorizare prețuri | E-commerce, operațiuni | creștere a marjei de profit cu peste 15%, vânzări cu 4% mai mari, cu 30% mai puțin timp pentru analiști |

| Analiza concurenței | Vânzări, produs, operațiuni | ajustări de preț mai rapide, competitivitate îmbunătățită |

| Cercetare de piață (recenzii) | Produs, marketing | iterare mai rapidă a produsului, copy publicitar mai bun, insighturi SEO |

| Generare de leaduri | Vânzări | peste 3.000 de leaduri/lună, peste 8 ore economisite pe reprezentant pe săptămână |

| Inventar și prognoza cererii | Operațiuni, supply chain | reducere cu 20% a suprastocării, mai puține rupturi de stoc |

| Identificarea tendințelor | Marketing, executivi | detectarea timpurie a produselor și categoriilor în trend |

Și iată partea și mai interesantă: raportează acum valoare măsurabilă din analiza datelor. Dacă nu faci scraping pe Amazon, lași insighturi — și bani — pe masă.

Privire de ansamblu: Amazon Scraper Python vs. no code web scraper tools

Există două modalități principale de a scoate datele Amazon din browser și de a le aduce în spreadsheeturile sau dashboardurile tale:

-

Amazon Scraper Python (web scraping with python):

Scrii propriul script folosind biblioteci Python precum Requests și BeautifulSoup. Asta îți oferă control total, dar trebuie să știi să scrii cod, să gestionezi măsuri anti-bot și să-ți întreții scriptul pe măsură ce Amazon își schimbă site-ul.

-

No code web scraper tools (precum Thunderbit):

Folosești un tool care îți permite să dai click, să alegi și să extragi date — fără programare. Instrumente moderne precum folosesc chiar AI pentru a înțelege ce date trebuie preluate, pentru a gestiona subpage-urile și paginarea și pentru a exporta direct în Excel sau Google Sheets.

Iată cum se compară:

| Criteriu | Python Scraper | No Code (Thunderbit) |

|---|---|---|

| Timp de configurare | Ridicat (instalare, cod, depanare) | Redus (instalezi extensia) |

| Competențe necesare | E nevoie de programare | Niciuna (point & click) |

| Flexibilitate | Nelimitată | Ridicată pentru cazurile obișnuite |

| Mentenanță | Tu repari codul | Toolul se actualizează singur |

| Gestionarea anti-bot | Tu gestionezi proxy-uri, headere | Integrată, gestionată pentru tine |

| Scalabilitate | Manuală (thread-uri, proxy-uri) | Cloud scraping, paralelizat |

| Export de date | Personalizat (CSV, Excel, DB) | Un click în Excel, Sheets |

| Cost | Gratuit (timpul tău + proxy-uri) | Freemium, plătești pentru scară |

În secțiunile următoare, te voi ghida prin ambele abordări — mai întâi, cum să construiești un Amazon scraper în Python (cu cod real), apoi cum să faci același lucru cu AI web scraper-ul Thunderbit.

Cum începi cu Amazon Scraper Python: prerechizite și configurare

Înainte să intrăm în cod, hai să-ți pregătim mediul.

Vei avea nevoie de:

- Python 3.x (descarcă de pe )

- Un editor de cod (îmi place VS Code, dar merge orice)

- Următoarele biblioteci:

requests(pentru cereri HTTP)beautifulsoup4(pentru parsarea HTML)lxml(parser HTML rapid)pandas(pentru tabele de date/export)re(expresii regulate, încorporat)

Instalarea bibliotecilor:

1pip install requests beautifulsoup4 lxml pandasConfigurarea proiectului:

- Creează un folder nou pentru proiect.

- Deschide editorul, creează un fișier Python nou (de ex.

amazon_scraper.py). - Ești gata de pornire!

Pas cu pas: web scraping cu Python pentru datele produselor Amazon

Hai să vedem cum faci scraping pe o singură pagină de produs Amazon. (Nu-ți face griji, ajungem imediat și la scraping pentru mai multe produse și pagini.)

1. Trimiterea cererilor și preluarea HTML-ului

Mai întâi, să luăm HTML-ul unei pagini de produs. (Înlocuiește URL-ul cu orice produs Amazon.)

1import requests

2url = "<https://www.amazon.com/dp/B0ExampleASIN>"

3response = requests.get(url)

4html_content = response.text

5print(response.status_code)Atenție: această cerere de bază are mari șanse să fie blocată de Amazon. Poți vedea un error 503 sau un CAPTCHA în locul paginii de produs. De ce? Pentru că Amazon știe că nu ești un browser real.

Cum gestionezi măsurile anti-bot ale Amazon

Amazon nu e fan al boturilor. Ca să eviți blocarea, trebuie să:

- Setezi un header User-Agent (prefă-te că ești Chrome sau Firefox)

- Rotești User-Agent-urile (nu folosi același string de fiecare dată)

- Încetinești cererile (adaugă întârzieri aleatorii)

- Folosești proxy-uri (pentru scraping la scară mare)

Iată cum setezi headerele:

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64)... Safari/537.36",

3 "Accept-Language": "en-US,en;q=0.9",

4}

5response = requests.get(url, headers=headers)Vrei ceva mai avansat? Folosește o listă de User-Agent-uri și rotește-le la fiecare cerere. Pentru proiecte mari, vei vrea un serviciu de proxy (sunt destule), dar pentru scraping la scară mică, headerele și întârzierile sunt de obicei suficiente.

Extragerea câmpurilor cheie ale produsului

După ce ai HTML-ul, e timpul să-l parsezi cu BeautifulSoup.

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html_content, "lxml")Acum, hai să extragem lucrurile importante:

Titlul produsului

1title_elem = soup.find(id="productTitle")

2product_title = title_elem.get_text(strip=True) if title_elem else NonePrețul

Prețul pe Amazon poate apărea în câteva locuri. Încearcă aceste opțiuni:

1price = None

2price_elem = soup.find(id="priceblock_ourprice") or soup.find(id="priceblock_dealprice")

3if price_elem:

4 price = price_elem.get_text(strip=True)

5else:

6 price_whole = soup.find("span", {"class": "a-price-whole"})

7 price_frac = soup.find("span", {"class": "a-price-fraction"})

8 if price_whole and price_frac:

9 price = price_whole.text + price_frac.textRatingul și numărul de recenzii

1rating_elem = soup.find("span", {"class": "a-icon-alt"})

2rating = rating_elem.get_text(strip=True) if rating_elem else None

3review_count_elem = soup.find(id="acrCustomerReviewText")

4reviews_text = review_count_elem.get_text(strip=True) if review_count_elem else ""

5reviews_count = reviews_text.split()[0] # de ex. „1,554 ratings”URL-ul imaginii principale

Amazon uneori ascunde imaginile la rezoluție mare în JSON-ul din HTML. Iată o soluție rapidă cu regex:

1import re

2match = re.search(r'"hiRes":"(https://.*?.jpg)"', html_content)

3main_image_url = match.group(1) if match else NoneSau poți lua direct tagul imaginii principale:

1img_tag = soup.find("img", {"id": "landingImage"})

2img_url = img_tag['src'] if img_tag else NoneDetalii despre produs

Specificații precum brandul, greutatea și dimensiunile sunt de obicei într-un tabel:

1details = {}

2rows = soup.select("#productDetails_techSpec_section_1 tr")

3for row in rows:

4 header = row.find("th").get_text(strip=True)

5 value = row.find("td").get_text(strip=True)

6 details[header] = valueSau, dacă Amazon folosește formatul „detailBullets”:

1bullets = soup.select("#detailBullets_feature_div li")

2for li in bullets:

3 txt = li.get_text(" ", strip=True)

4 if ":" in txt:

5 key, val = txt.split(":", 1)

6 details[key.strip()] = val.strip()Afișează rezultatele:

1print("Titlu:", product_title)

2print("Preț:", price)

3print("Rating:", rating, "pe baza a", reviews_count, "recenzii")

4print("URL imagine principală:", main_image_url)

5print("Detalii:", details)Scraping pentru mai multe produse și gestionarea paginării

Un produs e bine, dar probabil vrei o listă întreagă. Iată cum faci scraping pe rezultatele căutării și pe mai multe pagini.

Obținerea linkurilor produselor dintr-o pagină de căutare

1search_url = "<https://www.amazon.com/s?k=bluetooth+headphones>"

2res = requests.get(search_url, headers=headers)

3soup = BeautifulSoup(res.text, "lxml")

4product_links = []

5for a in soup.select("h2 a.a-link-normal"):

6 href = a['href']

7 full_url = "<https://www.amazon.com>" + href

8 product_links.append(full_url)Gestionarea paginării

URL-urile de căutare Amazon folosesc &page=2, &page=3 etc.

1for page in range(1, 6): # extrage primele 5 pagini

2 search_url = f"<https://www.amazon.com/s?k=bluetooth+headphones&page={page}>"

3 res = requests.get(search_url, headers=headers)

4 if res.status_code != 200:

5 break

6 soup = BeautifulSoup(res.text, "lxml")

7 # ... extrage linkurile produselor ca mai sus ...Parcurgerea paginilor de produs și exportul în CSV

Adună datele produselor într-o listă de dicționare, apoi folosește pandas:

1import pandas as pd

2df = pd.DataFrame(product_data_list) # listă de dict-uri

3df.to_csv("amazon_products.csv", index=False)Sau în Excel:

1df.to_excel("amazon_products.xlsx", index=False)Best practices pentru proiectele Amazon Scraper Python

Să fim realiști — Amazon își schimbă constant site-ul și se luptă cu scrapers. Iată cum îți menții proiectul funcțional:

- Rotește headerele și User-Agent-urile (folosește o bibliotecă precum

fake-useragent) - Folosește proxy-uri pentru scraping la scară mare

- Încetinește cererile (random

time.sleep()între cereri) - Gestionează elegant erorile (reîncearcă la 503, fă back off dacă ești blocat)

- Scrie logică de parsare flexibilă (caută mai mulți selectori pentru fiecare câmp)

- Monitorizează schimbările HTML (dacă scriptul începe brusc să returneze

Nonepentru tot, verifică pagina) - Respectă robots.txt (Amazon interzice scrapingul în multe secțiuni — fă scraping responsabil)

- Curăță datele pe parcurs (elimină simbolurile monetare, virgulele, spațiile albe)

- Rămâi conectat la comunitate (forumuri, Stack Overflow, Reddit r/webscraping)

Checklist pentru întreținerea scraperului tău:

- [ ] Rotește User-Agent-urile și headerele

- [ ] Folosește proxy-uri dacă faci scraping la scară mare

- [ ] Adaugă întârzieri aleatorii

- [ ] Modularizează codul pentru actualizări ușoare

- [ ] Monitorizează banările sau CAPTCHA-urile

- [ ] Exportă datele regulat

- [ ] Documentează selectorii și logica

Pentru o analiză mai profundă, consultă .

Alternativa no code: scraping Amazon cu Thunderbit AI Web Scraper

Bine, deci ai văzut varianta Python. Dar dacă nu vrei să scrii cod — sau pur și simplu vrei să obții datele în două clicuri și să mergi mai departe cu viața ta? Aici intră .

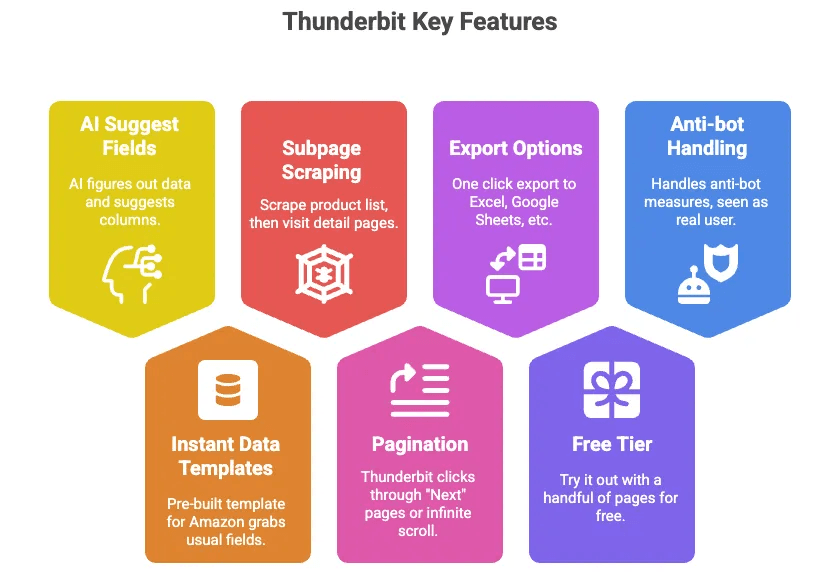

Thunderbit este o extensie Chrome AI web scraper care îți permite să extragi date despre produsele Amazon (și date de pe aproape orice site) fără să scrii cod. Iată de ce îmi place:

- AI Suggest Fields: apasă pur și simplu pe un buton, iar AI-ul Thunderbit își dă seama ce date există pe pagină și îți sugerează coloane (precum Titlu, Preț, Rating etc.).

- Instant Data Templates: pentru Amazon există un template predefinit care extrage toate câmpurile obișnuite — fără configurare.

- Subpage Scraping: extrage o listă de produse, apoi lasă Thunderbit să viziteze fiecare pagină de detalii a produsului și să scoată automat mai multe informații.

- Pagination: Thunderbit poate da click automat prin paginile „Next” sau prin infinite scroll.

- Export în Excel, Google Sheets, Airtable, Notion: un singur click și datele sunt gata de folosit.

- Free Tier: îl poți testa gratuit pe câteva pagini.

- Gestionează pentru tine partea anti-bot: pentru că rulează în browserul tău (sau în cloud), Amazon îl vede ca pe un utilizator real.

Pas cu pas: folosind Thunderbit pentru a extrage datele produselor Amazon

Iată cât de simplu e:

-

Instalează Thunderbit:

Descarcă și autentifică-te.

-

Deschide Amazon:

Mergi la pagina Amazon pe care vrei să o extragi (rezultate de căutare, pagină de produs, orice).

-

Apasă „AI Suggest Fields” sau folosește un template:

Thunderbit va sugera coloane de extras (sau poți alege template-ul Amazon Product).

-

Revizuiește coloanele:

Ajustează coloanele dacă vrei (adaugă/elimină câmpuri, redenumește etc.).

-

Apasă „Scrape”:

Thunderbit preia datele din pagină și le afișează într-un tabel.

-

Gestionează subpage-urile și paginarea:

Dacă ai extras o listă, apasă „Scrape Subpages” pentru a vizita fiecare pagină de detalii și a extrage mai multe informații. Thunderbit poate, de asemenea, să dea click automat prin paginile „Next”.

-

Exportă datele:

Apasă „Export to Excel” sau „Export to Google Sheets”. Gata.

-

(Opțional) Programează scrapingul:

Ai nevoie de aceste date în fiecare zi? Folosește schedulerul Thunderbit ca să automatizezi procesul.

Asta e tot. Fără cod, fără debugging, fără proxy-uri, fără bătăi de cap. Pentru o demonstrație vizuală, vezi sau .

Amazon Scraper Python vs. no code web scraper: comparație side-by-side

Hai să punem totul cap la cap:

| Criteriu | Python Scraper | Thunderbit (No Code) |

|---|---|---|

| Timp de configurare | Ridicat (instalare, cod, depanare) | Redus (instalezi extensia) |

| Competențe necesare | E nevoie de programare | Niciuna (point & click) |

| Flexibilitate | Nelimitată | Ridicată pentru cazurile obișnuite |

| Mentenanță | Tu repari codul | Toolul se actualizează singur |

| Gestionarea anti-bot | Tu gestionezi proxy-uri, headere | Integrată, gestionată pentru tine |

| Scalabilitate | Manuală (thread-uri, proxy-uri) | Cloud scraping, paralelizat |

| Export de date | Personalizat (CSV, Excel, DB) | Un click în Excel, Sheets |

| Cost | Gratuit (timpul tău + proxy-uri) | Freemium, plătești pentru scară |

| Cel mai potrivit pentru | Developeri, nevoi personalizate | Utilizatori business, rezultate rapide |

Dacă ești un developer care adoră să experimenteze și are nevoie de ceva super personalizat, Python este prietenul tău. Dacă vrei viteză, simplitate și zero cod, Thunderbit este calea de urmat.

Când să alegi Python, no code sau AI web scraper pentru datele Amazon

Alege Python dacă:

- Ai nevoie de logică personalizată sau vrei să integrezi scrapingul în sistemele tale backend

- Faci scraping la scară foarte mare (zeci de mii de produse)

- Vrei să înveți cum funcționează scrapingul „pe dedesubt”

Alege Thunderbit (no code, AI web scraper) dacă:

- Vrei date rapid, fără să scrii cod

- Ești utilizator business, analyst sau marketer

- Vrei ca echipa ta să poată obține singură datele

- Vrei să eviți complicațiile cu proxy-uri, măsuri anti-bot și mentenanță

Folosește-le pe amândouă dacă:

- Vrei să faci rapid un prototip cu Thunderbit, apoi să construiești o soluție Python personalizată pentru producție

- Vrei să folosești Thunderbit pentru colectarea datelor și Python pentru curățare/analiză

Pentru majoritatea utilizatorilor business, Thunderbit va acoperi 90% din nevoile de Amazon scraping într-o fracțiune din timp. Pentru ceilalți 10% — lucrurile super personalizate, la scară mare sau profund integrate — Python rămâne regele.

Concluzie și idei-cheie

Extracția datelor despre produsele Amazon este o superputere pentru orice echipă de sales, e-commerce sau operations. Fie că urmărești prețurile, analizezi concurența sau pur și simplu încerci să-ți scapi echipa de copy-paste-ul nesfârșit, există o soluție pentru tine.

- Scrapingul în Python îți oferă control total, dar vine cu o curbă de învățare și mentenanță continuă.

- Web scrapers no code precum Thunderbit fac extragerea datelor Amazon accesibilă tuturor — fără cod, fără bătăi de cap, doar rezultate.

- Cea mai bună abordare? Folosește instrumentul care se potrivește cu abilitățile, calendarul și obiectivele tale de business.

Dacă ești curios, încearcă Thunderbit — e gratuit pentru început și vei fi uimit cât de repede poți obține datele de care ai nevoie. Iar dacă ești developer, nu-ți fie teamă să combini abordările: uneori, cel mai rapid mod de a construi este să lași AI-ul să facă părțile plictisitoare pentru tine.

Întrebări frecvente

1. De ce ar vrea o companie să extragă date despre produsele Amazon?

Extracția datelor de pe Amazon le permite companiilor să monitorizeze prețurile, să analizeze concurența, să colecteze recenzii pentru cercetarea de produs, să previzioneze cererea și să genereze leaduri de vânzări. Cu peste 600 de milioane de produse și aproape 2 milioane de selleri pe Amazon, este o sursă bogată de competitive intelligence.

2. Care sunt principalele diferențe dintre folosirea Python și a instrumentelor no code precum Thunderbit pentru scraping pe Amazon?

Scraper-ele Python oferă flexibilitate maximă, dar cer abilități de programare, timp de configurare și mentenanță continuă. Thunderbit, un AI web scraper no code, le permite utilizatorilor să extragă instant date de pe Amazon printr-o extensie Chrome — fără cod, cu gestionare anti-bot integrată și opțiuni de export în Excel sau Sheets.

3. Este legal să extragi date de pe Amazon?

Termenii de utilizare Amazon interzic, în general, scrapingul, iar compania implementează activ măsuri anti-bot. Totuși, multe companii extrag în continuare date public disponibile, asigurându-se că operează responsabil, de exemplu respectând rate limits și evitând cererile excesive.

4. Ce tip de date pot extrage din Amazon cu instrumente de web scraping?

Câmpurile comune includ titluri de produse, prețuri, ratinguri, număr de recenzii, imagini, specificații de produs, disponibilitate și chiar informații despre seller. Thunderbit suportă și scraping pe subpage-uri și paginare, pentru a captura date din mai multe listări și pagini.

5. Când ar trebui să aleg scrapingul în Python în locul unui tool precum Thunderbit (sau invers)?

Folosește Python dacă ai nevoie de control total, logică personalizată sau intenționezi să integrezi scrapingul în sisteme backend. Folosește Thunderbit dacă vrei rezultate rapide fără cod, ai nevoie să scalezi ușor sau ești utilizator business și cauți o soluție cu mentenanță redusă.

Vrei să aprofundezi? Vezi aceste resurse:

Scraping plăcut — și fie ca spreadsheeturile tale să fie mereu actualizate.