Jest w tym coś ponadczasowego: odpalasz terminal, klepiesz jedno polecenie i patrzysz, jak surowe dane z sieci spływają na ekran — jakbyś właśnie podejrzał kulisy Matrixa. Dla programistów i bardziej zaawansowanych technicznie osób to taka „magiczna różdżka”: niepozorne narzędzie wiersza poleceń, które po cichu działa na miliardach urządzeń — od serwerów w chmurze po inteligentną lodówkę. I nawet w 2026 roku, mimo wysypu błyszczących narzędzi no-code i rozwiązań AI, web-scraping-with-curl wciąż jest jednym z najpewniejszych wyborów, gdy liczy się szybkość, kontrola i możliwość skryptowania.

Od lat buduję narzędzia do automatyzacji i pomagam zespołom ogarniać dane z internetu — a mimo to nadal wracam do cURL, gdy muszę błyskawicznie pobrać stronę, zdebugować API albo postawić prototyp procesu scrapowania. W tym poradniku przeprowadzę Cię przez curl web scraping tutorial: od absolutnych podstaw po bardziej „pro” triki — z realnymi przykładami komend, praktycznymi wskazówkami i uczciwym spojrzeniem na to, gdzie cURL błyszczy (a gdzie zaczyna mu brakować pary). A jeśli jesteś bardziej po stronie biznesu i wolisz nie dotykać terminala, pokażę Ci, jak — nasz web scraper oparty na AI — potrafi zamienić „potrzebuję tych danych” w „oto mój arkusz” dosłownie w dwa kliknięcia, bez pisania kodu.

Zobaczmy więc, dlaczego cURL nadal ma sens w web scrapingu w 2025 roku, jak korzystać z niego skutecznie i kiedy warto sięgnąć po coś jeszcze mocniejszego.

Czym jest cURL? Fundament web-scraping-with-curl

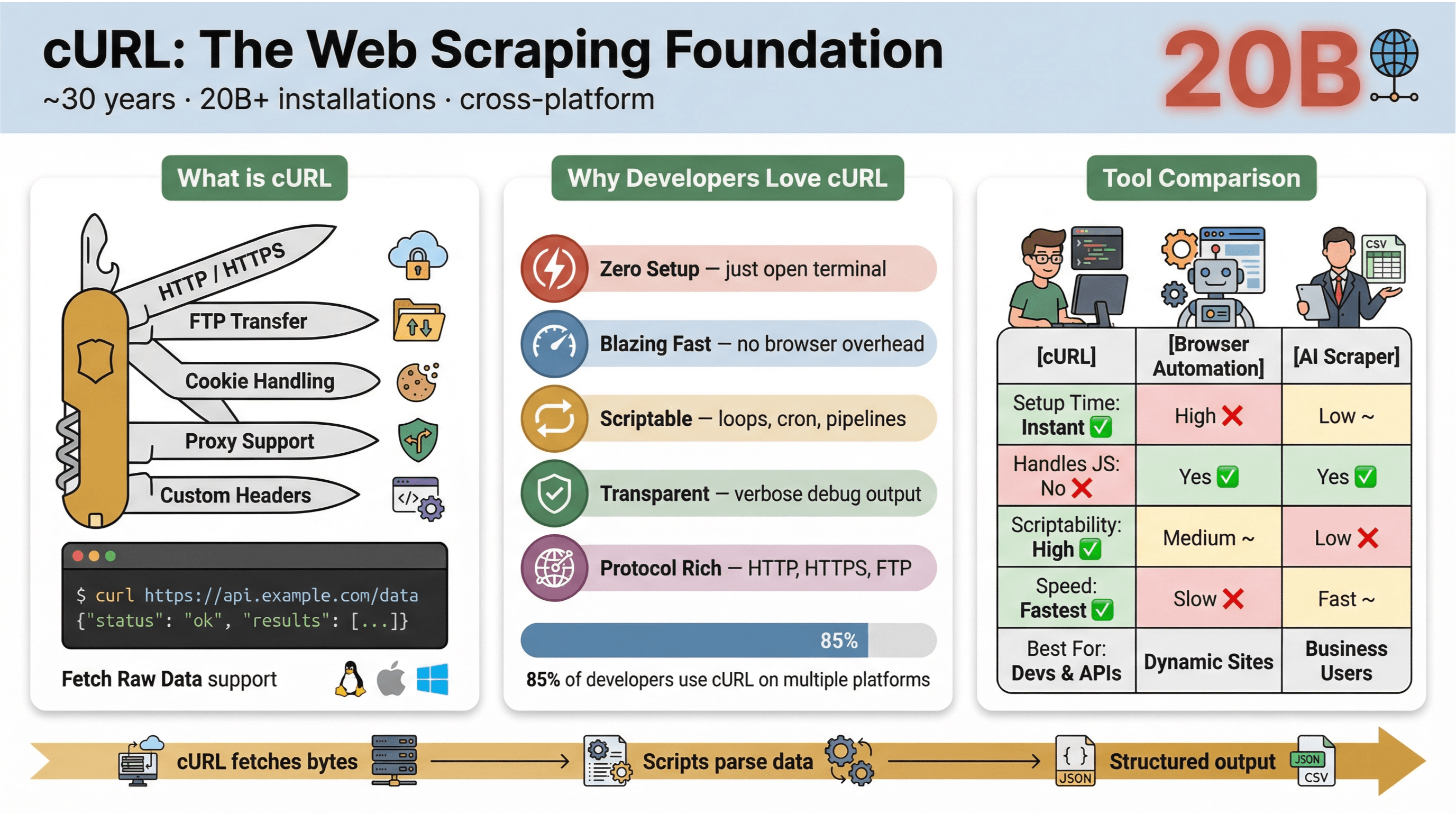

W najprostszym ujęciu to narzędzie i biblioteka do przesyłania danych z użyciem adresów URL. Ma prawie 30 lat (tak, serio) i jest praktycznie wszędzie — w systemach operacyjnych, w skryptach, a także w tle niezliczonych transferów danych w ponad . Jeśli kiedykolwiek pobierałeś stronę jednym poleceniem, testowałeś API albo ściągałeś plik z terminala, bardzo możliwe, że używałeś cURL.

Co sprawia, że cURL jest tak popularny w web scrapingu?

- Lekki i wieloplatformowy: działa na Linuxie, macOS, Windowsie, a nawet na urządzeniach wbudowanych.

- Obsługa protokołów: radzi sobie z HTTP, HTTPS, FTP i wieloma innymi.

- Łatwy do skryptowania: idealny do automatyzacji, zadań cron i „sklejania” procesów.

- Bez interakcji użytkownika: zaprojektowany do pracy nieinteraktywnej — świetny do batchy i pipeline’ów.

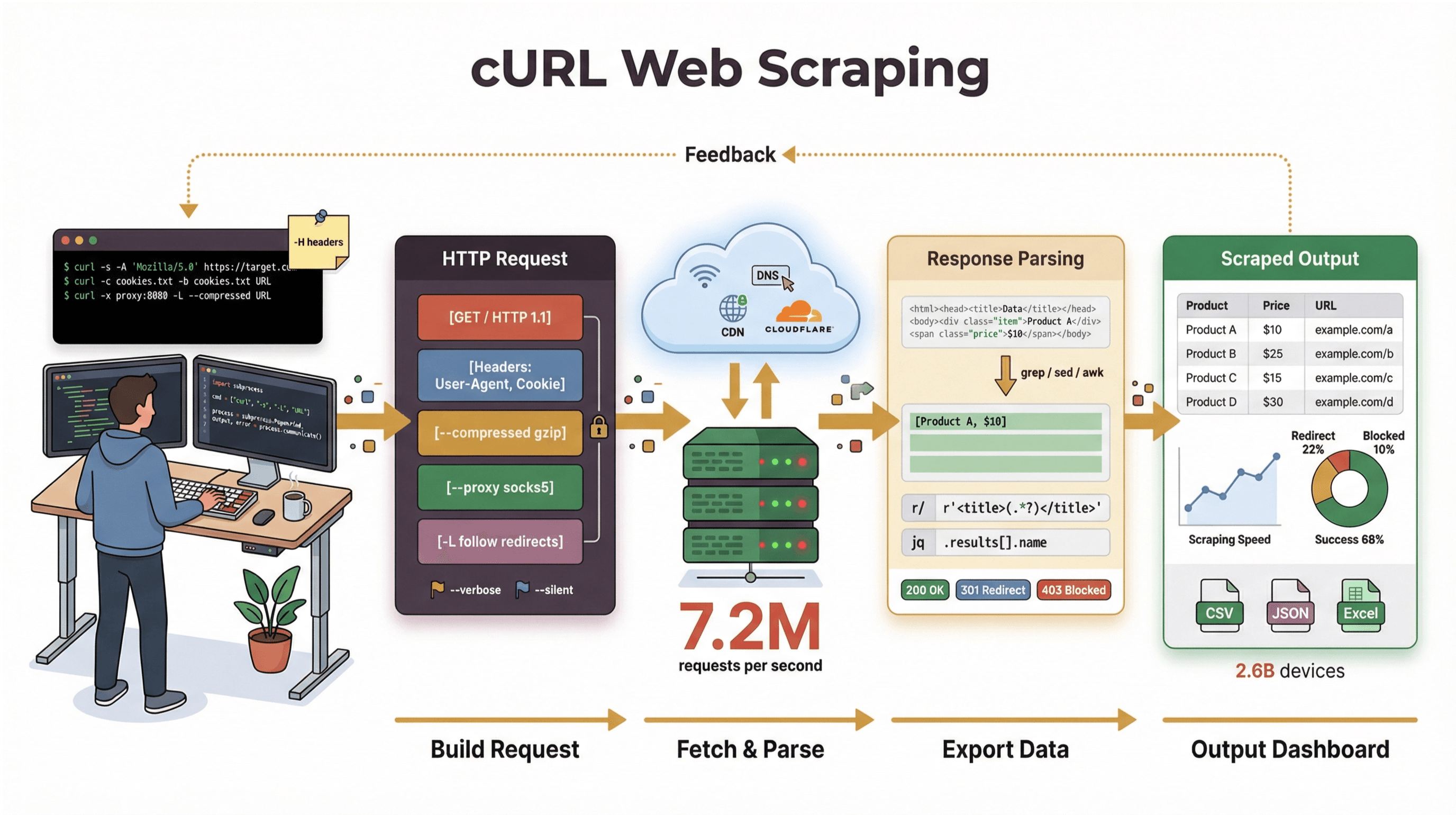

Warto jednak jasno powiedzieć: głównym zadaniem cURL jest pobranie surowych danych — HTML, JSON, obrazów, czegokolwiek. Nie parsuje, nie renderuje i nie porządkuje danych za Ciebie. Traktuj cURL jako „pierwszy kilometr” web scrapingu: dostarcza bajty, ale do zamiany ich na uporządkowane informacje potrzebujesz innych narzędzi (np. skryptów w Pythonie, grep/sed/awk albo AI 웹 스크래퍼).

Jeśli chcesz zajrzeć do oficjalnej dokumentacji, zobacz .

Dlaczego warto używać cURL do web scrapingu? (curl web scraping tutorial)

Skoro na rynku jest tyle nowych narzędzi, czemu programiści i użytkownicy techniczni wciąż wracają do cURL? Oto, co wyróżnia to podejście:

- Minimum przygotowań: bez instalacji i zależności — otwierasz terminal i jedziesz.

- Szybkość: pobierasz dane natychmiast, bez czekania na załadowanie przeglądarki.

- Skryptowalność: łatwo iterować po URL-ach, automatyzować żądania i łączyć komendy.

- Bogate możliwości: cookies, proxy, przekierowania, własne nagłówki i wiele więcej.

- Przejrzystość: tryb verbose/debug pokazuje dokładnie, co się dzieje.

W ponad 85% respondentów zadeklarowało, że korzysta z narzędzia cURL w wierszu poleceń, a niemal wszyscy używają go na wielu platformach. To nadal scyzoryk szwajcarski do żądań HTTP, szybkiego pobierania danych i diagnozowania problemów.

Szybkie porównanie cURL z innymi metodami scrapowania:

| Funkcja | cURL | Automatyzacja przeglądarki (np. Selenium) | AI Web Scraper (np. Thunderbit) |

|---|---|---|---|

| Czas konfiguracji | Natychmiast | Długi | Krótki |

| Skryptowalność | Wysoka | Średnia | Niska (bez kodu) |

| Obsługa JavaScript | Nie | Tak | Tak (Thunderbit: przez przeglądarkę) |

| Cookies/sesje | Ręcznie | Automatycznie | Automatycznie |

| Strukturyzacja danych | Ręcznie (parsowanie później) | Ręcznie (parsowanie później) | AI / szablony |

| Najlepsze zastosowanie | Dev, szybkie pobrania | Złożone, dynamiczne strony | Biznes, eksport danych w strukturze |

W skrócie: cURL jest bezkonkurencyjny do szybkiego, skryptowalnego pobierania danych — szczególnie ze stron statycznych, API albo w prostych automatyzacjach. Ale gdy potrzebujesz parsować złożony HTML, obsłużyć JavaScript lub wyeksportować dane w uporządkowanej formie, przyda się narzędzie bardziej wyspecjalizowane.

Start: podstawowe przykłady komend cURL do web scrapingu

Przejdźmy do praktyki. Oto jak krok po kroku używać cURL do podstawowych zadań web scrapingu.

Pobieranie surowego HTML przez cURL

Najprostszy scenariusz: pobierz HTML strony.

1curl https://books.toscrape.com/To polecenie pobiera stronę główną — publicznej strony demonstracyjnej do web scrapingu. W terminalu zobaczysz surowy HTML — wypatruj tagów typu <title> albo fragmentów w stylu „In stock.”

Zapisywanie wyniku do pliku

Chcesz zachować HTML do późniejszego parsowania? Użyj flagi -o:

1curl -o page.html https://books.toscrape.com/W efekcie dostaniesz plik page.html z pełną zawartością HTML. Idealne do dalszej analizy lub parsowania innymi narzędziami.

Wysyłanie żądań POST w cURL

Musisz wysłać formularz albo uderzyć w API? Użyj -d dla POST. Przykład z — serwisem do testów HTTP:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Dostaniesz odpowiedź JSON, która „odbiije” wysłane dane — świetne do testów i prototypowania.

Podgląd nagłówków i debugowanie

Czasem chcesz zobaczyć nagłówki odpowiedzi albo zdiagnozować żądanie:

-

Same nagłówki (HEAD):

1curl -I https://books.toscrape.com/ -

Nagłówki + treść:

1curl -i https://httpbin.org/get -

Tryb verbose/debug:

1curl -v https://books.toscrape.com/

Te opcje pomagają zrozumieć, co dzieje się „pod maską” — nieocenione przy rozwiązywaniu problemów.

Szybka ściąga z komend:

| Zadanie | Przykład komendy | Uwagi |

|---|---|---|

| Pobranie HTML | curl URL | Wypisuje HTML w terminalu |

| Zapis do pliku | curl -o file.html URL | Zapisuje wynik do pliku |

| Podgląd nagłówków | curl -I URL lub curl -i URL | -I tylko HEAD, -i nagłówki + body |

| POST z danymi formularza | curl -d "a=1&b=2" URL | Wysyła dane w formacie application/x-www-form-urlencoded |

| Debug żądania/odpowiedzi | curl -v URL | Szczegółowe informacje o request/response |

Więcej przykładów znajdziesz w .

Wyższy poziom: zaawansowany web scraping z cURL (web-scraping-with-curl)

Gdy opanujesz podstawy, cURL daje sporo zaawansowanych możliwości przy bardziej złożonych zadaniach.

Obsługa cookies i sesji

Wiele stron wymaga cookies do utrzymania sesji logowania lub śledzenia użytkownika. W cURL możesz zapisać i ponownie wykorzystać cookies między żądaniami:

1# Zapisz cookies po logowaniu

2curl -c cookies.txt https://example.com/login

3# Użyj cookies w kolejnych żądaniach

4curl -b cookies.txt https://example.com/accountDzięki temu możesz naśladować sesję przeglądarki i wejść na strony za logowaniem (o ile nie ma wyzwań opartych o JavaScript).

Podszywanie się pod User-Agent i własne nagłówki

Niektóre serwisy zwracają inną treść w zależności od User-Agent lub nagłówków. Domyślnie cURL przedstawia się jako „curl/WERSJA”, co bywa powodem blokad lub alternatywnej zawartości. Aby udawać przeglądarkę:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Możesz też ustawić własne nagłówki, np. preferencje językowe:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/To pomaga uzyskać treść zbliżoną do tej, którą widzi realny użytkownik w przeglądarce.

Używanie proxy w web scrapingu

Chcesz puścić ruch przez proxy (np. testy geolokalizacji albo ograniczanie ryzyka bana IP)? Użyj -x:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Korzystaj z proxy odpowiedzialnie i zgodnie z regulaminem serwisu.

Automatyzacja scrapowania wielu stron

Chcesz pobrać wiele podstron — np. kolejne strony listy produktów? Wystarczy prosta pętla w shellu:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneTo pobiera strony 2–5 katalogu Books to Scrape i zapisuje każdą do osobnego pliku. (Strona 1 to homepage.)

Ograniczenia web-scraping-with-curl: co warto wiedzieć

Choć cURL bardzo lubię, nie jest to rozwiązanie na wszystko. Oto gdzie zaczyna brakować mu możliwości:

- Brak wykonywania JavaScript: cURL nie poradzi sobie ze stronami, które renderują treść w JS albo wymagają rozwiązywania wyzwań antybotowych ().

- Parsowanie po Twojej stronie: dostajesz surowy HTML/JSON, ale musisz go samodzielnie przetworzyć — zwykle dodatkowymi skryptami lub narzędziami.

- Ograniczona obsługa złożonych sesji: logowania wieloetapowe, tokeny czy formularze potrafią szybko zrobić się nieczytelne.

- Brak strukturyzacji danych: cURL nie zamienia stron w wiersze, tabele ani arkusze.

- Wrażliwość na wykrywanie botów: wiele serwisów stosuje dziś zaawansowane zabezpieczenia (JS, fingerprinting, CAPTCHA), których cURL po prostu nie przeskoczy ().

Szybkie porównanie:

| Ograniczenie | Samo cURL | Nowoczesne narzędzia (np. Thunderbit) |

|---|---|---|

| Obsługa JavaScript | Nie | Tak |

| Strukturyzacja danych | Ręcznie | Automatycznie (AI/szablony) |

| Obsługa sesji | Ręcznie | Automatycznie |

| Omijanie antybotów | Ograniczone | Zaawansowane (przeglądarkowe/AI) |

| Łatwość użycia | Dla technicznych | Dla nietechnicznych |

Do stron statycznych i API cURL jest świetny. Gdy robi się dynamicznie albo „pod ochroną”, warto wejść poziom wyżej.

Thunderbit vs. cURL: najlepsze podejście dla osób nietechnicznych

Teraz o — naszym AI Web Scraper w formie rozszerzenia Chrome. Jeśli pracujesz w sprzedaży, marketingu czy operacjach i po prostu chcesz przenieść dane ze strony do Excela, Google Sheets albo Notion — bez terminala — Thunderbit jest stworzony właśnie do tego.

Porównanie Thunderbit i cURL:

| Funkcja | cURL | Thunderbit |

|---|---|---|

| Interfejs | Wiersz poleceń | Kliknij i wybierz (rozszerzenie Chrome) |

| Sugestie pól przez AI | Nie | Tak (AI analizuje stronę i proponuje kolumny) |

| Paginacja/podstrony | Ręczne skrypty | Automatycznie (AI wykrywa i scrapuje) |

| Eksport danych | Ręcznie (parsowanie + zapis) | Bezpośrednio do Excel, Google Sheets, Notion, Airtable |

| Strony JS/chronione | Nie | Tak (scrapowanie w przeglądarce) |

| No-code | Nie (wymaga skryptów) | Tak (dla każdego) |

| Darmowy plan | Zawsze darmowe | Darmowe do 6 stron (10 z boostem trial) |

W Thunderbit otwierasz rozszerzenie, klikasz „AI Suggest Fields”, a AI samo podpowiada, jakie dane wyciągnąć. Możesz scrapować tabele, listy, szczegóły produktów, a nawet automatycznie odwiedzać podstrony. Potem eksportujesz dane prosto do ulubionych narzędzi — bez parsowania i bez bólu głowy.

Thunderbit zaufało już ponad — szczególnie zespoły sprzedaży, ecommerce i nieruchomości, które potrzebują uporządkowanych danych „na już”.

Chcesz sprawdzić? .

Łączenie cURL i Thunderbit: elastyczne strategie web scrapingu

Jeśli jesteś użytkownikiem technicznym, nie musisz wybierać tylko jednego narzędzia. W praktyce wiele zespołów łączy cURL i Thunderbit, żeby zyskać maksymalną elastyczność:

- Prototypuj w cURL: szybko testuj endpointy, sprawdzaj nagłówki i obserwuj, jak serwis odpowiada.

- Skaluj w Thunderbit: gdy potrzebujesz danych w strukturze, scrapowania wielu stron lub powtarzalnego procesu — przełącz się na Thunderbit i eksportuj bezpośrednio.

Przykładowy workflow do researchu rynku:

- Pobierz kilka stron przez cURL i podejrzyj strukturę HTML.

- Zdecyduj, jakie pola są potrzebne (np. nazwy produktów, ceny, opinie).

- Otwórz Thunderbit, kliknij „AI Suggest Fields” i pozwól AI skonfigurować scraper.

- Zeskrob wszystkie strony (w tym podstrony i paginację) i wyeksportuj do Google Sheets.

- Analizuj, udostępniaj i działaj — bez ręcznego parsowania.

Tabela decyzyjna:

| Sytuacja | cURL | Thunderbit | Oba |

|---|---|---|---|

| Szybkie pobranie API lub strony statycznej | ✅ | ||

| Potrzebujesz danych w arkuszu w strukturze | ✅ | ||

| Debug nagłówków/cookies | ✅ | ||

| Scrapowanie stron dynamicznych (dużo JS) | ✅ | ||

| Powtarzalny workflow bez kodu | ✅ | ||

| Prototyp, a potem skalowanie | ✅ | ✅ | Workflow hybrydowy |

Typowe problemy i pułapki w web scrapingu z cURL

Zanim ruszysz na pełną skalę z cURL, warto znać realne wyzwania:

- Systemy antybotowe: wiele stron ma dziś zaawansowane zabezpieczenia (wyzwania JS, CAPTCHA, fingerprinting), których cURL nie ominie ().

- Jakość danych: zmiany w HTML, brakujące pola lub niespójne układy potrafią zepsuć skrypty.

- Koszt utrzymania: gdy strona się zmienia, musisz aktualizować logikę parsowania.

- Ryzyka prawne i compliance: zawsze sprawdzaj regulamin serwisu, robots.txt i przepisy. To, że dane są publiczne, nie oznacza automatycznie, że można je dowolnie wykorzystywać (, ).

- Ograniczenia skali: cURL jest świetny do mniejszych zadań, ale przy dużej skali musisz ogarnąć proxy, limity, retry i obsługę błędów.

Wskazówki: debug i zgodność z zasadami

- Zaczynaj od stron demo lub takich, gdzie masz zgodę (np. ).

- Szanuj limity — nie „młotkuj” endpointów.

- Unikaj scrapowania danych osobowych bez podstawy prawnej.

- Jeśli trafisz na ścianę JS lub CAPTCHA, rozważ narzędzie przeglądarkowe, takie jak Thunderbit.

Podsumowanie krok po kroku: jak scrapować strony za pomocą cURL

Szybka checklista web-scraping-with-curl:

- Wybierz docelowy URL (lub listę URL-i): zacznij od strony statycznej albo endpointu API.

- Pobierz stronę:

curl URL - Zapisz wynik do pliku:

curl -o file.html URL - Sprawdź nagłówki / debug:

curl -I URL,curl -v URL - Wyślij dane POST:

curl -d "a=1&b=2" URL - Obsłuż cookies/sesje:

curl -c cookies.txt ...,curl -b cookies.txt ... - Ustaw nagłówki / User-Agent:

curl -A "..." -H "..." URL - Podążaj za przekierowaniami:

curl -L URL - Użyj proxy (jeśli trzeba):

curl -x proxy:port URL - Zautomatyzuj pobieranie wielu stron: pętle w shellu lub skrypty.

- Parsuj i porządkuj dane: użyj dodatkowych narzędzi/skryptów.

- Przełącz się na Thunderbit, gdy potrzebujesz danych w strukturze, no-code lub stron dynamicznych.

Wnioski i najważniejsze lekcje: jak wybrać właściwe narzędzie do web scrapingu

Web-scraping-with-curl to w 2026 roku nadal bardzo przydatna umiejętność dla osób technicznych — szczególnie do szybkiego pobierania danych, prototypowania i automatyzacji. Szybkość, skryptowalność i powszechność cURL sprawiają, że to stały element zestawu narzędzi każdego developera. Ale wraz z tym, jak internet staje się coraz bardziej dynamiczny i chroniony, a użytkownicy biznesowi oczekują danych w strukturze bez kodu, narzędzia takie jak przesuwają granice możliwości.

Najważniejsze wnioski:

- Używaj cURL do stron statycznych, API i szybkiego prototypowania — zwłaszcza gdy chcesz pełnej kontroli.

- Przesiądź się na Thunderbit (lub podobne AI 웹 스크래퍼), gdy potrzebujesz danych w strukturze, obsługi stron dynamicznych/JS albo procesu przyjaznego biznesowi i bez kodu.

- Łącz oba podejścia dla maksymalnej elastyczności: prototyp w cURL, skalowanie i struktura w Thunderbit.

- Scrapuj odpowiedzialnie — respektuj regulaminy, limity i granice prawne.

Chcesz zobaczyć, jak proste może być scrapowanie? i przekonaj się, jak działa ekstrakcja danych wspierana przez AI. A jeśli chcesz więcej, zajrzyj na — znajdziesz tam kolejne poradniki, wskazówki i branżowe insighty. Mogą Ci się też spodobać:

Powodzenia w scrapowaniu — oby Twoje dane zawsze były czyste, uporządkowane i na wyciągnięcie jednej komendy (albo kliknięcia).

FAQ

1. Czy cURL poradzi sobie ze stronami renderowanymi przez JavaScript?

Nie. cURL nie wykonuje JavaScript — pobiera surowy HTML zwrócony przez serwer. Jeśli strona wymaga JS do wyrenderowania treści albo do przejścia zabezpieczeń antybotowych, cURL nie uzyska dostępu do danych. W takich przypadkach użyj narzędzi przeglądarkowych, np. .

2. Jak zapisać wynik cURL bezpośrednio do pliku?

Użyj flagi -o: curl -o filename.html URL. Zapisuje to treść odpowiedzi do pliku zamiast wyświetlać ją w terminalu.

3. Jaka jest różnica między cURL a Thunderbit w web scrapingu?

cURL to narzędzie wiersza poleceń do pobierania surowych danych z sieci — świetne dla osób technicznych i automatyzacji. Thunderbit to rozszerzenie Chrome oparte na AI, stworzone dla użytkowników biznesowych: wyciąga dane w strukturze z dowolnej strony, radzi sobie ze stronami dynamicznymi i eksportuje bezpośrednio do narzędzi takich jak Excel czy Google Sheets — bez kodu.

4. Czy scrapowanie stron cURL jest legalne?

Scrapowanie publicznie dostępnych danych jest w USA zazwyczaj legalne po ostatnich orzeczeniach, ale zawsze sprawdzaj regulamin serwisu, robots.txt i lokalne przepisy. Nie pobieraj danych osobowych ani chronionych bez zgody i respektuj limity oraz zasady etyczne (, ).

5. Kiedy warto przejść z cURL na bardziej zaawansowane narzędzie, takie jak Thunderbit?

Gdy potrzebujesz scrapować strony dynamiczne (dużo JS), chcesz mieć dane w arkuszu w uporządkowanej formie albo preferujesz workflow bez kodu — Thunderbit będzie lepszym wyborem. cURL zostaw do szybkich, technicznych zadań; Thunderbit wykorzystuj do powtarzalnej ekstrakcji danych przyjaznej biznesowi.

Więcej porad i tutoriali o web scrapingu znajdziesz na albo na naszym .