Obrazy są wszędzie — w galeriach produktów, ofertach nieruchomości i katalogach konkurencji. Jeśli zajmujesz się sprzedażą, marketingiem albo badaniami, pewnie nieraz musiałeś pobrać dziesiątki, a nawet setki obrazów ze stron internetowych.

Nikt nie chce ręcznie klikać „zapisz obraz” przy 500 plikach. Właśnie do tego służą narzędzia do pobierania obrazów.

Przetestowałem 10 opcji w — od rozszerzeń przeglądarki po biblioteki Pythona. Oto, co najlepiej sprawdza się w różnych zastosowaniach.

Dlaczego w 2026 roku potrzebujesz scrappera obrazów

Treści wizualne to nie tylko „ładne obrazki” — to także konkretna wartość biznesowa. Posty z obrazami potrafią generować nawet , a zaangażowanie w mediach społecznościowych może wzrosnąć o , gdy dodasz materiały wizualne. Firmy pobierają obrazy do wszystkiego — od badań rynku (wychwytywania trendów w katalogach konkurencji), przez tworzenie treści (gromadzenie zdjęć produktów), aż po trenowanie AI (zasilanie modeli oznaczonymi zdjęciami).

Ale jest haczyk: strony internetowe stają się coraz bardziej skomplikowane. Obrazy ładują się dynamicznie, chowają za nieskończonym przewijaniem albo siedzą na podstronach. Ręczne pobieranie jest wolne, podatne na błędy i — nie oszukujmy się — potrafi wykończyć psychicznie. A dla zespołów nietechnicznych stworzenie własnego crawlera może brzmieć jak rocket science.

Właśnie tu wchodzą nowoczesne narzędzia do pobierania obrazów. Automatyzują żmudną pracę, radzą sobie ze skomplikowanymi stronami i pozwalają każdemu — tak, nawet współpracownikowi, który „używa tylko Excela” — pobierać obrazy na dużą skalę. Rynek oprogramowania do web scrapingu dynamicznie rośnie i ma przekroczyć , a ponad wykorzystuje dziś web scraping do analiz biznesowych. Morał? Jeśli nie korzystasz ze scrappera obrazów, już zostajesz w tyle.

Jak wybraliśmy najlepsze narzędzia do pobierania obrazów

Nie wszystkie scrappery obrazów są sobie równe. Oto, na co zwracałem uwagę, wybierając top 10:

- Łatwość obsługi: Czy osoba bez kodowania może uzyskać wyniki w kilka minut? Sterowanie językiem naturalnym, interfejsy typu point-and-click i natychmiastowy podgląd to ogromny plus.

- Opcje eksportu: Czy narzędzie pozwala pobierać obrazy lub adresy URL do Excela, Google Sheets, Notion albo przez API? Integracje są kluczowe w procesach biznesowych.

- Dostosowanie i elastyczność: Czy poradzi sobie z logowaniem, dynamiczną treścią lub niestandardową logiką ekstrakcji? Zaawansowani użytkownicy potrzebują czegoś więcej niż tylko „Zapisz jako”.

- Automatyzacja i harmonogramy: Czy można ustawić i zapomnieć? Zaplanowane uruchomienia i przetwarzanie w chmurze ratują życie przy powtarzalnych zadaniach.

- Skalowalność: Czy narzędzie nie zaciśnie zębów przy 10 000 obrazów? Musi obsługiwać zarówno małe, jak i ogromne zadania.

- Cena i opłacalność: Czy jest darmowy plan? Czy koszt ma sens dla małych zespołów, czy raczej jest skrojony pod budżety enterprise?

Mając to na uwadze, oto 10 najlepszych narzędzi do pobierania obrazów, które warto rozważyć w 2026 roku — każde z własnymi mocnymi stronami, ograniczeniami i idealnymi zastosowaniami.

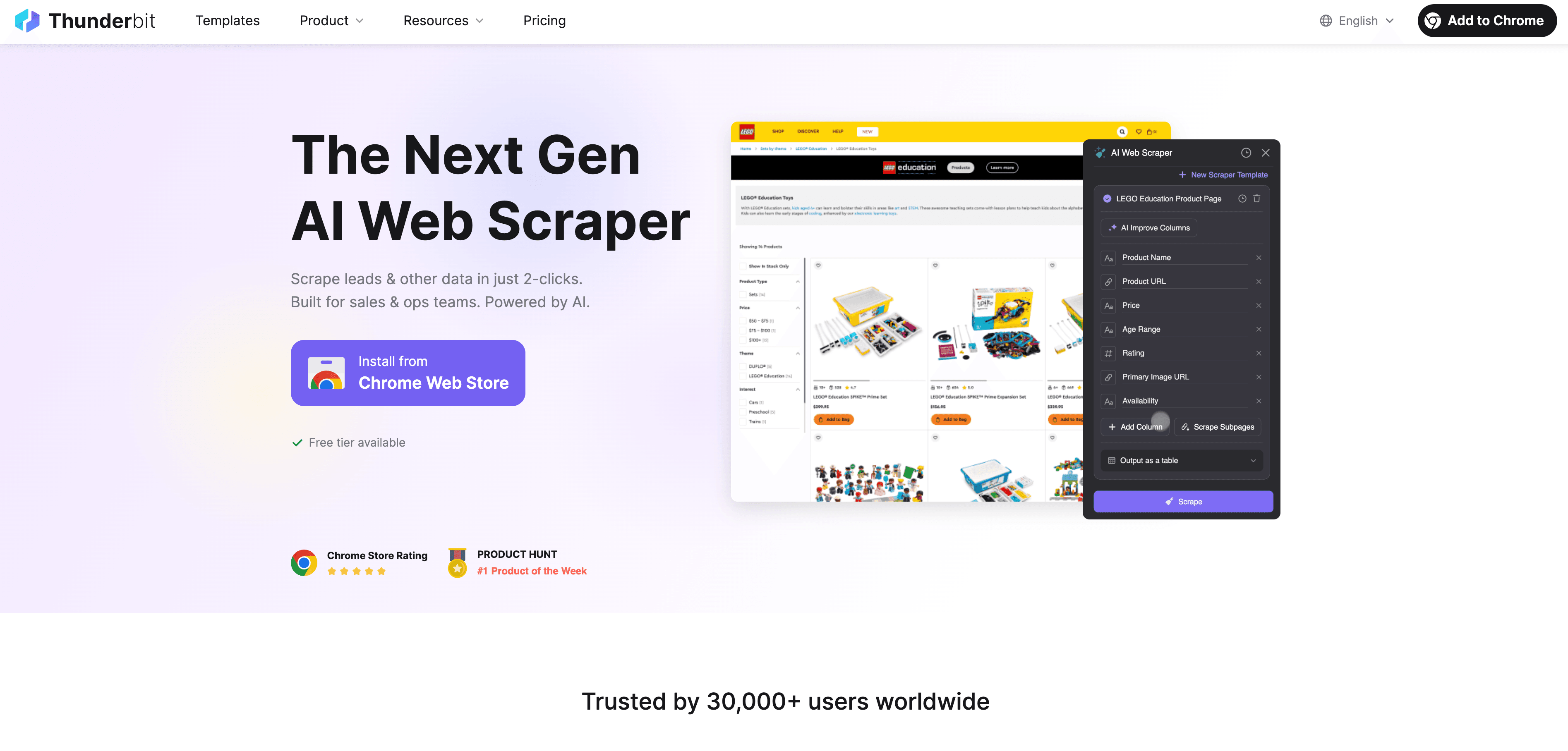

1. Thunderbit

to mój pierwszy wybór dla zespołów nietechnicznych i każdego, kto chce pobierać obrazy możliwie bez tarcia. Jako współzałożyciel mam lekkie uprzedzenie — ale naszą misją od zawsze było sprawienie, by web scraping był tak prosty, że poradziłaby sobie z nim nawet twoja babcia (zakładając, że interesuje się analizą konkurencji).

Co wyróżnia Thunderbit? Chodzi o prostotę. Wystarczy kliknąć „AI Suggest Fields”, pozwolić AI wykryć wszystkie obrazy (i dowolne inne dane, których potrzebujesz), a następnie nacisnąć „Scrape”. Thunderbit automatycznie przechodzi przez podstrony, obsługuje nieskończone przewijanie i eksportuje obrazy bezpośrednio do Excela, Google Sheets, Airtable lub Notion. Możesz nawet użyć darmowego , aby pobrać każdy obraz z jednej strony jednym kliknięciem — bez konfiguracji, bez kodu.

Najważniejsze funkcje:

- Pobieranie obrazów w 2 kliknięciach (AI robi ciężką robotę)

- Scraping podstron (automatyczne pobieranie obrazów ze stron szczegółów)

- Darmowe ekstraktory obrazów, e-maili i telefonów

- Natychmiastowy eksport do Sheets, Notion, Airtable, Excel, CSV lub JSON

- Darmowy plan (6 stron, nielimitowana liczba wierszy), płatne plany od 15 USD/mies.

- Obsługa wielu języków (34 języki)

- Brak utrzymania — AI dostosowuje się do zmian na stronie

Dla kogo: Zespoły sprzedaży, marketingu i operacji, które chcą szybko i dokładnie pobierać dane o obrazach bez kodowania i konfiguracji. Idealne do katalogowania produktów konkurencji, zbierania zdjęć nieruchomości albo budowania bibliotek treści.

Więcej o tym, jak Thunderbit wypada na tle innych narzędzi, znajdziesz w naszym .

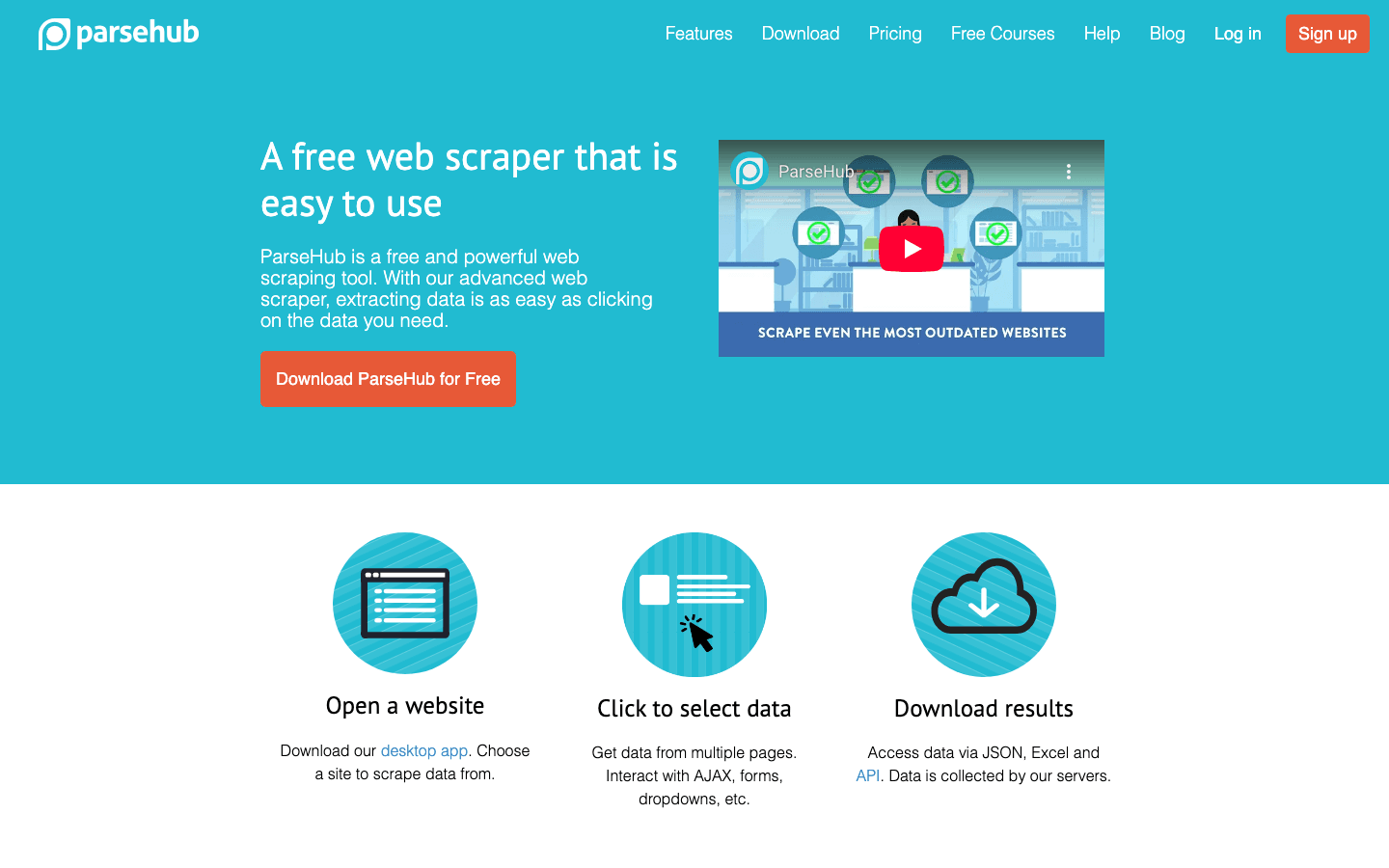

2. ParseHub

to potężne narzędzie dla użytkowników, którzy muszą pobierać obrazy ze złożonych, dynamicznych stron — na przykład takich z nieskończonym przewijaniem, galeriami ładowanymi przez AJAX czy serwisów wymagających klikania filtrów i okien pop-up.

Dlaczego ParseHub robi wrażenie: Wizualny edytor przepływu pracy pozwala zaplanować wieloetapową logikę scrapingu bez pisania kodu. Możesz dodawać warunki, pętle, a nawet zmienne, aby obsłużyć trudniejsze strony. ParseHub potrafi wchodzić w interakcje z formularzami, klikać przyciski i wyciągać obrazy, które pojawiają się dopiero po określonych działaniach.

Najważniejsze funkcje:

- Wizualny edytor z zaawansowaną logiką (warunki, pętle)

- Obsługa treści dynamicznych i mocno opartych na JavaScript

- Harmonogramy w chmurze i dostęp do API

- Automatyczna rotacja IP, aby unikać blokad

- Eksport do CSV, JSON i integracje z Tableau

Dla kogo: Analitycy danych, dziennikarze lub badacze pobierający dane z trudnych stron, którzy chcą precyzyjnej kontroli bez kodowania. Jest darmowy plan (do 200 stron na jedno uruchomienie), ale zaawansowani użytkownicy będą potrzebować planu za 189 USD/mies. dla chmury i wyższych limitów.

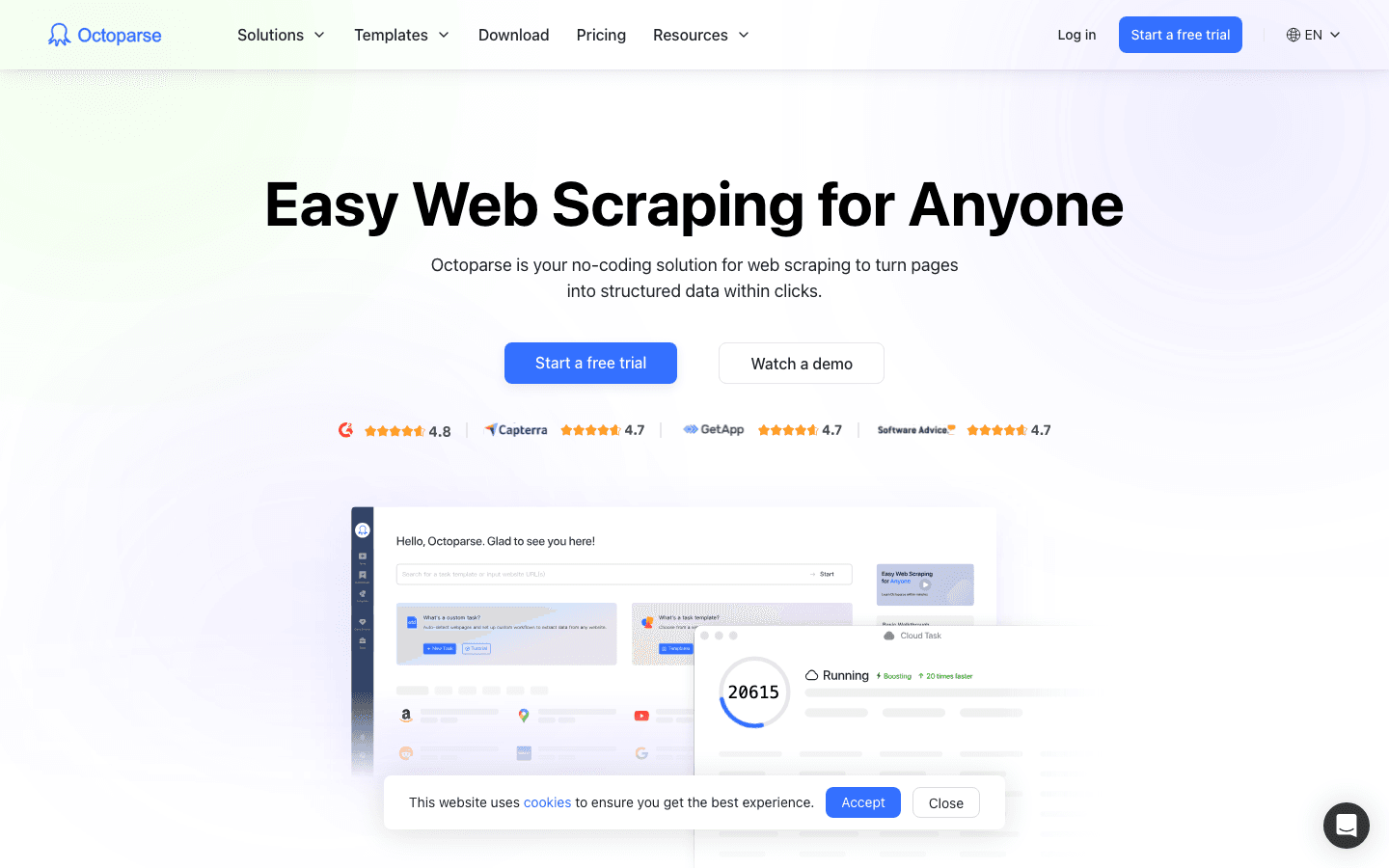

3. Octoparse

to mistrz no-code do masowego pobierania obrazów. Interfejs przypominający arkusz kalkulacyjny i funkcja automatycznego wykrywania sprawiają, że jest bardzo przystępny dla użytkowników nietechnicznych.

Dlaczego Octoparse jest popularny: Wystarczy wskazać i kliknąć obraz lub listę, a AI Octoparse zasugeruje, co pobrać. Szczególnie dobrze radzi sobie z paginacją, nieskończonym przewijaniem i stronami wymagającymi logowania. Scrapowanie w chmurze i harmonogramy są dostępne w płatnych planach, dzięki czemu możesz uruchamiać duże zadania bez zajmowania własnego komputera.

Najważniejsze funkcje:

- Konfiguracja no-code typu point-and-click

- Automatycznie wykrywa listy i obrazy

- Obsługuje paginację, nieskończone przewijanie i logowanie

- Scrapowanie i harmonogramy w chmurze

- Eksport do CSV, Excela, JSON i baz danych

Dla kogo: Zespoły marketingowe, małe firmy lub każdy, kto potrzebuje szybko pobrać dużo obrazów bez kodowania. Darmowy plan do małych zadań; płatne plany od 119 USD/mies.

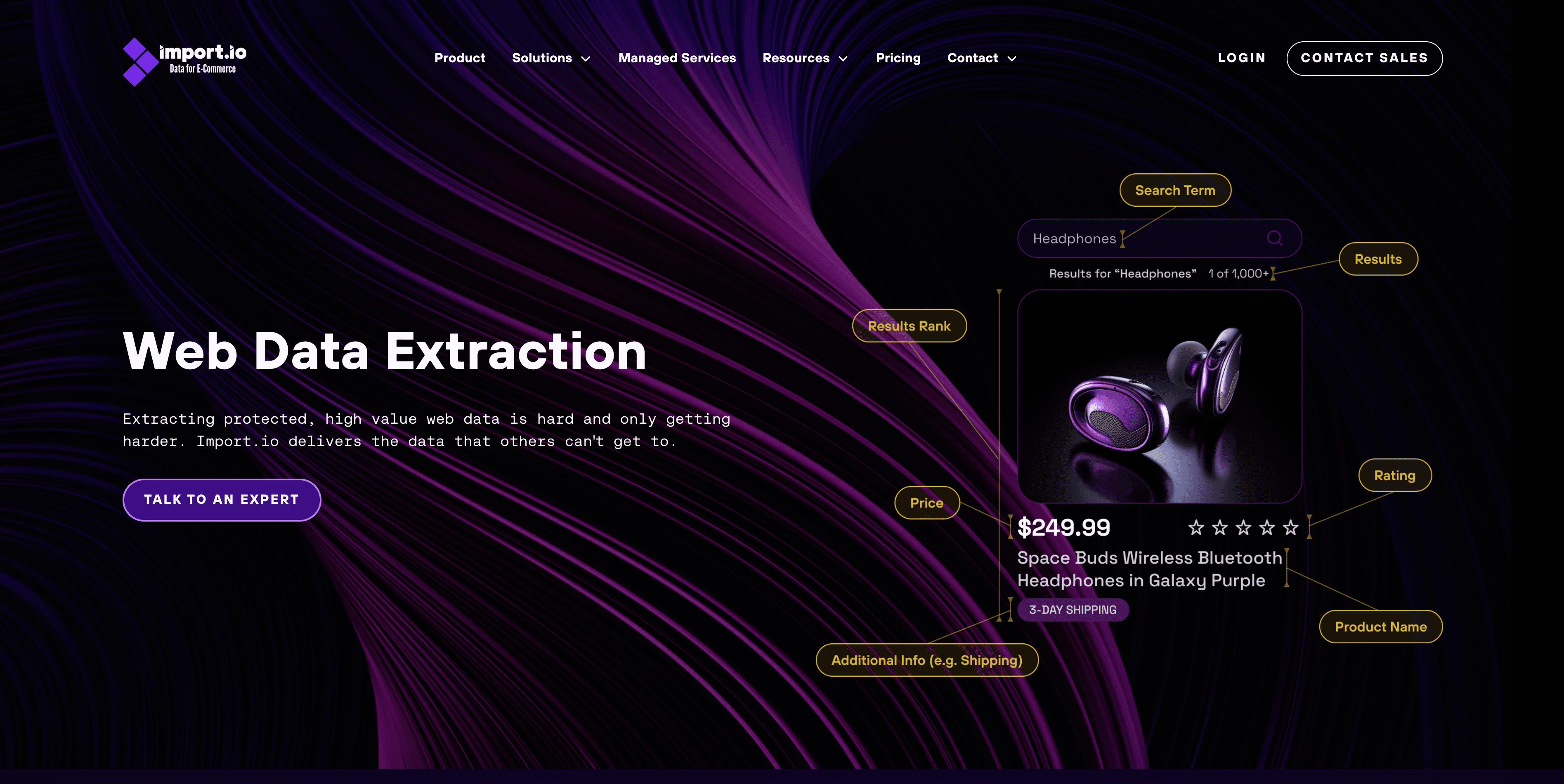

4.

to platforma ekstrakcji danych klasy enterprise, która równie dobrze sprawdza się jako solidny scrapper obrazów. Jej interaktywny interfejs pozwala nagrywać procesy pracy (na przykład logowanie, filtrowanie i przechodzenie przez galerie), a potem uruchamiać je na dużą skalę w chmurze.

Co wyróżnia na tle innych: Zostało zaprojektowane z myślą o integracjach — pobrane obrazy i dane mogą trafiać bezpośrednio do dashboardów analitycznych, narzędzi BI lub baz danych przez API i webhooki. świetnie radzi sobie też z chronioną i dynamiczną treścią.

Najważniejsze funkcje:

- Interaktywny rejestrator przepływów pracy

- Obsługa logowania, dynamicznej treści i stron chronionych

- Integracje API/webhook do procesów analitycznych

- Usługi zarządzane dla klientów enterprise

Dla kogo: Średnie i duże firmy potrzebujące niezawodnej, skalowalnej ekstrakcji obrazów jako części większego pipeline’u danych. Ceny zaczynają się od około 299 USD/mies., dostępny jest bezpłatny okres próbny.

5. Apify

to przyjazna dla deweloperów platforma automatyzacji z marketplace’em gotowych „Actors” (gotowych scraperów) oraz możliwością napisania własnego w Node.js lub Pythonie.

Dlaczego Apify jest elastyczny: Możesz znaleźć Actora dla popularnych serwisów (jak Instagram czy Amazon) albo zbudować własny scraper do wszystkiego innego. Infrastruktura chmurowa Apify obsługuje harmonogramy, zarządzanie proxy i skalowanie — dzięki czemu możesz pobierać tysiące stron równolegle.

Najważniejsze funkcje:

- Marketplace Actorów (gotowe scrapery dla popularnych stron)

- Własne skrypty w Node.js/Pythonie

- Harmonogramy i przechowywanie w chmurze

- Solidne integracje z API

Dla kogo: Deweloperzy, startupy lub inżynierowie danych, którzy chcą programowalnego i skalowalnego scrapingu. Darmowy plan do lekkiego użycia; płatne plany od 49 USD/mies.

6. Mozenda

to rozwiązanie klasy enterprise skupione na ekstrakcji danych strukturalnych, w tym obrazów, plików i PDF-ów. Interfejs point-and-click jest przyjazny, ale prawdziwa siła tkwi w automatyzacji, harmonogramach i zarządzaniu zespołem.

Dlaczego Mozenda nadaje się dla enterprise: Została zbudowana pod kątem niezawodności — solidne harmonogramy, powiadomienia i automatyzacja przepływów pracy. Mozenda potrafi łączyć dane z wielu źródeł, eksportować je do różnych formatów, a nawet działać lokalnie (on-premises) w wrażliwych projektach.

Najważniejsze funkcje:

- Wizualny kreator agentów (bez kodowania)

- Obsługa złożonych stron, wielopoziomowych danych i obrazów

- Harmonogramy, powiadomienia i automatyzacja workflow

- Współpraca zespołowa i usługi zarządzane

Dla kogo: Duże organizacje lub zespoły z ciągłymi, krytycznymi zadaniami scrapingu. Ceny zaczynają się od około 99 USD/mies., dostępne są też opcje enterprise szyte na miarę.

7. VisualScraper

to lekkie, przyjazne narzędzie do szybkich zadań pobierania obrazów. Interfejs jest minimalistyczny — po prostu wskaż, kliknij i pobierz.

Dlaczego VisualScraper jest wygodny: To idealne rozwiązanie do małych zadań lub jednorazowych projektów. Możesz planować zadania, eksportować do CSV/JSON/XML, a nawet odbierać wyniki przez e-mail lub FTP. Nie jest tak mocny jak najwięksi gracze, ale przy podstawowych potrzebach trudno pobić jego prostotę — i cenę, bo dla większości użytkowników jest darmowy.

Najważniejsze funkcje:

- Prosty interfejs point-and-click

- Podgląd danych w czasie rzeczywistym

- Harmonogramy i eksport do wielu formatów

- Darmowa aplikacja na Windows do małych zadań

Dla kogo: Osoby prywatne, hobbyści lub właściciele małych firm, którzy potrzebują okazjonalnie pobrać obrazy bez długiej nauki.

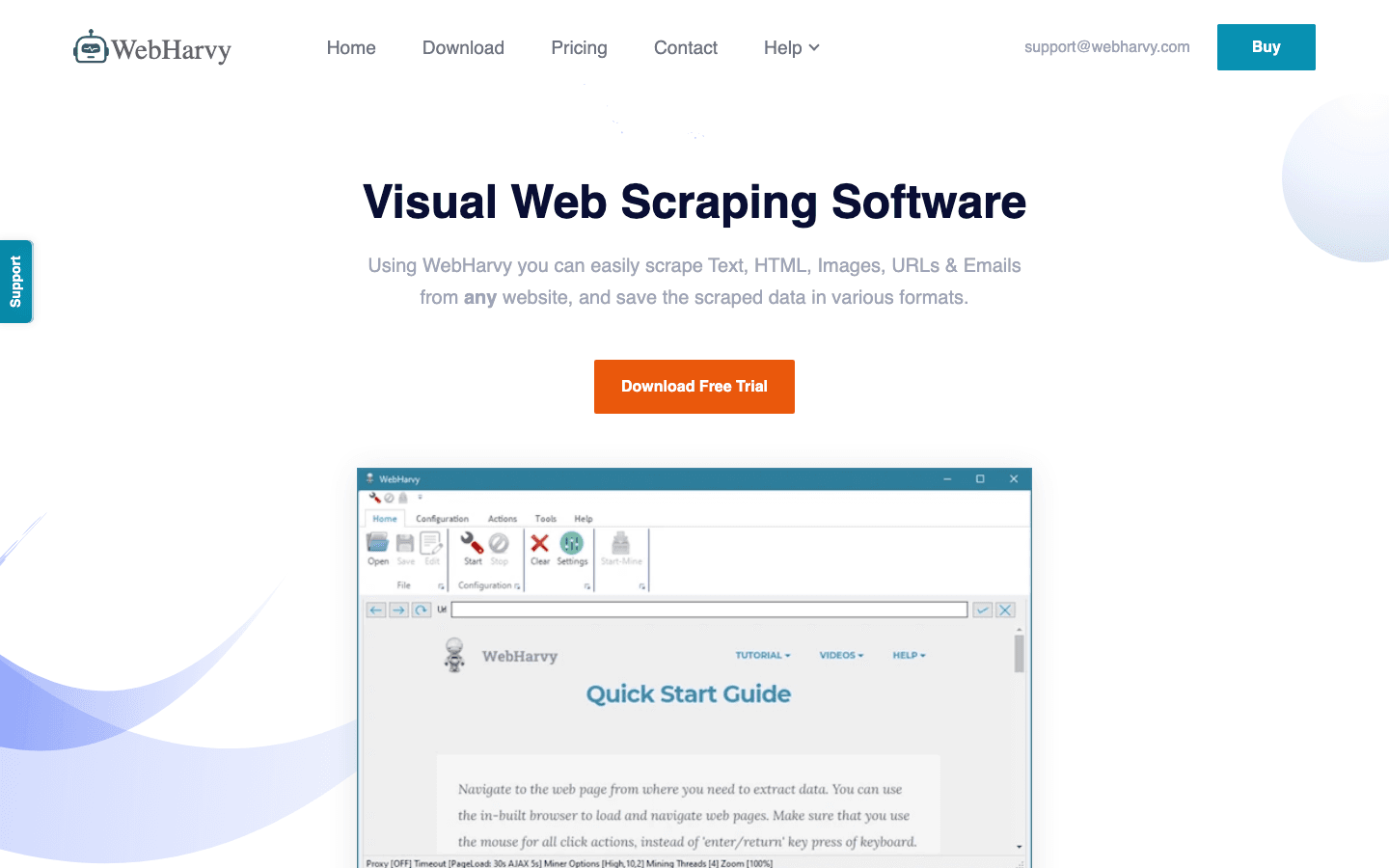

8. WebHarvy

to wizualny scraper na Windows, znany ze sprytnego wykrywania wzorców. Klikasz jeden obraz, a WebHarvy automatycznie znajduje i pobiera wszystkie podobne obrazy na stronie.

Dlaczego WebHarvy jest sprytny: Radzi sobie z wielopoziomowym scrapingiem (na przykład pobieraniem obrazów galerii ze stron szczegółów produktów), wypełnianiem formularzy, klikaniem przycisków, a nawet uruchamianiem niestandardowego JavaScriptu na trudnych stronach. To jednorazowy zakup, więc unikasz opłat miesięcznych.

Najważniejsze funkcje:

- Inteligentne rozpoznawanie wzorców

- Wielopoziomowe pobieranie obrazów z galerii

- Eksport do Excela, CSV, JSON, SQL

- Licencja jednorazowa (bez abonamentu)

Dla kogo: Osoby bez umiejętności programowania, które chcą połączyć wygodę z zaawansowanymi funkcjami, zwłaszcza na Windows. Świetne dla badaczy i małych firm.

9. Diffbot

to AI-owy mózg ekstrakcji danych z sieci. Wystarczy podać mu URL (albo milion), a jego computer vision i NLP rozpoznają i wyciągną wszystkie główne obrazy — bez reguł i selektorów.

Dlaczego Diffbot jest wyjątkowy: To rozwiązanie API-first, ogromnie skalowalne i odporne na zmiany na stronie (AI dostosowuje się automatycznie). Knowledge Graph Diffbota pozwala nawet przeszukiwać bazę obrazów i danych strukturalnych z całej sieci.

Najważniejsze funkcje:

- Ekstrakcja oparta na AI (bez konfiguracji)

- Obsługa milionów stron przez API

- Zwraca adresy URL obrazów, metadane i tagi

- Knowledge Graph do zapytań obejmujących całą sieć

Dla kogo: Enterprise, firmy AI lub dostawcy danych potrzebujący ogromnych, bezobsługowych zbiorów obrazów. Darmowy plan obejmuje 10 tys. wywołań API miesięcznie; płatne plany od 299 USD/mies. Wymaga pewnej znajomości kodowania.

10. Scrapy

to open-source’owy framework Pythona do własnego web scrapingu. Jeśli jesteś deweloperem, Scrapy daje ci pełną kontrolę — piszesz spidery, które crawlują dowolną stronę, pobierają obrazy i przetwarzają je tak, jak chcesz.

Dlaczego Scrapy jest potężny: Wbudowany Images Pipeline automatyzuje pobieranie obrazów, tworzenie miniaturek i filtrowanie według rozmiaru lub formatu. Scrapy jest szybki, skalowalny i ma ogromny ekosystem rozszerzeń do proxy, crawlów w chmurze i wielu innych rzeczy.

Najważniejsze funkcje:

- Najwyższa elastyczność dzięki podejściu code-first

- Asynchroniczne, szybkie crawlowanie

- Wbudowane pobieranie i przetwarzanie obrazów

- Darmowy i open source

Dla kogo: Deweloperzy i zespoły techniczne z niestandardowymi lub dużymi potrzebami scrapingu. Jedyny koszt to twój czas i zasoby serwera.

Tabela porównawcza narzędzi do pobierania obrazów

| Narzędzie | Łatwość obsługi | Formaty eksportu | Automatyzacja/Harmonogramy | Najlepsze dla | Cena (w przybliżeniu) |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Excel, Sheets, Notion | Tak | Zespoły nietechniczne, MŚP | Darmowy, od 15 USD/mies. |

| ParseHub | ★★★★☆ | CSV, JSON, Tableau | Tak (chmura) | Analitycy, złożone strony | Darmowy, od 189 USD/mies. |

| Octoparse | ★★★★☆ | CSV, Excel, JSON | Tak (chmura) | No-coderzy, masowa ekstrakcja | Darmowy, od 119 USD/mies. |

| Import.io | ★★★★☆ | API, CSV, DB | Tak (chmura) | Enterprise, integracje BI | Od 299 USD/mies. |

| Apify | ★★★☆☆ | JSON, CSV, API | Tak (chmura) | Deweloperzy, skalowalne projekty | Darmowy, od 49 USD/mies. |

| Mozenda | ★★★★☆ | CSV, Excel, API, DB | Tak | Enterprise, zespołowe workflow | Od 99 USD/mies. |

| VisualScraper | ★★★★☆ | CSV, JSON, XML, e-mail | Tak | Osoby indywidualne, małe projekty | Darmowy, od 49 USD/mies. (chmura) |

| WebHarvy | ★★★★☆ | Excel, CSV, JSON, SQL | Tak | Osoby bez kodowania, użytkownicy Windows | 99 USD jednorazowo |

| Diffbot | ★★★☆☆ | API (JSON, metadane) | Tak (API) | Enterprise, AI, deweloperzy | Darmowy, od 299 USD/mies. |

| Scrapy | ★★★☆☆ | Dowolny (własny kod) | Tak (niestandardowo) | Deweloperzy, własne pipeline’y | Darmowy |

Jak wybrać odpowiedni scrapper obrazów dla swojej firmy

Oto mój krótki przewodnik decyzyjny:

- Nie jesteś techniczny i chcesz szybkości oraz prostoty? Zacznij od albo .

- Musisz pobierać dane ze złożonych, dynamicznych stron? Wypróbuj lub .

- Enterprise, potrzebujesz integracji i wsparcia? Sprawdź , lub .

- Jesteś deweloperem i chcesz pełnej kontroli? lub będą najlepszym wyborem.

- Potrzebujesz tylko szybkiego, darmowego narzędzia do małych zadań? to solidny wybór.

Zawsze korzystaj z darmowych okresów próbnych lub planów free — uruchom mały testowy scraping na docelowej stronie, aby sprawdzić, które narzędzie najlepiej pasuje do twojego procesu i potrzeb danych.

Podsumowanie: znajdź idealny scrapper obrazów na 2026 rok

Wizualna skarbnica internetu tylko czeka, aż po nią sięgniesz — o ile masz odpowiedni scrapper obrazów. Niezależnie od tego, czy budujesz katalog produktów, śledzisz konkurencję, czy zasilasz kolejną wiralową kampanię, te narzędzia mogą oszczędzić ci godziny pracy i trochę nerwów. Moja rada? Zacznij od realnego przypadku użycia, dopasuj do niego narzędzie, które odpowiada twoim umiejętnościom i budżetowi, i nie bój się eksperymentować.

A jeśli chcesz zobaczyć, jak łatwe może być pobieranie obrazów, i wypróbuj je w praktyce. Twój palec od Ctrl+S będzie ci wdzięczny.

Więcej pogłębionych materiałów o scrapingu znajdziesz na .

FAQ

1. Czym jest narzędzie do pobierania obrazów i jak działa?

Narzędzie do pobierania obrazów automatyzuje proces wyciągania obrazów (lub ich adresów URL) ze stron internetowych. Większość narzędzi pozwala wskazać, co chcesz pobrać (za pomocą AI, point-and-click albo kodu), a potem masowo zbiera i eksportuje obrazy — oszczędzając godziny ręcznej pracy.

2. Czy mogę korzystać z narzędzi do pobierania obrazów bez umiejętności kodowania?

Jak najbardziej. Narzędzia takie jak , i są stworzone z myślą o użytkownikach nietechnicznych i oferują sterowanie językiem naturalnym lub interfejsy wizualne.

3. Jaka jest różnica między darmowymi a płatnymi narzędziami do pobierania obrazów?

Darmowe narzędzia świetnie nadają się do małych, okazjonalnych zadań, ale mogą mieć ograniczenia dotyczące wolumenu, funkcji lub wsparcia. Płatne narzędzia oferują więcej automatyzacji, przetwarzania w chmurze i zaawansowanych funkcji — idealne dla biznesu i potrzeb enterprise.

4. Jak wyeksportować obrazy do Excela, Google Sheets lub Notion?

Większość nowoczesnych scrapperów (takich jak ) pozwala jednym kliknięciem eksportować wyniki bezpośrednio do Excela, Sheets, Notion lub Airtable. Inne oferują pobieranie CSV/JSON albo integrację przez API do niestandardowych procesów.

5. Czy pobieranie obrazów z dowolnej strony jest legalne?

Zawsze należy respektować regulamin strony i prawa autorskie. Pobieraj tylko publicznie dostępne obrazy i nie używaj zeskrobanych treści do celów komercyjnych bez zgody. W razie wątpliwości skonsultuj się z prawnikiem albo używaj obrazów wyłącznie do wewnętrznej analizy.

Gotowy, by uczynić pobieranie obrazów najłatwiejszą częścią swojego workflow? Wypróbuj kilka narzędzi z tej listy i zobacz, które najbardziej ci odpowiada — twój kolejny duży projekt może być dosłownie jedno scrapowanie stąd.

Dowiedz się więcej: