Moja pierwsza próba automatyzacji przeglądarki: późny wieczór, zimna kawa i arkusz pełen linków do produktów, które odkładałem na później, bo bałem się żmudnego kopiuj-wklej. Musiał istnieć lepszy sposób.

I istnieje. Automatyzacja przeglądarki przeszła drogę od niszowego triku dla programistów do kluczowego narzędzia biznesowego. Ale sieć robi się coraz bardziej wymagająca — strony ładują treści dynamicznie, ukrywają dane za przyciskami i bez przerwy wyskakują z nich okienka.

Oto 15 narzędzi do automatyzacji przeglądarki, które przetestowałem — w tym AI scrapery, takie jak — dopasowane do różnych poziomów umiejętności i zastosowań.

Czym jest automatyzacja przeglądarki? Odkrywając potencjał automatyzacji sieci i web scrapingu

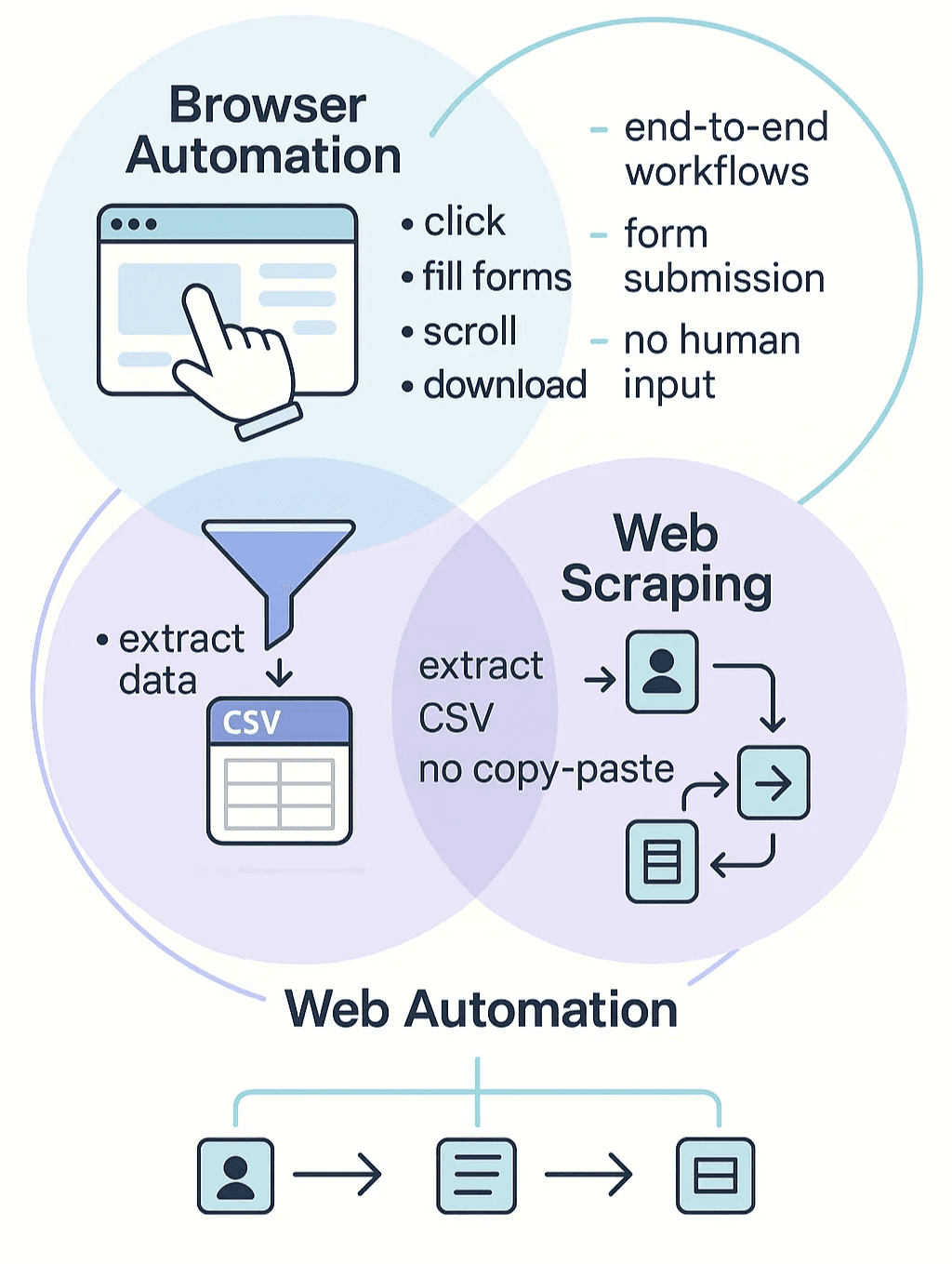

Rozbijmy to na części: automatyzacja przeglądarki to po prostu oprogramowanie, które naśladuje to, co robisz w przeglądarce — klika linki, wypełnia formularze, przewija strony, pobiera pliki — bez twojego udziału. Traktuj to jak cyfrowego asystenta, który bez przerwy powtarza internetowe zadania, których wolałbyś nie robić sam ().

Web scraping to specjalna odmiana automatyzacji przeglądarki, nastawiona na wydobywanie danych ze stron internetowych i zamienianie ich w uporządkowaną formę — na przykład arkusz kalkulacyjny albo bazę danych — żeby dało się z nich realnie korzystać. Koniec z kopiuj-wklej. Automatyzacja sieci to szersze pojęcie obejmujące jedno i drugie: chodzi o automatyzowanie każdej interakcji z aplikacjami webowymi, od wyciągania danych po wysyłanie formularzy, a nawet uruchamianie całych procesów ().

Dlaczego automatyzacja przeglądarki stała się dziś tak ważna? Współczesne strony są dynamiczne i mocno oparte na JavaScript. Treści ładują się podczas przewijania, przyciski ujawniają ukryte informacje, a czasem trzeba się zalogować albo przeklikać kilka ekranów, by dotrzeć do danych. Stare scrapery, które po prostu pobierają statyczny HTML, nie dają rady. Narzędzia do automatyzacji przeglądarki faktycznie sterują prawdziwą przeglądarką (czasem w trybie headless — bez interfejsu), więc potrafią obsłużyć takie dynamiczne treści i zasymulować rzeczywiste działania użytkownika ().

Krótko mówiąc: automatyzacja przeglądarki to sekretne paliwo do wyciągania danych i interakcji ze współczesną siecią, szczególnie wtedy, gdy wszystko zaczyna się komplikować.

Dlaczego automatyzacja przeglądarki ma znaczenie dla nowoczesnych firm

Porozmawiajmy o wartości biznesowej. Automatyzacja przeglądarki i web scraping nie są już tylko dla technicznych geeków — dziś są krytyczne dla sprzedaży, ecommerce, operacji i praktycznie każdego zespołu, który opiera się na danych z sieci.

Oto dlaczego:

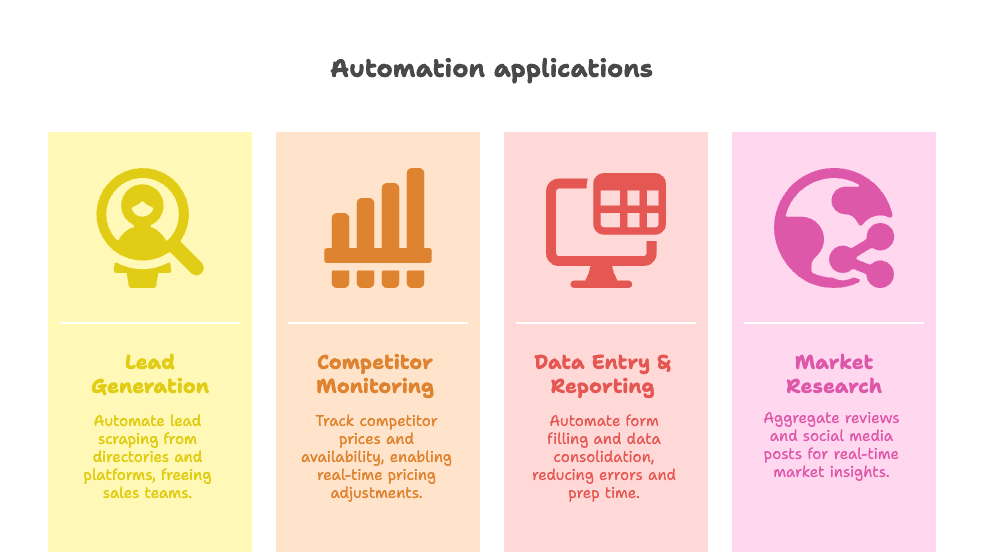

- Pozyskiwanie leadów: Wyciągaj świeże leady z katalogów firm, LinkedIn czy Google Maps, nawet kiedy śpisz. Zespoły sprzedaży korzystające z automatyzacji raportują, że spędzają o 82% więcej czasu na faktycznej sprzedaży, a nie na polowaniu na dane kontaktowe ().

- Monitorowanie konkurencji i śledzenie cen: Zespoły ecommerce używają botów do codziennego monitorowania cen konkurencji i dostępności produktów, a własne ceny dostosowują niemal w czasie rzeczywistym ().

- Wprowadzanie danych i raportowanie: Automatyzuj wypełnianie formularzy, scalaj dane z wielu źródeł i eliminuj błędy ludzkie. Jedna firma z branży ochrony zdrowia zmniejszyła ręczne wprowadzanie danych o 60% i skróciła czas przygotowania raportów o 40% ().

- Badania rynku: Zbieraj recenzje, ogłoszenia lub posty z mediów społecznościowych, by uzyskać wgląd w dane w czasie rzeczywistym, których ręcznie po prostu nie da się zebrać.

A liczby to potwierdzają:

- Prawie to dziś boty — w dużej mierze związane z automatyzacją i scrapingiem.

- wykorzystuje web scraping do wspierania projektów AI i analityki.

- w pierwszym roku to nic niezwykłego w przypadku inwestycji w automatyzację cyfrową.

Oto krótka tabela popularnych scenariuszy biznesowych i korzyści z automatyzacji przeglądarki:

| Scenariusz biznesowy | Korzyść z automatyzacji |

|---|---|

| Pozyskiwanie leadów | Szybko buduje listy leadów, uwalnia handlowców od żmudnego domykania sprzedaży |

| Śledzenie cen | Bieżąca wiedza o rynku, dynamiczne ceny, natychmiastowa reakcja na zmiany u konkurencji |

| Wprowadzanie danych i raportowanie | Eliminuje męczące kopiuj-wklej, ogranicza błędy, utrzymuje dane na bieżąco |

| Badania rynku i analiza konkurencji | Agreguje duże zbiory danych do analizy, wspiera strategię opartą na danych |

W skrócie: automatyzacja przeglądarki to sposób, w jaki nowoczesne firmy działają szybciej, dokładniej i bardziej konkurencyjnie.

Kategorie narzędzi do automatyzacji przeglądarki: od AI Web Scraper po rozwiązania no-code

Nie wszystkie narzędzia do automatyzacji przeglądarki są sobie równe. W zależności od twojego zaplecza i potrzeb, warto wybierać spośród czterech głównych kategorii:

- Narzędzia dla programistów: Dla osób, które lubią kodować (np. Selenium, Puppeteer, Playwright, Cypress). Maksymalna elastyczność, ale potrzebne są umiejętności programowania.

- Platformy no-code/low-code: Wizualne kreatory i rejestratory (jak Browserflow, Axiom.ai, UI Vision), które pozwalają osobom nietechnicznym automatyzować zadania przez klikanie albo przeciąganie bloków.

- Pakiety RPA dla firm: Rozbudowane platformy (UiPath, Automation Anywhere, Microsoft Power Automate) stworzone do wielkoskalowej, kompleksowej automatyzacji procesów biznesowych.

- Rozwiązania oparte na AI: Nowi gracze na rynku — narzędzia takie jak , które używają AI do „czytania” stron, adaptowania się do zmian i pozwalają automatyzować pracę kilkoma kliknięciami albo zwykłymi poleceniami po angielsku.

Każda kategoria ma swoje mocne strony. Programiści dostają pełną kontrolę, użytkownicy biznesowi — szybkość i prostotę, a narzędzia AI zacierają tę granicę, czyniąc zaawansowaną automatyzację dostępną dla każdego.

Thunderbit: AI Web Scraper dla każdego

Będę szczery: jestem stronniczy, ale z dobrego powodu. to narzędzie, które chciałbym mieć lata temu. To rozszerzenie do Chrome oparte na AI, które pozwala każdemu — tak, nawet jeśli nie znasz ani linijki kodu — wyciągać uporządkowane dane z dowolnej strony w zaledwie dwa kliknięcia.

Dlaczego Thunderbit się wyróżnia:

- AI Suggest Fields: Wystarczy kliknąć „AI Suggest Fields”, a Thunderbit odczyta stronę, zaproponuje najlepsze kolumny i sam skonfiguruje scraper.

- Scraping podstron: Potrzebujesz więcej szczegółów? Thunderbit może automatycznie odwiedzać każdą podstronę (na przykład strony produktów lub profili) i wzbogacać twoją tabelę danych.

- Scheduled Scraping: Ustaw i zapomnij. Zaplanuj regularne uruchamianie scrape’ów — idealne do monitorowania cen, sprawdzania stanów magazynowych albo cyklicznego pozyskiwania leadów.

- Gotowe szablony Instant Data Scraper: W przypadku popularnych serwisów, takich jak Amazon, Zillow czy Instagram, po prostu wybierz szablon i wyeksportuj dane jednym kliknięciem.

- Darmowy eksport danych: Pobierz wyniki jako CSV, Excel albo wyślij je bezpośrednio do Google Sheets, Airtable lub Notion — eksport nie jest blokowany paywallem.

- AI Data Transformation: Podsumowuj, kategoryzuj, tłumacz albo zmieniaj format danych w trakcie scrapowania — AI robi ciężką robotę ().

Dla kogo jest to narzędzie? Zespoły sprzedaży, operatorzy ecommerce, agenci nieruchomości, marketerzy — właściwie każdy, kto potrzebuje danych z sieci, ale nie chce walczyć z kodem albo kruchymi, starymi scraperami.

Co lubię najbardziej: Thunderbit dostosowuje się do zmian na stronie (koniec z psującymi się skryptami), radzi sobie ze stronami ciężkimi od JavaScript i sprawia, że scraping jest tak prosty jak zamówienie jedzenia na dowóz. Do tego można przetestować go za darmo, a płatne plany zaczynają się od zaledwie 9 USD miesięcznie (). Jeśli chcesz zobaczyć go w akcji, sprawdź albo zajrzyj po więcej wskazówek na .

Selenium: klasyczna platforma do automatyzacji przeglądarki

Selenium to OG automatyzacji przeglądarki — można je traktować jak scyzoryk szwajcarski dla programistów i inżynierów QA. Jest open source, obsługuje wszystkie główne przeglądarki i pozwala pisać skrypty w Javie, Pythonie, C#, JavaScripcie i wielu innych językach.

Mocne strony:

- Działa w różnych przeglądarkach i systemach: Funkcjonuje wszędzie, integruje się z CI/CD i stanowi podstawę wielu zautomatyzowanych zestawów testowych.

- Dojrzały ekosystem: Mnóstwo wtyczek, dostawców cloud grid i wsparcia społeczności.

- Darmowy i open source: Bez opłat licencyjnych.

Ograniczenia: Wymaga umiejętności programowania, bywa trudny w utrzymaniu (zwłaszcza gdy strony się zmieniają) i nie jest najszybszy przy masowych zadaniach scrapingowych. Ale jeśli jesteś programistą albo specjalistą QA, Selenium wciąż trzeba znać.

Puppeteer: headless browser automation do web scrapingu

Puppeteer od Google to biblioteka Node.js, która steruje Chrome lub Chromium — domyślnie w trybie headless. To ulubione narzędzie programistów, którzy chcą automatyzować Chrome, wyciągać dynamiczne treści albo generować PDF-y i zrzuty ekranu.

Mocne strony:

- Nowoczesne API JavaScript: Łatwo pisać skrypty do złożonych zadań w przeglądarce.

- Tryb headless: Szybki i oszczędny pod względem zasobów przy scrapingu lub testach.

- Świetny do dynamicznych stron: Bez problemu obsługuje strony mocno oparte na JavaScript.

Ograniczenia: Przede wszystkim dla użytkowników JavaScript/Node.js i głównie pod Chrome/Chromium (wsparcie dla Firefoksa się poprawia). Jeśli potrzebujesz Safari albo Edge, sprawdź Playwright.

Playwright: automatyzacja wieloprzeglądarkowa dla nowoczesnych aplikacji webowych

Playwright od Microsoftu to nowsze narzędzie z bardzo mocnym zapleczem. Obsługuje Chromium, Firefox i WebKit (silnik Safari) przez jedno API i działa w JavaScript, Pythonie, Javie oraz .NET.

Mocne strony:

- Prawdziwa automatyzacja wielu przeglądarek: Jeden skrypt, wszystkie przeglądarki.

- Automatyczne oczekiwanie i niezawodność: Mniej niestabilnych testów i błędów scrapingu.

- Świetne narzędzia debugowania: Inspector, trace viewer i codegen.

Ograniczenia: Ekosystem jest trochę młodszy niż w przypadku Selenium, ale szybko nadrabia. Jeśli zaczynasz nowy projekt, Playwright to świetny wybór.

Cypress: uproszczona automatyzacja sieci i testowanie

Cypress to przyjazne dla programistów narzędzie do testów end-to-end, stworzone z myślą o nowoczesnych aplikacjach webowych. Uruchamia testy wewnątrz przeglądarki, oferuje debugowanie w czasie rzeczywistym i jest uwielbiane przez zespoły front-endowe.

Mocne strony:

- Wszechstronny runner testów: Wizualny, interaktywny i szybki.

- Automatyczne oczekiwanie: Mniej niestabilnych testów, mniej ręcznego kodu opartego na timingach.

- Świetny do SPA: Sprawnie obsługuje zachowania asynchroniczne.

Ograniczenia: Historycznie skupiony na Chrome (teraz wspiera też Firefox/WebKit), nie jest projektowany pod scraping ani przepływy wielozakładkowe. Najlepszy do testowania własnych aplikacji, nie do scrapowania stron trzecich.

Narzędzia no-code i low-code do automatyzacji przeglądarki

Browserflow

Browserflow to rozszerzenie do Chrome, które pozwala wizualnie budować automatyzacje — bez kodu. Klikasz po stronie, nagrywasz działania, dopracowujesz kroki i automatyzujesz zadania takie jak scraping, wypełnianie formularzy czy wprowadzanie danych.

Najważniejsze cechy:

- Wizualny kreator przepływów: Przeciągaj i upuszczaj kroki, dodawaj pętle i warunki.

- Integracja z Google Sheets: Eksportuj dane bezpośrednio do Sheets.

- Planowanie w chmurze: Uruchamiaj przepływy według harmonogramu (w planach płatnych).

Idealne dla osób nietechnicznych, które chcą automatyzować powtarzalne zadania webowe bez zawracania głowy IT.

Axiom.ai

Axiom.ai to kolejne no-code rozszerzenie do Chrome, skupione na automatyzacji procesów biznesowych (). Budujesz boty krok po kroku, integrujesz je z Google Sheets, API, a nawet Zapier.

Najważniejsze cechy:

- Interfejs do budowy botów: Składaj działania wizualnie.

- Gotowe szablony: Szybki start dzięki typowym przepływom pracy.

- Planowanie w chmurze i integracje: Automatyzuj pracę między aplikacjami webowymi.

Świetne dla zespołów operacyjnych i każdego, kto chce automatyzować przenoszenie danych i zadania webowe bez pisania kodu.

UI Vision, Browser Automation Studio, TagUI

- UI Vision: Open-source’owe rozszerzenie do przeglądarki z komendami w stylu Selenium IDE i automatyzacją wizualną (rozpoznawanie obrazów, OCR). Darmowe, wieloplatformowe i potrafi nawet automatyzować aplikacje desktopowe.

- Browser Automation Studio: Aplikacja na Windows z wizualnym IDE do skryptów, obsługą wielowątkowości i możliwością kompilowania samodzielnych botów. Potężna, ale z bardziej stromą krzywą nauki.

- TagUI: Open-source’owe narzędzie RPA z linii komend, które pozwala pisać skrypty automatyzacji prostym angielskim (lub w innych językach). Świetne dla osób technicznych, które chcą darmowego i elastycznego rozwiązania.

Narzędzia RPA klasy enterprise

UiPath

UiPath to ciężka platforma RPA do automatyzacji wszystkiego — od zadań w przeglądarce po aplikacje desktopowe. Wizualny projektant przepływów, AI computer vision i solidna orkiestracja sprawiają, że to ulubieniec dużych organizacji.

Mocne strony: skala enterprise, silna społeczność, obsługa automatyzacji z udziałem użytkownika i bez jego udziału.

Ograniczenia: drogie rozwiązanie, a zaawansowane funkcje wymagają nauki. Najlepsze dla firm z dużymi ambicjami automatyzacyjnymi.

Automation Anywhere

Kolejny topowy pakiet RPA, Automation Anywhere oferuje automatyzację w modelu cloud-first, wizualny kreator botów i mocne integracje z aplikacjami biznesowymi ().

Mocne strony: przyjazny w obsłudze, natywny dla chmury, dobry zarówno do automatyzacji front-office, jak i back-office.

Ograniczenia: podobne koszty i złożoność jak UiPath, ale nadal solidny wybór dla przedsiębiorstw.

Microsoft Power Automate

Jeśli działasz w ekosystemie Microsoftu, Power Automate wnosi automatyzację przeglądarki i pulpitu do użytkowników Office 365 ().

Mocne strony: ścisła integracja z aplikacjami Microsoftu, przystępny cenowo dla obecnych klientów, łatwy dla użytkowników biznesowych.

Ograniczenia: mocno nastawiony na Windows, mniej dojrzały w zaawansowanych funkcjach RPA, ale szybko się rozwija.

BrowserStack Automate

BrowserStack Automate nie jest kreatorem skryptów — to platforma chmurowa do uruchamiania skryptów Selenium, Playwright lub Cypress na tysiącach kombinacji przeglądarek i urządzeń ().

Mocne strony: ogromny zasięg, równoległe uruchamianie testów, brak infrastruktury do utrzymania.

Ograniczenia: nie służy do budowania automatyzacji, ale jest niezbędny do testowania wieloprzeglądarkowego na dużą skalę.

Jak wybrać najlepsze narzędzie do automatyzacji przeglądarki dla siebie

Wybór odpowiedniego narzędzia może przypominać kupowanie nowego telefonu — każdy ma swoją opinię i wszystko zależy od tego, czego naprawdę potrzebujesz. Oto mój krok po kroku sposób:

- Określ cel: Chcesz wyciągać dane, automatyzować procesy biznesowe czy testować aplikacje webowe?

- Oceń umiejętności zespołu: Programiści? Wybierz narzędzia oparte na kodzie. Użytkownicy biznesowi? No-code albo rozwiązania AI, takie jak Thunderbit.

- Uwzględnij złożoność: Prosty scraping? Spróbuj Thunderbit albo Browserflow. Złożone przepływy między wieloma aplikacjami? Sprawdź UiPath lub Power Automate.

- Sprawdź kompatybilność przeglądarek: Potrzebujesz obsługi wielu przeglądarek? Playwright albo Selenium. Wystarczy tylko Chrome? Puppeteer, Cypress albo większość narzędzi no-code.

- Pomyśl o skali: Przy bardzo dużych zadaniach najlepiej skalują się narzędzia oparte na kodzie albo enterprise RPA. Przy umiarkowanych potrzebach rozszerzenia do przeglądarki w zupełności wystarczą.

- Budżet: Narzędzia open source są darmowe, ale wymagają więcej konfiguracji. Narzędzia no-code i AI są przystępne dla małych i średnich firm. Pakiety RPA to inwestycja.

Oto szybkie porównanie:

| Kategoria narzędzia | Łatwość użycia | Funkcje i możliwości | Idealni użytkownicy |

|---|---|---|---|

| Frameworki oparte na kodzie | Stroma krzywa nauki | Maksymalna elastyczność | Programiści, inżynierowie QA |

| Narzędzia no-code | Bardzo łatwe | Umiarkowana złożoność | Użytkownicy biznesowi, analitycy |

| Enterprise RPA | Średnia (szkolenie) | Kompleksowa automatyzacja | Duże organizacje, zespoły RPA |

| Narzędzia oparte na AI | Najłatwiejsze | Inteligentny, adaptacyjny scraping | Sprzedaż, operacje, użytkownicy nietechniczni |

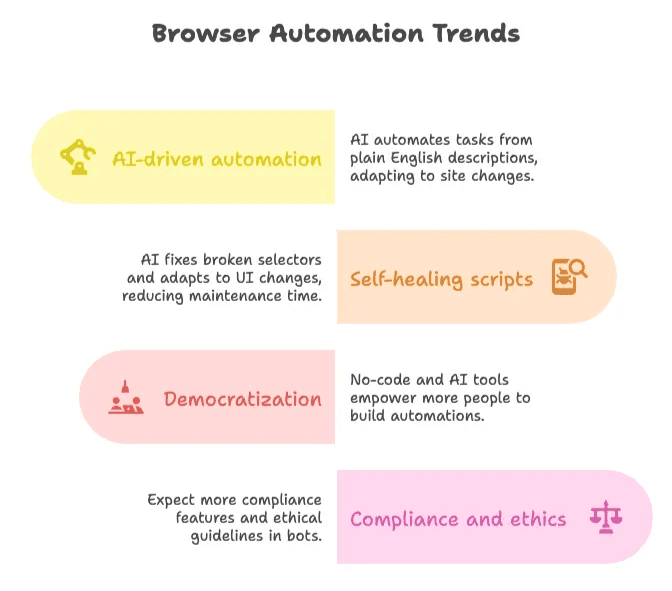

Przyszłe trendy w automatyzacji przeglądarki, web scrapingu i technologii AI Web Scraper

- Automatyzacja oparta na AI: Narzędzia takie jak Thunderbit wyznaczają kierunek, pozwalając użytkownikom opisywać zadania prostym angielskim i automatycznie dostosowując się do zmian na stronach ().

- Samonaprawiające się skrypty: AI potrafi dziś naprawiać uszkodzone selektory i dostosowywać się do zmian w interfejsie, skracając czas utrzymania nawet o 50% ().

- Demokratyzacja: Coraz więcej „obywatelskich developerów” tworzy własne automatyzacje dzięki narzędziom no-code i AI ().

- Zgodność i etyka: W miarę jak boty stają się coraz powszechniejsze, można się spodziewać większej liczby wbudowanych funkcji zgodności i wytycznych etycznych ().

Wniosek jest prosty: automatyzacja przeglądarki staje się coraz potężniejsza i bardziej przyjazna użytkownikom. Jeśli jeszcze jej nie używasz, zostawiasz czas i pieniądze na stole.

Podsumowanie: przyspiesz swój biznes dzięki odpowiedniemu narzędziu do automatyzacji przeglądarki

Automatyzacja przeglądarki to nie tylko trend technologiczny — to kręgosłup nowoczesnego, opartego na danych biznesu. Niezależnie od tego, czy prowadzisz jednoosobową działalność, czy pracujesz w firmie z listy Fortune 500, odpowiednie narzędzie może oszczędzić ci godzin pracy, zwiększyć dokładność i odblokować wnioski, których wcześniej nie brałeś pod uwagę.

Moja rada? Zacznij od małego kroku. Wybierz jedno narzędzie z tej listy — jeśli chcesz najprostszy i najdokładniejszy web scraping bez kodu, to świetne miejsce na start. Przetestuj je na prawdziwym zadaniu, zobacz zwrot z inwestycji na własne oczy, a potem skaluj rozwiązanie wraz z rozwojem firmy.

I pamiętaj: przyszłość należy do tych, którzy automatyzują. Chwyć więc swojego cyfrowego asystenta, pożegnaj się z nudną pracą w sieci i wróćmy do ciekawszych rzeczy.

FAQ

-

Jaka jest różnica między automatyzacją przeglądarki, web scrapingiem i automatyzacją sieci?

Automatyzacja przeglądarki naśladuje ludzkie działania w przeglądarce — klikanie, przewijanie i wypełnianie formularzy. Web scraping skupia się na wyciąganiu uporządkowanych danych (na przykład tabel) ze stron internetowych. Automatyzacja sieci to szersza kategoria, która obejmuje oba te obszary i każdy zadanie automatyzowane przez przeglądarkę — takie jak wysyłanie formularzy, zbieranie danych czy pełne przepływy pracy.

-

Dlaczego firmy inwestują w automatyzację przeglądarki?

Bo oszczędza czas, zmniejsza liczbę błędów i podnosi wydajność. Zespoły sprzedaży zbierają leady, ecommerce śledzi ceny, a operacje automatyzują wprowadzanie danych. Badania pokazują zwrot z inwestycji rzędu 30–200% w pierwszym roku, a 65% firm wykorzystuje dane z sieci do projektów AI i analityki.

-

Nie jestem programistą — czy mimo to mogę scrapować strony?

Tak! Narzędzia takie jak są stworzone dla osób bez kodowania. Wystarczy zainstalować rozszerzenie do Chrome, kliknąć „AI Suggest Fields”, a Thunderbit sam wyciągnie dla ciebie uporządkowane dane — nawet z dynamicznych stron. Jest szybki, dokładny i można go przetestować za darmo. Idealny dla zespołów sprzedaży, ecommerce i badań.

Dowiedz się więcej: