Świat asystentów AI i frameworków agentowych rozwija się w zawrotnym tempie, ale jedno się nie zmieniło: wszyscy chcą rozwiązań szybszych, lżejszych i łatwiejszych w instalacji. Widziałem to na własne oczy — niezależnie od tego, czy jesteś samotnym deweloperem majstrującym przy Raspberry Pi, czy szefem IT próbującym utrzymać koszty chmury w ryzach, popyt na rozwiązania typu „minimalna instalacja” jest wszędzie. Ostatnio coraz częściej dostaję pytania o lekkie alternatywy dla OpenClaw. Ludzie chcą wiedzieć: czy da się uzyskać moc OpenClaw bez ciężkiej instalacji, nadmiernego zużycia pamięci i problemów operacyjnych?

Jeśli szukasz lekkiej alternatywy dla OpenClaw albo zależy Ci na instalacji o małym śladzie zasobów, jesteś w dobrym miejscu. W tym przewodniku wyjaśnię, co naprawdę oznacza „minimalna instalacja OpenClaw”, dlaczego ma to znaczenie i jak ocenić najlepsze lekkie opcje pod kątem Twoich potrzeb — niezależnie od tego, czy działasz na starszym sprzęcie, wdrażasz rozwiązanie na dużą skalę, czy po prostu chcesz uniknąć kolejnej „zupy zależności” na serwerze.

Czym jest lekka alternatywa dla OpenClaw?

Zacznijmy od podstaw: co mamy na myśli, mówiąc o „lekkiej alternatywie dla OpenClaw”?

OpenClaw to hostowana samodzielnie brama i warstwa orkiestracji dla agentowych asystentów. Mówiąc prościej, to platforma łącząca interfejsy czatu — takie jak aplikacje webowe, desktopowe czy komunikatory — z modelami AI i narzędziami, zarządzając m.in. pamięcią, stanem i bezpiecznym wykonywaniem kodu (). Jest jednak pewien haczyk: standardowa instalacja OpenClaw opiera się na Dockerze, obejmuje wiele usług i zalecane minimum 2 GB RAM już dla samej bramy — zanim w ogóle uruchomisz duże modele językowe.

Lekka alternatywa to każde narzędzie, framework lub platforma, które dostarcza podobne możliwości „asystenta” lub „agenta” jak OpenClaw, ale przy mniejszym rozmiarze instalacji, niższym zużyciu pamięci/CPU i prostszym procesie konfiguracji. Myśl o wdrożeniach w jednym kontenerze, minimalnej liczbie zależności i możliwości uruchomienia na skromnym sprzęcie albo w środowiskach o ograniczonych zasobach.

Najważniejsze różnice między standardową instalacją OpenClaw a lekkimi/minimalnymi alternatywami zwykle sprowadzają się do:

- Złożoności instalacji: Lekkie opcje często działają w jednym kontenerze Docker albo nawet jako pojedynczy plik binarny, podczas gdy domyślna konfiguracja OpenClaw może wymagać wielu kontenerów i trwałych wolumenów.

- Śladu zasobów: Minimalne alternatywy są projektowane z myślą o mniejszym zużyciu RAM, CPU i miejsca na dysku — czasem nawet 1–2 GB RAM dla całego stosu.

- Zakresu funkcji: W zamian za lżejszą i łatwiejszą w utrzymaniu instalację możesz zrezygnować z części zaawansowanych funkcji bramy lub piaskownicy.

Krótko mówiąc, lekka alternatywa dla OpenClaw polega na uzyskaniu kluczowych korzyści — czatu AI, integracji narzędzi i pamięci — bez zbędnego balastu.

Dlaczego użytkownicy szukają rozwiązań o małym śladzie zasobów OpenClaw

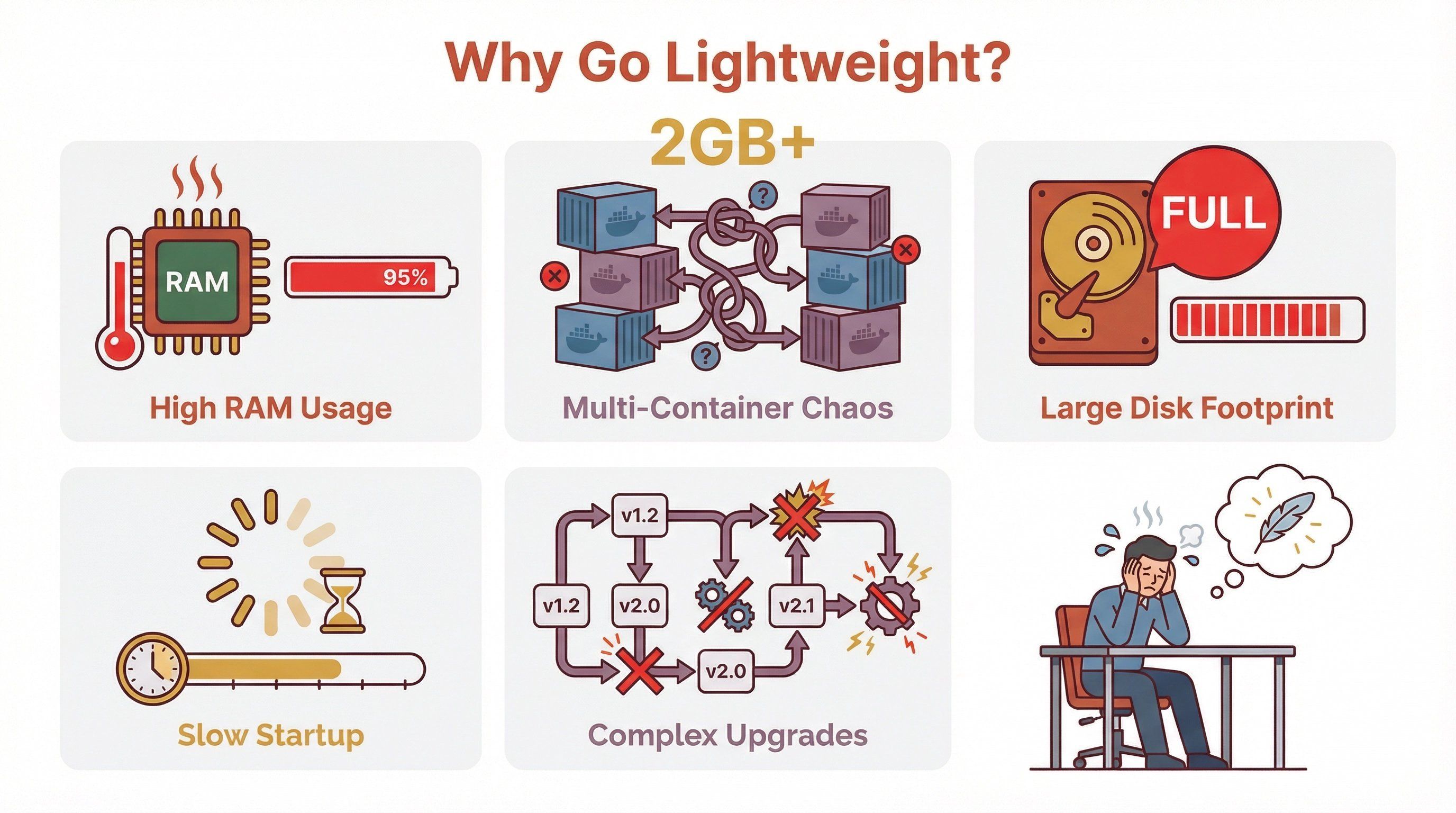

Dlaczego więc wszyscy nagle są tak zafascynowani minimalnymi instalacjami i lekkimi frameworkami? Z rozmów z użytkownikami i zespołami IT wynika, że powody są bardzo uniwersalne:

- Szybsza konfiguracja i wdrożenie: Nikt nie chce spędzać godzin na walce z plikami Docker Compose czy rozwiązywaniu konfliktów zależności. Minimalna instalacja oznacza, że działasz po kilku minutach, a nie po kilku godzinach.

- Mniejsze zużycie zasobów: Niezależnie od tego, czy wdrażasz rozwiązanie na chmurowej maszynie wirtualnej, Raspberry Pi czy starym laptopie, każdy gigabajt RAM i każdy cykl CPU ma znaczenie. Mniejszy ślad zasobów oznacza więcej instancji, niższe rachunki za chmurę albo po prostu brak spowolnień.

- Łatwiejsze utrzymanie: Im mniej ruchomych części, tym mniej rzeczy może się zepsuć. Lekkie alternatywy są często łatwiejsze do aktualizacji, tworzenia kopii zapasowych i zabezpieczenia.

- Lepsze dopasowanie do scenariuszy edge i offline: Jeśli potrzebujesz uruchomić asystenta lokalnie, w laboratorium albo w środowisku wrażliwym na prywatność, minimalne instalacje są wybawieniem.

| Problem | Dlaczego to ważne |

|---|---|

| Wysokie wymagania RAM/CPU | Ogranicza wdrożenie na starszym lub mniejszym sprzęcie |

| Konfiguracja wielu kontenerów | Zwiększa złożoność i liczbę rzeczy do utrzymania oraz zabezpieczenia |

| Duży ślad na dysku | Problem na urządzeniach edge lub przy małej przestrzeni |

| Wolny start | Utrudnia szybkie prototypowanie i skalowanie |

| Złożone aktualizacje | Więcej komponentów = więcej problemów przy upgrade’ach |

Jeśli kiedykolwiek próbowałeś uruchomić OpenClaw na chmurowej maszynie z 2 GB RAM i widziałeś, jak wszystko działa ślamazarnie, dokładnie wiesz, o co chodzi.

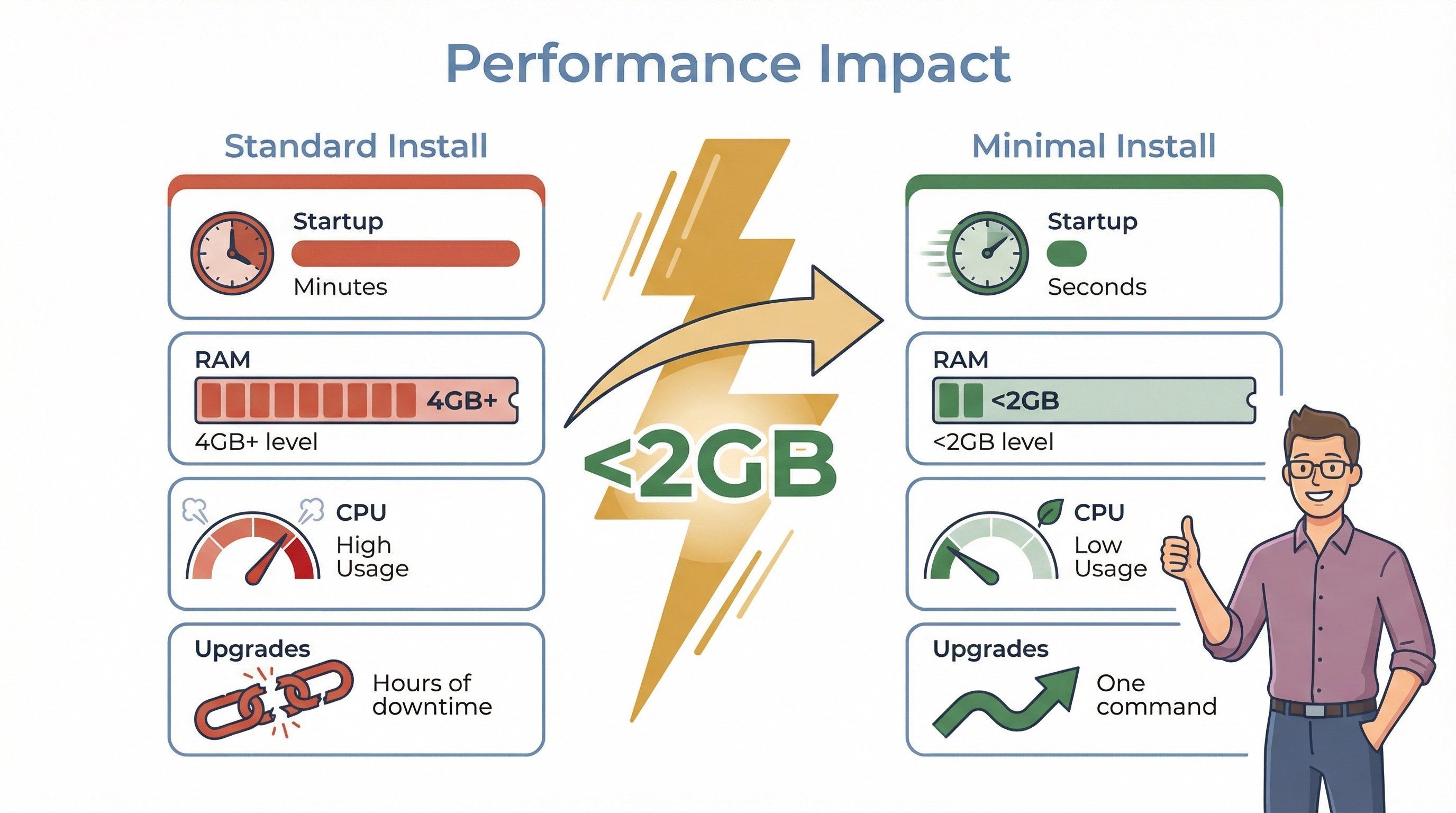

Jak minimalna instalacja OpenClaw wpływa na wydajność systemu

Na chwilę wejdźmy w technikalia. Rozmiar i złożoność platformy asystenta mają bezpośredni wpływ na wydajność systemu, stabilność i skalowalność.

Standardowe instalacje OpenClaw (z Dockerem, pamięcią i piaskownicą) mogą bez problemu zużywać ponad 2 GB RAM już sama platforma, zanim załadujesz model językowy lub bazę wektorową (). Dodaj do tego lokalną inferencję LLM albo przetwarzanie dokumentów, a robi się 4 GB, 8 GB lub więcej.

Minimalne alternatywy instalacyjne są projektowane tak, aby:

- Uruchamiać się szybciej: Instalacje w jednym kontenerze lub jako pojedynczy plik binarny mogą być gotowe w kilka sekund, a nie minut.

- Zużywać mniej pamięci: Przenosząc inferencję LLM do zewnętrznych API albo korzystając z mniejszych modeli lokalnych, możesz utrzymać zużycie RAM poniżej 2 GB dla całego stosu ().

- Zmniejszać obciążenie CPU: Mniejszy narzut orkiestracji oznacza więcej zasobów na właściwe zadania AI.

- Obniżać ryzyko konfliktów: Mniej usług = mniej kolizji portów, niezgodności zależności i niespodzianek przy aktualizacjach.

Oto przykład z życia: zaleca minimum 2 GB RAM (4 GB preferowane), a sugeruje co najmniej 4 GB. Dla porównania może działać w trybie pojedynczego użytkownika z jednym kontenerem i znacznie mniejszym śladem pamięci — zwłaszcza jeśli korzystasz ze zdalnych API LLM.

Możliwe usprawnienia wydajności:

- Czas uruchamiania skrócony z minut do sekund

- Zużycie RAM mniejsze o 50% lub więcej

- Niższe wykorzystanie CPU w czasie bezczynności

- Szybsze aktualizacje i mniej przestojów

Kluczowe kryteria wyboru lekkiej alternatywy dla OpenClaw

Nie wszystkie „lekkie” alternatywy są sobie równe. Oto, na co polecam zwracać uwagę przy ocenie opcji:

- Rozmiar instalacji: Jak duży jest plik do pobrania? Czy wdrożysz rozwiązanie jako pojedynczy kontener Docker lub binarkę?

- Zużycie pamięci: Jakie jest bazowe zużycie RAM platformy (bez inferencji LLM)?

- Szybkość uruchomienia: Jak szybko przejdziesz od

docker rundo działającego asystenta? - Łatwość aktualizacji: Czy proces upgrade’u jest prosty, czy co miesiąc będziesz walczyć z demonami zależności?

- Kompatybilność: Czy wspiera potrzebne Ci modele LLM, narzędzia i integracje?

- Zestaw funkcji: Czy dostajesz najważniejsze funkcje asystenta, czy za minimalizm płacisz zbyt dużą cenę?

- Bezpieczeństwo i izolacja: Czy platforma zapewnia piaskownicę lub izolację dla wykonywania narzędzi?

Oto szybka lista kontrolna, z której możesz skorzystać:

| Kryterium | Dlaczego to ważne | Na co zwrócić uwagę |

|---|---|---|

| Rozmiar instalacji | Szybkie wdrożenie, mniej potrzebnego miejsca | Obraz <500 MB, pojedyncza binarka |

| Zużycie pamięci | Działanie na mniejszym sprzęcie, niższy koszt chmury | Bazowo <2 GB RAM |

| Szybkość startu | Szybkie prototypowanie, mniej przestojów | Gotowość w <30 sekund |

| Aktualizacje | Mniej utrzymania, mniej niespodzianek | Upgrade jednym poleceniem, stabilne API |

| Kompatybilność | Brak blokady dostawcy, lepsza przyszłościowość | API OpenAI/Ollama, model wtyczek |

| Funkcje | Nie trać kluczowych możliwości dla minimalizmu | Pamięć, narzędzia, uwierzytelnianie, RAG |

| Bezpieczeństwo | Bezpieczne wykonywanie narzędzi, mniejsze ryzyko | Izolacja kontenera lub procesu |

Sztuka polega na znalezieniu równowagi między małym śladem zasobów a funkcjami, których naprawdę potrzebujesz. Czasem „mniej znaczy więcej”, ale czasem „mniej” oznacza po prostu „za mało”.

Popularne lekkie alternatywy dla OpenClaw do minimalnej instalacji

Na podstawie najnowszych zestawień branżowych i własnych badań, oto kilka najlepszych lekkich alternatyw dla OpenClaw w różnych scenariuszach:

1.

- Najlepsze dla: instalacji dla jednego użytkownika i z minimalnym zużyciem zasobów

- Dlaczego jest lekkie: jeden kontener Docker, opcjonalny tryb dla pojedynczego użytkownika, trwały wolumen na dane, możliwość korzystania ze zdalnych API LLM przy minimalnym użyciu RAM/CPU

- Unikalne mocne strony: działa także offline, obsługuje endpointy zgodne z Ollama i OpenAI, aktywna społeczność ()

- Komis: nie odtwarza natywnie modelu bramy/wielu interfejsów OpenClaw; izolacja narzędzi jest podstawowa

2.

- Najlepsze dla: zespołów wieloosobowych, które chcą znanego doświadczenia w stylu „klona ChatGPT”

- Dlaczego jest lekkie: wdrożenie przez Docker, podane minimalne wymagania (2 GB RAM), można uruchomić jako pojedynczą usługę dla małych zespołów

- Unikalne mocne strony: bezpieczne uwierzytelnianie wielu użytkowników, szerokie wsparcie dostawców, ostatnie wzmocnienia bezpieczeństwa ()

- Komis: bardziej skoncentrowane na aplikacji webowej; nie jest bramą dla wielu powierzchni czatu; część funkcji wymaga dodatkowych usług

3.

- Najlepsze dla: prywatnego, kompleksowego środowiska AI z minimalną konfiguracją

- Dlaczego jest lekkie: instalacja przez Docker lub aplikację desktopową, wbudowana baza wektorowa, do podstawowego użycia działa nawet przy 2 GB RAM

- Unikalne mocne strony: wsparcie dla wielu użytkowników, agenci, pipeline’y dokumentów, podejście privacy-first ()

- Komis: nie jest bramą dla wielu interfejsów czatu; izolacja narzędzi zależy od architektury

4.

- Najlepsze dla: prywatnego Q&A na dokumentach i aplikacji uwzględniających kontekst

- Dlaczego jest lekkie: profile Docker Compose, przy zewnętrznych API LLM może działać przy umiarkowanych zasobach

- Unikalne mocne strony: zgodność z API OpenAI, mocny nacisk na prywatność, elastyczne opcje magazynu wektorów ()

- Komis: nie jest zamiennikiem typu drop-in dla komunikacyjnej bramy OpenClaw

5.

- Najlepsze dla: wizualnego kreatora workflow i agentów z minimalną instalacją

- Dlaczego jest lekkie: instalacja przez NPM lub Docker, domyślnie SQLite, może działać jako pojedyncza usługa

- Unikalne mocne strony: wizualne płótno workflow, ekosystem wtyczek, łatwe lokalne testowanie ()

- Komis: nie jest gotowym asystentem; trzeba samemu zbudować konektory

Porównanie lekkich alternatyw dla OpenClaw: tabela funkcji

Zestawmy te opcje obok siebie dla szybkiego porównania:

| Platforma | Ścieżka instalacji | Min. RAM (platforma) | Szybkość uruchomienia | Wielu użytkowników | Obsługa backendu LLM | Model narzędzi/wtyczek | Bezpieczeństwo/izolacja | Najlepsze dla |

|---|---|---|---|---|---|---|---|---|

| Open WebUI | Docker (pojedynczy) | Niski–średni | Szybkie | Opcjonalnie | Ollama, zgodne z OpenAI | Narzędzia w Pythonie | Podstawowe | Jeden użytkownik, minimalnie |

| LibreChat | Docker (wiele usług) | min. 2 GB (4 GB zalecane) | Szybkie | Tak | Wielu dostawców | Agenci, wtyczki | Wielousługowe | Zespoły, czat-centryczne |

| AnythingLLM | Docker/Desktop | 2 GB+ | Szybkie | Tak | Lokalny + hostowany | Agenci, API | Wbudowana baza wektorowa | Prywatne, all-in-one |

| PrivateGPT | Docker Compose | Średni | Szybkie | Opcjonalnie | Lokalny + hostowany | API RAG | Izolacja API | Prywatne Q&A na dokumentach |

| Flowise | NPM/Docker | Niski–średni | Szybkie | Opcjonalnie | Węzły dostawców | Wizualny kreator | SQLite/DB | Wizualny kreator workflow |

Uwaga: zużycie RAM może wzrosnąć, jeśli uruchamiasz lokalne LLM lub importujesz duże dokumenty. Przy naprawdę minimalnych instalacjach korzystaj ze zdalnych API LLM albo małych modeli.

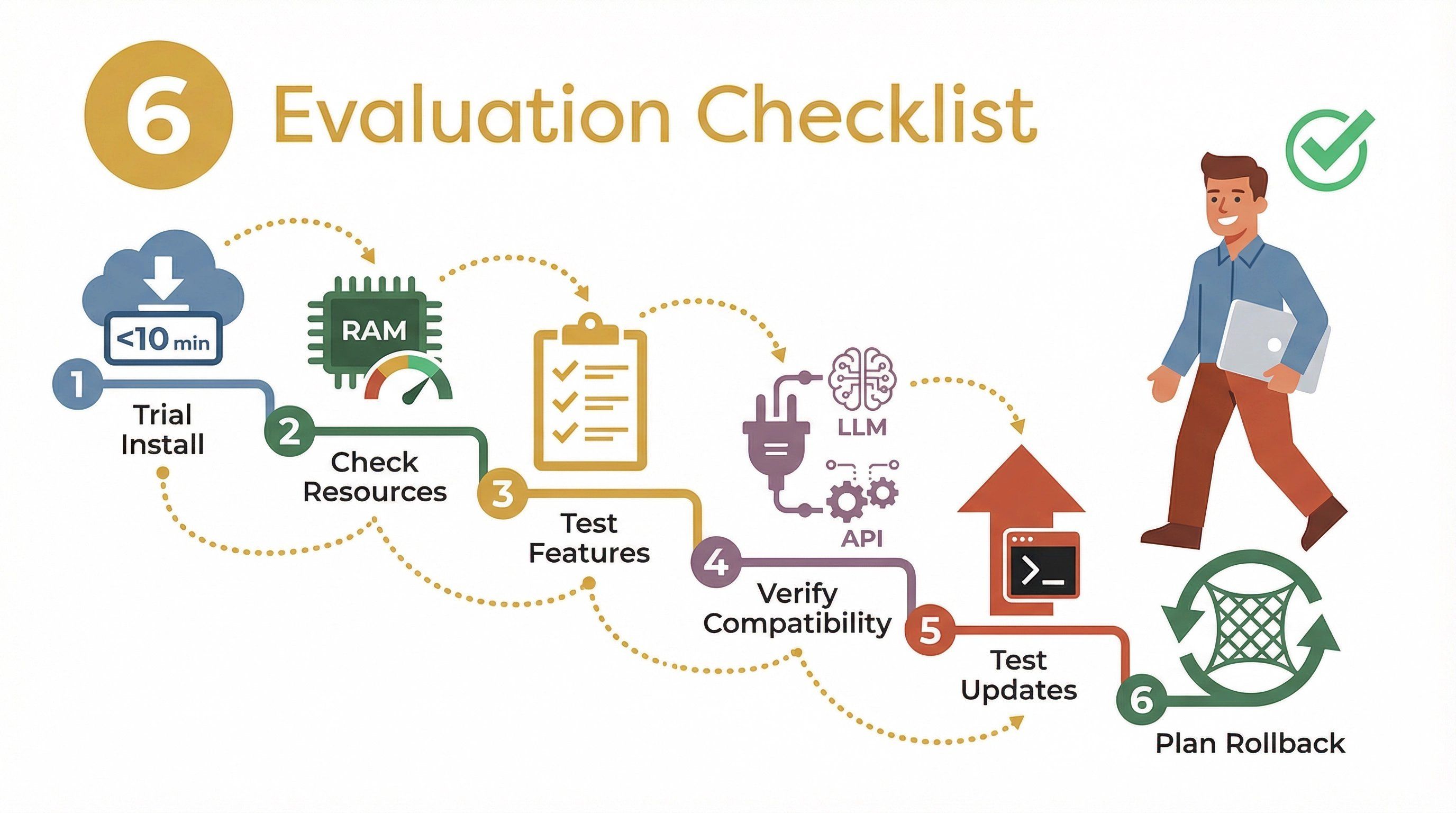

Praktyczne kroki do oceny i testowania rozwiązań minimalnej instalacji OpenClaw

Gotowy, by przetestować lekką alternatywę? Oto prosty framework oceny, którego używam:

- Instalacja próbna: Wdróż platformę w piaskownicy lub testowej maszynie wirtualnej. Zmierz czas instalacji i uruchomienia.

- Pomiar zużycia zasobów: Użyj narzędzi systemowych (np.

htoplubdocker stats), aby monitorować RAM i CPU w stanie bezczynności oraz podczas podstawowego użycia. - Uruchom podstawowe workflow: Przetestuj kluczowe funkcje — czat, wykonywanie narzędzi/wtyczek, pobieranie dokumentów itd.

- Sprawdź kompatybilność: Połącz się z preferowanymi LLM, wtyczkami lub zewnętrznymi API.

- Test aktualizacji: Spróbuj zaktualizować platformę i zobacz, jak płynny jest ten proces.

- Test w piaskownicy: Jeśli to możliwe, uruchamiaj wszystko w środowisku jednorazowym, aby w razie problemów łatwo wrócić do poprzedniego stanu.

Oto krótka lista kontrolna:

| Krok | Na co zwrócić uwagę |

|---|---|

| Instalacja/uruchomienie | <10 minut, bez złożonych zależności |

| Zużycie zasobów | <2 GB RAM bazowo, niski CPU w spoczynku |

| Test funkcji | Kluczowe funkcje asystenta działają zgodnie z oczekiwaniami |

| Kompatybilność | Łączy się z Twoimi LLM i narzędziami |

| Proces aktualizacji | Upgrade jednym poleceniem lub na miejscu |

| Wycofanie zmian | Łatwy powrót do poprzedniej wersji |

Typowe pułapki przy przechodzeniu na lekkie alternatywy dla OpenClaw

Przejście na minimalną instalację nie zawsze przebiega gładko. Oto najczęstsze pułapki — i sposoby, jak ich uniknąć:

- Brakujące funkcje: Niektóre lekkie platformy pomijają zaawansowane funkcje bramy lub piaskownicy. Upewnij się, że nie tracisz niczego krytycznego dla swojego workflow.

- Ograniczona dokumentacja: Mniejsze projekty mogą mieć skąpe materiały. Sprawdź fora społeczności lub zgłoszenia na GitHubie, jeśli potrzebujesz pomocy.

- Problemy z integracjami: Nie wszystkie wtyczki i narzędzia działają od razu po instalacji. Przetestuj najważniejsze integracje jak najwcześniej.

- Komplikacje migracyjne: Przenoszenie danych, takich jak historia czatu czy dokumenty, z OpenClaw na nową platformę może być trudne. Zaplanuj okno migracyjne i wykonaj kopię zapasową wszystkiego.

- Kompromisy w bezpieczeństwie: Prostsze instalacje czasem oznaczają mniejszą izolację lub słabsze ustawienia bezpieczeństwa. Utwardź wdrożenie (uwierzytelnianie, TLS, zapory).

Moja rada? Zacznij od projektu pilotażowego, dokładnie przetestuj wszystko i utrzymuj stare środowisko, dopóki nie będziesz pewien nowego.

Podsumowanie: jak wybrać właściwe rozwiązanie dla swoich potrzeb minimalnej instalacji

Wzrost popularności lekkich alternatyw dla OpenClaw to bezpośrednia odpowiedź na realne problemy związane z ciężkimi, złożonymi instalacjami. Niezależnie od tego, czy jesteś samotnym deweloperem, małym zespołem czy liderem IT w dużej firmie, istnieje opcja minimalnej instalacji, która da Ci potrzebne funkcje asystenta — bez zbędnego balastu.

Oto, co bym rekomendował:

- Określ funkcje niezbędne: Wiedz, bez czego nie możesz się obejść (wielu użytkowników, obsługa wtyczek, bezpieczeństwo).

- Skorzystaj z powyższych kryteriów i tabel porównawczych, aby zawęzić listę najlepiej dopasowanych alternatyw.

- Przetestuj i zmierz: Sprawdź w swoim środowisku, zmierz zużycie zasobów i kompatybilność.

- Zaplanuj migrację: Nie spiesz się — przenoś dane i workflow stopniowo.

I pamiętaj: „najlepsza” minimalna instalacja OpenClaw to ta, która pasuje do Twojego zastosowania, sprzętu i umiejętności zespołu. Lekkie nie musi znaczyć ograniczone — po prostu skupione.

Jeśli chcesz automatyzować pobieranie danych z sieci jako część workflow swojego asystenta, sprawdź — nasz oparty na AI web scraper zaprojektowany z myślą o minimalnej konfiguracji i maksymalnej produktywności. A jeśli interesują Cię głębsze analizy automatyzacji, scrapingu i narzędzi AI, zajrzyj na .

FAQ

1. Czym jest lekka alternatywa dla OpenClaw?

Lekka alternatywa dla OpenClaw to narzędzie lub framework, które oferuje podobne możliwości asystenta AI jak OpenClaw, ale przy mniejszym rozmiarze instalacji, niższym zużyciu pamięci/CPU i prostszej konfiguracji — idealne do scenariuszy minimalnej instalacji lub środowisk o ograniczonych zasobach.

2. Dlaczego powinienem interesować się rozwiązaniami o małym śladzie zasobów OpenClaw?

Rozwiązania o małym śladzie zasobów uruchamiają się szybciej, zużywają mniej RAM/CPU, są łatwiejsze w utrzymaniu i mogą działać na starszym sprzęcie lub w środowiskach edge/offline — dzięki czemu świetnie nadają się do szybkiego prototypowania i wdrożeń wrażliwych kosztowo.

3. Jakie są główne kompromisy związane z lekkimi alternatywami?

Możesz stracić część zaawansowanych funkcji (np. bramy dla wielu interfejsów czy wykonywania narzędzi w piaskownicy) i być zmuszony dodać dodatkowe komponenty, aby dorównać OpenClaw. Zawsze sprawdzaj, czy wspierane są funkcje, które są dla Ciebie niezbędne.

4. Jak ocenić, czy lekka alternatywa jest dla mnie odpowiednia?

Przetestuj proces instalacji, zmierz zużycie zasobów, uruchom kluczowe workflow, sprawdź kompatybilność z preferowanymi LLM i narzędziami oraz upewnij się, że platforma spełnia Twoje wymagania dotyczące bezpieczeństwa i aktualizacji.

5. Jakie są najpopularniejsze lekkie alternatywy dla OpenClaw?

Do najciekawszych opcji należą , , , i . Każde z nich ma własne mocne strony w różnych scenariuszach minimalnej instalacji.

Jeśli chcesz odchudzić swój stos i odzyskać RAM, wypróbuj jedno z tych rozwiązań minimalnej instalacji. A jeśli chcesz automatyzować ekstrakcję danych z sieci bez żadnych problemów z konfiguracją, zawsze chętnie pomoże.

Dowiedz się więcej