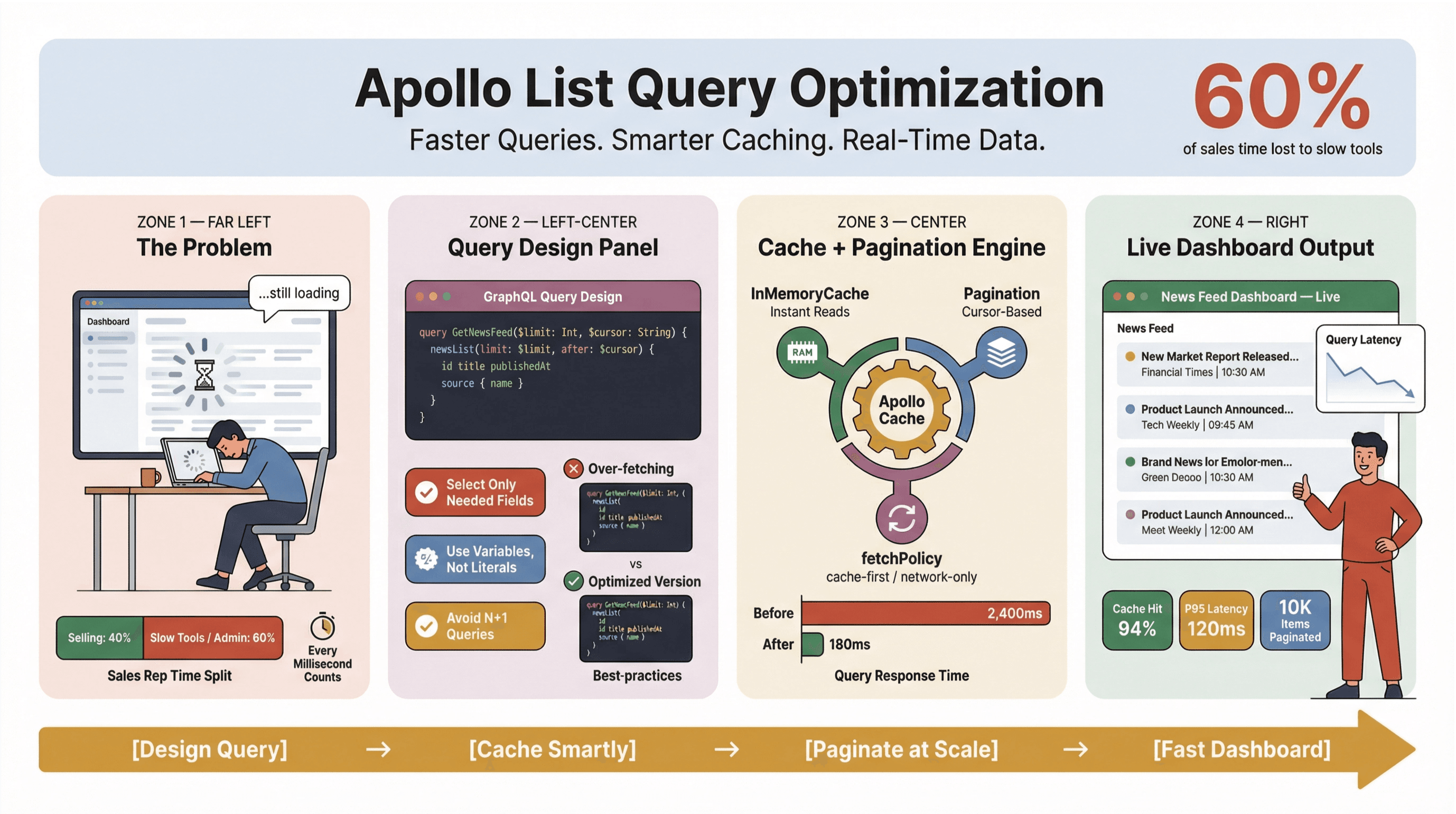

Optymalizacja zapytań do listy apollo to nie żadna techniczna fanaberia — to realna umiejętność przetrwania dla każdego, kto żyje z danych newsowych w czasie rzeczywistym, automatycznego zbierania wiadomości albo szybkich procesów sprzedażowo-operacyjnych. Widziałem to nie raz: jedno ociężałe zapytanie do listy potrafi zamienić dopieszczony dashboard w totalne wąskie gardło — handlowcy wpatrują się w kręcące się ładowanie, a operacje ratują się obejściami w arkuszach. W świecie, w którym , liczy się dosłownie każda milisekunda.

Jak więc doprowadzić do tego, żeby zapytania list w Apollo Client były szybkie jak błysk, niezawodne i gotowe na skalowanie — szczególnie gdy zbierasz newsy, śledzisz leady albo karmisz krytyczne dashboardy? W tym poradniku rozkładam na czynniki pierwsze najlepsze praktyki, które poznałem (czasem metodą „auć, już wiem”): od projektowania zapytań, przez cache i paginację, aż po integrację narzędzi no-code, takich jak , które automatyzują żmudne pozyskiwanie danych z newsów. Nieważne, czy jesteś developerem, PM-em, czy osobą, na którą zawsze spada wina, gdy dashboard zwalnia — to Twoja ściąga do wydajnych list w Apollo GraphQL (i tak, nawet jeśli w tle przewijają się misje apollo, tu chodzi o te „misje” w produkcie).

Dlaczego warto optymalizować zapytania list w Apollo? (apollo client list performance, optimize apollo list queries)

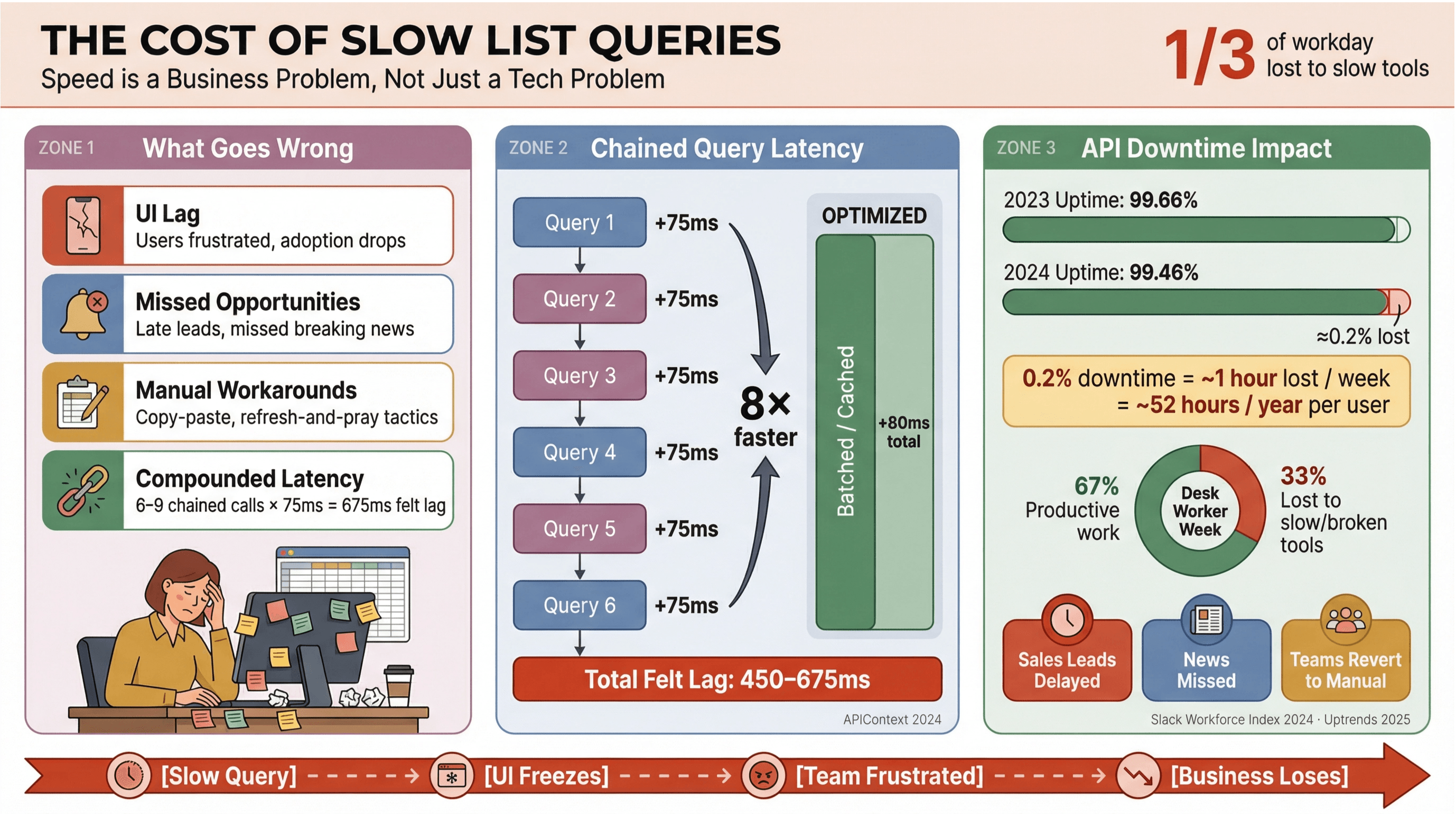

Nie ma co się oszukiwać: nikt nie chce czekać, aż załadują się nagłówki albo leady sprzedażowe. W środowiskach biznesowych — zwłaszcza tam, gdzie liczy się lub dane w czasie rzeczywistym — wolne zapytania list w Apollo nie tylko wkurzają. One po prostu kosztują: pieniądze, czas, decyzje i energię, a na końcu i tak wypychają ludzi z powrotem do ręcznej roboty. pokazuje, że pracownicy biurowi spędzają około jednej trzeciej dnia na zadaniach o niskiej wartości, często właśnie przez powolne albo porozrzucane narzędzia.

Co się dzieje, gdy zapytania list nie są zoptymalizowane:

- Opóźnienia w UI: użytkownicy czują zwłokę, rośnie frustracja, spada adopcja.

- Utracone okazje: w sprzedaży lub monitoringu newsów nawet kilka sekund może oznaczać przegapienie gorącego leada albo breaking news.

- Ręczne obejścia: zespoły wracają do kopiuj-wklej, arkuszy i strategii „odśwież i módl się”.

- Narastająca latencja: każde wolne wywołanie API się sumuje — jeśli proces uruchamia 6–9 zależnych zapytań, nawet 75 ms opóźnienia na call może urosnąć do 450–675 ms odczuwalnego laga ().

I to nie jest wyłącznie kwestia szybkości. — średni uptime spadł z 99,66% do 99,46% w zaledwie rok, co przekłada się na prawie godzinę straconej produktywności tygodniowo w aplikacjach, które intensywnie korzystają z list. Jeśli Twoja firma jedzie na newsach w czasie rzeczywistym, to ryzyko, na które zwyczajnie nie możesz sobie pozwolić.

Dobór właściwej struktury danych i pól (apollo graphql list best practices)

Jeden z najczęstszych błędów, które widzę (i tak — sam też w to wpadłem), to traktowanie każdego zapytania listy jak zapytania szczegółowego. W GraphQL możesz pobrać dokładnie to, czego potrzebujesz — więc korzystaj z tego bez wyrzutów sumienia. Nadmiarowe pobieranie danych to wróg wydajności, szczególnie w narzędziach do scrapowania newsów i dashboardach czasu rzeczywistego.

Dopasowanie pól pod zautomatyzowane pozyskiwanie newsów

Załóżmy, że budujesz feed z wiadomościami. Czy naprawdę potrzebujesz pełnej treści artykułu, wszystkich tagów, komentarzy i bio autora w zapytaniu listy? Zwykle: nie. Zobacz różnicę:

Wydajne zapytanie listy:

1query NewsFeed($after: String, $first: Int) {

2 newsFeed(after: $after, first: $first) {

3 edges {

4 cursor

5 node {

6 id

7 title

8 url

9 sourceName

10 publishedAt

11 }

12 }

13 pageInfo { endCursor hasNextPage }

14 }

15}Niewydajne zapytanie listy (tego nie rób):

1query NewsFeedTooHeavy($after: String, $first: Int) {

2 newsFeed(after: $after, first: $first) {

3 edges {

4 node {

5 id title url publishedAt

6 fullText

7 summary

8 entities { ... }

9 relatedArticles { ... }

10 }

11 }

12 }

13}Pierwsze zapytanie jest lekkie, konkretne i „do roboty” — idealne do rankingu, filtrowania i renderowania wierszy. Drugie? To w praktyce zapytanie szczegółowe w przebraniu: duże payloady i spowolnienie wszystkiego (, ).

Wskazówka: idź w podejście dwupoziomowe — w liście pobieraj tylko lekkie pola, a ciężkie szczegóły (np. pełny tekst czy wzbogacanie NLP) ładuj dopiero, gdy użytkownik otworzy element albo najedzie na niego.

Wykorzystanie cache Apollo Client dla szybszych zapytań (apollo client list performance)

Cache w Apollo Client to Twoja cicha supermoc, jeśli chcesz mieć responsywne listy. Przy sensownej konfiguracji pozwala:

- Zwracać powtarzane zapytania natychmiast (bez rundy do sieci)

- Zmniejszyć obciążenie serwera i koszty API

- Zapewnić płynną nawigację wstecz/dalej oraz zmianę filtrów

Cache nie jest jednak czarami — wymaga odrobiny ustawień i konsekwencji.

Ustawianie skutecznych polityk cache

Apollo wspiera kilka :

| Polityka | Co robi | Najlepsze zastosowanie dla list newsów |

|---|---|---|

| cache-first | Czyta z cache, pobiera z sieci, jeśli brakuje danych | Powrót do list, zmiana filtrów, nawigacja wstecz/dalej |

| network-only | Zawsze pobiera z sieci | Ręczne odświeżenie, „najnowsze nagłówki” |

| cache-and-network | Najpierw zwraca cache, potem aktualizuje odpowiedzią z sieci | Szybki pierwszy render + aktualizacja w tle (świetne dla feedów) |

| no-cache | Zawsze pobiera, nigdy nie zapisuje w cache | Jednorazowe wrażliwe zapytania (rzadko dla list) |

Dla danych newsowych w czasie rzeczywistym najbardziej lubię cache-and-network — użytkownik widzi wynik od razu, a aktualizacja dzieje się w tle. Uważaj tylko na „migotanie” UI, jeśli dane po odświeżeniu zmieniają kolejność ().

Wskazówki konfiguracyjne cache:

- Używaj stabilnych identyfikatorów (

idlub_id) do normalizacji (). - Dostosuj rozmiar cache i garbage collection dla dużych list ().

- Unikaj trzymania ogromnych, nienormalizowanych blobów pod

ROOT_QUERY— potrafi to „zamrozić” aplikację ().

Paginacja i ograniczanie liczby elementów (apollo graphql list best practices)

Jeśli próbujesz ładować setki albo tysiące artykułów czy leadów naraz, to proszenie się o kłopoty. Paginacja to nie tylko UX — to twarda konieczność wydajnościowa.

Apollo obsługuje zarówno paginację , jak i . Porównanie:

| Typ paginacji | Plusy | Minusy | Najlepsze dla |

|---|---|---|---|

| Offset-based | Prosta, łatwa do wdrożenia | Może pomijać/dublować elementy przy zmianach danych | Niezmienne lub małe listy |

| Cursor-based | Stabilna, dobrze znosi zmiany danych | Trochę bardziej złożona | Feedy newsów, duże listy |

W większości przypadków (news w czasie rzeczywistym albo listy leadów) paginacja cursor-based to najlepszy wybór. Trzyma spójność nawet wtedy, gdy dochodzą nowe elementy albo stare są usuwane ().

Wskazówki dot. paginacji w Apollo:

- Skonfiguruj

keyArgs, aby kontrolować klucze cache dla pól paginowanych (). - Zaimplementuj funkcję

merge, aby łączyć strony w cache. - Używaj

fetchMore, by dociągać kolejne strony bez nadpisywania poprzednich wyników.

Praktyczne wzorce paginacji dla narzędzi do scrapowania newsów

Typowy interfejs do pozyskiwania newsów:

- pokazuje ostatnie 20–50 nagłówków (tylko lekkie pola)

- dociąga kolejne po scrollu lub kliknięciu „następna strona”

- pobiera szczegóły dopiero, gdy są potrzebne

Efekt? UI jest szybkie, API mniej dostaje po głowie, a użytkownicy są po prostu bardziej produktywni.

Integracja Thunderbit do zautomatyzowanego pozyskiwania newsów

No dobra — ale skąd w ogóle bierze się całe to ustrukturyzowane dane newsowe? Tu wchodzi .

Thunderbit to no-code AI web scraper w formie rozszerzenia Chrome, który potrafi wyciągać z praktycznie dowolnej strony: nagłówki, URL-e, źródła, autorów, daty publikacji, streszczenia i obrazy — bez pisania kodu. Widziałem zespoły, które dzięki Thunderbit zautomatyzowały cały proces pozyskiwania newsów, zamieniając nieustrukturyzowane strony w czyste dane gotowe do bazy albo API GraphQL.

Połączenie Thunderbit z Apollo dla newsów w czasie rzeczywistym

Oto workflow, który szczególnie lubię dla zespołów sprzedaży i operacji, które muszą mieć świeże info:

- Warstwa ekstrakcji: użyj szablonu w Thunderbit, aby cyklicznie pobierać ustrukturyzowane dane z wybranych serwisów.

- Warstwa przechowywania: zapisuj dane w bazie zoptymalizowanej pod szybkie odczyty.

- Warstwa GraphQL: wystaw w API pole listy

newsFeedoraz pole szczegółunewsArticle(id). - Warstwa klienta: w Apollo Client pobieraj listę (lekkie pola, paginacja), a szczegóły dociągaj tylko wtedy, gdy są potrzebne.

Taki pipeline „scrape → store → query” sprawia, że zapytania Apollo zawsze pracują na świeżych, ustrukturyzowanych danych — bez ręcznego kopiowania i kruchych skryptów.

Bonus: Thunderbit potrafi też wzbogacać listy o dodatkowe pola (np. sentyment lub kategorię) dzięki sugestiom pól opartym o AI, co czyni feed jeszcze bardziej „inteligentnym” — coś jak apollp ai w praktyce, tylko w realnym procesie.

Instrukcja krok po kroku: optymalizacja zapytań list w Apollo

Chcesz wdrożyć to w praktyce? Oto moja checklista optymalizacji zapytań list w Apollo:

-

Odchudź zapytania

- Pobieraj tylko pola potrzebne do wyświetlenia listy (tytuł, URL, znacznik czasu itd.).

- Ciężkie pola (pełny tekst, obrazy, wzbogacanie) przenieś do zapytań szczegółowych.

-

Wdróż paginację

- Dla dużych lub dynamicznych list wybierz paginację cursor-based.

- Skonfiguruj

keyArgsi funkcjemerge, aby cache działał poprawnie.

-

Wykorzystaj cache Apollo

- Normalizuj encje stabilnymi ID.

- Dobierz właściwą politykę pobierania (

cache-and-networkświetnie sprawdza się dla newsów). - Dostosuj rozmiar cache i garbage collection do wolumenu danych.

-

Zautomatyzuj pozyskiwanie danych

- Użyj Thunderbit do automatyzacji scrapowania newsów i utrzymania świeżości danych.

- Eksportuj ustrukturyzowane dane bezpośrednio do bazy lub arkusza.

-

Monitoruj i diagnozuj

- Skorzystaj z , aby analizować zapytania, cache i wydajność.

- Wypatruj dużych zapisów do cache, nadmiaru watched queries i „szarpania” UI.

- Śledź p95/p99 latencji i wskaźniki błędów (, ).

Monitorowanie i rozwiązywanie problemów z wydajnością zapytań

Devtools Apollo to tutaj koło ratunkowe. Możesz:

- podejrzeć aktywne zapytania i stan cache

- wyłapać duplikaty zapytań lub nadmiar watcherów

- zidentyfikować duże bloby w cache albo problemy z normalizacją

Jeśli widzisz lagi UI lub wolne aktualizacje, sprawdź:

- zbyt „ciężkie” zapytania list (odchudź je)

- słabą normalizację cache (popraw ID)

- problemy z łączeniem stron w paginacji (przejrzyj

keyArgsimerge)

I pamiętaj: mierz latencję ogonową (tail latency), nie tylko średnie. To tam kryje się prawdziwy ból użytkownika.

Porównanie tradycyjnych metod scrapowania newsów z podejściem opartym o AI

Nie oszukujmy się: kiedyś pozyskiwanie danych z newsów oznaczało pisanie własnych skryptów, walkę z headless browserami i modlitwę, żeby layout strony nie zmienił się z dnia na dzień. Dziś, dzięki narzędziom opartym o AI, takim jak Thunderbit, możesz zautomatyzować cały proces — bez kodu i bez dramatu.

This paragraph contains content that cannot be parsed and has been skipped.