Powiem tak: niewiele rzeczy w cyfrowym świecie daje tak dziwnie satysfakcjonujące uczucie, jak schludna, kompletna lista każdej jednej podstrony w serwisie — trochę jak odnalezienie wszystkich skarpet po praniu. Ale jeśli kiedykolwiek próbowałeś ogarnąć pobieranie podstron witryny do audytu treści, migracji albo po prostu po to, by sprawdzić, co kryje się w „cyfrowej piwnicy”, wiesz, że rzadko bywa to tak proste, jak brzmi. Widziałem zespoły, które spędzały godziny (a nawet dni), sklejając listy z map witryny, wyników Google i eksportów z CMS-a — po czym okazywało się, że nadal brakuje ukrytych lub dynamicznych stron. A gdy próbowałem pomóc znajomemu wyeksportować wszystkie adresy URL z WordPressa… powiedzmy tylko, że było dużo kawy i odrobina egzystencjalnego niepokoju.

Dobra wiadomość? Nie musisz dalej bawić się w cyfrowe chowanego z własną stroną. W tym poradniku przeprowadzę Cię przez najważniejsze sposoby na wyszukiwanie adresów URL w witrynie — zarówno te „starej szkoły”, jak i nowoczesne — oraz pokażę, jak narzędzia oparte na AI, takie jak , potrafią zrobić to znacznie szybciej, dokładniej i (tak, naprawdę) przyjemniej. Niezależnie od tego, czy jesteś marketerem, developerem, czy po prostu pechowcem z zadaniem „zbierz wszystkie URL-e”, znajdziesz tu konkretne kroki, przykłady z życia i uczciwe porównania, które pomogą wybrać najlepszą metodę dla Twojego zespołu.

Dlaczego możesz potrzebować listy podstron: zastosowania z życia

Zanim przejdziemy do „jak”, pogadajmy o „po co”. Dlaczego tyle zespołów w ogóle musi robić wyszukiwanie adresów URL w witrynie? Okazuje się, że to nie tylko temat SEO — to powracająca potrzeba w marketingu, sprzedaży, IT i operacjach. Oto najczęstsze scenariusze:

- Audyty SEO i audyty treści oraz strategia: Audyty treści stały się standardem — . Pełna lista URL-i to fundament oceny wyników, aktualizacji starszych materiałów i poprawy pozycji. Co więcej, .

- Redesign i migracje stron: ), a każda migracja wymaga mapowania obecnych URL-i, by uniknąć błędów 404 i strat w SEO.

- Zgodność, porządek i utrzymanie: Zespoły operacyjne muszą namierzać osierocone lub przestarzałe strony — czasem stare mikrowitryny kampanii, które nadal działają i tylko czekają, by kogoś skompromitować.

- Analiza konkurencji: Marketing i sprzedaż zbierają dane z witryn konkurentów, by spisać strony produktowe, cenniki czy wpisy blogowe i szukać luk lub leadów.

- Generowanie leadów i outreach: Zespoły sprzedaży często potrzebują list lokalizatorów sklepów, katalogów dealerów lub stron członkowskich do działań outreach.

- Inwentaryzacja treści: Content marketerzy prowadzą bieżącą listę wpisów, landingów, PDF-ów i innych zasobów, by unikać duplikacji i maksymalizować wartość.

Poniżej szybka tabela podsumowująca te przypadki:

| Scenariusz | Kto tego potrzebuje | Dlaczego kompletna lista stron ma znaczenie |

|---|---|---|

| Audyt SEO / audyt treści | Specjaliści SEO, content marketerzy | Ocena każdego elementu treści; brakujące strony = niepełna analiza i utracone szanse optymalizacji |

| Migracja / redesign witryny | Web developerzy, SEO, IT, Marketing | Mapowanie starych URL-i na nowe, przekierowania, zapobieganie błędom i stratom SEO |

| Analiza konkurencji | Marketing, Sprzedaż | Wgląd we wszystkie podstrony konkurenta; ukryte strony mogą ujawnić okazje |

| Generowanie leadów | Zespoły sprzedaży | Zbieranie stron kontaktowych/zasobów do outreach; brak luk = brak utraconych leadów |

| Inwentaryzacja treści | Content marketing | Aktualne repozytorium, identyfikacja braków, unikanie duplikacji i przegląd starych stron |

A skutki pominięcia ukrytych lub brakujących stron? Są jak najbardziej realne. Wyobraź sobie redesign, w którym zapominasz o ukrytym landingu, który nadal konwertuje, albo audyt, w którym brakuje 5% stron, bo nie są zindeksowane. To utracone przychody, ryzyko spadków w SEO i czasem kryzys wizerunkowy, którego nikt nie przewidział.

Najpopularniejsze sposoby na znalezienie URL-i w witrynie: tradycyjne metody

Przejdźmy do mięsa: jak w praktyce ludzie ogarniają pobieranie podstron witryny? Jest kilka sprawdzonych metod — jedne są szybkie i „na skróty”, inne bardziej dokładne (i czasem bardziej bolesne). Oto jak to wygląda:

Wyszukiwanie w Google i operatory

Jak to działa:

Otwórz Google i wpisz site:twojadomena.pl. Google pokaże strony, które ma zindeksowane dla tej domeny. Możesz zawęzić wyniki słowami kluczowymi lub katalogami (np. site:twojadomena.pl/blog).

Co dostajesz:

Listę zindeksowanych stron — czyli to, co Google „wie” o Twojej witrynie.

Ograniczenia:

- Pokazuje tylko to, co jest w indeksie, a nie wszystko, co istnieje

- Zwykle kończy się po kilkuset wynikach, nawet dla dużych serwisów

- Pomija nowe, ukryte lub celowo niezindeksowane strony

Kiedy używać:

Świetne do szybkiego podglądu lub małych stron, ale nie do pełnego audytu.

Sprawdzenie robots.txt i sitemap.xml

Jak to działa:

Wejdź na twojadomena.pl/robots.txt i poszukaj linii „Sitemap:”. Otwórz mapę witryny (zwykle twojadomena.pl/sitemap.xml lub /sitemap_index.xml). Mapy witryny zawierają URL-e, które właściciel chce indeksować.

Co dostajesz:

Listę kluczowych stron — często wszystkie wpisy blogowe, strony produktowe itd. .

Ograniczenia:

- Sitemap zawiera tylko strony, które właściciel chce indeksować — ukryte lub osierocone często nie trafiają na listę

- Może być nieaktualna, jeśli nie jest regularnie generowana

- Część serwisów ma wiele sitemap; czasem trzeba ich poszukać

Kiedy używać:

Idealne, gdy masz własną stronę lub chcesz szybko podejrzeć główne sekcje konkurenta. Pamiętaj jednak: widzisz to, co właściciel chce pokazać.

Narzędzia typu SEO Spider i crawlery

Jak to działa:

Narzędzia takie jak Screaming Frog, Sitebulb czy DeepCrawl działają jak robot wyszukiwarki. Podajesz adres witryny, a narzędzie podąża za linkami wewnętrznymi i buduje listę znalezionych stron.

Co dostajesz:

Potencjalnie wszystkie strony, do których prowadzą linki w serwisie, plus dane techniczne (kody statusu, meta tagi itd.).

Ograniczenia:

- Strony osierocone (bez linków) nie zostaną znalezione, chyba że podasz je ręcznie

- Strony dynamiczne lub generowane przez JavaScript mogą zostać pominięte, jeśli narzędzie nie obsługuje renderowania

- Crawl dużych serwisów bywa długi i potrafi „zjeść” pamięć komputera

- Wymaga konfiguracji i wiedzy technicznej

Kiedy używać:

Dobre dla specjalistów SEO i developerów do głębokich audytów. Mniej przyjazne dla osób nietechnicznych.

Google Search Console i Analytics

Jak to działa:

Jeśli masz dostęp do witryny, Google Search Console (GSC) i Analytics pozwalają eksportować listy URL-i.

- GSC: Raporty dotyczące indeksowania i skuteczności pokazują URL-e zindeksowane i wykluczone (do 1 000 w eksporcie, więcej przez API).

- Analytics: Pokazuje strony, które miały ruch w wybranym okresie (GA4 pozwala wyeksportować do 100 000 wierszy).

Ograniczenia:

- GSC i Analytics pokazują tylko strony, które Google zna lub które miały ruch

- Limity eksportu (1 000 wierszy w GSC, 100k w GA4)

- Wymaga weryfikacji/własności witryny; nie nadaje się do analizy konkurencji

- Strony bez ruchu lub niezindeksowane nie pojawią się w raportach

Kiedy używać:

Świetne dla własnej strony, szczególnie przed migracją lub audytem. Nie do analizy konkurencji.

Panele CMS

Jak to działa:

Jeśli strona działa na WordPressie, Shopify lub innym CMS, często da się wyeksportować listę stron i wpisów z panelu administracyjnego (czasem z pomocą wtyczki).

Co dostajesz:

Listę wszystkich wpisów treści — stron, postów, produktów itd.

Ograniczenia:

- Wymaga dostępu administracyjnego

- Może nie obejmować stron nietreściowych lub dynamicznych

- Jeśli korzystasz z kilku systemów (blog, sklep, dokumentacja), trzeba połączyć eksporty

Kiedy używać:

Najlepsze dla właścicieli stron do inwentaryzacji treści lub backupu. Nie pomaga w analizie konkurencji.

Ograniczenia tradycyjnych metod zbierania podstron

Bądźmy szczerzy: żadna z tych metod nie jest idealna. Oto najważniejsze luki:

- Złożoność techniczna: Wiele podejść wymaga umiejętności technicznych lub specjalistycznych narzędzi. Dla osób nietechnicznych to realna bariera. Ręczny audyt treści może zająć .

- Niepełne pokrycie: Każda metoda może coś pominąć — indeks Google nie obejmuje stron niezindeksowanych lub nowych, sitemap pomija osierocone, crawlery pomijają nielinkowane lub dynamiczne, eksport z CMS nie obejmuje elementów poza systemem.

- Czas i ręczna robota: Często trzeba łączyć dane z wielu źródeł, usuwać duplikaty i czyścić listę — to żmudne i podatne na błędy. Ludzie wymyślają nawet „patenty” typu kopiuj-wklej z sitemap do Excela albo skrypty w wierszu poleceń.

- Aktualność: Listy szybko się dezaktualizują. Tradycyjne metody wymagają powtarzania procesu po każdej zmianie w serwisie.

- Dostęp i uprawnienia: Część metod wymaga dostępu admina lub własności witryny — odpada przy analizie konkurencji.

- Nadmiar danych: SEO crawlery potrafią zasypać technikaliami, gdy Tobie potrzebna jest po prostu lista URL-i.

W skrócie: tradycyjny proces przypomina „pieczenie ciasta, gdy przepis ciągle się zmienia, a piekarnik co jakiś czas blokuje dostęp”. (To autentyczna analogia od stratega treści — i niestety bardzo trafna.)

Poznaj Thunderbit: sposób na URL-e wspierany przez AI

A teraz ciekawsza część. Co, jeśli mógłbyś po prostu poprosić asystenta: „przejdź po tej stronie i wypisz mi wszystkie podstrony”, a on faktycznie by to zrobił — bez kodu i bez kombinowania? Właśnie na tym polega .

Thunderbit to rozszerzenie Chrome typu AI web scraper stworzone z myślą o osobach nietechnicznych (ale wystarczająco mocne dla profesjonalistów). Wykorzystuje AI do „czytania” stron, porządkowania danych i eksportu wszystkich URL-i — także tych ukrytych, dynamicznych i z podstron. Nie musisz pisać kodu ani grzebać w skomplikowanych ustawieniach. Otwierasz stronę, klikasz „AI Suggest Fields” i Thunderbit robi resztę.

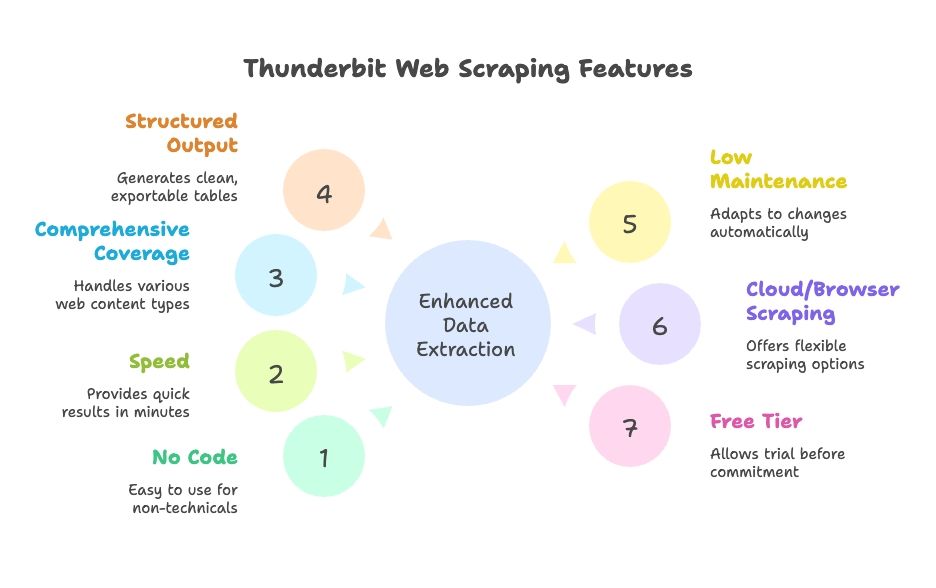

Co wyróżnia Thunderbit:

- Bez kodowania i konfiguracji: Interfejs w naturalnym języku, prowadzony przez AI. Każdy w zespole da radę.

- Szybkość: Wyniki w minuty, nie w godziny.

- Szerokie pokrycie: Obsługa treści dynamicznych, paginacji, infinite scroll i podstron.

- Uporządkowany wynik: Czyste tabele gotowe do eksportu do Google Sheets, Excel, Airtable, Notion, CSV lub JSON.

- Mniej utrzymania: AI dopasowuje się do zmian w serwisie; mniej ręcznego „dostrajania”.

- Scraping w chmurze lub w przeglądarce: Wybierasz, co lepiej pasuje do Twojego procesu.

- Dostępny darmowy plan: Możesz przetestować przed zakupem.

Jak Thunderbit upraszcza zbieranie podstron

Zobaczmy, jak to wygląda w praktyce. Pokażę Ci, jak przejść od „potrzebuję listy wszystkich podstron” do „oto arkusz, szefie” w kilka kliknięć.

Krok 1: Zainstaluj i uruchom Thunderbit

Pobierz i przypnij do paska. Wejdź na stronę, którą chcesz zebrać (np. stronę główną), a następnie kliknij ikonę Thunderbit, aby otworzyć interfejs.

Wskazówka: Thunderbit daje darmowe kredyty nowym użytkownikom, więc możesz przetestować narzędzie bez sięgania po kartę.

Krok 2: Wybierz źródło danych

Domyślnie Thunderbit zbiera dane z bieżącej strony, ale możesz też wkleić listę URL-i (np. z mapy witryny lub stron kategorii), jeśli chcesz zacząć od konkretnej sekcji.

- Dla większości serwisów zacznij od strony głównej lub strony z sitemapą.

- Dla e-commerce sensowny start to kategoria lub lista produktów.

Krok 3: Użyj „AI Suggest Fields”, aby wykryć URL-e

Tu dzieje się magia. Kliknij „AI Suggest Fields” (albo „AI Suggest Columns”). AI Thunderbit skanuje stronę, rozpoznaje wzorce i proponuje kolumny typu „Page Title” i „Page URL” dla znalezionych linków. W razie potrzeby możesz je dopasować.

- Na stronie głównej zobaczysz linki z nawigacji, stopki i sekcji wyróżnionych.

- Na sitemapie dostaniesz czystą listę URL-i.

- Możesz dodawać/usuwać kolumny i doprecyzować, co ma zostać wyciągnięte.

AI wykonuje najtrudniejszą część — bez XPathów i selektorów CSS. To jak stażysta-robot, który naprawdę rozumie, o co prosisz.

Krok 4: Włącz zbieranie z podstron (Subpage Scraping)

Większość serwisów nie pokazuje wszystkich podstron na homepage. Tu wchodzi Subpage Scraping. Oznacz kolumnę z URL jako link „follow”, a Thunderbit będzie przechodzić po każdym znalezionym odnośniku i zbierać kolejne URL-e z tych stron. Możesz też ustawić zagnieżdżone szablony do wielopoziomowego zbierania.

- Dla list stronicowanych lub przycisków „load more” włącz Pagination & Scrolling, aby Thunderbit kontynuował aż do zebrania całości.

- Dla serwisów z subdomenami lub sekcjami (np. blog na ) Thunderbit też może za nimi podążać, jeśli go do tego skierujesz.

Krok 5: Uruchom scraping

Kliknij „Scrape” i obserwuj, jak Thunderbit działa. Tabela będzie wypełniać się URL-ami (i innymi wybranymi polami) w czasie rzeczywistym. Przy większych serwisach możesz puścić proces w tle i wrócić później.

Krok 6: Sprawdź wyniki i wyeksportuj

Po zakończeniu przejrzyj dane — Thunderbit pozwala sortować, filtrować i usuwać duplikaty bezpośrednio w aplikacji. Następnie wyeksportuj jednym kliknięciem do Google Sheets, Excel, CSV, Airtable, Notion lub JSON. Koniec z kopiuj-wklej i bałaganem w formatowaniu.

Cały proces? Dla małej lub średniej strony możesz mieć pełną listę URL-i w mniej niż 10 minut. Dla dużych serwisów nadal jest to nieporównywalnie szybciej (i spokojniej) niż sklejanie danych z wielu źródeł.

Wykrywanie ukrytych i dynamicznych stron z Thunderbit

Jedną z moich ulubionych rzeczy w Thunderbit jest to, jak radzi sobie z podstronami, które tradycyjne narzędzia często pomijają:

- Treści renderowane przez JavaScript: Ponieważ Thunderbit działa w prawdziwej przeglądarce, potrafi przechwycić strony ładowane dynamicznie (np. tablice ofert pracy z infinite scroll czy listy produktów).

- Strony osierocone lub bez linków: Jeśli masz trop (np. sitemapę albo wyszukiwarkę na stronie), Thunderbit może pomóc znaleźć strony, które nigdzie nie są podlinkowane.

- Subdomeny i sekcje: W razie potrzeby Thunderbit może podążać za linkami między subdomenami, dając pełny obraz serwisu.

- Interakcje jak użytkownik: Trzeba wpisać coś w wyszukiwarkę albo kliknąć filtr, by odsłonić ukryte strony? AI Autofill w Thunderbit też to ogarnie.

Przykład z życia: Zespół marketingu musiał znaleźć wszystkie stare landing page’e — wiele z nich nie było nigdzie podlinkowanych, ale nadal istniały. Zbierając wyniki wyszukiwania Google w Thunderbit i dokładając znane wzorce URL, odkryli dziesiątki zapomnianych stron, oszczędzając firmie zamieszania (i kilku bólów głowy).

Thunderbit vs. tradycyjne metody: szybkość, prostota i pokrycie

Zestawmy Thunderbit z klasycznymi podejściami:

| Aspekt | Wyszukiwanie Google „site:” | Sitemap XML | Crawler SEO (Screaming Frog) | Google Search Console | Eksport z CMS | Thunderbit AI Scraper |

|---|---|---|---|---|---|---|

| Szybkość | Bardzo szybko, ale z ograniczeniami | Natychmiast, jeśli dostępne | Różnie (minuty do godzin) | Szybko dla małych stron | Natychmiast dla małych stron | Szybko: konfiguracja w minuty, automatyczny scraping |

| Łatwość użycia | Bardzo łatwe | Łatwe | Średnie (wymaga ustawień) | Średnie | Łatwe (jeśli masz admina) | Bardzo łatwe, bez kodu |

| Pokrycie | Niskie (tylko indeks) | Wysokie dla „zamierzonych” stron | Wysokie dla podlinkowanych stron | Wysokie dla zindeksowanych, ale limit eksportu | Średnie (tylko treści) | Bardzo wysokie: dynamiczne treści i podstrony |

| Wynik i integracje | Ręczne kopiowanie | XML (trzeba parsować) | CSV z dużą ilością danych pobocznych | CSV/Excel, do 1 000 wierszy | CSV/XML, często wymaga czyszczenia | Czysta tabela, eksport 1 klik do Sheets, Excel itd. |

| Utrzymanie | Ręczne powtarzanie | Wymaga aktualizacji | Ponowny crawl po zmianach | Okresowy eksport | Eksport po zmianach | Niskie: AI się dopasowuje, możliwe harmonogramy |

Thunderbit wygrywa prostotą, kompletnością i integracjami. Tradycyjne metody mają swoje mocne strony, ale zwykle wymagają więcej pracy, by połączyć wyniki i utrzymać je aktualne. AI w Thunderbit dopasowuje się do zmian w serwisie, więc nie musisz ciągle poprawiać ustawień ani robić ręcznych eksportów.

Jak wybrać właściwe podejście: komu pasuje która metoda?

Która metoda będzie najlepsza dla Ciebie? Oto moje spojrzenie po latach pomagania zespołom ogarniać dane z witryn:

- Specjaliści SEO / developerzy: Jeśli potrzebujesz głębokich danych technicznych (meta tagi, błędy linków itd.) albo audytujesz ogromny serwis enterprise, crawler lub własny skrypt nadal mogą mieć sens. Ale nawet wtedy Thunderbit szybko dostarczy listę URL-i do dalszej pracy.

- Marketerzy, stratedzy treści, PM-owie: Thunderbit to wybawienie. Koniec z czekaniem, aż IT uruchomi skrypt lub poskleja eksporty. Do inwentaryzacji treści, analizy konkurencji czy szybkiego audytu — możesz działać samodzielnie.

- Sprzedaż / lead gen: Thunderbit ułatwia wyciąganie list lokalizacji, stron wydarzeń czy katalogów członków z dowolnej witryny — bez kodowania.

- Małe strony / szybkie zadania: Dla małych serwisów ręczne sprawdzenie lub sitemap może wystarczyć. Ale konfiguracja Thunderbit jest tak szybka, że często i tak warto go użyć, by niczego nie pominąć.

- Budżet: Tradycyjne metody są tanie (poza Twoim czasem). Thunderbit ma darmowy plan, a płatne są przystępne dla większości firm. Pamiętaj: Twój czas też kosztuje.

- Bardzo niestandardowe potrzeby: Jeśli potrzebujesz bardzo specyficznych danych lub złożonej logiki, własny scraper może być konieczny. Ale AI w Thunderbit ogarnia większość przypadków przy minimalnej konfiguracji.

Wskazówki decyzyjne:

- Jeśli masz dostęp do witryny i mniej niż 1 000 stron, spróbuj eksportu z Google Search Console — ale sprawdź, czy lista jest kompletna.

- Jeśli nie masz dostępu do witryny lub potrzebujesz danych o konkurencji, Thunderbit albo crawler będą najlepszym wyborem.

- Jeśli cenisz czas i chcesz rozwiązania, które skaluje się bez bólu, Thunderbit trudno przebić.

- Do pracy zespołowej duży plus to bezpośredni eksport do Google Sheets.

Wiele organizacji działa hybrydowo: Thunderbit do szybkich zadań i dla osób nietechnicznych, a tradycyjne narzędzia do głębokich audytów.

Najważniejsze wnioski: lista podstron dla każdej potrzeby biznesowej

Podsumujmy:

- Kompletna lista podstron jest kluczowa dla SEO, strategii treści, migracji i researchu sprzedażowego. Chroni przed niespodziankami, błędami linków i utraconymi szansami. Większość marketerów robi audyty treści co najmniej raz w roku ().

- Tradycyjne metody istnieją, ale każda ma braki. Żadne pojedyncze podejście nie gwarantuje pełnej, aktualnej listy. Często wymagają umiejętności technicznych i łączenia wyników z wielu źródeł.

- Scraping wspierany przez AI (Thunderbit) to nowoczesna alternatywa. Thunderbit wykorzystuje AI do „myślenia” i klikania za Ciebie, dzięki czemu web scraping staje się dostępny dla każdego. Obsługuje treści dynamiczne, podstrony i eksportuje dane w gotowym formacie — oszczędza czas i zmniejsza liczbę błędów. W porównaniach 1:1 Thunderbit często robi w minuty to, co wcześniej zajmowało godziny, i to bez stromej krzywej uczenia ().

- Dobierz metodę do potrzeb i zespołu. Przy ogromnych serwisach warto używać całego zestawu narzędzi, ale dla większości użytkowników biznesowych sam Thunderbit będzie najlepszym wyborem.

- Dbaj o aktualność. Regularne audyty pozwalają wcześnie wyłapać problemy i utrzymać stronę „szczupłą” oraz skuteczną. Harmonogramy w Thunderbit ułatwiają to, podczas gdy ręczne procesy często są odkładane przez nakład pracy.

Na koniec: Koniec z wymówkami, że nie wiesz, co jest na Twojej stronie (albo na stronie konkurencji). Z odpowiednim podejściem zbudujesz pełną listę podstron i wykorzystasz ją do poprawy SEO, UX i strategii biznesowej. Pracuj mądrzej, nie ciężej — niech AI zrobi najtrudniejszą robotę i niech żadna strona nie zostanie pominięta.

Kolejne kroki

Jeśli chcesz przestać stresować się zadaniem „daj mi wszystkie URL-e”, i przetestuj na swojej stronie albo na stronie konkurenta. Zdziwisz się, ile czasu (i spokoju) zyskasz. A jeśli chcesz wejść głębiej w web scraping, zajrzyj do innych poradników na , np. albo .

FAQ

1. Po co w ogóle potrzebna jest lista wszystkich podstron w witrynie?

Zespoły SEO, marketingu, sprzedaży i IT często potrzebują pełnej listy URL-i do zadań takich jak audyty treści, migracje stron, generowanie leadów czy analiza konkurencji. Kompletna i poprawna lista pomaga uniknąć błędów linków, zapobiega duplikacji lub „zapomnieniu” treści oraz ujawnia ukryte możliwości.

2. Jakie są tradycyjne sposoby na znalezienie wszystkich URL-i w witrynie?

Najczęściej używa się wyszukiwania site: w Google, sprawdza pliki sitemap.xml i robots.txt, wykonuje crawl narzędziami SEO typu Screaming Frog, eksportuje dane z CMS-ów (np. WordPress) oraz pobiera listy stron zindeksowanych lub z ruchem z Google Search Console i Analytics. Każda z tych metod ma jednak ograniczenia w zakresie pokrycia i wygody.

3. Jakie są ograniczenia tradycyjnych metod wyszukiwania URL-i?

Tradycyjne podejścia często pomijają strony dynamiczne, osierocone lub niezindeksowane. Wymagają wiedzy technicznej, potrafią zająć wiele godzin na łączenie i czyszczenie danych, a przy dużych serwisach słabo się skalują. Często potrzebujesz też własności witryny lub dostępu admina, co nie zawsze jest możliwe.

4. Jak Thunderbit upraszcza znajdowanie wszystkich podstron?

Thunderbit to web scraper oparty na AI, który skanuje witryny jak człowiek — przechodzi po podstronach, radzi sobie z JavaScriptem i automatycznie porządkuje dane. Nie wymaga kodowania, działa jako rozszerzenie Chrome i w kilka minut eksportuje czyste listy URL-i do Google Sheets, Excel, CSV i innych formatów.

5. Kto powinien używać Thunderbit, a kto tradycyjnych narzędzi?

Thunderbit jest idealny dla marketerów, strategów treści, zespołów sprzedaży i osób nietechnicznych, które chcą szybko i bezproblemowo uzyskać pełną listę URL-i. Tradycyjne narzędzia lepiej sprawdzają się w audytach technicznych wymagających głębokich metadanych lub własnych skryptów. Wiele zespołów łączy oba podejścia — Thunderbit dla szybkości i wygody, a klasyczne narzędzia do analizy „w głąb”.