Pamiętam dzień, kiedy ktoś po raz pierwszy zapytał mnie: „Shuai, możesz pobrać dane z tej strony?”. W tamtym czasie web scraping był niszową sztuczką, o której wiedziało tylko kilku developerów — wystarczały Python i BeautifulSoup. Dziś rynek freelancerów od web scrapingu urósł do i wszystko wskazuje na to, że do 2030 roku jego wartość znów się podwoi. Zleceń zdalnych przybywa, a klienci nie chcą już tylko „działającego skryptu” — oczekują gotowych rozwiązań biznesowych (najlepiej z plikiem CSV!) dostarczonych błyskawicznie.

I tu właśnie tkwi sedno: rola freelancera zajmującego się web scrapingiem zmieniła się diametralnie. To już nie jest tylko pisanie kodu. Oczekuje się od Ciebie pełnej obsługi procesu — od ustalenia zakresu, przez wydobycie danych i ich oczyszczenie, aż po dostarczenie w odpowiednim formacie, a nawet zarządzanie ryzykiem prawnym. Narzędzia takie jak podnoszą poprzeczkę w zakresie szybkości i jakości, więc oczekiwania stale rosną. Niezależnie od tego, czy jesteś doświadczonym scraperem, czy dopiero zaczynasz, rozłóżmy na czynniki pierwsze, czego potrzeba, by odnieść sukces w tej nowej rzeczywistości. Podzielę się praktycznym doświadczeniem, konkretnymi wskazówkami i pokażę, jak Thunderbit może stać się Twoją tajną bronią.

Czym dziś naprawdę zajmuje się freelancer od web scrapingu?

Bądźmy szczerzy: freelancer od web scrapingu w 2025 roku wygląda zupełnie inaczej niż pięć lat temu. Wtedy wystarczyło oddać skrypt w Pythonie. Dziś trzeba ogarniać cały proces — od pierwszego spotkania na Zoomie po finalną dostawę do Google Sheets.

Skąd ta zmiana? Bo zapotrzebowanie na web scraping eksplodowało. ma osiągnąć 2,5 miliarda dolarów do 2032 roku, a już wykorzystuje web scraping do AI i analityki. E-commerce, nieruchomości, finanse — każda branża potrzebuje danych, a zalewają Upwork i Freelancer. Ale konkurencja też nie śpi.

Dzisiejsi klienci oczekują znacznie więcej niż tylko „kodu”:

- Zrozumienia celów biznesowych (nie tylko struktury HTML — po co im te dane?)

- Jasnej komunikacji („u mnie działa” nie przejdzie)

- Czystych, gotowych do użycia danych

- Zgodności z prawem i zarządzania ryzykiem

- Stałego wsparcia

Krótko mówiąc, musisz być jednocześnie inżynierem, konsultantem, project managerem i data engineerem. Freelancerzy, którzy dostarczają taką „pełnoseryjną” wartość, zdobywają powracających klientów i wyższe stawki.

Jakie umiejętności są potrzebne do zleceń web scrapingowych? Python już nie wystarczy

Python, BeautifulSoup i Playwright to dziś absolutne minimum. Ale żeby wygrywać zlecenia zdalne i międzynarodowe, potrzebujesz szerszego zestawu kompetencji.

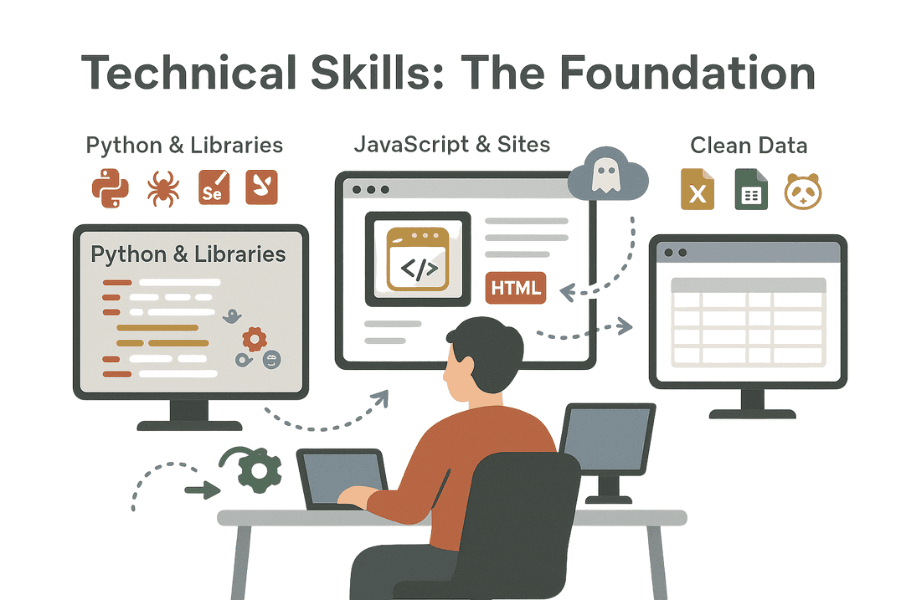

Umiejętności techniczne: fundament

- Python i biblioteki: korzysta z Pythona, a BeautifulSoup, Scrapy, Selenium i Playwright to najczęściej wybierane narzędzia.

- JavaScript i dynamiczne strony: Nowoczesne serwisy mocno opierają się na JavaScript, więc headless browsers i obsługa dynamicznie ładowanej treści są niezbędne.

- API i automatyzacja: Umiejętność pracy z web scraper API i frameworkami automatyzacji daje realną przewagę.

- Czyszczenie danych: Dostarczenie dopracowanych danych w Pandas, Excelu lub Google Sheets ma większe znaczenie, niż wielu osobom się wydaje.

Nowe czynniki, które naprawdę wyróżniają

Oto, co większość freelancerów pomija:

- Komunikacja: Czy potrafisz jasno wyjaśnić kwestie techniczne? Czy dobrze zbierasz wymagania podczas kick-off calla? To właśnie zamienia jednorazowe zlecenia w długoterminowe kontrakty.

- Zarządzanie projektami: Dotrzymywanie terminów i spokojne reagowanie na zmiany zakresu — niezawodność jest zauważana i doceniana.

- Wszechstronność narzędziowa: Poza kodem — czy potrafisz wykorzystać no-code rozwiązania, takie jak , oraz API, żeby działać szybciej?

- Zgodność z prawem i etyka: stawia na etyczny scraping. Znajomość GDPR i robots.txt to absolutna podstawa.

Dlaczego Thunderbit i podobne narzędzia są tak ważne

Korzystanie z narzędzi opartych na AI, takich jak Thunderbit, mocno podnosi produktywność. Koniec z wielogodzinnym pisaniem selektorów i debugowaniem paginacji.

- Twórz prototypy wymagań w kilka minut

- Obsługuj klientów nietechnicznych

- Skup się na dostarczaniu wartości i bierz więcej projektów

Idealny freelancer od web scrapingu w 2025 roku to hybryda: trochę inżynier, trochę konsultant, trochę partner biznesowy.

Thunderbit: tajna broń freelancera od web scrapingu

Przez lata budowałem narzędzia SaaS i automatyzacyjne, a upraszczanie i przyspieszanie pracy to moja życiowa specjalność. Właśnie dlatego stworzyłem — żeby wyeliminować najbardziej bolesne elementy web scrapingu, szczególnie dla freelancerów.

Thunderbit to , które prowadzi Cię od „potrzebuję tych danych” do „proszę, gotowy arkusz” w zaledwie kilka kliknięć. Bez strojenia selektorów, bez frustracji przy debugowaniu. Oto dlaczego pomaga freelancerom działać szybciej i lepiej.

Funkcje AI w Thunderbit zostały stworzone po to, byś mógł szybko dostarczać dane gotowe do użycia w biznesie.

AI Suggest Fields: koniec z zgadywaniem selektorów

Znasz ten schemat — przeglądanie HTML, zgadywanie selektorów CSS, nadzieja, że strona nie zmieni układu. Funkcja AI Suggest Fields w Thunderbit całkowicie to zmienia. Jedno kliknięcie i AI analizuje stronę, podpowiada najlepsze kolumny do wyciągnięcia oraz generuje dopasowane prompty ekstrakcji dla każdego pola.

- Szybkość: To, co wcześniej zajmowało godzinę, teraz trwa kilka minut

- Dokładność: AI wyłapuje pola, które mogłyby umknąć, zmniejszając luki w danych

- Prezentacje dla klientów: Pokaż próbkę ekstrakcji od razu na spotkaniu i buduj zaufanie natychmiast

Sama ta funkcja potrafi drastycznie skrócić czas konfiguracji. To jak mieć asystenta 24/7, który nigdy nie śpi.

Subpage & Cloud Scraping: złożone projekty bez stresu

W prawdziwych projektach rzadko chodzi tylko o „zeskrob tę jedną tabelę”.

- Przechodzenie do podstron (szczegóły produktu, profile użytkowników)

- Obsługa paginacji (nieskończone przewijanie, przycisk „następna strona”)

- Duże zlecenia obejmujące setki lub tysiące stron

Subpage Scraping w Thunderbit pozwala AI automatycznie odwiedzać każdą podstronę i pobierać dodatkowe informacje — bez konieczności tworzenia własnego crawlra.

Dzięki Cloud Scraping możesz pobrać nawet 50 stron równolegle po stronie serwera.

- Szybsza realizacja: duże projekty możesz zamknąć nawet w godzinę

- Bezobsługowość: proxy, limity i ponawianie prób są obsługiwane automatycznie

- Browser Mode: dla stron wymagających logowania lub zawierających wrażliwe dane możesz pracować bezpiecznie w sesji przeglądarki klienta

Szablony, eksporty i więcej

- Szablony jednym kliknięciem: popularne serwisy, takie jak Amazon, Zillow, Instagram i Shopify, mają gotowe szablony — wybierasz i działasz

- Bezplatny eksport danych: pobieraj jako CSV albo eksportuj bezpośrednio do Google Sheets, Excel, Airtable lub Notion — bez dodatkowych opłat

- Scheduled Scrapers: ustaw cykliczne uruchomienia (codziennie, co tydzień) i zamieniaj jednorazowe zlecenia w subskrypcyjny przychód

Thunderbit obsługuje , więc możesz pewnie realizować projekty globalne — od Tokio po São Paulo.

Globalne strategie na zdobywanie zdalnych zleceń web scrapingowych

Chciałbym, żeby ktoś powiedział mi to wcześniej: cały świat może być Twoim klientem. Zdalne zlecenia web scrapingowe nie ograniczają się do USA i Wielkiej Brytanii — rynki wzrostowe są też w Azji i Ameryce Łacińskiej. Rynek freelancerów nadal rośnie, a , przy dwucyfrowych wzrostach w takich krajach jak RPA i Kanada.

Jak wykorzystać globalny popyt

- Wykorzystaj znajomość języków: Dzięki wsparciu 34 języków w Thunderbit możesz śmiało oferować scraping niemieckich danych o nieruchomościach, japońskiego e-commerce czy brazylijskich danych z social mediów.

- Wyróżnij się na platformach: Podkreślaj umiejętność pracy wielojęzycznej i dostarczania danych w różnych formatach na Upwork, Freelancer i niszowych portalach.

- Pokaż doświadczenie międzynarodowe: Jeśli wcześniej pracowałeś z zagranicznymi stronami, wyeksponuj to w profilu. Case studies błyskawicznie budują wiarygodność.

Jak się odróżnić

- Szybka reakcja: Nawet przy różnych strefach czasowych jasne określenie dostępności robi ogromną różnicę.

- Próbki danych: Użyj Thunderbit, żeby natychmiast wygenerować przykładowe dane z docelowej strony — to buduje zaufanie i zwiększa skuteczność ofert.

- Postaw na zgodność z prawem: Wielu klientów obawia się ryzyka prawnego. Etyczne i zgodne z przepisami podejście powinno być widocznym atutem.

W erze pracy zdalnej geografia przestaje być barierą. Z odpowiednimi narzędziami i strategią możesz zdobywać klientów od Doliny Krzemowej po Szanghaj.

Cennik i dostarczanie: jak maksymalizować przychód jako freelancer od web scrapingu

Porozmawiajmy o pieniądzach. Wycenianie projektów scrapingowych bywa trudne, ale dobre podejście może zwiększyć zarówno Twoje zarobki, jak i zadowolenie klienta.

Najczęstsze modele rozliczeń

- Stawka godzinowa: Zazwyczaj od , zależnie od złożoności i poziomu umiejętności.

- Rozliczenie za projekt: Stała kwota za konkretne deliverable. Klienci lubią przewidywalność kosztów.

- Wycena oparta na wartości: Cena zależy od tego, jaką wartość przynoszą dane (np. automatyzacja 50 godzin ręcznej pracy, wsparcie wzrostu przychodów).

Jak Thunderbit zwiększa Twoją siłę cenową

Dzięki Thunderbit zyskujesz przewagę zarówno pod względem szybkości, jak i jakości:

- Szybsza realizacja: projekty, które wcześniej trwały dni, teraz zamykasz w kilka godzin

- Mniej błędów: mniej debugowania to mniej poprawek

- Szansa na usługę cykliczną: ustawiasz harmonogram scrapingu i sprzedajesz subskrypcję (np. 200 USD/miesiąc)

Klienci chętnie płacą więcej za szybkość, niezawodność i stałe wsparcie. Nie wyceniaj się na podstawie godzin — wyceniaj się na podstawie wartości, jaką dostarczasz.

Jak komunikować wartość

- Zacznij od ROI: wyjaśnij, jak dane pomogą zwiększyć przychody, oszczędzić czas lub ograniczyć ryzyko

- Bądź transparentny: jasno opisz konfigurację, utrzymanie, aktualizacje i to, jak poradzisz sobie ze zmianami na stronie

- Oferuj pakiety usług: Basic (jednorazowo), Standard (z czyszczeniem i analizą), Premium (cykliczne aktualizacje i priorytetowe wsparcie)

Pamiętaj: klienci nie płacą za kod. Płacą za efekt.

Zgodność danych i zarządzanie ryzykiem: budowanie zaufania i długoterminowych relacji

Oto niewygodna prawda: jeden błąd w obszarze zgodności może natychmiast zakończyć współpracę z klientem. Ponieważ obawia się legalności pozyskiwania danych, zarządzanie ryzykiem nie jest opcją — to konieczność.

Najlepsze praktyki

- Szanuj regulamin serwisu: zawsze sprawdź ToS docelowej strony. Jeśli masz wątpliwości, skonsultuj się z klientem lub poproś o zgodę.

- Przestrzegaj przepisów o ochronie danych: w przypadku GDPR, CCPA i podobnych regulacji trzymaj się wyłącznie danych publicznych, niepoufnych. Nie przetwarzaj danych osobowych bez zgody.

- Korzystaj ze scrapingu w przeglądarce: Browser Mode w Thunderbit pozwala etycznie pobierać dane, używając sesji logowania klienta.

- Pilnuj limitów zapytań: nie bombarduj serwerów żądaniami. Cloud Mode w Thunderbit robi to automatycznie, ale zawsze warto to sprawdzić.

Jak komunikować zgodność

Warto dodać do oferty krótką deklarację:

„Wszystkie działania związane z pozyskiwaniem danych są zgodne z obowiązującymi przepisami o prywatności oraz zasadami serwisu. Pobieramy wyłącznie informacje publicznie dostępne. W przypadku wymagania logowania korzystamy z autoryzowanego dostępu klienta, aby zapewnić etyczną ekstrakcję danych.”

Taki akapit od razu stawia Cię w roli profesjonalisty, a nie tylko kodera.

Od jednorazowych projektów do przychodu subskrypcyjnego: automatyzacja sukcesu klienta

Jeśli chcesz stabilnych dochodów, kluczem jest zamiana jednorazowych zleceń w usługi cykliczne.

Jak to zrobić

- Scheduled scrapers: użyj harmonogramu w Thunderbit, aby ustawić uruchomienia dzienne, tygodniowe lub miesięczne

- Regularne deliverables: zaproponuj cotygodniowy monitoring cen, codzienną analizę social mediów albo comiesięczne raporty rynkowe

- Model retainerowy: pobieraj opłatę za wdrożenie plus miesięczną opłatę za utrzymanie. Wielu klientów chętnie płaci 100–400 USD miesięcznie za stałe dostarczanie danych.

Realny przykład

Jeden freelancer zamienił codzienny projekt pozyskiwania cen e-commerce w automatycznie aktualizowany dashboard z miesięcznym kontraktem. Dzięki automatyzacji w Thunderbit codzienna praca jest minimalna — a przychód pozostaje stabilny.

Pro tip

Po każdej jednorazowej realizacji zawsze proponuj usługę cykliczną. Wielu klientów nawet nie zdaje sobie sprawy, jak dużą wartość mogą mieć dane dostarczane regularnie.

Budowanie marki: jak wyróżnić się na rynku freelancerów web scrapingu

Na zatłoczonym rynku Twoja marka decyduje o tym, czy zostaniesz zapamiętany. Oto jak zbudować profil, który wyróżni Cię w zleceniach zdalnych i międzynarodowych.

Konkretne kroki

- Dopracuj profil: na Upwork, LinkedIn i swojej stronie pokazuj zarówno umiejętności techniczne, jak i wpływ biznesowy

- Pokaż efekty: publikuj case studies, opinie klientów i próbki danych. Mierz rezultaty — wzrost przychodów, oszczędzony czas

- Twórz treści: pisz o wyzwaniach web scrapingu, zgodności i sukcesach na blogu lub LinkedInie (ten artykuł jest tego przykładem!)

- Angażuj się w społecznościach: odpowiadaj na pytania na Reddicie, w grupach LinkedIn i na forach poświęconych web scrapingowi. Open source też pomaga

- Podkreślaj zarówno kompetencje techniczne, jak i biznesowe: klienci chcą partnera, a nie tylko wykonawcy. Pokaż, że rozumiesz ich cele i potrafisz dostarczyć dane, z którymi da się działać

Branża nie stoi w miejscu. Ucz się nowych narzędzi, takich jak Thunderbit, śledź zmiany prawne