Szczerze mówiąc: kiedy pierwszy raz próbowałem wyciągnąć każdy adres URL z dużej witryny, pomyślałem: „No ile to może potrwać?”. Kilka godzin później nadal przeklikiwałem kolejne strony, kopiowałem linki do arkusza i zastanawiałem się nad swoimi życiowymi wyborami. Jeśli kiedykolwiek próbowałeś znaleźć wszystkie strony w witrynie — czy to do audytu treści, budowania listy leadów, czy analizy konkurencji — wiesz, jak bardzo to męczy. To nużące, podatne na błędy i, szczerze mówiąc, zwykła strata czasu i talentu.

Ale jest też dobra wiadomość: nie musisz już robić tego po staremu. Narzędzia oparte na AI, takie jak , zmieniają zasady gry dla użytkowników biznesowych, pozwalając znaleźć wszystkie adresy URL w domenie w kilka minut, a nie dni. Co więcej, firmy korzystające z narzędzi do web scrapingu opartych na AI raportują przy zbieraniu danych, a niektóre mówią nawet o niż przy metodach ręcznych. To nie jest tylko statystyka — to godziny, a czasem dni, odzyskane z Twojego życia.

Przyjrzyjmy się więc, dlaczego znalezienie wszystkich stron w witrynie jest takie trudne, dlaczego ogólne modele AI, takie jak GPT czy Claude, niewiele tu pomogą, i jak wyspecjalizowani agenci AI — tacy jak Thunderbit — sprawiają, że cały proces staje się banalnie prosty. I tak, pokażę Ci dokładnie, jak wyciągnąć każdy potrzebny adres URL, nawet jeśli nie znasz się na kodowaniu.

Dlaczego znalezienie wszystkich adresów URL w domenie jest tak trudne

Spójrzmy prawdzie w oczy: witryny nie są projektowane po to, żeby podawać Ci w gotowej liście każdą stronę, jaką zawierają. Są tworzone dla odwiedzających, a nie dla osób, które próbują znaleźć wszystkie strony w witrynie naraz. Oto, dlaczego to takie uciążliwe:

- Ręczne kopiowanie i wklejanie to droga przez mękę: Klikanie w każde menu, listę i katalog, kopiowanie adresów URL jeden po drugim — to prosty przepis na przeciążenie nadgarstków i pominięcie połowy stron.

- Stronicowanie i nieskończone przewijanie: Wiele serwisów dzieli treści na wiele stron albo doładowuje kolejne wyniki podczas przewijania. Przegapisz przycisk „Dalej” albo nie przewiniesz wystarczająco daleko — i ominą Cię całe sekcje.

- Niespójne struktury stron: Niektóre strony pokazują linki w jednym formacie, inne w zupełnie innym układzie. Pilnowanie tego wszystkiego to koszmar.

- Ukryte lub osierocone strony: Nie każda strona jest podlinkowana z głównej nawigacji. Część jest ukryta głęboko i dostępna tylko przez mapę witryny albo wyszukiwarkę wewnętrzną.

- Błędy ludzkie: Im więcej stron musisz skopiować, tym większa szansa na pomyłki — duplikaty URL-i, literówki albo zwykłe pominięcie czegoś.

A jeśli pracujesz na serwisie z setkami albo tysiącami stron? Zapomnij. Ręczne zbieranie po prostu nie skaluje się na taką liczbę. Jak ujął to jeden zespół danych: przy czymkolwiek wykraczającym poza trywialne przypadki .

Co właściwie znaczy „znaleźć wszystkie strony w witrynie”?

Zanim przejdziemy do rozwiązań, doprecyzujmy, o co nam tak naprawdę chodzi.

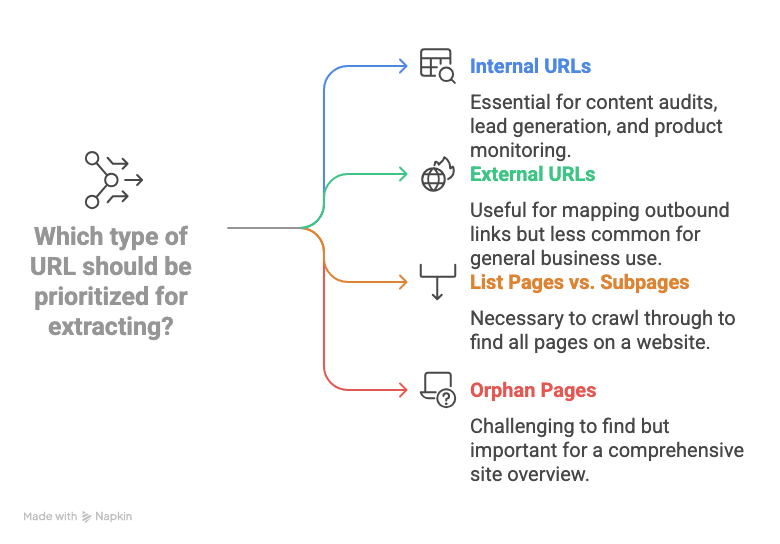

- Adresy URL wewnętrzne: To linki prowadzące do stron w tej samej domenie (np. /about-us lub /products/widget-123). W większości zastosowań biznesowych — audytów treści, generowania leadów, monitorowania produktów — to właśnie adresy wewnętrzne są głównym celem.

- Adresy URL zewnętrzne: Linki prowadzące do innych witryn. Zwykle nie są potrzebne, chyba że mapujesz linki wychodzące.

- Strony list i podstrony: Wiele serwisów ma strony „huby” lub listy (np. kategorie, archiwa bloga, katalogi), które prowadzą do stron szczegółowych, takich jak karty produktów czy profile. Żeby naprawdę znaleźć wszystkie strony w witrynie, trzeba przejść przez te listy i zebrać każdą podstronę, do której prowadzą.

- Strony osierocone: To strony, do których nie prowadzi żaden oczywisty link. Czasem da się je znaleźć przez mapę witryny albo wyszukiwarkę wewnętrzną, ale łatwo je przeoczyć.

Więc gdy mówimy o znajdowaniu wszystkich adresów URL w domenie, mamy na myśli: zebranie każdego wewnętrznego adresu strony — od strony głównej po najgłębiej ukryty produkt czy artykuł — najlepiej w formacie, z którego da się od razu korzystać, np. arkuszu kalkulacyjnym.

Tradycyjne metody znajdowania wszystkich adresów URL w domenie

Istnieje kilka starych sposobów na to zadanie, ale każdy z nich ma własny zestaw problemów:

Ręczne kopiowanie i wklejanie oraz narzędzia przeglądarkowe

To podejście „na siłę”: kliknij każdy link, skopiuj każdy adres URL, wklej do arkusza i miej nadzieję, że niczego nie przegapisz. Niektórzy używają rozszerzeń przeglądarki, które pobierają wszystkie linki z bieżącej strony, ale i tak trzeba to powtarzać dla każdej podstrony, a przy paginacji czy ukrytych sekcjach zostajesz sam. Na witrynę pięciostronicową jeszcze ujdzie — ale przy czymkolwiek większym już nie.

Korzystanie z wyszukiwania witryny i mapy strony

- Wyszukiwanie Google z operatorem site: Wpisz site:twojadomena.com w Google, a zobaczysz sporo zindeksowanych stron. Problem w tym, że Google pokazuje tylko to, co zindeksował (często z limitem około 1000 wyników), więc przegapisz nowe, ukryte lub słabe jakościowo strony. sama przyznaje, że to nie jest pełne rozwiązanie.

- Mapy witryny XML: Wiele serwisów ma plik /sitemap.xml z listą ważnych adresów URL. Świetnie — jeśli mapa jest aktualna i zawiera wszystkie strony. Ale nie każda witryna ją ma, a niektóre dzielą mapę na kilka plików. Strony osierocone często nie trafiają do zestawienia.

Techniczne crawlery i skrypty

- Narzędzia SEO (takie jak Screaming Frog): Przeskanują witrynę jak wyszukiwarka i wyplują listę adresów URL. Są potężne, ale wymagają konfiguracji, ustawień, a przy dużych serwisach czasem także płatnej licencji.

- Skrypty Python (takie jak Scrapy): Deweloperzy mogą pisać skrypty do crawlownia i ekstrakcji adresów URL. Ale bądźmy szczerzy: jeśli nie czujesz się pewnie z kodem, to odpada. Do tego skrypty psują się, gdy zmienia się układ strony, więc ciągle trzeba je aktualizować.

Wniosek: Tradycyjne metody są albo zbyt ręczne, albo zbyt niepełne, albo zbyt techniczne dla większości użytkowników biznesowych. Nie bez powodu tak wiele osób rezygnuje w połowie.

Dlaczego ogólne modele AI nie potrafią w pełni zautomatyzować ekstrakcji URL-i

Możesz myśleć: „A nie mogę po prostu poprosić ChatGPT albo Claude, żeby znalazły mi wszystkie strony w witrynie?”. Gdyby to było takie proste. W rzeczywistości:

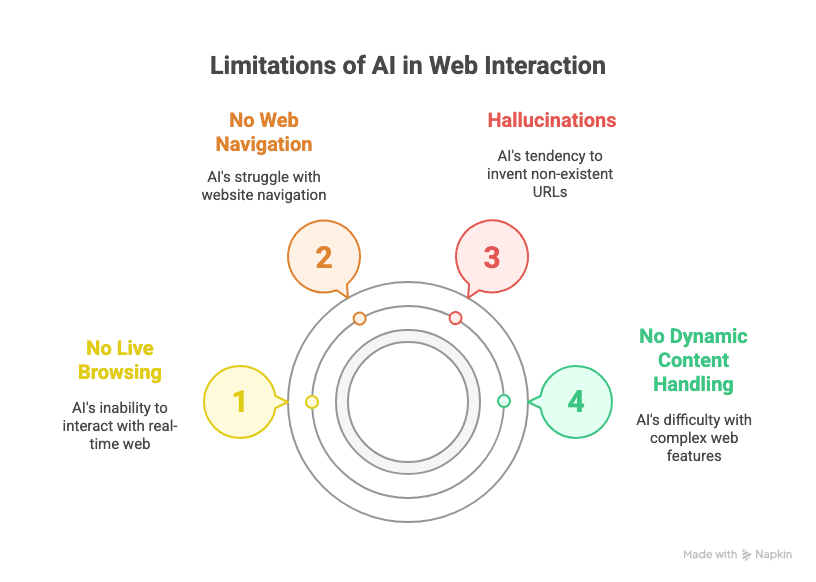

- Brak przeglądania na żywo: Ogólne modele AI, takie jak GPT czy Claude, nie potrafią naprawdę przeglądać sieci w czasie rzeczywistym. Nie „widzą” bieżącego stanu witryny — działają tylko na podstawie danych treningowych albo tego, co wkleisz.

- Brak nawigacji po sieci: Nawet z wtyczkami albo włączonym przeglądaniem LLM-y nie wiedzą, jak kliknąć „Dalej”, obsłużyć nieskończone przewijanie ani systematycznie przejść przez każdy link w serwisie.

- Halucynacje: Poproś ogólną AI o wszystkie adresy URL w domenie, a często wymyśli linki, które brzmią wiarygodnie, ale w rzeczywistości nie istnieją. (Widziałem, jak zmyślała /about-us dla serwisów, które nigdy takiej strony nie miały.)

- Brak obsługi dynamicznej treści: Serwisy ładujące treści przez JavaScript, wymagające logowania albo korzystające ze złożonej nawigacji są poza zasięgiem zwykłych modeli LLM.

Jak pisze : „Jeśli chcesz pobierać setki albo tysiące stron… sam ChatGPT to za mało”. Potrzebujesz narzędzia zaprojektowanego dokładnie do tego zadania.

Agenci AI wertykalni to przyszłość (i dlaczego ma to znaczenie)

Tu wchodzi moje doświadczenie w SaaS i automatyzacji: wertykalne agenty AI — narzędzia AI zbudowane dla konkretnej dziedziny, jak ekstrakcja danych z sieci — to jedyny sposób na uzyskanie wiarygodnych, skalowalnych rezultatów w zadaniach biznesowych. Dlaczego?

- Ogólne modele LLM są świetne do pisania albo wyszukiwania, ale mają skłonność do „halucynacji” i nie radzą sobie ze złożonymi, wieloetapowymi, powtarzalnymi procesami na poziomie stabilności, jakiego potrzebują firmy.

- Narzędzia SaaS dla przedsiębiorstw muszą automatyzować wiele powtarzalnych, ustrukturyzowanych zadań. I właśnie tu błyszczą wertykalne agenty AI — są zbudowane do jednego konkretnego zadania i robią je dobrze, przy minimalnej liczbie błędów.

- Przykładów nie brakuje w różnych branżach: Thunderbit do ekstrakcji danych z sieci, Devin AI do tworzenia oprogramowania, Alta do automatyzacji sprzedaży, IL VISTA od Infinity Learn dla edukacji, Rippling dla HR, Harvey dla prawa… i tak dalej.

Krótko mówiąc: jeśli chcesz niezawodnie znaleźć wszystkie strony w witrynie, potrzebujesz wertykalnego agenta AI stworzonego do tego celu — a nie ogólnego chatbota.

Poznaj Thunderbit: ekstrakcja adresów URL z AI dla każdego

I właśnie tutaj pojawia się . Jako rozszerzenie Chrome do AI Web Scraper, Thunderbit jest stworzone dla użytkowników biznesowych — bez kodowania, bez technicznej konfiguracji, po prostu wyniki. Oto, co je wyróżnia:

- Interfejs w języku naturalnym: Wystarczy opisać, czego potrzebujesz („Wypisz wszystkie adresy URL stron w tej witrynie”), a AI Thunderbit samo wymyśli, jak to wyciągnąć.

- AI Suggest Fields: Thunderbit skanuje stronę i automatycznie proponuje nazwy kolumn (np. „Adres URL strony”) — bez grzebania w selektorach CSS czy XPath.

- Obsługa paginacji i nieskończonego przewijania: Thunderbit może automatycznie klikać „Dalej” albo przewijać stronę, więc niczego nie przegapisz.

- Nawigacja po podstronach: Trzeba zejść głębiej? Thunderbit może podążać za linkami do podstron i pobierać dane także stamtąd.

- Ustrukturyzowany eksport: Eksportuj wyniki bezpośrednio do Google Sheets, Excel, Notion, Airtable lub CSV — za darmo i jednym kliknięciem.

- Bez kodowania: Jeśli umiesz przeglądać witrynę, umiesz też używać Thunderbit. To naprawdę takie proste.

A ponieważ Thunderbit jest wertykalnym agentem AI, został zbudowany z myślą o stabilności i powtarzalności — idealnie dla użytkowników biznesowych, którzy muszą automatyzować te same zadania wielokrotnie.

Krok po kroku: jak znaleźć wszystkie adresy URL w domenie z Thunderbit

Gotowy zobaczyć, jak to działa? Oto nietechniczny przewodnik po wyciąganiu każdego potrzebnego adresu URL.

1. Zainstaluj rozszerzenie Thunderbit do Chrome

Na początek: . Działa w Chrome, Edge, Brave i innych przeglądarkach opartych na Chromium. Przypnij je do paska narzędzi, żeby mieć szybki dostęp.

2. Otwórz docelową stronę z listą lub katalogiem

Przejdź do witryny, z której chcesz wyciągnąć adresy URL. Może to być strona główna, mapa witryny, katalog albo dowolna strona listy prowadząca do interesujących Cię podstron.

3. Uruchom Thunderbit i skonfiguruj pola

Kliknij ikonę Thunderbit, aby otworzyć rozszerzenie. Rozpocznij nowy szablon scrapera. I tu zaczyna się magia:

- Kliknij „AI Suggest Fields”. AI Thunderbit przeskanuje stronę i zasugeruje kolumny — szukaj tej oznaczonej jako „Page URL”, „Link” albo podobnie.

- Jeśli nie widzisz dokładnie pola, którego potrzebujesz, po prostu dodaj kolumnę nazwaną „Page URL” (albo taką, która ma dla Ciebie sens). AI Thunderbit jest trenowane, by rozpoznawać takie nazwy i mapować je na właściwe dane.

4. Włącz paginację lub przewijanie, jeśli to potrzebne

Jeśli strona docelowa ma wiele podstron (np. „Strona 1, 2, 3…” albo przycisk „Load more”), włącz w Thunderbit paginację:

- Przełącz się na tryb „Click Pagination” dla witryn z przyciskiem „Next” albo na „Infinite Scroll” dla stron, które doładowują treści podczas przewijania.

- Thunderbit poprosi Cię o wskazanie przycisku „Next” albo obszaru przewijania — po prostu kliknij, a resztą zajmie się AI.

5. Rozpocznij scrapowanie i sprawdź wyniki

Kliknij przycisk „Scrape”. Thunderbit przejdzie przez wszystkie strony i zbierze każdy znaleziony adres URL. Wyniki zobaczysz od razu w tabeli w rozszerzeniu. Przy dużych witrynach może to potrwać kilka minut, ale i tak jest to znacznie szybsze niż robienie tego ręcznie.

6. Wyeksportuj listę adresów URL

Gdy scraping się zakończy, kliknij Export. Możesz wysłać dane bezpośrednio do:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Eksport jest darmowy i zachowuje całe formatowanie. Koniec z bólem kopiowania i wklejania.

Porównanie Thunderbit z innymi rozwiązaniami do ekstrakcji URL-i

| Metoda | Łatwość użycia | Dokładność i pokrycie | Skalowalność | Opcje eksportu |

|---|---|---|---|---|

| Ręczne kopiowanie i wklejanie | Bolesne | Niska (łatwo coś pominąć) | Brak | Ręczny (Excel itp.) |

| Ekstraktory linków w przeglądarce | OK dla 1 strony | Średnia | Słaba | Ręczny |

Wyszukiwanie Google site: | Łatwe | Średnia (niepełne) | Limit ok. 1000 | Ręczny |

| Mapa witryny XML | Łatwe (jeśli istnieje) | Dobra (jeśli aktualna) | Dobra | Ręczny/Skrypt |

| Narzędzia SEO (Screaming Frog) | Techniczne | Wysoka | Wysoka (płatna) | CSV, Excel |

| Skrypty Python (Scrapy itp.) | Bardzo techniczne | Wysoka | Wysoka | Niestandardowy |

| Thunderbit | Bardzo łatwe | Bardzo wysoka | Wysoka | Google Sheets, CSV itp. |

Thunderbit daje Ci dokładność i skalę profesjonalnego crawlera połączoną z łatwością użycia rozszerzenia przeglądarkowego. Bez kodu, bez konfiguracji, po prostu wyniki.

Bonus: wyciąganie z Thunderbit nie tylko adresów URL

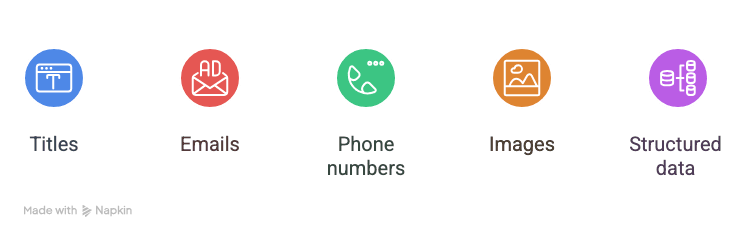

A tu robi się naprawdę ciekawie. Thunderbit nie służy tylko do URL-i — możesz wyciągać:

- Tytuły

- Adresy e-mail

- Numery telefonów

- Obrazy

- Dowolne ustrukturyzowane dane na stronie

Na przykład, jeśli budujesz listę leadów, możesz z pomocą Thunderbit pobrać z każdego wpisu katalogowego adres URL profilu, imię i nazwisko, e-mail oraz numer telefonu — wszystko za jednym razem. Jeśli audytujesz produkty, możesz wyciągnąć adres URL produktu, nazwę, cenę i status dostępności. Thunderbit obsługuje nawet , więc może kliknąć każdy link i pobrać szczegóły także stamtąd.

I tak, ekstraktory e-maili i numerów telefonów w Thunderbit są całkowicie darmowe. To duża zaleta dla zespołów sprzedaży i marketingu.

Najważniejsze wnioski: jak znaleźć wszystkie strony w witrynie z pomocą AI

Podsumujmy:

- Wyciąganie wszystkich adresów URL z domeny jest trudne przy użyciu metod ręcznych lub ogólnych narzędzi.

- Ogólne modele AI, takie jak GPT, nie radzą sobie z nawigacją po sieci, paginacją ani dynamiczną treścią.

- Wertykalne agenty AI, takie jak Thunderbit, są stworzone do ekstrakcji danych z sieci — stabilne, powtarzalne i proste w użyciu dla biznesu.

- Thunderbit upraszcza wszystko: zainstaluj rozszerzenie, użyj AI do zaproponowania pól, włącz paginację, wykonaj scraping i wyeksportuj dane. Bez kodu, bez stresu.

- Możesz wyciągnąć więcej niż tylko URL-e: tytuły, e-maile, numery telefonów i nie tylko — idealne do lead gen, audytów czy researchu.

Jeśli masz dość kopiowania linków i walki z technicznymi crawlerami, . Jest darmowy plan, więc sam zobaczysz, ile czasu i nerwów możesz oszczędzić.

A jeśli chcesz sprawdzić inne sposoby, w jakie Thunderbit może pomóc — na przykład , albo — zajrzyj na , gdzie znajdziesz więcej poradników i wskazówek.

Gotowy odzyskać czas stracony na ręczne zbieranie danych? Przyszłość ekstrakcji danych z sieci należy do wertykalnych agentów AI — a Thunderbit wyznacza kierunek. Wypróbuj go i spraw, by Twój kolejny audyt, lista leadów czy projekt badawczy był jak najłatwiejszy.

Czytaj więcej

P.S. Jeśli kiedykolwiek najdzie Cię pokusa, żeby ręcznie skopiować 1000 adresów URL, pamiętaj: teraz jest na to AI. Twoje nadgarstki — i Twój szef — będą Ci wdzięczni.