Wciąż pamiętam, jak po raz pierwszy próbowałem zebrać dane ze strony internetowej do analiz biznesowych. Siedziałem wtedy, wpatrując się w morze kopiowania i wklejania, i myślałem: „Musi istnieć lepszy sposób”. Dziś web scraping nie jest już domeną wyłącznie programistów czy data scientistów. To codzienny sposób na zwiększanie produktywności dla zespołów sprzedaży, osób z e-commerce, badaczy i, szczerze mówiąc, każdego, kto kiedykolwiek musiał zamienić chaotyczną stronę internetową w schludny arkusz kalkulacyjny. Najlepsze jest to, że rozszerzenia Chrome do web scrapingu sprawiły, iż cały proces jest tak prosty, że nawet moi znajomi nietechniczni potrafią dziś zbierać dane jak profesjonaliści — czasem aż się zastanawiam, czy moja mama potajemnie nie prowadzi agencji lead generation.

Jeśli zauważyłeś, że temat decyzji opartych na danych nagle stał się wszędzie obecny, nie jesteś sam. Najnowsze szacunki rynkowe pokazują, że globalny rynek oprogramowania do web scrapingu osiągnie około 1,03 mld USD w 2025 roku (), a prognozy mówią o 2,23 mld USD do 2031 roku (), co oznacza CAGR na poziomie ok. 13,78% w latach 2026–2031. Po stronie popytu dane z Google Trends pokazują wyraźny trend wzrostowy: zainteresowanie hasłem „web scraping” rosło średnio o ok. 10% rocznie w latach 2004–2024, a od 2020 roku wzrosło o ok. 46% (). Z perspektywy ruchu internetowego scrapowanie oparte na AI staje się czymś, czego nie da się już ignorować. W IV kwartale 2025 roku około 1 na 31 wizyt na stronach klientów TollBit pochodziła od bota do scrapingu AI, co oznacza wyraźny wzrost z około 1 na 200 wizyt w I kwartale 2025 roku (). Rozszerzenia Chrome do web scrapingu napędzają ten trend, obniżając próg wejścia do pozyskiwania danych i sprawiając, że cały proces wydaje się niemal tak prosty jak zamówienie jedzenia z dostawą. W tym artykule przeprowadzę Cię przez 10 najlepszych rozszerzeń Chrome do web scrapingu w 2025 roku — co potrafią, dla kogo są stworzone, ile kosztują i co mówią prawdziwi użytkownicy. Niezależnie od tego, czy jesteś przedstawicielem handlowym, analitykiem e-commerce, czy po prostu masz dość ręcznego kopiowania i wklejania danych, znajdziesz tu coś dla siebie.

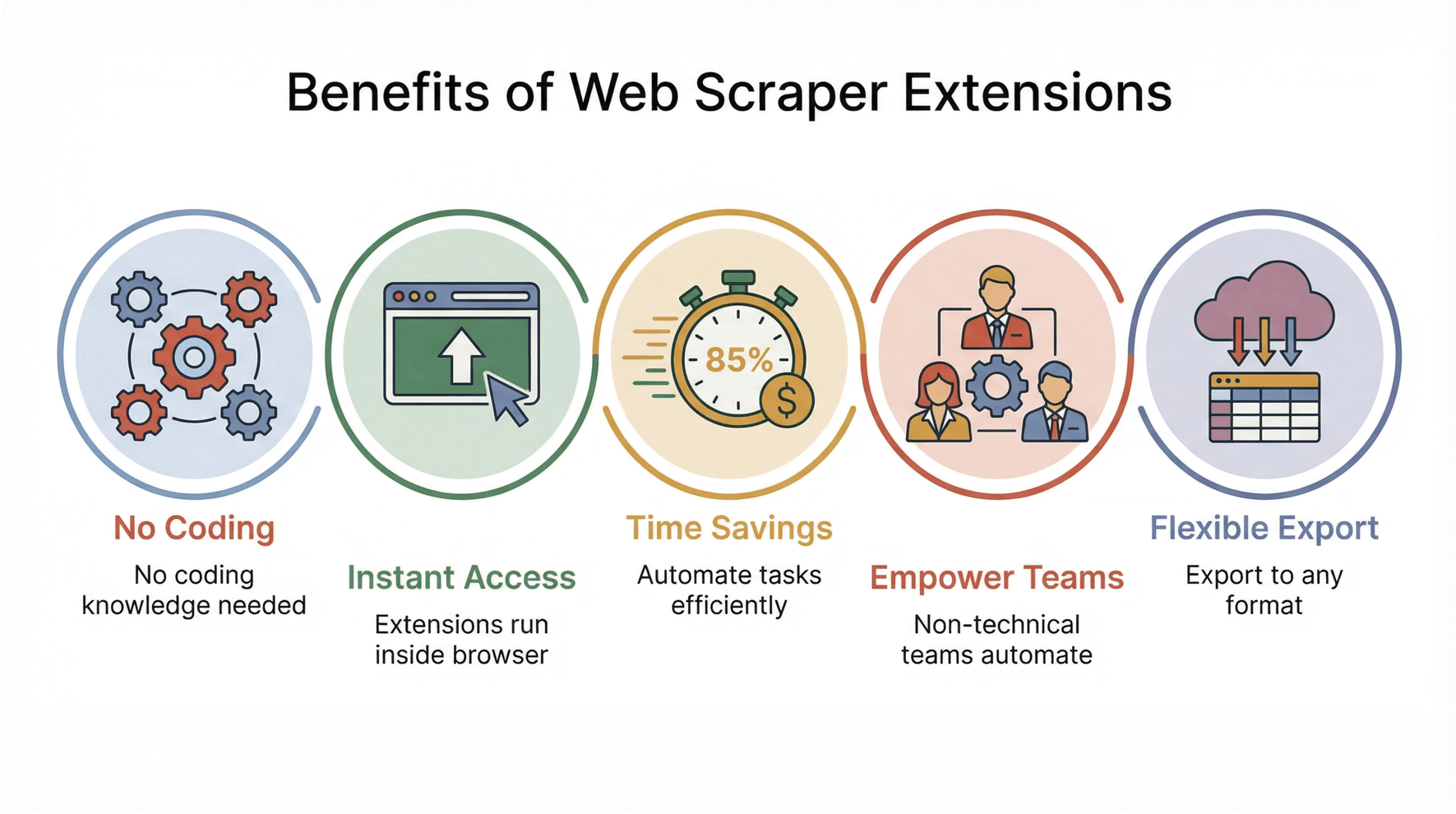

Dlaczego warto używać rozszerzenia Chrome do web scrapingu?

Bądźmy szczerzy: nikt nie budzi się z ekscytacją na myśl o kopiowaniu i wklejaniu wierszy danych ze strony internetowej. Właśnie dlatego rozszerzenia Chrome do web scrapingu są takim wybawieniem dla użytkowników biznesowych. Oto, dlaczego warto mieć je w swojej przeglądarce:

- Bez kodowania: Nie musisz być programistą. Większość rozszerzeń pozwala po prostu wskazać, kliknąć i pobrać dane — bez skryptów Pythona i bez linii komend.

- Natychmiastowy dostęp: Działają bezpośrednio w przeglądarce, więc możesz pobierać dane z dowolnej aktywnej karty. Bez przełączania się między aplikacjami i bez topornego oprogramowania desktopowego.

- Oszczędność czasu: Marketerzy raportowali skrócenie zadań z , gdy przestali ręcznie kopiować i wklejać, a zaczęli używać rozszerzeń do scrapingu.

- Wsparcie dla zespołów nietechnicznych: Zespoły sprzedaży, operacji i badań mogą automatyzować powtarzalne zadania związane z pobieraniem danych z sieci, zyskując czas na realną analizę (albo, wiecie, chwilę na kawę).

- Elastyczny eksport: Większość narzędzi pozwala wysłać dane bezpośrednio do Excela, Google Sheets, Airtable lub Notion — koniec z żonglowaniem CSV.

Krótko mówiąc, rozszerzenia Chrome do web scrapingu są tajną bronią każdego, kto chce zamienić internet w uporządkowaną, użyteczną bazę danych — bez bólu głowy.

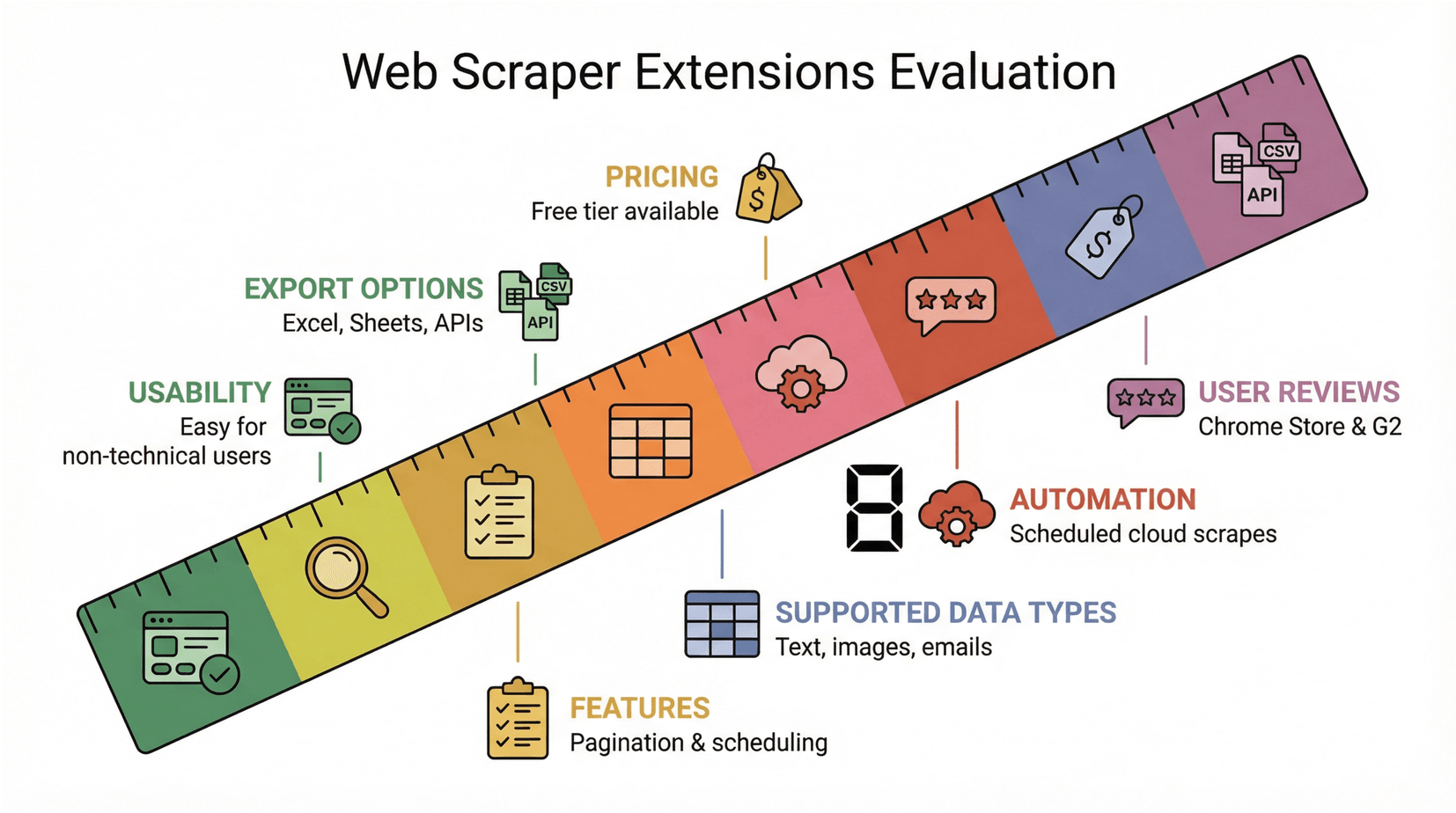

Jak wybraliśmy najlepsze rozszerzenia Chrome do web scrapingu

Spędziłem sporo czasu w terenie — testując narzędzia, czytając recenzje i rozmawiając z użytkownikami — żeby ustalić, które rozszerzenia Chrome do web scrapingu naprawdę dowożą. Oto kryteria, według których dokonałem wyboru:

- Funkcje: Czy narzędzie obsługuje paginację, scraping podstron, harmonogramy i eksport do popularnych formatów?

- Łatwość użycia: Czy jest przyjazne dla osób nietechnicznych? Czy można zacząć w kilka minut?

- Obsługiwane typy danych: Czy radzi sobie z tekstem, obrazami, e-mailami, numerami telefonów i nie tylko?

- Opcje eksportu: Czy dobrze współpracuje z Excelem, Google Sheets, Airtable, Notion lub API?

- Automatyzacja: Czy można zaplanować uruchomienia scrapingu albo uruchamiać go w chmurze?

- Cena: Czy jest darmowy plan? Czy płatne plany są rozsądne dla użytkowników biznesowych?

- Opinie użytkowników: Przejrzałem , , i , szukając opinii z prawdziwego życia — zarówno pochwał, jak i narzekań.

Szybka tabela porównawcza: 10 najlepszych rozszerzeń Chrome do web scrapingu

Poniżej znajdziesz szybkie porównanie 10 najlepszych rozszerzeń Chrome do scrapingu. Przewiń niżej, aby zobaczyć szczegółowy opis każdego z nich.

| Narzędzie | Funkcje | Opcje eksportu | Darmowy plan | Płatne plany (od) | Ocena / użytkownicy |

|---|---|---|---|---|---|

| Thunderbit | Scrapowanie AI w 2 kliknięciach, przechodzenie po podstronach/URL, szablony, harmonogramy | Excel, Sheets, Airtable, Notion | 6 stron/mies. (plus 10-stronicowy okres próbny) | 15 USD/mies. (plan 500 wierszy) | 4,4★ (130 recenzji) / 100 tys.+ użytkowników Chrome Web Store |

| Browse AI | Wizualne trenowanie robota, uruchomienia w chmurze, monitorowanie, 7 tys.+ integracji | CSV, Google Sheets, API/Webhooks | 50 kredytów/mies. (na zawsze) | 19 USD/mies. (rocznie) | 4,0★ (44 recenzje) / 100 tys. użytkowników Chrome Web Store |

| Instant Data Scraper | AI automatycznie wykrywa tabele/listy, paginację, nieskończone przewijanie | Excel, CSV | Bez limitu (całkowicie darmowe) | Darmowe | 4,9★ (6,9 tys. recenzji) / 1 000 000 użytkowników Chrome Web Store |

| Simplescraper | Wizualne wybieranie punkt-po-punkcie, wiele stron i podstron, harmonogram w chmurze, API | CSV, JSON, Sheets, Airtable | 50 kredytów/mies. (w chmurze), bez limitu lokalnie | 39 USD/mies. (rocznie) | 4,4★ (362 recenzje) / 60 tys.+ użytkowników Chrome Web Store |

| PandaExtract / Ultimate Web Scraper | Jedno kliknięcie do wyodrębniania list i tabel, zadania wsadowe dla wielu URL, wyszukiwarka e-maili/telefonów/obrazów | CSV, Excel, Sheets | Dostępna wersja próbna | 60 USD jednorazowo (na użytkownika) | 4,7★ (181 recenzje) Chrome Web Store (10 tys.+ użytkowników (wersja legacy)) |

| WebScraper.io | Wizualne mapy witryny do wielopoziomowego scrapingu, obsługa dynamicznych treści/AJAX | CSV, XLSX, JSON (chmura) | Bez limitu przy lokalnym użyciu | 50 USD/mies. (harmonogram w chmurze) | 4,0★ (980 recenzji) Chrome Web Store (800 tys.+ użytkowników (wersja legacy)) |

| Data Miner | Ponad 50 tys. gotowych „przepisów”, własny JS, wiele stron, eksport do Sheets | CSV, Excel, Google Sheets | 500 stron/mies. | 19,99 USD/mies. (plan Solo) | (Brak na liście; klasa pro) DataMiner chwali się ponad 50 tys. gotowych przepisów DataMiner |

| Listly | Automatyczne wykrywanie pól strony, ekstrakcja z wielu kart/grup, harmonogram | Excel (XLSX), Sheets, CSV, JSON | Nielimitowany scraping pojedynczych stron | 30 USD/mies. (Light) | 4,7★ (907 recenzji) / 100 tys.+ użytkowników Chrome Web Store |

| NoCoding Data Scraper | Wizualny kreator RPA, logika warunkowa, generowanie receptur przez AI, wsadowe URL | Excel, Sheets, Slack, Webhooks | Bez limitu (darmowe) | Darmowe (płatne prace niestandardowe) | 4,3★ (183 recenzje) Chrome Web Store (40 tys.+ użytkowników (wersja legacy)) |

Uwaga: liczby „użytkowników” pochodzą z początku 2026 roku z Chrome Web Store. Dane legacy (takie jak 1M+ dla Instant Data Scraper czy 800K+ dla WebScraper.io) pochodzą z publicznych raportów i mogą nie być widoczne w sklepie.

1. Thunderbit: Najłatwiejsze rozszerzenie Chrome z AI do web scrapingu

Przegląd:

powstał po to, by maksymalnie uprościć pozyskiwanie danych z sieci dla osób nietechnicznych. Proces jest prosty: kliknij „AI Suggest Fields”, pozwól AI odczytać stronę, w razie potrzeby dopasuj kolumny i naciśnij „Scrape”. Thunderbit obsługuje wszystko — od tekstu i linków po e-maile, obrazy, a nawet podstrony (na przykład: pobieranie listy produktów, a potem automatyczne odwiedzenie każdej strony produktu).

Najważniejsze funkcje:

- Sugestie pól oparte na AI: AI Thunderbit odczytuje stronę i podpowiada, jakie dane warto pobrać — bez bawienia się selektorami.

- Scraping podstron: AI może podążać za linkami (np. do stron produktów lub profili) i wzbogacać tabelę o głębsze informacje.

- Gotowe szablony: Dla popularnych serwisów (Amazon, Zillow, Google Maps itd.) możesz użyć szablonów uruchamianych jednym kliknięciem — bez konfiguracji.

- Planowanie scrapingu: Opisz harmonogram prostym językiem („co poniedziałek o 9:00”), a Thunderbit uruchomi zadanie w chmurze.

- Darmowe wyodrębnianie e-maili/obrazów/telefonów: Pobieraj e-maile, numery telefonów i obrazy z dowolnej strony, PDF-a lub obrazu — bez dodatkowych opłat.

- Elastyczny eksport: Wyślij dane do Excela, Google Sheets, Airtable lub Notion za darmo.

Typowe zastosowania:

- Generowanie leadów sprzedażowych: Pobieraj dane kontaktowe z katalogów, LinkedIn lub Apollo i automatycznie wzbogacaj leady o e-maile/numery telefonów.

- Monitorowanie cen w e-commerce: Śledź ceny i stany magazynowe na Amazon, Shopify lub stronach konkurencji.

- Ekstrakcja danych nieruchomości: Zbieraj ogłoszenia z Zillow, Redfin lub .

- Badania: Zbieraj treści konkurencji, profile w social media lub publiczne zbiory danych.

Cennik:

Thunderbit działa w modelu freemium opartym na kredytach. Otrzymujesz darmowy okres próbny (scraping do ), a darmowy plan pozwala na pobranie . Płatne plany zaczynają się od za 500 kredytów (1 kredyt = 1 wiersz), aż do 249 USD/miesiąc za 20 000 kredytów. Wszystkie opcje eksportu i funkcje AI są dostępne w planach płatnych.

Opinie użytkowników:

Thunderbit ma ocenę 4,4★ w , z ponad 130 recenzjami i 100 tys.+ użytkowników. Użytkownicy chwalą łatwość w 2 kliknięciach i skuteczny scraping podstron, często mówiąc, że to „jakby ktoś z zespołu robił za mnie kopiuj-wklej”. Nowi użytkownicy wspominają o niewielkiej krzywej uczenia się przy opanowywaniu zaawansowanych promptów AI, ale ogólnie jest uznawany za najprostszy scraper oparty na AI z całej listy.

Zalety:

- Najłatwiejsza konfiguracja (AI robi ciężką pracę)

- Skuteczny scraping podstron

- Darmowy eksport do Excela, Sheets, Airtable i Notion

- Wszystko w jednym: scraping, czyszczenie, wzbogacanie danych

Wady:

- Użycie ograniczone kredytami (intensywni użytkownicy mogą potrzebować wyższych planów)

- Czasem pojawia się krzywa uczenia przy bardziej złożonych promptach AI

- Ograniczone integracje zewnętrzne poza Sheets/Airtable/Notion (API dostępne dla większych potrzeb)

to świetny wybór dla osób nietechnicznych, które chcą szybkiego scrapingu wspieranego przez AI i minimalnej konfiguracji. (I tak, nadal trochę się cieszę za każdym razem, gdy ktoś mówi mi, że w kilka minut zeskrobał profile z LinkedIn do Sheets.)

2. Browse AI: Wizualne pozyskiwanie danych z monitoringiem

Browse AI to ulubione narzędzie użytkowników biznesowych, którzy chcą automatyzować monitorowanie danych i ich pobieranie bez napisania choćby jednej linijki kodu.

Przegląd:

Browse AI pozwala „wyszkolić” robota, wskazując i klikając dane, które chcesz zebrać. Robot może następnie działać w chmurze według harmonogramu, obsługując paginację, nieskończone przewijanie, a nawet logowanie do stron. Szczególnie dobrze sprawdza się przy stałym monitoringu — np. śledzeniu cen, ofert pracy czy aktualizacji u konkurencji.

Najważniejsze funkcje:

- Wizualne trenowanie robota: Wskaż i kliknij, aby zaznaczyć dane, a potem pozwól robotowi powtarzać zadanie.

- Uruchomienia w chmurze i harmonogramy: Roboty mogą działać w chmurze nawet co 15 minut (w wyższych planach).

- Monitorowanie i alerty: Otrzymuj powiadomienia, gdy dane się zmieniają (np. spadek ceny, nowe ogłoszenia).

- Integracje: Łączy się z ponad 7000 aplikacji przez Zapier/Make i eksportuje dane do Google Sheets lub przez API/webhooki.

- Obsługa dynamicznych treści: Potrafi radzić sobie z CAPTCHA i trudnymi stronami.

Zastosowania:

- Śledzenie konkurencji: Monitorowanie cen, recenzji lub poziomu zapasów.

- Agregacja ofert pracy: Zbieranie nowych ogłoszeń z wielu stron.

- Badania rynku: Scraping danych SEO, ogłoszeń reklamowych lub publicznych zbiorów danych.

Cennik:

Darmowy plan obejmuje 50 kredytów miesięcznie (wystarczająco dla małych projektów). Płatne plany zaczynają się od (przy rozliczeniu rocznym) za 2000 kredytów, a kończą się na 249 USD/miesiąc za 10 000 kredytów i większą liczbę robotów.

Opinie użytkowników:

Browse AI ma bardzo dobre oceny: , . Użytkownicy chwalą „proste i intuicyjne” trenowanie robotów oraz oszczędność czasu. Jeden z recenzentów napisał: „Browse AI to świetne, proste i intuicyjne, a jednocześnie bardzo funkcjonalne narzędzie do ekstrakcji danych... działa bezproblemowo”. Niektórzy użytkownicy wspominają o początkowej krzywej uczenia przy bardziej zaawansowanych workflow i zauważają, że intensywne użycie może być kosztowne.

Zalety:

- Bez kodowania

- Skuteczne harmonogramy i monitoring

- Szerokie możliwości integracji

Wady:

- Krzywa uczenia przy wieloetapowym scrapingu

- Kredyty mogą szybko się zużywać przy dużych zadaniach

Browse AI to mocny wybór dla osób, które potrzebują stałego monitorowania danych i integracji z procesami biznesowymi.

3. Instant Data Scraper: Darmowe i szybkie rozszerzenie Chrome do web scrapingu

Instant Data Scraper (IDS) to „szwajcarski scyzoryk” dla każdego, kto chce błyskawicznego, bezproblemowego scrapingu — całkowicie za darmo.

Przegląd:

IDS wykorzystuje automatyczne wykrywanie wspierane przez AI, aby znaleźć tabele i listy na dowolnej stronie. Wystarczy kliknąć rozszerzenie, a ono podświetli dane. Możesz przełączać się między wykrytymi tabelami, obsługiwać paginację i eksportować do Excela lub CSV — wszystko w przeglądarce.

Najważniejsze funkcje:

- Automatyczne wykrywanie AI: Samodzielnie znajduje tabele i listy danych.

- Paginacja i nieskończone przewijanie: Obsługuje wielostronicowe listy i dynamiczne ładowanie.

- Brak konfiguracji: Naprawdę tylko jedno kliknięcie, żeby zacząć.

- Działa lokalnie: Dane zostają w przeglądarce — bez wysyłania do chmury.

Zastosowania:

- Szybkie pobieranie danych: Przedstawiciele handlowi, badacze i rekruterzy używają IDS do jednorazowych zrzutów danych — np. list kontaktów, informacji o produktach czy ogłoszeń o pracę.

- Doraźne badania: Scrapowanie wyników wyszukiwania, wątków na forach lub komentarzy w social media w kilka sekund.

Cennik:

Całkowicie darmowe. Bez limitów użycia, bez wersji premium.

Opinie użytkowników:

IDS ma grono fanów: i . Użytkownicy zachwycają się oszczędnością czasu („Nie mogę uwierzyć, że to jest za darmo. Chętnie bym zapłacił za to, biorąc pod uwagę, ile czasu mi oszczędza”). Niektórzy początkujący na starcie uznają interfejs za mylący, a IDS najlepiej sprawdza się przy prostych listach i tabelach — nie przy wielopoziomowym crawlowaniu.

Zalety:

- 100% za darmo

- Bardzo prosty do podstawowych zadań

- Obsługuje paginację i nieskończone przewijanie

Wady:

- Nie jest idealny do złożonego, wieloetapowego scrapingu

- Początkujący mogą potrzebować chwili na oswojenie się z interfejsem

Jeśli chcesz pobrać jedną czy dwie strony do Excela, IDS to pozycja obowiązkowa.

4. Simplescraper: Elastyczny scraper Chrome do API i integracji

Simplescraper jest wierny swojej nazwie: prosty, ale potężny, idealny dla osób, które chcą automatyzować scraping i łączyć dane z innymi aplikacjami.

Przegląd:

Simplescraper pozwala wskazywać i klikać dane, a następnie budować „recepturę” ekstrakcji. Obsługuje scraping wielu stron, nawigację po podstronach i może uruchamiać zadania w chmurze według harmonogramu. Integracje z Google Sheets, Airtable i Zapier ułatwiają automatyzację workflow.

Najważniejsze funkcje:

- Wizualny wybór punkt-po-punkcie: Budowanie receptur bez kodowania.

- Scraping wielu stron i podstron: Podążanie za linkami i obsługa paginacji.

- Harmonogram w chmurze: Automatyczne uruchamianie scrapingu (plany płatne).

- Integracje: Eksport do Sheets, Airtable, Zapiera i nie tylko.

- Funkcja AI „Enhance”: Analizowanie pobranych danych z użyciem GPT.

Zastosowania:

- Agregacja treści: Scrapowanie wpisów blogowych, newsów lub katalogów produktów.

- Automatyzacja workflow: Przekazywanie zeskrobanych danych do Sheets lub Airtable w celu aktualizacji w czasie rzeczywistym.

- Badania: Zbieranie danych do raportów lub analiz.

Cennik:

Darmowy plan pozwala na nieograniczone lokalne scrapes i 100 kredytów w chmurze miesięcznie. Płatne plany zaczynają się od (rocznie) za 6000 kredytów, a potem rosną wraz z większą skalą i dodatkowymi funkcjami.

Opinie użytkowników:

Simplescraper jest lubiany za ocenę i ponad 90 000 użytkowników. Użytkownicy chwalą „intuicyjny i prosty” interfejs oraz szybkie wsparcie. Niektórzy wspominają o krzywej uczenia przy bardziej zaawansowanych recepturach i zauważają, że obsługa proxy jest dostępna tylko w wyższych planach.

Zalety:

- Łatwy w użyciu do podstawowego scrapingu

- Mocne integracje i automatyzacja

- Nielimitowane lokalne scrapes w darmowym planie

Wady:

- Zaawansowane workflow wymagają nauki

- Obsługa proxy tylko w wyższych planach

Simplescraper to świetny wybór dla osób, które chcą automatyzować scraping i przesyłać dane do innych aplikacji.

5. PandaExtract: Rozszerzenie Chrome do web scrapingu danych strukturalnych

PandaExtract to nowsze narzędzie skupione na szybkim pozyskiwaniu danych strukturalnych — szczególnie leadów, produktów i obrazów.

Przegląd:

PandaExtract oferuje wyodrębnianie list jednym kliknięciem: najedź na tabelę lub listę, kliknij, a narzędzie pobierze wszystkie dane (w tym paginację). Obsługuje też masowy scraping z listy URL, wbudowaną ekstrakcję e-maili/telefonów/obrazów oraz gotowe szablony dla popularnych stron.

Najważniejsze funkcje:

- Wyodrębnianie list jednym kliknięciem: Inteligentnie podświetla i pobiera listy/tabele.

- Masowy scraping wielu URL: Wczytaj plik CSV z URL-ami do ekstrakcji wsadowej.

- Ekstrakcja e-maili/telefonów/obrazów: Wbudowane narzędzia do danych kontaktowych i multimediów.

- Licencja dożywotnia: Zapłać raz i używaj bez końca.

Zastosowania:

- Generowanie leadów: Pobieranie danych kontaktowych z katalogów firm, Google Maps lub Yelp.

- Badania e-commerce: Wyodrębnianie list produktów, cen i obrazów.

- Agregacja recenzji: Pobieranie opinii klientów z Amazon, Trustpilot itd.

Cennik:

Licencja dożywotnia: dla pojedynczego użytkownika (3 urządzenia), 240 USD dla zespołów. Dostępna wersja próbna.

Opinie użytkowników:

PandaExtract może pochwalić się oceną i ponad 10 000 użytkowników. Użytkownicy lubią interfejs „naprawdę użyteczny i bardzo prosty w obsłudze” oraz wartość jednorazowej płatności. Niektórzy zauważają, że dokumentacja jest skromniejsza niż w starszych narzędziach, a planowanie zadań jest ograniczone.

Zalety:

- Jednorazowa płatność (bez subskrypcji)

- Bardzo dobre do leadów i obrazów

- Gotowe szablony dla popularnych stron

Wady:

- Mniej zaawansowanych funkcji automatyzacji

- Mniejsza społeczność i dokumentacja

Jeśli szukasz narzędzia do danych strukturalnych, za które płacisz tylko raz, PandaExtract jest opłacalną opcją.

6. WebScraper.io: Potężny scraper Chrome do złożonych stron

WebScraper.io to wybór dla zaawansowanych użytkowników i analityków danych, którzy potrzebują maksymalnej elastyczności.

Przegląd:

Web Scraper korzysta z podejścia „wizualnej mapy witryny”: definiujesz krok po kroku plan, według którego scraper ma nawigować i pobierać dane. Radzi sobie z wielopoziomową nawigacją, dynamicznymi treściami i po konfiguracji potrafi scrapować niemal każdą stronę.

Najważniejsze funkcje:

- Wizualny kreator mapy witryny: Konfiguracja wielopoziomowego crawlowania w Chrome DevTools.

- Obsługa dynamicznych treści: Czekanie na AJAX, przewijanie i więcej.

- Duża możliwość dostosowania: Selectory, regex i zaawansowane opcje.

- Platforma w chmurze: Opcjonalne płatne uruchomienia w chmurze do harmonogramów i skali.

Zastosowania:

- Scraping katalogów e-commerce: Pobieranie tysięcy SKU z wielu kategorii.

- Agregacja newsów: Zbieranie artykułów, komentarzy lub wątków z forów.

- Duże projekty danych: Badania akademickie, dane rządowe itd.

Cennik:

Rozszerzenie jest darmowe i open source. Plany chmurowe zaczynają się od około 50 USD/miesiąc przy większej skali i harmonogramowaniu.

Opinie użytkowników:

Web Scraper ma ocenę i ponad 800 000 użytkowników. Użytkownicy chwalą elastyczność i moc narzędzia, ale zauważają wysoką krzywą uczenia dla początkujących. Jeden z recenzentów napisał: „Dzięki Web Scraper nie muszę pisać kodu, żeby dostać się do danych. Potrafi nawigować między stronami”.

Zalety:

- Bardzo elastyczny i potężny

- Darmowy do lokalnego użycia

- Obsługuje złożone, wielopoziomowe strony

Wady:

- Nie jest przyjazny dla początkujących

- Dla każdej strony wymaga ręcznej konfiguracji

Web Scraper jest idealny dla użytkowników, którzy muszą pobierać dane ze złożonych stron i nie boją się dłubania w ustawieniach.

7. DataMiner: Rozszerzenie Chrome do web scrapingu dla profesjonalistów

Data Miner to weteran w tej przestrzeni, znany z podejścia opartego na recepturach i solidnego wsparcia.

Przegląd:

Data Miner oferuje ogromną bibliotekę gotowych „receptur” dla popularnych stron, a także interfejs typu point-and-click do tworzenia własnych. Obsługuje paginację, wypełnianie formularzy, niestandardowy JavaScript i eksport do wielu formatów.

Najważniejsze funkcje:

- Ponad 60 tys. gotowych receptur: Szablony dla Google, LinkedIn, Amazon i wielu innych.

- Niestandardowy kreator receptur: Użyj CSS/XPath albo trybu wskazywania i klikania.

- Automatyczne crawlowanie: Obsługa wielu stron i scrapingu wsadowego.

- Wypełnianie formularzy i obsługa JS: Automatyzacja złożonych workflow.

Zastosowania:

- Generowanie leadów: Scrapowanie LinkedIn, katalogów firm lub portali z ofertami pracy.

- Badania rynku: Agregacja danych konkurencji, recenzji lub informacji o produktach.

- Czyszczenie danych: Wykorzystanie regex i własnych skryptów do zaawansowanej ekstrakcji.

Cennik:

Darmowy plan: 500 stron miesięcznie. Płatne plany zaczynają się od (Solo) i rosną wraz z większą skalą oraz dodatkowymi funkcjami.

Opinie użytkowników:

Data Miner ma ocenę i ponad 300 000 użytkowników. Użytkownicy uwielbiają bibliotekę receptur i wsparcie (ukłon dla Zacka z supportu, który podobno jest legendą). Niektórzy uważają, że po ostatnich aktualizacjach interfejs stał się przytłaczający, a limity darmowego planu są dość restrykcyjne.

Zalety:

- Ogromna biblioteka receptur

- Zaawansowane funkcje automatyzacji

- Mocne wsparcie i dokumentacja

Wady:

- Krzywa uczenia przy zaawansowanych funkcjach

- Darmowy plan jest ograniczony przy intensywnym użyciu

Data Miner jest idealny dla profesjonalistów, którzy chcą automatyzować powtarzalne zadania scrapingu.

8. Listly: Przyjazne użytkownikowi rozszerzenie Chrome do szybkiego zbierania danych

Listly to wschodząca gwiazda wśród użytkowników nietechnicznych, którzy chcą w okamgnieniu zamieniać strony internetowe w arkusze kalkulacyjne.

Przegląd:

Listly automatycznie wykrywa dane na dowolnej stronie i układa je w wiersze i kolumny. Obsługuje scrapowanie wielu kart, uruchomienia według harmonogramu i bezpośredni eksport do Google Sheets. Darmowy plan jest bardzo hojny dla jednorazowych scrapów pojedynczych stron.

Najważniejsze funkcje:

- Jedno kliknięcie do Excela: Automatyczne strukturyzowanie danych ułatwiające eksport.

- Ekstrakcja z wielu kart/grup: Scrapuj kilka stron naraz.

- Planowanie i automatyzacja: Uruchamiaj codzienne ekstrakcje (plany płatne).

- Integracja z Google Sheets: Synchronizacja w czasie rzeczywistym dla współpracy.

Zastosowania:

- Badania marketingowe: Scrapowanie statystyk social media, informacji o produktach lub recenzji.

- Ogłoszenia nieruchomości: Agregowanie danych o nieruchomościach z wielu stron.

- Zbieranie danych dla małych firm: Budowanie list prospectów lub monitorowanie konkurencji.

Cennik:

Darmowy do nielimitowanego scrapingu pojedynczych stron. Płatne plany zaczynają się od (Light) za ekstrakcję wielu stron/grup, a (Business) obejmuje większą skalę i harmonogramy.

Opinie użytkowników:

Listly ma ocenę i ponad 200 000 użytkowników. Użytkownicy kochają prostotę („To nie tylko oszczędziło mi czas; zmieniło moje podejście do pracy... to, co kiedyś zajmowało 10 minut, teraz z Listly zajmuje 1 minutę”). Bardziej zaawansowani użytkownicy zauważają, że darmowy plan jest ograniczony przy zadaniach wielostronicowych.

Zalety:

- Bardzo łatwy dla osób nietechnicznych

- Świetny darmowy plan do podstawowego użycia

- Bezpośredni eksport do Excela i Sheets

Wady:

- Ekstrakcja wielu stron/grup wymaga płatnego planu

- Mniejsza elastyczność przy zaawansowanej logice

Listly to jeden z najlepszych wyborów dla każdego, kto chce w kilka sekund przejść od strony internetowej do arkusza kalkulacyjnego.

9. NoCoding Data Scraper: Rozszerzenie Chrome do web scrapingu dla osób nietechnicznych

NoCoding Data Scraper (NDS) to ukryty klejnot dla osób, które chcą zarówno web scrapingu, jak i automatyzacji przeglądarki — bez pisania kodu.

Przegląd:

NDS łączy web scraping z funkcjami RPA (robotic process automation). Możesz wizualnie budować workflow do klikania, wypełniania formularzy, nawigacji i wyodrębniania danych. Obsługuje logikę warunkową, scraping wsadowy, a nawet integrację ze Slackiem/webhookami.

Najważniejsze funkcje:

- Wizualny kreator workflow: Rejestruj kroki takie jak klikanie, wypełnianie i scraping.

- Logika warunkowa: Gałęzie if/else do zaawansowanej automatyzacji.

- Generator receptur AI: Automatycznie tworzy receptury scrapingu.

- Scraping wsadowy i przyrostowy: Obsługa list URL i monitorowanie zmian.

- Integracje: Eksport do Excela, Sheets, Slacka lub webhooków.

Zastosowania:

- Badania biznesowe: Automatyzacja scrapingu i wprowadzania danych.

- Wyodrębnianie kontaktów: Pobieranie leadów i automatyczne wypełnianie formularzy.

- Automatyzacja workflow: Monitorowanie stron, wyzwalanie alertów lub integracja ze Slackiem.

Cennik:

Większość funkcji jest darmowa. Dostępne jest także tworzenie receptur na zamówienie za opłatą (100–300 USD za złożone zadania).

Opinie użytkowników:

NDS ma ocenę i ponad 40 000 użytkowników. Użytkownicy chwalą interfejs „potężny, a jednocześnie łatwy w użyciu” oraz szeroki zakres funkcji. Niektórzy wspominają o umiarkowanej krzywej uczenia dla początkujących, ale doceniają elastyczność.

Zalety:

- Darmowe i bogate w funkcje

- Łączy scraping z automatyzacją

- Świetne do złożonych, wieloetapowych workflow

Wady:

- Krzywa uczenia dla osób nietechnicznych

- Wsparcie społecznościowe zamiast dedykowanej pomocy

NDS jest idealny dla osób, które chcą automatyzować coś więcej niż tylko scraping — można go traktować jak osobistego robota do przeglądarki.

Jak wybrać odpowiednie rozszerzenie Chrome do web scrapingu do swoich potrzeb

Przy tak wielu opcjach, jak wybrać odpowiedni scraper Chrome dla swojej firmy? Oto moje podejście:

- Do bieżącego użytku biznesowego: i Simplescraper oferują łatwą automatyzację, harmonogramy i integracje.

- Do szybkich, jednorazowych zadań: Wypróbuj Instant Data Scraper lub Listly — oba są darmowe i bardzo proste.

- Do złożonych, wielopoziomowych stron: Web Scraper i Data Miner dają maksymalną kontrolę (choć wymagają nauki).

- Do generowania leadów i scrapingu kontaktów: PandaExtract to świetna wartość dzięki licencji dożywotniej.

- Do automatyzacji workflow: NoCoding Data Scraper pozwala automatyzować wieloetapowe procesy.

Weź pod uwagę wolumen, typ danych, budżet i to, jak bardzo chcesz wszystko zautomatyzować. I nie zapomnij sprawdzić opinii użytkowników, żeby zobaczyć feedback z prawdziwego świata.

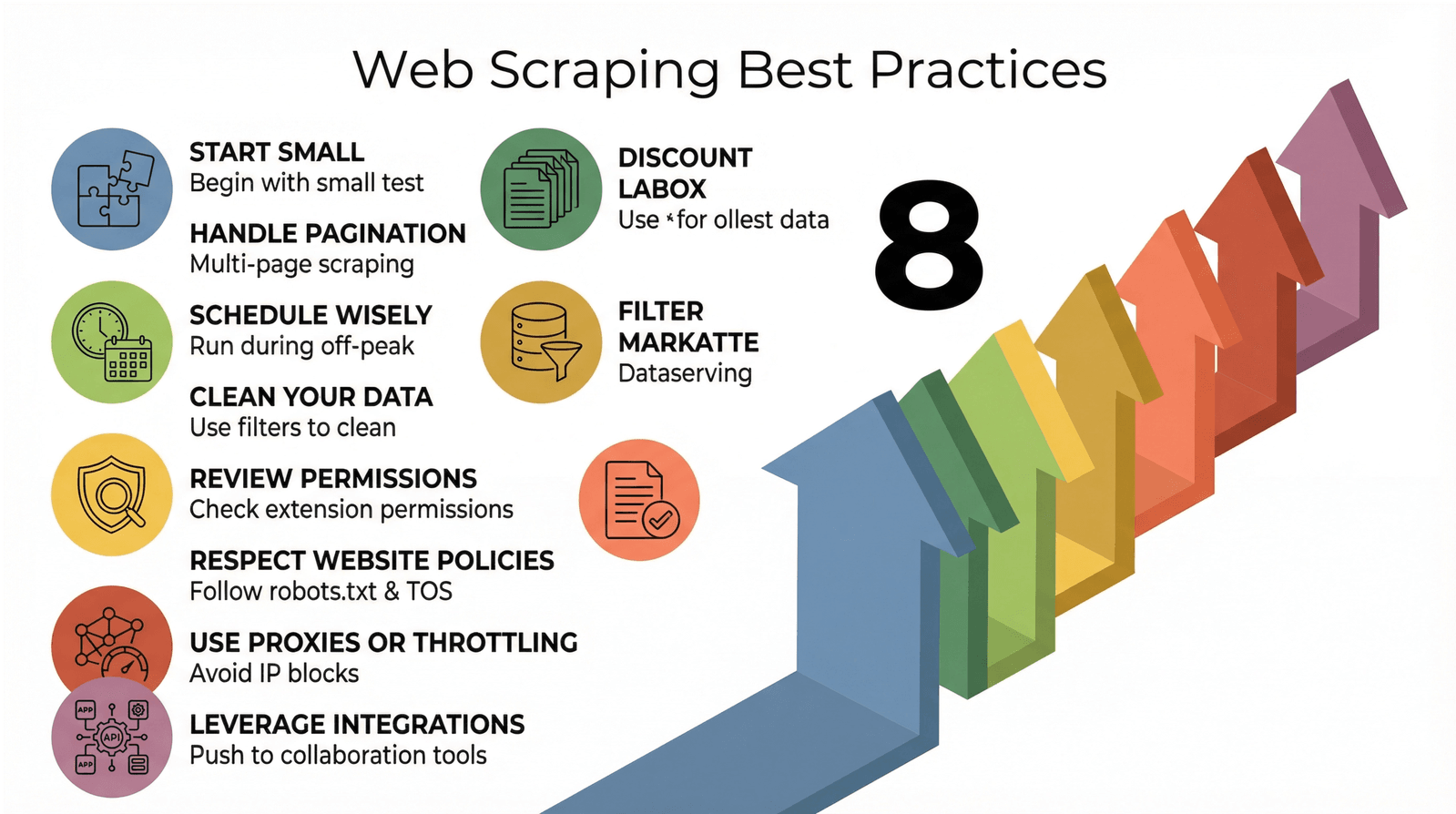

Wskazówki, jak wycisnąć maksimum z Chrome Web Scrapera

Po drodze zebrałem kilka trików (i nauczyłem się też kilku lekcji na własnych błędach):

- Zacznij od małej skali: Przetestuj scraper na kilku stronach, zanim zwiększysz skalę.

- Obsłuż paginację: Korzystaj z wbudowanych funkcji paginacji do scrapowania wielostronicowych list.

- Planuj rozsądnie: Uruchamiaj scrapowanie poza godzinami szczytu, żeby uniknąć blokad.

- Czyść dane: Używaj wbudowanych filtrów albo eksportuj do Sheets/Excela w celu porządkowania.

- Sprawdzaj uprawnienia: Instaluj rozszerzenia tylko z zaufanych źródeł i sprawdzaj, do jakich danych mają dostęp.

- Szanuj zasady witryny: Zawsze sprawdzaj robots.txt i regulamin. Scrapuj odpowiedzialnie — nikt nie lubi niekontrolowanego bota.

- Używaj proxy lub ograniczania tempa: Przy dużych zadaniach narzędzia takie jak Listly czy Simplescraper oferują wsparcie proxy i regulację prędkości, żeby unikać blokad.

- Wykorzystuj integracje: Przesyłaj dane bezpośrednio do Sheets, Airtable lub Notion, aby współpracować w czasie rzeczywistym.

A jeśli kiedykolwiek złapiesz się na tym, że scrapujesz własną stronę firmową po raz trzeci w ciągu tygodnia, może to znak, że pora na spotkanie zespołu o dostępie do danych.

Podsumowanie: jak odblokować wartość biznesową dzięki najlepszym rozszerzeniom Chrome do web scrapingu

Web scraping stał się mainstreamem, a rozszerzenia Chrome do web scrapingu są w samym centrum tej rewolucji. Niezależnie od tego, czy budujesz pipeline sprzedażowy, monitorujesz ceny w e-commerce, czy po prostu chcesz uniknąć kolejnego nocnego maratonu kopiuj-wklej, znajdziesz tu narzędzie dla siebie.

Moja rada? Zacznij od darmowych planów — sprawdź, który workflow najlepiej pasuje do Twoich potrzeb, i przechodź na wyższy plan dopiero wtedy, gdy będziesz gotowy na skalowanie. Najlepsze jest to, że w 2026 roku nie musisz być programistą ani data scientistą, żeby wykorzystać wartość web scrapingu. Z odpowiednim scraperem Chrome możesz zamienić internet we własną bazę danych biznesowych — bez zarywania nocy na kofeinie.

Miłego scrapingu — i pamiętaj, że jeśli kiedyś utkniesz, to pewnie istnieje jakieś rozszerzenie (albo życzliwy CEO), który był już dokładnie w tym miejscu.

FAQ:

-

Czym jest rozszerzenie Chrome do web scrapingu i po co go używać?

Rozszerzenie Chrome do web scrapingu to dodatek do przeglądarki, który wyodrębnia uporządkowane dane (tabele, listy, obrazy, dane kontaktowe) z dowolnej strony internetowej bez pisania kodu. Pozwala wskazać, kliknąć i pobrać dane w formatach takich jak CSV, Excel, Google Sheets czy JSON.

Automatyzując kopiowanie i wklejanie, narzędzia te oszczędzają godziny przy generowaniu leadów, monitorowaniu cen, badaniach treści czy projektach akademickich — zamieniając ręczne workflow w proste działania w przeglądarce i dając więcej czasu na analizę lub strategię.

-

Jakich funkcji powinienem szukać w rozszerzeniu Chrome do web scrapingu?

Kluczowe funkcje to wykrywanie pól oparte na AI, paginacja i nawigacja po podstronach, harmonogramy lub uruchomienia w chmurze oraz elastyczne opcje eksportu (Sheets, Airtable, Notion, API). Warto szukać obsługi wielu typów danych (tekst, obrazy, e-maile, numery telefonów), łatwości użycia typu point-and-click dla osób nietechnicznych, szablonów dla popularnych stron oraz możliwości obsługi dynamicznych treści (nieskończone przewijanie, formularze logowania). Ważny jest też darmowy plan do podstawowego użycia oraz przejrzysty cennik przy skalowaniu.

-

Dlaczego warto wybrać Thunderbit do web scrapingu wspieranego przez AI?

Thunderbit łączy sugestie pól oparte na AI z scrapingiem w dwóch kliknięciach, automatycznie wykrywa strukturę danych i podąża za podstronami, aby wzbogacić zestaw danych. Oferuje gotowe szablony dla Amazon, Google Maps, Zillow i innych serwisów, a także planowanie w chmurze („co poniedziałek o 9:00”) w prostym języku. Możesz pobierać tekst, linki, e-maile, numery telefonów i obrazy, a potem eksportować wszystko bezpośrednio do Excela, Google Sheets, Airtable lub Notion. Darmowy plan obejmuje 6 stron miesięcznie i kredyty próbne; płatne plany zaczynają się od 15 USD/miesiąc za 500 wierszy.

Dowiedz się więcej: