Wyszukiwanie na GitHubie frazy „amazon scraper” zwraca około . Gdy zawęzimy wynik do repozytoriów wypchniętych w ciągu ostatnich sześciu miesięcy, zostaje mniej więcej — ledwie 20%. Reszta? Porzucone poradniki, przestarzałe wrappery i skrypty, które przestały działać w chwili, gdy Amazon zaostrzył zabezpieczenia.

Spędziłem sporo czasu, przekopując się przez repozytoria Amazon scraper, czytając zgłoszenia na GitHubie i śledząc wątki społecznościowe na Reddicie oraz Stack Overflow. Wzorzec zawsze jest ten sam: ktoś trafia na popularne repo, poświęca godzinę na konfigurację, uruchamia je raz i wpada na ścianę CAPTCHA albo błędów 503. Podejście Amazona do walki z botami w 2026 roku nie ma już wiele wspólnego z tym sprzed nawet dwóch lat — fingerprinting TLS, analiza zachowań i agresywne wdrażanie CAPTCHA sprawiły, że stary plan „rotuj user-agentami i licz na szczęście” jest prawie bezużyteczny. Ten przewodnik omawia najlepsze praktyki, które naprawdę mają znaczenie, jeśli chcesz pobierać wiarygodne dane z Amazona z repozytorium na GitHubie, oraz co robić, gdy — a nie czy — scraper się zepsuje.

Czym jest Amazon Scraper na GitHubie i dlaczego tak wiele z nich zawodzi?

Repozytorium Amazon scraper na GitHubie to zwykle skrypt open source — najczęściej napisany w Pythonie, Node.js albo Scrapy — który wyciąga uporządkowane dane ze stron Amazona. Najczęściej chodzi o tytuł produktu, cenę, ASIN, oceny, liczbę recenzji, dostępność, informacje o sprzedawcy, karty wyników wyszukiwania i treść recenzji.

Architektura jest zazwyczaj prosta:

- Klient HTTP albo przeglądarka headless pobiera stronę.

- Parser HTML lub JSON wyodrębnia pola.

- Dane trafiają do CSV, JSON albo bazy danych.

Repozytoria zwykle dzielą się na cztery grupy:

- Lekkie biblioteki Pythona (np. )

- Spidery Scrapy (np. )

- Automatyzatory przeglądarki Selenium lub Playwright

- Projekty typu API wrapper, które tak naprawdę są front-endem do komercyjnej usługi scrapingowej (np. )

Wzorzec awarii jest przewidywalny. Większość repozytoriów psuje się, bo:

- Amazon zmienia układ strony albo fragmenty HTML

- Amazon zwraca 503 albo CAPTCHA zamiast prawdziwej treści

- TLS i HTTP fingerprint scrapera przestają przypominać przeglądarkę

- Niezgodność locale, języka lub nagłówków wzbudza podejrzenia

- Opiekun repozytorium odchodzi po rozwiązaniu swojego pierwotnego, wąskiego przypadku użycia

Duża liczba gwiazdek i „aktualnie używalne” to dwie zupełnie różne rzeczy. W audycie, który przeprowadziłem na potrzeby tego artykułu, tylko około trzy z ośmiu szeroko widocznych repozytoriów wyglądały na wyraźnie aktywne w 2026 roku.

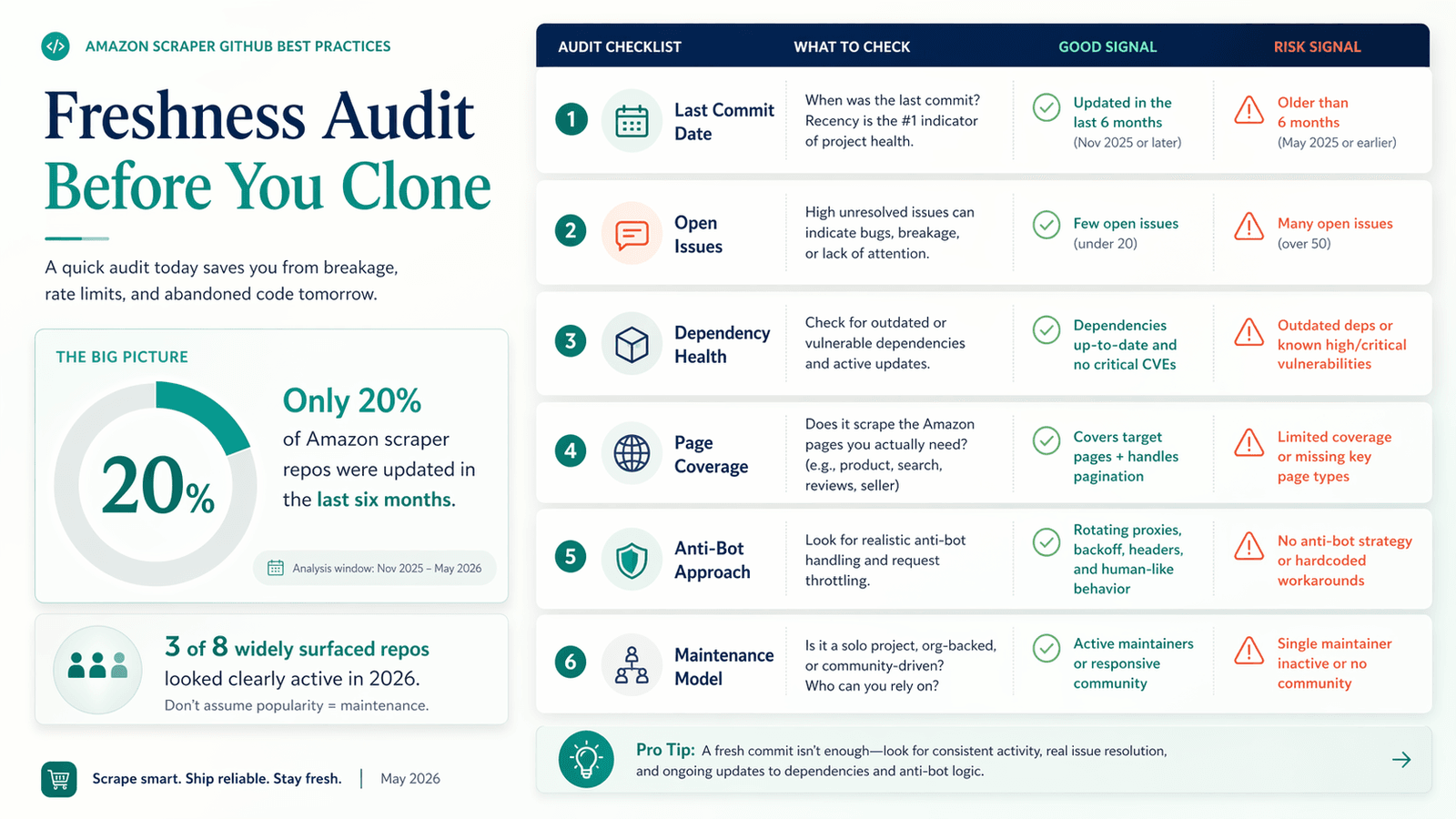

Zrób audyt świeżości na 2026 rok, zanim sklonujesz jakiekolwiek repo Amazon Scraper z GitHuba

Ten krok ma dla Amazona większe znaczenie niż dla większości innych źródeł danych. Postawa obronna Amazona zmienia się szybciej niż w typowym serwisie e-commerce, więc repo, które działa bez problemu na stronie firmowej, może przestać być użyteczne na Amazonie w ciągu kilku tygodni. Mimo to większość list „best amazon scraper github” poleca repozytoria bez sprawdzenia, czy nadal działają. Użytkownicy tracą godziny na konfigurację zepsutych narzędzi.

Jak sprawdzić, czy repozytorium na GitHubie nadal żyje

Zanim wykonasz git clone, przejdź przez te kontrole:

- Data ostatniego commita: Cokolwiek starsze niż 6 miesięcy to na Amazonie poważny sygnał ostrzegawczy.

- Otwarte zgłoszenia vs. tempo odpowiedzi: Przeszukaj kartę Issues pod kątem haseł „captcha”, „503”, „blocked” i „not working”. Jeśli takie raporty się piętrzą, a maintainer nie odpowiada, odpuść.

- Zdrowie zależności: Otwórz

requirements.txtalbopackage.json. Przestarzałe biblioteki (np. starerequestsbez nowoczesnej obsługi TLS) to czerwona flaga. - Pokrycie typów stron Amazona: Czy repo obsługuje strony produktów, wyniki wyszukiwania i recenzje? Czy tylko jeden typ?

- Podejście anty-bot: Nagłówki wpisane na sztywno bez wsparcia proxy to podejście z 2023 roku, które nie przetrwa 2026.

Lista kontrolna świeżości Amazon Scraper GitHub

| Sygnał świeżości | Co sprawdzić | Czerwona flaga 🚩 |

|---|---|---|

| Data ostatniego commita | Feed commitów albo data wypchnięcia repo | Starsza niż 6 miesięcy |

| Otwarte zgłoszenia | Karta Issues — filtruj „captcha”, „503”, „blocked” | Powtarzające się awarie bez odpowiedzi maintenera |

| Zdrowie zależności | requirements.txt / package.json | Przestarzałe biblioteki, brak nowoczesnej strategii TLS |

| Pokrycie stron Amazona | README + przykłady kodu | Obsługuje tylko jeden typ strony (np. produkt, ale nie wyszukiwanie ani recenzje) |

| Podejście anty-bot | Kod źródłowy, konfiguracja proxy | Tylko nagłówki i ciągi UA wpisane na sztywno |

| Model utrzymania | Czy to prawdziwy scraper, poradnik czy komercyjny wrapper API? | Repo to w praktyce tylko front-end do płatnej usługi |

Co faktycznie wykazał audyt

Sprawdziłem osiem szeroko widocznych repozytoriów Amazon scraper według tych kryteriów. Wyniki są mało optymistyczne:

| Repo / narzędzie | Gwiazdki | Sygnał ostatniego commita | Zakres | Status w 2026 | Uwagi |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2 872 | 2026-04-02 | Zarządzany wrapper API scrapera | Działa, ale nie jest DIY | Świeże, ale to tak naprawdę front-end do zarządzanej usługi |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | Zarządzane API do wyszukiwania, szczegółów, recenzji | Działa, ale nie jest DIY | Dobre pokrycie, ale to produkt API, nie surowy scraper |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Lekka biblioteka Pythona | Działa | Najbardziej klarowny bezpośredni scraper z GitHuba korzystający z curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Tylko recenzje | Wąski, ale używalny | Stary i bardzo wyspecjalizowany w recenzjach |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Ostatni commit 2023; repo wypchnięte 2024-08-20 | Spidery Scrapy + middleware proxy | Poziom poradnika, starzeje się | Dobre do nauki, nie jako gotowy stos na 2026 |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | CLI Node do wyszukiwania, szczegółów, recenzji | Wysokie ryzyko | Szeroki zakres, ale utrzymanie jest zbyt stare |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Od wyszukiwania do CSV | Martwe na 2026 | Historycznie popularne, ale wyraźnie przestarzałe |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Poradnik wyszukiwanie/produkt | Martwe na 2026 | W praktyce archiwalne |

Publiczne zgłoszenia pokazują tę samą historię. ma issue zatytułowane „All requests receive captcha response.” ma „Doesn't seem to be working.” ma „Bypass Amazon protection.” To nie są niszowe przypadki — to pierwsze problemy, na jakie trafiają użytkownicy.

Plan anty-bana: jak nie zostać zablokowanym przy użyciu Amazon Scraper z GitHuba

Bycie blokowanym to największy problem dla każdego, kto korzysta z projektu amazon scraper github. Ogólne rady w stylu „użyj proxy i rotuj user-agentami” już nie wystarczają. Stos anty-botowy Amazona z lat 2025–2026 obejmuje fingerprinting TLS, analizę zachowań i agresywne CAPTCHA. Potrzebujesz podejścia warstwowego.

Dopasowanie fingerprintu TLS: dlaczego zwykłe requests kończy się banem

To jedna z najczęściej pomijanych technik anty-bana. Fingerprinting TLS działa tak: kiedy Twój skrypt otwiera bezpieczne połączenie z Amazonem, serwer może sporo wywnioskować o kliencie po tym, jak „podaje mu rękę” — po oferowanych zestawach szyfrów, kolejności rozszerzeń i ustawieniach HTTP/2. Przeglądarki używają dość stałych ustawień TLS i HTTP/2, a takie kombinacje da się fingerprintować technikami takimi jak .

Zwykłe requests i standardowe konfiguracje httpx potrafią kopiować nagłówki, ale nie kopiują zachowania TLS i HTTP/2 jak w Chrome. Amazon widzi różnicę.

rozwiązuje to bezpośrednio. Oferuje impersonację przeglądarki — obsługiwane cele to m.in. chrome136, safari184 i firefox133 — dzięki czemu fingerprint TLS klienta HTTP odpowiada prawdziwej przeglądarce. Dokumentacja wyraźnie ostrzega przed generowaniem losowych ciągów JA3: fingerprinty przeglądarek są w dużej mierze stałe dla danej wersji, a losowy bełkot jest łatwiejszy do wykrycia niż skopiowany, prawdziwy fingerprint.

Dane ze społeczności to potwierdzają. potwierdza, że argument impersonate jest przydatny, bo rotuje profile przeglądarki i utrzymuje zgodność nagłówków. Inny zauważa, że Amazon blokuje klientów na podstawie fingerprintu TLS „po około miesiącu albo dwóch”. wprost pyta, czy Amazon fingerprintuje python-requests (spoiler: tak).

Jeśli nadal używasz zwykłego requests jako podstawowego klienta do Amazona, zmień to założenie, zanim zmienisz cokolwiek innego.

Prawidłowa rotacja proxy — nie tylko „użyj proxy”

Celem proxy nie jest jak najczęstsza rotacja. Chodzi o to, by sesje wyglądały wiarygodnie.

Residential vs. datacenter: Proxy datacenter są tańsze, ale łatwiejsze do wykrycia. Residential są droższe, ale znacznie trudniejsze do oznaczenia przez Amazona. zaczyna się od 4,00 USD/GB pay-as-you-go, a przy większych planach spada do 3,50 USD/GB. zaczyna się od 6 USD/GB. Amazon należy do kategorii „zaawansowany cel”, w której residential proxy są warte tej dopłaty.

Rotacja per request vs. per session: Tu większość poradników się myli. Rotowanie proxy przy każdym żądaniu, przy jednoczesnym zachowaniu tych samych ciasteczek i nagłówków, może wyglądać mniej jak człowiek, a nie bardziej. Bezpieczniejszy wzorzec:

- Przechodzenie wyszukiwanie → produkt → recenzje na tej samej stickiej sesji, jeśli to możliwe

- Zmiana sesji przy rozpoczęciu nowej ścieżki wyszukiwania, a nie przy każdym żądaniu

- Rotacja między sesjami, a nie losowo wewnątrz jednej sesji przeglądania

Jeden zauważył, że standardowe adresy IP ISP działały znacznie gorzej niż mobilne IP na popularnych serwisach e-commerce. Inny raportował blokady nawet przy rotujących user-agentach i residential proxy — dobra przypominajka, że same proxy nie wystarczą.

Tempo żądań, backoff i limitowanie częstotliwości

Strony 503 Amazona to nie przypadkowy pech. To sprzężenie zwrotne.

o pobieraniu ponad 500 ASIN-ów opisywał błąd 503 w tym samym miejscu za każdym razem, około ASIN 101, nawet przy uśpieniach. Wzorzec jest stary, ale wniosek nadal aktualny: zbyt duży wolumen z jednego IP albo jednego fingerprintu w końcu uruchamia zabezpieczenia.

Najlepsze praktyki tempa dla samodzielnych scraperów z GitHuba:

- Losowe opóźnienia między żądaniami (a nie stałe interwały, które da się wykryć)

- 2 do 5 sekund przerwy między publicznymi żądaniami produktów dla prostych klientów HTTP

- Eksponencjalny backoff po 503 lub CAPTCHA — zwiększaj odstęp zamiast od razu ponawiać próbę

- Mniejsza współbieżność niż wydaje Ci się potrzebna

- Logowanie w trybie fail-open zamiast ciasnych pętli retry

Większość repozytoriów amazon scraper github nie ma wbudowanego limitowania częstotliwości. Trzeba je dodać samodzielnie.

Orkiestracja nagłówków: więcej niż tylko ciągi User-Agent

Amazon sprawdza cały zestaw nagłówków, nie tylko User-Agent.

Realistyczny zestaw nagłówków przeglądarki powinien zawierać:

User-AgentAcceptAccept-LanguageAccept-Encoding- wskazówki

Sec-CH-*, gdy są odpowiednie - zachowanie połączenia spójne z wybranym profilem przeglądarki

Nagłówki muszą pasować do locale marketplace. Jeden zauważył, że ten sam setup bota był wykrywany tylko w niektórych lokalizacjach, a inny komentujący wskazał nagłówki związane z regionem, takie jak Accept-Language.

Zasada jest prosta: nagłówki, profil TLS/przeglądarki i geografia proxy nie mogą sobie przeczyć. Nie wysyłaj nagłówków Chrome z UA Firefoxa. Nie używaj amerykańskiego proxy z Accept-Language: de-DE.

Obsługa CAPTCHA: kiedy rozwiązywać, a kiedy odpuścić

Natrafienie na CAPTCHA oznacza, że Amazon już jest podejrzliwy. Samo jej rozwiązanie nie resetuje poziomu zaufania.

W przypadku pojedynczych, rzadkich CAPTCHA:

- Pakiet PyPI to czysto pythonowy solver tekstowych CAPTCHA Amazona, choć jego najnowsze wydanie pochodzi z maja 2023 roku — traktuj go jako narzędzie taktyczne, nie długoterminową strategię

- podaje cenę Amazon Captcha na poziomie 0,45 USD za 1 000 rozwiązań

W przypadku powtarzających się pętli CAPTCHA:

- Przestań rozwiązywać i zacznij odpuszczać

- Powtarzające się CAPTCHA oznaczają spaloną sesję — ich rozwiązywanie nie odbuduje zaufania do fingerprintu, historii sesji ani reputacji IP

- Jeśli CAPTCHA grupują się według podsieci proxy, problem leży w warstwie sieci, nie w parserze

Kiedy naprawdę potrzebujesz przeglądarki headless, a kiedy to przesada

Błędnym odruchem jest uruchamianie Playwright do wszystkiego.

Dobre zastosowania przeglądarki:

- Wyniki wyszukiwania zależne od renderowania JavaScript albo stanu zależnego od locale

- Ścieżki recenzji, które przekierowują do stron logowania lub sign-in

- Procesy, w których ciasteczka i kontekst przeglądarki są ważniejsze niż surowa szybkość

Złe zastosowania przeglądarki:

- Zwykłe publiczne strony produktów

- Statyczne wyciąganie szczegółów produktu, gdzie wystarczy klient HTTP podobny do przeglądarki

- Duże masowe pobieranie, gdzie liczy się wydajność obliczeniowa

Zacznij od najlżejszego klienta, który działa. Jeden o scrapowaniu na dużą skalę opisywał progresję: najpierw requests, potem curl_cffi, a pełna przeglądarka dopiero wtedy, gdy lżejsze opcje zawodzą. Przeglądarki headless są wyraźnie wolniejsze i bardziej zasobożerne niż klienci HTTP przy scrapowaniu stron produktów Amazona.

Macierz decyzji anty-bana dla projektów Amazon Scraper GitHub

| Scenariusz | Zalecane podejście | Dlaczego |

|---|---|---|

| Publiczne strony produktów (mała skala) | curl_cffi + sticka sesja residential | Najtańsza ścieżka, która nadal wygląda jak przeglądarka |

| Strony wyników wyszukiwania | Najpierw curl_cffi, Playwright tylko jeśli renderowanie albo stan psują HTTP | Wyszukiwanie jest bardziej stanowe i wrażliwe na locale |

| Recenzje (wymagane logowanie) | Tryb przeglądarkowy z prawdziwymi cookies/sesją | Logowanie i dynamiczne przepływy recenzji trudniej odtworzyć czystym HTTP |

| Duża skala (5k+ dziennie) | Zarządzane API scrapera, unlocker albo platforma no-code | Sam kod z GitHuba staje się problemem infrastrukturalnym |

Gdy Twój projekt Amazon Scraper GitHub się psuje: miej plan awaryjny no-code

Każdy doświadczony scraper ma plan B.

Aktualizacje Amazona prędzej czy później zepsują każde repozytorium GitHub — i to w najgorszym możliwym momencie. Dla zespołów e-commerce zepsuty scraper oznacza pominięte zmiany cen, nieaktualne dane konkurencji i luki w dashboardach.

Wiele osób szukających „amazon scraper github” to w rzeczywistości użytkownicy biznesowi — osoby z e-commerce, marketerzy, badacze FBA — którzy sięgnęli po kod, bo nie znaleźli lepszych opcji. Dane z forów pokazują też realną frustrację z oficjalnym Amazona: ograniczony dostęp, ograniczone dane i , których wielu sprzedawców nie może spełnić.

Dlaczego Amazon Scraper na GitHubie potrzebują ciągłego utrzymania

Powyższy audyt pokazuje to bardzo jasno:

- Przestarzałe repozytoria gromadzą zgłoszenia o błędach bez poprawek

- Repozytoria, które „działają”, otwarcie opisują teraz środki anty-botowe w README

- Wątki społeczności coraz częściej kręcą się wokół fingerprintów TLS, pętli CAPTCHA i jakości proxy — a nie selektorów CSS

Dla użytkowników biznesowych ten ciężar utrzymania to prawdziwy ukryty koszt. Repo jest darmowe. Twój czas na debugowanie o 2:00 w nocy — już nie.

Thunderbit jako praktyczna alternatywa dla Amazon Scraper

oferuje , który wyciąga tytuł, cenę, ASIN, oceny, markę, dostępność, kraj wysyłki i oryginalny URL — bez pisania kodu.

Jak to wygląda w praktyce:

- Scraping w 2 kliknięcia zamiast konfiguracji środowisk Pythona, zależności i proxy

- Natychmiastowy szablon Amazona — bez narzutu AI, po prostu ekstrakcja jednym kliknięciem

- Tryb scrapowania przeglądarkowego dla stron wymagających logowania (jak strony recenzji, które frustrują użytkowników scraperów z GitHuba)

- Cloud scraping dla publicznych stron produktów z dużą prędkością (50 stron naraz)

- Darmowy eksport do Google Sheets, Airtable, Notion, Excel — nie tylko CSV/JSON

- Scheduled scraper do bieżącego monitorowania cen

- AI dostosowuje się do zmian układu — bez kosztów utrzymania po Twojej stronie

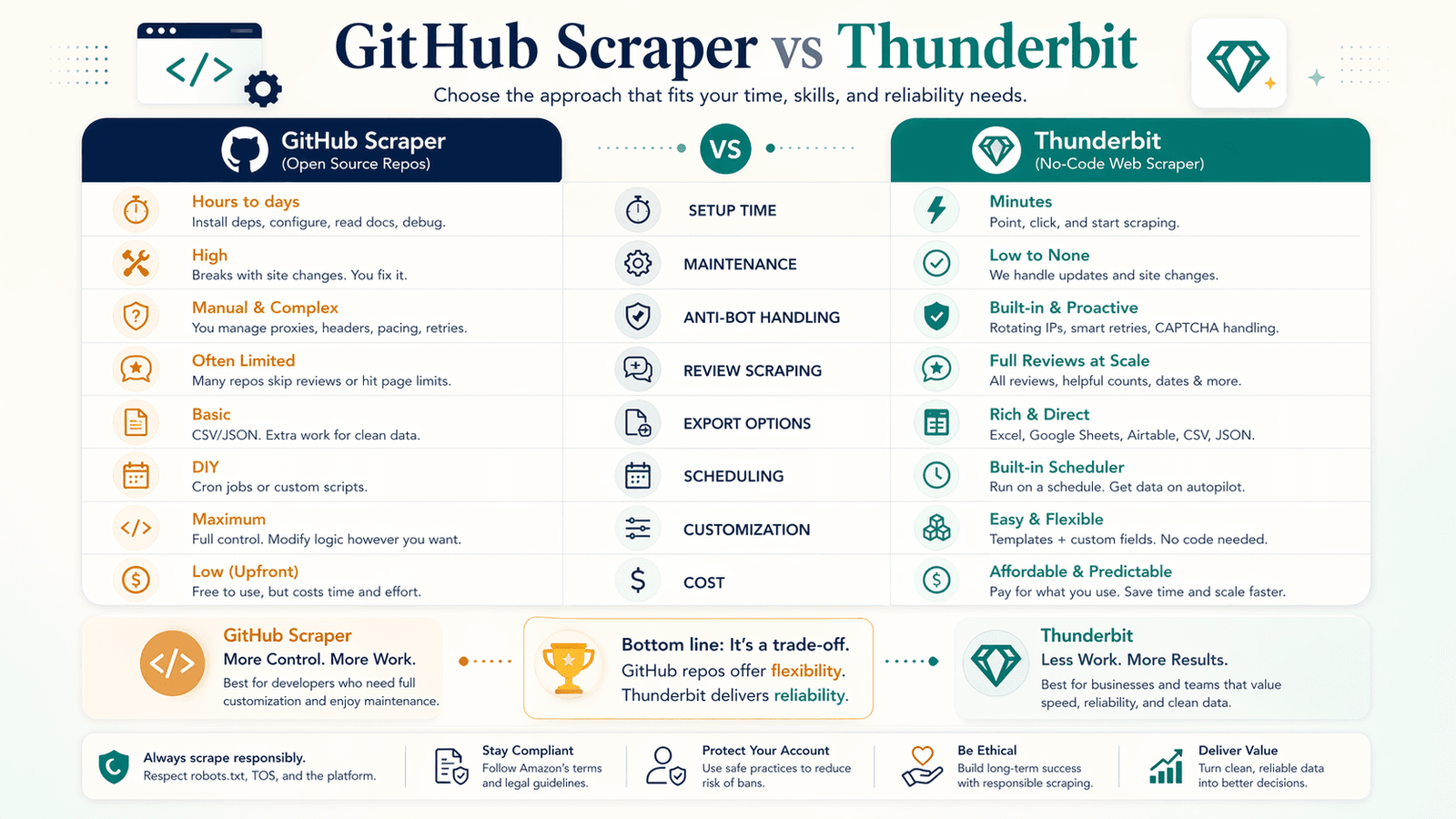

GitHub Amazon Scraper kontra Thunderbit: uczciwe porównanie

| Czynnik | GitHub Scraper (np. AmzPy) | Thunderbit |

|---|---|---|

| Czas konfiguracji | 15–60 min (Python, zależności, proxy) | Około 2 min (instalacja rozszerzenia Chrome) |

| Utrzymanie | Ty naprawiasz awarie | AI dostosowuje się do zmian układu |

| Obsługa anty-bot | DIY (proxy, nagłówki, TLS) | Wbudowana (tryb cloud + browser) |

| Scraping recenzji (po zalogowaniu) | Złożone zarządzanie sesją | Tryb scrapowania przeglądarkowego |

| Eksport danych | Tylko CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Harmonogram | DIY (cron, Airflow itd.) | Wbudowany scheduled scraper |

| Dostosowanie | Większe | Mniejsze |

| Koszt | Darmowy (plus koszty proxy) | Dostępny plan darmowy; model kredytowy |

Uczciwy kompromis: repozytoria GitHub dają większą możliwość dostosowania; Thunderbit oferuje większą niezawodność. Jeśli Twojemu zespołowi bardziej zależy na uptime niż na elastyczności, ścieżka no-code zwykle jest bardziej racjonalnym wyborem.

Najlepsze praktyki dla planowanego i cyklicznego scrapowania Amazona

Większość projektów amazon scraper github jest budowana do jednorazowych uruchomień, ale realne zastosowania biznesowe — monitorowanie cen, śledzenie stanów magazynowych, analiza konkurencji — wymagają cyklicznego scrapowania. Repozytoria GitHuba niemal nigdy nie zawierają natywnego harmonogramowania, więc użytkownicy muszą składać wszystko z cron jobów, Airflow albo workflowów n8n.

Harmonogramowanie DIY dla Amazon Scrapers z GitHuba

Minimalny sensowny setup cykliczny:

- Cron job na Linuxie lub macOS, który uruchamia skrypt według harmonogramu

- Logi tylko dopisywane, żeby dało się debugować błędy po fakcie

- Deduplikacja po ASIN + znacznik czasu, żeby nie zapisywać tych samych danych dwa razy

- Alerty o błędach (choćby prosty e-mail przy kodzie wyjścia innym niż zero), żeby wiedzieć, kiedy uruchomienie padnie o 3:00

Dla bardziej złożonych zespołów:

- n8n do lekkiej automatyzacji workflowów (często wspominane w wątkach społeczności)

- Airflow do cięższych pipeline’ów harmonogramowanych

- Stan w bazie danych, jeśli potrzebujesz różnic i historii

Kluczową najlepszą praktyką nie jest sam scheduler — tylko zarządzanie stanem. Śledź ostatnie poprawne uruchomienie, ostatni zestaw ASIN-ów, zmienione ceny i nieudane URL-e.

Harmonogramowanie prostsze z Thunderbit

w Thunderbit pozwala opisać interwał zwykłym językiem, wkleić URL-e i kliknąć „Schedule”. AI zamienia naturalny język na harmonogram cron — bez technicznej konfiguracji. Dla zespołów e-commerce bez inżynierów, które monitorują ceny albo premiery produktów konkurencji, to realne zmniejszenie tarcia operacyjnego.

Najlepsze praktyki dla cyklicznych scrape’ów Amazona

Obowiązują niezależnie od narzędzia:

- Deduplikuj po ASIN + okno czasowe — nie zapisuj tego samego produktu dwa razy w jednym przebiegu

- Zapisuj ceny jako liczby, nie surowe stringi — oszczędza to czyszczenie downstream

- Dodawaj znaczniki czasu scrape’u do każdego wiersza — będą potrzebne do analizy trendów

- Śledź delty, nie tylko stan bieżący — „cena spadła o 12% od zeszłego tygodnia” jest użyteczniejsze niż „cena wynosi 24,99 USD”

- Ustawiaj alerty na istotne zmiany — spadek ceny konkurencji o 15% zasługuje na powiadomienie; wahanie 0,5% to szum

- Myśl o przechowywaniu danych — płaskie pliki wystarczą przy małych uruchomieniach; przy 5k+ ASIN-ów dziennie rozważ bazę danych albo arkusz w chmurze

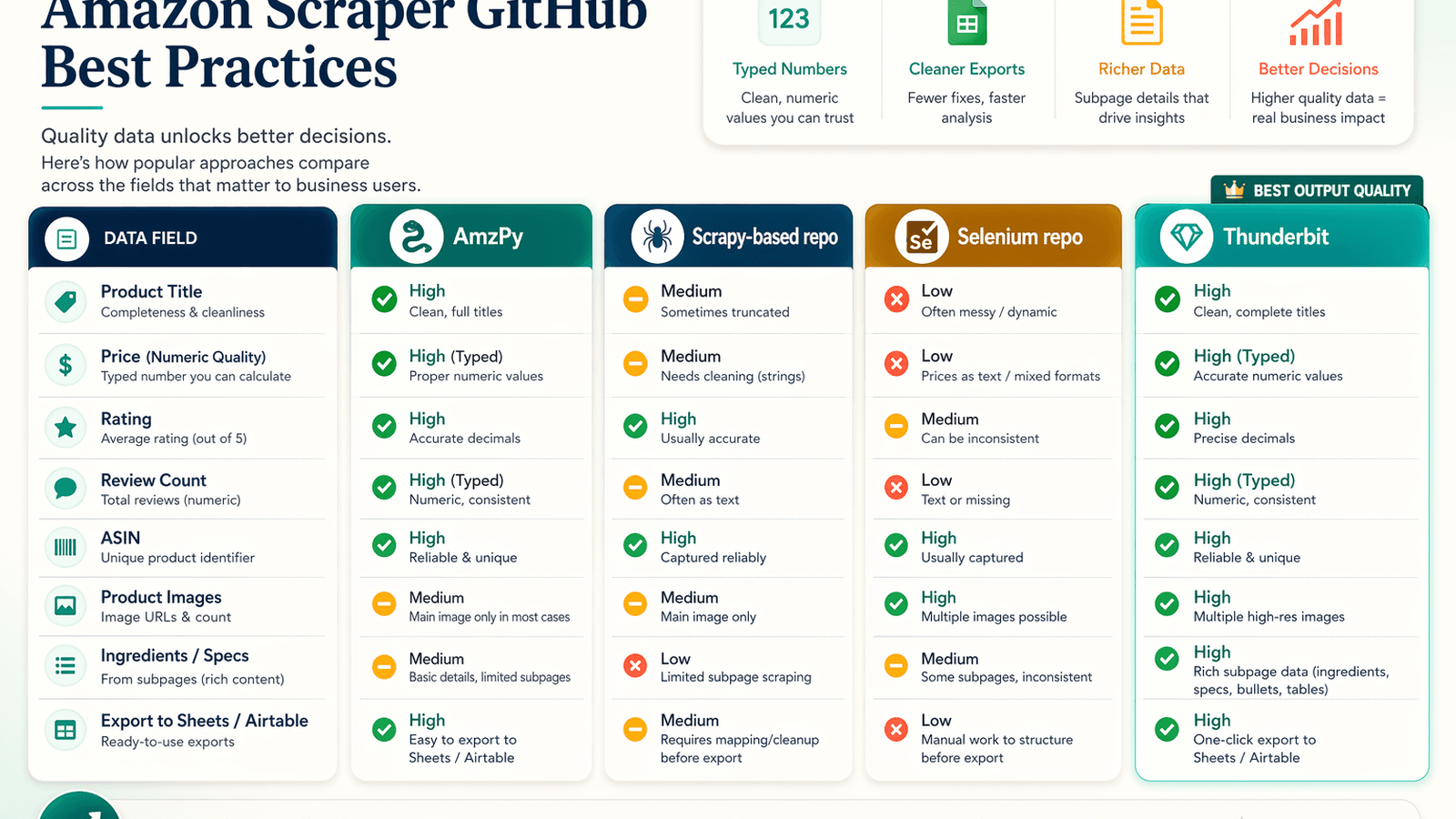

Jakość wyników obok siebie: co faktycznie zwraca każde podejście Amazon Scraper GitHub

Nikt nie porównuje rzeczywistej jakości wyników między repozytoriami amazon scraper github. Użytkownicy bardzo dbają o jakość danych — „które narzędzie daje najczystsze, najbardziej kompletne dane” — ale muszą każde repo sklonować i przetestować samodzielnie. Ta sekcja wypełnia tę lukę.

Co popularne repozytoria GitHub faktycznie wyciągają, a czego nie

Na podstawie przykładów z README, publicznych przykładów i udokumentowanych formatów wyjściowych:

| Podejście | Co wyraźnie wyciąga | Typowe luki / kompromisy |

|---|---|---|

| amzpy | Tytuł, cena, waluta, URL obrazka, oceny, recenzje, warianty, ASIN | Zorientowane na stronę produktu; mniej bogate w pełne recenzje/specyfikacje |

| tducret/amazon-scraper-python | CSV z tytułem, oceną, liczbą recenzji, URL produktu, URL obrazka, ASIN | Przestarzałe, skupione na listingach, słabe podejście anty-bot |

| python-scrapy-playbook scraper | Wyniki wyszukiwania, strony produktów, recenzje, pipeline’y CSV/JSON | Poziom poradnika; opiera się na zewnętrznym middleware proxy; prawdopodobnie wymaga więcej czyszczenia |

| omkarcloud/amazon-scraper | Wyszukiwanie, kategorie, szczegóły, top recenzje, wiele obrazów/wideo/specyfikacji | To nie jest surowy scraper — to zarządzana usługa API |

| Szablon Amazon w Thunderbit | Tytuł, cena, ASIN, marka, ocena, recenzje, dostępność, kraj wysyłki, wzbogacanie podstron | Mniejsza kontrola na poziomie kodu niż w niestandardowych skryptach |

Tabela porównawcza jakości wyjścia

| Pole danych | AmzPy | Repo oparte na Scrapy | Repo Selenium | Thunderbit |

|---|---|---|---|---|

| Tytuł produktu | ✅ | ✅ | ✅ | ✅ |

| Cena (numeryczna) | ⚠️ string | ✅ | ⚠️ string | ✅ (typ liczbowy) |

| Ocena | ✅ | ✅ | ✅ | ✅ |

| Liczba recenzji | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Obrazy produktu | ❌ | ⚠️ tylko miniatura | ✅ | ✅ (pełna rozdzielczość, do eksportu) |

| Składniki/specyfikacje | ❌ | ❌ | ❌ | ✅ (przez scrapowanie podstron + AI) |

| Eksport do Sheets/Airtable | ❌ | ❌ | ❌ | ✅ za darmo |

Dlaczego formatowanie danych ma znaczenie dla użytkowników biznesowych

Niespójne dane tworzą ukryty nakład pracy. Nawet skuteczny scraper może być porażką operacyjną, jeśli:

- Ceny są stringami z symbolami waluty zamiast czystymi liczbami

- Brakujące wartości są niespójne (pusty string vs. null vs. „N/A”)

- Obrazy to tylko miniatury niskiej rozdzielczości

- Pola recenzji albo specyfikacji wymagają postprocessingu przed analizą

Dla zespołów e-commerce czyste dane bezpośrednio wpływają na szybkość analizy i podejmowanie decyzji. AI w Thunderbit formatuje dane według typu — liczby jako liczby, daty jako daty, URL-e jako URL-e — więc są gotowe do użycia od razu. Repozytoria GitHuba różnią się pod tym względem bardzo mocno, a czas czyszczenia szybko się kumuluje.

Szybka checklista: najlepsze praktyki Amazon Scraper GitHub

- Sprawdź datę ostatniego commita przed klonowaniem. Starsze niż sześć miesięcy to na Amazonie silny sygnał ostrzegawczy.

- Przeszukaj issues pod kątem „captcha”, „503”, „blocked” i „not working” przed konfiguracją.

- Preferuj

curl_cffialbo inny klient HTTP imitujący przeglądarkę zamiast zwykłegorequests. - Utrzymuj spójność nagłówków, profilu TLS, języka i geografii proxy — bez sprzeczności.

- Używaj stickych sesji do ścieżek przeglądania; nie rotuj wszystkiego ślepo przy każdym żądaniu.

- Dodaj losowe tempo i eksponencjalny backoff.

- Traktuj powtarzające się CAPTCHA jako spaloną sesję, a nie zagadkę do brute-force.

- Używaj przeglądarek headless tylko wtedy, gdy klient HTTP nie potrafi wiarygodnie odtworzyć strony.

- Zapisuj punkty kontrolne i stan, żeby nieudane przebiegi można było bezpiecznie wznowić.

- Miej plan awaryjny — czy to zarządzane API, czy narzędzie no-code jak .

Aspekty prawne i etyczne scrapowania Amazona w 2026 roku

Kilka rzeczy, które warto krótko znać.

Postawa Amazona jest restrykcyjna i staje się jeszcze bardziej restrykcyjna. Najmocniejsze sygnały:

- Własne strony pomocy Amazona zwracają teraz z komunikatem: „To discuss automated access to Amazon data please contact api-services-support@amazon.com.”

- Amazona blokuje szeroki zakres dynamicznych ścieżek, recenzji, profili, wishlist i listingów ofert.

- wyraźnie sprzeciwia się ukrytemu lub maskowanemu dostępowi agentów, obchodzeniu zabezpieczeń i błędnemu identyfikowaniu agenta jako Google Chrome. Amazon wydał też w tej sprawie.

- Amazon wobec crawlerów OpenAI pod koniec 2025 roku.

Praktyczne ryzyko jest wyraźnie większe, gdy przechodzisz od publicznych stron produktów do przepływów uwierzytelnionych, maskowanej automatyzacji albo masowej komercyjnej ekstrakcji. To nie jest porada prawna — w swojej konkretnej sytuacji skonsultuj się z własnym zespołem prawnym.

Najważniejsze wnioski: jak zdobywać wiarygodne dane z Amazona i nie dostać bana

W kolejności ważności:

- Audytuj przed klonowaniem. Załóż, że większość wyników na GitHubie to przestarzałe repo, poradniki albo wrappery na komercyjne API.

- Najpierw podnieś poziom warstwy sieciowej. Fingerprinting TLS i spójność sesji są ważniejsze niż selektory HTML.

- Używaj stickych residential sessions, a nie losowego chaosu proxy. Rotuj między sesjami, nie wewnątrz nich.

- Tempo żądań ustaw jak użytkownik, nie jak test obciążeniowy. Losowe opóźnienia i eksponowany backoff są nie do negocjacji.

- Rozwiązuj pojedyncze CAPTCHA; porzucaj sesje, które są powtarzalnie sprawdzane. Nie brute-forcuj spalonego fingerprintu.

- Miej plan awaryjny. Amazon coś zmieni w środku tygodnia i Twój scraper z GitHuba się wysypie. Utrzymywane narzędzie no-code, takie jak , albo zarządzane API może utrzymać działanie Twojego pipeline’u, podczas gdy Ty będziesz debugować.

- Priorytetem jest jakość wyjścia. Czyste, typowane dane oszczędzają więcej czasu downstream niż szybki, ale brudny scraper.

Jeśli zależy Ci bardziej na niezawodności niż na dostosowaniu, Thunderbit oferuje utrzymywaną alternatywę — sprawdź albo obejrzyj tutoriale na . Deweloperzy, którzy chcą pełnej kontroli, jak najbardziej mogą używać repozytoriów GitHub — ale tylko z praktykami anty-bana i utrzymania opisanymi w tym przewodniku.

FAQ

Czy scrapowanie danych o produktach Amazona za pomocą scrapera z GitHuba jest legalne?

Warunki korzystania z Amazona ograniczają automatyczne zbieranie danych, a Amazon aktywnie egzekwuje te zasady za pomocą pism cease-and-desist i środków technicznych (szczególnie w latach 2025–2026). Scrapowanie publicznie dostępnych danych produktowych to strefa szara; scrapowanie za loginem albo maskowanie bota jako prawdziwej przeglądarki wiąże się z większym ryzykiem. To nie jest porada prawna — skonsultuj się z zespołem prawnym w swoim konkretnym przypadku.

Jak często psują się repozytoria Amazon scraper na GitHubie?

Bardzo często. Amazon regularnie zmienia układ stron, dodaje nowe warstwy anty-bot i deprecjonuje endpointy. W audycie do tego artykułu tylko około 3 z 8 szeroko widocznych repo wyglądały na wyraźnie działające w 2026 roku. Nawet repozytoria „działające” często mają otwarte zgłoszenia o CAPTCHA i błędach 503. Spodziewaj się, że co kilka tygodni albo miesięcy będziesz musiał coś poprawiać lub aktualizować.

Jaki jest najlepszy Amazon scraper na GitHubie w 2026 roku?

Nie ma jednego zwycięzcy — wszystko zależy od użycia i Twojej wygody technicznej. Jeśli chcesz lekki, bezpośredni scraper w Pythonie, należy do bardziej aktualnych opcji. Jeśli potrzebujesz szerszego pokrycia przez zarządzane API, działa, ale nie jest prawdziwie DIY. Zastosuj checklistę świeżości z tego artykułu, aby samodzielnie ocenić każde repo przed podjęciem decyzji.

Czy Thunderbit potrafi scrapować Amazona bez kodowania?

Tak. w Thunderbit wyciąga tytuł produktu, cenę, ASIN, oceny, markę, dostępność i więcej jednym kliknięciem. Obsługuje tryb scrapowania przeglądarkowego dla stron wymagających logowania, cloud scraping dla publicznych stron z dużą prędkością, planowane scrapowanie dla zadań cyklicznych oraz darmowy eksport do Google Sheets, Airtable, Notion i Excela. Możesz zacząć od instalacji .

Jak uniknąć bana na IP podczas scrapowania Amazona?

Użyj podejścia warstwowego: (1) przejdź ze zwykłego requests na klienta imitującego TLS, takiego jak curl_cffi, (2) używaj residential proxy ze sticky sessions zamiast losowej rotacji datacenter, (3) dodaj losowe tempo i eksponowany backoff, (4) utrzymuj spójność całego zestawu nagłówków z profilem przeglądarki i locale marketplace oraz (5) traktuj powtarzające się CAPTCHA jako sygnał do porzucenia sesji, a nie zagadkę do nieskończonego rozwiązywania. Więcej szczegółów znajdziesz wcześniej, w macierzy decyzji anty-bana w tym artykule.