Heb je ooit geprobeerd om met Python data van het web te plukken? Dan weet je vast hoe het gaat: het ene moment haal je moeiteloos productprijzen of leads binnen, en het volgende moment – pats – wordt je script geblokkeerd, komt je IP op de zwarte lijst en sta je oog in oog met een CAPTCHA-muur waar zelfs de meest geduldige persoon van zucht. In 2025 is dit geen uitzondering meer, maar dagelijkse kost voor iedereen in sales, marketing of operations die afhankelijk is van openbare webdata om voorop te blijven.

En het wordt alleen maar pittiger: meer dan komt door anti-botmaatregelen zoals IP-blokkades en CAPTCHAs, en ongeveer loopt hier regelmatig tegenaan. Nu bots bijna de helft van al het internetverkeer uitmaken, halen websites alles uit de kast om zich te beschermen. Maar geen paniek – of je nu een Python-pro bent of gewoon snel een oplossing zoekt, ik laat je zien hoe je blokkades ontwijkt, proxies slim inzet en zelfs je scraping naar een hoger niveau tilt met AI-tools zoals .

Webscraping zonder blokkades in Python: de basics

Laten we bij het begin beginnen. Webscraping is simpelweg het automatisch verzamelen van data van websites. Python is hiervoor de populairste taal – gebruikt Python-tools om te scrapen. Maar websites zijn niet bepaald fan van bots. Waarom? Te veel geautomatiseerde verzoeken kunnen servers overbelasten, content stelen of concurrenten een voorsprong geven.

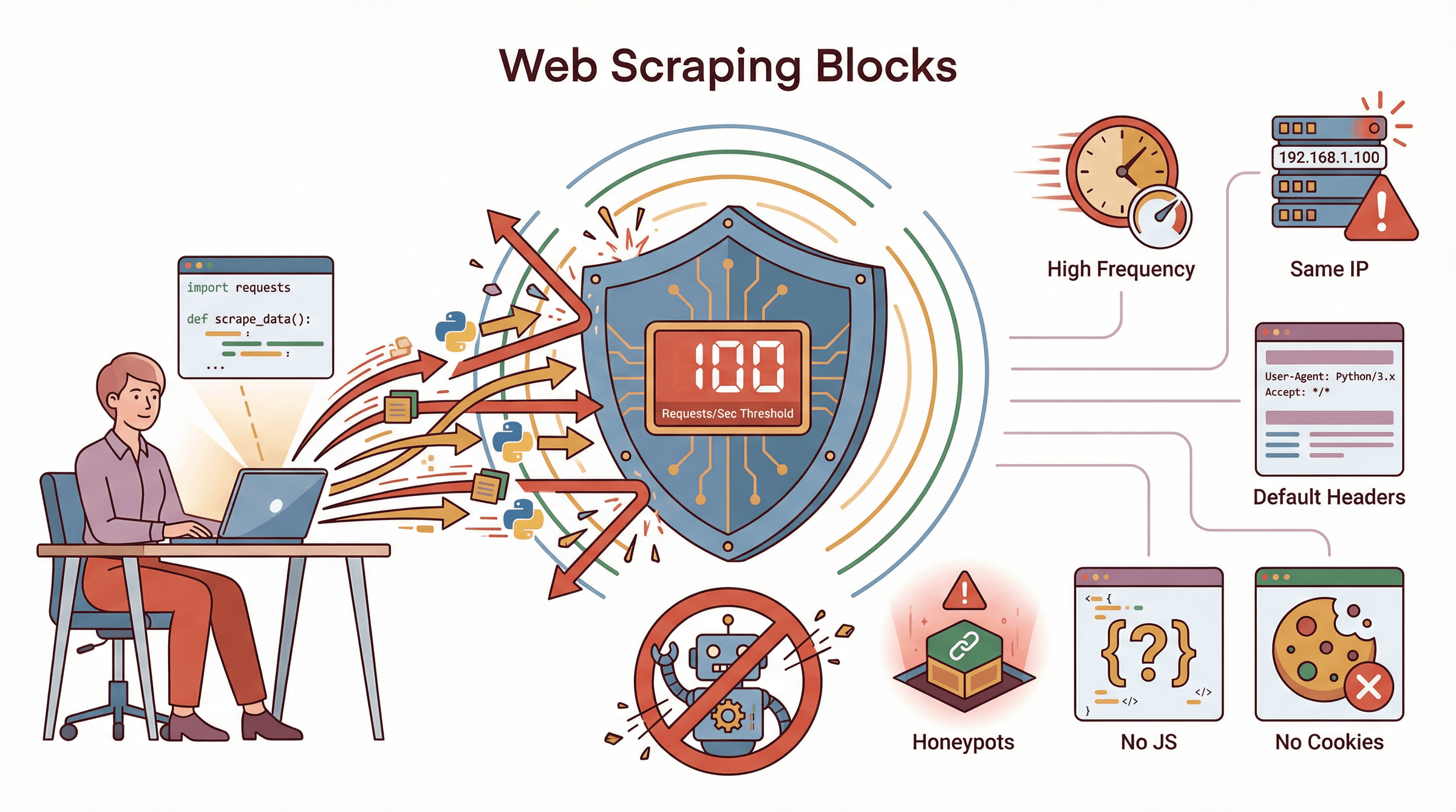

Hoe beschermen sites zich? Dit zijn de meest voorkomende anti-scrapingmaatregelen:

- IP-adres blokkeren & rate limiting: Te veel verzoeken vanaf één IP? Dan kun je een blokkade of vertraging verwachten.

- CAPTCHAs: Die 'bewijs dat je mens bent'-puzzels waar bots (en soms ook mensen) een hekel aan hebben.

- User-Agent en header filtering: Als je script zich meldt als “python-requests/2.x”, roep je eigenlijk: “Ik ben een bot!”

- JavaScript-uitdagingen & browser fingerprinting: Sommige sites eisen dat je JavaScript draait of subtiele browserchecks doorstaat.

- Honeypots: Verborgen links of velden die alleen bots activeren.

Als je niet oplet, trapt je Python-script sneller in deze valkuilen dan je “403 Forbidden” kunt zeggen.

Waarom IP-blokkades voorkomen belangrijk is bij Python webscraping

Geblokkeerd worden is niet alleen technisch irritant – het is een zakelijk risico. Stel je voor dat je salesteam geen nieuwe leads kan binnenhalen, je prijsanalist een prijsdaling bij de concurrent mist, of je marktonderzoek gebaseerd is op onvolledige data. Dat is niet alleen frustrerend, het kan je echt geld kosten.

Even op een rijtje:

| Toepassing | Voorbeeldsituatie | Risico bij blokkade | Voordeel van betrouwbare scraping |

|---|---|---|---|

| Leadgeneratie | Contacten scrapen uit directories of LinkedIn | Onvolledige lijsten, gemiste saleskansen | Altijd actuele leads voor outreach |

| Prijsmonitoring | Dagelijks prijzen van concurrenten volgen | Verouderde data, gemiste prijswijzigingen | Direct inzicht in prijzen, sneller reageren |

| Concurrentieanalyse | Productdetails of reviews verzamelen | Blinde vlekken, gemiste productlanceringen | Volledig zicht op concurrenten, slimmere strategie |

| Marktonderzoek & SEO | Nieuws, fora of zoekresultaten aggregeren | Vertekend beeld, verspilde analysetijd | Complete, actuele datasets voor betere analyses |

Voor is webdata niet zomaar 'handig', maar echt onmisbaar voor hun succes.

Hoe websites Python webscraping blokkeren: de grootste triggers

Wat zorgt er nu precies voor dat een Python-webscraper wordt geblokkeerd? Dit zie ik het vaakst gebeuren:

Wat zorgt er nu precies voor dat een Python-webscraper wordt geblokkeerd? Dit zie ik het vaakst gebeuren:

- Te hoge verzoekfrequentie: Mensen klikken geen 100 pagina’s per seconde. Doe je dat wel, dan val je op.

- Herhaald gebruik van hetzelfde IP: Alle verzoeken vanaf één IP? Zeker als het een datacenter is, ben je snel de klos.

- Standaard headers: De standaard Python user-agent of ontbrekende headers verraden je direct.

- Geen cookies of sessies: Echte gebruikers verzamelen cookies tijdens het surfen. Bots zonder cookies vallen op.

- JavaScript niet uitvoeren: Kan je scraper geen JS draaien, dan mis je data of faal je botchecks.

- Robots.txt negeren: Geen technische blokkade, maar je valt wel snel op.

- Honeypots: Verborgen links aanklikken of onzichtbare formulieren invullen? Meteen geblokkeerd.

Veel beginners maken de fout om sites te overladen met verzoeken, geen proxies te roteren en user-agents en vertragingen niet te variëren. Ik heb universiteitsnetwerken compleet geblokkeerd zien worden op NASDAQ door duizenden verzoeken per seconde. Oeps.

Proxies inzetten bij Python webscraping om IP-blokkades te vermijden

Daar komen proxies om de hoek kijken: jouw geheime wapen tegen IP-blokkades. Een proxy fungeert als tussenpersoon en stuurt je verzoeken via een ander IP-adres. Voor de website lijkt het alsof het verkeer ergens anders vandaan komt.

Soorten proxies

- Datacenter proxies: Goedkoop en snel, maar makkelijk te detecteren. Prima voor simpele scraping.

- Residentiële proxies: Echte thuis-IP’s – moeilijker te blokkeren, maar trager en duurder.

- Roterende proxies: Wisselen automatisch van IP bij elk verzoek. Ideaal voor grootschalige scraping.

- Mobiele proxies: Gebruiken mobiele netwerken. Alleen nodig voor de lastigste sites.

Voor de meeste zakelijke scraping zijn roterende residentiële proxies de beste keuze – ze zijn betrouwbaar en wisselen vaak genoeg om blokkades te vermijden.

Proxies integreren met Python Requests, Selenium en Beautiful Soup

Tijd voor de praktijk. Zo voeg je proxies toe aan je Python-scripts:

Met Requests:

1import requests

2proxy = "http://USERNAME:PASSWORD@PROXY_IP:PORT"

3proxies = {"http": proxy, "https": proxy}

4headers = {"User-Agent": "Mozilla/5.0 ..."}

5response = requests.get("https://target-website.com/data", proxies=proxies, headers=headers)

6html = response.textMet Beautiful Soup:

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3data_items = soup.find_all('div', class_='item')Met Selenium:

1from selenium import webdriver

2proxy = "PROXY_IP:PORT"

3chrome_options = webdriver.ChromeOptions()

4chrome_options.add_argument(f'--proxy-server=http://{proxy}')

5driver = webdriver.Chrome(options=chrome_options)

6driver.get("https://target-website.com")Voor roterende proxies kun je een lijst afgaan of een service gebruiken die dit automatisch regelt. Onthoud: als een proxy faalt, vang de fout op en probeer het met een andere.

Best practices voor proxybeheer en rotatie

- Gebruik een grote pool: Hoe meer proxies, hoe beter. Roteer na elk verzoek of batch.

- Monitor proxygezondheid: Verwijder slechte proxies uit je pool. Herhaal mislukte verzoeken met een nieuw IP.

- Gebruik proxies niet te vaak: Verspreid je verzoeken. Laat niet één IP al het werk doen.

- Geografische targeting: Gebruik proxies uit hetzelfde land als je doelwebsite indien nodig.

- Mix proxytypes: Begin met datacenter, schakel over op residentieel als je geblokkeerd wordt.

- Vermijd gratis proxies: Ze zijn traag, onbetrouwbaar en vaak al geblokkeerd.

- Respecteer limieten van je provider: Verspil je proxytegoed niet te snel.

Proxies beheren is bijna een kunst op zich. Maar zelfs de beste proxysetup is niet genoeg.

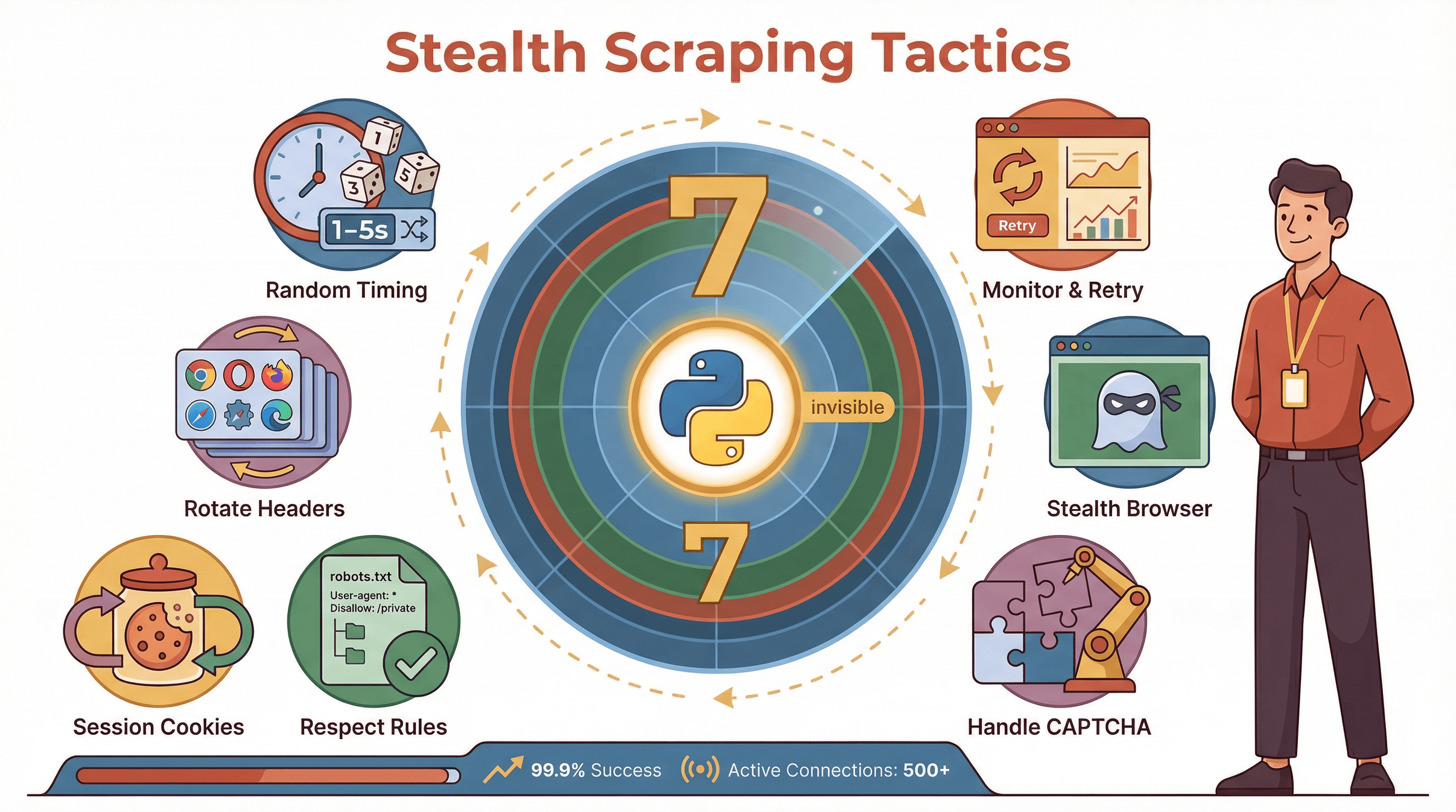

Verder dan proxies: slimme trucs om blokkades te ontwijken in Python

Wil je echt onder de radar blijven? Combineer deze tactieken met je proxystrategie:

Wil je echt onder de radar blijven? Combineer deze tactieken met je proxystrategie:

- Varieer de timing van verzoeken: Verstuur niet alles op een vast ritme. Gebruik willekeurige vertragingen (bijv. 1–5 seconden).

- Roteer user-agents en headers: Gebruik een lijst met echte browser user-agents. Varieer Accept-Language, Referer, enz.

- Gebruik sessies en cookies: Bewaar cookies tussen verzoeken om echt surfgedrag na te bootsen.

- Respecteer robots.txt en vertraag bij fouten: Negeer de regels niet. Krijg je 429 of 503, doe het rustiger aan.

- Omgaan met CAPTCHAs: Gebruik een CAPTCHA-oplosservice of probeer het opnieuw met een andere proxy.

- Stealth headless browsers: Gebruik tools als undetected-chromedriver of Playwright’s stealth-plugins.

- Monitoren en opnieuw proberen: Houd logs bij, let op pieken in fouten en probeer automatisch opnieuw met nieuwe proxies.

Er zijn uitstekende Python-libraries voor deze trucs – fake-useragent, requests.Session() en stealth browser-plugins zijn je beste vrienden.

Geef je scraping een boost: AI-tools versus traditionele Python-proxy-methodes

Nu wordt het pas echt interessant. Wat als je al dat gedoe met proxies, headers en blokkades kon overslaan? Daar komt om de hoek kijken.

Thunderbit is een AI-webscraper Chrome-extensie waarmee je in twee klikken data van elke website haalt – zonder code, zonder proxy-instellingen, zonder onderhoud. Klik op “AI Suggest Fields”, laat de AI bepalen wat er gescrapet moet worden en druk op “Scrape”. Thunderbit regelt proxies, anti-blokkades, paginering en zelfs subpagina’s automatisch.

Laten we beide aanpakken vergelijken:

| Aspect | Python scraping (proxies) | Thunderbit AI-webscraper |

|---|---|---|

| Installatietijd | Uren (code, proxies, parsing) | Minuten (aanklikken en klaar) |

| Technische kennis | Hoog (coderen, HTTP, proxies) | Laag (iedereen kan het gebruiken) |

| Blokkades vermijden | Handmatig (proxies, headers roteren) | Automatisch (AI + ingebouwd proxybeheer) |

| Onderhoud | Doorlopend (code, proxies bijwerken) | Minimaal (AI past zich aan, sjablonen klaar) |

| Paginering/subpagina’s | Handmatig coderen nodig | Eén klik, AI regelt het |

| Data exporteren | Handmatig (CSV, Excel via code) | Eén klik naar Sheets, Excel, Notion, Airtable |

| Schaalbaarheid | Afhankelijk van je infra/proxies | Hoog (cloud scraping, parallelle pagina’s) |

| Kosten | Proxykosten + ontwikkeltijd | Gratis tier, daarna betaalbare abonnementen |

| Betrouwbaarheid | Variabel (afhankelijk van setup) | Hoog (geoptimaliseerd voor bedrijven) |

Thunderbit is vooral ideaal voor niet-technische teams of iedereen die snel data wil – zonder gedoe.

Stapsgewijs: scrapen zonder blokkades met Thunderbit

Zo gebruik ik Thunderbit om een site te scrapen die Python-scripts normaal blokkeert:

- Installeer de Thunderbit Chrome-extensie: .

- Ga naar de gewenste website: Log in indien nodig – Thunderbit gebruikt je browsersessie.

- Klik op “AI Suggest Fields”: Thunderbit scant de pagina en stelt kolommen voor om te extraheren (zoals “Naam”, “Prijs”, “E-mail”).

- Klik op “Scrape”: Thunderbit verzamelt de data in een gestructureerde tabel.

- Paginering verwerken: Zet “Scrape All Pages” aan en Thunderbit klikt door alle pagina’s om alles te verzamelen.

- Subpagina’s scrapen: Gebruik “Scrape Subpages” om detailpagina’s te bezoeken en je data te verrijken.

- Exporteren: Met één klik stuur je je data naar Google Sheets, Excel, Notion of Airtable.

Thunderbit regelt alle anti-blokkade magie voor je – IP’s roteren, verzoeken doseren en zelfs eenvoudige CAPTCHAs oplossen. Voor de meeste zakelijke gebruikers werkt het gewoon.

Thunderbits aanpak voor paginering en subpagina’s scrapen

Thunderbit beperkt zich niet tot de eerste pagina. Het kan:

- Scrollen en klikken als een mens: Bij oneindig scrollen of “volgende pagina”-knoppen bootst Thunderbit echt surfgedrag na.

- Sessies behouden: Ben je ingelogd, dan blijft je sessie actief over meerdere pagina’s.

- Belasting verdelen: In cloudmodus scrapet Thunderbit meerdere pagina’s tegelijk, elk vanaf een ander IP.

- Dynamische content verwerken: Thunderbit voert JavaScript uit, zodat alle data wordt opgehaald – ook als die later laadt.

- Subpagina’s scrapen: Thunderbit kan elke detailpagina bezoeken, extra velden ophalen en deze samenvoegen in je hoofddata.

Voor de website lijkt het alsof er gewoon meerdere echte gebruikers aan het browsen zijn – geen botleger.

Python-proxy-methodes versus Thunderbit voor zakelijke gebruikers

Welke aanpak past het beste bij jou? Een kort overzicht:

| Factor | Python + proxies | Thunderbit |

|---|---|---|

| Snelheid | Langzamer op te zetten | Direct resultaat |

| Onderhoud | Hoog (code, proxies) | Laag (AI past zich aan, sjablonen) |

| Benodigde kennis | Ontwikkelaar | Iedereen |

| Blokrisico | Gemiddeld (als je niet oplet) | Laag (AI/proxy-automatisering) |

| Kosten | Proxykosten + ontwikkeltijd | Gratis tier, daarna €15/maand+ |

| Ideaal voor | Maatwerk, complexe scraping | Sales, marketing, research teams |

Ben je een ontwikkelaar die graag sleutelt en volledige controle wil, dan zijn Python en proxies nog steeds een goede keuze. Maar voor de meeste zakelijke gebruikers – zeker als je geen proxyhoofdpijn wilt – is Thunderbit een enorme productiviteitswinst.

Belangrijkste inzichten: slimmer scrapen, niet harder

Dit zijn mijn belangrijkste lessen (en wat ik graag eerder had willen weten):

- Proxies zijn onmisbaar om IP-blokkades te voorkomen bij Python-scraping – maar het beheer is uitdagend.

- Slimme anti-blokkade tactieken (willekeurige vertragingen, headerrotatie, sessies) maken een groot verschil.

- AI-tools zoals Thunderbit nemen al het lastige werk uit handen – proxies, anti-blokkades, paginering, subpagina’s en export – zodat jij je kunt richten op de data.

- Kies het juiste gereedschap voor je team: Wil je snelheid en betrouwbaarheid, dan is Thunderbit een logische keuze. Wil je maatwerk en hou je van code, dan blijft Python + proxies krachtig.

Benieuwd hoe makkelijk scrapen kan zijn? en probeer het bij je volgende project. Meer scraping-tips? Bekijk de .

Veel succes met scrapen – en moge je IP’s onzichtbaar blijven en je data altijd actueel zijn.

Veelgestelde vragen

1. Wat is de grootste reden dat Python-webscrapers worden geblokkeerd?

De meest voorkomende oorzaak is te veel verzoeken vanaf één IP of het gebruik van standaardheaders die direct verraden dat je een bot bent. Websites herkennen deze patronen snel en blokkeren of vertragen je toegang.

2. Hoe helpen proxies om IP-blokkades te voorkomen bij Python webscraping?

Proxies sturen je verzoeken via verschillende IP-adressen, waardoor het lijkt alsof het verkeer van meerdere gebruikers komt. Roterende proxies zijn vooral effectief bij grootschalige scraping.

3. Wat zijn de best practices voor proxybeheer in Python?

Gebruik een grote pool proxies, roteer ze vaak, monitor op fouten, vermijd gratis proxies en stem de locatie van je proxies af op het land van je doelwebsite. Varieer altijd je timing en headers.

4. Hoe voorkomt Thunderbit blokkades zonder handmatig proxies in te stellen?

Thunderbit automatiseert proxyrotatie, het doseren van verzoeken en anti-blokkadetechnieken op de achtergrond. De AI-agent bootst echt gebruikersgedrag na, regelt paginering en subpagina’s en exporteert data met één klik – zonder code.

5. Moet ik Python of Thunderbit gebruiken voor mijn zakelijke scraping?

Ben je een ontwikkelaar met complexe, maatwerkbehoeften, dan biedt Python met proxies flexibiliteit. Maar voor de meeste sales-, marketing- en researchteams die snel en betrouwbaar data willen zonder technische rompslomp, is Thunderbit de slimmere en eenvoudigere keuze.

Klaar om slimmer te scrapen? en laat blokkades achter je.

Meer weten