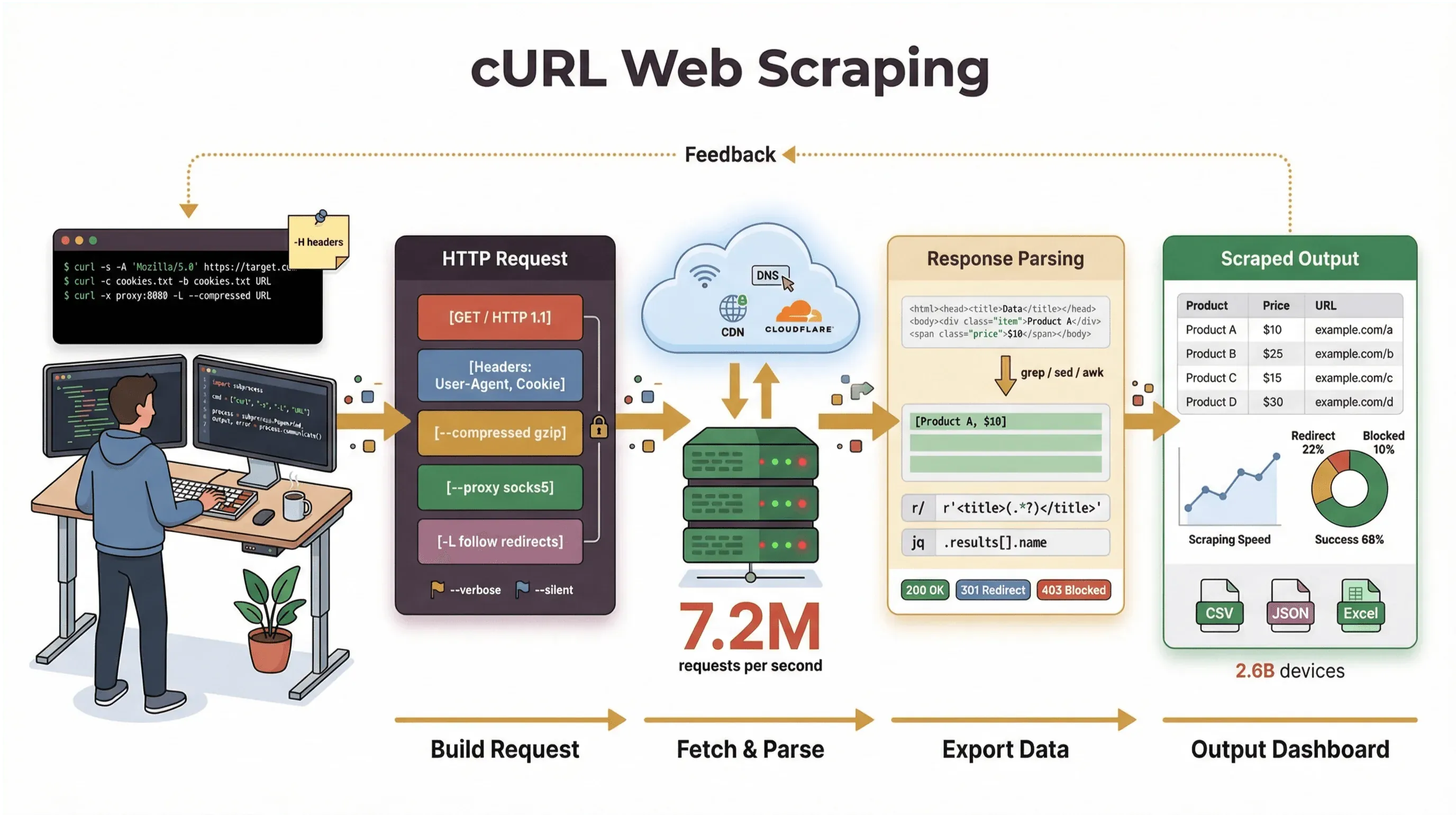

Er is iets tijdloos aan een terminal openen, één commando typen en zien hoe ruwe webdata binnenstroomt, alsof je net de Matrix hebt opengebroken. Voor ontwikkelaars en technische power users is die magische toverstaf: een ogenschijnlijk onopvallende command-line tool die stilletjes op miljarden apparaten draait, van cloudservers tot je slimme koelkast. En zelfs in 2026, met alle glimmende no-code- en AI-scrapingtools die er zijn, blijft webscrapen met cURL voor iedereen die snelheid, controle en scriptbaarheid wil een vaste keuze.

Ik werk al jaren aan automatiseringstools en help teams met het verwerken van webdata, en ik grijp nog steeds naar cURL als ik een pagina moet ophalen, een API wil debuggen of een scraping-workflow wil prototypen. In deze gids neem ik je mee in een cURL-webscrapingtutorial die zowel de basis als de pro-trucs behandelt — met echte commando-voorbeelden, praktische tips en een nuchtere blik op waar cURL sterk is en waar het vastloopt. En als je meer een zakelijke gebruiker bent die liever niet met de command line werkt, laat ik zien hoe , onze AI-aangedreven webscraper, je in twee klikken van “ik heb deze data nodig” naar “hier is mijn spreadsheet” brengt — zonder code.

Ik werk al jaren aan automatiseringstools en help teams met het verwerken van webdata, en ik grijp nog steeds naar cURL als ik een pagina moet ophalen, een API wil debuggen of een scraping-workflow wil prototypen. In deze gids neem ik je mee in een cURL-webscrapingtutorial die zowel de basis als de pro-trucs behandelt — met echte commando-voorbeelden, praktische tips en een nuchtere blik op waar cURL sterk is en waar het vastloopt. En als je meer een zakelijke gebruiker bent die liever niet met de command line werkt, laat ik zien hoe , onze AI-aangedreven webscraper, je in twee klikken van “ik heb deze data nodig” naar “hier is mijn spreadsheet” brengt — zonder code.

Laten we erin duiken en kijken waarom cURL in 2025 nog steeds relevant is voor webscraping, hoe je het effectief inzet en wanneer het tijd is om naar iets nog krachtigers te grijpen.

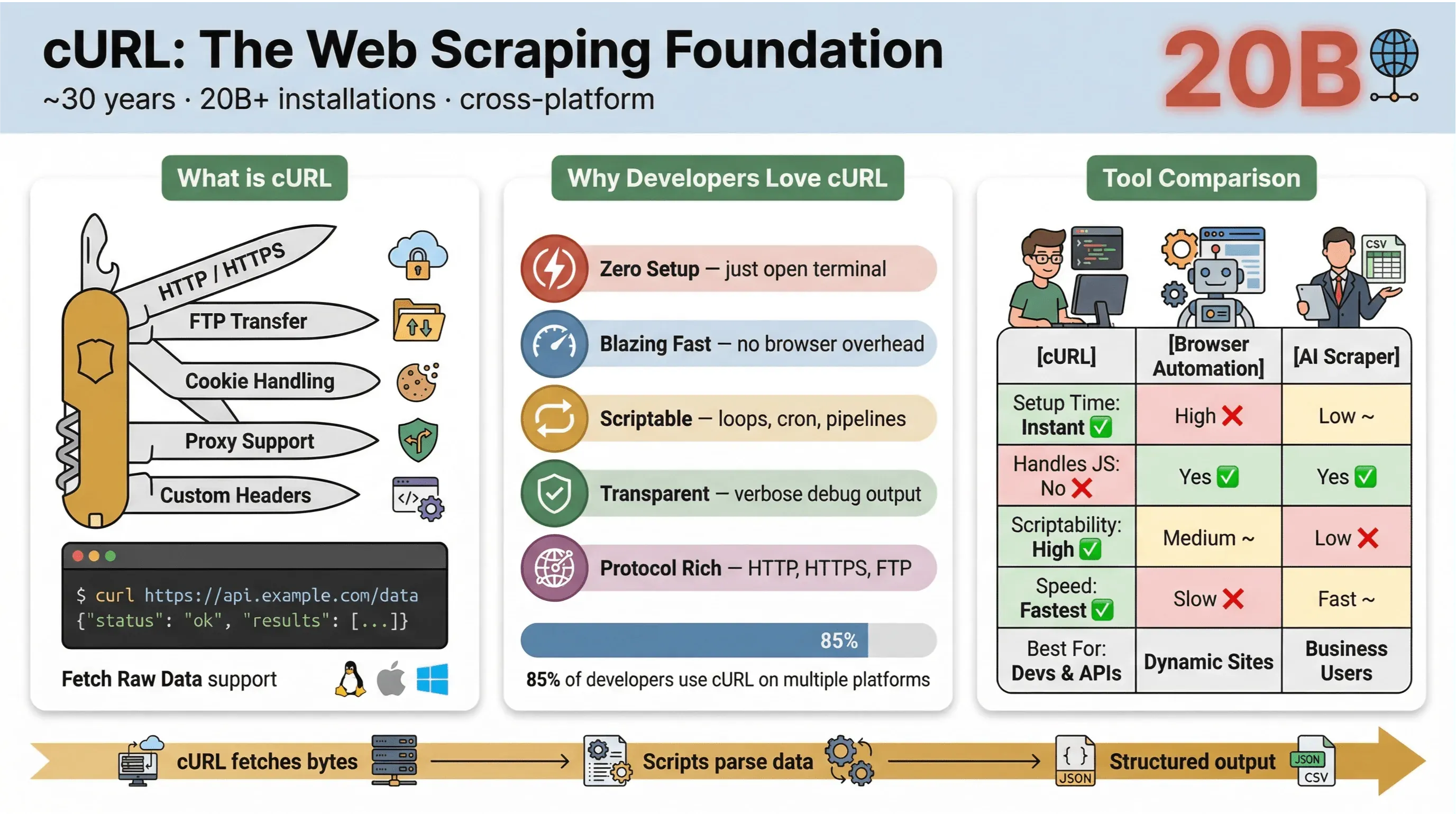

Wat is cURL? De basis van webscrapen met cURL

In de kern is een command-line tool en library voor het overzetten van data via URL's. Het bestaat al bijna 30 jaar (ja, echt) en is overal te vinden — ingebouwd in besturingssystemen, draaiend in scripts en stilletjes data overzettend op meer dan . Als je ooit een snel commando hebt gebruikt om een webpagina op te halen, een API te testen of een bestand te downloaden, is de kans groot dat je cURL hebt gebruikt.

Dit maakt cURL zo populair voor webscraping:

Dit maakt cURL zo populair voor webscraping:

- Lichtgewicht en platformoverschrijdend: Werkt op Linux, macOS, Windows en zelfs ingebedde apparaten.

- Ondersteuning voor protocollen: Verwerkt onder meer HTTP, HTTPS en FTP.

- Scripbaar: Ideaal voor automatisering, cronjobs en glue code.

- Geen gebruikersinteractie nodig: Ontworpen voor niet-interactief gebruik — perfect voor batchtaken en pipelines.

Maar laten we eerlijk zijn: de hoofdtaak van cURL is het ophalen van ruwe data — HTML, JSON, afbeeldingen, noem maar op. Het parseert, rendert of structureert die data niet voor je. Zie cURL als de “eerste mijl” van webscraping: het levert je de bytes, maar je hebt andere tools nodig (zoals Python-scripts, grep/sed/awk of een AI-webscraper) om daar gestructureerde informatie van te maken.

Wil je de officiële documentatie zien? Bekijk dan .

Waarom cURL gebruiken voor webscraping? (cURL-webscrapingtutorial)

Waarom grijpen ontwikkelaars en technische gebruikers steeds weer naar cURL voor webscraping, ondanks al die nieuwe tools? Dit zijn de redenen waarom cURL eruit springt:

- Minimale setup: Geen installaties, geen afhankelijkheden — open gewoon je terminal en ga aan de slag.

- Snelheid: Haal meteen data op, zonder te wachten tot een browser is geladen.

- Scripbaarheid: Loop eenvoudig over URL's, automatiseer requests en koppel commando's aan elkaar.

- Ondersteuning voor protocollen en functies: Werk met cookies, proxies, redirects, custom headers en meer.

- Transparantie: Zie precies wat er gebeurt met verbose/debug-output.

In de gaf ruim 85% van de respondenten aan de cURL command-line tool te gebruiken, en vrijwel iedereen meldde dat ze hem op meerdere platforms gebruiken. Het blijft de Zwitserse zakmes-oplossing voor HTTP-requests, snelle data-opvraging en troubleshooting.

Hier is een snelle vergelijking tussen cURL en andere scrapingmethoden:

| Functie | cURL | Browserautomatisering (bijv. Selenium) | AI-webscraper (bijv. Thunderbit) |

|---|---|---|---|

| Insteltijd | Direct | Hoog | Laag |

| Scripbaarheid | Hoog | Gemiddeld | Laag (geen code nodig) |

| Ondersteuning voor JavaScript | Nee | Ja | Ja (Thunderbit: via browser) |

| Cookie-/sessieondersteuning | Handmatig | Automatisch | Automatisch |

| Datastructurering | Handmatig (later parsen) | Handmatig (later parsen) | Op basis van AI/template |

| Het meest geschikt voor | Developers, snelle pulls | Complexe, dynamische sites | Zakelijke gebruikers, gestructureerde export |

Kortom: cURL is onverslaanbaar voor snelle, scripbare data-opvragingen — vooral voor statische pagina's, API's of wanneer je eenvoudige workflows wilt automatiseren. Maar zodra je complexe HTML wilt parsen, JavaScript wilt verwerken of gestructureerde data wilt exporteren, heb je iets specialers nodig.

Aan de slag: basisvoorbeelden van cURL-webscrapingcommando's

Laten we praktisch worden. Zo gebruik je cURL stap voor stap voor basistaken op het gebied van webscraping.

Ruwe HTML ophalen met cURL

De eenvoudigste use case: de HTML van een webpagina ophalen.

1curl https://books.toscrape.com/Dit commando haalt de homepage op van , een openbare demo-site voor webscraping. Je ziet de ruwe HTML-uitvoer in je terminal — let op tags zoals <title> of fragmenten als “In stock.”

Output opslaan naar een bestand

Wil je die HTML later parsen? Gebruik de -o-flag:

1curl -o page.html https://books.toscrape.com/Nu heb je een page.html-bestand met de volledige HTML-inhoud. Perfect voor verdere analyse of parsing met andere tools.

POST-verzoeken versturen met cURL

Moet je een formulier indienen of met een API praten? Gebruik de -d-flag voor POST-verzoeken. Hier is een voorbeeld met , een site die is ontworpen voor HTTP-tests:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Je krijgt een JSON-response terug die je ingestuurde data weerspiegelt — ideaal voor testen en prototypen.

Headers inspecteren en debuggen

Soms wil je responseheaders zien of het verzoek debuggen:

-

Alleen headers (HEAD-request):

1curl -I https://books.toscrape.com/ -

Headers meenemen met de body:

1curl -i https://httpbin.org/get -

Verbose/debug-output:

1curl -v https://books.toscrape.com/

Deze flags helpen je te begrijpen wat er onder de motorkap gebeurt — essentieel voor troubleshooting.

Hier is een snelle referentietabel voor deze commando's:

| Taak | Commando-voorbeeld | Opmerkingen |

|---|---|---|

| HTML ophalen | curl URL | Geeft HTML weer in de terminal |

| Opslaan naar bestand | curl -o bestand.html URL | Schrijft output naar een bestand |

| Headers inspecteren | curl -I URL of curl -i URL | -I alleen HEAD, -i met headers en body |

| Formulierdata posten | curl -d "a=1&b=2" URL | Stuurt form-encoded data |

| Request/response debuggen | curl -v URL | Laat gedetailleerde request/response-informatie zien |

Voor meer voorbeelden, bekijk de .

Naar een hoger niveau: geavanceerd webscrapen met cURL (webscrapen met cURL)

Zodra je de basis onder de knie hebt, opent cURL een wereld aan geavanceerde functies voor complexere scrapingtaken.

Cookies en sessies verwerken

Veel sites hebben cookies nodig om inlogsessies bij te houden of gebruikers te volgen. Met cURL kun je cookies opslaan en opnieuw gebruiken tussen verzoeken:

1# Cookies opslaan na inloggen

2curl -c cookies.txt https://example.com/login

3# Cookies gebruiken voor volgende verzoeken

4curl -b cookies.txt https://example.com/accountZo kun je browsersessies nabootsen en pagina's achter een loginmuur bereiken (zolang er geen JavaScript-uitdaging is).

User-Agent en custom headers nabootsen

Sommige websites leveren andere content op basis van je User-Agent of headers. Standaard identificeert cURL zichzelf als “curl/VERSION”, wat blokkades of andere content kan triggeren. Om een browser na te bootsen:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Je kunt ook custom headers instellen, zoals taalvoorkeuren:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/Zo krijg je dezelfde content te zien als een echte browser.

Proxies gebruiken voor webscraping

Moet je je verzoeken via een proxy laten lopen (voor geo-tests of om IP-blokkades te vermijden)? Gebruik de -x-flag:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Zorg er wel voor dat je proxies verantwoord gebruikt en binnen de voorwaarden van de site.

Multi-page scraping automatiseren

Wil je meerdere pagina's scrapen — bijvoorbeeld gepagineerde productoverzichten? Gebruik een eenvoudige shell-lus:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-$\{p\}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-$\{p\}.html"

4 sleep 1

5doneDit haalt pagina's 2 tot en met 5 van de Books to Scrape-catalogus op en slaat elke pagina op in een apart bestand. (Pagina 1 is de homepage.)

Beperkingen van webscrapen met cURL: wat je moet weten

Hoezeer ik cURL ook waardeer, het is geen wondermiddel. Hier schiet het tekort:

- Geen uitvoering van JavaScript: cURL kan geen pagina's verwerken die JavaScript nodig hebben om content te renderen of anti-botuitdagingen op te lossen ().

- Handmatige parsing vereist: Je krijgt ruwe HTML of JSON, maar je moet het zelf parsen — vaak met extra scripts of tools.

- Beperkte sessieafhandeling: Complexe logins, tokens of meerstapsformulieren kunnen snel rommelig worden.

- Geen ingebouwde datastructurering: cURL maakt geen rijen, tabellen of spreadsheets van webpagina's.

- Gevoelig voor anti-botdetectie: Veel sites gebruiken tegenwoordig geavanceerde botbeveiliging (JavaScript, fingerprinting, CAPTCHA's) die cURL simpelweg niet kan omzeilen ().

Hier is een snelle vergelijkingstabel:

| Beperking | Alleen cURL | Moderne scrapingtools (bijv. Thunderbit) |

|---|---|---|

| Ondersteuning voor JavaScript | Nee | Ja |

| Datastructurering | Handmatig | Automatisch (AI/template) |

| Sessieafhandeling | Handmatig | Automatisch |

| Anti-bot omzeilen | Beperkt | Geavanceerd (browsergebaseerd/AI) |

| Gebruiksgemak | Technisch | Niet-technisch |

Voor statische pagina's en API's is cURL fantastisch. Voor alles wat dynamischer of beter beveiligd is, zul je verder in de toolchain moeten gaan.

Thunderbit versus cURL: de beste webscrapingaanpak voor niet-technische gebruikers

Laten we het nu hebben over , onze AI-aangedreven Chrome-extensie voor webscraping. Als je een salesmedewerker, marketeer of operations-professional bent die gewoon data van een website naar Excel, Google Sheets of Notion wil krijgen — zonder de command line aan te raken — dan is Thunderbit voor jou gemaakt.

Zo verhoudt Thunderbit zich tot cURL:

| Functie | cURL | Thunderbit |

|---|---|---|

| Gebruikersinterface | Command line | Point-and-click (Chrome-extensie) |

| AI-veldensuggestie | Nee | Ja (AI leest de pagina en stelt kolommen voor) |

| Omgaan met paginering/subpagina's | Handmatig scripten | Automatisch (AI detecteert en scraped) |

| Data-export | Handmatig (parsen + opslaan) | Direct naar Excel, Google Sheets, Notion, Airtable |

| JavaScript/beveiligde pagina's | Nee | Ja (browsergebaseerd scrapen) |

| Geen code nodig | Nee (scripting vereist) | Ja (iedereen kan het gebruiken) |

| Gratis niveau | Altijd gratis | Gratis tot 6 pagina's (10 met proefboost) |

Met Thunderbit open je gewoon de extensie, klik je op “AI Suggest Fields” en laat je de AI bepalen welke data moet worden uitgelezen. Je kunt tabellen, lijsten, productdetails en zelfs subpagina's automatisch laten bezoeken en scrapen. Daarna exporteer je je data direct naar je favoriete zakelijke tools — zonder parsing, zonder gedoe.

Thunderbit wordt vertrouwd door meer dan , en is vooral populair bij sales-, e-commerce- en vastgoedteams die snel gestructureerde data nodig hebben.

Wil je het uitproberen? .

cURL en Thunderbit combineren: flexibele webscrapingstrategieën

Als je technisch bent, hoef je niet voor één tool te kiezen. Sterker nog: veel teams gebruiken cURL en Thunderbit samen voor maximale flexibiliteit:

- Prototype met cURL: Gebruik cURL om snel endpoints te testen, headers te inspecteren en te begrijpen hoe een site reageert.

- Schaal op met Thunderbit: Als je gestructureerde data, scrapen over meerdere pagina's of een herhaalbare workflow nodig hebt, schakel je over naar Thunderbit voor point-and-click-extractie en directe exports.

Hier is een voorbeeldworkflow voor marktonderzoek:

- Gebruik cURL om een paar pagina's op te halen en de HTML-structuur te bekijken.

- Bepaal welke datavelden je wilt (bijv. productnamen, prijzen, reviews).

- Open Thunderbit, klik op “AI Suggest Fields” en laat de AI de scraper instellen.

- Scrape alle pagina's (inclusief subpagina's of gepagineerde lijsten) en exporteer naar Google Sheets.

- Analyseer, deel en gebruik je data — handmatige parsing is niet nodig.

Hier is een snelle beslissingtabel:

| Scenario | Gebruik cURL | Gebruik Thunderbit | Gebruik beide |

|---|---|---|---|

| Snelle API- of statische pagina-opvraag | ✅ | ||

| Gestructureerde data in een spreadsheet nodig | ✅ | ||

| Headers/cookies debuggen | ✅ | ||

| Dynamische/JavaScript-zware pagina's scrapen | ✅ | ||

| Een herhaalbare, no-code workflow bouwen | ✅ | ||

| Prototypen en daarna opschalen | ✅ | ✅ | Hybride workflow |

Veelvoorkomende uitdagingen en valkuilen bij webscrapen met cURL

Voordat je losgaat met cURL, laten we de echte uitdagingen bespreken die je zult tegenkomen:

- Anti-botsystemen: Veel sites gebruiken tegenwoordig geavanceerde beveiliging (JavaScript-uitdagingen, CAPTCHA's, fingerprinting) die cURL niet kan omzeilen ().

- Problemen met datakwaliteit: Veranderende HTML, ontbrekende velden of inconsistente lay-outs kunnen je scripts breken.

- Onderhoudslast: Elke keer dat een site verandert, moet je je parsingslogica bijwerken.

- Juridische en compliance-risico's: Controleer altijd de gebruiksvoorwaarden, robots.txt en relevante wetgeving voordat je scrapt. Omdat data openbaar is, betekent dat nog niet dat je die vrij mag gebruiken (, ).

- Schaallimieten: cURL is geweldig voor kleine klussen, maar voor grootschalig scrapen moet je proxies, rate limits en foutafhandeling beheren.

Tips voor troubleshooting en compliance:

- Begin altijd met sites waarvoor je toestemming hebt of met demo-sites (zoals ).

- Respecteer rate limits — val endpoints niet onnodig hard aan.

- Vermijd het scrapen van persoonsgegevens, tenzij je daar een wettelijke grondslag voor hebt.

- Loop je vast op JavaScript- of CAPTCHA-muren? Overweeg dan over te stappen op een browsergebaseerde tool zoals Thunderbit.

Stapsgewijze samenvatting: hoe je websites schraapt met cURL

Hier is je snelle checklist voor webscrapen met cURL:

- Bepaal je doel-URL('s): Begin met een statische pagina of API-endpoint.

- Haal de pagina op:

curl URL - Sla output op in een bestand:

curl -o file.html URL - Inspecteer headers/debug:

curl -I URL,curl -v URL - Verstuur POST-data:

curl -d "a=1&b=2" URL - Beheer cookies/sessies:

curl -c cookies.txt ...,curl -b cookies.txt ... - Stel custom headers/User-Agent in:

curl -A "..." -H "..." URL - Volg redirects:

curl -L URL - Gebruik proxies (indien nodig):

curl -x proxy:port URL - Automatiseer multi-page scraping: gebruik shell-lussen of scripts.

- Parseer en structureer data: gebruik waar nodig extra tools/scripts.

- Schakel over naar Thunderbit voor gestructureerd, no-code scrapen of dynamische pagina's.

Conclusie & belangrijkste inzichten: de juiste webscrapingtool kiezen

Webscrapen met cURL is in 2026 nog steeds een krachtige vaardigheid voor technische gebruikers — vooral voor snelle data-opvragingen, prototyping en automatisering. De snelheid, scripbaarheid en alomtegenwoordigheid van cURL maken het een vaste waarde in elke ontwikkelaarstoolbox. Maar nu het web dynamischer en beter beveiligd wordt, en zakelijke gebruikers gestructureerde data zonder code eisen, herdefiniëren tools zoals wat mogelijk is.

Belangrijkste inzichten:

- Gebruik cURL voor statische pagina's, API's en snelle prototypes — vooral als je volledige controle wilt.

- Schakel over naar Thunderbit (of vergelijkbare AI-webscrapers) wanneer je gestructureerde data nodig hebt, dynamische/JavaScript-zware pagina's wilt verwerken of een no-code, zakelijke workflow wilt.

- Combineer beide voor maximale flexibiliteit: prototype met cURL, schaal op en structureer met Thunderbit.

- Scrape altijd verantwoord — respecteer sitevoorwaarden, rate limits en juridische grenzen.

Nieuwsgierig hoe eenvoudig webscraping kan zijn? en ervaar zelf AI-aangedreven data-extractie. En als je dieper wilt gaan, bekijk dan de voor meer tutorials, tips en branche-inzichten. Misschien vind je dit ook interessant:

Veel scrapeplezier — en moge je data altijd schoon, gestructureerd en slechts één commando (of klik) verwijderd zijn.

FAQ's

1. Kan cURL webpagina's verwerken die met JavaScript worden gerenderd?

Nee, cURL kan geen JavaScript uitvoeren. Het haalt ruwe HTML op zoals die door de server wordt geleverd. Als een pagina JavaScript nodig heeft om content te renderen of anti-botuitdagingen op te lossen, kan cURL die data niet benaderen. Gebruik in zulke gevallen browsergebaseerde tools zoals .

2. Hoe sla ik cURL-output direct op naar een bestand?

Gebruik de -o-flag: curl -o bestandsnaam.html URL. Dit schrijft de responsebody naar een bestand in plaats van die in je terminal weer te geven.

3. Wat is het verschil tussen cURL en Thunderbit voor webscraping?

cURL is een command-line tool voor het ophalen van ruwe webdata — ideaal voor technische gebruikers en automatisering. Thunderbit is een AI-aangedreven Chrome-extensie voor zakelijke gebruikers die gestructureerde data van elke website willen halen, dynamische pagina's willen verwerken en direct willen exporteren naar tools zoals Excel of Google Sheets — zonder code.

4. Is het legaal om websites te scrapen met cURL?

Het scrapen van openbare data is in de VS na recente rechterlijke uitspraken over het algemeen legaal, maar controleer altijd de gebruiksvoorwaarden van de website, robots.txt en relevante wetten. Vermijd het scrapen van persoonlijke of beschermde data zonder toestemming en houd je aan rate limits en ethische richtlijnen (, ).

5. Wanneer moet ik overstappen van cURL naar een geavanceerder tool zoals Thunderbit?

Als je dynamische/JavaScript-zware pagina's wilt scrapen, gestructureerde data in een spreadsheet nodig hebt of liever een no-code workflow gebruikt, is Thunderbit de betere keuze. Gebruik cURL voor snelle, technische taken; gebruik Thunderbit voor zakelijke, herhaalbare data-extractie.

Voor meer tips en tutorials over webscraping, bezoek de of bekijk ons .