Als je in 2026 webscrapingtools beoordeelt, ben je meestal niet op zoek naar een filosofieles. Je wilt een shortlist waarop je kunt vertrouwen, snel kunnen zien welke tools geschikt zijn voor zakelijke gebruikers en welke vooral thuishoren in engineering-heavy stacks, en genoeg concreet bewijs om te voorkomen dat je het verkeerde product koopt. Precies dat is het doel van deze pagina.

Ik ben Shuai Guan, medeoprichter en CEO van . Ik werk elke dag aan AI-gestuurde scraping en browserautomatisering, dus ik kijk minder naar algemene ranglijsten en meer naar de juiste match: welke tools een sales- of operationsteam deze week verder helpen, welke beter passen in een developer-workflow, en welke pas echt logisch worden zodra schaal en anti-bot-infrastructuur het grootste probleem zijn.

Het korte antwoord

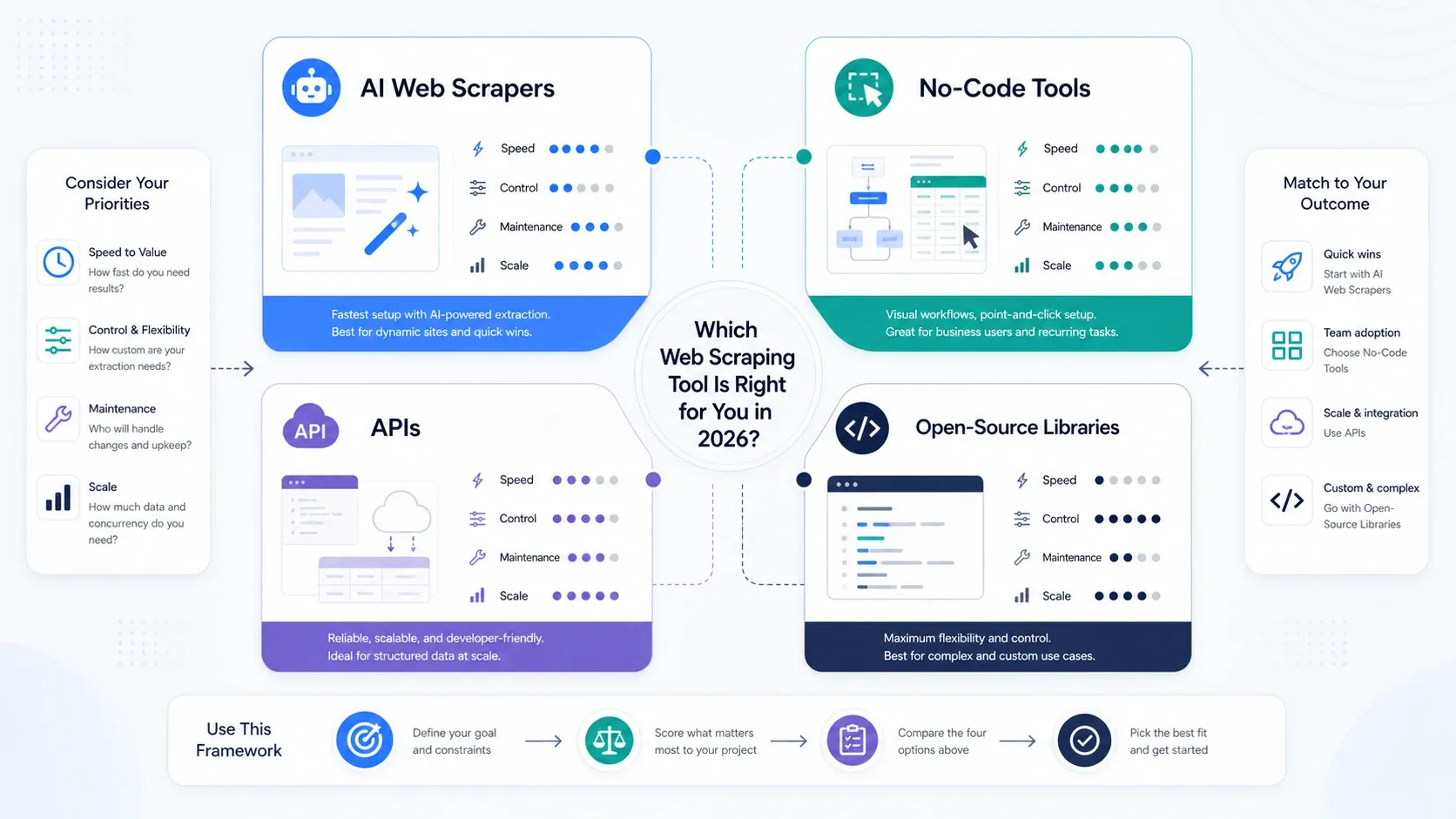

Als je alleen de beslislogica nodig hebt, gebruik dan dit:

- Kies een AI-webscraper als je zo snel mogelijk van website naar spreadsheet wilt, met minimale inrichting.

- Kies een no-code scraper als je meer controle nodig hebt over taken, planning of cloud-runs zonder code te schrijven.

- Kies een API-platform als je team rendering, proxyrotatie, anti-botafhandeling of integratie in een intern product nodig heeft.

- Kies een open-sourcebibliotheek als je volledige controle wilt en zelf onderhoud, selectors, infrastructuur en fouten kunt beheren.

Dit artikel behandelt alle 20 tools, maar de aanbevelingslogica is bewust simpel: begin met de lichtste tool die je workflow betrouwbaar aankan, en ga pas verder in de stack wanneer onderhoud, blokkades of schaal je daartoe dwingen.

Snelle vergelijkingstabel: de beste webscrapingtools in 2026

De prijzen en abonnementsmodellen hieronder zijn gecontroleerd op basis van officiële product- of prijspagina's op 7 mei 2026. Waar leveranciers gebruiksafhankelijke tarieven of maatwerk enterprise-offertes hanteren, beschrijf ik het prijsmodel in plaats van te doen alsof er één universeel betrouwbare prijs bestaat.

| Tool | Type | Beste voor | Waarom deze tool op de lijst van 2026 staat | Prijsmodel (gecontroleerd in mei 2026) |

|---|---|---|---|---|

| Thunderbit | AI-webscraper | Sales, operations, ecommerce, vastgoed | Snelste route voor niet-programmeurs; AI-veldsuggesties, subpagina's, exports, browser- en cloudworkflow | Gratis laag, betaalde abonnementen, zakelijke maatwerkprijzen |

| Browse AI | AI-webscraper | Zakelijke gebruikers die websites monitoren | Sterke no-code robots, monitoring en output in spreadsheet-/API-stijl | Gratis plan, betaalde abonnementen, premium beheerde laag |

| Bardeen | AI-automatisering + scraping | Revenue ops en browserworkflows | Beter wanneer scraping slechts één stap is in een bredere automatiseringsworkflow | Gratis plan en betaalde abonnementen |

| Diffbot | AI-extractieplatform | Enterprise- en datateams | Sterkste keuze wanneer je AI-extractie plus grootschalige gestructureerde datastromen wilt | Enterprise-prijsmodel |

| Instant Data Scraper | Lichtgewicht browser-scraper | Casual gebruikers en snelle tabel-extractie | Nog steeds een van de eenvoudigste manieren om snel een zichtbare lijst of tabel naar CSV te halen | Gratis |

| Octoparse | No-code scraper | Analisten en operationele teams met grotere terugkerende jobs | Volwassen visuele builder met cloud-extractie, anti-blokkering en sjablonen | Gratis plan, vanaf $69/maand betaald, enterprise op maat |

| ParseHub | Low-code scraper | Analisten die logica en desktopcontrole nodig hebben | Flexibele projectlogica en geneste navigatie, maar een steilere leercurve dan nieuwere AI-first tools | Gratis plan en betaalde abonnementen |

| Web Scraper | No-code scraper | Beginners en lichte cloudjobs | Goede instap als je houdt van sitemap-gebaseerde scraping en browser-first inrichting | Gratis extensie, betaalde cloudabonnementen |

| Data Miner | Browser-scraper | Onderzoekers en growth-operators | Nog steeds nuttig voor snelle, op recepten gebaseerde extractie in de browser | Gratis plan en betaalde abonnementen |

| Apify | API- + Actor-platform | Technische teams en hybride operators | Uitstekend ecosysteem van Actors plus custom runtime wanneer browserextensies te beperkt worden | Gratis plan, starter vanaf $29/maand plus gebruik, grotere betaalde niveaus |

| ScrapingBee | Scraping-API | Developers die JS-zware sites scrapen | Goede keuze wanneer je rendering en proxy-afhandeling wilt zonder zelf de browserlaag te bouwen | Gratis proefperiode en betaalde abonnementen |

| ScraperAPI | Scraping-API | Developers die snel willen opschalen | Eenvoudige API, proefcredits, gestructureerde producten en minder eigen infrastructuur nodig | 7-daagse proef met 5.000 credits, vanaf $49/maand betaald |

| Bright Data | Enterprise-API + proxyplatform | Hoog volume, compliance-zware programma's | Breedste dataverzamelingsstack wanneer unblock, proxy en beheerde acquisitie belangrijker zijn dan eenvoud | Gebruik- en productgebaseerde prijzen |

| Oxylabs | Enterprise-API + proxyplatform | Teams die scraping als infrastructuur inkopen | Sterk voor grootschalige verzameling, vooral prijs-, SEO- en marktonderzoekswerk | Web Scraper API vanaf $49/maand; bredere proxyprijzen variëren |

| Zyte | API + anti-botstack | Developer- en datateams | Goede fit als je API-first extractie wilt met sterke browser-, rotatie- en anti-detectieprimitieven | Proef met $5 gratis tegoed, gebruiksafhankelijke verplichtingen |

| Selenium | Open-source browserautomatisering | QA-achtige automatisering en moeilijke interactiestromen | Nog steeds nuttig wanneer de nauwkeurigheid van gebruikersinteractie belangrijker is dan scraper-throughput | Gratis en open-source |

| BeautifulSoup4 | Open-source parser | Beginners en lichte parsing | Het beste als parser in een eenvoudige stack, niet als volledig scrapingplatform | Gratis en open-source |

| Scrapy | Open-source crawlingframework | Productie-custom crawlers | Beste balans tussen kracht en volwassenheid als je de pipeline zelf wilt beheren | Gratis en open-source |

| Puppeteer | Open-source browserautomatisering | Node-first scraping en browserscripting | Ideaal als je team al comfortabel werkt binnen het Chrome/Node-ecosysteem | Gratis en open-source |

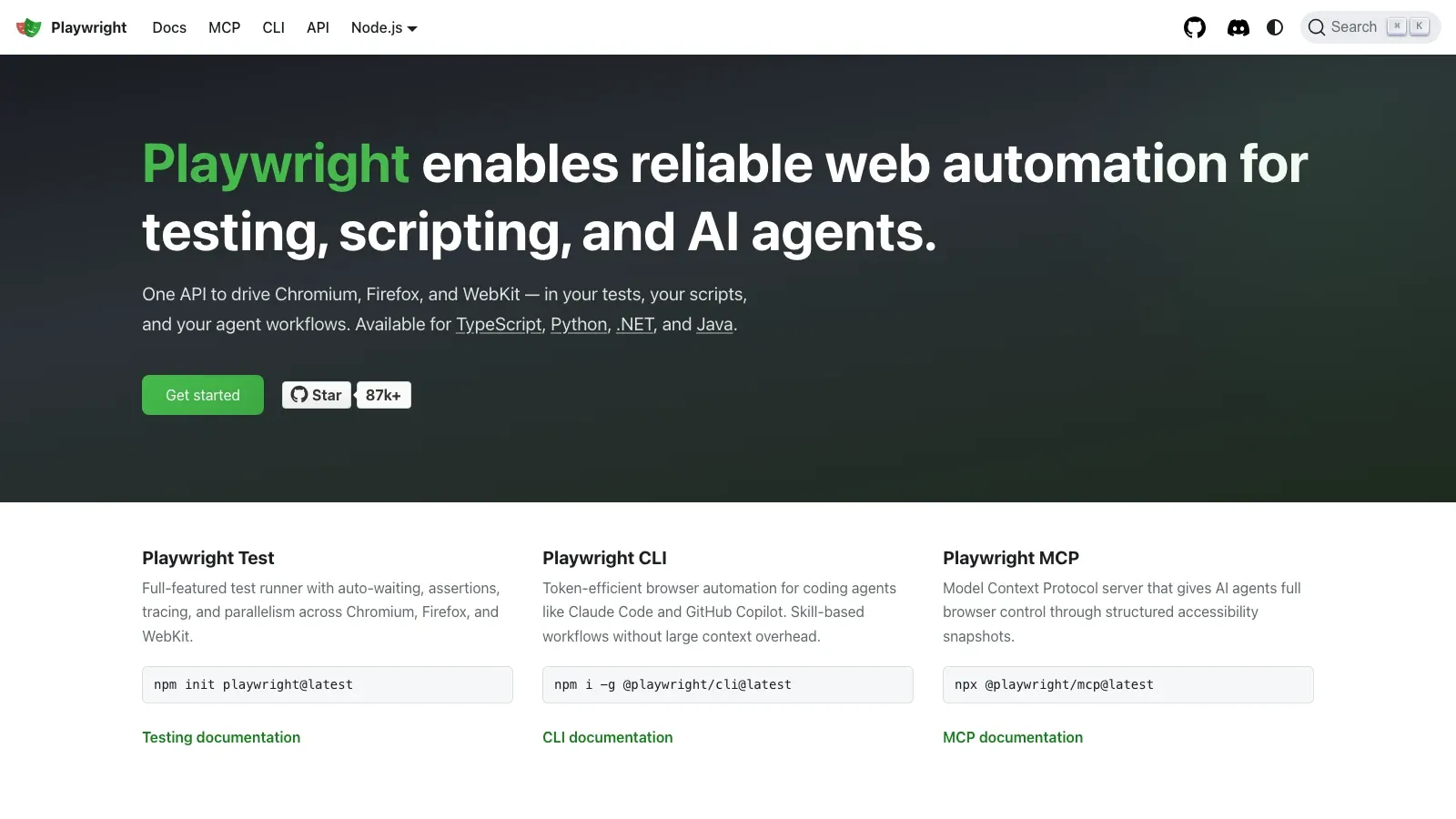

| Playwright | Open-source browserautomatisering | Moderne multi-browserautomatisering | Vaak de strakste keuze voor moderne browserautomatisering met sterke developer-ergonomie | Gratis en open-source |

Hoe ik deze tools heb beoordeeld

Ik heb vier filters gebruikt:

- Tijd tot eerste geslaagde scrape

Als een niet-technische gebruiker niet snel bruikbare data kan ophalen, telt dat mee. - Onderhoudslast

Snelle inrichting betekent niets als de workflow bij elke sitewijziging stukgaat. - Schaalplafond

Sommige tools zijn ideaal voor 50 pagina's per week en waardeloos voor 5 miljoen requests per maand. - Workflow-fit

De beste tool voor een revenue ops-team is zelden de beste tool voor een dataplatformteam.

Het resultaat is geen universele ranglijst. Het is een beslispagina om eerst de juiste toolcategorie te kiezen en daarna het juiste product binnen die categorie.

Welk type webscrapingtool heb je eigenlijk nodig?

- Kies AI-webscrapers als je primaire doel operationele snelheid is.

- Kies no-code tools als je meer pagination, planning en herhaalbare taakcontrole nodig hebt.

- Kies API's en scrapingplatforms als rendering, rotatie en unblock-capaciteit nu de bottleneck zijn.

- Kies open-sourcebibliotheken als je team controle belangrijker vindt dan gemak en de stack intern kan ondersteunen.

Als je team nog steeds twijfelt of scraping thuis hoort bij operations of engineering, begin dan eerst met een AI- of no-code tool. Je leert sneller wat belangrijk is door echte jobs uit te voeren dan door de stack vooraf te ingewikkeld te ontwerpen.

Beste AI-webscrapers voor zakelijke teams

Dit zijn de tools waar ik als eerste naar zou kijken als je spreadsheet-klare data wilt met zo min mogelijk inrichting.

1. Thunderbit

Thunderbit is hier de eenvoudigste optie als je team gestructureerde data wil extraheren zonder selectors, browserscripting of scraping-infrastructuur te hoeven leren. De workflow draait om AI-veldsuggesties, verrijking van subpagina's en directe export naar de tools waarin zakelijke gebruikers al werken.

- Beste voor: sales, operations, ecommerce, vastgoed en andere browserintensieve teams.

- Waarom het opvalt: het verkort de insteltijd voor niet-programmeurs beter dan alles anders op deze lijst.

- Let op: als je diepe custom crawlerlogica of zeer gespecialiseerde engineeringcontrole nodig hebt, kom je uiteindelijk verder in de stack terecht.

- Prijsmodel: gratis laag, self-service betaalde abonnementen en zakelijke prijzen.

2. Browse AI

Browse AI blijft een sterke keuze voor zakelijke gebruikers die point-and-click-inrichting en terugkerende monitoring willen. Het robotmodel is vooral handig wanneer scraping en wijzigingsdetectie even belangrijk zijn.

- Beste voor: prijsmonitoring, competitorpagina's en herhaalbare lijst-extractie.

- Waarom het opvalt: verzorgde onboarding, vooraf gebouwde robots en een duidelijke route van website naar spreadsheet of API-achtige output.

- Let op: complexe jobs met hoog volume kunnen sneller duur worden of operationeel onhandig zijn dan bij API-first stacks.

- Prijsmodel: gratis plan, betaalde abonnementen, premium/beheerde laag.

3. Bardeen

Bardeen is het meest interessant wanneer scraping slechts één actie is binnen een bredere browserautomatiseringsflow. Als je data verplaatst naar CRM's, spreadsheets of outbound workflows, is het automatiseringsaspect belangrijker dan pure scraping-diepte.

- Beste voor: revenue ops, leadworkflows en browser-native taakautomatisering.

- Waarom het opvalt: sterker verhaal rond workflowautomatisering dan pure extractietools.

- Let op: het is niet de beste fit wanneer de scraping zelf complex en bedrijfskritisch is.

- Prijsmodel: gratis plan en betaalde abonnementen.

4. Diffbot

Diffbot is bedoeld voor teams die AI-extractie op enterprise-schaal nodig hebben, niet voor gebruikers die de goedkoopste of eenvoudigste route zoeken. Het is logischer wanneer de kwaliteit van gestructureerde data en grootschalige ingest belangrijker zijn dan handmatige controle.

- Beste voor: enterprise-datateams, content intelligence en grote extractieprogramma's.

- Waarom het opvalt: computer-vision-achtige extractie en sterke focus op gestructureerde output.

- Let op: overkill voor kleine teams en onhandig als je use case lichtgewicht is.

- Prijsmodel: enterprise-achtige abonnementen en maatwerkverkoop.

5. Instant Data Scraper

Instant Data Scraper verdient nog steeds een plek, omdat er genoeg situaties zijn waarin je gewoon die zichtbare tabel, directory of lijst direct nodig hebt. Het is geen platform, maar vaak is het genoeg.

- Beste voor: eenmalige extractie, snelle leadlijsten, eenvoudige directories en zichtbare tabellen.

- Waarom het opvalt: bijna geen frictie op de juiste pagina's.

- Let op: beperkte automatisering, beperkte diepgang en minder geschikt voor geavanceerde workflows.

- Prijsmodel: gratis.

Beste no-code webscrapingtools voor herhaalbare jobs

Zodra de klus meer is dan een incidentele scrape, worden visuele builders en cloud-uitvoering belangrijk.

6. Octoparse

Octoparse blijft een van de sterkste no-code platforms als je cloud-runs, dekking van sjablonen en geavanceerder taakbeheer nodig hebt dan een browserextensie kan bieden.

- Beste voor: analisten, prijs-teams en operators die terugkerende verzameljobs draaien.

- Waarom het opvalt: volwassen task builder, cloud-extractie, anti-blokkering en een groot sjabloonecosysteem.

- Let op: krachtiger dan AI-first browsertools, maar daardoor ook meer instelwerk.

- Prijsmodel: gratis plan, vanaf $69/maand betaald, enterprise op maat.

7. ParseHub

ParseHub blijft relevant voor gebruikers die meer controle willen dan een AI-scraper biedt, maar geen codebase willen bouwen. Het beloont geduld, niet snelheid.

- Beste voor: analisten en technisch nieuwsgierige operators die een steilere leercurve aankunnen.

- Waarom het opvalt: flexibele navigatielogica en meer controle dan lichte browsertools.

- Let op: de productervaring voelt zwaarder aan dan bij nieuwere toetreders, vooral voor snel bewegende zakelijke teams.

- Prijsmodel: gratis plan en betaalde abonnementen.

8. Web Scraper

Web Scraper is nog steeds een prima startpunt als je van het sitemap-model houdt en iets wilt dat in de browser begint en later kan doorgroeien naar cloudplanning.

- Beste voor: beginners, hobbyprojecten en kleinere herhaalbare jobs.

- Waarom het opvalt: toegankelijke sitemap-workflow en eenvoudige browser-first adoptie.

- Let op: het wordt beperkend zodra je meer adaptieve extractielogica nodig hebt.

- Prijsmodel: gratis browserextensie en betaalde cloudabonnementen.

9. Data Miner

Data Miner kun je het best zien als een snelle extractietool in plaats van een volledig scrapingplatform. Toch hoort het erbij, omdat werken met recepten nuttig is voor veel research- en prospectingtaken.

- Beste voor: onderzoekers, growth-teams en snelle exportwerkzaamheden in de browser.

- Waarom het opvalt: receptmodel, weinig frictie en eenvoudige browserexport.

- Let op: niet de juiste tool voor serieuze scraping op platform-schaal.

- Prijsmodel: gratis plan en betaalde abonnementen.

Beste API-platforms wanneer schaal en blokkering het echte probleem worden

Dit is de laag waar engineeringteams niet meer denken: “Hoe scrape ik deze pagina?”, maar: “Hoe maak ik dit betrouwbaar op volume?”

10. Apify

Apify is het meest flexibele platform in deze groep als je zowel een marktplaats voor herbruikbare scrapers als een plek wilt om je eigen code uit te voeren. Het overbrugt no-code ontdekking en developer-executie beter dan de meeste concurrenten.

- Beste voor: hybride teams, scraping geleid door developers en herbruikbare automatiseringsworkflows.

- Waarom het opvalt: Actor-ecosysteem plus custom runtime geven het een uitzonderlijk brede inzetbaarheid.

- Let op: zodra je custom gaat, zit je weer in engineeringland en vervaagt het eenvoudsvoordeel.

- Prijsmodel: gratis plan, starter vanaf $29/maand plus gebruik, grotere gebruiksniveaus en enterprise.

11. ScrapingBee

ScrapingBee is een goede keuze wanneer je echte behoefte is: “Geef me een gerenderde pagina en regel de vervelende infrastructuur voor me.” Het past goed bij JS-zware targets.

- Beste voor: developers die dynamische sites scrapen en weinig tijd willen besteden aan infrastructuur.

- Waarom het opvalt: eenvoudige API rond rendering, proxies en browserautomatisering.

- Let op: het is een infrastructuurdienst, dus parsing, retry-logica en downstreamkwaliteit blijven jouw verantwoordelijkheid.

- Prijsmodel: proefperiode en betaalde abonnementen.

12. ScraperAPI

ScraperAPI blijft een van de makkelijkste manieren om proxybeheer en request-succespercentages uit te besteden wanneer je snel wilt opschalen.

- Beste voor: developers die snel van prototype naar volume willen.

- Waarom het opvalt: eenvoudige API, proefcredits, gestructureerde producten en schaalniveaus.

- Let op: net als alle API-first producten neemt het de noodzaak voor engineeringoordeel rond parsing en datavalidatie niet weg.

- Prijsmodel: 7-daagse proef met 5.000 credits, vanaf $49/maand betaald.

13. Bright Data

Bright Data is de zwaargewicht-optie wanneer unblock-capaciteit, proxyvoorraad en beheerde acquisitie belangrijker zijn dan eenvoud van de tool.

- Beste voor: enterpriseprogramma's, grootschalige en compliance-gevoelige verzameling, en beheerde data-acquisitie.

- Waarom het opvalt: breedte van proxy-, scraper-, browser- en datasetproducten.

- Let op: duur en snel te veel als je kernworkflow nog relatief simpel is.

- Prijsmodel: gebruiksafhankelijke en productgebaseerde prijzen voor API's, proxies en beheerde diensten.

14. Oxylabs

Oxylabs blijft een sterke keuze voor teams die scraping inkopen als infrastructuur in plaats van als browsertool. Het is vooral relevant wanneer betrouwbaarheid en inkoopvolwassenheid belangrijk zijn.

- Beste voor: enterprise-verzameling, prijsmonitoring, SEO-monitoring en marktonderzoek.

- Waarom het opvalt: robuust infrastructuurverhaal, veel proxy-diepte en een duidelijker enterprise-aankoopproces.

- Let op: niet ideaal als je team een informele self-serviceworkflow wil.

- Prijsmodel: Web Scraper API vanaf $49/maand; andere producten variëren per unit en gebruik.

15. Zyte

Zyte verdient nog steeds serieuze overweging van developer- en datateams die anti-detectie, browseracties, JS-rendering en roterende IP's willen achter één API-first verhaal.

- Beste voor: technische teams die herhaalbare extractiesystemen bouwen.

- Waarom het opvalt: browseracties, JS-rendering, IP-rotatie en anti-botpositie in één stack.

- Let op: beter voor teams met engineering-eigenaarschap dan voor niet-technische operators.

- Prijsmodel: proef met $5 gratis tegoed en gebruiksafhankelijke maandelijkse verplichtingen.

Beste open-sourcebibliotheken voor developers die volledige controle willen

Als je de scraper-stack van begin tot eind zelf wilt beheren, zijn dit in 2026 de nuttigste bouwstenen.

16. Selenium

Selenium blijft nuttig wanneer je QA-achtige interactienauwkeurigheid, legacy browserautomatiseringsworkflows of heel expliciete controle over gebruikersflows nodig hebt.

- Beste voor: interactiezware automatisering, overlap met QA en sites waar browsergedrag belangrijker is dan crawl-throughput.

- Waarom het opvalt: volwassen ecosysteem en brede browserondersteuning.

- Let op: zwaarder en trager dan nieuwere browsertools bij veel scrapingworkloads.

- Prijsmodel: gratis en open-source.

17. BeautifulSoup4

BeautifulSoup is geen volledig scrapingplatform, maar blijft een van de eenvoudigste manieren om rommelige HTML te parsen in lichte workflows.

- Beste voor: beginners, snelle scripts en parser-first taken.

- Waarom het opvalt: eenvoudige API en lage cognitieve belasting.

- Let op: combineer het met request-, browser- of crawler-tools; op zichzelf is het alleen een parser.

- Prijsmodel: gratis en open-source.

18. Scrapy

Scrapy is nog steeds het beste antwoord wanneer je een echt crawlerframework nodig hebt in plaats van een paar losse scripts.

- Beste voor: custom crawlers in productie en intern beheerde datapijplijnen.

- Waarom het opvalt: hoge prestaties, pipelines, middleware en langdurige uitbreidbaarheid.

- Let op: er is serieuze engineeringoverhead, en JS-zware targets vereisen vaak aanvullende tooling.

- Prijsmodel: gratis en open-source.

19. Puppeteer

Puppeteer blijft een sterke match voor Node-first teams die directe controle willen over Chromium en browserscripting.

- Beste voor: Node-gebaseerde scraping, screenshots en browserautomatiseringstaken.

- Waarom het opvalt: directe, krachtige controle over Chromium-gedrag.

- Let op: smaller browserverhaal dan Playwright en nog steeds zwaar qua resources op schaal.

- Prijsmodel: gratis en open-source.

20. Playwright

Playwright is mijn standaardaanbeveling voor moderne browserautomatisering als je team code schrijft en een nieuwere abstractielaag wil dan Selenium.

- Beste voor: moderne browserautomatisering, JS-zware sites en teams die developer-ergonomie belangrijk vinden.

- Waarom het opvalt: sterk multi-browsermodel, betrouwbaar wachtgedrag en schone API's.

- Let op: je blijft verantwoordelijk voor browserinfrastructuur, concurrency, selector-drift en datavalidatie.

- Prijsmodel: gratis en open-source.

Mijn shortlist per teamtype

- Sales- en operationele teams: begin met Thunderbit en kijk daarna naar Browse AI als monitoring belangrijker is dan subpagina-verrijking.

- Analisten- en onderzoeksteams: eerst Octoparse als terugkerende jobs groter zijn dan browserextensietools comfortabel aankunnen.

- GTM-teams met veel automatisering: Bardeen als scraping slechts één stap is in een bredere workflow.

- Developerteams die interne tooling bouwen: Apify, Zyte, ScraperAPI of Playwright, afhankelijk van hoeveel eigenaarschap over de stack je wilt.

- Enterprise dataprogramma's: Bright Data, Oxylabs, Diffbot en Zyte zijn de serieuze infrastructuurgesprekken.

Wanneer je een stap verder in de stack moet gaan

Gebruik deze regel:

- Blijf bij AI-tools totdat je tegen grenzen van herhaalbaarheid of edge-cases aanloopt.

- Ga naar no-code tools wanneer planning, pagination, anti-blokkering of cloud-runs belangrijker worden dan one-click eenvoud.

- Ga naar API's wanneer unblock-rate, JS-rendering en concurrency de echte bottlenecks worden.

- Ga naar open-sourcebibliotheken wanneer de kosten van vendorabstractie hoger worden dan de kosten van het zelf beheren van de hele stack.

De meeste teams gaan te vroeg een stap verder in de stack. Dat is een van de meest voorkomende fouten die ik zie.

Slotgedachte

Voor de meeste niet-technische teams is het juiste antwoord in 2026 niet “de krachtigste scraper”. Het is de tool die nauwkeurige data met zo min mogelijk onderhoud in de volgende workflow krijgt. Daarom blijven AI-first tools winnen voor operators, terwijl API's en open-source stacks beter passen bij technische teams met duidelijke schaalvereisten.

Als je de kortste route van pagina naar gestructureerde output wilt, begin dan met Thunderbit. Als je al weet dat je job zware infrastructuur nodig heeft, stap dan direct over naar de API- en developerlagen. Verwar complexiteit niet met verfijning.

Veelgestelde vragen

1. Wat is in 2026 de beste webscrapingtool voor niet-technische gebruikers?

Voor de meeste niet-technische gebruikers bieden AI-first tools zoals Thunderbit en Browse AI de snelste route naar bruikbare data, omdat ze selectorwerk, instelfrictie en onderhoud verminderen.

2. Wat moet ik kiezen als mijn sites JavaScript-zwaar zijn of requests agressief blokkeren?

Kijk dan naar ScrapingBee, ScraperAPI, Zyte, Bright Data, Oxylabs, Playwright of Selenium, afhankelijk van of je een beheerde dienst wilt of directe engineeringcontrole.

3. Zijn no-code tools nog steeds relevant nu AI-webscrapers beter zijn?

Ja. No-code tools zoals Octoparse en ParseHub blijven belangrijk wanneer je meer expliciete controle nodig hebt over taaklogica, cloud-uitvoering en beheer van herhaalbare jobs.

4. Welke tools zijn het meest logisch voor engineeringteams?

Apify, Zyte, ScraperAPI, Scrapy, Playwright, Puppeteer en Selenium zijn de meest natuurlijke keuzes wanneer developers de workflow beheren.

5. Hoe maak ik snel een shortlist zonder te veel onderzoek te doen?

Kies eerst het type tool, niet de leverancier. Bepaal of je AI-eenvoud, no-code controle, API-infrastructuur of open-source eigenaarschap nodig hebt. Vergelijk daarna de producten binnen die laag.

Gerelateerde lectuur