Als je ooit een B2B-leadlijst hebt willen opbouwen, een concurrentieanalyse hebt willen doen of gewoon je CRM up-to-date wilt houden, dan weet je hoe waardevol LinkedIn is. Maar eerlijk is eerlijk: profielen handmatig kopiëren is ongeveer net zo leuk als naar verf kijken die opdroogt, en de eigen tools van LinkedIn geven zelden precies de data die je zoekt. Daarom willen in 2026 meer sales- en operationsteams dan ooit LinkedIn scrapen met Python—uren saai klikwerk omzetten in een paar regels code en een spreadsheet vol prospects.

Maar hier zit natuurlijk de adder onder het gras: LinkedIn is inmiddels het Fort Knox van zakelijke data. Met meer dan 1,3 miljard leden en maar liefst 310 miljoen maandelijkse actieve gebruikers () is het dé bron voor B2B-leads—maar tegelijk ook het zwaarst afgeschermd tegen bots en scrapers. Sterker nog, LinkedIn heeft in 2025 alleen al meer dan 30 miljoen accounts beperkt wegens scraping of automatisering (). Hoe haal je dan in 2026 wél LinkedIn-data binnen met Python—zonder dat je account digitaal op slot gaat? We leggen het stap voor stap uit: van de setup tot veilig scrapen, datacleaning en hoe tools zoals Thunderbit je workflow flink kunnen versnellen.

Wat betekent LinkedIn scrapen met Python?

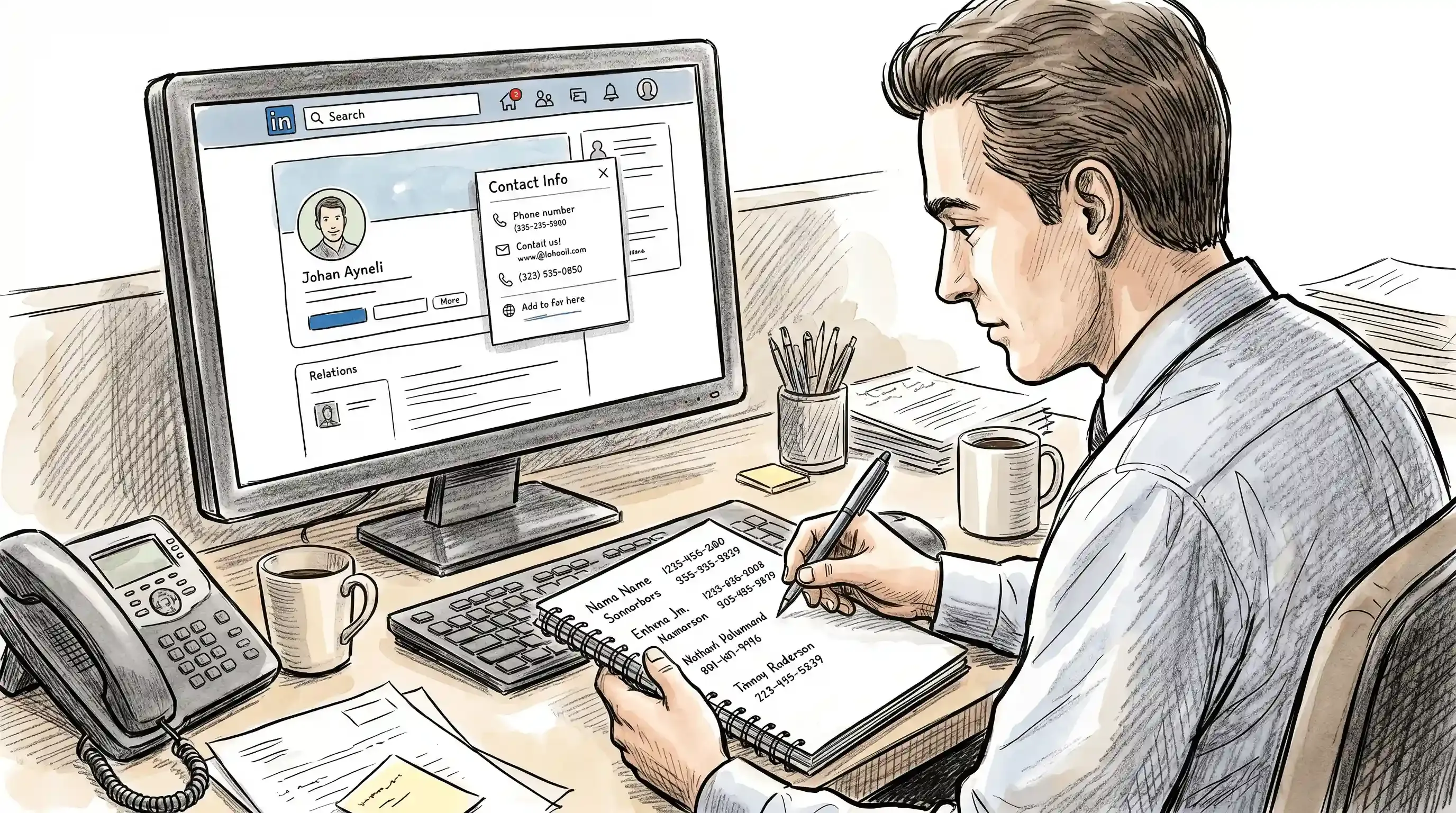

Als we het hebben over LinkedIn scrapen met Python, bedoelen we eigenlijk dat je Python-scripts en libraries inzet om data van LinkedIn-webpagina’s automatisch te verzamelen. In plaats van namen, functietitels of bedrijfsgegevens één voor één te kopiëren en plakken, schrijf je een script dat het zware werk doet—profielen bezoekt, de gewenste velden eruit haalt en alles in een gestructureerd formaat opslaat.

Handmatige dataverzameling is alsof je appels één voor één plukt. LinkedIn-data extraheren met Python is alsof je de hele boom schudt en de appels in een mand opvangt. De belangrijkste zoektermen hier—linkedin data extraction python, python linkedin scraper en automate linkedin scraping—wijzen allemaal op hetzelfde idee: code gebruiken om LinkedIn-data op schaal te verzamelen, sneller en (hopelijk) veiliger dan een mens ooit zou kunnen.

Zakelijke toepassingen van LinkedIn scraping:

- Gerichte leadlijsten opbouwen voor sales outreach

- CRM-records verrijken met actuele functietitels en bedrijven

- Trends in concurrentie-aanwervingen of personeelswissels volgen

- Zakelijke netwerken in kaart brengen voor marktonderzoek

- Bedrijfsberichten of vacatures bundelen voor analyse

Kortom: als je gestructureerde LinkedIn-data nodig hebt en je niet je hele weekend wilt besteden aan op “Connect” klikken, dan is Python je beste vriend.

Waarom LinkedIn scraping automatiseren? Belangrijkste zakelijke use cases

Laten we realistisch zijn: LinkedIn is niet zomaar een sociaal netwerk—het is de ruggengraat van moderne B2B-sales en marketing. Daarom zijn teams in 2026 zo gefocust op het automatiseren van LinkedIn scraping:

- Leadgeneratie: en 62% zegt dat het daadwerkelijk leads oplevert. LinkedIn genereert 277% meer leads dan Facebook en Twitter samen.

- Markt- en concurrentieonderzoek: LinkedIn is de enige plek waar je op schaal real-time organigrammen, aanwervingstrends en bedrijfsnieuws kunt zien.

- CRM-verrijking: Zonder automatisering is je CRM up-to-date houden een nachtmerrie. Met LinkedIn scraping kun je titels, bedrijven en contactgegevens in bulk bijwerken.

- Content- en eventanalyse: Wil je weten wie er binnen jouw niche publiceert, spreekt of mensen aanneemt? LinkedIn scraping levert de data.

Hier is een korte tabel met de meest voorkomende use cases:

| Team | Use case | Opgeleverde waarde |

|---|---|---|

| Sales | Leadlijsten opbouwen, outreach voorbereiden | Meer afspraken, hogere conversie |

| Marketing | Doelgroeponderzoek, contentcuratie | Betere targeting, hogere betrokkenheid |

| Operations | CRM-verrijking, organigrammen in kaart brengen | Schonere data, minder handmatige invoer |

| Recruitment | Talent sourcing, concurrentie volgen | Sneller werven, slimmere pipelines |

En de ROI? Teams die AI-gestuurde automatisering gebruiken voor prospecting melden dat ze 2–3 uur per dag besparen (), en bedrijven zoals TripMaster zagen 650% ROI uit LinkedIn-gebaseerde leadgeneratie (). Dat is niet alleen tijdwinst—het werkt als een echte multipliër voor je pipeline.

Python versus andere LinkedIn scraping-oplossingen: wat je moet weten

Waarom zou je Python gebruiken in plaats van een browserextensie of een SaaS-tool? Hier is de eerlijke vergelijking:

Handmatig kopiëren en plakken

- Voordelen: Geen setup, geen risico (tenzij je last krijgt van een muisarm)

- Nadelen: Traag, foutgevoelig, onmogelijk schaalbaar

Browserextensies (zoals PhantomBuster, Evaboot)

- Voordelen: Makkelijk op te zetten, geen code nodig, geschikt voor kleine klussen

- Nadelen: Beperkte schaal, groot ban-risico, vaak Sales Navigator nodig, maandelijkse kosten

SaaS API’s (zoals Bright Data, Apify)

- Voordelen: Hoge schaal, weinig onderhoud, compliance wordt door de provider afgehandeld

- Nadelen: Duur bij veel volume, soms vertraagde of gecachte data, minder flexibel

Python-scripts

- Voordelen: Maximale flexibiliteit, lage kost per rij op schaal, real-time data

- Nadelen: Hoge technische kennis vereist, hoogste ban-risico, doorlopend onderhoud

Hier is een vergelijking naast elkaar:

| Aspect | DIY Python | Browserextensie | SaaS API |

|---|---|---|---|

| Installatietijd | Dagen–weken | Minuten | Uren |

| Technische kennis | Hoog | Laag | متوسط/Medium |

| Kosten (10K rijen) | ~$200 (proxies) | $50–300 | $300–500 |

| Schaalbaarheidslimiet | Hoog | Laag–Middel | Hoog |

| Ban-risico | Hoogst | Hoog | Laagst |

| Dataversheid | Realtime | Realtime | Gecachet |

| Onderhoud | Doorlopend | Laag | Geen |

| Compliance | Risico bij gebruiker | Risico bij gebruiker | Risico bij provider |

Kort gezegd: als je technisch onderlegd bent en volledige controle wilt, is Python nauwelijks te verslaan. Maar voor de meeste zakelijke gebruikers bieden tools zoals een veel snellere en veiligere route naar LinkedIn-data—zeker nu LinkedIn’s beveiliging elk jaar strenger wordt.

Aan de slag: je Python LinkedIn scraper opzetten

Klaar om erin te duiken? Zo richt je in 2026 je Python-omgeving in voor LinkedIn scraping:

1. Installeer Python en de belangrijkste libraries

- Python 3.10+ is aan te raden voor de beste compatibiliteit.

- Kernlibraries:

- Playwright (de nieuwe standaard voor browserautomatisering)

- Selenium (nog steeds populair, maar trager en makkelijker te detecteren)

- Beautiful Soup (voor het parsen van HTML)

- Requests (voor eenvoudige HTTP-verzoeken; beperkt bruikbaar op LinkedIn)

- pandas (voor datacleaning en export)

Installeren via pip:

1pip install playwright selenium beautifulsoup4 pandasVoor Playwright moet je ook browserbinaries installeren:

1playwright install2. Browserdrivers instellen

- Playwright beheert zijn eigen drivers.

- Selenium heeft of nodig.

- Zorg dat je browser- en driverversies overeenkomen.

3. Voorbereiden op inloggen

- Je hebt een LinkedIn-account nodig (liefst een ouder account met echte activiteit).

- Voor de meeste scripts doe je één van deze twee dingen:

- De inlogflow automatiseren (kans op CAPTCHA)

- Je

li_atsessiecookie injecteren (sneller, maar nog steeds riskant)

4. Houd rekening met de voorwaarden van LinkedIn

Waarschuwing: LinkedIn scrapen, zelfs met je eigen account, schendt hun gebruikersvoorwaarden. Het juridische landschap is complex (zie de hiQ vs. LinkedIn-zaak), en LinkedIn handhaaft inmiddels extreem streng. Gebruik deze scripts alleen voor educatieve of interne onderzoeksdoeleinden, en verkoop of publiceer gescrapete data nooit.

Omgaan met LinkedIn-beperkingen: hoe je accountban in 2026 vermindert

Hier wordt het lastig. LinkedIn’s anti-botverdediging in 2026 is geen grap. Ze hebben complete bedrijven stilgelegd (RIP Proxycurl) en in 2025 alleen al meer dan 30 miljoen accounts beperkt (). Hoe scrape je dan zonder schade?

De belangrijkste risico’s

- Rate limits: Niet-ingelogde gebruikers krijgen ongeveer 50 profielweergaven per dag per IP. Ingelogde accounts kunnen er een paar honderd doen voordat CAPTCHAs of bans optreden ().

- CAPTCHAs: Vaak voorkomend, vooral na snelle profielbezoeken of logins.

- Accountbeperkingen: LinkedIn kan accounts blokkeren, beperken of permanent verbannen bij verdachte activiteit.

Bewezen strategieën om risico te beperken

- Gebruik mobiele of oudere residential proxies: Mobiele proxies hebben een 85% overlevingskans op LinkedIn, tegenover 50% voor residential en vrijwel nul voor datacenter-IP’s ().

- Randomiseer vertragingen: Gebruik niet steeds vaste

time.sleep(5). Varieer liever tussen 2 en 8 seconden. - Warm accounts eerst op: Ga niet meteen 100 profielen langs met een vers account. Begin rustig en bootst echt gebruikersgedrag na.

- Scrape tijdens kantooruren: Laat het tijdstip aansluiten op de tijdzone van je account.

- Wissel user agents per sessie: Maar verander ze niet midden in een sessie—LinkedIn ziet dat.

- Scroll op natuurlijke wijze: Gebruik browserautomatisering om te scrollen en lazy-loaded content te triggeren.

- Eén IP per account: Draai nooit meerdere accounts achter één proxy.

- Let op vroege waarschuwingssignalen: 429-fouten, redirects naar

/authwallof lege profielinhoud betekenen dat je dicht bij een ban zit.

Pro-tip: Zelfs de beste stealth plugins (Playwright Stealth, undetected-chromedriver) repareren alleen oppervlakkige fingerprints. LinkedIn’s detectie gaat veel dieper—dus doe niet te zelfverzekerd.

De juiste Python-libraries kiezen voor LinkedIn-data-extractie

In 2026 is het Python scrapinglandschap duidelijker dan ooit. Zo verhouden de belangrijkste libraries zich tot elkaar:

| Library | Statische HTML | JS-gerenderd | Inlogflows | Snelheid | Beste voor |

|---|---|---|---|---|---|

| Requests + BS4 | ✅ | ❌ | ❌ | Snelst | Kleine, openbare pagina’s |

| Selenium 4.x | ✅ | ✅ | ✅ | Traag | Legacy, brede browserondersteuning |

| Playwright (Python) | ✅ | ✅ | ✅ | Snel | Standaard voor LinkedIn in 2026 |

| Scrapy | ✅ | Met plugin | Met moeite | Snel | Gestructureerde crawls op grote schaal |

Waarom Playwright wint voor LinkedIn:

- 12% snellere paginalading en 15% minder geheugengebruik dan Selenium ()

- Kan LinkedIn’s asynchrone laden aan zonder handmatige trucjes

- Natuurlijke tabbeheerfunctie voor parallel scrapen

- Officiële stealth plugin voor basis fingerprint-evasie

Beginnertip: Als je net begint, is Playwright je beste keuze. Selenium is nog steeds handig voor oudere projecten, maar het is trager en makkelijker te detecteren.

Stap voor stap: je eerste Python LinkedIn scraper-script

Laten we een eenvoudig voorbeeld doornemen met Selenium (voor beginners) en Playwright (voor productie). Onthoud: deze scripts zijn alleen voor educatief gebruik.

Voorbeeld 1: minimale Selenium-login en profielscrape

1from selenium import webdriver

2from selenium.webdriver.common.by import By

3from selenium.webdriver.common.keys import Keys

4import time, random

5driver = webdriver.Chrome()

6driver.get("https://www.linkedin.com/login")

7driver.find_element(By.ID, "username").send_keys("you@example.com")

8driver.find_element(By.ID, "password").send_keys("yourpassword" + Keys.RETURN)

9time.sleep(random.uniform(3, 6)) # willekeurige vertraging

10# Ga naar een profiel

11driver.get("https://www.linkedin.com/in/some-profile/")

12time.sleep(random.uniform(4, 8))

13# Scroll om lazy-load te activeren

14driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

15# Data extraheren (vereenvoudigd)

16name = driver.find_element(By.CSS_SELECTOR, "h1").text

17print("Naam:", name)

18driver.quit()Opmerking: Voor productie wil je waarschijnlijk je li_at-cookie injecteren in plaats van elke keer opnieuw in te loggen (om CAPTCHAs te vermijden).

Voorbeeld 2: Playwright async scraper (aanbevolen voor 2026)

1import asyncio

2from linkedin_scraper import BrowserManager, PersonScraper

3async def main():

4 async with BrowserManager() as browser:

5 await browser.load_session("session.json") # slaat je inlogsessie op

6 scraper = PersonScraper(browser.page)

7 person = await scraper.scrape("https://linkedin.com/in/username")

8 print(person.name, person.experiences)

9asyncio.run(main())()

Waar je anti-banmaatregelen toevoegt:

- Gebruik mobiele proxies in je browsermanager

- Randomiseer vertragingen tussen acties

- Scrape in kleine batches, niet alles tegelijk

Waarschuwing: Elke scraper die op selectors leunt, breekt zodra LinkedIn zijn DOM aanpast (dat gebeurt om de paar weken). Houd rekening met onderhoud.

LinkedIn-data opschonen en formatteren met Python

Scraping is maar de helft van het verhaal. LinkedIn-data is rommelig—denk aan dubbele namen, inconsistente functietitels en vreemde Unicode-tekens. Zo ruim je het op:

1. Gebruik pandas voor tabelverwerking

1import pandas as pd

2df = pd.read_csv("linkedin_raw.csv")

3df = df.drop_duplicates(subset=["email", "phone"]) # exacte deduplicatie

4df["name"] = df["name"].str.lower().str.strip()2. Fuzzy matching voor bedrijfsnamen

1from rapidfuzz import fuzz

2def is_similar(a, b):

3 return fuzz.ratio(a, b) > 90

4# Voorbeeld: "Acme Corp" vs "ACME Corporation"3. Telefoonnummers en e-mails normaliseren

1import phonenumbers

2from email_validator import validate_email, EmailNotValidError

3# Telefoonnummer normaliseren

4num = phonenumbers.parse("+1 415-555-1234", None)

5print(phonenumbers.format_number(num, phonenumbers.PhoneNumberFormat.E164))

6# E-mail valideren

7try:

8 v = validate_email("someone@example.com")

9 print(v.email)

10except EmailNotValidError as e:

11 print("Ongeldig e-mailadres:", e)4. Exporteren naar Excel, Google Sheets of CRM

- Excel:

df.to_excel("cleaned_data.xlsx") - Google Sheets: gebruik de

gspread-library - Airtable: gebruik

pyairtable - Salesforce/HubSpot: gebruik de bijbehorende Python API-clients

Pro-tip: Ruim data altijd op en verwijder dubbelen vóór je alles in je CRM importeert. Niets bederft de dag van een sales rep sneller dan dezelfde prospect twee keer bellen.

LinkedIn scraping efficiënter maken met Thunderbit

Laten we nu kijken hoe je je leven nog makkelijker maakt. Hoe graag ik Python ook gebruik, scrapers voor LinkedIn onderhouden is een eindeloze katten-en-muis-game. Daarom hebben we bij Thunderbit een gebouwd die het pijnlijke deel van LinkedIn-data-extractie wegneemt.

Waarom Thunderbit?

- Scrapen in 2 klikken: Klik gewoon op “AI Suggest Fields” en Thunderbit leest de pagina, stelt kolommen voor en haalt de data op—geen code, geen selectors, geen gedoe.

- Subpage scraping: Scrape een zoekresultatenpagina en laat Thunderbit daarna elk profiel bezoeken om je tabel automatisch te verrijken.

- Directe templates: Voorgebouwd voor LinkedIn, Amazon, Google Maps en meer—je bent binnen seconden bezig.

- Gratis export: Stuur data naar Excel, Google Sheets, Airtable, Notion of download als CSV/JSON.

- AI Autofill: Automatiseer formulierinvulling en repetitieve workflows—ideaal voor sales ops en CRM-beheerders.

- Cloud of browser scraping: Kies de modus die past bij je use case en inlogbehoefte.

- Geen onderhoud: Thunderbit’s AI past zich aan de lay-outwijzigingen van LinkedIn aan, dus je hoeft niet steeds kapotte scripts te fixen.

Thunderbit wordt wereldwijd vertrouwd door meer dan 100.000 gebruikers en heeft een beoordeling van 4,4★ in de Chrome Web Store (). Voor de meeste zakelijke gebruikers is het de snelste en veiligste manier om LinkedIn-data te extraheren—zonder je account of je gemoedsrust op het spel te zetten.

Geavanceerde tips: LinkedIn scraping-workflows opschalen en automatiseren

Als je klaar bent om professioneel te werken, zo schaal je je LinkedIn scraping op:

1. Scripts plannen

- cron (Linux/Mac) of Taakplanner (Windows) voor eenvoudige taken

- APScheduler of Prefect 3 voor Python-native planning en retries

- Airflow voor enterprise-level orkestratie

2. Cloud deployment

- AWS Lambda (met Playwright in een container)

- GCP Cloud Run

- Railway / Fly.io / Render voor eenvoudige Playwright-hosting

- Apify voor cloud-workflows specifiek voor scraping

3. Monitoring en drift-detectie

- Sentry voor foutmonitoring

- Aangepaste alerts bij pieken in 429-fouten of DOM-wijzigingen

- Hash-based diffing om te detecteren wanneer LinkedIn’s lay-out verandert

4. CRM-integratie

- Gebruik API’s voor Salesforce, HubSpot, Notion of Airtable om opgeschoonde data automatisch door te sturen

- Bouw een pipeline: Scheduler → Scraper → pandas clean/dedupe → verrijking → push naar CRM → alerts

5. Blijf compliant

- Scrape nooit meer dan een paar honderd profielen per account per dag

- Wissel proxies en user agents af

- Let op vroege ban-signalen en pauzeer scripts als je die ziet

Pro-tip: Zelfs met al deze automatisering kan LinkedIn de spelregels wijzigen. Zorg dus altijd voor een back-upplan—and overweeg Thunderbit voor je meest kritieke workflows.

Conclusie en belangrijkste inzichten

LinkedIn scrapen met Python in 2026 is krachtiger dan ooit, maar ook riskanter. Dit moet je onthouden:

- LinkedIn is de belangrijkste bron voor B2B-data—maar ook de zwaarst verdedigde tegen scrapers.

- Python geeft je maximale flexibiliteit voor LinkedIn-data-extractie, maar brengt een hoog ban-risico en doorlopend onderhoud met zich mee.

- Playwright is nu de gouden standaard voor LinkedIn scraping—sneller en betrouwbaarder dan Selenium.

- Ban-risico verlagen draait om proxies, vertragingen en realistisch gebruikersgedrag—mobiele proxies halen 85%, residential 50%, datacenter 0%.

- Datacleaning is essentieel—gebruik pandas, fuzzy matching en validatielibraries voordat je data in je CRM zet.

- Thunderbit biedt een veiliger en sneller alternatief—met AI-gestuurde scraping, verrijking van subpagina’s, directe export en geen code nodig.

- Opschalen betekent alles automatiseren—van planning tot monitoring tot CRM-integratie.

En bovenal: scrape ethisch en verantwoord. De juridische afdeling van LinkedIn staat niet bepaald bekend om haar gevoel voor humor.

Als je het zat bent om voortdurend te vechten tegen LinkedIn’s steeds veranderende verdediging, . Het is de tool die ik zelf graag eerder had gehad—en hij kan jou (en je LinkedIn-account) een hoop ellende besparen.

Wil je dieper gaan? Bekijk dan de voor meer gidsen over webscraping, automatisering en best practices voor sales ops.

Veelgestelde vragen

1. Is LinkedIn scrapen met Python in 2026 legaal?

Het juridische landschap is complex. Hoewel de zaak hiQ vs. LinkedIn oordeelde dat het scrapen van openbare data de CFAA niet schendt, kan LinkedIn wel degelijk zijn gebruikersvoorwaarden handhaven, en daarin is scraping verboden. In 2025 schakelde LinkedIn Proxycurl uit en beperkte het meer dan 30 miljoen accounts wegens scraping. Gebruik scraping-scripts daarom alleen voor interne of educatieve doeleinden, en verkoop of publiceer gescrapete data nooit.

2. Wat is de veiligste manier om LinkedIn scraping te automatiseren?

Gebruik oudere accounts, mobiele proxies (85% overlevingskans), randomiseer vertragingen en scrape tijdens kantooruren. Gebruik nooit datacenter-IP’s en let op vroege ban-signalen. Voor de meeste zakelijke gebruikers bieden tools zoals een veel lagere risicovariant dan zelf Python-scripts bouwen.

3. Welke Python-library is in 2026 het beste voor LinkedIn scraping?

Playwright is nu de standaardkeuze—sneller, betrouwbaarder en beter in het omgaan met dynamische LinkedIn-content dan Selenium. Voor eenvoudige, openbare pagina’s werken Requests + Beautiful Soup nog steeds, maar voor alles met login of JavaScript kies je Playwright.

4. Hoe maak ik LinkedIn-data schoon en netjes na het scrapen?

Gebruik pandas voor tabelverwerking en deduplicatie, RapidFuzz voor fuzzy matching, phonenumbers en email-validator voor contactgegevens, en exporteer naar Excel, Google Sheets of je CRM met de bijbehorende Python-libraries.

5. Hoe helpt Thunderbit bij LinkedIn-data-extractie?

Thunderbit gebruikt AI om velden voor te stellen, subpage scraping af te handelen en data direct naar je favoriete tools te exporteren—zonder code. Het past zich aan de frequente lay-outwijzigingen van LinkedIn aan, wat onderhoud en ban-risico vermindert. Bovendien is het gratis te proberen en wordt het wereldwijd vertrouwd door meer dan 100.000 gebruikers.

Benieuwd hoe LinkedIn scraping eruitziet in de praktijk—zonder gedoe? en begin in twee klikken met data-extractie. Je sales team (en je LinkedIn-account) zullen je dankbaar zijn.

Meer weten