Vorige week heb ik een hele middag geprobeerd om een AI-agent een leveranciersformulier te laten invullen op een portaal achter een inlogscherm. Na drie uur zat ik naar een “Connection Refused”-fout te staren, was mijn VPS door het geheugen heen en overwoog ik serieus om het hele klusje dan maar handmatig te doen.

Die ervaring is eigenlijk het standaardpakket bij OpenClaw browser automation. De tool kan pagina’s navigeren, data scrapen, formulieren invullen en complexe workflows aan elkaar knopen met gewone Engelse instructies — echt indrukwekkend. Maar precies tussen “dit klinkt geweldig” en “dit werkt ook echt op mijn machine” raken de meeste mensen vast.

Ik heb veel tijd aan beide kanten van dat gat doorgebracht: bij het bouwen van automatiseringstools bij én bij het testen van wat het open-source ecosysteem te bieden heeft. Deze gids is wat ik zelf had willen hebben: een echte stapsgewijze setup, de browsermodus-keuze waar iedereen op struikelt, een Windows-native route (want WSL zou geen vereiste moeten zijn), een overlevingsgids tegen anti-botmaatregelen, echte outputvoorbeelden, veelvoorkomende fouten met concrete fixes, en een eerlijke blik op wanneer OpenClaw de juiste keuze is — en wanneer het eigenlijk te veel van het goede is.

Wat is OpenClaw browser automation?

OpenClaw is een gratis, open-source AI-agentplatform (MIT-licentie) dat namens jou een browser kan bedienen. In plaats van Selenium-scripts of Puppeteer-code te schrijven, beschrijf je in gewone taal wat je wilt laten doen — “Ga naar deze pagina en haal alle productnamen en prijzen eruit” — en de AI zoekt uit hoe het moet. Het gebruikt een genummerd snapshotsysteem waarbij de agent pagina-elementen identificeert, referentienummers toekent en stap voor stap met die elementen werkt.

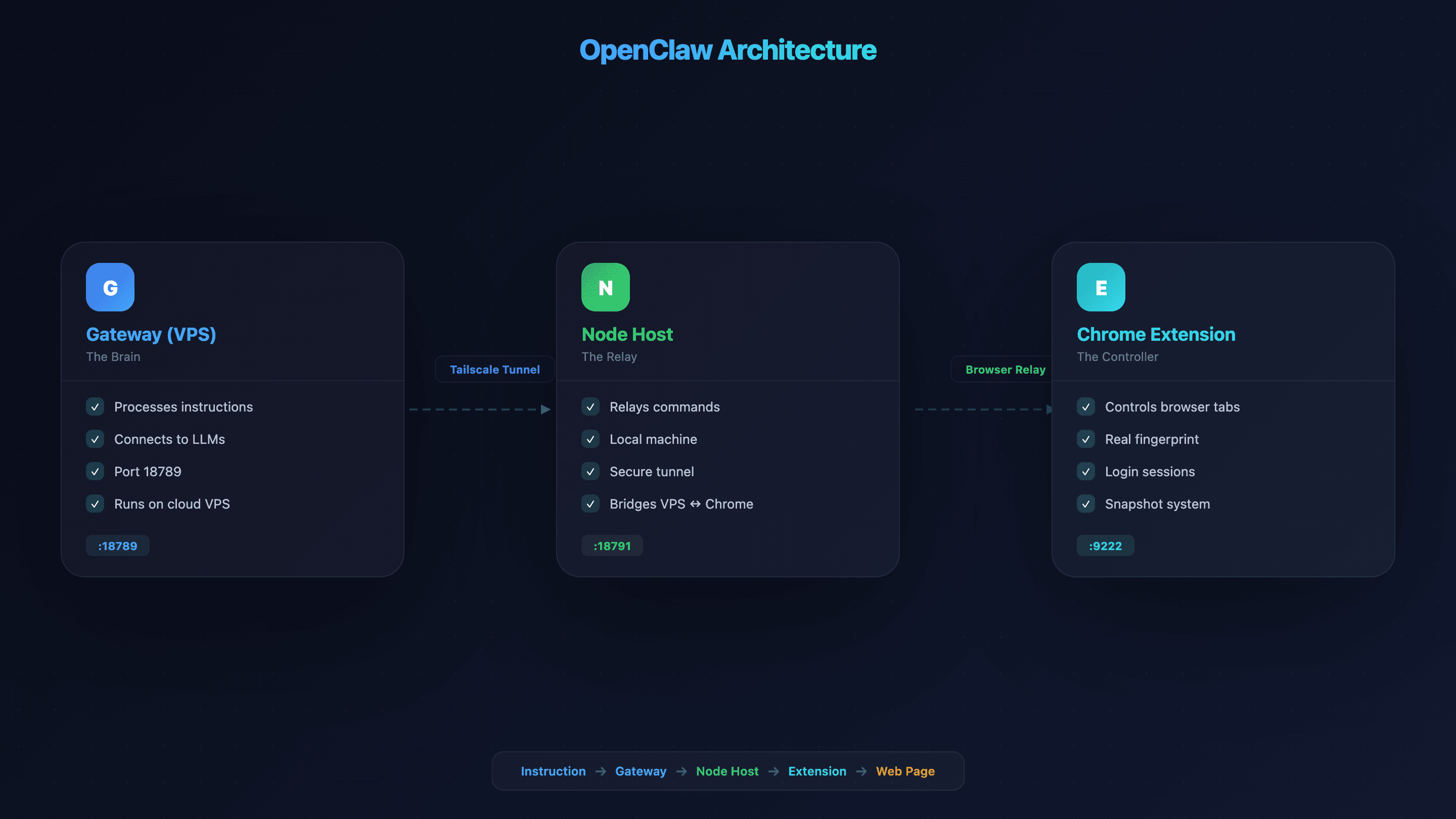

De architectuur bestaat uit drie onderdelen — daarom is de setup meer dan alleen een extensie installeren:

- Gateway (VPS/server): het “brein” dat je instructies verwerkt en verbinding maakt met LLM’s. Draait standaard op poort 18789.

- Node Host (lokale machine): een tussenlaag waarmee de Gateway browserinstructies naar je lokale Chrome kan sturen. Verbonden via een beveiligde tunnel zoals Tailscale.

- Chrome-extensie (Browser Relay): geeft de agent directe controle over browsertabbladen in je eigen browser.

Aanvullende poorten zijn onder andere Control Service (18791), CDP Relay (18792) en managed browser CDP (, met ondersteuning voor maximaal 100 parallelle profielen).

Ja, dat zijn veel bewegende delen. Maar zodra je weet wat elk onderdeel doet, valt de setup op z’n plek. Zie het als een radiografisch bestuurbare auto: de Gateway is de afstandsbediening, de Node Host is het radiosignaal en de Chrome-extensie is de auto zelf.

Waarom OpenClaw browser automation relevant is voor zakelijke teams

Kenniswerkers besteden tot in plaats van aan werk met hoge waarde, waaronder 1,8 uur per dag alleen al aan zoeken en informatie verzamelen. Smartsheet ontdekte dat minstens een kwart van hun werkweek kwijt is aan handmatige, repetitieve taken. Alleen al handmatige gegevensinvoer kost Amerikaanse bedrijven naar schatting .

Dat is precies het probleem dat OpenClaw browser automation probeert op te lossen. In de praktijk past het op concrete bedrijfsprocessen:

| Use case | Wat OpenClaw doet | Zakelijk resultaat | |---|---|---| | Leadgeneratie | Haalt contactgegevens uit directories en bedrijfspagina’s | Sneller gevulde salespipeline | | Concurrentieprijsmonitoring | Navigeert dagelijks productpagina’s en extraheert prijzen | Directe marktinzichten | | Formulieren invullen / data-invoer | Vult repetitieve webformulieren in (CRM, portals, aanvragen) | Uren bespaard per week | | Contentmonitoring | Controleert concurrentieblogs, vacaturebanken, persberichten | Vroegtijdige signalen uit de markt | | QA / testen | Loopt webflows door om te verifiëren of ze werken | Minder kapotte gebruikerservaringen |

De markt voor AI-agenten bereikte in 2025 , bijna een verdubbeling ten opzichte van $3,7 miljard in 2023, en gebruikt inmiddels AI-automatisering in ten minste één functie. Het is dus allang geen niche meer.

Sandbox Chromium vs. Browser Relay vs. Chrome Remote Debugging: kies de juiste modus

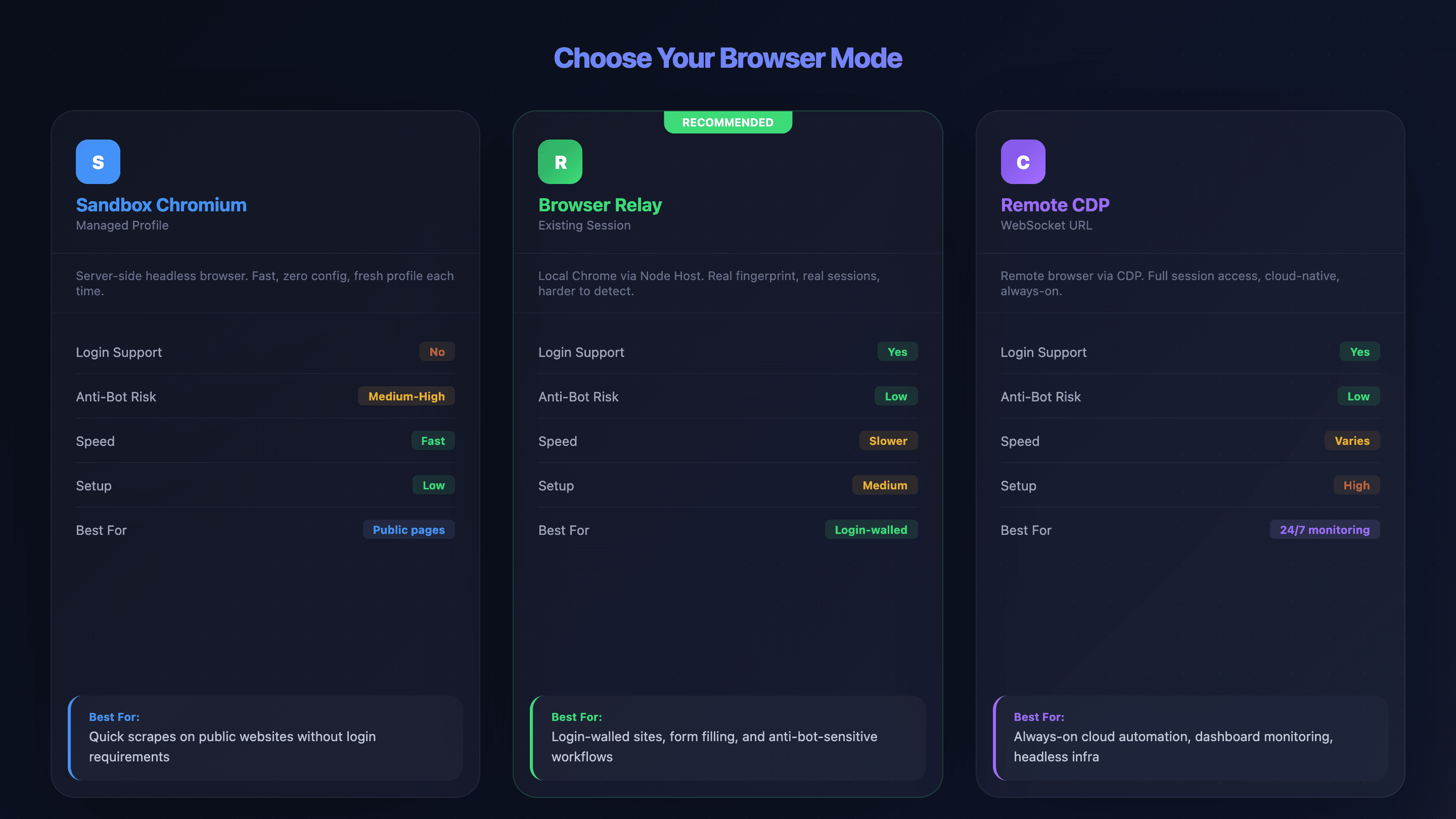

De verkeerde browsermodus kiezen is in mijn ervaring de grootste bron van frustratie voor nieuwe OpenClaw-gebruikers. Ik heb mensen uren zien debuggen aan verbindingsproblemen die gewoon voorkomen hadden kunnen worden door meteen een andere modus te kiezen. OpenClaw biedt drie manieren om verbinding te maken, en elk heeft duidelijke voor- en nadelen:

- Sandbox Chromium (Managed Profile): OpenClaw start zijn eigen headless browser op de server. Geen login-sessies, snel, weinig setup — maar wel beter detecteerbaar voor anti-botsystemen.

- Browser Relay (Existing-Session): een node host op je lokale machine stuurt instructies van de VPS door naar je echte Chrome-browser. Ondersteunt login-sessies en cookies en gebruikt je echte browserfingerprint.

- Chrome Remote Debugging (Remote CDP): verbindt via een WebSocket-URL met een externe browser. Volledige sessietoegang, hoogste setupcomplexiteit. Werkt met cloudproviders zoals Browserless of Browserbase.

Vergelijkingstabel: alle drie de browsermodi

| Factor | Sandbox Chromium | Browser Relay | Remote CDP | |---|---|---|---| | Login-ondersteuning | ❌ Nee (schoon profiel) | ✅ Ja (echte sessies) | ✅ Ja (vooraf geauthenticeerd) | | Risico op anti-botdetectie | ⚠️ Midden-hoog | ✅ Laag (echte fingerprint) | ✅ Laag (door provider beheerd) | | Snelheid | ✅ Snel | ⚠️ Langzamer (netwerkrelay) | ⚠️ Variabel | | Setupcomplexiteit | Laag | Middel | Hoog | | Volledige feature-ondersteuning | ✅ Ja (alle functies) | ⚠️ Beperkt (geen batch, geen download-interceptie) | Afhankelijk van provider | | Beste voor | Openbare pagina’s, snelle scrapes | Sites achter login, formulieren invullen | Cloudinfrastructuur, 24/7 monitoring |

Beslisboom: welke modus moet je kiezen?

Loop deze vragen in volgorde door:

- “Moet je ingelogd zijn?” — Nee → Sandbox Chromium. Ja → volgende vraag.

- “Heeft de site zware anti-botbescherming?” — Ja → Browser Relay (je echte browserfingerprint verkleint de kans op detectie). Nee → Browser Relay of Remote CDP.

- “Heb je een blijvende, altijd-aan sessie nodig (bijv. een dashboard 24/7 monitoren)?” — Ja → Remote CDP met een cloudprovider. Nee → Browser Relay.

Praktische voorbeelden:

- Publieke Amazon-lijsten scrapen → Sandbox Chromium

- Een CRM-formulier invullen achter login → Browser Relay

- Een intern analytics-dashboard continu volgen → Remote CDP met Browserless/Browserbase

Maak deze keuze goed en je bespaart jezelf uren debuggen. Echt waar.

Voor je begint

- Moeilijkheid: gemiddeld (CLI-ervaring nodig)

- Benodigde tijd: 45–75 minuten voor de volledige setup; 10–15 minuten per stap

- Wat je nodig hebt: een VPS (minimaal 2 GB RAM, 4 GB aanbevolen), Node.js v22.12.0+, een Tailscale-account (gratis), een Chrome-browser en geduld

Stap 1: OpenClaw aan de praat krijgen op een VPS (of lokaal)

De VPS is waar het “brein” van OpenClaw draait. Er zijn twee routes om dat voor elkaar te krijgen:

Optie A: VPS-hosting met één klik

Verschillende providers bieden vooraf geconfigureerde OpenClaw-images aan:

| Provider | Vanafprijs | Opmerkingen | |---|---|---| | Hostinger | Vanaf $6.99/maand | Vooraf geconfigureerde image | | Tencent Cloud Lighthouse | Vanaf ~$0.08/jaar (actie) | 2 cores/4 GB aanbevolen | | Hetzner | Vanaf $4.09/maand (CX22) | Beste prijs-kwaliteit; handmatige installatie | | DigitalOcean | Vanaf $4/maand | Handmatige installatie | | Vultr | Vanaf $3.50/maand | Handmatige installatie |

Optie B: handmatige CLI-installatie

1# Installeren via npm (vereist Node.js v22.12.0+)

2npm install -g openclaw

3# Onboardingwizard starten

4openclaw onboard

5# Gateway-token genereren (bewaar dit — je hebt het nodig voor de node host)

6openclaw doctor --generate-gateway-token

7# Configuratie valideren

8openclaw doctor --fixMinimale specificaties: 2 GB RAM (crasht bij 1 GB), 4 GB aanbevolen. Elke headless browserinstance gebruikt 400–800 MB in idle toestand. Gebruik je Docker, stel dan shm_size: '2gb' in — dit is cruciaal voor stabiliteit.

Na deze stap hoort OpenClaw te draaien en heb je een Gateway-token veilig opgeslagen. (Ik bewaar de mijne in een wachtwoordmanager. Niet kwijtraken.)

Stap 2: Tailscale instellen om VPS en lokale machine te verbinden

Tailscale maakt een privé, versleutelde tunnel tussen je VPS en je lokale apparaat, zodat browserinstructies niet via het openbare internet lopen. Omdat OpenClaw begin 2026 volgens Kaspersky, is deze stap overslaan geen goed idee.

1# Op de VPS

2curl -fsSL https://tailscale.com/install.sh | sh

3sudo tailscale up --ssh=true

4# Noteer het Tailscale-IP van de VPS (100.x.x.x)

5# Configureer Gateway om te luisteren op het Tailscale-netwerk

6openclaw config set gateway.listen "100.x.x.x:18789"Installeer Tailscale op je lokale machine via . Beide apparaten moeten hetzelfde Tailscale-account gebruiken.

Alternatieven als Tailscale niet jouw ding is:

| Factor | Tailscale | Cloudflare Tunnel | WireGuard | |---|---|---|---| | Insteltijd | 5 min | 10–15 min | 20–30 min | | Kosten | Gratis (persoonlijk) | Gratis | Gratis | | NAT traversal | Automatisch | Automatisch | Handmatig |

Je zou nu vanaf je lokale machine het Tailscale-IP van je VPS moeten kunnen pingen. Lukt dat niet, controleer dan of beide apparaten op hetzelfde Tailscale-account zitten.

Stap 3: de Node Host installeren op je lokale apparaat

De node host stuurt browserinstructies van de VPS-Gateway door naar je lokale Chrome — de vertaler tussen server en browser.

1# Installeer het node-hostpakket

2npm install -g @openclaw/node-host

3# Stel het Gateway-token uit stap 1 in

4export OPENCLAW_GATEWAY_TOKEN="your-token-here"

5# Start de node host en verwijs naar het Tailscale-IP van je VPS

6openclaw node install --host 100.x.x.x --port 18789

7# Keur de verbinding goed vanaf de VPS-kant

8openclaw node approve <node-id>Je zou een bevestiging moeten zien dat de node verbonden en goedgekeurd is. Als de goedkeuringsstap blijft hangen, start dan het Gateway-proces op de VPS opnieuw op.

Stap 4: installeer de OpenClaw Chrome-extensie

De extensie geeft de agent directe controle over browsertabbladen. Je kunt hem ook uit de Chrome Web Store halen door te zoeken op “OpenClaw Browser Relay.”

1# Installeer de extensiebestanden

2openclaw browser extension install

3# Of handmatig:

4# 1. Open chrome://extensions

5# 2. Zet "Developer mode" aan (schakelaar rechtsboven)

6# 3. Klik op "Load unpacked" → selecteer de extensiemap

7# 4. Vastmaken aan de werkbalk

8# 5. Controleer of het badge "ON" toontAls het badge “ON” toont, zit je goed. Blijft het op “OFF” staan, ga dan naar het troubleshooting-gedeelte hieronder.

Stap 5: voer je eerste OpenClaw browser automation-taak uit

Open een doel-tabblad en probeer in de OpenClaw-chatinterface iets simpels:

1Ga naar https://books.toscrape.com en haal de titel en prijs van elk boek op de pagina eruitVerwachte flow: instructie verzonden → agent neemt een snapshot (identificeert paginაეlementen met genummerde referenties) → agent extraheert data → gestructureerde output terug als JSON of CSV.

Een tip uit ervaring: begin met doodsimpele prompts. Te veel detail kan de AI juist in de war brengen — voeg extra uitleg pas toe als de agent je eerste instructie verkeerd interpreteert.

Voor 20 boeken op de eerste pagina kun je ongeveer 30–60 seconden verwachten. Gestructureerde data terug? Dan werkt je OpenClaw browser automation-setup.

OpenClaw browser automation op Windows: de native setup-route

De meeste OpenClaw-gidsen gaan uit van macOS of Linux. Als je op Windows zit, heb je dat vast al gemerkt. Een forumgebruiker verwoordde het perfect: “veel oplossingen leken conceptueel sterk, maar geen enkele was ontworpen voor native Windows.”

Dit is wat echt werkt.

Optie A: Chrome Remote Debugging op Windows (aanbevolen native route)

De meest betrouwbare Windows-native aanpak. Open PowerShell en start Chrome met remote debugging aan:

1& "C:\Program Files\Google\Chrome\Application\chrome.exe" --remote-debugging-port=9222Als Chrome niet op dat pad staat, probeer dan:

1# Controleer alternatieve locaties

2Get-ChildItem "C:\Program Files*\Google\Chrome\Application\chrome.exe" -Recurse

3# Of controleer AppData

4& "$env:LOCALAPPDATA\Google\Chrome\Application\chrome.exe" --remote-debugging-port=9222Stel daarna OpenClaw in om via Remote CDP te verbinden door cdpUrl op ws://localhost:9222 te zetten in je openclaw.json-configuratie.

Optie B: Docker Desktop als Windows-fallback

Als de native route problemen geeft, kan Docker Desktop op Windows een headless Chromium-container draaien:

1docker run -d --name openclaw-browser -p 9222:9222 --shm-size=2g browserless/chrome

2# Verwijs OpenClaw naar: cdpUrl: "ws://localhost:9222"Het voegt nog een extra laag complexiteit toe, maar is voor sommige gebruikers stabieler. Het werkt, maar elegant is het niet.

Windows-specifiek foutoverzicht

| Fout | Oorzaak | Oplossing (PowerShell) |

|---|---|---|

| Poort 9222 is al in gebruik | Er staat al een andere DevTools-sessie open | Get-Process -Id (Get-NetTCPConnection -LocalPort 9222).OwningProcess | Stop-Process -Force |

| Chrome-binary niet gevonden | Verkeerd pad | Get-ChildItem "C:\Program Files*\Google\Chrome\Application\chrome.exe" -Recurse |

| Tailscale connection refused | Windows Firewall blokkeert | New-NetFirewallRule -DisplayName "OpenClaw" -Direction Inbound -LocalPort 18789 -Protocol TCP -Action Allow |

| npm-permissiefouten | Niet als admin uitgevoerd | Start PowerShell als Administrator, of gebruik nvm-windows |

Alle commando’s hierboven zijn PowerShell, niet bash. Je kunt ze direct kopiëren en plakken.

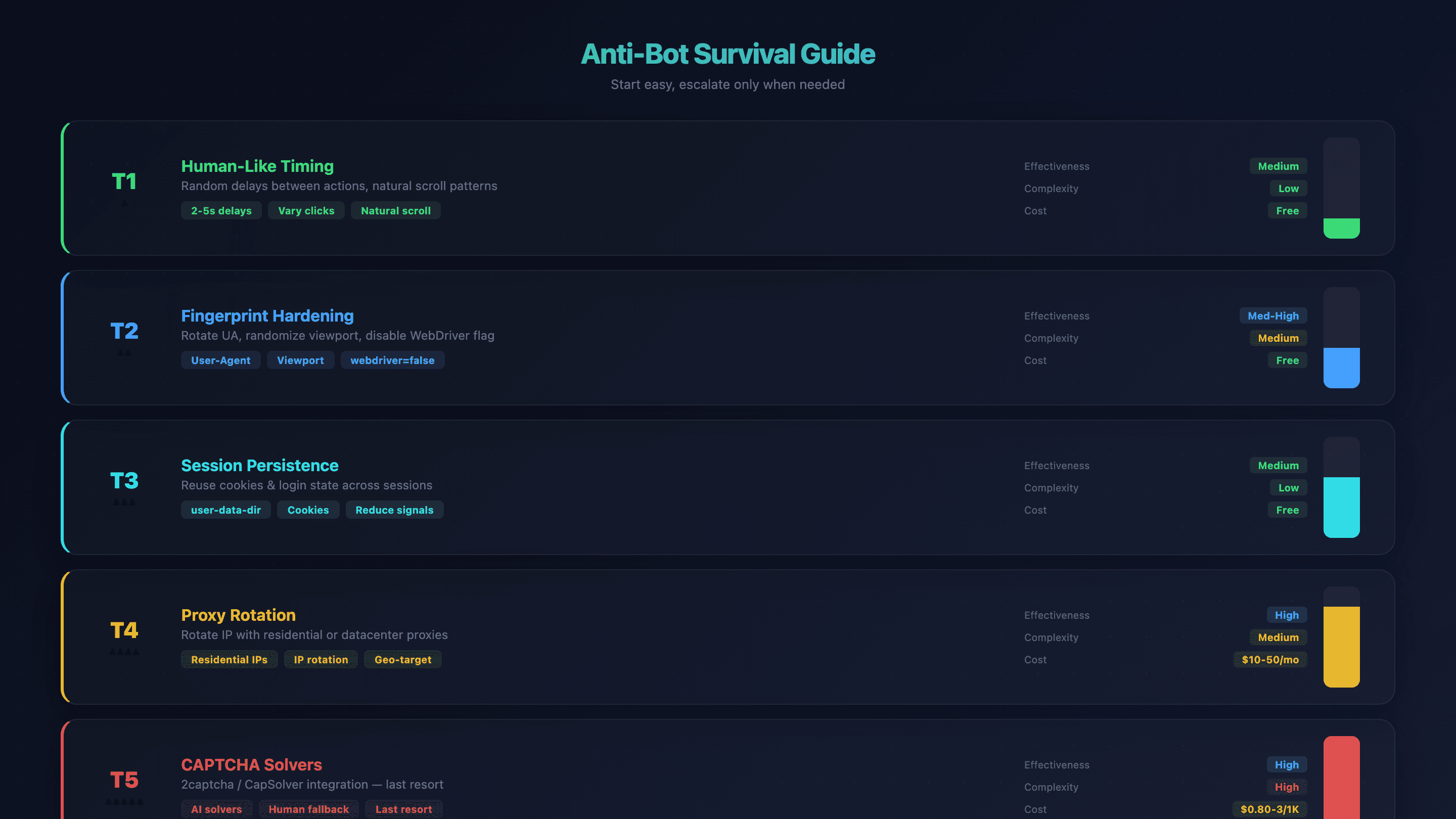

Overlevingsgids tegen anti-bots voor OpenClaw browser automation

Botdetectie is voor OpenClaw-gebruikers de grootste frustratie. De standaard Chromium van OpenClaw heeft — sites herkennen het via de WebDriver-flag, schermafmetingen, fontfingerprinting en IP-reputatie. Ik heb agents op sommige sites binnen enkele seconden geblokkeerd zien worden.

Maar je kunt in lagen werken. Begin met de makkelijkste oplossing en schaal alleen op als dat nodig is.

Laag 1: menselijk timing- en gedragspatroon

Voeg willekeurige pauzes toe tussen acties in je prompts. In plaats van klikken op machinesnelheid, instrueer je de agent bijvoorbeeld: “wacht 2–5 seconden tussen elke klik.” De AI varieert timing sowieso al enigszins, maar expliciete instructies helpen.

Effectiviteit: gemiddeld | Complexiteit: laag | Kosten: gratis

Laag 2: fingerprint verharden

Wissel user-agent strings af, randomiseer de viewportgrootte en laat OpenClaw de navigator.webdriver-flag automatisch uitschakelen (via --disable-blink-features=AutomationControlled).

1# Aangepaste headers instellen

2openclaw browser set headers --headers-json '{"User-Agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 Chrome/124.0.0.0 Safari/537.36"}'

3# Viewport randomiseren

4openclaw browser set viewport 1366 768

5# Tijdzone en taal instellen

6openclaw browser set timezone America/New_York

7openclaw browser set locale en-USVoor diepere anti-detectie raadt de community Camoufox aan (een op Firefox gebaseerde anti-detect-browser met fingerprintspoofing op C++-engineniveau).

Effectiviteit: gemiddeld-hoog | Complexiteit: middel | Kosten: gratis

Laag 3: sessiebehoud

Gebruik user-data-dir om cookies en loginstatus tussen sessies te behouden. Daarmee verminder je signalen van een “verse browser” die anti-botsystemen vaak triggeren.

1openclaw config set browser.profiles.persistent.userDataDir "/path/to/chrome-profile"

2openclaw config set browser.profiles.persistent.cdpPort 18802Effectiviteit: gemiddeld | Complexiteit: laag | Kosten: gratis

Laag 4: proxyrotatie

Als timing en fingerprinting niet genoeg zijn, roteer dan je IP-adres. Residential proxies zijn lastiger te detecteren; datacenterproxies zijn sneller en goedkoper.

1export OPENCLAW_BROWSER_PROXY="http://user:pass@proxy.example.com:8080"Let op: proxyconfiguratie op browserniveau is nog steeds een feature request (GitHub Issue #8079). Voorlopig moeten proxies op OS- of omgevingsniveau worden ingesteld.

| Provider | Residential | Datacenter | Beste voor | |---|---|---|---| | Bright Data | $4–8.40/GB | $0.43–0.60/GB | Enterprise, hoogste kwaliteit | | Oxylabs | $6–8/GB | $0.48–5/GB | Scrapen op grote schaal | | Decodo (Smartproxy) | $4–5.50/GB | $0.70–5/GB | Middelgroot budget | | IPRoyal | $5–7/GB | -- | Budgetvriendelijk | | DataImpulse | $1/GB | -- | Laagste kosten |

Effectiviteit: hoog | Complexiteit: middel | Kosten: $10–50/maand

Laag 5: CAPTCHA-solvers

Als laatste redmiddel. Koppel diensten zoals 2captcha of CapSolver.

| Service | reCAPTCHA v2 | Cloudflare Turnstile | Latency | |---|---|---|---| | 2Captcha | $2.99/1K | $2.99/1K | 15–45s (menselijke oplosser) | | CapSolver | $0.80–1.50/1K | $0.80/1K | 0.5–10s (AI) |

FlareSolverr (open-source Cloudflare-bypass) wordt in 2025–2026 als onbetrouwbaar omschreven vanwege de steeds sterkere verdedigingsmechanismen van Cloudflare.

Effectiviteit: hoog | Complexiteit: hoog | Kosten: $0.80–3/1K oplossingen

Samenvatting anti-bot tabel

| Techniek | Effectiviteit | Complexiteit | Kosten | |---|---|---|---| | Menselijke timing | Gemiddeld | Laag | Gratis | | Fingerprint verharden | Gemiddeld-hoog | Middel | Gratis | | Sessiebehoud | Gemiddeld | Laag | Gratis | | Proxyrotatie | Hoog | Middel | $10–50/maand | | CAPTCHA-solvers | Hoog | Hoog | $0.80–3/1K oplossingen |

Voor gebruikers die steeds tegen anti-botmuren aanlopen en gewoon de data nodig hebben: de cloudscraping van handelt anti-bot voor openbare websites direct af — geen proxyconfiguratie, geen fingerprint-tuning. Het is een fundamenteel andere aanpak (AI leest de site telkens via beheerde cloudinfrastructuur) die de hele anti-bot-wapenwedloop omzeilt voor standaard data-extractie.

Echte output: wat OpenClaw browser automation nu eigenlijk oplevert

Voordat je 45–75 minuten setup-tijd investeert, wil je waarschijnlijk weten hoe het eindresultaat eruitziet. Terecht — hier zijn drie workflowvoorbeelden met echte output.

Voorbeeld 1: webscraping — productdata extraheren

Prompt: “Ga naar https://books.toscrape.com en haal de titel en prijs van elk boek op de pagina eruit”

Output (eerste 5 rijen):

| Titel | Prijs | |---|---| | A Light in the Attic | £51.77 | | Tipping the Velvet | £53.74 | | Soumission | £50.10 | | Sharp Objects | £47.82 | | Sapiens: A Brief History of Humankind | £54.23 |

Verstreken tijd: ~45 seconden voor 20 rijen (één pagina). Voor paginering was een vervolginstructie nodig: “Klik op de Next-knop en herhaal dit voor 5 pagina’s.” Totaal: ~100 rijen in ongeveer 3 minuten.

Voorbeeld 2: formulierautomatisering — een webformulier met meerdere velden invullen

Scenario: een leveranciersaanvraagformulier invullen met bedrijfsnaam, contactgegevens en interesse in producten.

De agent neemt een snapshot van het formulier, identificeert elk veld via een referentienummer en vult ze achter elkaar in. Voor: lege formuliervelden. Na: alle velden ingevuld, bevestigingsmelding zichtbaar. Eventuele dropdowns of selectievakjes worden door het snapshotsysteem afgehandeld — de agent “ziet” de opties en selecteert de juiste.

Verstreken tijd: ~30 seconden voor een formulier met 6 velden.

Voorbeeld 3: paginering — scrapen over meerdere pagina’s

Eerste resultaat: 20 rijen van pagina 1. Na de instructie “klik op Next en herhaal voor alle pagina’s”: 1.000 rijen over 50 pagina’s op books.toscrape.com. De agent detecteert de “Next”-knop via een snapshot en klikt er in een lus op.

Verstreken tijd: ~12 minuten voor de volledige dataset van 1.000 rijen.

Zij aan zij: dezelfde scrapingtaak in Thunderbit

Voor hetzelfde books.toscrape.com-voorbeeld ziet de workflow er in zo uit:

- Installeer de (~30 seconden)

- Navigeer naar de pagina

- Klik op “AI Suggest Fields” → AI herkent Title, Price, Availability, Rating

- Klik op “Scrape” → 20 rijen uitgelezen

- Gebruik de pagineringsopties → alle pagina’s scrapen

- Exporteer naar Google Sheets (gratis)

Totale tijd: ~3 minuten van nul naar geëxporteerde data, zonder VPS, zonder CLI, zonder configuratie.

Het punt is niet dat de ene tool “beter” is. De juiste keuze hangt af van wat je precies wilt doen.

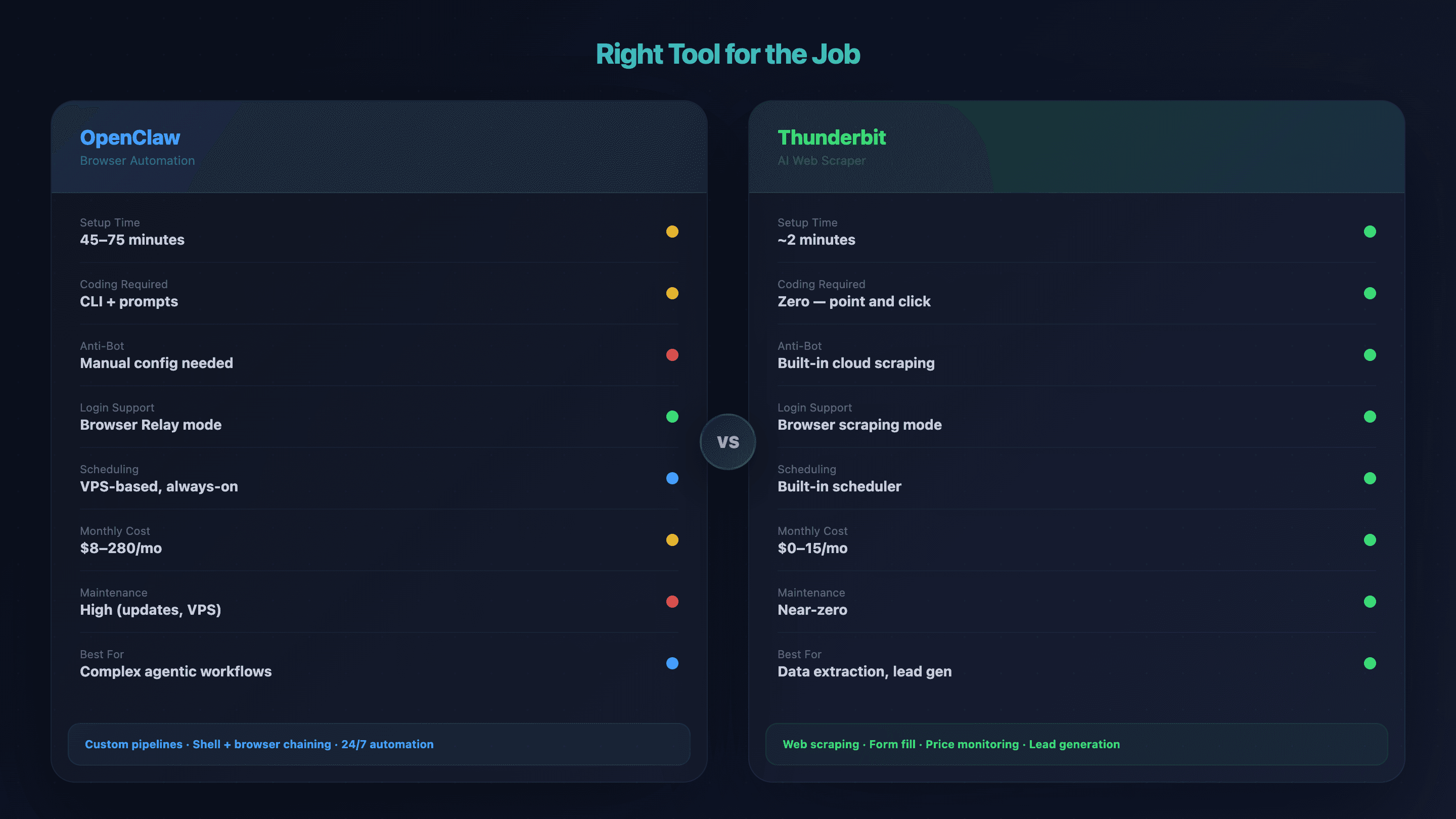

Wanneer OpenClaw browser automation te zwaar is (en wat je dan beter kunt gebruiken)

OpenClaw blinkt uit in complexe, meerstaps, agentische automatisering — workflows achter login, browseracties koppelen aan shellcommando’s, 24/7 draaien op een VPS. Maar als het doel is “productdata van een listingpagina halen” of “e-mails uit een directory trekken”, dan is de volledige stack met VPS + Tailscale + node host waarschijnlijk overkill.

Ik heb mensen 60+ minuten setup zien investeren voor een taak die met een simpeler tool in 2 minuten klaar is. Geen goede ruil.

De juiste tool voor de klus: vergelijkingstabel

| Factor | OpenClaw browser automation | Thunderbit | |---|---|---| | Insteltijd | 45–75 min (VPS + Tailscale + node host) | ~2 min (Chrome-extensie installeren) | | Code vereist | CLI + natuurlijke taalprompts | Geen — klik op “AI Suggest Fields” → “Scrape” | | Anti-botafhandeling | Handmatig (proxy, fingerprintconfiguratie) | Ingebouwde cloudscraping | | Navigeren achter login | ✅ Browser Relay / remote debug | ✅ Browser scraping-modus | | Verrijking van subpagina’s | Per workflow eigen scripting | Subpagina’s met 1 klik scrapen | | Geplande / 24×7-runs | VPS-gebaseerd, altijd aan | Ingebouwde | | Maandelijkse kosten | $8–14 (hobby) tot $110–280 (zwaar gebruik) | $0 (gratis tier) tot $15/maand | | Onderhoudslast | Hoog (updates, VPS, debugging) | Bijna nul — AI past zich aan layoutwijzigingen aan | | Beste voor | Complexe agentische workflows, custom pipelines | Data-extractie, formulieren invullen, leadgeneratie, prijsmonitoring |

Use-case routing

- Je hebt meerstaps agentische workflows nodig die browseracties combineren met shellcommando’s, messaging-apps en databases → OpenClaw is dan de juiste keuze.

- Je wilt data van websites scrapen, formulieren invullen of prijzen monitoren zonder een terminal aan te raken → brengt je sneller waar je moet zijn. Bekijk ook het voor snelle demo’s.

- Je hebt een licht script nodig voor één specifieke API-endpoint → een simpele Python-script met requests kan al genoeg zijn.

Dat is echt het denkkader dat ik gebruik wanneer iemand in mijn team vraagt: “welke tool moeten we hiervoor gebruiken?”

Veelvoorkomende OpenClaw browser automation-fouten en hoe je ze oplost

Sla dit gedeelte op. Het is gesorteerd op symptoom, zodat je met Ctrl+F snel de juiste fix vindt.

“Connection Refused” of Node Host maakt geen verbinding

Waarschijnlijke oorzaken (controleer in deze volgorde):

- Tailscale draait niet op beide apparaten → voer

tailscale statusuit op beide - Gateway luistert niet op het Tailscale-netwerk (nog steeds op localhost) →

openclaw config set gateway.listen "100.x.x.x:18789" - Verkeerd IP-adres → controleer met

tailscale ip -4 - Firewall blokkeert poort 18789 →

sudo ufw allow 18789/tcp(Linux) of voeg een Windows Firewall-regel toe

Extensiebadge blijft “OFF” of tab wordt niet gedetecteerd

- Extensie niet geladen in Developer mode →

chrome://extensions→ Developer mode aanzetten → herladen - Node host draait niet → herstart met

openclaw node start - Conflict met Chrome-instantie → sluit alle Chrome-instanties, start opnieuw en laad de extensie opnieuw

Agent geeft lege of verkeerde data terug

- Pagina is nog niet volledig geladen: zeg tegen de agent dat hij “3 seconden moet wachten na het navigeren voordat hij extraheert.” Veel SPA’s hebben tijd nodig om te renderen.

- Anti-botblokkade: controleer of je een CAPTCHA-pagina ziet in plaats van echte content. Schakel van Sandbox Chromium naar Browser Relay.

- Verouderde snapshot: vraag de agent om “een nieuwe snapshot te maken” — referentienummers worden na navigatie ongeldig.

“Port 9222 Already in Use”

Komt vaak voor als Chrome DevTools of een andere automatiseringstool die poort al gebruikt.

1# macOS/Linux

2lsof -i :9222 | grep LISTEN

3kill -9 <PID>

4# Windows PowerShell

5Get-Process -Id (Get-NetTCPConnection -LocalPort 9222).OwningProcess | Stop-Process -ForceVPS raakt door het geheugen heen

Elke headless browserinstance gebruikt 400–800 MB RAM. Meerdere tegelijk draaien kan een kleine VPS laten crashen.

Oplossingen:

- Schakel het laden van afbeeldingen/CSS/fonts uit:

openclaw browser network route --abort "**/*.{png,jpg,gif,css,woff2}" - Beperk het aantal gelijktijdige instances tot wat je RAM aankan

- Stel

shm_size: '2gb'in bij Docker-configuraties - Schakel sessie-hibernatie in:

OPENCLAW_HIBERNATE_AFTER=300 - Upgrade naar een VPS met 4 GB+ RAM als je meer ruimte nodig hebt

Tips om je OpenClaw browser automation soepel te laten draaien

Een paar best practices die ik door de tijd heen heb geleerd bij dit soort setups:

- Schakel afbeeldingen, stylesheets en fonts uit bij scraping-taken die alleen data nodig hebben. Dat verlaagt het verbruik flink en versnelt alles.

- Herbruik browserinstances in plaats van voor elke taak een nieuwe te starten. Verse instances kosten veel RAM en triggeren vaker anti-botsignalen.

- Begin met simpele prompts. Voeg extra details pas toe als de agent je verkeerd begrijpt. Te veel uitleg kan de AI juist in verwarring brengen.

- Monitor het resourcegebruik van je VPS (CPU, RAM) en schaal op voordat je limieten raakt. Een gecrashte VPS om 2 uur ’s nachts debuggen is geen pretje.

- Houd OpenClaw en de Chrome-extensie up-to-date — maar test updates eerst in een stagingomgeving. OpenClaw brengt ongeveer uit, en niet alles verloopt vlekkeloos.

- Voor terugkerende taken (dagelijkse prijschecks, wekelijkse lead-opvragingen) laat Thunderbit’s je met gewone taal intervallen instellen, zodat je VPS-onderhoud volledig kunt vergeten.

Ethische en juridische aandachtspunten

Kort, maar belangrijk. Respecteer robots.txt (vastgelegd als IETF-standaard in ), beperk je requesttempo, bekijk de gebruiksvoorwaarden van doelwebsites en behandel persoonsgegevens volgens de AVG/privacywetgeving. Het precedent (2022) stelde vast dat scrapen van openbaar toegankelijke data niet in strijd is met de CFAA, maar dat betekent niet dat alles zomaar mag. Verantwoord automatiseren beschermt zowel jou als je bedrijf. Lees voor meer hierover onze gids over .

Afronding

OpenClaw browser automation is een krachtige optie voor complexe, meerstaps webworkflows die via natuurlijke taal worden aangestuurd. Dit is wat het belangrijkst is:

- Kies vooraf de juiste browsermodus (Sandbox, Relay, Remote CDP) — die ene keuze bespaart je uren debuggen.

- Windows-gebruikers hebben een werkbare route, maar je moet wel Windows-specifieke commando’s volgen en letten op firewall- en padproblemen.

- Anti-botafhandeling is een echte uitdaging — begin met de eenvoudigste technieken (timing, fingerprinting) en schaal alleen op als dat nodig is.

- Bekijk de output vóór je je vastlegt. Als gestructureerde data van een listingpagina alles is wat je nodig hebt, brengt een no-code tool zoals je binnen enkele minuten zonder onderhoud op weg.

- Reserveer budget voor onderhoud. OpenClaw brengt ongeveer 13 releases per maand uit, VPS-kosten tellen op en debuggen hoort erbij.

Als je eerst de eenvoudige route wilt proberen, biedt — installeer de extensie, scrape een pagina en kijk of dat jouw use case afdekt voordat je in een volledige VPS-setup stapt. Ga je toch voor OpenClaw, zet deze gids dan in je favorieten. Je zult dat foutenoverzicht uiteindelijk nodig hebben — en moge je browserinstances altijd genoeg RAM hebben.

FAQ’s

Wat is het verschil tussen OpenClaw Sandbox Chromium en Browser Relay?

Sandbox Chromium draait een headless browser op de server — snel en met weinig setup, maar het maakt elke keer een nieuw profiel aan (dus geen login-sessies) en is beter detecteerbaar voor anti-botsystemen. Browser Relay stuurt instructies naar je echte Chrome-browser op je lokale machine, waardoor logins worden ondersteund, je echte browserfingerprint wordt gebruikt en websites het lastiger vinden om het als automatisering te herkennen. De keerzijde is dat Browser Relay langzamer is door de netwerkrelay en enkele featurebeperkingen heeft (geen batchacties, geen download-interceptie).

Kan ik OpenClaw browser automation op Windows draaien zonder WSL?

Ja, maar met kanttekeningen. De meest betrouwbare native Windows-route is Chrome Remote Debugging via PowerShell (chrome.exe --remote-debugging-port=9222). Docker Desktop is een fallback als dat onbetrouwbaar blijkt. Volledige native ondersteuning voor de Node Host op Windows kan nog wat rafelig zijn — check de actuele docs en reken op Windows-specifieke issues zoals firewallblokkades en verschillen in binaire paden. Elk commando in het Windows-gedeelte van deze gids is PowerShell, geen bash.

Hoe ga ik om met CAPTCHA’s in OpenClaw browser automation?

Begin met het verlagen van detectierisico: voeg menselijk ogende timing toe, verstevig je browserfingerprint en gebruik sessiebehoud om signalen van een verse browser te vermijden. Blijven CAPTCHA’s terugkomen, koppel dan een solverdienst zoals 2captcha ($2.99/1K oplossingen) of CapSolver ($0.80–1.50/1K, AI-aangedreven). Voor openbare websites waar je alleen de data nodig hebt, handelt Thunderbit’s cloudscraping anti-bot automatisch af zonder proxy- of CAPTCHA-configuratie.

Is OpenClaw browser automation gratis te gebruiken?

OpenClaw zelf is open-source (MIT-licentie) en gratis. Maar om het te draaien heb je infrastructuur nodig — een VPS van $4–15 per maand, plus optionele diensten zoals proxyrotatie ($10–50 per maand) of CAPTCHA-solvers (betaling per oplossing). De totale maandkosten lopen uiteen van $8–14 voor hobbygebruik tot $110–280 voor zware automatiseringsworkloads. Ter vergelijking: dekt basaal scrapen zonder infrastructuurkosten.

Wat moet ik doen als mijn OpenClaw-agent steeds lege resultaten teruggeeft?

Controleer drie dingen, in deze volgorde: Ten eerste kan de pagina nog niet volledig geladen zijn — zeg tegen de agent dat hij “3 seconden moet wachten na het navigeren voordat hij extraheert.” Ten tweede kun je tegen een anti-botmuur aanlopen — als de agent een CAPTCHA-pagina ziet in plaats van echte content, schakel dan van Sandbox Chromium naar Browser Relay. Ten derde kunnen de snapshots verouderd zijn — vraag de agent om “een nieuwe snapshot te maken” na elke navigatie. Werkt geen van deze drie, kijk dan naar het geheugengebruik van je VPS — een gecrashte browserinstance geeft vaak stilletjes lege resultaten terug.