Webscraping is tegenwoordig niet meer alleen iets voor techneuten; het is een must-have skill voor iedereen die zich bezighoudt met sales, operations of marktonderzoek. De hoeveelheid webdata groeit als kool—tussen 2019 en 2023 is de hoeveelheid data wereldwijd met bijna . Geen wonder dat data als het kloppend hart van hun beslissingen ziet. Maar er zit een addertje onder het gras: vindt het verwerken van ongestructureerde data (zoals rommelige HTML) een flinke uitdaging. Ik heb genoeg teams gezien die eindeloos zitten te knippen en plakken om webinfo in spreadsheets te krijgen—geloof me, daar word je niet vrolijk van.

En daar komt Python’s BeautifulSoup om de hoek kijken. In deze praktische gids laat ik je stap voor stap zien hoe je BeautifulSoup inzet voor webscraping, inclusief een concreet Python Beautiful Soup voorbeeld dat je direct kunt gebruiken voor jouw bedrijf. En omdat ik graag slim werk (en niet harder), laat ik ook zien hoe je BeautifulSoup combineert met , onze AI-webscraper, zodat je workflow sneller én je data direct netjes gestructureerd is—ook als je geen programmeur bent.

Wat is BeautifulSoup en waarom gebruiken voor webscraping?

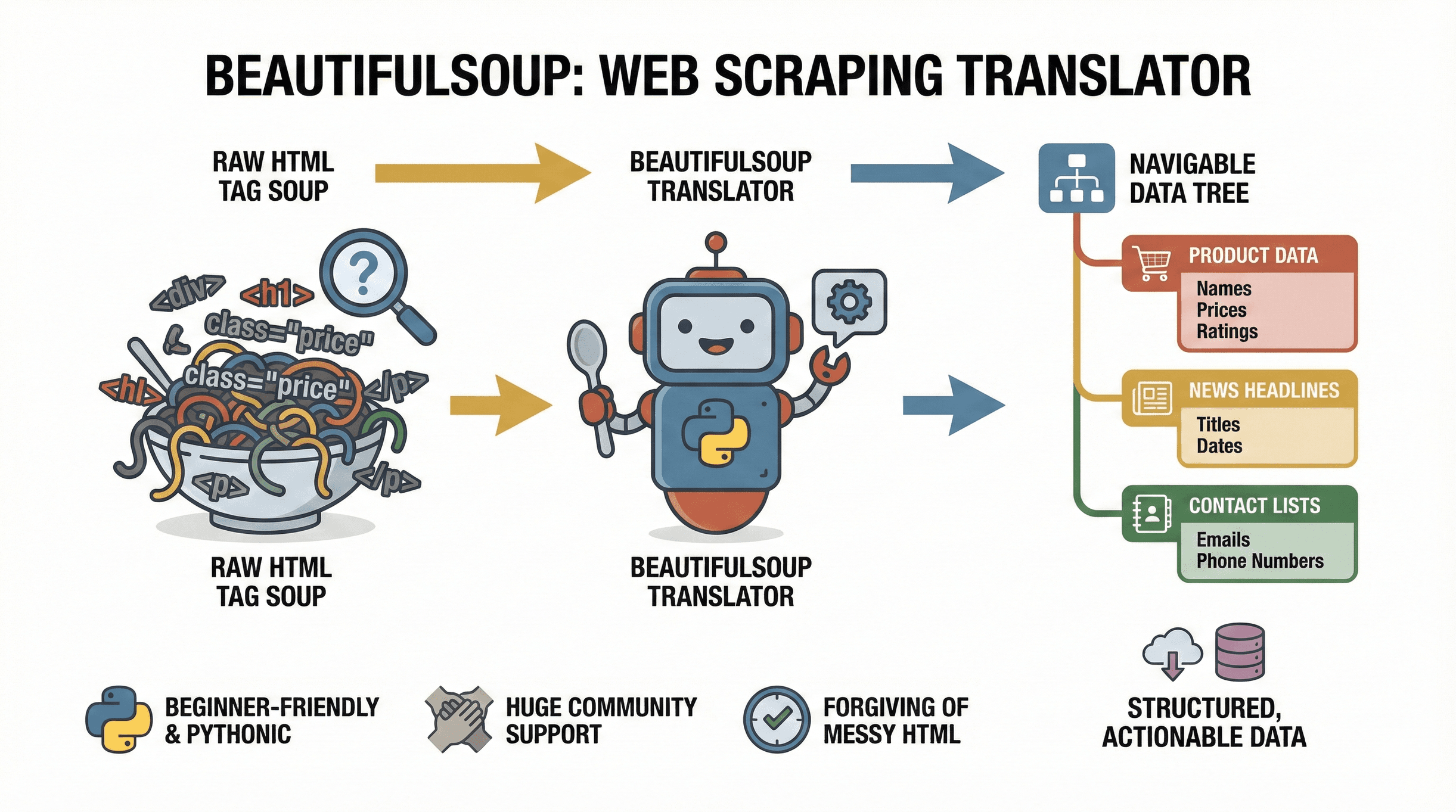

Laten we bij het begin beginnen. is een Python-bibliotheek waarmee je makkelijk HTML- en XML-documenten kunt ontleden. Zie het als een soort vertaler: het verandert de ‘tag-soep’ van een webpagina in een overzichtelijke boomstructuur, zodat je snel de data kunt vinden, ophalen en bewerken die je nodig hebt. Of je nu productprijzen uit een webshop wilt halen, nieuwsberichten wilt verzamelen of bedrijfsgegevens uit directories wilt scrapen—BeautifulSoup is dé tool om webpagina’s om te zetten in bruikbare, gestructureerde data.

Laten we bij het begin beginnen. is een Python-bibliotheek waarmee je makkelijk HTML- en XML-documenten kunt ontleden. Zie het als een soort vertaler: het verandert de ‘tag-soep’ van een webpagina in een overzichtelijke boomstructuur, zodat je snel de data kunt vinden, ophalen en bewerken die je nodig hebt. Of je nu productprijzen uit een webshop wilt halen, nieuwsberichten wilt verzamelen of bedrijfsgegevens uit directories wilt scrapen—BeautifulSoup is dé tool om webpagina’s om te zetten in bruikbare, gestructureerde data.

Waarom is het zo populair? Allereerst is het super toegankelijk voor beginners. BeautifulSoup kan prima overweg met rommelige HTML (en geloof me, dat kom je overal tegen), en dankzij de Python-achtige syntax kun je met een paar regels code al aan de slag. Bovendien is er een grote community en veel documentatie—dus als je vastloopt, is hulp zo gevonden.

Typische toepassingen van BeautifulSoup zijn bijvoorbeeld:

- Productnamen, prijzen en reviews uit webshops halen

- Nieuwsberichten, auteurs en publicatiedata van nieuwssites verzamelen

- Tabellen of bedrijfs-/contactlijsten uitlezen

- E-mailadressen of telefoonnummers van advertentieplatforms verzamelen

- Prijswijzigingen, nieuwe vacatures of andere updates monitoren

Staat je data in statische HTML? Dan is BeautifulSoup je beste maatje voor webscraping.

De unieke voordelen van BeautifulSoup voor webscraping

Er zijn veel Python-bibliotheken voor webscraping—waarom zou je BeautifulSoup kiezen? Dit zijn de belangrijkste pluspunten:

- Eenvoud: BeautifulSoup is lichtgewicht en makkelijk te leren. Je hoeft geen compleet framework op te tuigen of veel standaardcode te schrijven. Ideaal voor snelle, eenmalige klusjes of als je net begint.

- Tolerantie: Het kan omgaan met kapotte of slecht opgebouwde HTML, wat vaker voorkomt dan je denkt.

- Flexibiliteit: Je zit niet vast aan een strakke structuur. Geef gewoon HTML aan BeautifulSoup en haal eruit wat je nodig hebt.

- Integratie: BeautifulSoup werkt goed samen met andere Python-bibliotheken zoals

requests(voor het ophalen van webpagina’s),csv(voor het opslaan van data) enpandas(voor data-analyse).

Hoe verhoudt het zich tot andere tools?

| Tool | Beste voor | Voordelen | Nadelen |

|---|---|---|---|

| BeautifulSoup | Statische HTML, beginners | Simpel, snel op te zetten, tolerant, flexibel | Niet geschikt voor JavaScript-rijke sites |

| Scrapy | Grootschalige, asynchrone taken | Krachtig, schaalbaar, ingebouwde crawler | Steilere leercurve, meer configuratie |

| Selenium | JavaScript/dynamische content | Kan met JS omgaan, formulieren invullen, klikken | Langzamer, zwaarder, meer resources |

Ben je net begonnen of wil je snel statische pagina’s uitlezen? BeautifulSoup is het Zwitsers zakmes van webscraping (). Voor complexere of dynamische sites kun je het combineren met Selenium of Scrapy—maar BeautifulSoup is de beste manier om de basis te leren.

Je Python-omgeving instellen voor BeautifulSoup

Klaar om te starten? Zo zet je je omgeving op:

-

Installeer Python: Download de nieuwste versie via .

-

Maak een virtuele omgeving aan (optioneel, maar handig):

1python -m venv venv 2source venv/bin/activate # Op Windows: venv\Scripts\activate -

Installeer BeautifulSoup en afhankelijkheden:

1pip install beautifulsoup4 requests lxml html5libbeautifulsoup4: De hoofd-bibliotheekrequests: Voor het ophalen van webpagina’slxmlofhtml5lib: Snellere/betrouwbaardere HTML-parsers

-

Tips bij problemen:

- Krijg je een “pip not found” foutmelding? Probeer

pip3ofpy -m pip. - Op Mac/Linux heb je soms

sudonodig voor rechten. - Op Windows: zorg dat Python aan je PATH is toegevoegd.

- Krijg je een “pip not found” foutmelding? Probeer

Test je installatie met deze korte check:

1from bs4 import BeautifulSoup

2import requests

3html = requests.get("http://example.com").text

4soup = BeautifulSoup(html, "html.parser")

5print(soup.title)Zie je <title>Example Domain</title>? Dan zit je goed ().

Stapsgewijs Beautiful Soup Python voorbeeld

Laten we een praktisch voorbeeld bekijken. Stel, je wilt de laatste nieuwsheadlines van een publieke nieuwssite ophalen. Zo pak je dat aan:

1. Haal de webpagina op

1import requests

2from bs4 import BeautifulSoup

3url = "https://www.bbc.com/news"

4response = requests.get(url)

5html = response.text2. Parse de HTML

1soup = BeautifulSoup(html, "html.parser")3. Inspecteer de HTML-structuur

Open de ontwikkelaarstools van je browser (rechtsklik → Inspecteren) en zoek naar de tags die de headlines bevatten. Op veel nieuwssites staan headlines in <h3>-tags met specifieke klassen.

Bijvoorbeeld:

1<h3 class="gs-c-promo-heading__title">Headline Title</h3>4. Haal de data eruit

1headlines = soup.find_all("h3", class_="gs-c-promo-heading__title")

2for h in headlines:

3 print(h.get_text(strip=True))Dit print alle nieuwsheadlines op de pagina.

5. Sla de data op in CSV

Sla de headlines op voor latere analyse:

1import csv

2with open("headlines.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.writer(file)

4 writer.writerow(["headline"])

5 for h in headlines:

6 writer.writerow([h.get_text(strip=True)])Nu heb je een CSV-bestand dat je zo in Excel of Google Sheets kunt openen.

HTML-structuur begrijpen voor effectieve data-extractie

Voordat je code schrijft, inspecteer altijd eerst de HTML van de pagina. Zo doe je dat:

- Open de ontwikkelaarstools: Rechtsklik op de pagina en kies “Inspecteren”.

- Zoek de data: Beweeg met je muis over elementen om te zien welke tags de info bevatten die je zoekt (bijv. headlines, prijzen, auteurs).

- Noteer tags en klassen: Let op unieke identifiers zoals

class="product-title"ofid="main-content". - Test je selectors: Gebruik de

.find(),.find_all()of.select()methodes van BeautifulSoup om die elementen te targeten.

Tip: Gebruik soup.prettify() om een leesbare versie van de HTML in je Python-console te printen.

Data extraheren en structureren met BeautifulSoup

Stel, je wilt zowel titels als auteurs van een blogpagina halen:

1articles = soup.find_all("article")

2data = []

3for article in articles:

4 title = article.find("h2").get_text(strip=True)

5 author = article.find("span", class_="author").get_text(strip=True)

6 data.append({"title": title, "author": author})Nu heb je een lijst met dictionaries—ideaal om te exporteren naar CSV of verder te analyseren.

Je kunt ook links, afbeeldingen of andere attributen zo ophalen:

1for link in soup.find_all("a"):

2 print(link.get("href"))Of afbeeldingen:

1for img in soup.find_all("img"):

2 print(img.get("src"))Data opslaan: van Python naar Excel of CSV

Heb je je data gestructureerd? Exporteren is simpel. Zo doe je dat met het csv-module:

1import csv

2with open("articles.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.DictWriter(file, fieldnames=["title", "author"])

4 writer.writeheader()

5 for row in data:

6 writer.writerow(row)Of, als je liever met pandas werkt:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv("articles.csv", index=False)

4df.to_excel("articles.xlsx", index=False)Gebruik altijd UTF-8 encoding om problemen met speciale tekens te voorkomen, zeker bij internationale data.

Praktijkvoorbeeld: nieuwsdata scrapen met BeautifulSoup

Laten we een concreet voorbeeld doorlopen: artikel-titels, auteurs en publicatiedata van een nieuwssite scrapen.

Stel, je wilt scrapen voor artikeldata:

1import requests

2from bs4 import BeautifulSoup

3import csv

4url = "https://edition.cnn.com/world"

5response = requests.get(url)

6soup = BeautifulSoup(response.content, "html.parser")

7articles = soup.find_all("article")

8data = []

9for article in articles:

10 title_tag = article.find("h3")

11 date_tag = article.find("span", class_="date")

12 author_tag = article.find("span", class_="author")

13 title = title_tag.get_text(strip=True) if title_tag else ""

14 date = date_tag.get_text(strip=True) if date_tag else ""

15 author = author_tag.get_text(strip=True) if author_tag else ""

16 data.append({"title": title, "date": date, "author": author})

17with open("cnn_articles.csv", "w", newline='', encoding="utf-8") as file:

18 writer = csv.DictWriter(file, fieldnames=["title", "date", "author"])

19 writer.writeheader()

20 for row in data:

21 writer.writerow(row)Dit script haalt de nieuwste artikelen op, pakt titel, datum en auteur, en slaat ze op in een CSV. Je kunt deze data gebruiken voor concurrentieanalyse, trendonderzoek of contentanalyse—wat je maar wilt.

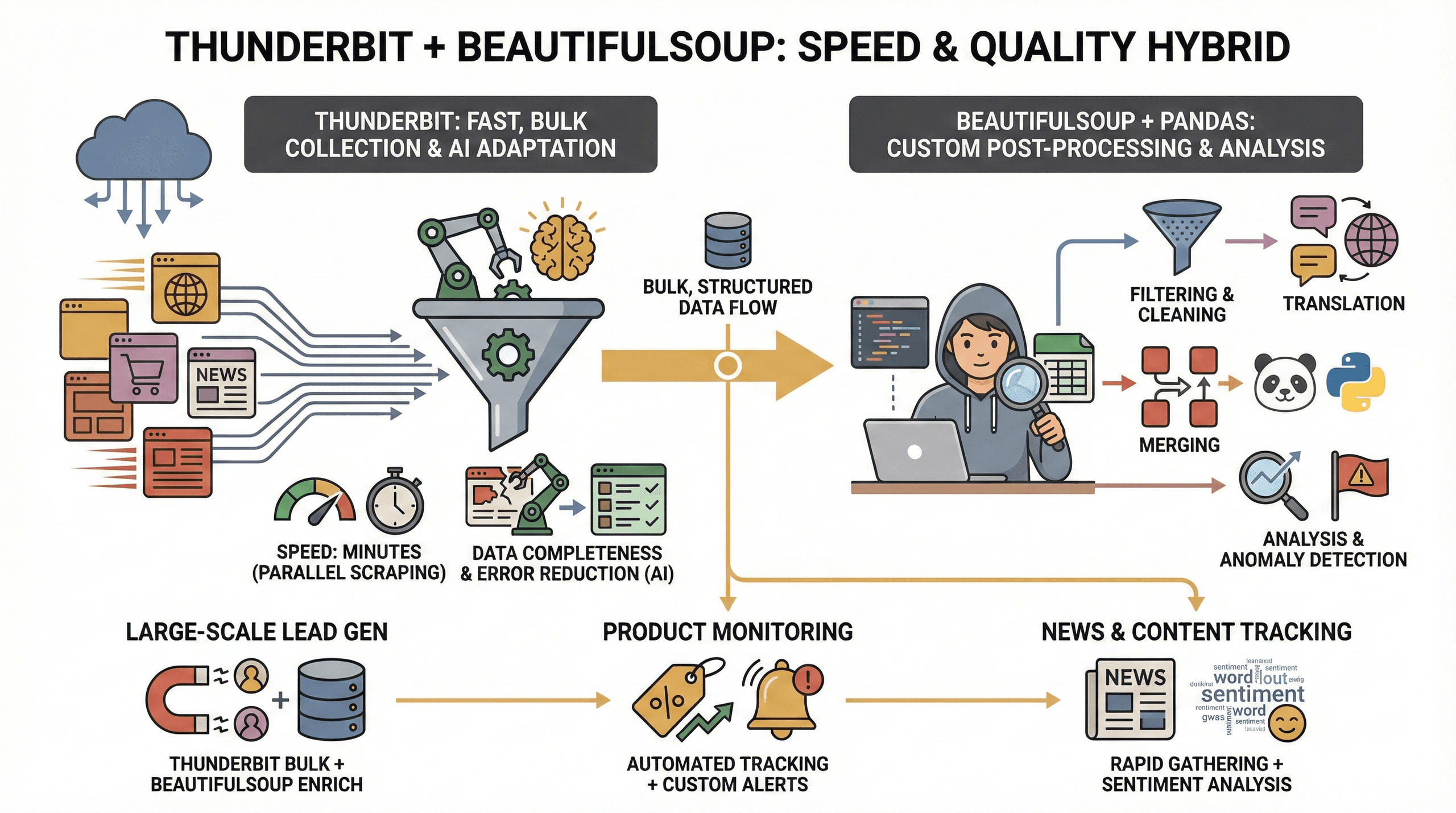

Je workflow verbeteren: BeautifulSoup combineren met Thunderbit

Tijd om je scrapingproces nog slimmer te maken. is een AI-webscraper Chrome-extensie die het giswerk uit data-extractie haalt. Met Thunderbit kun je:

- Gebruik “AI Suggest Fields”: Thunderbit leest de pagina en stelt automatisch voor welke velden je kunt extraheren—geen gedoe meer met HTML of selectors.

- Subpagina’s scrapen: Thunderbit volgt links naar subpagina’s (zoals product- of artikelpagina’s) en verrijkt je dataset met extra details.

- Direct exporteren: Stuur je data met één klik naar Excel, Google Sheets, Airtable of Notion.

- Paginering aan: Thunderbit kan data van meerdere pagina’s (ook met infinite scroll) verzamelen.

- Scrapes plannen: Stel terugkerende taken in om je data actueel te houden.

Zo ziet mijn favoriete hybride workflow eruit:

- Begin met Thunderbit: Open de gewenste site, klik op het Thunderbit-icoon en laat “AI Suggest Fields” de juiste kolommen (zoals titel, auteur, datum) herkennen.

- Exporteer de data: Download de resultaten als CSV of stuur ze direct naar Google Sheets.

- Gebruik BeautifulSoup voor maatwerk: Wil je diepere analyse (zoals tekst opschonen, dedupliceren of combineren met andere bronnen)? Laad de geëxporteerde CSV in Python en gebruik BeautifulSoup of pandas voor verdere verwerking.

Deze combinatie geeft je het beste van twee werelden: de snelheid en AI-veldherkenning van Thunderbit, plus de flexibiliteit van BeautifulSoup voor maatwerk.

Snelheid en datakwaliteit: waarom Thunderbit en BeautifulSoup samen gebruiken?

Waarom beide tools inzetten? Dit zijn mijn bevindingen:

Waarom beide tools inzetten? Dit zijn mijn bevindingen:

- Snelheid: Thunderbit kan tientallen pagina’s tegelijk scrapen (tot 50 parallel in cloudmodus), dus je hebt je data in minuten in plaats van uren.

- Datavolledigheid: Thunderbit’s AI past zich aan lay-outwijzigingen aan en haalt gestructureerde data zelfs van lastige sites, waardoor je minder snel velden mist.

- Minder fouten: Geen kapotte scripts meer als een class-naam verandert—Thunderbit’s AI analyseert de pagina elke keer opnieuw.

- Maatwerk na afloop: Voor geavanceerde wensen (zoals filteren, vertalen of datasets samenvoegen) geven BeautifulSoup en pandas je volledige controle.

Deze hybride aanpak is vooral waardevol voor:

- Grootschalige leadgeneratie: Gebruik Thunderbit voor de bulk, BeautifulSoup voor opschonen en verrijken.

- Productmonitoring: Thunderbit doet het repetitieve werk, BeautifulSoup analyseert trends of signaleert afwijkingen.

- Nieuws- en contenttracking: Verzamel snel artikelen met Thunderbit, gebruik Python voor sentimentanalyse of keyword-extractie.

Veelvoorkomende problemen bij webscraping met BeautifulSoup

Webscraping gaat niet altijd zonder slag of stoot—dit zijn veelvoorkomende valkuilen en oplossingen:

- Dynamische content: Laadt een site data met JavaScript (infinite scroll, AJAX)? BeautifulSoup alleen ziet die data niet. Gebruik Selenium of de browsermodus van Thunderbit.

- Anti-botmaatregelen: Sommige sites blokkeren automatische verzoeken. Stel een aangepaste User-Agent in, voeg vertragingen toe tussen verzoeken, of gebruik Thunderbit’s cloud scraping om eenvoudige blokkades te omzeilen.

- Wijzigingen in HTML-structuur: Werkt je script ineens niet meer? De HTML van de site is waarschijnlijk aangepast. Inspecteer de pagina opnieuw en pas je selectors aan. Thunderbit’s AI kan hier helpen door zich automatisch aan te passen.

- Ontbrekende data: Controleer altijd of elementen bestaan voordat je

.get_text()aanroept. Gebruik.get()in plaats van[]voor attributen om KeyErrors te voorkomen. - Encoding-problemen: Sla bestanden op met UTF-8 encoding om speciale tekens goed te verwerken.

En vergeet niet: respecteer altijd robots.txt en de gebruiksvoorwaarden van de site. Scrape netjes—niemand zit te wachten op een onbeschofte bot.

Samenvatting & belangrijkste punten

Webscraping met BeautifulSoup is een van de meest waardevolle skills in het huidige datatijdperk. Dit hebben we behandeld in deze BeautifulSoup webscraping tutorial:

- BeautifulSoup is het ideale startpunt om statische HTML te parseren en gestructureerde data met Python te extraheren.

- Installeren is eenvoudig—je hebt alleen Python, pip en een paar libraries nodig.

- HTML inspecteren is cruciaal om de juiste data te targeten.

- Exporteren naar CSV/Excel maakt je data direct bruikbaar voor zakelijke analyses.

- Combineren met Thunderbit geeft je AI-veldherkenning, snellere scraping en makkelijke export—perfect voor zakelijke gebruikers en niet-programmeurs.

- Hybride workflows (Thunderbit voor bulk, BeautifulSoup voor maatwerk) leveren de beste mix van snelheid, datakwaliteit en flexibiliteit.

Wil je je webscraping skills naar een hoger niveau tillen? Probeer beide tools: experimenteer met een eenvoudige BeautifulSoup-script en ontdek hoe snel je kunt werken met de . Meer praktische tips vind je op de .

Veel succes met scrapen—en moge je data altijd schoon, gestructureerd en direct inzetbaar zijn.

Veelgestelde vragen

1. Wat is BeautifulSoup en waar gebruik je het voor?

BeautifulSoup is een Python-bibliotheek voor het ontleden van HTML- en XML-documenten. Het helpt je om data uit webpagina’s te halen en om te zetten naar gestructureerde formaten zoals lijsten of tabellen—ideaal voor webscraping.

2. Hoe verhoudt BeautifulSoup zich tot Selenium en Scrapy?

BeautifulSoup is lichtgewicht en eenvoudig voor statische HTML-pagina’s. Selenium is beter voor dynamische, JavaScript-rijke sites, terwijl Scrapy een compleet framework is voor grootschalige, asynchrone scraping. Voor beginners en snelle taken is BeautifulSoup de beste keuze.

3. Kun je BeautifulSoup en Thunderbit samen gebruiken?

Zeker. Thunderbit kan met AI snel velden herkennen en extraheren van webpagina’s, waarna je BeautifulSoup kunt inzetten voor maatwerk of diepere analyse van de geëxporteerde data.

4. Wat zijn veelvoorkomende uitdagingen bij webscraping met BeautifulSoup?

Veelvoorkomende issues zijn het omgaan met dynamische content, anti-botmaatregelen en veranderingen in HTML-structuur. Met de AI-functies of browsermodus van Thunderbit kun je veel van deze uitdagingen tackelen.

5. Hoe exporteer ik data die ik met BeautifulSoup heb gescrapet naar Excel of CSV?

Je kunt de ingebouwde csv-module van Python of de pandas-bibliotheek gebruiken om je data naar CSV of Excel te schrijven. Gebruik altijd UTF-8 encoding voor speciale tekens en compatibiliteit met spreadsheettools.

Zelf aan de slag? Download de en begin vandaag nog slimmer te scrapen. Meer handleidingen en tips vind je op de .

Meer weten