Laat ik je eerlijk zeggen: er zijn maar weinig dingen in het digitale leven die zo’n voldaan gevoel geven als een overzichtelijke, complete lijst van alle pagina’s op een website—het is een beetje alsof je eindelijk al je sokken na het wassen weer bij elkaar hebt. Maar als je ooit hebt geprobeerd om alle pagina’s van een site te verzamelen voor bijvoorbeeld een content-audit, migratie of gewoon om te weten wat er allemaal op je site staat, dan weet je dat het zelden zo makkelijk is als het klinkt. Ik heb teams dagenlang zien puzzelen met sitemaps, Google-zoekopdrachten en CMS-exporten, om er vervolgens achter te komen dat ze alsnog verborgen of dynamische pagina’s missen. En over die keer dat ik een vriend hielp om alle WordPress-URL’s te exporteren—laten we zeggen dat er veel koffie en een beetje existentiële twijfel bij kwam kijken.

Het goede nieuws? Je hoeft niet langer verstoppertje te spelen met je eigen website. In deze gids laat ik je alle belangrijke manieren zien om website-URL’s te vinden—van klassiek tot modern—en ontdek je hoe AI-tools zoals dit proces niet alleen sneller en vollediger maken, maar zelfs een stuk leuker. Of je nu marketeer, developer of gewoon de pechvogel bent die “alle URL’s moet verzamelen”, je vindt hier praktische stappen, voorbeelden uit de praktijk en eerlijke vergelijkingen om de beste aanpak voor jouw team te kiezen.

Waarom zou je eigenlijk alle websitepagina’s willen verzamelen? Laten we eerst even stilstaan bij het ‘waarom’. Het is niet alleen een SEO-dingetje—marketing, sales, IT en operations hebben hier allemaal regelmatig mee te maken. Dit zijn de meest voorkomende situaties:

- SEO-content audits & strategie: Content-audits zijn standaard geworden; . Een volledige URL-lijst is de basis om prestaties te beoordelen, oude content te updaten en je ranking te verbeteren. .

- Website redesigns & migraties: ), en bij elke migratie moet je de huidige URL’s in kaart brengen om gebroken links en SEO-verlies te voorkomen.

- Compliance en onderhoud: Operations-teams moeten verouderde of verweesde pagina’s opsporen—soms staan er nog oude campagnesites live die voor verrassingen kunnen zorgen.

- Concurrentieanalyse: Sales- en marketingteams halen lijsten van productpagina’s, prijzen of blogposts van concurrenten binnen om kansen te ontdekken.

- Leadgeneratie & outreach: Sales-teams stellen lijsten samen van store locators, dealerpagina’s of ledenoverzichten voor hun outreach.

- Content-inventarisatie: Contentmarketeers houden een actueel overzicht bij van alle blogs, landingspagina’s, PDF’s en meer om dubbel werk te voorkomen en waarde te maximaliseren.

Hier een handige tabel met de scenario’s:

| Scenario | Wie heeft het nodig | Waarom een volledige paginalijst belangrijk is |

|---|---|---|

| SEO-audit / Content-audit | SEO-specialisten, contentmarketeers | Elk stuk content beoordelen; ontbrekende pagina’s = onvolledige analyse, gemiste optimalisatie |

| Website-migratie/redesign | Webdevelopers, SEO, IT, marketing | Oude en nieuwe URL’s koppelen, redirects instellen, gebroken links en SEO-verlies voorkomen |

| Concurrentieanalyse | Marketing, sales | Alle pagina’s van concurrenten zien; verborgen pagina’s kunnen kansen onthullen |

| Leadgeneratie | Sales-teams | Contact-/resourcepagina’s verzamelen voor outreach; geen potentiële lead missen |

| Content-inventarisatie | Contentmarketing | Up-to-date overzicht, gaten ontdekken, dubbelingen voorkomen, oude pagina’s beoordelen |

En de impact van ontbrekende of verborgen pagina’s? Die is echt. Stel je voor dat je een redesign plant en een verborgen landingspagina vergeet die nog steeds leads oplevert, of dat je bij een audit 5% van je pagina’s mist omdat ze niet geïndexeerd zijn. Dat betekent gemiste omzet, SEO-problemen en soms een PR-crisis die je niet zag aankomen.

Hoe pakken mensen dit nu aan? Er zijn een aantal beproefde methoden—de ene snel en oppervlakkig, de andere grondig (en soms pijnlijk). Dit zijn de opties:

Google Search en zoekoperators

Hoe werkt het:

Open Google en typ site:jouwwebsite.nl. Google toont alle pagina’s die het heeft geïndexeerd voor dat domein. Je kunt verfijnen met zoekwoorden of submappen (bijv. site:jouwwebsite.nl/blog).

Wat krijg je:

Een lijst van geïndexeerde pagina’s—oftewel, wat Google van je site kent.

Beperkingen:

- Toont alleen wat geïndexeerd is, niet alles wat bestaat

- Geeft meestal na een paar honderd resultaten geen nieuwe pagina’s meer, zelfs bij grote sites

- Mist nieuwe, verborgen of bewust niet-geïndexeerde pagina’s

Wanneer gebruiken:

Handig voor een snelle check of kleine sites, niet voor een volledige audit.

robots.txt en sitemap.xml controleren

Hoe werkt het:

Ga naar jouwwebsite.nl/robots.txt en zoek naar regels met “Sitemap:”. Open de sitemap (meestal jouwwebsite.nl/sitemap.xml of /sitemap_index.xml). Sitemaps bevatten de URL’s die de site-eigenaar wil laten indexeren.

Wat krijg je:

Een lijst van belangrijke pagina’s—vaak alle blogs, productpagina’s, enz. .

Beperkingen:

- Sitemaps bevatten alleen pagina’s die de eigenaar wil laten indexeren—verborgen of verweesde pagina’s ontbreken vaak

- Sitemaps kunnen verouderd zijn als ze niet opnieuw worden gegenereerd

- Sommige sites hebben meerdere sitemaps; soms moet je even zoeken

Wanneer gebruiken:

Ideaal als je eigenaar bent van de site of snel de hoofdstructuur van een concurrent wilt zien. Maar je ziet alleen wat de eigenaar wil tonen.

SEO Spider Tools en websitecrawlers

Hoe werkt het:

Tools zoals Screaming Frog, Sitebulb of DeepCrawl bootsen een zoekmachine na. Je voert de URL van je site in, en de tool volgt alle interne links om een lijst van gevonden pagina’s te maken.

Wat krijg je:

In potentie elke pagina die gelinkt is op de site, plus data zoals statuscodes en metatags.

Beperkingen:

- Verweesde pagina’s (niet gelinkt) worden gemist, tenzij je ze handmatig toevoegt

- Dynamische of JavaScript-pagina’s worden soms gemist, tenzij de tool headless browsing ondersteunt

- Grote sites crawlen duurt lang en kan je computer belasten

- Vereist technische kennis en installatie

Wanneer gebruiken:

Ideaal voor SEO-specialisten of developers die diepgaande audits doen. Minder geschikt voor niet-technische gebruikers.

Google Search Console en Analytics

Hoe werkt het:

Als je toegang hebt tot de site, kun je via Google Search Console (GSC) en Analytics lijsten van URL’s exporteren.

- GSC: Index Coverage en Performance rapporten tonen geïndexeerde en uitgesloten URL’s (tot 1.000 per export, meer via API).

- Analytics: Laat alle pagina’s zien die in een bepaalde periode verkeer hebben gehad (GA4 tot 100.000 rijen per export).

Beperkingen:

- GSC en Analytics tonen alleen pagina’s die Google kent of die verkeer hebben gehad

- Exportlimieten (1.000 rijen voor GSC, 100k voor GA4)

- Vereist eigenaarschap/verificatie van de site; niet bruikbaar voor concurrentieonderzoek

- Pagina’s zonder verkeer of die niet geïndexeerd zijn, verschijnen niet

Wanneer gebruiken:

Perfect voor je eigen site, vooral voor een migratie of audit. Niet geschikt voor concurrentieanalyse.

CMS-dashboards

Hoe werkt het:

Draait je site op WordPress, Shopify of een ander CMS? Dan kun je vaak direct vanuit het dashboard een lijst van pagina’s en berichten exporteren (soms met een plugin).

Wat krijg je:

Een lijst van alle content—pagina’s, berichten, producten, enz.

Beperkingen:

- Vereist admin-toegang

- Bevat mogelijk geen niet-content of dynamische pagina’s

- Als je site meerdere systemen gebruikt (blog, shop, docs), moet je exports combineren

Wanneer gebruiken:

Ideaal voor site-eigenaren die een content-inventarisatie of back-up willen maken. Niet bruikbaar voor concurrentieonderzoek.

Eerlijk is eerlijk: geen van deze methoden is perfect. De belangrijkste nadelen op een rij:

- Technische drempel: Veel methoden vereisen technische kennis of speciale tools. Voor niet-technische teamleden is dit een flinke hobbel. Een handmatige content-audit kan .

- Onvolledige dekking: Elke methode kan bepaalde pagina’s missen—Google mist niet-geïndexeerde of nieuwe pagina’s, sitemaps missen verweesde pagina’s, crawlers missen ongelinkte of dynamische pagina’s, CMS-exports missen alles buiten het systeem.

- Handmatig werk en tijd: Vaak moet je data uit verschillende bronnen combineren, dedupliceren en opschonen—saai en foutgevoelig. Mensen delen zelfs “hacks” zoals copy-pasten uit sitemaps naar Excel of command-line scripts gebruiken.

- Onderhoud en actualiteit: Lijsten verouderen snel. Traditionele methoden vereisen dat je het proces steeds opnieuw uitvoert bij elke wijziging op de site.

- Toegang en rechten: Sommige methoden vereisen admin-toegang of eigenaarschap van de site—niet handig voor concurrentieonderzoek.

- Data-overload: SEO-spiders kunnen je overspoelen met technische data, terwijl je alleen een simpele URL-lijst wilt.

Kortom, het traditionele proces is “als een taart proberen te bakken terwijl het recept steeds verandert en de oven af en toe op slot gaat.” (Ja, dat is een echte vergelijking van een contentstrateeg—en ik herken het gevoel.)

Maak kennis met Thunderbit: de AI-oplossing voor het vinden van website-URL’s

Nu wordt het pas echt interessant. Wat als je gewoon een assistent kon vragen: “loop die website door en geef me een lijst van alle pagina’s”, en het gebeurt echt—zonder code, zonder gedoe? Dat is precies waar voor is.

Thunderbit is een AI-webscraper Chrome-extensie, speciaal ontworpen voor niet-technische gebruikers (maar krachtig genoeg voor professionals). De AI “leest” websites, structureert de data en exporteert alle website-URL’s—ook verborgen, dynamische en subpagina’s. Je hoeft geen code te schrijven of ingewikkelde instellingen te gebruiken. Gewoon de site openen, “AI Suggest Fields” aanklikken en Thunderbit doet het zware werk.

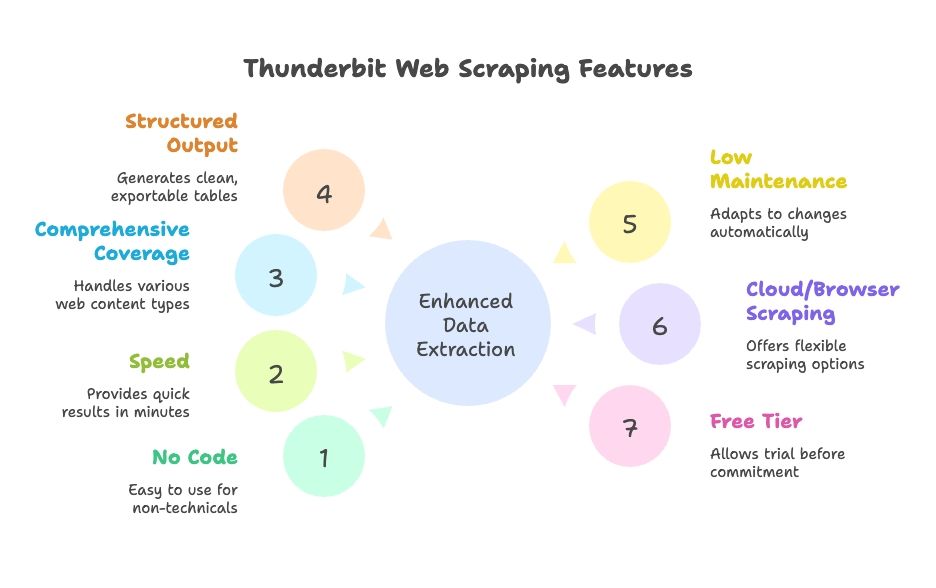

Waarom Thunderbit zo bijzonder is:

- Geen code of installatie nodig: Natuurlijke taalinterface, gestuurd door AI. Iedereen in het team kan ermee werken.

- Snelheid: Resultaat in minuten, niet uren.

- Volledige dekking: Kan overweg met dynamische content, paginering, infinite scroll en subpagina’s.

- Gestructureerde output: Nette tabellen, direct te exporteren naar Google Sheets, Excel, Airtable, Notion, CSV of JSON.

- Weinig onderhoud: AI past zich automatisch aan sitewijzigingen aan; minder bijsturen nodig.

- Cloud- of browserscraping: Kies wat het beste past bij jouw workflow.

- Gratis versie beschikbaar: Probeer het uit zonder verplichtingen.

Zo maakt Thunderbit het verzamelen van websitepagina’s eenvoudig

Laten we stap voor stap bekijken hoe Thunderbit werkt. Zo ga je van “ik heb een lijst van alle pagina’s nodig” naar “hier is het spreadsheet, baas” in een paar klikken.

Stap 1: Installeer en start Thunderbit

Download de en zet hem vast in je browser. Navigeer naar de website die je wilt scrapen (bijvoorbeeld je homepage) en klik op het Thunderbit-icoon om de interface te openen.

Tip: Thunderbit geeft nieuwe gebruikers gratis credits, dus je kunt het uitproberen zonder direct te betalen.

Stap 2: Kies je gegevensbron

Thunderbit staat standaard op het scrapen van de huidige pagina, maar je kunt ook een lijst van URL’s invoeren (zoals een sitemap of categoriepagina’s) als je vanuit een specifiek deel wilt starten.

- Voor de meeste sites begin je met de homepage of een sitemap.

- Voor webshops kun je starten met een categorie- of productoverzichtspagina.

Stap 3: Gebruik “AI Suggest Fields” om URL’s te detecteren

Hier komt de AI in actie. Klik op “AI Suggest Fields” (of “AI Suggest Columns”). Thunderbit’s AI scant de pagina, herkent patronen en stelt kolommen voor zoals “Paginatitel” en “Pagina-URL” voor alle gevonden links. Je kunt deze kolommen aanpassen.

- Op een homepage krijg je bijvoorbeeld navigatie-, footer- en uitgelichte links.

- Op een sitemap krijg je een nette lijst van URL’s.

- Je kunt kolommen toevoegen of verwijderen, of verfijnen wat je wilt extraheren.

Thunderbit’s AI doet het zware werk—geen XPaths of CSS-selectors nodig. Het is alsof je een robotstagiair hebt die echt begrijpt wat je bedoelt.

Stap 4: Zet Subpage Scraping aan

De meeste sites tonen niet alle pagina’s op de homepage. Daar komt Thunderbit’s Subpage Scraping van pas. Markeer de URL-kolom als “volg”-link, en Thunderbit klikt door op elke gevonden link om meer URL’s van die pagina’s te verzamelen. Je kunt zelfs geneste sjablonen instellen voor meerlaagse scraping.

- Voor paginering of “laad meer”-knoppen kun je Pagination & Scrolling inschakelen zodat Thunderbit doorgaat tot alles gevonden is.

- Voor sites met subdomeinen of secties (zoals een blog op ), kan Thunderbit deze ook volgen als je dat aangeeft.

Stap 5: Start de scraping

Klik op “Scrape” en kijk hoe Thunderbit aan het werk gaat. In real-time vult hij een tabel met URL’s (en andere gekozen velden). Bij grote sites kun je het proces op de achtergrond laten draaien en later terugkomen.

Stap 6: Controleer en exporteer

Klaar? Bekijk de resultaten—Thunderbit laat je sorteren, filteren en dubbele waarden verwijderen in de app. Daarna kun je alles met één klik exporteren naar Google Sheets, Excel, CSV, Airtable, Notion of JSON. Geen gedoe meer met copy-paste of rommelige opmaak.

Het hele proces? Voor een kleine tot middelgrote site heb je binnen 10 minuten een volledige URL-lijst. Voor grotere sites is het nog steeds veel sneller (en minder stressvol) dan alles handmatig combineren.

Verborgen en dynamische pagina’s ontdekken met Thunderbit

Een van mijn favoriete features van Thunderbit is hoe het omgaat met pagina’s die traditionele tools vaak missen:

- JavaScript-gegenereerde content: Omdat Thunderbit in een echte browser draait, kan het pagina’s vastleggen die dynamisch laden (zoals infinite scroll vacaturebanken of productoverzichten).

- Verweesde of ongelinkte pagina’s: Als je een hint hebt (zoals een sitemap of zoekfunctie), kan Thunderbit die gebruiken om pagina’s te vinden die nergens gelinkt zijn.

- Subdomeinen of secties: Thunderbit kan links over subdomeinen volgen als dat nodig is, zodat je een compleet beeld krijgt.

- Interacties zoals een gebruiker: Moet je een zoekveld invullen of een filter aanklikken om verborgen pagina’s te zien? Thunderbit’s AI-autovullen regelt dat ook.

Praktijkvoorbeeld: Een marketingteam moest alle oude landingspagina’s vinden—veel daarvan waren nergens gelinkt, maar bestonden nog wel. Door Google-zoekresultaten te scrapen met Thunderbit en bekende URL-patronen in te voeren, vonden ze tientallen vergeten pagina’s en voorkwamen zo verwarring (en hoofdpijn).

Thunderbit versus traditionele methoden: snelheid, eenvoud en dekking

Laten we Thunderbit vergelijken met de traditionele methoden:

| Aspect | Google “site:” Search | XML Sitemap | SEO Crawler (Screaming Frog) | Google Search Console | CMS Export | Thunderbit AI Webscraper |

|---|---|---|---|---|---|---|

| Snelheid | Heel snel, maar beperkt | Direct als beschikbaar | Varieert (minuten tot uren) | Snel bij kleine sites | Direct bij kleine sites | Snel, in minuten geconfigureerd, automatisch scrapen |

| Gebruiksgemak | Heel makkelijk | Makkelijk | Gemiddeld (vereist setup) | Gemiddeld | Makkelijk (als admin) | Zeer makkelijk, geen code nodig |

| Dekking | Laag (alleen geïndexeerd) | Hoog voor bedoelde pagina’s | Hoog voor gelinkte pagina’s | Hoog voor geïndexeerd, beperkte export | Gemiddeld (alleen content) | Zeer hoog, ook dynamisch & subpagina’s |

| Output & integratie | Handmatig kopiëren | XML (moet omgezet worden) | CSV met veel extra data | CSV/Excel, tot 1.000 rijen | CSV/XML, soms opschonen | Nette tabel, 1-klik export naar Sheets, Excel, enz. |

| Onderhoud | Handmatig opnieuw doen | Moet bijgewerkt worden | Opnieuw crawlen bij wijzigingen | Periodiek exporteren | Exporteren na wijzigingen | Weinig—AI past zich aan, kan scraping plannen |

Thunderbit blinkt uit in gebruiksgemak, volledigheid en integratie. Traditionele methoden hebben elk hun sterke punten, maar vereisen meer werk om resultaten te combineren en actueel te houden. Thunderbit’s AI past zich aan sitewijzigingen aan, zodat je niet steeds instellingen hoeft te wijzigen of handmatig te exporteren.

De juiste aanpak kiezen: wie gebruikt welke methode?

Welke methode past het beste bij jou? Mijn advies, gebaseerd op jaren ervaring met website-data:

- SEO-specialisten / developers: Heb je diepgaande technische data nodig (zoals metatags, gebroken links), of werk je aan een enorme enterprise-site, dan is een crawler of script soms nog steeds handig. Maar zelfs dan kun je met Thunderbit snel een URL-lijst genereren voor je andere tools.

- Marketeers, contentstrategen, projectmanagers: Thunderbit is een uitkomst. Je hoeft niet meer te wachten op IT of exports te combineren. Voor content-inventarisatie, concurrentieanalyse of een snelle audit kun je het zelf doen.

- Sales-teams / leadgeneratie: Thunderbit maakt het eenvoudig om lijsten van winkels, evenementenpagina’s of ledenoverzichten van elke site te halen—zonder code.

- Kleine websites / snelle taken: Voor kleine sites is een handmatige check of sitemap soms genoeg. Maar Thunderbit is zo snel opgezet dat je eigenlijk niets mist.

- Budget: Traditionele methoden zijn goedkoop (behalve je tijd). Thunderbit heeft een gratis versie en betaalbare abonnementen. Vergeet niet: je tijd is ook geld waard!

- Zeer specifieke databehoeften: Heb je heel specifieke data of complexe logica nodig, dan is een eigen scraper soms nodig. Maar Thunderbit’s AI dekt de meeste use-cases met minimale setup.

Keuzetips:

- Heb je minder dan 1.000 pagina’s en site-eigendom, probeer dan een Google Search Console-export—maar controleer de volledigheid.

- Geen toegang tot de site of concurrentiedata nodig? Thunderbit of een crawler is je vriend.

- Waardeer je je tijd en wil je een schaalbare oplossing? Thunderbit is moeilijk te overtreffen.

- Voor samenwerking in teams is Thunderbit’s directe export naar Google Sheets een groot voordeel.

Veel organisaties kiezen voor een hybride aanpak: Thunderbit voor snelle taken en niet-technische teamleden, traditionele tools voor diepgaande audits.

Belangrijkste inzichten: websitepagina’s verzamelen voor elk zakelijk doel

Samengevat:

- Een volledige lijst van je websitepagina’s is essentieel voor SEO, contentstrategie, migraties en salesonderzoek. Het voorkomt verrassingen, gebroken links en gemiste kansen. De meeste marketeers voeren nu minstens jaarlijks een content-audit uit ().

- Traditionele methoden bestaan, maar hebben elk hun beperkingen. Geen enkele aanpak garandeert een volledige, actuele lijst. Vaak zijn technische vaardigheden en het combineren van meerdere exports nodig.

- AI-gedreven scraping (Thunderbit) is de moderne oplossing. Thunderbit gebruikt AI om het “denkwerk” en klikken over te nemen, waardoor webscraping voor iedereen toegankelijk wordt. Het verwerkt dynamische content, subpagina’s en exporteert data direct bruikbaar—dat bespaart tijd en voorkomt fouten. In vergelijkingen doet Thunderbit in minuten wat voorheen uren kostte, zonder leercurve ().

- Kies de methode die past bij je team en doel. Gebruik alle tools voor grote sites, maar voor de meeste bedrijven is Thunderbit alleen al voldoende.

- Houd het actueel. Regelmatige audits zorgen dat je problemen vroeg ontdekt en je website efficiënt blijft. Met Thunderbit’s planningsfunctie is dit haalbaar, terwijl handmatige processen vaak worden overgeslagen vanwege de moeite.

Laatste gedachte: Geen excuses meer om niet te weten wat er op je eigen website (of die van je concurrent) staat. Met de juiste aanpak krijg je een compleet overzicht van alle pagina’s en kun je die kennis inzetten voor betere SEO, gebruikerservaring en strategie. Werk slimmer, niet harder—laat AI het zware werk doen en zorg dat geen enkele pagina wordt vergeten.

Volgende stappen

Wil je nooit meer opzien tegen de taak “haal alle URL’s op”? en probeer het op je eigen site of die van een concurrent. Je zult versteld staan hoeveel tijd (en frustratie) je bespaart. Wil je meer leren over webscraping? Bekijk dan onze andere gidsen op de , zoals of .

Veelgestelde vragen

1. Waarom zou ik een lijst van alle pagina’s op een website willen?

Teams in SEO, marketing, sales en IT hebben vaak een volledige lijst van website-URL’s nodig voor taken als content-audits, website-migraties, leadgeneratie en concurrentieanalyse. Een complete en actuele lijst voorkomt gebroken links, dubbele of vergeten content en onthult verborgen kansen.

2. Wat zijn de traditionele manieren om alle website-URL’s te vinden?

Veelgebruikte methoden zijn Google’s site:-zoekopdracht, het controleren van sitemap.xml en robots.txt, crawlen met SEO-tools zoals Screaming Frog, exporteren vanuit CMS-platforms zoals WordPress, en het ophalen van geïndexeerde/verkeerspagina’s uit Google Search Console en Analytics. Elke methode heeft echter beperkingen qua dekking en gebruiksgemak.

3. Wat zijn de beperkingen van traditionele methoden om URL’s te vinden?

Traditionele methoden missen vaak dynamische, verweesde of niet-geïndexeerde pagina’s. Ze vereisen technische kennis, kosten veel tijd om te combineren en op te schonen, en schalen slecht bij grote sites of herhaalde audits. Je hebt vaak site-eigendom of admin-rechten nodig, wat niet altijd mogelijk is.

4. Hoe maakt Thunderbit het vinden van alle websitepagina’s eenvoudiger?

Thunderbit is een AI-webscraper die websites scant zoals een mens—klikt door subpagina’s, verwerkt JavaScript en structureert data automatisch. Je hebt geen code nodig, werkt via een Chrome-extensie en kunt in enkele minuten schone URL-lijsten exporteren naar Google Sheets, Excel, CSV en meer.

5. Wie zou Thunderbit moeten gebruiken en wie traditionele tools?

Thunderbit is ideaal voor marketeers, contentstrategen, sales-teams en niet-technische gebruikers die snel en volledig URL-lijsten willen zonder gedoe. Traditionele tools zijn beter voor technische audits met diepgaande metadata of maatwerk. Veel teams gebruiken beide—Thunderbit voor snelheid en gemak, traditionele tools voor diepgaande analyse.