Ik zal eerlijk zijn: de eerste keer dat ik alle URL’s van een grote website probeerde te verzamelen, dacht ik: “Hoe moeilijk kan het zijn?” Een paar uur later klikte ik nog steeds door eindeloze pagina’s, kopieerde ik links naar een spreadsheet en vroeg ik me af waar ik mee bezig was. Als je ooit hebt geprobeerd om alle pagina’s op een website te vinden—of dat nu was voor een contentaudit, een leadlijst of concurrentieonderzoek—dan ken je die frustratie. Het kost veel tijd, is foutgevoelig en, eerlijk gezegd, zonde van je tijd en talent.

Maar er is goed nieuws: je hoeft het niet langer op de omslachtige manier te doen. AI-gestuurde tools zoals veranderen het spel voor zakelijke gebruikers en maken het mogelijk om alle URL’s op een domein te vinden in minuten in plaats van dagen. Bedrijven die AI-gedreven webscrapingtools gebruiken, rapporteren zelfs bij dataverzameling, en sommige zien tot vergeleken met handmatige methoden. Dat is niet zomaar een statistiek — dat zijn uren of zelfs dagen van je leven terug.

Laten we dus bekijken waarom alle pagina’s op een website vinden zo lastig is, waarom generieke AI-modellen zoals GPT of Claude daarbij weinig helpen, en hoe gespecialiseerde AI-agenten — zoals Thunderbit — dit proces een fluitje van een cent maken. En ja, ik neem je stap voor stap mee door hoe je precies elke URL kunt extraheren die je nodig hebt, ook als je geen programmeur bent.

Waarom alle URL’s op een domein vinden zo uitdagend is

Laten we eerlijk zijn: websites zijn niet ontworpen om je netjes een lijst te geven van elke pagina die ze bevatten. Ze zijn gebouwd voor bezoekers, niet voor mensen die in één keer alle pagina’s op een website willen vinden. Daarom is deze taak zo’n hoofdpijn:

- Handmatig kopiëren en plakken is een ramp: Door elk menu, elke lijst en elke directory klikken en URL’s één voor één kopiëren is vragen om RSI — en om de helft van de pagina’s te missen.

- Paginering en eindeloos scrollen: Veel sites splitsen content over meerdere pagina’s of laden meer resultaten terwijl je scrolt. Mis je een knop “Volgende” of scroll je niet ver genoeg, dan mis je hele secties.

- Inconsistente paginastucturen: Sommige pagina’s tonen links in één formaat, andere gebruiken een andere indeling. Het bijhouden daarvan is een nachtmerrie.

- Verborgen of verweesde pagina’s: Niet elke pagina is gelinkt vanuit het hoofdmenu. Sommige zitten diep verstopt en zijn alleen bereikbaar via sitemaps of interne zoekfunctie.

- Menselijke fouten: Hoe meer pagina’s je moet kopiëren, hoe groter de kans op fouten — dubbele URL’s, typefouten of gewoon iets overslaan.

En werk je op een site met honderden of duizenden pagina’s? Vergeet het maar. Handmatig extraheren schaalt gewoon niet. Zoals een datateam het verwoordde: voor alles wat verder gaat dan triviale gevallen, .

Wat betekent het om “alle pagina’s op een website te vinden”?

Voordat we naar oplossingen springen, moeten we eerst helder hebben waar we eigenlijk naar op zoek zijn.

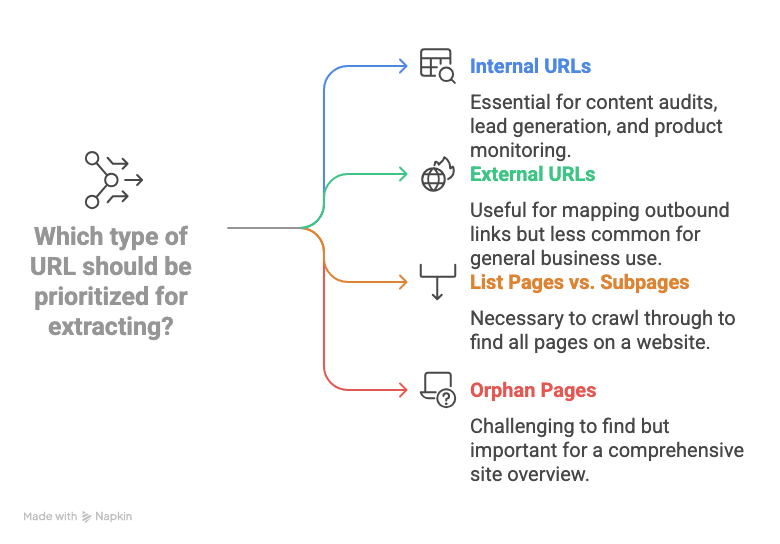

- Interne URL’s: Dit zijn links die verwijzen naar pagina’s op hetzelfde domein (zoals /over-ons of /producten/widget-123). Voor de meeste zakelijke toepassingen — contentaudits, leadgeneratie, productmonitoring — zijn interne URL’s het hoofddoel.

- Externe URL’s: Links die naar andere websites gaan. Die heb je meestal niet nodig, tenzij je uitgaande links in kaart brengt.

- Overzichtspagina’s vs. subpagina’s: Veel sites hebben hub- of lijstpagina’s (denk aan categoriepagina’s, blogarchieven, directories) die linken naar detailpagina’s, zoals product- of profielpagina’s. Om echt alle pagina’s op een website te vinden, moet je deze lijsten doorlopen en elke subpagina meenemen waarnaar ze linken.

- Verweesde pagina’s: Dit zijn pagina’s die nergens duidelijk gelinkt zijn. Soms kun je ze via sitemaps of interne zoekfunctie vinden, maar ze worden makkelijk gemist.

Dus wanneer we het hebben over alle URL’s op een domein vinden, bedoelen we: elke interne pagin URL verzamelen, van de homepage tot de diepste product- of artikelpagina, idealiter in een formaat dat je kunt gebruiken, zoals een spreadsheet.

Traditionele methoden om alle URL’s op een domein te vinden

Er zijn een paar ouderwetse manieren om dit aan te pakken, maar elk heeft zijn eigen set frustraties:

Handmatig kopiëren en plakken en browsertools

Dit is de “brute force”-aanpak: klik op elke link, kopieer elke URL, plak die in een spreadsheet en hoop dat je niets mist. Sommige mensen gebruiken browserextensies om alle links van de huidige pagina te pakken, maar dan moet je dit nog steeds voor elke pagina herhalen, en voor paginering of verborgen secties ben je zelf verantwoordelijk. Prima voor een site met vijf pagina’s — veel minder geschikt voor iets groters.

Site search en sitemaps gebruiken

- Google’s site:-zoekopdracht: Typ site:yourdomain.com in Google en je ziet een hoop geïndexeerde pagina’s. Maar Google toont alleen wat het heeft geïndexeerd (vaak beperkt tot ongeveer 1.000 resultaten), dus je mist nieuwe, verborgen of laagwaardige pagina’s. geeft toe dat dit geen volledige oplossing is.

- XML-sitemaps: Veel sites hebben een /sitemap.xml met belangrijke URL’s. Handig — als de sitemap actueel is en echt elke pagina bevat. Maar niet elke site heeft er een, en soms zijn sitemaps opgesplitst in meerdere bestanden. Verweesde pagina’s vallen vaak buiten de boot.

Technische crawlers en scripts

- SEO-tools (zoals Screaming Frog): Deze crawlen een site als een zoekmachine en spugen een lijst met URL’s uit. Ze zijn krachtig, maar vereisen installatie, configuratie en soms een betaalde licentie voor grote sites.

- Python-scripts (zoals Scrapy): Ontwikkelaars kunnen scripts schrijven om URL’s te crawlen en te extraheren. Maar laten we eerlijk zijn: als je niet prettig met code bent, is dit geen serieuze optie. Bovendien breken scripts zodra de site-indeling verandert, dus je rent constant achter de feiten aan.

Kortom: traditionele methoden zijn ofwel te handmatig, te onvolledig of te technisch voor de meeste zakelijke gebruikers. Er is een reden waarom zoveel mensen halverwege afhaken.

Waarom generieke AI-modellen URL-extractie niet volledig kunnen automatiseren

Misschien denk je: “Kan ik ChatGPT of Claude niet gewoon vragen om alle pagina’s van een website voor me te vinden?” Ik wou dat het zo makkelijk was. Dit is de realiteit:

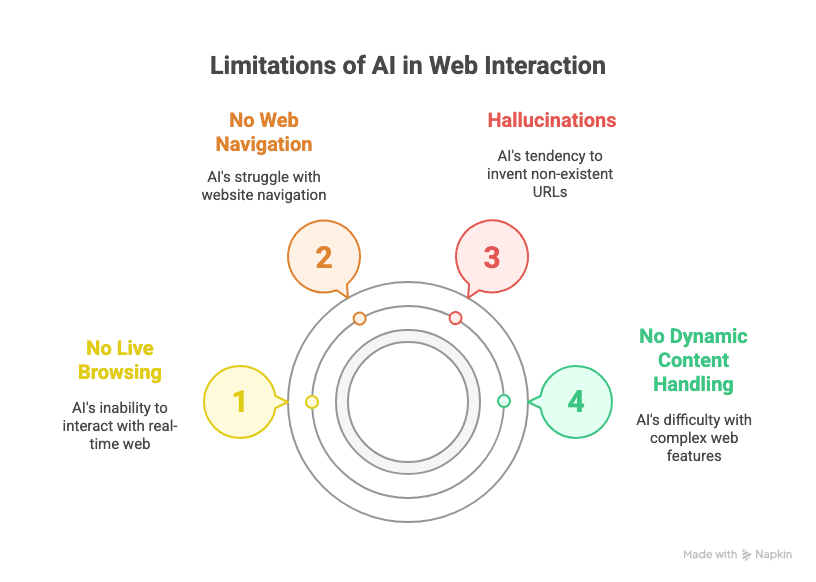

- Geen live browsen: Algemenedoel-AI-modellen zoals GPT of Claude kunnen het web niet echt in realtime doorzoeken. Ze “zien” de actuele staat van een website niet — ze werken alleen met hun trainingsdata of met wat jij plakt.

- Geen webnavigatie: Zelfs met plugins of ingeschakelde browsefuncties weten LLM’s niet hoe ze op “Volgende” moeten klikken, eindeloos scrollen moeten afhandelen of systematisch elke link op een site moeten volgen.

- Hallucinaties: Vraag een generieke AI om alle URL’s op een domein, en hij verzint vaak links die plausibel klinken maar in werkelijkheid niet bestaan. (Ik heb gezien dat hij /over-ons-pagina’s verzon voor sites die er nooit één hadden.)

- Geen verwerking van dynamische content: Sites die content laden met JavaScript, inloggen vereisen of complexe navigatie gebruiken, zijn voor algemene LLM’s buiten bereik.

Zoals het zegt: “Als je pagina’s bij honderden of duizenden wilt scrapen… schiet ChatGPT alleen tekort.” Je hebt een tool nodig die speciaal voor deze taak is gebouwd.

Verticale AI-agenten zijn de toekomst (en waarom dat belangrijk is)

Hier komt mijn ervaring in SaaS en automatisering van pas: verticale AI-agenten — AI-tools gebouwd voor een specifiek domein, zoals webdata-extractie — zijn de enige manier om betrouwbare, schaalbare resultaten te krijgen voor zakelijke taken. Waarom?

- Algemene LLM’s zijn geweldig voor schrijven of zoeken, maar ze zijn gevoelig voor hallucinaties en kunnen geen meerstaps-workflows aan die herhaalbaar en stabiel moeten zijn voor bedrijven.

- Enterprise-SaaS-tools moeten veel repetitieve, gestructureerde taken automatiseren. Dáár blinken verticale AI-agenten in uit — ze zijn gebouwd om één ding te doen, en dat goed, met minimale fouten.

- Voorbeelden zijn er in overvloed, in allerlei sectoren: Thunderbit voor webdata-extractie, Devin AI voor softwareontwikkeling, Alta voor salesautomatisering, Infinity Learn’s IL VISTA voor onderwijs, Rippling voor HR, Harvey voor legal… en de lijst gaat door.

Kortom: als je op betrouwbare wijze alle pagina’s op een website wilt vinden, heb je een verticale AI-agent nodig die voor die taak is gebouwd — niet een algemene chatbot.

Maak kennis met Thunderbit: AI-gestuurde URL-extractie voor iedereen

Hier komt om de hoek kijken. Als Chrome-extensie voor AI-webscraping is Thunderbit ontworpen voor zakelijke gebruikers — geen code, geen technische setup, gewoon resultaat. Dit maakt het anders:

- Interface in natuurlijke taal: Beschrijf gewoon wat je wilt (“Geef alle pagina-URL’s op deze site weer”), en Thunderbit’s AI zoekt uit hoe het dit moet extraheren.

- AI-velden voorstellen: Thunderbit scant de pagina en doet automatisch voorstellen voor kolomnamen (zoals “Pagina-URL”) — geen gedoe met CSS-selectors of XPath.

- Ondersteunt paginering en eindeloos scrollen: Thunderbit kan automatisch op “Volgende” klikken of omlaag scrollen, zodat je geen pagina’s mist.

- Navigatie naar subpagina’s: Dieper gaan? Thunderbit kan ook links naar subpagina’s volgen en daar data ophalen.

- Gestructureerde export: Exporteer je resultaten direct naar Google Sheets, Excel, Notion, Airtable of CSV — gratis en met één klik.

- Geen code nodig: Als je een website kunt gebruiken, kun je Thunderbit gebruiken. Zo simpel is het.

En omdat Thunderbit een verticale AI-agent is, is het gebouwd voor stabiliteit en herhaalbaarheid — perfect voor zakelijke gebruikers die dezelfde taken steeds opnieuw willen automatiseren.

Stap voor stap: hoe vind je alle URL’s op een domein met Thunderbit

Klaar om te zien hoe het werkt? Hier is een niet-technische uitleg om elke URL te extraheren die je nodig hebt.

1. Installeer de Thunderbit Chrome-extensie

Eerst dit: . Het werkt in Chrome, Edge, Brave en andere Chromium-browsers. Zet het vast op je werkbalk voor snelle toegang.

2. Open je doel-lijst of directorypagina

Ga naar de website waarvan je URL’s wilt extraheren. Dat kan de homepage zijn, een sitemap, een directory of een willekeurige lijstpagina die links bevat naar de pagina’s die je nodig hebt.

3. Open Thunderbit en stel je velden in

Klik op het Thunderbit-pictogram om de extensie te openen. Start een nieuw scraper-sjabloon. Hier gebeurt de magie:

- Klik op “AI Suggest Fields”. Thunderbit’s AI scant de pagina en stelt kolommen voor — zoek naar een kolom met label “Page URL”, “Link” of iets soortgelijks.

- Zie je niet exact het veld dat je wilt? Voeg dan gewoon een kolom toe met de naam “Page URL” (of een naam die logisch is). Thunderbit’s AI is getraind om deze termen te herkennen en ze aan de juiste data te koppelen.

4. Schakel paginering of scrollen in, indien nodig

Als je doelpagina meerdere pagina’s heeft (zoals “Pagina 1, 2, 3…” of een knop “Meer laden”), zet dan paginering aan in Thunderbit:

- Schakel over naar de modus “Klik-paginering” voor sites met “Volgende”-knoppen, of “Eindeloos scrollen” voor sites die meer laden terwijl je scrolt.

- Thunderbit vraagt je om de knop “Volgende” of het scrollgebied te selecteren — klik erop, en de AI doet de rest.

5. Start het scrapen en bekijk je resultaten

Klik op de knop “Scrape”. Thunderbit crawlt alle pagina’s en verzamelt elke URL die het vindt. Je ziet de resultaten direct in een tabel in de extensie verschijnen. Voor grote sites kan dit een paar minuten duren, maar het is nog steeds veel sneller dan handmatig doen.

6. Exporteer je lijst met URL’s

Zodra het scrapen klaar is, klik je op Exporteren. Je kunt je data rechtstreeks sturen naar:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Exporten zijn gratis en behouden al je opmaak. Geen gekopieer en geplak meer.

Thunderbit vergelijken met andere oplossingen voor URL-extractie

| Methode | Gebruiksgemak | Nauwkeurigheid en dekking | Schaalbaarheid | Exportopties |

|---|---|---|---|---|

| Handmatig kopiëren en plakken | Pijnlijk | Laag (makkelijk iets te missen) | Geen | Handmatig (Excel, enz.) |

| Browser-linkextractors | Prima voor 1 pagina | Middelmatig | Slecht | Handmatig |

Google site:-zoekopdracht | Makkelijk | Middelmatig (niet compleet) | Beperkt tot ~1.000 | Handmatig |

| XML-sitemap | Makkelijk (als die bestaat) | Goed (als actueel) | Goed | Handmatig/Script |

| SEO-tools (Screaming Frog) | Technisch | Hoog | Hoog (betaald) | CSV, Excel |

| Python-scripts (Scrapy, enz.) | Zeer technisch | Hoog | Hoog | Maatwerk |

| Thunderbit | Zeer makkelijk | Zeer hoog | Hoog | Google Sheets, CSV, enz. |

Thunderbit geeft je de nauwkeurigheid en schaal van een professionele crawler met het gebruiksgemak van een browserextensie. Geen code, geen setup, gewoon resultaat.

Bonus: met Thunderbit meer extraheren dan alleen URL’s

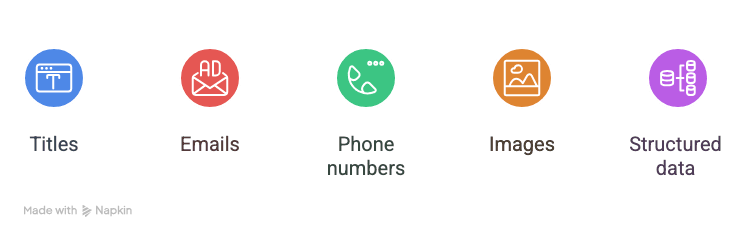

Hier wordt het pas echt interessant. Thunderbit is niet alleen voor URL’s — je kunt ook extraheren:

- Titels

- E-mailadressen

- Telefoonnummers

- Afbeeldingen

- Alle gestructureerde data op de pagina

Als je bijvoorbeeld een leadlijst bouwt, kan Thunderbit de profiel-URL, naam, e-mail en telefoonnummer uit elk directory-item halen — allemaal in één run. Als je producten controleert, kun je de product-URL, naam, prijs en voorraadstatus ophalen. Thunderbit ondersteunt zelfs , zodat het in elk item kan doorklikken en daar details kan extraheren.

En ja, Thunderbit’s e-mail- en telefoon-extractors zijn helemaal gratis. Dat is een groot voordeel voor sales- en marketingteams.

Belangrijkste inzichten: hoe vind je alle pagina’s op een website met AI

Even samenvatten:

- Alle URL’s uit een domein halen is lastig met handmatige of generieke tools.

- Generieke AI-modellen zoals GPT kunnen webnavigatie, paginering en dynamische content niet goed aan.

- Verticale AI-agenten zoals Thunderbit zijn speciaal gebouwd voor webdata-extractie — stabiel, herhaalbaar en makkelijk voor zakelijke gebruikers.

- Thunderbit maakt het eenvoudig: installeer de extensie, laat AI velden voorstellen, schakel paginering in, scrape en exporteer. Geen code, geen gedoe.

- Je kunt meer extraheren dan alleen URL’s: titels, e-mailadressen, telefoonnummers en meer — perfect voor leadgeneratie, audits of onderzoek.

Ben je klaar met links kopiëren en plakken of worstelen met technische crawlers? . Er is een gratis versie, dus je ziet zelf hoeveel tijd (en mentale rust) je bespaart.

En ben je benieuwd naar andere manieren waarop Thunderbit kan helpen — zoals , of — bekijk dan de voor meer handleidingen en tips.

Klaar om je tijd terug te winnen van handmatige dataverzameling? De toekomst van webdata-extractie is die van verticale AI-agenten — en Thunderbit loopt voorop. Probeer het uit en laat je volgende audit, leadlijst of onderzoeksproject de makkelijkste ooit zijn.

Meer lezen

P.S. Als je ooit in de verleiding komt om 1.000 URL’s met de hand te kopiëren en plakken, onthoud dan: daar bestaat nu AI voor. Je polsen (en je baas) zullen je dankbaar zijn.