Data is tegenwoordig de motor achter groei, maar eerlijk is eerlijk: data verzamelen voelt soms meer als een potje ganzenbord dan als even snel je tank volgooien. In 2025 is de hoeveelheid en variatie aan informatie die bedrijven moeten binnenhalen gigantisch. Of je nu razendsnel klantonderzoek wilt doen, prijzen van concurrenten wilt checken of een lijst met potentiële klanten wilt opbouwen, met de juiste online dataverzamelingsdienst verander je urenlang handmatig werk in een paar klikken en een kant-en-klare spreadsheet. Na jaren in SaaS en automatisering heb ik zelf gezien hoe het juiste hulpmiddel echt het verschil maakt voor je project (en je nachtrust).

Maar met zoveel opties—van enquêteplatforms tot webscrapers en formulierenbouwers—hoe maak je de juiste keuze? In deze gids zet ik de 9 beste online dataverzamelingsdiensten voor 2025 voor je op een rij, inclusief hun plus- en minpunten en wanneer je ze het beste kunt inzetten. Of je nu in sales zit, marktonderzoek doet of gewoon klaar bent met eindeloos knippen en plakken, er zit sowieso iets voor je tussen.

Waarom Online Dataverzamelingsdiensten Onmisbaar Zijn voor Moderne Organisaties

Even een beeld schetsen: in 2025 produceren we wereldwijd naar schatting aan data. Bedrijven die deze datastroom slim weten te benutten, groeien . Maar de uitdaging is: het draait om de juiste data, op het juiste moment, uit de juiste bronnen. Dat is precies wat de winnaars onderscheidt van de rest.

Online dataverzamelingsdiensten zijn inmiddels de ruggengraat van datagedreven werken. Ze nemen het saaie werk uit handen—denk aan klantfeedback verzamelen, webdata scrapen of leadlijsten bouwen—zodat je team zich kan focussen op analyse en actie. Salesafdelingen gebruiken webscrapers om duizenden leads per maand te genereren, terwijl e-commerce bedrijven realtime concurrentieprijzen en voorraad in de gaten houden. Aan de enquêtekant vertrouwt op online enquêtes voor klantfeedback, en gebruikt die input bij productontwikkeling.

Kortom: of je nu gestructureerde enquête-antwoorden verzamelt of juist ongestructureerde webdata, met het juiste hulpmiddel bespaar je tijd, voorkom je fouten en blijf je de concurrentie een stap voor.

Hoe We de Beste Online Dataverzamelingsdiensten Hebben Geselecteerd

Niet elk dataverzamelingshulpmiddel is hetzelfde. Zo heb ik de top 9 geselecteerd:

- Automatisering & AI: Vermindert het handmatig werk? Kan het taken inplannen, AI inzetten om velden te suggereren of zich automatisch aanpassen aan veranderingen?

- Gebruiksgemak: Is het toegankelijk voor niet-techneuten of zakelijke gebruikers? Drag-and-drop en AI-begeleiding scoorden hoog.

- Integratie & Export: Kun je makkelijk exporteren naar Excel, Google Sheets, Notion, Airtable of je CRM?

- Schaalbaarheid & Betrouwbaarheid: Kan het duizenden reacties of rijen aan zonder problemen? Is het geschikt voor grotere organisaties?

- Prijs & Waarde: Is er een gratis versie voor kleine projecten? Groeit de prijs eerlijk mee met je gebruik?

- Beste Toepassing: Sommige tools zijn enquête-specialisten, andere blinken uit in webscraping. Ik heb ze gekoppeld aan hun ideale scenario’s.

Daarnaast heb ik gebruikersreviews, expertmeningen en recente updates meegenomen om deze lijst zo praktisch mogelijk te maken.

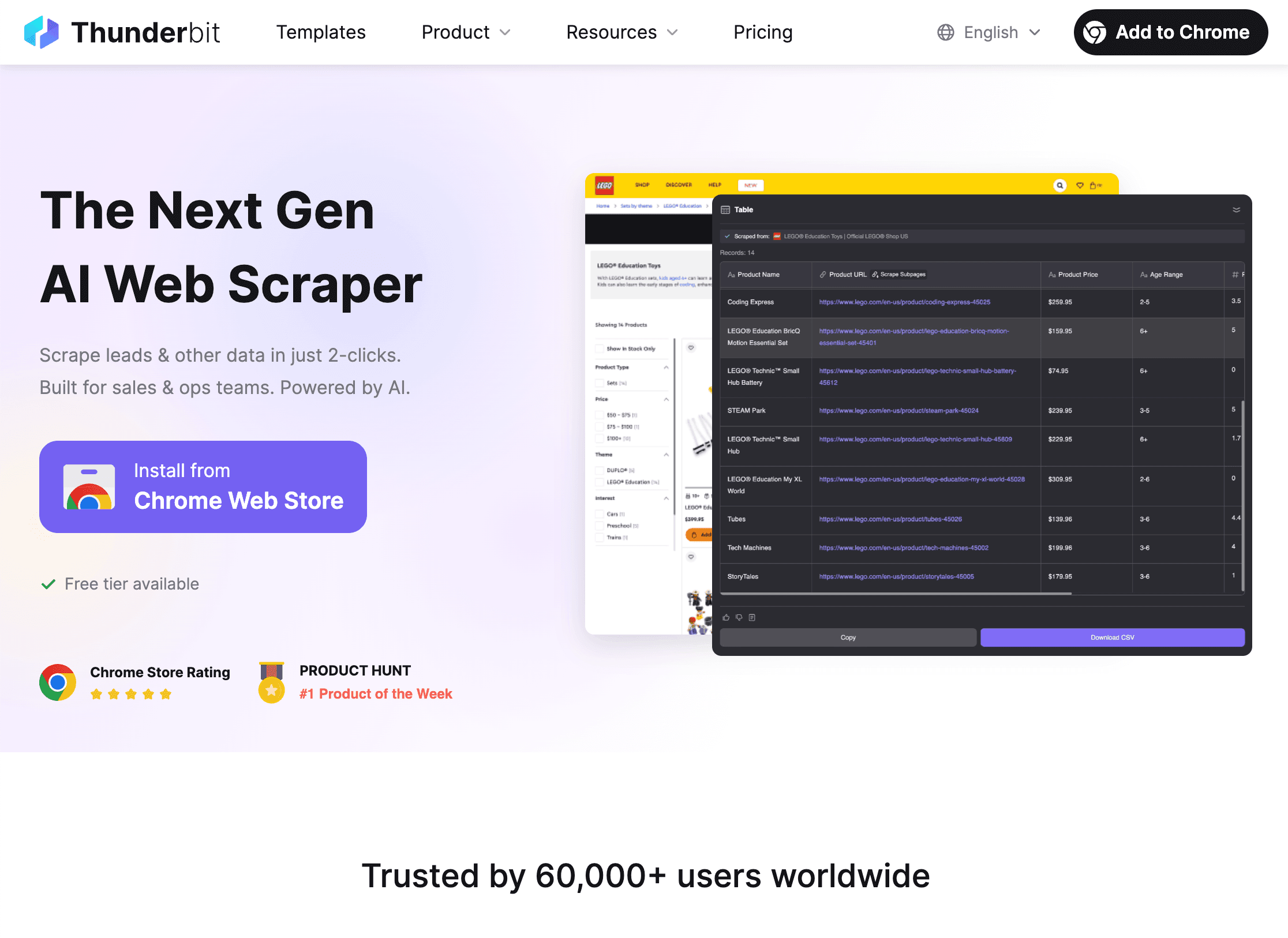

1. Thunderbit

is mijn absolute favoriet voor webdataverzameling die veel verder gaat dan simpele formulieren. Als is Thunderbit gemaakt voor zakelijke gebruikers die gestructureerde data uit elke website willen halen—zonder code, zonder sjablonen, zonder gedoe.

is mijn absolute favoriet voor webdataverzameling die veel verder gaat dan simpele formulieren. Als is Thunderbit gemaakt voor zakelijke gebruikers die gestructureerde data uit elke website willen halen—zonder code, zonder sjablonen, zonder gedoe.

Waarom Thunderbit eruit springt:

- AI-gestuurde Setup: Klik op “AI Suggest Fields” en Thunderbit scant de pagina, doet suggesties en stelt de scraper automatisch in. Het is alsof je een slimme AI-assistent hebt die precies weet wat je zoekt.

- Subpagina’s & Paginering: Data nodig van detailpagina’s of meerdere pagina’s? Thunderbit volgt links, klikt op “Volgende” en voegt alles samen in één tabel—volledig automatisch.

- Direct Exporteren: Exporteer je data direct naar Excel, Google Sheets, Airtable of Notion. Geen extra kosten, geen gedoe met CSV’s.

- Ongestructureerde Data: Thunderbit is niet alleen voor nette tabellen—het haalt ook e-mails, telefoonnummers, afbeeldingen en zelfs data uit PDF’s of afbeeldingen via OCR.

- Plannen & Cloud Scraping: Stel terugkerende taken in (“elke dag om 9 uur scrapen”) en laat Thunderbit’s cloudservers het zware werk doen—tot 50 pagina’s tegelijk.

Ideaal voor: Leadgeneratie, concurrentiemonitoring, e-commerce, marktonderzoek en iedereen die data uit complexe of rommelige websites wil halen.

Prijs: Gratis tot 6 pagina’s (of 10 met een proefboost), daarna betaalde plannen vanaf $15/maand voor 500 rijen. Alle functies inbegrepen—geen verborgen kosten voor export of AI.

Tip: Ben je klaar met kopiëren en plakken of vastlopende scrapers? Thunderbit’s AI-aanpak is een verademing, vooral voor ongestructureerde data zoals nichegidsen, productcatalogi of contactgegevens van lastige websites.

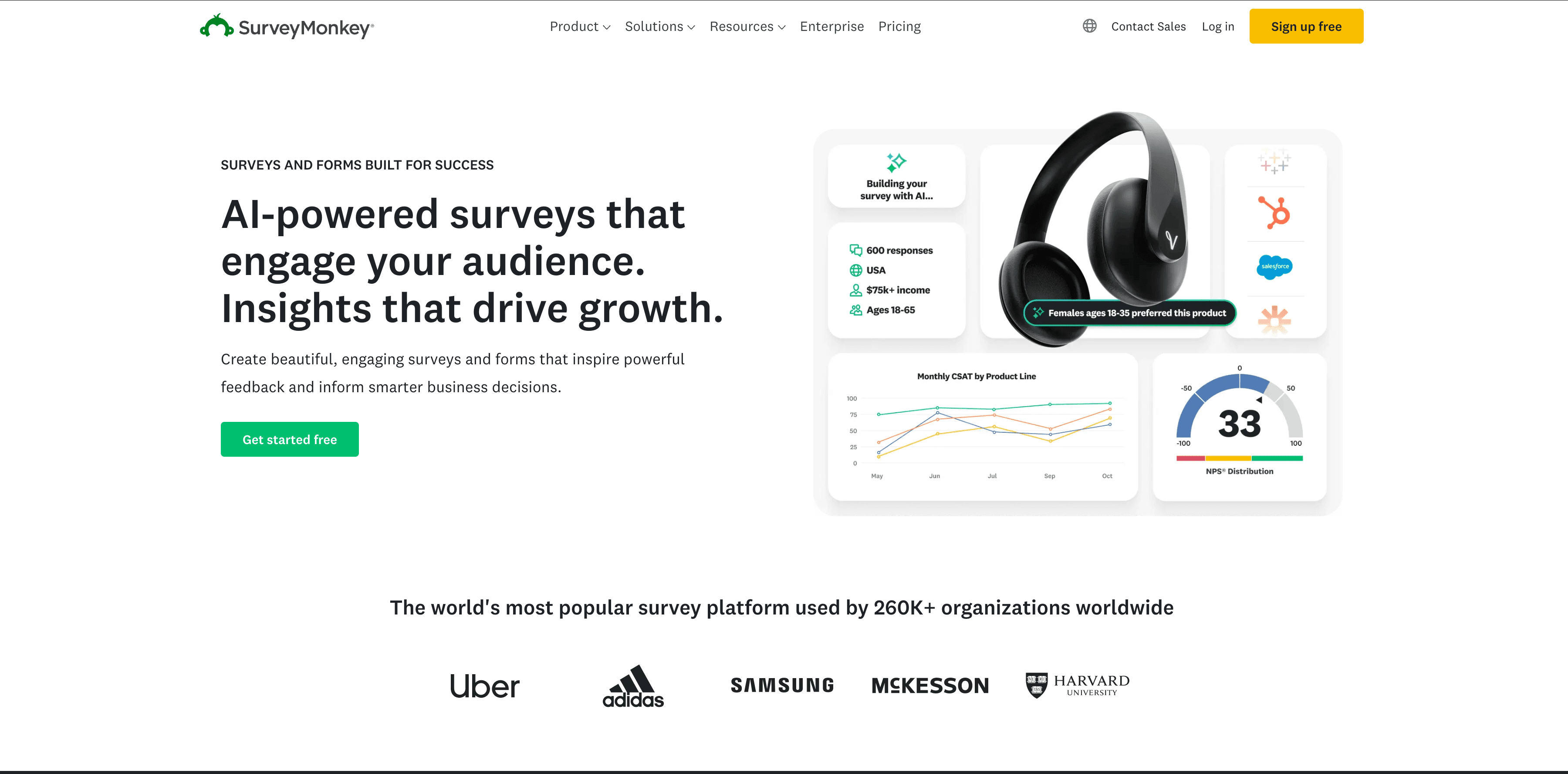

2. SurveyMonkey

is het klassieke online enquêteplatform—vertrouwd door zowel startups als multinationals voor het grootschalig verzamelen van klant-, medewerker- of marktonderzoek.

is het klassieke online enquêteplatform—vertrouwd door zowel startups als multinationals voor het grootschalig verzamelen van klant-, medewerker- of marktonderzoek.

Waarom SurveyMonkey opvalt:

- Enquêtesjablonen & AI-bouwer: Meer dan 400 kant-en-klare sjablonen en een AI-vraaggenerator maken het eenvoudig om in enkele minuten professionele enquêtes te lanceren.

- Geavanceerde Logica: Ondersteunt skip logic, vertakkingen en zelfs A/B-testvragen voor diepgaandere feedback.

- Distributie & Panel: Deel via web, e-mail, social media of koop gerichte reacties via het wereldwijde panel van SurveyMonkey.

- Analyse & Integraties: Realtime dashboards, export naar CSV/SPSS en koppelingen met Salesforce, Mailchimp, Slack en meer.

Ideaal voor: Klanttevredenheidsonderzoeken, medewerkerbetrokkenheid, marktonderzoek en elke situatie waarin je snel en schaalbaar feedback wilt verzamelen.

Prijs: Gratis plan (10 vragen, 25 reacties per enquête); betaalde plannen vanaf ca. $25/maand. Sommige integraties en geavanceerde functies vereisen hogere pakketten.

Tip: Het “Audience” panel van SurveyMonkey is ideaal als je geen eigen lijst hebt—je kunt reacties kopen van specifieke doelgroepen of regio’s.

3. Qualtrics

is de zwaargewicht voor enterprise-enquêtes, experience management en diepgaande analyses.

is de zwaargewicht voor enterprise-enquêtes, experience management en diepgaande analyses.

Waarom Qualtrics opvalt:

- Complexe Enquêtelogica: Dynamische vertakkingen, embedded data, randomisatie en geavanceerde vraagtypes (conjoint, max-diff, enz.).

- AI-Analyse: Ingebouwde sentimentanalyse (Text iQ), voorspellende analyses en Stats iQ voor geavanceerde statistiek—zonder dat je een expert hoeft te zijn.

- Workflowautomatisering: Acties triggeren op basis van antwoorden (bijv. supportticket aanmaken bij lage NPS), integratie met Salesforce, SAP en meer.

- Enterprise Security & Schaal: Rolgebaseerde toegang, compliance (GDPR, HIPAA) en sterke ondersteuning.

Ideaal voor: Grote organisaties, universiteiten of onderzoeksteams die complexe, grootschalige feedbackprogramma’s of marktonderzoek uitvoeren.

Prijs: Alleen voor enterprises (maatwerkoffertes, vaak tienduizenden per jaar).

Tip: Heb je boardroom-klare inzichten, maatwerkworkflows of directe koppeling met bedrijfsprocessen nodig? Qualtrics is de gouden standaard.

4. Google Forms

is de eenvoudige, volledig gratis oplossing voor snelle enquêtes, polls of interne dataverzameling.

is de eenvoudige, volledig gratis oplossing voor snelle enquêtes, polls of interne dataverzameling.

Waarom Google Forms opvalt:

- Eenvoud: Drag-and-drop bouwer, realtime samenwerking en directe koppeling met Google Sheets.

- Onbeperkt Gratis Gebruik: Geen limieten op formulieren of reacties—ideaal voor kleine teams of interne projecten.

- Integratie: Naadloze koppeling met Google Workspace (Sheets, Gmail) en uit te breiden via Zapier of Google Apps Script.

Ideaal voor: Snelle enquêtes, eventregistraties, interne polls of elke situatie waarin je in enkele minuten een formulier wilt maken.

Prijs: Gratis voor iedereen met een Google-account.

Tip: Niet het meest aanpasbaar of analytisch, maar Google Forms is ongeëvenaard in snelheid en eenvoud—perfect voor kleine bedrijven of ad-hoc projecten.

5. Typeform

is de koning van boeiende, interactieve enquêtes—ontworpen om de respons te verhogen met een conversatie-achtige, één-vraag-per-keer ervaring.

is de koning van boeiende, interactieve enquêtes—ontworpen om de respons te verhogen met een conversatie-achtige, één-vraag-per-keer ervaring.

Waarom Typeform opvalt:

- Conversational UX: Formulieren voelen als een gesprek, niet als een taak—met , ruim boven het gemiddelde.

- Design & Aanpasbaarheid: Mooie sjablonen, eigen branding en eenvoudig in te sluiten.

- Logica & Automatisering: Visuele logica, workflowautomatisering (e-mails sturen, CRM-koppeling) en integraties met HubSpot, Slack en meer.

Ideaal voor: Marketing, leadgeneratie, gebruikersonderzoek of elke situatie waarin gebruikerservaring en hoge respons belangrijk zijn.

Prijs: Gratis plan (10 reacties/maand); betaalde plannen vanaf $25/maand.

Tip: Hoe aantrekkelijker je formulier, hoe meer mensen het invullen. Typeform is mijn favoriet voor externe enquêtes waar elke reactie telt.

6. Zoho Survey

is de geïntegreerde enquête-oplossing voor bedrijven die al met Zoho werken—of voor wie veel functionaliteit wil voor een scherpe prijs.

is de geïntegreerde enquête-oplossing voor bedrijven die al met Zoho werken—of voor wie veel functionaliteit wil voor een scherpe prijs.

Waarom Zoho Survey opvalt:

- Zoho-integratie: Naadloze koppeling met Zoho CRM, Campaigns, Analytics en meer.

- Meertalig & Mobiel: Ondersteunt enquêtes in meerdere talen en offline dataverzameling via de mobiele app.

- Automatisering: Skip logic, e-mailtriggers en workflowintegratie (vooral krachtig met andere Zoho-apps).

Ideaal voor: Kleine tot middelgrote bedrijven, vooral als je al Zoho gebruikt.

Prijs: Gratis plan (100 reacties/enquête); betaalde plannen vanaf ca. $8/maand (jaarlijks).

Tip: Gebruik je al Zoho CRM? Dan is Zoho Survey een logische keuze—het koppelt feedback direct aan klantdata.

7. JotForm

is het Zwitsers zakmes onder de online formulieren—geschikt voor alles van enquêtes tot bestelformulieren, inschrijvingen en betalingen.

is het Zwitsers zakmes onder de online formulieren—geschikt voor alles van enquêtes tot bestelformulieren, inschrijvingen en betalingen.

Waarom JotForm opvalt:

- Drag-and-Drop Bouwer: Meer dan 2.000 sjablonen en een enorme bibliotheek aan widgets (e-handtekening, rekenmachines, bestandsuploads, enz.).

- Voorwaardelijke Logica & Workflows: Velden tonen/verbergen, automatische e-mails, goedkeuringsflows en berekeningen.

- Betalingsintegratie: Ontvang betalingen via PayPal, Stripe, Square en meer—direct in je formulier.

- Integraties: 100+ directe koppelingen (Salesforce, Google Drive, Airtable, enz.), plus Zapier en API.

Ideaal voor: MKB’s die flexibele formulieren nodig hebben voor inschrijvingen, bestellingen, enquêtes of andere dataverzameling die verder gaat dan simpele Q&A.

Prijs: Gratis plan (5 formulieren, 100 inzendingen/maand); betaalde plannen vanaf $34/maand.

Tip: JotForm is ideaal als je meer wilt dan alleen enquête-antwoorden—denk aan eventregistraties, bestelformulieren of alles met berekeningen of betalingen.

8. QuestionPro

is een uitgebreid enquêteplatform voor onderzoekers, academische teams en bedrijven die geavanceerde vraagtypes en analyses nodig hebben.

is een uitgebreid enquêteplatform voor onderzoekers, academische teams en bedrijven die geavanceerde vraagtypes en analyses nodig hebben.

Waarom QuestionPro opvalt:

- Geavanceerde Vraagtypes: Ondersteunt conjoint, max-diff, matrixvragen en meer—ideaal voor marktonderzoek.

- Complexe Logica: Gedetailleerde vertakkingen, loops en kwaliteitscontroles (zoals aandachtchecks, fraudedetectie).

- Panelbeheer: Bouw en beheer respondentpanels voor doorlopend onderzoek.

- Integraties: Google Sheets, Tableau, Salesforce, HubSpot en meer (sommige alleen in hogere pakketten).

Ideaal voor: Marktonderzoek, academische studies, grootschalige feedbackprogramma’s of situaties waar onderzoekskwaliteit vereist is.

Prijs: Gratis basisversie; betaalde plannen vanaf ca. $85/gebruiker/maand voor teams.

Tip: Wil je de kracht van Qualtrics zonder het enterprise prijskaartje? QuestionPro is een sterke optie, vooral voor onderzoeksteams.

9. Alchemer

(voorheen SurveyGizmo) is de tool voor bedrijven die maximale flexibiliteit, diepgaande aanpassing en workflowautomatisering willen—zonder enterprise-complexiteit.

(voorheen SurveyGizmo) is de tool voor bedrijven die maximale flexibiliteit, diepgaande aanpassing en workflowautomatisering willen—zonder enterprise-complexiteit.

Waarom Alchemer opvalt:

- Extreem Aanpasbaar: Geavanceerde vertakkingen, scripting, quota’s en eigen branding (zelfs custom HTML/CSS).

- Workflowautomatisering: 400+ integraties (CRM, databases, helpdesks), onbeperkt in alle plannen, en krachtige triggers (bijv. automatisch supporttickets aanmaken).

- Enterprise Features: Rolgebaseerde toegang, SSO, sterke beveiliging en snelle implementatie (meeste klanten live in dagen, niet maanden).

- Kostenefficiënt: Biedt 90% van de functionaliteit van Qualtrics voor ongeveer 20% van de prijs.

Ideaal voor: Grote bedrijven of teams die zeer op maat gemaakte enquêtes, complexe feedbackworkflows of diepe integratie met bedrijfsprocessen nodig hebben.

Prijs: Team- en Enterprise-plannen (middenklasse, maatwerkoffertes, doorgaans veel goedkoper dan Qualtrics).

Tip: Wil je dat je enquêteplatform zich aanpast aan jouw bedrijf—in plaats van andersom? Dan is Alchemer de beste keuze.

Snel Vergelijkingsoverzicht: Online Dataverzamelingsdiensten in één Oogopslag

| Service | Ideaal voor | Automatisering & AI | Integraties | Vanaf prijs | Unieke kracht |

|---|---|---|---|---|---|

| Thunderbit | Webscraping, sales leads, e-commerce | AI-gestuurd, subpagina/paginering, plannen | Excel, Sheets, Airtable, Notion | Gratis, $15/mnd | Eenvoudigste AI-webscraper, 2-kliks setup, verwerkt ongestructureerde data |

| SurveyMonkey | Klant-/medewerkerfeedback, marktonderzoek | AI-vragenbouwer, skip logic, A/B | Salesforce, Mailchimp, Slack, meer | Gratis, $25/mnd | 400+ sjablonen, koop reacties via Audience panel |

| Qualtrics | Enterprise onderzoek, CX/EX programma’s | Geavanceerde logica, Text iQ, workflow | SAP, Salesforce, BI-tools, API’s | $$$ (maatwerk) | Diepe analyses, workflowautomatisering, enterprise schaal |

| Google Forms | Snelle enquêtes, interne formulieren | Basis skip logic, auto-link naar Sheets | Google Workspace, Zapier | Gratis | Volledig gratis, direct inzetbaar, onbeperkt aantal reacties |

| Typeform | Hoge betrokkenheid, marketing, leads | Conversational UI, logica, workflow | HubSpot, Slack, Zapier, webhooks | Gratis, $25/mnd | 47% gemiddelde voltooiing, prachtig design |

| Zoho Survey | MKB, Zoho-gebruikers, meertalig | Skip logic, e-mailtriggers, mobiele app | Zoho CRM, Analytics, Zapier, API | Gratis, $8/mnd | Naadloze Zoho-integratie, betaalbaar voor MKB |

| JotForm | Flexibele formulieren, bestellingen, inschrijvingen | Voorwaardelijke logica, auto-e-mails, betalingen | 100+ apps, Salesforce, Drive, API | Gratis, $34/mnd | 2.000+ sjablonen, widgets, betaling & e-handtekening |

| QuestionPro | Marktonderzoek, academisch, grootschalig | Conjoint, vertakkingen, panelbeheer, QA | Sheets, Tableau, Salesforce, API | Gratis, $85/mnd | Onderzoekskwaliteit, panelbeheer |

| Alchemer | Maatwerkworkflows, enterprise feedback | Geavanceerde logica, scripting, triggers | 400+ (CRM, DB, helpdesk), API | $$ (maatwerk) | Maximale flexibiliteit, onbeperkte integraties, snelle implementatie |

De Juiste Online Dataverzamelingsdienst Kiezen voor Jouw Organisatie

Welke tool past het beste bij jou? Hier mijn advies:

- Wil je complexe webdata scrapen, leads automatiseren of concurrenten monitoren? Kies voor . Dankzij de AI-setup en directe export is dit de makkelijkste webscraper van 2025.

- Snel interne enquêtes of simpele feedback verzamelen? is gratis, snel en ideaal voor eenvoudige behoeften.

- Maximale respons en een prettige gebruikerservaring? is de beste keuze voor aantrekkelijke, interactieve formulieren.

- Werk je al met Zoho voor CRM of bedrijfsvoering? sluit naadloos aan op je workflow.

- Geavanceerde analyses, vertakkingen of enterprise feedback nodig? , of zijn dan de beste opties—kies op basis van je budget en integratiebehoeften.

- Flexibele formulieren voor bestellingen, inschrijvingen of betalingen? is de meest veelzijdige alles-in-één bouwer.

- Op zoek naar een betrouwbaar, allround enquêteplatform? blijft de favoriet voor de meeste feedbackbehoeften.

Tip: Begin met een gratis proefversie of plan, test met een klein project en kijk welke tool het beste bij je team en workflow past. Laat je niet verleiden door functies die je nooit gebruikt—kies het eenvoudigste hulpmiddel dat aan je eisen voldoet en goed integreert met je bestaande systemen.

En vergeet niet: de echte waarde zit niet alleen in het verzamelen van data, maar in het omzetten naar actie. De beste tool is degene die je helpt de cirkel rond te maken—analyseren, delen en slimmer beslissen.

Veelgestelde Vragen

1. Wat is het verschil tussen een webscraper en een enquêteplatform?

Een webscraper (zoals Thunderbit) haalt automatisch data van websites—ideaal voor het verzamelen van productinformatie, prijzen of contactgegevens. Enquêteplatforms (zoals SurveyMonkey of Typeform) zijn bedoeld om gestructureerde feedback van mensen te verzamelen via formulieren of vragenlijsten.

2. Welke tool is het beste voor klantfeedback?

Voor snelle, eenvoudige enquêtes zijn Google Forms of SurveyMonkey prima. Voor diepgaandere analyses of grootschalige feedback zijn Qualtrics of Alchemer beter geschikt.

3. Kan ik data direct exporteren naar Excel of Google Sheets met deze tools?

Ja—Thunderbit, SurveyMonkey, Google Forms, Zoho Survey, JotForm en anderen ondersteunen directe export naar Excel, Sheets of via integraties.

4. Zijn er gratis opties voor online dataverzameling?

Zeker. Google Forms, de gratis versies van SurveyMonkey, Zoho Survey, JotForm en Thunderbit laten je kosteloos starten, al bieden betaalde plannen meer functies en hogere limieten.

5. Hoe kies ik de juiste online dataverzamelingsdienst voor mijn bedrijf?

Bepaal eerst je belangrijkste gebruik (webscraping, enquêtes, formulieren, enz.), je integratiebehoeften en je budget. Test een paar tools met een klein project en kies degene die het makkelijkst werkt voor je team en goed past in je workflow.

Klaar om je dataverzameling in 2025 te versnellen? om AI-webscraping te proberen, of ontdek meer tips en gidsen op de . Succes met dataverzamelen!