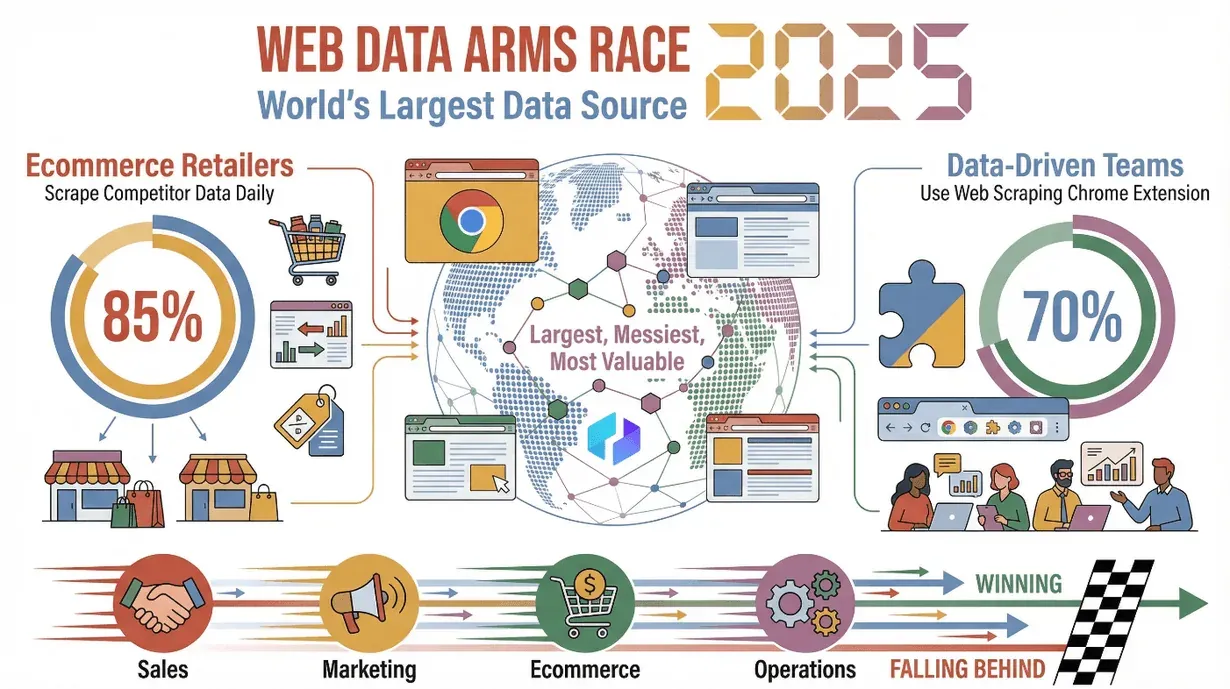

Het internet is tegenwoordig veel meer dan alleen een plek voor grappige kattenfilmpjes en memes—het is uitgegroeid tot de grootste, meest chaotische en waardevolle databron die je je kunt voorstellen. In 2025 is er echt sprake van een datawedloop: , en meer dan . Of je nu in sales, marketing, e-commerce of operations werkt: snel de juiste data in het juiste formaat verzamelen, kan het verschil maken tussen vooroplopen of achterblijven.

Toch is er een uitdaging: websites zijn niet bepaald gemaakt om makkelijk data te verzamelen. Ze zijn vaak rommelig, veranderen continu en zijn bedoeld voor mensen, niet voor spreadsheets. Webscraping tools brengen daar verandering in: ze maken van die chaos overzichtelijke, bruikbare tabellen. Na jaren ervaring in SaaS en automatisering weet ik: de juiste tool bespaart je uren werk, verhoogt de nauwkeurigheid en laat je inzichten ontdekken die je anders nooit had gevonden.

Toch is er een uitdaging: websites zijn niet bepaald gemaakt om makkelijk data te verzamelen. Ze zijn vaak rommelig, veranderen continu en zijn bedoeld voor mensen, niet voor spreadsheets. Webscraping tools brengen daar verandering in: ze maken van die chaos overzichtelijke, bruikbare tabellen. Na jaren ervaring in SaaS en automatisering weet ik: de juiste tool bespaart je uren werk, verhoogt de nauwkeurigheid en laat je inzichten ontdekken die je anders nooit had gevonden.

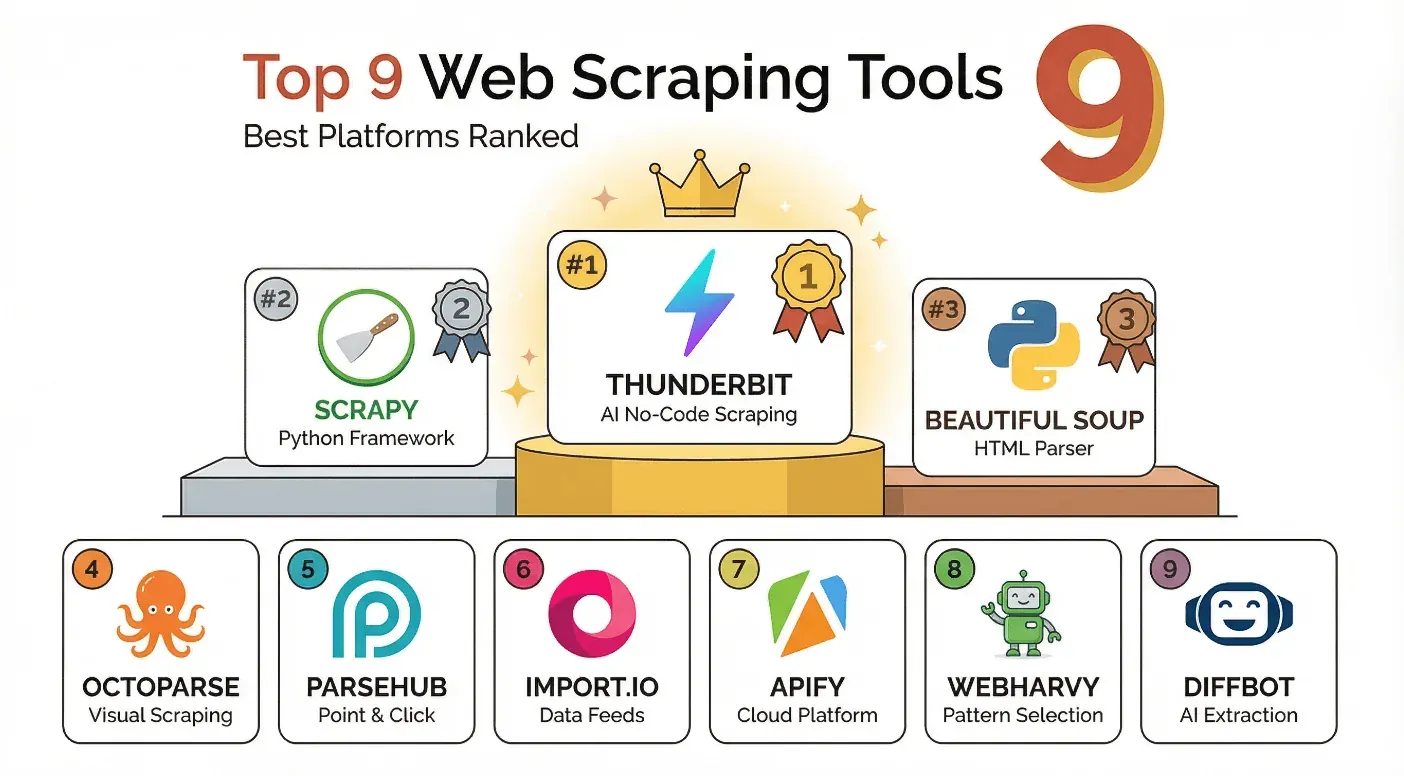

Welke webscraping tools zijn in 2025 écht de moeite waard? Ik heb de negen beste voor je op een rij gezet—van AI-gedreven Chrome-extensies voor zakelijke gebruikers tot open-source frameworks voor ontwikkelaars. Laten we erin duiken.

Waarom Webscraping Tools Onmisbaar Zijn voor Moderne Bedrijven

Webscraping tools zijn de geheime kracht achter slimmere sales, effectievere marketing en flexibelere bedrijfsvoering. Waarom zijn ze zo belangrijk?

- Leadgeneratie: Sales-teams halen gericht leads uit bedrijvengidsen, LinkedIn en reviewwebsites.

- Concurrentieanalyse: Marketing- en e-commerceteams houden prijzen, productlanceringen en advertenties van concurrenten in de gaten—vaak real-time.

- Marktonderzoek: Analisten en onderzoekers verzamelen reviews, nieuws en klantfeedback om trends te spotten vóór de concurrentie.

- Prijsmonitoring: Winkels en merken checken prijzen en voorraad op honderden sites om scherp te blijven ().

- Contentaggregatie: Operations-teams halen data uit vacaturebanken, woningaanbod of leverancierscatalogi om processen te stroomlijnen.

Hier zie je in één oogopslag hoe webscraping tools bedrijfsresultaten verbeteren:

| Zakelijk Doel | Handmatig Probleem | Webscraping Oplossing |

|---|---|---|

| Leadgeneratie | Kopiëren van tientallen sites | Automatische extractie, bulk export |

| Prijsmonitoring | Dagelijks handmatig controleren | Geplande scraping, directe alerts |

| Marktonderzoek | Honderden reviews lezen | Geaggregeerde, gestructureerde data |

| Contentaggregatie | Data samenvoegen van meerdere sites | Gecombineerde export naar Excel/Sheets |

| Concurrentieanalyse | Trage, onvolledige data | Real-time, volledig inzicht |

Het voordeel is duidelijk: bedrijven die moderne scraping tools inzetten , en .

Hoe We de Beste Webscraping Tools Hebben Geselecteerd

Niet elke webscraping tool is hetzelfde. Sommige zijn gemaakt voor zakelijke gebruikers die zonder code resultaat willen, andere zijn juist bedoeld voor ontwikkelaars die maatwerk en schaalbaarheid zoeken. Hier lette ik op bij het selecteren van de beste tools:

- Gebruiksgemak: Kun je zonder technische kennis snel aan de slag? Is de interface logisch?

- Schaalbaarheid: Kan de tool honderden of zelfs miljoenen pagina’s aan? Kun je taken automatiseren en plannen?

- Exportmogelijkheden: Kun je exporteren naar Excel, Google Sheets, Airtable, Notion of via een API?

- Support & Community: Is er goede documentatie, zijn er tutorials en krijg je snel hulp?

- Prijs & Waarde: Is er een gratis versie? Zijn de betaalde pakketten transparant en eerlijk?

- Unieke functies: Denk aan AI-gedreven extractie, subpagina scraping, API-integratie of visuele workflows.

Ik heb elke tool gekoppeld aan het type bedrijfssituatie waarvoor deze het beste past—zodat je snel ziet welke tool aansluit bij jouw wensen en technische niveau.

1. Thunderbit

is mijn favoriet voor zakelijke gebruikers die met AI webdata willen verzamelen zonder technische rompslomp. Als Chrome-extensie is Thunderbit ideaal voor sales, marketing, e-commerce en operations die snel gestructureerde, betrouwbare data nodig hebben.

Wat maakt Thunderbit uniek? Het draait om eenvoud én kracht:

- AI-gestuurde veldsuggesties: Klik op “AI Suggest Fields” en Thunderbit leest de pagina, stelt kolommen voor (zoals Naam, Prijs, E-mail) en maakt automatisch extractieprompts aan.

- Subpagina scraping: Meer details nodig? Thunderbit’s AI bezoekt automatisch subpagina’s (zoals product- of profielpagina’s) en verrijkt je dataset—zonder extra instellingen.

- Direct exporteren: Stuur je data direct naar Excel, Google Sheets, Airtable of Notion. Exporteren is altijd gratis.

- Geplande scraping: Automatiseer terugkerende taken (zoals dagelijkse prijschecks) met natuurlijke taal.

- Gratis E-mail, Telefoon en Afbeelding-extractors: Haal contactgegevens of afbeeldingen van elke site met één klik.

- AI-autovullen: Laat AI online formulieren voor je invullen—ideaal voor workflows en repetitieve taken.

Thunderbit wordt vertrouwd door meer dan , en met het kun je tot 6 pagina’s scrapen (of 10 met een proefboost). Betaalde abonnementen starten vanaf slechts $15/maand voor 500 credits—geschikt voor teams van elke omvang.

Wil je Thunderbit in actie zien? Bekijk ons of lees onze voor tips en handleidingen.

2. Scrapy

is hét open-source framework voor ontwikkelaars die volledige controle willen over hun webscrapingprojecten. Scrapy is geschreven in Python en laat je eigen spiders bouwen die data op grote schaal kunnen verzamelen en verwerken.

Waarom kiezen ontwikkelaars voor Scrapy?

- Krachtig framework: Ondersteunt complexe, meerlaagse crawls, eigen pipelines en API-integraties.

- Schaalbaar: Geschikt voor grote projecten, gelijktijdige verzoeken en het scrapen van veel pagina’s tegelijk ().

- Uitbreidbaar: Voeg eenvoudig middleware toe voor proxies, user agents of JavaScript-rendering (met Splash).

- Actieve community: Veel tutorials, plugins en ondersteuning voor geavanceerde toepassingen.

Scrapy is ideaal voor teams met Python-kennis die grootschalig willen scrapen, data willen integreren in pipelines of robuuste, herhaalbare workflows willen bouwen. Het is open-source en gratis, maar je moet wel zelf je omgeving opzetten en onderhouden.

3. Beautiful Soup

is een Python-bibliotheek die geliefd is bij beginners vanwege de eenvoud en kracht bij het parsen van HTML en XML. Wil je snel data halen uit statische webpagina’s? Dan is Beautiful Soup een uitstekende keuze.

Waarom kiezen voor Beautiful Soup?

- Toegankelijk voor beginners: Makkelijk te leren, met veel uitleg en voorbeelden ().

- Flexibel parsen: Kan ook rommelige of onvolledige HTML aan.

- Ideaal voor kleine projecten: Perfect voor eenmalige scripts, snelle dataverzameling of om de basis van webscraping te leren.

Beperkingen? Beautiful Soup is niet geschikt voor grote of dynamische sites en kan geen JavaScript aan. Combineer het voor die gevallen met requests of Selenium, of stap over op Scrapy.

4. Octoparse

is een no-code webscraping tool voor iedereen—van zelfstandige ondernemers tot grote teams. Dankzij de visuele interface kun je zelfs complexe of dynamische websites eenvoudig scrapen.

Waarom gebruikers fan zijn van Octoparse:

- Geen code nodig: Visuele workflowbouwer, drag-and-drop selectors en kant-en-klare sjablonen.

- Cloud & lokaal: Draai scrapes op je eigen computer of in de cloud voor grotere, snellere taken.

- Kan omgaan met paginering & dynamische content: Scrape “Load more”-pagina’s, oneindig scrollen en AJAX-sites.

- Exportmogelijkheden: Download als CSV, Excel, JSON, HTML of exporteer naar databases ().

De gratis versie is geschikt voor kleine klussen, betaalde pakketten starten rond $75/maand voor intensiever gebruik. Favoriet voor marktonderzoek, concurrentieanalyse en iedereen die zonder code resultaat wil.

5. ParseHub

is een visuele scraping tool die uitblinkt op JavaScript-rijke en dynamische websites. Met de workflowbouwer kun je klikken, lussen en voorwaardelijk data extraheren—zelfs van lastige sites.

ParseHub’s sterke punten:

- Visuele data selectie: Klik op elementen om te selecteren, doorloop lijsten en scrape subpagina’s.

- Ondersteunt dynamische content: Haal data op die door JavaScript wordt geladen, werk met dropdowns en automatiseer klikken.

- Flexibele export: Download als CSV, Excel, JSON of koppel aan Dropbox/Amazon S3 ().

- Gratis versie: Tot 5 projecten en 200 pagina’s per run; betaalde pakketten bieden meer mogelijkheden.

ParseHub is ideaal voor gevorderde gebruikers die flexibiliteit willen zonder te programmeren. Vooral populair voor e-commerce, vacaturesites en vastgoeddata.

6. Import.io

is gericht op grootschalige data-extractie en visualisatie voor bedrijven. Met een gebruiksvriendelijke interface, uitgebreide ondersteuning en geavanceerde analyses is Import.io ideaal voor grote projecten.

Wat maakt Import.io bijzonder?

- Point-and-click extractie: Geen code nodig—selecteer simpelweg de gewenste data.

- Datavisualisatie: Analyseer, visualiseer en deel je resultaten direct.

- Enterprise-functies: Voldoet aan compliance, biedt managed services en ondersteunt grote volumes.

- Export & integratie: Download als CSV, Excel of koppel aan Google Sheets en BI-tools ().

De prijs is afgestemd op grote bedrijven, dus vooral geschikt voor organisaties met veel databehoefte en bijpassend budget.

7. Apify

is een platform voor schaalbare webautomatisering en maatwerk data-extractie. Ontwikkelaars bouwen, draaien en delen hier eenvoudig scraping “actors” (vooraf gebouwde of eigen scripts).

Waarom Apify een topkeuze is:

- Marketplace van actors: Toegang tot 200+ kant-en-klare scrapers voor bekende sites, of bouw je eigen in JavaScript/Python.

- API-first: Integreer gescrapete data direct in je workflows of applicaties.

- Cloud deployment: Draai taken op schaal, plan terugkerende jobs en beheer alles vanuit één dashboard ().

- Flexibele prijsstelling: Gratis voor kleine klussen; betaal per gebruik voor grotere projecten.

Apify is perfect voor technische teams die willen automatiseren, opschalen en webdata direct in hun bedrijfsprocessen willen integreren.

8. WebHarvy

is een point-and-click webscraping tool die automatisch patronen op webpagina’s herkent. Ideaal voor niet-technische gebruikers die geen zin hebben in XPath of CSS-selectors.

Belangrijkste kenmerken van WebHarvy:

- Automatische patroonherkenning: Klik op een data-element en WebHarvy vindt vergelijkbare velden ().

- Ondersteunt AJAX/JavaScript: Kan dynamische content, afbeeldingen en keyword-gebaseerde extractie aan.

- Exportmogelijkheden: Download als Excel, CSV, XML, JSON of SQL.

- Eenmalige licentie: Betaal één keer, gebruik voor altijd (inclusief een jaar updates/support).

WebHarvy is populair bij kleine bedrijven, onderzoekers en zelfstandigen die visueel willen werken en geen geavanceerde automatisering nodig hebben.

9. Diffbot

is de AI-krachtpatser op het gebied van webdata-extractie. Met machine learning en computer vision zet Diffbot elke publieke webpagina om in gestructureerde data—zonder handmatige instellingen.

Wat maakt Diffbot uniek?

- AI-gedreven extractie: Herkent en haalt automatisch entiteiten, relaties en feiten uit webpagina’s ().

- Knowledge Graph: Toegang tot een enorme, continu bijgewerkte database van personen, bedrijven, producten en meer.

- API-toegang: Integreer gestructureerde data direct in je apps, onderzoek of analyses ().

- Enterprise-ready: Gebruikt door onder andere Microsoft, Adobe en Hubspot.

Prijzen starten bij $299/maand voor startups, met pay-per-call opties voor API-gebruik (). Ideaal voor onderzoek, enterprise data science en iedereen die AI-niveau nauwkeurigheid op schaal nodig heeft.

Vergelijkingstabel Webscraping Tools

Hier vind je een overzicht van alle negen tools naast elkaar:

| Tool | Beste Voor | No-Code | AI-gedreven | API/Dev Vriendelijk | Subpagina Scraping | Exportopties | Prijs (vanaf) |

|---|---|---|---|---|---|---|---|

| Thunderbit | Zakelijke gebruikers | Ja | Ja | Nee | Ja | Excel, CSV, Sheets, Notion, Airtable | Gratis (6 pagina’s), $15/mnd |

| Scrapy | Ontwikkelaars | Nee | Nee | Ja | Ja (maatwerk) | CSV, JSON, XML, DB | Gratis, open-source |

| Beautiful Soup | Beginners, devs | Nee | Nee | Ja | Nee | Maatwerk (via Python) | Gratis, open-source |

| Octoparse | Niet-coders, teams | Ja | Nee | Gedeeltelijk | Ja | CSV, Excel, JSON, DB | Gratis, $75/mnd |

| ParseHub | Visueel, dynamische sites | Ja | Nee | Gedeeltelijk | Ja | CSV, Excel, JSON, S3, Dropbox | Gratis, $189/jaar |

| Import.io | Enterprise, analytics | Ja | Nee | Ja | Ja | CSV, Excel, Sheets, BI-tools | Maatwerk, enterprise |

| Apify | Devs, automatisering | Nee | Nee | Ja | Ja | CSV, JSON, Sheets, API | Gratis, pay-as-you-go |

| WebHarvy | Niet-coders, MKB | Ja | Nee | Nee | Ja | Excel, CSV, XML, JSON, SQL | $139/jaar (eenmalig) |

| Diffbot | AI, onderzoek, enterprise | Nee | Ja | Ja | Ja (AI-crawl) | JSON, Knowledge Graph API | $299/mnd |

De Juiste Webscraping Tool Kiezen

Welke tool past het beste bij jou? Hier een handig overzicht:

- Voor niet-coders/zakelijke gebruikers: Thunderbit, Octoparse, ParseHub, WebHarvy

- Voor ontwikkelaars/automatisering: Scrapy, Beautiful Soup, Apify

- Voor enterprise/AI-behoeften: Import.io, Diffbot

- Voor dynamische of JavaScript-rijke sites: ParseHub, Octoparse, Apify

- Voor directe, gestructureerde export: Thunderbit, Import.io

Mijn tip? Begin bij je zakelijke doel en technische vaardigheden. Wil je AI-gedreven, moeiteloos scrapen en direct exporteren? Dan is een uitstekende keuze. Wil je volledige controle of zelf crawlers bouwen? Kies dan voor Scrapy of Apify. Voor enterprise of AI-gedreven data zijn Import.io en Diffbot de toppers.

De meeste tools bieden gratis proefversies—dus probeer gerust verschillende opties en ontdek wat het beste werkt voor jouw workflow.

Veelgestelde Vragen

1. Wat is een webscraping tool en waarom heb ik er één nodig?

Een webscraping tool is software die data van websites haalt en omzet in gestructureerde formaten zoals spreadsheets of databases. Bedrijven gebruiken ze voor leadgeneratie, prijsmonitoring, marktonderzoek en meer—het bespaart tijd en verhoogt de nauwkeurigheid ten opzichte van handmatig kopiëren.

2. Is webscraping legaal?

Webscraping is toegestaan zolang je alleen openbare data verzamelt en de gebruiksvoorwaarden van websites respecteert. Vermijd altijd het scrapen van persoonlijke of gevoelige informatie zonder toestemming en check de lokale wetgeving.

3. Welke webscraping tool is het beste voor niet-coders?

Thunderbit, Octoparse, ParseHub en WebHarvy zijn allemaal geschikt voor niet-technische gebruikers. Thunderbit springt eruit door AI-veldherkenning en directe export naar Excel, Google Sheets, Notion of Airtable.

4. Kan ik dynamische of JavaScript-rijke websites scrapen?

Zeker! Tools als ParseHub, Octoparse en Apify zijn speciaal gemaakt voor dynamische content, AJAX en “Load more”-pagina’s. Thunderbit’s AI past zich ook aan veel moderne websites aan.

5. Hoe kies ik de juiste webscraping tool voor mijn bedrijf?

Kijk naar je technische kennis, hoeveelheid data, exportwensen en budget. Niet-coders kunnen het beste starten met Thunderbit of Octoparse; ontwikkelaars kiezen vaak voor Scrapy of Apify; grote bedrijven met veel databehoefte kunnen Import.io of Diffbot overwegen. De meeste tools bieden gratis proefversies—probeer er een paar uit en ontdek wat het beste werkt.

Klaar om van het web je volgende concurrentievoordeel te maken? of lees meer tips op onze . Veel succes met scrapen!

Meer weten?