Afgelopen kwartaal zat ons operations-team 40 uur per week concurrentiedata te copy-pasten naar spreadsheets. Dit kwartaal? 20 minuten.

Het verschil? geautomatiseerde webscrapingtools. Die zijn geëvolueerd van “alleen voor developers” naar iets dat elke sales rep of marketeer even snel tijdens de lunch kan instellen.

Ik bouw al jaren SaaS- en automatiseringstools (en ja, ik ben medeoprichter van ). De lichting tools van 2026 is tot nu toe de sterkste: AI-first, zelfherstellend en écht bruikbaar voor mensen zonder technische achtergrond.

Hieronder vind je 10 tools die ik zelf hands-on heb getest, vergeleken op use case en benodigde skills.

Waarom geautomatiseerde webscrapingtools belangrijk zijn voor zakelijke gebruikers

Laten we eerlijk zijn: de tijd van handmatig data kopiëren van websites is voorbij (tenzij je houdt van RSI en existentiële wanhoop). geautomatiseerde webscrapingtools zijn inmiddels bedrijfskritisch voor organisaties van elke omvang. Sterker nog: , en webscraping is daar een belangrijk onderdeel van.

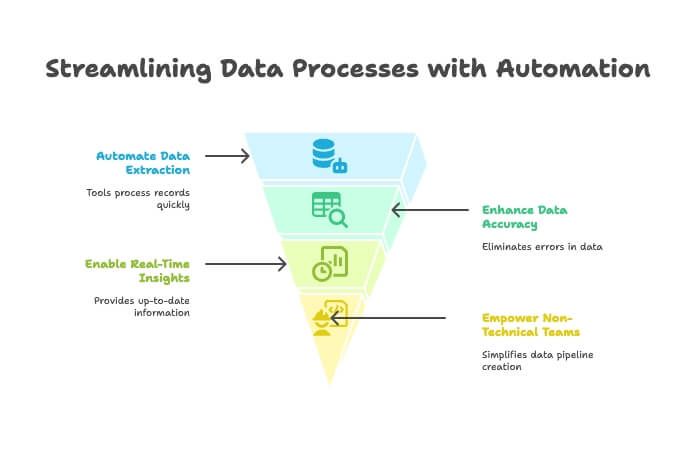

Dit is waarom deze tools zoveel waarde leveren:

- Bespaar tijd & verminder handwerk: Geautomatiseerde scrapers verwerken duizenden records in minuten, zodat je team zich kan richten op werk met meer impact. Een gebruiker meldde “honderden uren” te hebben bespaard door dataverzameling te automatiseren ().

- Betere datakwaliteit: Geen typefouten of gemiste regels meer. Automatische extractie levert schonere, betrouwbaardere data.

- Snellere besluitvorming: Met realtime datastromen volg je concurrenten, monitor je prijzen of bouw je leadlijsten zonder te wachten op het maandelijkse “stagiairsrapport”.

- Ook voor niet-technische teams: Dankzij no-code en AI-gedreven tools kunnen zelfs mensen die denken dat “XPath” een yogahouding is, webdatapijplijnen bouwen ().

Het is dan ook geen verrassing dat , en bijna 80% zegt dat hun organisatie zonder die data niet effectief kan opereren. In 2026 geldt: als je je dataverzameling niet automatiseert, laat je waarschijnlijk geld—en inzichten—liggen.

Hoe we de beste geautomatiseerde webscrapingtools hebben gekozen

Nu de markt voor webscrapingsoftware naar verwachting , kan de juiste keuze voelen als schoenen kopen in een winkel met 10.000 modellen. Zo heb ik het teruggebracht tot een shortlist:

- Gebruiksgemak: Kan iemand zonder developer-achtergrond snel starten? Hoe steil is de leercurve?

- AI-mogelijkheden: Herkent de tool automatisch velden, kan hij dynamische sites aan, of kun je in gewone taal beschrijven wat je nodig hebt?

- Export & integraties: Hoe makkelijk krijg je data in Excel, Google Sheets, Airtable, Notion of je CRM?

- Prijs: Is er een gratis proefperiode? Zijn betaalde plannen haalbaar voor individuen en kleine teams, of vooral enterprise?

- Schaalbaarheid: Werkt het zowel voor kleine eenmalige klussen als voor grote, geplande extracties?

- Doelgroep: Is het gemaakt voor business users, developers, of allebei?

- Unieke pluspunten: Wat maakt deze tool onderscheidend?

Ik heb tools opgenomen voor elk niveau—van “ik wil gewoon een spreadsheet” tot “ik wil het hele internet crawlen”. Tijd voor de lijst.

1. Thunderbit: de AI-webscraper voor iedereen

Ik trap af met de tool die ik door en door ken—want mijn team en ik hebben ’m gebouwd om precies die frustraties weg te nemen die ik al jaren bij zakelijke gebruikers zie. is geen klassieke “drag-and-drop” of “bouw-je-eigen-selector” scraper. Het is een AI-gedreven data-assistent: jij zegt wat je wilt, en de tool doet het zware werk—zonder code, zonder gedoe met XPath, zonder tranen.

Waarom Thunderbit bovenaan staat

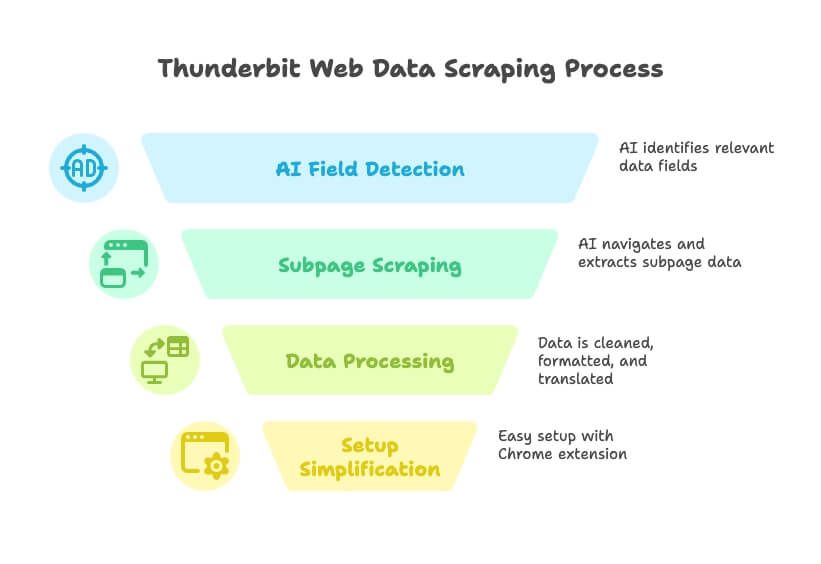

Thunderbit komt het dichtst in de buurt van “van elke website een database maken”. Zo werkt het:

- Aangestuurd door natuurlijke taal: Vertel Thunderbit welke data je nodig hebt (“ik wil alle bedrijfsnamen, e-mails en telefoonnummers uit deze directory”), en de AI herkent de relevante velden.

- AI Suggest Fields: Met één klik leest Thunderbit de pagina en stelt de beste kolommen voor—geen giswerk of eindeloze trial-and-error.

- Subpagina’s & multi-level scraping: Details nodig per listing? Thunderbit klikt door, haalt extra info op en voegt die toe aan je tabel.

- Data opschonen, vertalen en classificeren: Thunderbit pakt niet alleen ruwe data; het kan ook opschonen, formatteren, vertalen en velden categoriseren tijdens het scrapen.

- Geen gedoe met setup: Installeer de , klik op “AI Suggest Fields” en je bent binnen een minuut aan het scrapen.

- Gratis proef & lage instapprijs: Ruime gratis versie (scrape tot 6 pagina’s gratis), met betaalde plannen vanaf $9/maand. Minder dan wat ik in een week aan koffie uitgeef.

Thunderbit is gemaakt voor sales-, marketing- en operations-teams die snel data nodig hebben. Geen code, geen plugins, geen training. Zie het als een data-stagiair die wél luistert en nooit klaagt.

Thunderbit’s opvallende functies

- AI-gedreven scraping: De AI begrijpt paginastructuur, past zich aan lay-outwijzigingen aan en handelt paginering en subpagina’s automatisch af ().

- Direct exporteren: Stuur resultaten meteen naar Excel, Google Sheets, Airtable, Notion of download als CSV/JSON.

- Cloud of lokaal draaien: Run scrapes in de cloud voor snelheid en schaal, of in je browser als je je login/sessie nodig hebt.

- Geplande scraper: Stel terugkerende jobs in om data actueel te houden—ideaal voor prijsmonitoring of periodieke lead-updates.

- Onderhoudsarm: Thunderbit’s AI past zich aan websitewijzigingen aan, zodat je minder tijd kwijt bent aan het repareren van kapotte scrapers ().

Voor wie? Iedereen die van “ik heb deze data nodig” naar “hier is je spreadsheet” wil in minuten—zeker niet-technische gebruikers. Met en een 4,9★-score groeit Thunderbit snel uit tot de standaard voor business teams die resultaat willen, geen hoofdpijn.

Wil je het in actie zien? Bekijk het of lees meer in de .

2. Clay: geautomatiseerde data-enrichment gecombineerd met webscraping

Clay is een soort Zwitsers zakmes voor growth-teams. Het is niet alleen een webscraper tool—het is een automatiserings-spreadsheet die met 50+ live databronnen koppelt (denk aan Apollo, LinkedIn, Crunchbase) en ingebouwde AI gebruikt om leads te verrijken, outreach-mails te schrijven en prospects te scoren.

- Workflow-automatisering: Elke rij is een lead; elke kolom kan data ophalen of een actie starten. Een bedrijfslist scrapen, verrijken met LinkedIn-profielen en een gepersonaliseerde mail sturen? Clay kan het.

- AI-integratie: Gebruikt GPT-4 voor icebreakers, bio-samenvattingen en meer.

- Integraties: Koppelt native met HubSpot, Salesforce, Gmail, Slack en meer.

- Prijs: Vanaf ongeveer $99/maand voor het Professional-plan, met een gratis proef voor licht gebruik.

Beste voor: Outbound sales, growth hackers en marketeers die een eigen lead-pipeline willen bouwen—scraping, enrichment en outreach in één omgeving. Krachtig, maar als je nieuw bent met automation tools is er wel een leercurve ().

3. Bardeen: browsergebaseerde webscraper voor workflow-automatisering

Bardeen voelt als een browserrobot die data kan scrapen én repetitieve webtaken automatiseert—allemaal vanuit een Chrome-extensie.

- No-code automatisering: 500+ “Playbooks” voor scraping, formulieren invullen, data tussen apps verplaatsen en meer.

- AI Command Builder: Beschrijf je taak in gewone taal en Bardeen bouwt de workflow.

- Integraties: Werkt met Notion, Trello, Slack, Salesforce en 100+ andere apps.

- Prijs: Gratis voor licht gebruik (100 automation credits/maand), met betaalde plannen vanaf $99/maand voor teams.

Beste voor: Power users en go-to-market teams die scraping willen combineren met vervolgacties in meerdere apps. Heel flexibel, maar voor beginners kan het wat veel zijn ().

4. Bright Data: enterprise-grade geautomatiseerde webscrapingtools

Bright Data (voorheen Luminati) is het zware geschut van webscraping—denk aan wereldwijde proxy-netwerken, geavanceerde API’s en de capaciteit om duizenden pagina’s per dag te crawlen.

- Enterprise-schaal: 100+ miljoen IP’s, Web Scraper IDE, Web Unlocker om anti-botmaatregelen te omzeilen.

- Aanpasbaar: Bouw complexe, grootschalige extracties met hoge betrouwbaarheid.

- Prijs: Vanaf $499/maand voor de Web Scraper IDE, met kleinere “micro”-pakketten.

Beste voor: Grote ondernemingen, data-aggregators en gevorderde gebruikers die robuuste, schaalbare oplossingen nodig hebben. Als je dagelijks duizenden pagina’s crawlt en IP-blokkades wilt vermijden, is Bright Data hiervoor gemaakt ().

5. Octoparse: visuele webscraper voor gevorderde beginners

Octoparse is een populaire no-code tool met een visuele point-and-click interface—ideaal als je kracht wilt zonder te programmeren.

- Drag-and-drop UI: Klik elementen aan om te bepalen wat je wilt extraheren; ondersteunt logins, paginering en meer.

- Templates: 500+ kant-en-klare templates voor veelgebruikte sites (Amazon, Twitter, enz.).

- Cloud scraping: Draai jobs op Octoparse-servers, plan extracties en gebruik IP-rotatie.

- Prijs: Gratis plan met beperkingen; betaalde plannen vanaf $119/maand.

Beste voor: Niet-programmeurs en data-analisten die een capabele scraper willen zonder code. Sterk voor prijsmonitoring, productlijsten en researchprojecten ().

6. : dataplatform voor webscraping voor bedrijven

is een van de pioniers in webscraping en is inmiddels uitgegroeid tot een volwaardig data-extractieplatform.

- Point-and-click extractie: Kan omgaan met logins, dropdowns en interactieve elementen.

- Cloud-based: Verwerk duizenden URL’s parallel, plan extracties en gebruik API’s.

- Enterprise-focus: Ingezet voor prijsmonitoring, marktonderzoek en het bouwen van machine-learning datasets.

- Prijs: Starter $199/maand, Standard $599/maand, Advanced $1.099/maand.

Beste voor: Middelgrote tot grote organisaties en datateams die betrouwbare, onderhouden oplossingen nodig hebben voor grote volumes. Voor hobbyprojecten vaak te zwaar, maar voor business-scale een powerhouse ().

7. Parsehub: flexibele webscraper met visuele editor

Parsehub is een desktopapp (Windows, Mac, Linux) waarmee je scrapers bouwt door door de interface van een website te klikken.

- Visuele workflow: Selecteer elementen, stel extractieregels in en verwerk logins, dropdowns en infinite scroll.

- Cloudfuncties: Draai scrapes in de cloud, plan jobs en gebruik API-toegang.

- Prijs: Gratis tier voor kleine klussen; betaalde plannen vanaf $149/maand.

Beste voor: Onderzoekers, mkb’ers of individuen die meer controle willen dan een browserextensie, maar nog niet zelf willen coderen ().

8. Common Crawl: open webdata voor AI en onderzoek

Common Crawl is niet echt een tool in de klassieke zin—het is een gigantische open dataset met webcrawl-data, maandelijks bijgewerkt.

- Schaal: ~400 TB webdata, met miljarden webpagina’s.

- Gratis & open: Je hoeft geen eigen crawler te draaien.

- Technische skills vereist: Je hebt big data tooling en engineering-ervaring nodig om de data te filteren en te parsen.

Beste voor: Data scientists en engineers die AI-modellen bouwen of grootschalig onderzoek doen. Voor algemene webtekst of langetermijnarchieven is dit een goudmijn ().

9. Crawly: lichtgewicht geautomatiseerde webscrapingtool voor startups

Crawly (van Diffbot) is een cloud-based, AI-gedreven crawler die data van miljoenen websites kan vastleggen en gestructureerde resultaten teruggeeft—zonder parsingregels.

- AI-extractie: Gebruikt machine vision en NLP om content te herkennen en te extraheren.

- API-toegang: Query de verzamelde data en integreer met analytics of databases.

- Prijs: Enterprise-niveau; prijs op aanvraag.

Beste voor: Startups en teams met enige technische kennis die grootschalige, slimme webdata-extractie willen zonder zelf scrapers te bouwen ().

10. Apify: developer-vriendelijke webscraper met marketplace

Apify is een cloudplatform waarop je eigen scrapers (“Actors”) bouwt of een bibliotheek met community-scrapers gebruikt.

- Flexibiliteit voor developers: Ondersteunt scraping met JavaScript/Python, headless Chrome, proxybeheer en scheduling.

- Marketplace: Grote bibliotheek met kant-en-klare scrapers voor populaire sites.

- Prijs: Gratis tier met $5/maand aan credits; betaalde plannen vanaf $49/maand.

Beste voor: Developers en technisch sterke analisten die maximale controle en schaalbaarheid willen. Ook niet-coders kunnen pre-built Actors gebruiken voor veelvoorkomende taken ().

Vergelijkingstabel: geautomatiseerde webscrapingtools

| Tool | Gebruiksgemak | AI-functies | Prijs (vanaf) | Doelgroep | Unieke pluspunten |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Natuurlijke taal, AI Suggest Fields, subpagina-scraping | $9/maand | Niet-technische zakelijke gebruikers | Setup in 2 klikken, geen code, directe export, gratis proef |

| Clay | ★★★★☆ | AI-enrichment, GPT-4 | $99/maand | Growth/sales ops | Automatiserings-spreadsheet, enrichment, outreach |

| Bardeen | ★★★★☆ | AI command builder | $99/maand | Power users, GTM-teams | Browser-RPA, 500+ playbooks, diepe integraties |

| Bright Data | ★★☆☆☆ | Proxy-rotatie, anti-bot AI | $499/maand | Enterprises, developers | Schaal, betrouwbaarheid, wereldwijde proxies |

| Octoparse | ★★★★☆ | Visuele AI-detectie | $119/maand | Analisten, niet-coders | Drag-and-drop, templates, cloud scraping |

| Import.io | ★★★☆☆ | Interactieve extractors | $199/maand | Enterprises, datateams | Parallel verwerken, scheduling, API, support |

| Parsehub | ★★★★☆ | Visuele workflows | $149/maand | Onderzoekers, mkb | Desktopapp, kan dynamische sites aan |

| Common Crawl | ★☆☆☆☆ | N.v.t. (alleen dataset) | Gratis | Data scientists, engineers | Enorme open dataset, web-scale archieven |

| Crawly | ★★☆☆☆ | AI-extractie | Custom/Enterprise | Startups, tech-teams | AI-gedreven, geen parsingregels, API-toegang |

| Apify | ★★★★☆ | Actor marketplace | $49/maand | Developers, tech-analisten | Bouwen/marketplace, cloud-automatisering, flexibiliteit |

Zo kies je de juiste webscraper voor jouw situatie

De beste geautomatiseerde webscrapingtool hangt af van je teamgrootte, technische vaardigheden en doelen. Mijn snelle richtlijn:

- Voor niet-technische gebruikers (Sales, Marketing, Ops): Kies . Gemaakt voor jou—geen code, geen setup, gewoon resultaat. Ideaal voor leadgeneratie, prijsmonitoring en snelle dataklussen.

- Voor teams die leven voor automatisering: Clay en Bardeen zijn top als je scraping wilt combineren met enrichment, outreach of workflow-automatisering.

- Voor enterprises & developers: Bright Data, en Apify zijn het meest geschikt voor grootschalige, sterk aanpasbare projecten.

- Voor onderzoekers & analisten: Octoparse en Parsehub bieden visuele interfaces en krachtige functies zonder dat je hoeft te coderen.

- Voor AI- & data science-projecten: Common Crawl en Crawly leveren enorme datasets en AI-gedreven extractie voor wie modellen wil bouwen of trainen.

Stel jezelf de vraag: wil je binnen minuten starten, of heb je een maatwerkoplossing op enterprise-niveau nodig? Twijfel je, begin dan met een gratis proef—de meeste tools bieden die.

Thunderbit’s unieke waarde: AI-assistent voor businessdata

Tussen al deze tools valt Thunderbit op als de enige die echt aanvoelt als een “AI-assistent” voor webscraping én datatransformatie. Het gaat niet alleen om data ophalen—het gaat om rommelige websites omzetten naar nette, gestructureerde inzichten, zonder technische drempels.

- Interface in natuurlijke taal: Beschrijf wat je nodig hebt in gewone taal; Thunderbit regelt de rest.

- Volledige workflow-automatisering: Van extractie tot opschonen, vertalen en exporteren—Thunderbit dekt het hele proces.

- Perfect voor snel experimenteren: Een nieuwe markt valideren, een leadlijst bouwen of concurrenten monitoren? Thunderbit is de snelste en goedkoopste start.

Het is alsof je een data-analist in je browser hebt—één die nooit om salarisverhoging vraagt en nooit vakantie neemt.

Conclusie: start slimmer met de juiste geautomatiseerde webscrapingtool

Het scraping-landschap van 2026 lijkt totaal niet meer op dat van twee jaar geleden. Zelfherstellende AI-scrapers, LLM-native pipelines en no-code tools die écht prettig werken hebben alles veranderd. Of je nu solo-founder bent, een lean salesteam runt of enterprise data scientist bent: er staat hier een tool tussen die past. De sleutel is je workflow en skills matchen met het juiste platform—zodat je stopt met worstelen met code en begint met het ontsluiten van inzichten.

Klaar om handmatig copy-pasten achter je te laten en slimmer te werken? en ervaar hoe eenvoudig webscraping kan zijn. Of kies een van de andere opties op basis van je doelen. Hoe dan ook: de toekomst van datagedreven business is voor teams die automatiseren.

Meer leren? Bekijk voor deep dives, tutorials en tips om meer uit je webdata te halen. Veel scrape-plezier—en hopelijk blijft je data altijd schoon en breken je scrapers nooit (en als het toch gebeurt: laat de AI het oplossen).

Veelgestelde vragen

1. Waarom zijn geautomatiseerde webscrapingtools in 2026 belangrijk voor zakelijke gebruikers?

geautomatiseerde webscrapingtools maken dataverzameling veel efficiënter: je bespaart tijd, vermindert handwerk en verhoogt de nauwkeurigheid. Ze ondersteunen realtime besluitvorming en maken het mogelijk dat niet-technische teams webdata kunnen gebruiken zonder code te schrijven. Voor sales, marketing en operations zijn ze inmiddels essentieel.

2. Wat maakt Thunderbit anders dan andere webscrapingtools?

Thunderbit gebruikt AI zodat je in gewone taal kunt aangeven welke data je wilt. Het detecteert velden automatisch, verwerkt subpagina’s en paginering, en exporteert resultaten direct naar tools zoals Excel en Airtable. Het is ontworpen voor niet-technische gebruikers en biedt daarnaast functies zoals data opschonen en een geplande scraper, tegen een lage instapprijs.

3. Welke tool is het beste voor grootschalige enterprise scrapingprojecten?

Bright Data en zijn zeer geschikt voor enterprise. Ze bieden onder andere proxy-rotatie, anti-botmaatregelen, grootschalige parallelle verwerking en API-toegang—ideaal voor organisaties die betrouwbaar duizenden webpagina’s op schaal moeten verwerken.

4. Zijn er tools die scraping combineren met automatisering en outreach?

Ja. Clay en Bardeen combineren webscraping met workflow-automatisering. Clay verrijkt leads en automatiseert outreach, terwijl Bardeen browser-taken en workflows automatiseert met AI-gestuurde playbooks.

5. Wat is de beste optie voor gebruikers zonder technische achtergrond?

Thunderbit is de beste keuze voor niet-technische gebruikers dankzij de interface in natuurlijke taal, AI-gestuurde setup en het gebruiksgemak. Je hebt geen code of ingewikkelde configuratie nodig—ideaal voor zakelijke gebruikers die snel betrouwbare data willen zonder technische complexiteit.