Trustpilot heeft verspreid over 1,27 miljoen bedrijven — en de meeste scrapers die zijn gebouwd om die data te extraheren, zijn maanden geleden al stukgegaan. Als je onlangs hebt geprobeerd reviews op te halen, ben je waarschijnlijk vastgelopen op de beruchte login-muur op pagina 10 en kreeg je tool alleen nog maar een foutmelding terug.

Ik heb de afgelopen weken tools getest, onderzocht en vergeleken die in 2026 nog betrouwbaar Trustpilot-reviewdata kunnen ophalen. Het speelveld is flink veranderd: Trustpilot heeft strengere anti-botbeveiliging, de Next.js-frontend genereert classnamen die bij elke uitrol veranderen, en — het allerbelangrijkste — zonder in te loggen stopt de toegang nu al na 10 reviewpagina’s. Een vatte de frustratie perfect samen: "none of the actors on the store work."

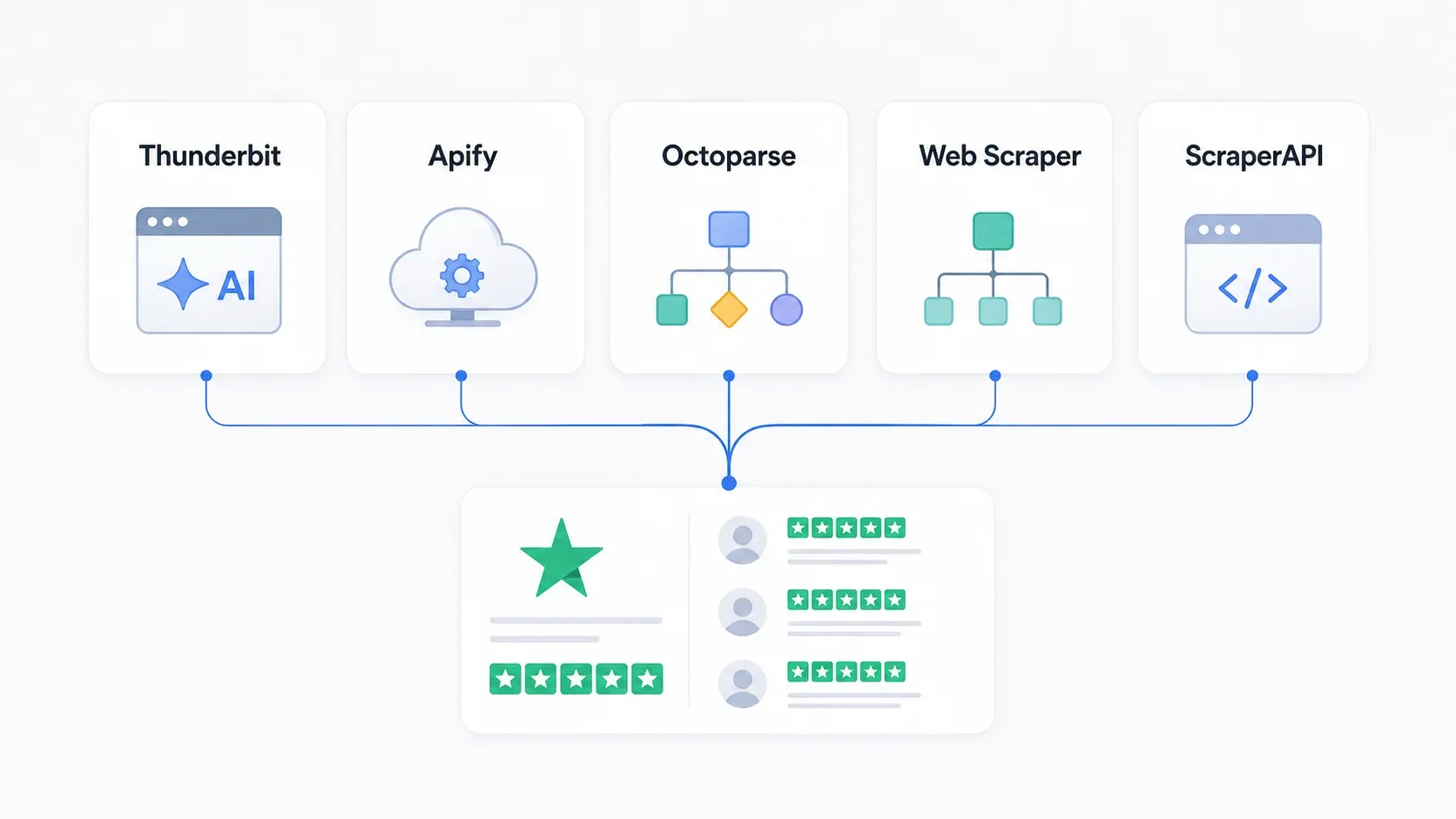

Welke tools werken dan wél? Ik heb er vijf beoordeeld op hoe ze omgaan met de login-muur, anti-botmaatregelen, onderhoudslast en de praktische behoeften van zowel marketeers als developers.

Waarom Trustpilot-reviews scrapen in 2026 lastiger is dan het lijkt

Trustpilot is geen simpele statische website die je met een basis-HTTP-verzoek ophaalt en met BeautifulSoup parsed. Het is een modern, dynamisch gerenderd platform op basis van Next.js, en de beveiliging is het afgelopen jaar merkbaar strenger geworden.

Waar je in de praktijk mee te maken hebt:

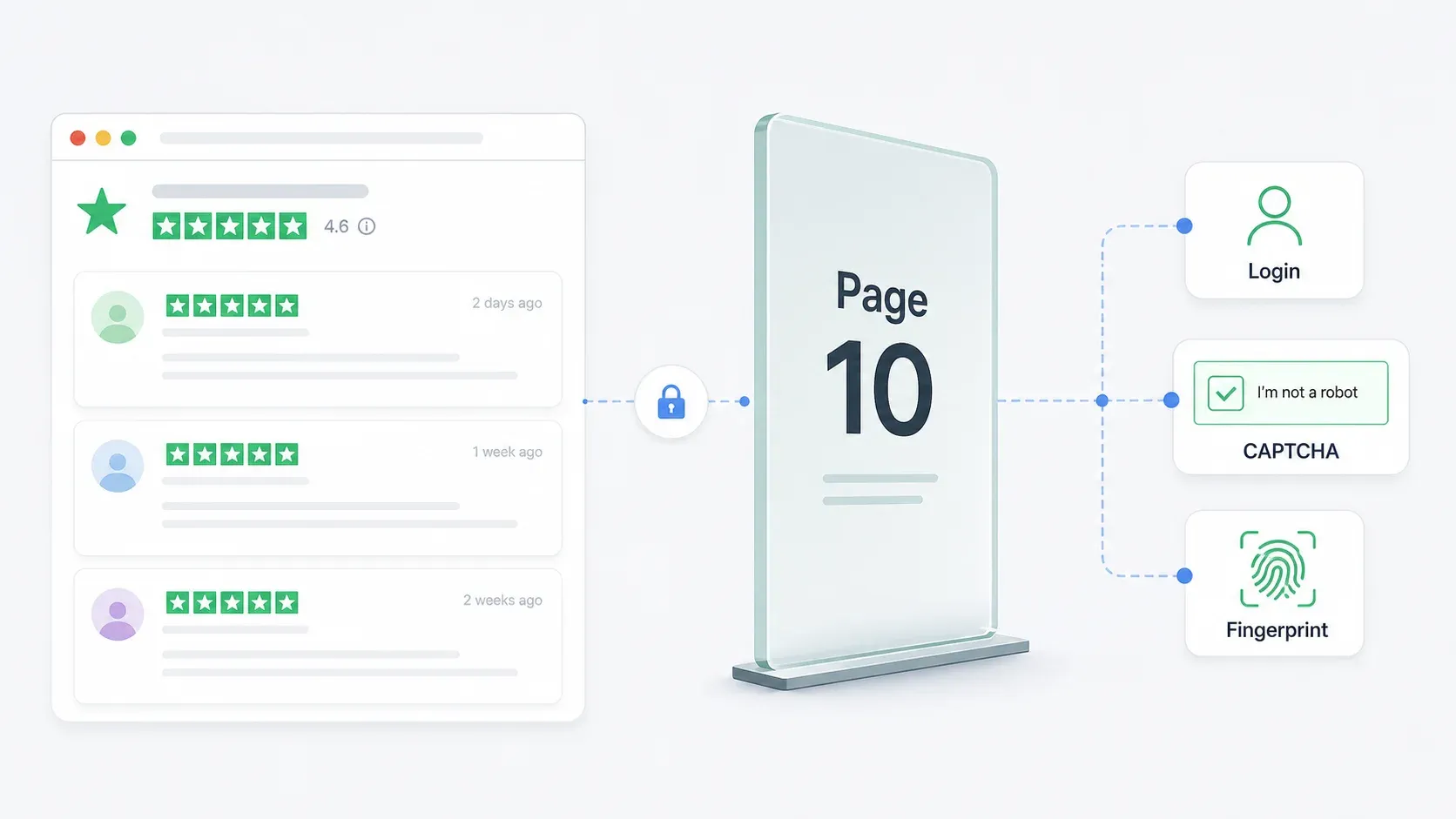

De login-muur op pagina 10. Dit is het grootste knelpunt. bevestigt dat Trustpilot slechts de eerste 10 reviewpagina’s toestaat voordat er een loginprompt verschijnt. Voor een bedrijf met 2.000 reviews (ongeveer 100 pagina’s met 20 reviews per pagina) mis je dus 90% van de data, tenzij je een geauthenticeerde sessie hebt.

Anti-botbeveiliging. Trustpilot gebruikt reCAPTCHA, blokkering op basis van sessies, requestfiltering op CDN-niveau en browser fingerprinting. Op de staat expliciet dat de site "protected by reCAPTCHA" is en apparaats- en interactiesignalen verzamelt.

Dynamische CSS-classnamen. Omdat Trustpilot Next.js met CSS-modules gebruikt, worden classnamen zoals styles_reviewCardInner__EwDq2 tijdens de build gegenereerd en veranderen ze telkens wanneer Trustpilot een update uitrolt. vertrouwt op precies deze selectors — wat betekent dat code op basis van die tutorial bij de volgende frontendwijziging stukgaat.

Wijzigingen in de DOM-structuur. Naast classnamen kan ook de HTML-hiërarchie zelf verschuiven. Elementen worden anders genest, er verschijnen nieuwe wrappers en paginatiecomponenten worden opnieuw opgebouwd.

Scrapers die leunen op CSS-selectors — of het nu Apify Actors, Octoparse-workflows of custom Python-scripts zijn — zijn op Trustpilot structureel kwetsbaar. Ze werken totdat ze het niet meer doen. En "totdat ze het niet meer doen" wordt vaak gemeten in weken, niet in maanden.

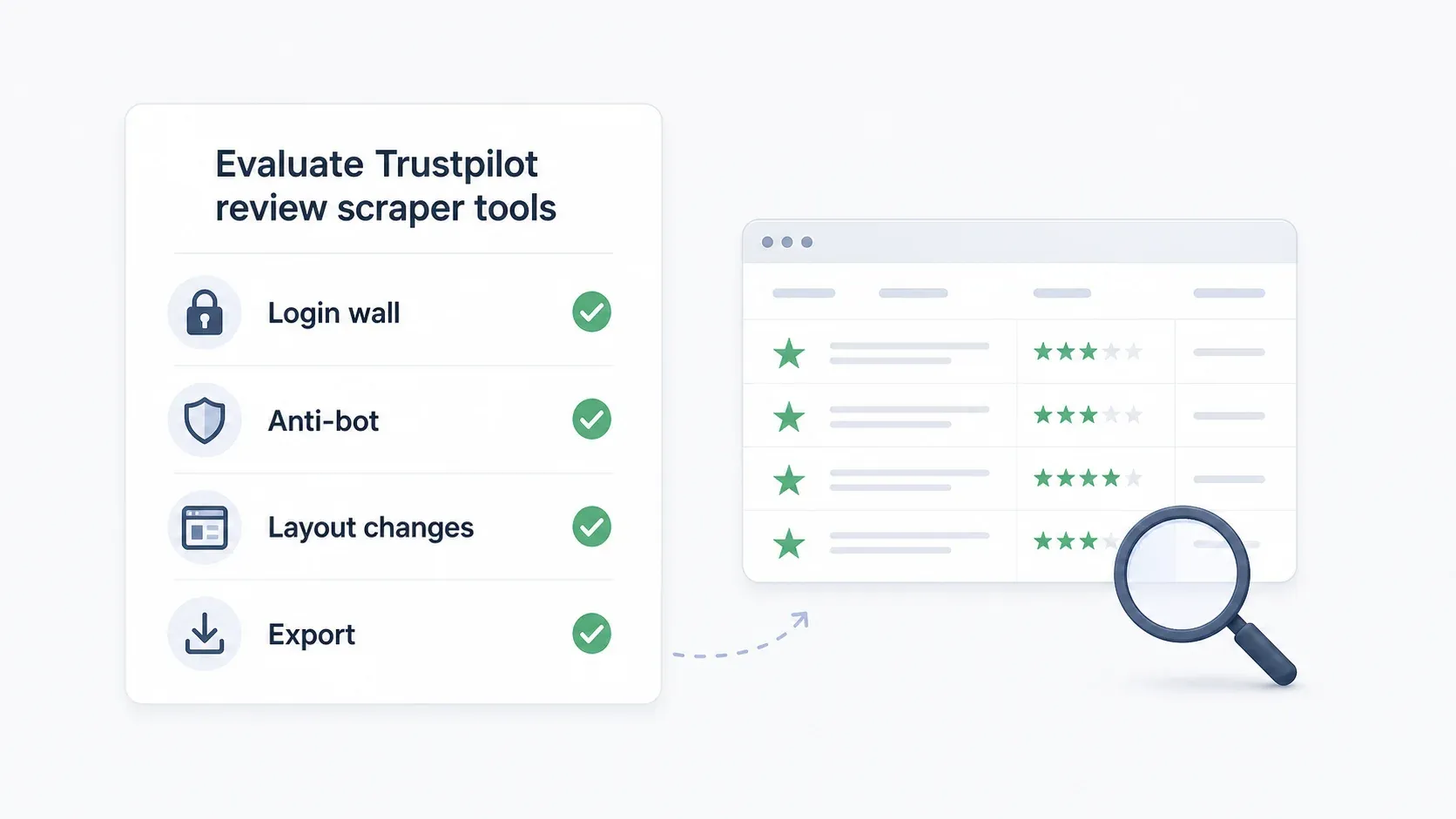

Waar we op hebben gelet bij de beste Trustpilot-reviewscrapers

Ik heb deze tools niet beoordeeld met een generieke "kan het een webpagina scrapen"-checklist. Elke tool op deze lijst kan namelijk data uit een simpele HTML-pagina halen.

De echte vraag: kan de tool in 2026 specifiek met Trustpilot uit de voeten, inclusief alle eigenaardigheden?

Dit vonden we het belangrijkst:

| Criteria | Waarom dit belangrijk is voor Trustpilot |

|---|---|

| Omgaan met login-muur (pagina 10+) | De meeste bedrijven hebben veel meer dan 200 reviews. Een limiet van 10 pagina’s betekent dat je het grootste deel van de historische data mist. |

| Aanpak om anti-bot te omzeilen | reCAPTCHA, sessieblokkering en CDN-filtering stoppen naïeve scrapers meteen. |

| Robuustheid van selectors / onderhoud | Gegenereerde CSS-classnamen breken selector-based tools regelmatig. Kan de tool zichzelf herstellen? |

| Ondersteuning voor paginatie | Reviews beslaan honderden pagina’s. Handmatig pagina voor pagina extraheren is niet haalbaar. |

| No-code versus codevereiste | Marketeers willen point-and-click; developers willen volledige controle. |

| Prijs / gratis plan | Budgetbewuste teams willen duidelijkheid voordat ze zich vastleggen. |

| Exportopties | Zakelijke gebruikers hebben Google Sheets, Airtable, Notion nodig — niet alleen ruwe JSON. |

De login-muur is de dealbreaker.

Als een tool niet voorbij pagina 10 komt — of ten minste een duidelijke route biedt voor geauthenticeerde toegang — dan is het in 2026 geen bruikbare Trustpilot-scraper.

Beste Trustpilot-reviewscrapers in één oogopslag

De volledige vergelijking:

| Tool | Niveau | Omgaan met login-muur | Anti-botaanpak | Paginatie | Gratis plan | Exportopties |

|---|---|---|---|---|---|---|

| Thunderbit | No-code | Browsermodus (gebruikt je ingelogde Chrome-sessie) | AI-semantische extractie past zich aan lay-outwijzigingen aan | Automatische detectie, meerdere pagina’s | 6 pagina’s gratis/maand | Excel, Sheets, Airtable, Notion, CSV, JSON |

| Apify | Low-code | Afhankelijk van de Actor; sommige vereisen cookieconfiguratie voor pagina’s >10 | Ingebouwde proxyrotatie, Actor-specifiek | Configureerbaar per Actor | $5/maand gratis platformcredits | JSON, CSV, Excel, XML, RSS |

| Octoparse | No-code (visueel) | Handmatige cookie-/sessieconfiguratie | IP-rotatie, residential proxies, CAPTCHA-oplossing (betaald) | Click/scroll-workflow | Gratis plan + 14-daagse premium proefperiode | CSV, Excel, JSON, HTML, XML, databases |

| Web Scraper | No-code (sitemap) | Beperkt — eigen gids documenteert limiet van 10 reviewpagina’s | Cloud + proxy op betaalde plannen | Configureerbaar; JS-click aanbevolen | Gratis Chrome-extensie | CSV, XLSX |

| ScraperAPI | Developer (Python) | Sessies/cookies beheren op code-niveau | 40M+ residential proxies, JS-rendering, CAPTCHA-afhandeling | Op code gebaseerd | 7-daagse proefperiode, 5.000 API-credits | Door developer bepaald (CSV, JSON, enz.) |

1. Thunderbit

is een AI-gedreven Chrome-extensie voor zakelijke teams die gestructureerde data van websites nodig hebben zonder code te schrijven. Voor Trustpilot biedt het specifiek een die in twee klikken de naam van de reviewer, beoordeling, reviewtitel, reviewtekst, datum en bedrijfsreactie extraheert.

Ik ben bevooroordeeld — ik werk hier — maar de reden dat we Thunderbit zo hebben gebouwd, sluit direct aan op waarom Trustpilot scrapen lastig is. Onze AI leest pagina’s semantisch in plaats van te vertrouwen op CSS-selectors. Wanneer Trustpilot zijn classnamen verandert of de DOM herschikt, past Thunderbit zich aan omdat het kijkt naar de betekenis van pagina-elementen, niet naar hun specifieke HTML-adressen.

Hoe Thunderbit omgaat met de login-muur op pagina 10

Hier komt browsermodus van pas. Thunderbit draait binnen je Chrome-browser — dezelfde browser waarin je al bent ingelogd op Trustpilot. Wanneer je overschakelt naar browser-scrapingmodus, leest de extensie de pagina’s die zichtbaar zijn in je geauthenticeerde sessie. Geen proxy-acrobatiek. Geen cookie-injectie. Geen Playwright-session pools.

De praktische workflow: log in op Trustpilot in Chrome, ga naar de reviewpagina die je wilt, klik op "AI Suggest Fields" en vervolgens op "Scrape." Vanaf daar gaat de paginering automatisch — Thunderbit werkt door elke pagina heen die je browsersessie kan bereiken.

Waarom Thunderbit niet stukgaat wanneer Trustpilot verandert

Onze zet dit direct naast elkaar: traditionele scrapers vallen uit wanneer lay-outs veranderen en CSS-selectors moeten worden bijgewerkt. Thunderbit gebruikt semantische AI die inhoud begrijpt zonder op specifieke CSS te leunen, dynamische content aankan en automatische paginatie beheert.

Vergelijk dat met de tutorialcode van ScraperAPI, die parseert op basis van classnamen zoals styles_reviewCardInner__EwDq2. Die selector gaat stuk zodra Trustpilot weer een update uitrolt. Thunderbit’s AI vraagt: "waar staat de reviewtekst op deze pagina?" in plaats van: "wat zit er in deze specifieke div class?"

Belangrijkste functies voor Trustpilot-scraping

- AI Suggest Fields: detecteert automatisch reviewvelden (naam, beoordeling, datum, titel, tekst, bedrijfsreactie) zonder handmatige configuratie

- Workflow in twee klikken: AI Suggest Fields → Scrape. Meer niet.

- Browsermodus voor pagina’s waarvoor je moet inloggen: werkt binnen je geauthenticeerde Chrome-sessie voor toegang tot pagina 10+

- Automatische paginatie: verwerkt reviewsets over meerdere pagina’s zonder handmatige tussenkomst

- Subpage scraping: kan individuele reviewerprofielen bezoeken voor verrijkingsdata

- Gepland scrapen: stel wekelijkse of maandelijkse reviewmonitoring in voor reputatiebewaking

- Exports: Google Sheets, Airtable, Notion, CSV, JSON — allemaal gratis inbegrepen

Prijzen

- Gratis plan: 6 pagina’s/maand, geen creditcard vereist

- Creditsysteem: 1 credit = 1 uitvoerregel

- Betaalde plannen: vanaf ongeveer $9/maand op de

Beste keuze voor: marketingteams, operationele teams en zakelijke gebruikers die Trustpilot-reviews nodig hebben zonder code aan te raken — en die geen scraper willen onderhouden die om de paar weken stukgaat.

2. Apify

is een cloudgebaseerd scrapingplatform met een marktplaats van vooraf gebouwde "Actors" — scrapingtemplates die andere gebruikers en het Apify-team hebben gemaakt. Voor Trustpilot bevat de store meerdere door de community onderhouden Actors met wisselende betrouwbaarheid.

De afweging bij Apify: het kan krachtig zijn, maar het is versnipperd. Sommige Actors werken. Sommige zijn verouderd. Sommige vereisen cookies voor pagina 10+. En de Reddit-klachten dat "none of the actors on the store work" zijn reëel — ze laten zien hoe snel Trustpilot-wijzigingen Actor-specifieke logica kunnen breken.

Trustpilot Actors en bekende beperkingen

De bevat meerdere Trustpilot Actors. Ten minste één (van developer "burbn") vermeldt expliciet dat een cookie-input vereist is voor pagina’s voorbij 10. Andere hebben 0,0 beoordelingen, heel weinig gebruikers of zeer recente wijzigingsdata — signalen dat onderhoud gaande is en de betrouwbaarheid varieert.

Ook verouderde Actors zijn het vermelden waard. Eén oudere Actor las Trustpilot’s ingebedde __NEXT_DATA__-JSON direct uit — een slimme aanpak die sneller was dan DOM-parsing, maar alsnog stukging toen Trustpilot zijn datastructuur wijzigde.

Omgaan met login-muur en anti-botbeveiliging

- Login-muur: hangt volledig af van de Actor die je kiest. Sommige ondersteunen cookie-injectie voor pagina 10+; andere niet.

- Anti-bot: Apify’s platform bevat proxyrotatie en infrastructuur op basis van compute units. Residential proxies zijn beschikbaar vanaf .

- Onderhoud: als een Actor stukgaat, wacht je op de maintainer, stap je over op een andere Actor of laat je een custom private Actor bouwen.

Prijzen

- Gratis plan: $5/maand vooraf betaalde usage, geen creditcard vereist

- Starter: $9/maand + betalen naar gebruik

- Scale: $99/maand + betalen naar gebruik

- Exports: JSON, CSV, Excel, XML, RSS (afhankelijk van de Actor)

Beste keuze voor: technisch vaardige gebruikers die meerdere Actors kunnen beoordelen, cookies kunnen configureren en problemen kunnen oplossen wanneer iets breekt. Minder geschikt voor teams die een set-and-forget-oplossing willen.

3. Octoparse

is een desktopgebaseerde no-code scraper met een visuele point-and-click workflowbuilder. Het zit tussen de eenvoud van Thunderbit in twee klikken en de volledige ontwikkelaarscontrole van ScraperAPI — je krijgt visuele configuratie zonder code, maar je bouwt en onderhoudt nog steeds een workflow.

Een Trustpilot-scrape instellen in Octoparse

De workflow is eenvoudig maar handmatig:

- Plak een Trustpilot-review-URL van een bedrijf

- Selecteer visueel de reviewelementen (titel, body, beoordeling, datum, naam van reviewer)

- Definieer een paginatieslus met de knop voor de volgende pagina

- Stel wachttijden in (2-5 seconden aanbevolen om reCAPTCHA te vermijden)

- Draai lokaal voor kleine samples of in de cloud voor grotere taken

Voor iemand die bekend is met de tool duurt het opzetten 10-15 minuten. De adder onder het gras: omdat Octoparse visuele selectors gebruikt die aan DOM-elementen zijn gekoppeld, moet je je workflow bijwerken zodra Trustpilot de paginastructuur wijzigt.

Omgaan met login-muur en anti-botbeveiliging

- Login-muur: vereist handmatige login-/cookie-/sessieconfiguratie. Niet automatisch afgevangen.

- Anti-bot: bevatten IP-rotatie, residential proxies ($3/GB) en automatische CAPTCHA-oplossing ($1-1,5 per duizend).

- Onderhoud: gemiddeld. Verwacht je workflow opnieuw op te bouwen of aan te passen wanneer Trustpilot zijn frontend bijwerkt.

Prijzen

- Gratis plan: gratis voor altijd, 10 taken, 1 apparaat, lokale extractie, tot 50.000 rijen/maand

- Standard: $69/maand (jaarlijks gefactureerd)

- Professional: $149/maand

- 14-daagse premium proefperiode: inclusief cloud-extractie, planning, API en templates

- Exports: Excel, CSV, JSON, HTML, XML; databases en Google Sheets op hogere niveaus

Beste keuze voor: gebruikers die visuele workflowcontrole willen, de opstarttijd niet erg vinden en comfortabel workflows onderhouden wanneer pagina’s veranderen. Goed voor teams die meer maatwerk nodig hebben dan een tool in twee klikken, maar minder complexiteit dan Python schrijven.

4. Web Scraper

is een Chrome-extensie en cloudplatform met een sitemap-gebaseerde aanpak voor scrapen. De sterkste Trustpilot-aanbieding is een die bedrijfsgegevens extraheert: bedrijfsnaam, categorie, adres, beoordeling, aantal reviews, TrustScore en website-URL.

Voor het scrapen van reviews zelf heeft Web Scraper een gedocumenteerde beperking die het vermelden waard is.

Vooraf gebouwde template versus eigen setup

De marktplaats-template werkt goed voor het ontdekken van bedrijven — het scrapen van bedrijfsprofielen binnen Trustpilot-categorieën. Voor aangepaste review-extractie laat de Sitemap Wizard je binnen de Chrome-extensie visueel een scraper bouwen.

raadt JavaScript-click-paginatie aan in plaats van URL-gebaseerde paginatie, omdat Trustpilot de inhoud dynamisch kan herschikken tussen pagina’s, waardoor resultaten kunnen verschuiven.

Omgaan met login-muur en anti-botbeveiliging

Hier is eerlijkheid belangrijk: de officiële gids van Web Scraper vermeldt expliciet dat Trustpilot slechts de eerste 10 reviewpagina’s toestaat voordat er een loginprompt verschijnt. De gids documenteert dit als een bekende beperking in plaats van een workaround te bieden.

- Login-muur: beperkte afhandeling. De limiet van 10 reviewpagina’s staat gedocumenteerd in hun eigen gids.

- Anti-bot: cloudplannen bevatten proxyondersteuning; de gids raadt vertragingen van 2-5 seconden en lagere concurrency aan.

- Paginatie: configureerbaar, maar in de praktijk beperkt tot de eerste 10 reviewpagina’s voor ongeauthenticeerde toegang.

Prijzen

- Gratis Chrome-extensie: lokale scraping, beperkte functionaliteit

- Project: $50/maand (5.000 URL-credits)

- Professional: $100/maand (20.000 URL-credits)

- Scale: vanaf $200/maand (onbeperkte URL-credits onder voorwaarden)

- 7-daagse gratis proefperiode op betaalde cloudplannen

- Exports: CSV, XLSX

Beste keuze voor: gebruikers die een kant-en-klare template willen voor het scrapen van Trustpilot-bedrijfsprofielen, of die alleen reviews van de eerste 10 pagina’s nodig hebben. Niet de juiste keuze als je de volledige reviewgeschiedenis nodig hebt van bedrijven met veel reviews.

5. ScraperAPI

is scraping-infrastructuur voor developers — geen point-and-click tool, maar een proxy-/renderlaag die anti-botmaatregelen afhandelt terwijl jij de parslogica schrijft. De promoot JS-rendering, CAPTCHA-afhandeling en 40M+ proxies.

Als je een Python-developer bent die volledige controle over de extractielogica wil, geeft ScraperAPI je de infrastructuur.

Je bent ook zelf verantwoordelijk voor het onderhoud.

Een custom Trustpilot-scraper bouwen met ScraperAPI

laat een workflow zien met Python + BeautifulSoup:

1import requests

2from bs4 import BeautifulSoup

3payload = {

4 "api_key": "YOUR_API_KEY",

5 "url": "https://www.trustpilot.com/review/example.com",

6 "render": "true",

7 "keep_headers": "true",

8}

9html = requests.get("https://api.scraperapi.com", params=payload).text

10soup = BeautifulSoup(html, "html.parser")De uitgewerkte code in de tutorial zet pages_to_scrape = 10 — een impliciete bevestiging van de publieke paginalimiet. Voor pagina 10+ moeten developers zelf geauthenticeerde sessies, cookies en tokens beheren.

Omgaan met login-muur en anti-botbeveiliging

- Login-muur: sessie-/cookiebeheer op code-niveau vereist. ScraperAPI regelt proxies en rendering; jij regelt de authenticatielogica.

- Anti-bot: residential proxy-pool met automatische IP-rotatie, JS-rendering via

render=true, CAPTCHA-afhandeling via slimme proxyrotatie. Beschikbaar op . - Onderhoud: wanneer Trustpilot classnamen verandert (wat regelmatig gebeurt), moet je je parsecode bijwerken. De selector

styles_reviewCardInner__EwDq2uit de tutorial tikt al als een tijdbom.

Prijzen

- 7-daagse proefperiode: , geen creditcard vereist

- Hobby: $49/maand (100.000 API-credits)

- Startup: $149/maand (1.000.000 credits)

- Business: $299/maand (3.000.000 credits)

- Exports: wat je code ook produceert (meestal CSV, JSON, databasewrites)

Beste keuze voor: developers die volledige maatwerkcontrole willen, hun eigen pars-scripts kunnen onderhouden en programmeerbare controle nodig hebben over sessiebeheer, paginatielogica en datastructuur. Niet voor niet-technische gebruikers.

Waarom Trustpilot-scrapers blijven stukgaan (en hoe je er een kiest die dat niet doet)

Dit is de meest onderschatte factor bij het kiezen van een Trustpilot-scraper. De vraag is niet "werkt deze tool vandaag?" maar "werkt deze tool over drie weken nog steeds?"

Scrapers gaan op Trustpilot om vier terugkerende redenen stuk:

-

Wijzigingen in gegenereerde CSS-classnamen. Next.js CSS-modules produceren classnamen zoals

styles_reviewCardInner__EwDq2. Die veranderen bij elke frontend-uitrol. Elke scraper die op deze classnamen target, breekt. -

Wijzigingen in de DOM-structuur. Trustpilot kan zijn HTML-hiërarchie herstructureren — reviewkaarten anders nesten, wrapper-elementen wijzigen, metadata op andere plekken zetten.

-

Wijzigingen in anti-bottriggers. Drempels voor reCAPTCHA verschuiven. Rotatie van sessietokens wordt agressiever. CDN-filterregels worden aangepast.

-

Wijzigingen in authenticatie/sessie. De login-muur op pagina 10 werd eind 2025 ingevoerd (of strenger afgedwongen). Toekomstige toegangsbeperkingen kunnen op elk moment verschijnen.

Het fundamentele architecturale verschil is tussen selector-based en semantische extractie:

-

Selector-based tools (Apify Actors, Octoparse-workflows, ScraperAPI-scripts, Web Scraper-sitemaps) vragen: "Vind het element op precies dit CSS-pad." Wanneer het pad verandert, falen ze stilletjes of leveren ze lege data op.

-

Semantische/AI-tools (Thunderbit) vragen: "Vind de reviewtekst, beoordeling en datum op deze pagina." De AI interpreteert pagina-inhoud op basis van betekenis, niet op basis van adres. Lay-outwijzigingen breken het niet, omdat de betekenis niet verandert.

Mijn aanbeveling:

- Geen enkele tolerantie voor onderhoud? → AI-gebaseerd (Thunderbit)

- Onderhoud is oké, je wilt cloudautomatisering? → Apify (met Actor-selectie en monitoring)

- Visuele controle, matig onderhoud? → Octoparse

- Template-gebaseerd, beperkte scope? → Web Scraper

- Volledige controle, alles zelf beheren? → ScraperAPI

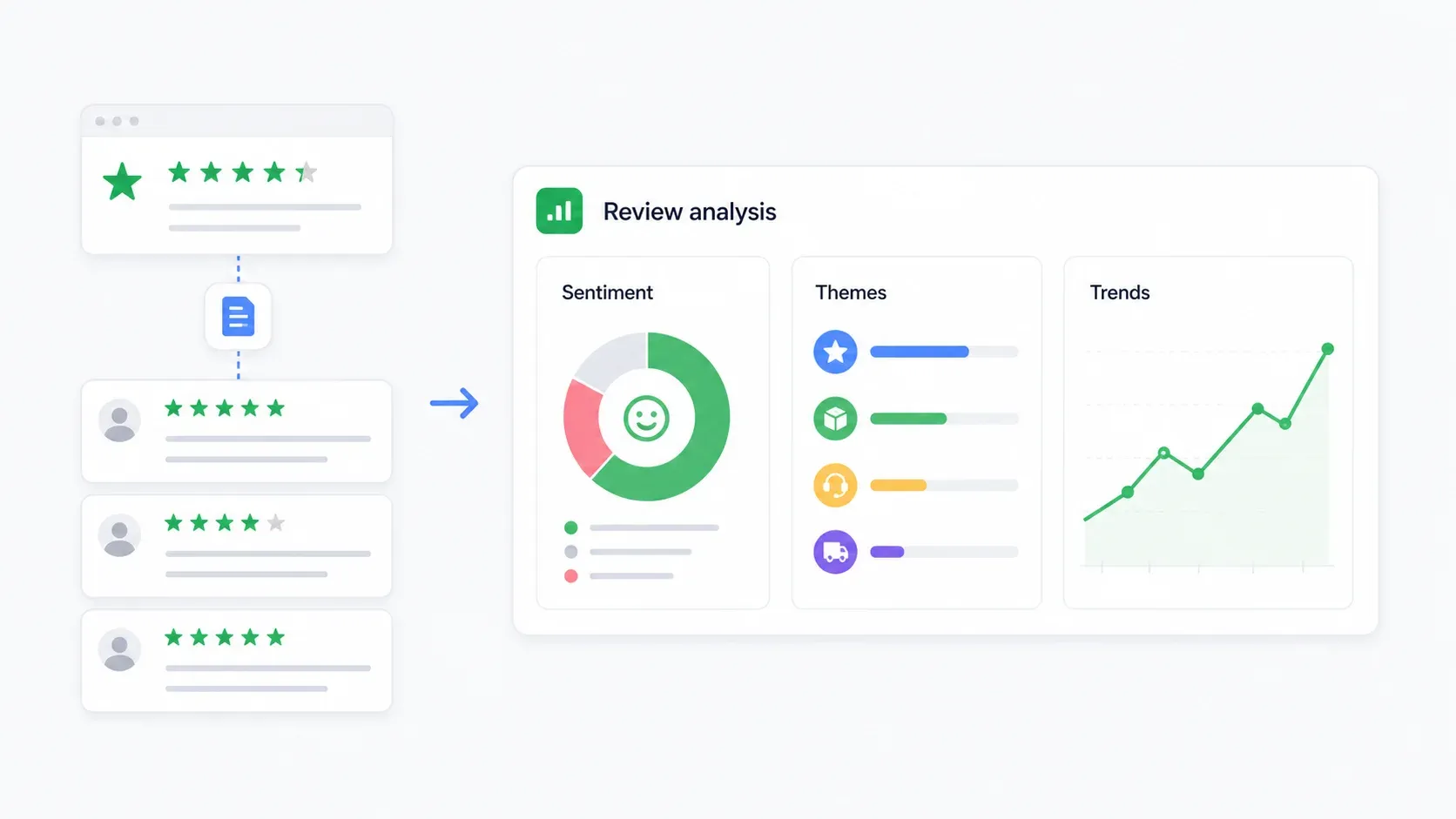

Wat je kunt doen met gescrapete Trustpilot-reviews

Reviews extraheren is stap één. De vraag die ik constant in forums zie: "Ik heb de data — en nu?"

Sentimentanalyse

De eenvoudigste workflow: exporteer reviews naar Google Sheets en gebruik vervolgens een AI-tool (ChatGPT, Claude of een AI-functie in Sheets) om elke review te classificeren als positief, neutraal of negatief. Voeg kolommen toe voor klachtcategorie, urgentie en voorgestelde prioriteit voor actie.

Voor grotere datasets kun je de CSV uploaden naar ChatGPT en om een samenvatting vragen: "Classificeer deze reviews op sentiment en identificeer de vijf belangrijkste klachtenthema’s met representatieve цитaten."

Concurrentiemonitoring

Gebruik Thunderbit’s geplande scraping om wekelijks of maandelijks reviews van concurrenten op te halen. Houd het volgende bij:

- Trend in gemiddelde beoordeling door de tijd heen

- Aandeel 1-sterren- en 2-sterrenreviews

- Veranderingen in reviewvolume (krijgen ze meer of minder reviews?)

- Meest voorkomende klachtenthema’s

- Reactiepercentage en reactiesnelheid van het bedrijf

Een eenvoudig Google Sheets-dashboard met draaitabellen op basis van beoordeling en datum geeft je een automatisch bijgewerkte bron voor concurrentie-inzichten.

Thema-extractie

Groepeer reviews op veelvoorkomende categorieën: verzending/levering, klantenservice, terugbetalingen, productkwaliteit, facturering, app-gebruiksgemak, prijs/waarde en zorgen over fraude. De output moet een tabel zijn met: thema, aantal, gemiddelde beoordeling, representatieve citaten en voorgestelde bedrijfsactie.

Dit is nuttiger dan een word cloud. Het laat zien wat daadwerkelijk tevredenheid of ontevredenheid veroorzaakt.

Bulk-analyse over meerdere bedrijven

Voor onderzoek op categorieniveau kun je reviews scrapen over meerdere bedrijven binnen dezelfde Trustpilot-categorie. Vergelijk reviewvolumes, beoordelingen, sterrenverdeling en de prevalentie van thema’s over een volledig marktsegment. De bedrijfsvermeldingstemplate van Web Scraper is nuttig om bedrijven te ontdekken; Thunderbit of ScraperAPI kunnen vervolgens de reviewdata per bedrijf sample-gebaseerd ophalen.

Juridische en ethische aandachtspunten bij Trustpilot-scraping

Ik ben geen advocaat, en dit is geen juridisch advies. Maar de compliance-realiteit doet er hier wel toe.

De gebruiksvoorwaarden van Trustpilot zijn duidelijk. Ze gebruikers om content te openen of verzamelen "by any means other than as provided or specifically approved by Trustpilot," en noemen expliciet text mining, data mining en web scraping zonder uitdrukkelijke toestemming.

Het risicospectrum ziet er zo uit:

- Laag risico: je eigen bedrijfsreviews exporteren voor interne analyse, vooral met de officiële business-tools of API van Trustpilot.

- Gemiddeld risico: openbare concurrentiepagina’s op lage schaal scrapen voor marktonderzoek. Nog steeds onderhevig aan de gebruiksvoorwaarden en privacyverplichtingen.

- Hoger risico: inhoud scrapen achter de login-muur op pagina 10+, technische controles omzeilen, reviewerdata herdistribueren of gescrapete reviews gebruiken voor AI-modeltraining.

GDPR-overwegingen: namen van reviewers, profiel लिंक, reviewtekst en locatiegegevens kunnen onder EU-privacywetgeving als persoonsgegevens gelden. Praktische beveiligingsmaatregelen zijn onder meer alleen de benodigde velden verzamelen, reviewer-namen hashen voor interne analyses, bewaartermijnen instellen en ruwe reviewtekst niet op grote schaal opnieuw publiceren.

Publieke versus geauthenticeerde data: er is een betekenisvol juridisch en ethisch verschil tussen het scrapen van pagina’s die iedereen kan zien (de eerste 10 reviewpagina’s) en het scrapen van data achter een authenticatiebarrière. Tools die alleen met publieke data werken, brengen minder compliance-risico met zich mee dan tools waarvoor inloggegevens nodig zijn.

Dit moet een factor zijn bij je toolkeuze. Thunderbit’s browsermodus werkt met pagina’s die zichtbaar zijn in je eigen sessie — het omzeilt authenticatie niet zelfstandig. ScraperAPI geeft developers volledige controle, maar ook volledige verantwoordelijkheid voor de rechtmatigheid van sessiebeheer.

Hoe je de juiste Trustpilot-reviewscraper kiest

Besliskader per persona:

- Niet-technische marketeer die reviews zonder code nodig heeft? → Thunderbit. Twee klikken, AI doet de rest, export naar Sheets/Notion/Airtable.

- Low-code gebruiker die comfortabel is met configuratie en debuggen? → Apify. Kies een Actor, configureer cookies voor pagina 10+, monitor op breuken.

- Visuele builder die workflowcontrole wil? → Octoparse. Point-and-click setup, maar reken op onderhoud wanneer Trustpilot verandert.

- Bedrijfsdata of alleen reviews van de eerste 10 pagina’s nodig? → Web Scraper. Sterke vooraf gebouwde templates voor bedrijfsprofielen.

- Developer die volledige aanpasbaarheid wil? → ScraperAPI. Je eigen parslogica, sessiebeheer en datapijplijn.

Als onderhoudsgevoeligheid je belangrijkste zorg is, loopt het spectrum van Thunderbit (bijna geen onderhoud) tot ScraperAPI (je onderhoudt alles zelf). Qua budget heeft elke tool op deze lijst een gratis instapmogelijkheid — begin daar eerst voordat je je vastlegt.

Conclusie

Trustpilot-reviewdata is echt waardevol voor concurrentie-inzicht, reputatiemonitoring en klantinzichten.

Maar in 2026 vereist het betrouwbaar extraheren ervan een tool die de login-muur op pagina 10 aankan, zich kan aanpassen aan DOM-wijzigingen en anti-botbeveiliging beheert zonder voortdurende handmatige tussenkomst.

Voor de meeste zakelijke gebruikers is de route met de minste weerstand — twee klikken, AI-gedreven veldherkenning, browsermodus voor geauthenticeerde pagina’s en geen onderhoud wanneer Trustpilot zijn frontend verandert. Je kunt het met 6 pagina’s per maand en zonder creditcard.

Voor developers die volledige controle willen, biedt ScraperAPI de infrastructuur. Voor iedereen daar tussenin dienen Apify, Octoparse en Web Scraper elk een specifieke niche. Het draait erom de tool af te stemmen op je technische comfort, onderhoudstolerantie en compliance-eisen.

Als je wilt zien hoe Thunderbit specifiek met Trustpilot omgaat, hebben we een . En voor bredere context over of , behandelen die gidsen de basis.

Veelgestelde vragen

1. Kun je Trustpilot-reviews scrapen voorbij pagina 10?

Ja, maar alleen via een geauthenticeerde route. Trustpilot blokkeert ongeauthenticeerde toegang na de eerste 10 reviewpagina’s. Thunderbit’s browsermodus werkt binnen je ingelogde Chrome-sessie, dus het kan pagina’s bereiken die jij kunt zien. ScraperAPI vereist sessie-/cookiebeheer op code-niveau. Apify Actors hebben cookieconfiguratie nodig. Octoparse vereist handmatige login/cookie-instelling. De eigen documentatie van Web Scraper erkent de limiet van 10 pagina’s zonder ingebouwde workaround.

2. Is het legaal om Trustpilot-reviews te scrapen?

De gebruiksvoorwaarden van Trustpilot verbieden geautomatiseerde gegevensverzameling zonder uitdrukkelijke toestemming. Het juridische risico verschilt per methode en gebruikssituatie: je eigen openbare reviews scrapen is minder risicovol dan authenticatiemuren omzeilen om concurrenten te scrapen. GDPR is van toepassing op EU-reviewdata. Dit is geen juridisch advies — raadpleeg een jurist voor grootschalige of commerciële scrapingprojecten.

3. Welke data kun je uit Trustpilot halen?

Veelvoorkomende velden zijn: naam van reviewer, sterbeoordeling, reviewtitel, reviewtekst, publicatiedatum, ervaringsdatum, status van geverifieerde aankoop, locatie van reviewer, tekst van bedrijfsreactie, bedrijfsnaam, TrustScore, totaal aantal reviews, sterrenverdeling en review-URL.

4. Hoe vaak gaan Trustpilot-scrapers stuk?

Tools op basis van selectors (Apify Actors, Octoparse-workflows, custom Python-scripts) kunnen stukgaan telkens wanneer Trustpilot zijn CSS-classnamen of DOM-structuur wijzigt — wat meerdere keren per maand kan gebeuren. AI-semantische tools zoals Thunderbit passen zich automatisch aan omdat ze de betekenis van de pagina interpreteren in plaats van specifieke selectors te targeten. Geen enkele tool is echter immuun voor grote veranderingen in toegangscontrole, zoals de login-muur op pagina 10.

5. Kan ik Trustpilot-reviews gratis scrapen?

Elke tool op deze lijst heeft een gratis instappunt: Thunderbit biedt 6 gratis pagina’s/maand, ScraperAPI geeft 5.000 proefcredits gedurende 7 dagen, Web Scraper heeft een gratis Chrome-extensie voor lokaal gebruik, Octoparse heeft een gratis-voor-altijd-plan (10 taken, 50.000 rijen/maand) en Apify bevat $5/maand aan gratis platformcredits. Voor kleinschalige samples of tests werken al deze opties zonder betaling.

Meer informatie