Tussen de 2 en 3 miljoen nieuwsartikelen worden er elke dag online gepubliceerd. Die data gestructureerd verzamelen — koppen, datums, bronnen, volledige artikeltekst — is ongeveer net zo leuk als meubels in elkaar zetten zonder handleiding.

Ik heb jaren besteed aan het bouwen en testen van automatiseringstools bij , en het landschap voor nieuws scraping in 2026 is een vreemde mix van enorme kansen en flinke frustratie. Google schrapte zijn officiële News API al in 2011, nieuwssites zetten steeds strengere anti-botmaatregelen in (Cloudflare, CAPTCHA’s, JavaScript-renderingwalls), en layouts veranderen zo vaak dat een scraper die op maandag werkt, op woensdag alweer stuk kan zijn. Ondertussen hebben business teams — van PR en sales tot academische onderzoekers en AI-engineers — juist meer dan ooit behoefte aan gestructureerde nieuwsdata.

Daarom heb ik 15 tools voor nieuws scraping getest, verdeeld over API’s, no-code platforms en open-source libraries. Het doel: je een gestandaardiseerde vergelijking geven op prijs, onderhoudslast, schone tekstextractie en echte toepasbaarheid — precies wat je in geen enkele andere gids zo compleet bij elkaar vindt.

Waarin onderscheiden de beste nieuws-scrapers zich in 2026?

De meeste artikelen over de “beste nieuws-scrapers” slaan evaluatiecriteria gewoon over, dus hier lees je wat ik écht heb getest. De meeste artikelen over de “beste nieuws-scrapers” noemen alleen functies en gaan dan snel verder. Maar na jaren aan scraping-infrastructuur bouwen, heb ik geleerd dat de criteria waar zakelijke gebruikers om geven specifiek zijn — en vaak worden gemist.

Dit is het evaluatiekader dat ik heb gebruikt:

| Criteria | Wat ik heb geëvalueerd |

|---|---|

| Aanpak | API, no-code browsertool of open-source library |

| Anti-botafhandeling | Proxy-rotatie, CAPTCHA-oplossing, ondersteuning voor headless browsers |

| Schone tekstextractie | Kan het advertenties/zijkolommen/navigatie verwijderen en alleen de artikeltekst teruggeven? |

| Metadata-uitvoer | Auteur, datum, afbeeldingen, bron-URL, categorie |

| Exportformaten | CSV, JSON, Google Sheets, Airtable, Notion, enz. |

| Paginering / bulkondersteuning | Kan het overweg met resultaten over meerdere pagina’s en batch-URL’s? |

| Onderhoudslast | Breekt het wanneer site-layouts veranderen? AI-adaptief vs. selector-gebaseerd |

| Genormaliseerde kosten per 1K resultaten | Appels-met-appels-prijsvergelijking (inclusief gratis tier) |

| Best passende use case | PR-monitoring, leadgeneratie, academisch onderzoek, LLM-pipeline, enz. |

Twee criteria verdienen extra uitleg. Genormaliseerde kosten per 1K resultaten zijn belangrijk omdat elke aanbieder prijzen anders uitdrukt — per credit, per request, per zoekopdracht, per rij. Zonder normalisatie vergelijk je appels met peren. En onderhoudslast is veruit het grootste pijnpunt dat ik van gebruikers hoor. Forum na forum is de klacht hetzelfde: “nieuwssites weten mijn crawlers elke dinsdag kapot te maken.” Ik heb elke tool beoordeeld op een drieledig niveau:

- 🟢 Weinig onderhoud: AI-adaptief of volledig beheerde API — layoutwijzigingen breken je workflow niet

- 🟡 Gemiddeld onderhoud: Anti-bot wordt afgehandeld, maar je extractielogica kan nog steeds breken

- 🔴 Veel onderhoud: Selector-gebaseerd — als de site verandert, los je het handmatig op

Welke nieuws-scraper past bij jouw rol? Een beslismatrix

Aanbevelingen voor scrapers behandelen bijna altijd iedereen hetzelfde, en dat is precies het probleem. Een PR-manager die merkvermeldingen volgt heeft heel andere behoeften dan een Python-ontwikkelaar die een RAG-pipeline bouwt. Dus vóór de volledige lijst hier een snel kader:

| Use case | Beste aanpak | Aanbevolen tools |

|---|---|---|

| Dagelijkse nieuwsbriefing (niet-technisch) | No-code browsertool of RSS | Thunderbit, Octoparse, ParseHub |

| PR / mediamonitoring op schaal | News API met alerts | Newscatcher, Webz.io, Newsdata.io |

| Sales-leadextractie uit nieuws | AI-scraper met subpagina-verrijking | Thunderbit (subpage scraping + e-mail-/telefoonextractie), Apify |

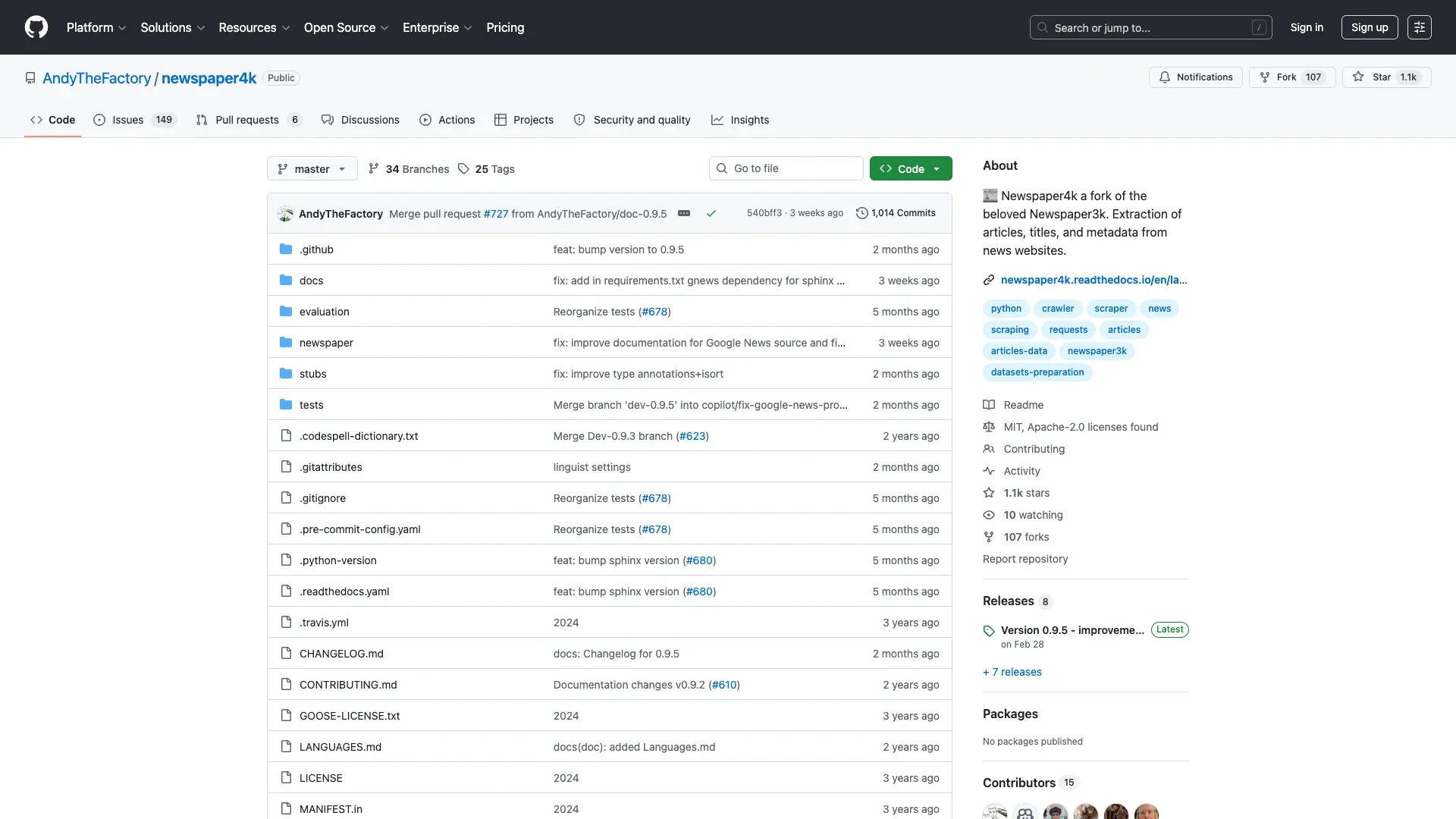

| Academisch onderzoek / corpusopbouw | Open-source library | Newspaper4k |

| LLM-pipeline / RAG-ingestie | Distill-to-Markdown API | Thunderbit API, ScraperAPI |

| Concurrentieanalyse / pricing | Geplande scraping | Thunderbit (geplande scraper), Bright Data |

Weet je al in welk vakje je valt? Ga dan door. Anders helpt de volledige uitwerking hieronder je verder.

De 15 beste nieuws-scrapers in één oogopslag

Hier is de hoofdvergelijking — prijzen genormaliseerd naar kosten per 1.000 resultaten bij het goedkoopste betaalde niveau, onderhoud beoordeeld op de drielaagse schaal.

| Tool | Type | Gratis tier | Kosten per 1K resultaten (schatting) | Anti-bot | Schone tekst | Onderhoud | Best passende use case |

|---|---|---|---|---|---|---|---|

| Thunderbit | No-code AI (Chrome-extensie + cloud) | 6 pagina’s/maand gratis | ~$3–$15 | Sterk (browser- en cloudmodi) | Ja (AI + subpagina) | 🟢 Laag | Zakelijke teams, leadgeneratie, dagelijkse monitoring |

| SerpApi | API | 250 zoekopdrachten/maand | ~$15 | Sterk (specifiek voor SERP’s) | Nee (alleen snippets) | 🟢 Laag | Google News SERP-dashboards |

| ScraperAPI | API | 1.000 credits/maand | ~$1–$5 | Sterk (proxy + JS-rendering) | Nee (ruwe HTML) | 🟡 Gemiddeld | Developers die anti-bot-infrastructuur willen |

| Newsdata.io | News API | 200 requests/dag | ~$5–$15 | N.v.t. (beheerde API) | Gedeeltelijk (premium) | 🟢 Laag | Gestructureerde nieuwsmetadata |

| Apify | Cloudplatform | $5 gratis credits | ~$1–$6 | Sterk | Verschilt per actor | 🟡 Gemiddeld | Aangepaste cloudworkflows |

| Oxylabs | Enterprise API | 2.000 resultaten trial | ~$0,50–$2 | Zeer sterk | Gedeeltelijk | 🟢 Laag | SERP + web op enterpriseniveau |

| ScrapingBee | API | Trial credits | ~$2–$5 | Sterk (headless Chrome) | Gedeeltelijk (basis) | 🟡 Gemiddeld | Nieuwswebsites met veel JavaScript |

| Scrapingdog | SERP API | 1.000 credits | ~$0,10–$0,50 | Sterk | Nee (SERP-data) | 🟢 Laag | Budgetvriendelijke SERP-monitoring |

| Bright Data | Enterpriseplatform | 1.000 request trial | ~$0,30–$0,50 | Zeer sterk | Ja (News Scraper) | 🟢 Laag | Nieuwsdata op enterpriseschaal |

| Octoparse | No-code desktop + cloud | Beperkte gratis versie | ~$5–$10 (genormaliseerd) | Sterk | Ja (met templates) | 🟡 Gemiddeld | Visueel no-code scrapen |

| ParseHub | No-code desktop | 5 projecten, 200 pagina’s/run | ~$5–$12 (genormaliseerd) | Matig | Ja (met configuratie) | 🔴 Hoog | Beginners, kleine projecten |

| Newscatcher | News API | Geen publieke gratis tier | Maatwerk (enterprise) | N.v.t. (beheerde API) | Ja (met NLP verrijkt) | 🟢 Laag | PR-/mediamonitoring |

| Webz.io | Nieuwsdataplatform | Geen gratis self-service tier | Maatwerk (enterprise) | N.v.t. (beheerde feed) | Ja (volledige tekst + metadata) | 🟢 Laag | Historische archieven, LLM-training |

| Newspaper4k | Open-source Python | Gratis | $0 (+ serverkosten) | Geen | Ja (speciaal gebouwd) | 🔴 Hoog | Developers, corpusopbouw |

| HasData | SERP API | Gratis credits | ~$0,25–$0,60 | Sterk | Nee (SERP-data) | 🟢 Laag | Budgetvriendelijk nieuws-SERP-endpoint |

Korte samenvatting: Scrapingdog en HasData zijn de goedkoopste API-opties per request. Thunderbit en Newspaper4k leveren de schoonste artikeltekst (op heel verschillende manieren). Bright Data en Oxylabs domineren de enterprise-laag. Onderhoudsproblemen? Blijf bij de 🟢 tools.

1. Thunderbit — beste no-code AI nieuws-scraper voor zakelijke teams

is de tool die mijn team en ik specifiek hebben gebouwd om het probleem op te lossen van: “Ik heb data van deze website nodig, maar ik wil geen code schrijven of selectors onderhouden.” Voor nieuws scraping is de workflow zo simpel mogelijk: open een nieuws pagina, klik op AI Suggest Fields, bekijk de kolommen die Thunderbit voorstelt (kop, datum, bron, URL, samenvatting — het leest de paginastructuur en ziet wat er aanwezig is), en klik daarna op Scrape.

is de tool die mijn team en ik specifiek hebben gebouwd om het probleem op te lossen van: “Ik heb data van deze website nodig, maar ik wil geen code schrijven of selectors onderhouden.” Voor nieuws scraping is de workflow zo simpel mogelijk: open een nieuws pagina, klik op AI Suggest Fields, bekijk de kolommen die Thunderbit voorstelt (kop, datum, bron, URL, samenvatting — het leest de paginastructuur en ziet wat er aanwezig is), en klik daarna op Scrape.

Een paar functies samen maken Thunderbit extra sterk voor nieuws:

- AI-adaptieve extractie: Geen CSS-selectors om te schrijven of te onderhouden. De AI leest elke keer de actuele paginalay-out, waardoor je scraper niet breekt wanneer een nieuwssite een redesign krijgt (en dat doen ze allemaal).

- Subpage scraping: Nadat je een lijst met artikellinks hebt gescrapet, kun je op Scrape Subpages klikken om elk artikel te bezoeken en de volledige tekst, auteur, publicatiedatum en afbeeldingen te extraheren. Zo krijg je schone artikelcontent, niet alleen koppen.

- Field AI Prompt: Je kunt de AI per kolom instrueren — bijvoorbeeld: “extraheer alleen de hoofdtekst van het artikel, sluit navigatie en advertenties uit” of “classificeer de sentimentwaarde van dit artikel als positief, neutraal of negatief.” Dat is uniek onder no-code tools en ontzettend handig voor nieuwsanalyse.

- Browser Scraping vs. Cloud Scraping: De browsemode gebruikt je eigen sessie (handig voor sites die cloud-IP’s blokkeren), terwijl de cloudmode tot 50 pagina’s tegelijk kan verwerken voor snelheid.

- Scheduled Scraper: Stel dagelijkse of wekelijkse scraping-runs in met natuurlijke taal voor tijdsintervallen — ideaal voor doorlopende nieuwsmonitoring.

- Export overal heen: Excel, CSV, Google Sheets, Airtable, Notion — allemaal ondersteund.

Prijzen en beperkingen

Thunderbit biedt een gratis tier (6 pagina’s/maand) en een trial van 10 pagina’s. Betaalde abonnementen beginnen rond voor 500 credits (1 credit = 1 rij). De Chrome-extensie is vereist voor de browsemode. AI-functies verbruiken credits, dus zwaar gebruik op duizenden artikelen vraagt om een betaald plan — maar voor de meeste zakelijke teams die dagelijks monitoren of wekelijks onderzoek doen, blijven de kosten bescheiden.

Onderhoud: 🟢 Laag. De AI leest de pagina elke keer opnieuw.

Beste voor: Niet-technische sales-, PR- en operationele teams die dagelijks nieuwsdata willen zonder scrapers te bouwen of te onderhouden.

Voor een diepere uitleg over hoe Thunderbit omgaat met , bekijk onze gids.

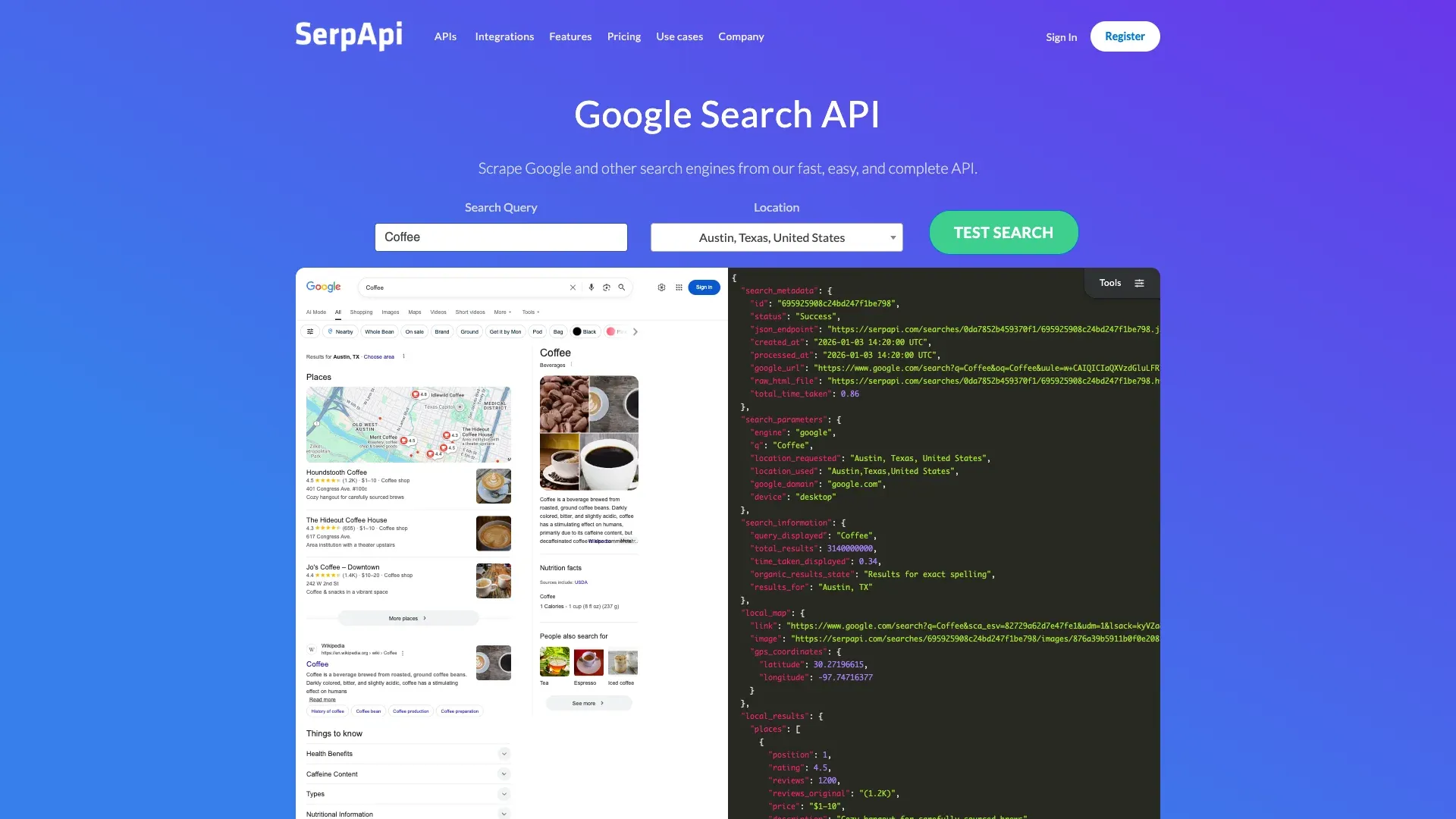

2. SerpApi — beste voor gestructureerde Google News SERP-data

is een SERP-specifieke API die gestructureerde JSON teruggeeft uit Google News-resultaten. Als je use case is: “geef me de beste Google News-resultaten voor een keyword, gestructureerd en klaar voor een dashboard,” dan is SerpApi een sterke keuze. Het geeft koppen, bron, datum, snippet en thumbnail terug — maar geen volledige artikeltekst. Daarvoor heb je een extra stap (of tool) nodig om de daadwerkelijke artikeltekst op te halen.

is een SERP-specifieke API die gestructureerde JSON teruggeeft uit Google News-resultaten. Als je use case is: “geef me de beste Google News-resultaten voor een keyword, gestructureerd en klaar voor een dashboard,” dan is SerpApi een sterke keuze. Het geeft koppen, bron, datum, snippet en thumbnail terug — maar geen volledige artikeltekst. Daarvoor heb je een extra stap (of tool) nodig om de daadwerkelijke artikeltekst op te halen.

Belangrijkste functies:

- Gestructureerde JSON-output uit Google News-SERP’s

- Anti-detectie wordt aan hun kant afgehandeld (specifiek voor SERP’s)

- Ondersteunt meerdere Google News-locaties en talen

Prijs: Gratis tier met 250 zoekopdrachten/maand. Betaalde plannen beginnen bij $75/maand voor 5.000 zoekopdrachten — ongeveer $15 per 1.000 resultaten.

Beperking: Geeft alleen snippets terug. Als je volledige artikeltekst nodig hebt, is SerpApi stap één, niet de hele pipeline.

Onderhoud: 🟢 Laag (beheerde API, zij vangen wijzigingen van Google op).

Beste voor: Developers die nieuwsmonitoringdashboards bouwen of SERP-data in analysetools willen voeden.

3. ScraperAPI — beste budgetvriendelijke scraping API met proxy-rotatie

is een algemene scraping API, niet specifiek voor nieuws, maar wel effectief voor het ophalen van nieuws pagina’s. De kernwaarde is proxy-rotatie, JavaScript-rendering en CAPTCHA-afhandeling — de anti-bot-infrastructuur die je anders zelf zou moeten bouwen.

is een algemene scraping API, niet specifiek voor nieuws, maar wel effectief voor het ophalen van nieuws pagina’s. De kernwaarde is proxy-rotatie, JavaScript-rendering en CAPTCHA-afhandeling — de anti-bot-infrastructuur die je anders zelf zou moeten bouwen.

Belangrijkste functies:

- Proxy-rotatie met residential en datacenter IP’s

- JavaScript-rendering voor dynamische nieuwssites

- CAPTCHA-afhandeling

- Geeft ruwe HTML terug — je parseert de artikelcontent zelf

Prijs: Gratis tier met 1.000 credits/maand (plus trial credits). JS-rendering kost meer credits per request. Betaalde plannen starten bij $49/maand. Genormaliseerde kosten liggen grofweg tussen $1 en $5 per 1.000 requests, afhankelijk van JS-gebruik.

Beperking: Geen ingebouwde artikelparsing. Je krijgt HTML, geen schone tekst. Combineer het met Newspaper4k of je eigen parser voor artikelextractie.

Onderhoud: 🟡 Gemiddeld (anti-bot wordt afgehandeld, maar de extractielogica is jouw verantwoordelijkheid).

Beste voor: Developers die anti-bot-infrastructuur willen zonder hun eigen proxynetwerk te bouwen.

4. Newsdata.io — beste dedicated news API voor gestructureerde metadata

is een speciaal gebouwde news API die dekt. Het levert gestructureerde data terug — titel, beschrijving, bron, datum, categorieën, sentiment — en volledige artikelinhoud op premiumplannen.

is een speciaal gebouwde news API die dekt. Het levert gestructureerde data terug — titel, beschrijving, bron, datum, categorieën, sentiment — en volledige artikelinhoud op premiumplannen.

Belangrijkste functies:

- Zoeken op keyword, categorie, taal, land

- Sentimentanalyse inbegrepen

- Historisch nieuwsarchief (betaalde plannen)

- Geen scraping-infrastructuur om te beheren

Prijs: Gratis tier met 200 requests/dag en beperkte velden. Betaalde plannen ontgrendelen volledige content en historische data. De kosten per 1.000 resultaten hangen af van het plan, maar liggen in de range van $5–$15.

Beperking: Dekt alleen de eigen geïndexeerde bronnen — je kunt niet willekeurige URL’s invoeren en zeggen: “scrape dit.” Als een nichepublicatie niet in hun index staat, vind je die hier niet.

Onderhoud: 🟢 Laag (volledig beheerde news API).

Beste voor: Teams die gestructureerde nieuwsmetadata nodig hebben en geen scraping-infrastructuur willen beheren.

5. Apify — beste cloudplatform voor aangepaste nieuws-scrapingworkflows

is een actor-gebaseerd cloudplatform met kant-en-klare scrapers voor Google News, specifieke publicaties en algemene artikelextractie. Het zit precies tussen no-code en volledig maatwerk in.

is een actor-gebaseerd cloudplatform met kant-en-klare scrapers voor Google News, specifieke publicaties en algemene artikelextractie. Het zit precies tussen no-code en volledig maatwerk in.

Belangrijkste functies:

- Kant-en-klare actors voor Google News, artikelextractie en meer

- Ondersteunt JavaScript-rendering en headless browser-uitvoering

- Cloud-uitvoering met planning

- Export naar JSON, CSV, Excel, XML en meer

Prijs: Gratis plan met . Betaalde niveaus op $49, $499 en $999/maand. Kosten per 1.000 resultaten verschillen per actor — grofweg $1–$6 voor news-scraping actors.

Beperking: De kant-en-klare actors worden onderhouden door de community en kunnen breken wanneer nieuwswebsites veranderen. Meer setup dan pure no-code tools.

Onderhoud: 🟡 Gemiddeld (actors kunnen updates nodig hebben wanneer sites veranderen).

Beste voor: Teams die cloud-uitvoering willen en comfortabel zijn met het kiezen en configureren van marketplace-actors.

6. Oxylabs — beste scraping-infrastructuur op enterpriseniveau

is een enterprise scrapingdienst met een proxy-pool van 100M+, CAPTCHA-oplossing en browser-rendering. Hun SERP Scraper API verwerkt Google News-resultaten met geo-targeting, en hun Web Scraper API werkt voor willekeurige nieuws pagina’s.

is een enterprise scrapingdienst met een proxy-pool van 100M+, CAPTCHA-oplossing en browser-rendering. Hun SERP Scraper API verwerkt Google News-resultaten met geo-targeting, en hun Web Scraper API werkt voor willekeurige nieuws pagina’s.

Belangrijkste functies:

- Enorme proxy-infrastructuur met geo-targeting

- SERP Scraper API voor Google News

- Web Scraper API voor willekeurige URL’s

- JSON/CSV-output, grootschalige gelijktijdige requests

Prijs: Vanaf $49/maand voor SERP-data. Maatwerk enterprise-prijzen voor hoge volumes. Gratis trial tot 2.000 resultaten.

Beperking: Duur voor kleine teams. Primair ontworpen voor grootschalige operaties.

Onderhoud: 🟢 Laag (volledig beheerde enterprise API).

Beste voor: Bedrijven die grote volumes, geo-getargete nieuwsdata en enterprise-betrouwbaarheid nodig hebben.

7. ScrapingBee — beste voor nieuwswebsites met veel JavaScript

is een scraping API die zich richt op JavaScript-rendering met echte browseruitvoering. Als de nieuwswebsite die je nodig hebt content via client-side JS laadt (en veel moderne sites doen dat), dan kan ScrapingBee daar goed mee overweg.

is een scraping API die zich richt op JavaScript-rendering met echte browseruitvoering. Als de nieuwswebsite die je nodig hebt content via client-side JS laadt (en veel moderne sites doen dat), dan kan ScrapingBee daar goed mee overweg.

Belangrijkste functies:

- Headless Chrome met proxy-rotatie

- CAPTCHA-afhandeling

- Basisfunctie “Article Extraction” voor sommige pagina’s

- Geeft ruwe HTML, JSON of Markdown-achtige output terug

Prijs: Plannen vanaf . Credit-gebaseerd, waarbij JS-rendering meer kost. Trial credits beschikbaar.

Beperking: De artikelextractiefunctie is basis vergeleken met AI-gestuurde alternatieven. Geeft vooral HTML terug — voor de meeste workflows heb je nog steeds parsing nodig.

Onderhoud: 🟡 Gemiddeld (anti-bot wordt afgehandeld, maar extractie vereist gebruikersconfiguratie).

Beste voor: Developers die nieuwswebsites met veel JavaScript scrapen en gerenderde HTML willen zonder headless browsers te beheren.

8. Scrapingdog — beste budgetvriendelijke SERP API voor nieuws

is een budget-SERP API met een speciaal Google News-endpoint. Reactietijden zijn snel (ongeveer 2 seconden per request in de test), en de prijs is de meest concurrerende in deze lijst voor API-opties.

is een budget-SERP API met een speciaal Google News-endpoint. Reactietijden zijn snel (ongeveer 2 seconden per request in de test), en de prijs is de meest concurrerende in deze lijst voor API-opties.

Belangrijkste functies:

- Speciaal Google News-endpoint

- Gestructureerde JSON-output (koppen, bron, datum, snippets)

- Snelle reactietijden

Prijs: Vanaf $40/maand voor 400.000 requests — dat is ongeveer $0,10 per 1.000 resultaten, wat opvallend goedkoop is. Gratis tier met 1.000 credits.

Beperking: Geeft alleen SERP-data terug (koppen, snippets), geen volledige artikelcontent. Dezelfde afweging als SerpApi, maar voor een fractie van de prijs.

Onderhoud: 🟢 Laag (beheerde SERP API).

Beste voor: Budgetbewuste developers die op schaal Google News SERP-data nodig hebben.

9. Bright Data — beste voor enterprise nieuwsdata op schaal

is de enterprise zwaargewicht. Hun platform bevat een speciaal News Scraper-product, enorme proxy-infrastructuur, CAPTCHA-oplossing, browser-rendering en downstream-levering naar S3, Snowflake en meer.

is de enterprise zwaargewicht. Hun platform bevat een speciaal News Scraper-product, enorme proxy-infrastructuur, CAPTCHA-oplossing, browser-rendering en downstream-levering naar S3, Snowflake en meer.

Belangrijkste functies:

- Speciaal News Scraper-product

- Voorgebouwde datasets en realtime verzameling

- Geautomatiseerd proxybeheer en CAPTCHA-oplossing

- Geplande verzameling en alerts

- Exports naar JSON, CSV, NDJSON, S3, Snowflake, GCS, Azure, SFTP

Prijs: Vanaf ongeveer op pay-as-you-go basis. Maatwerk enterpriseplannen beschikbaar. 1.000-request gratis trial.

Beperking: Complexe prijsstructuur met minimumbestedingen. Vooral ontworpen voor enterprisebudgetten.

Onderhoud: 🟢 Laag (enterprise-beheerd, hoge betrouwbaarheid).

Beste voor: Grote organisaties die betrouwbare nieuwsdatapijplijnen op hoge schaal nodig hebben.

10. Octoparse — beste visuele no-code scraper voor nieuws pagina’s

Octoparse is een desktopapplicatie met een visuele point-and-click workflowbuilder. Het heeft voorgebouwde templates voor veelgebruikte nieuwswebsites, ondersteunt paginering en infinite scroll, en biedt cloud-uitvoering voor geplande runs.

Octoparse is een desktopapplicatie met een visuele point-and-click workflowbuilder. Het heeft voorgebouwde templates voor veelgebruikte nieuwswebsites, ondersteunt paginering en infinite scroll, en biedt cloud-uitvoering voor geplande runs.

Belangrijkste functies:

- Visuele point-and-click workflowbuilder

- Voorgebouwde templates voor nieuwswebsites

- Cloud-uitvoering met planning

- IP-rotatie en automatische CAPTCHA-oplossing

- Exports naar Excel, CSV, JSON, databases, Google Sheets

Prijs: Gratis plan met 10 taken en 50K exports/maand. Betaalde plannen vanaf ongeveer $89/maand.

Beperking: Selector-gebaseerde extractie betekent dat scrapers breken wanneer nieuwswebsites hun layout updaten. Handmatige fixes zijn nodig — en nieuwswebsites updaten hun layout nu eenmaal vaak.

Onderhoud: 🟡 Gemiddeld (templates helpen, maar selectors kunnen nog steeds breken).

Beste voor: Gebruikers die een visuele no-code builder willen en af en toe template-onderhoud geen probleem vinden.

11. ParseHub — beste gratis no-code optie voor beginners

ParseHub is een visuele point-and-click scraper met een royale gratis versie. Het kan content gerenderd met JavaScript verwerken en werkt goed voor eenmalige onderzoeksprojecten of kleinschalige nieuws-extractie.

ParseHub is een visuele point-and-click scraper met een royale gratis versie. Het kan content gerenderd met JavaScript verwerken en werkt goed voor eenmalige onderzoeksprojecten of kleinschalige nieuws-extractie.

Belangrijkste functies:

- Visuele elementselectie (geen code)

- Verwerkt pagina’s met JavaScript-rendering

- Exports naar CSV/JSON

- Gratis tier: 5 projecten, 200 pagina’s per run

Prijs: Gratis plan met 5 projecten en 200 pagina’s/run. Betaalde plannen vanaf $189/maand.

Beperking: CSS-selector-gebaseerd, dus scrapers breken vaak wanneer layouts veranderen. Beperkte schaalbaarheid en trager dan API-tools. Gebruikers op Reddit en forums wijzen consequent op de leercurve en kwetsbaarheid.

Onderhoud: 🔴 Hoog (selectors breken vaak, geen AI-adaptatie).

Beste voor: Beginners die kleine, eenmalige nieuws-onderzoeksprojecten doen en een gratis startpunt willen.

12. Newscatcher — beste news API voor PR en mediamonitoring

is een dedicated news aggregation API met . Het is speciaal gebouwd voor mediamonitoring, PR-tracking en trendanalyse, met NLP-verrijkte velden zoals sentiment, samenvatting en entiteitsextractie.

is een dedicated news aggregation API met . Het is speciaal gebouwd voor mediamonitoring, PR-tracking en trendanalyse, met NLP-verrijkte velden zoals sentiment, samenvatting en entiteitsextractie.

Belangrijkste functies:

- Dekking van 70.000+ bronnen

- NLP-verrijking: sentiment, samenvatting, entiteitsextractie, deduplicatie, clustering

- Zoeken op keyword, onderwerp, bron, taal, land

- Toegang tot historisch archief

Prijs: Enterprise pricing (maatwerkoffertes). Geen publieke gratis tier voor testen, al kunnen ze op verzoek trials aanbieden.

Beperking: Enterprisegerichte prijsstelling kan buiten bereik liggen voor kleine teams. Geen gratis self-service tier.

Onderhoud: 🟢 Laag (volledig beheerde API).

Beste voor: PR- en mediamonitoringteams bij middelgrote tot grote bedrijven.

13. Webz.io — beste voor historische nieuwsarchieven en LLM-trainingsdata

is een nieuwsdataplatform met een enorm historisch archief — miljarden artikelen die jaren teruggaan. Het biedt zowel realtime feeds als toegang tot historische data, met gestructureerde JSON-output inclusief volledige artikeltekst, metadata en verrijkingen.

is een nieuwsdataplatform met een enorm historisch archief — miljarden artikelen die jaren teruggaan. Het biedt zowel realtime feeds als toegang tot historische data, met gestructureerde JSON-output inclusief volledige artikeltekst, metadata en verrijkingen.

Belangrijkste functies:

- Miljarden artikelen in het historische archief

- Realtime feeds en toegang tot historische data

- Volledige artikeltekst met gestructureerde metadata

- Populair bij AI/ML-teams voor trainingsdatasets en RAG-pipelines

Prijs: Enterprise-/maatwerkprijzen (op basis van datavolume). Geen gratis self-service tier voor nieuws.

Beperking: Niet ontworpen voor gelegenheidsgebruikers. Alleen enterprise pricing.

Onderhoud: 🟢 Laag (volledig beheerde datafeed).

Beste voor: AI/ML-teams die trainingsdatasets bouwen, en enterprise-teams die diepe historische nieuwsarchieven nodig hebben.

14. Newspaper4k — beste open-source library voor artikelextractie

is een Python-library (opvolger van Newspaper3k) die speciaal is gebouwd voor het extraheren van schone artikelcontent. Het verwijdert advertenties, zijkolommen en navigatie, en geeft alleen het artikel terug: titel, hoofdtekst, auteurs, publicatiedatum, afbeeldingen, keywords en samenvatting.

is een Python-library (opvolger van Newspaper3k) die speciaal is gebouwd voor het extraheren van schone artikelcontent. Het verwijdert advertenties, zijkolommen en navigatie, en geeft alleen het artikel terug: titel, hoofdtekst, auteurs, publicatiedatum, afbeeldingen, keywords en samenvatting.

Belangrijkste functies:

- Extraheert schone artikeltekst en verwijdert ruis

- Geeft titel, auteurs, publicatiedatum, afbeeldingen, keywords, samenvatting terug

- Volledig gratis en open-source

- Licht en snel voor statische HTML-pagina’s

Prijs: Gratis. Maar je hebt wel je eigen server, proxy-infrastructuur en ontwikkeltijd nodig.

Beperking: Geen ingebouwde anti-botafhandeling. Breekt op sterk dynamische nieuwswebsites met veel JS-rendering. Vereist Python-kennis en een aangepaste pipeline voor alles wat verder gaat dan basisextractie. Wanneer de HTML-structuur van een site verandert, los je het zelf op.

Onderhoud: 🔴 Hoog (breekt wanneer de HTML van de site verandert, handmatige fixes nodig).

Beste voor: Python-ontwikkelaars die eigen nieuws-extractiepijplijnen bouwen en maximale controle over artikelparsing willen.

15. HasData — beste budgetvriendelijke SERP API met nieuws-endpoint

is een SERP API met een speciaal Google News-endpoint. Het geeft gestructureerde JSON met nieuwsresultaten terug tegen concurrerende prijzen.

is een SERP API met een speciaal Google News-endpoint. Het geeft gestructureerde JSON met nieuwsresultaten terug tegen concurrerende prijzen.

Belangrijkste functies:

- Speciaal Google News-endpoint

- Gestructureerde JSON-output

- Reactietijd van ongeveer 3–4 seconden per request

- Gratis credits voor testen

Prijs: Vanaf (5 credits per nieuwsrequest = 40.000 requests). Dat is ongeveer $0,25–$0,60 per 1.000 resultaten.

Beperking: Geeft SERP-data terug (koppen, snippets), geen volledige artikelcontent.

Onderhoud: 🟢 Laag (beheerde SERP API).

Beste voor: Budgetbewuste teams die Google News SERP-data nodig hebben zonder de prijs van SerpApi.

Patronen die het waard zijn om op te letten

Na het doorlopen van alle 15 tools vallen een paar patronen op.

SERP API’s (SerpApi, Scrapingdog, HasData) zijn geweldig voor gestructureerde kopgegevens, maar laten je in de steek zodra je volledige artikeltekst nodig hebt. Dedicated news API’s (Newsdata.io, Newscatcher, Webz.io) lossen het metadata-probleem prachtig op, maar kunnen geen willekeurige URL’s scrapen. No-code tools (Thunderbit, Octoparse, ParseHub) geven je flexibiliteit om elke pagina te scrapen — al verschilt hun onderhoudsprofiel enorm. En Newspaper4k geeft je de schoonste artikelextractie, als je bereid bent de pipeline zelf te bouwen en te onderhouden.

API vs. no-code vs. open-source: de echte kosten per 1.000 artikelen

Niemand anders normaliseert deze vergelijking over alle categorieën heen. Hier is de rekensom:

| Methode | Insteltijd | Kosten per 1K artikelen | Onderhoud | Beste voor |

|---|---|---|---|---|

| Open-source (Newspaper4k) | Uren–dagen | $0 (maar server + ontwikkeltijd) | 🔴 Hoog | Developers met specifieke behoeften |

| News API (Newsdata.io, Newscatcher, Webz.io) | Minuten | $5–$50+ | 🟢 Laag | Gestructureerde data, historische archieven |

| Scraping API (ScraperAPI, ScrapingBee, Oxylabs) | 30 min | $1–$5 | 🟡 Gemiddeld | Developers die anti-botafhandeling willen |

| No-code AI (Thunderbit, Octoparse, ParseHub) | 2 minuten | $3–$15 | 🟢–🟡 | Zakelijke gebruikers, niet-technische teams |

De verborgen kosten van “gratis” open-source tools zitten in ontwikkeltijd. Een senior developer die 4 uur per maand besteedt aan het repareren van een kapotte Newspaper4k-pijplijn? Dat is niet gratis — dat is duur.

Aan de andere kant zijn enterprise API’s zoals Webz.io en Newscatcher weinig onderhoudsintensief, maar ze hebben prijskaartjes die alleen op schaal logisch zijn.

Voor de meeste zakelijke teams met wie ik praat, zit de sweet spot in een no-code AI-tool (zoals Thunderbit) voor flexibele, ad-hoc scraping, of een dedicated news API voor gestructureerde, doorlopende monitoring.

Het onderhoudsprobleem: waarom de meeste nieuws-scrapers kapotgaan (en welke niet)

Dit verdient een eigen sectie.

Het is de klacht die ik het vaakst zie in forums, supporttickets en gesprekken met gebruikers. Nieuwssites veranderen voortdurend hun layouts — soms wekelijks. Een scraper die op CSS-selectors of XPath is gebouwd, kan vandaag perfect werken en morgen rommel teruggeven.

Zo scoren de 15 tools op de onderhoudsschaal:

| Onderhoudsniveau | Tools | Wat gebeurt er als een site verandert |

|---|---|---|

| 🟢 Laag (AI-adaptief of beheerde API) | Thunderbit, SerpApi, Newsdata.io, Newscatcher, Webz.io, Scrapingdog, HasData, Oxylabs, Bright Data | De AI leest de pagina opnieuw, of de API-aanbieder vangt de wijziging op. Je hoeft niets aan te passen. |

| 🟡 Gemiddeld (template + proxy) | ScraperAPI, ScrapingBee, Apify, Octoparse | Anti-bot wordt afgehandeld, maar je extractielogica of actor/template kan updates nodig hebben. |

| 🔴 Hoog (selector-gebaseerd) | ParseHub, Newspaper4k | Wanneer de site verandert, breekt je scraper. Je past selectors of parseregels handmatig aan. |

Thunderbit’s aanpak is hier extra noemenswaardig: omdat de AI bij elke scrape de actuele paginastructuur opnieuw leest, zijn er geen hardcoded selectors om te onderhouden. Ik heb gezien dat onze gebruikers maandenlang dezelfde nieuwsbronnen scrapen zonder hun configuratie te hoeven aanpassen, zelfs nadat die sites lay-outwijzigingen doorvoerden. Dat is precies de betrouwbaarheid die telt als je een dagelijkse nieuwsbriefing of een wekelijks concurrentierapport draait.

Schone artikeltekst: welke nieuws-scrapers halen de ruis er echt uit?

“Ik heb de data, maar die zit vol advertenties, navigatiemenu’s en rommel in de zijbalk.” Dat is ongeveer drie op de vijf supportvragen die ik zie over nieuws scraping.

Hier is de eerlijke verdeling:

| Mogelijkheid tot schone tekst | Tools |

|---|---|

| Geeft standaard schone artikeltekst terug | Newspaper4k, Thunderbit (met subpage scraping + Field AI Prompt), Newsdata.io (premium), Webz.io, Bright Data (News Scraper), Newscatcher |

| Geeft alleen koppen/snippets terug (geen volledige tekst) | SerpApi, Scrapingdog, HasData, Oxylabs (SERP-modus) |

| Geeft ruwe HTML terug (gebruiker moet parsen) | ScraperAPI, ScrapingBee |

| Verschilt per configuratie | Apify, Octoparse, ParseHub |

Newspaper4k is de gouden standaard voor het verwijderen van ruis uit standaard nieuws pagina’s — het is letterlijk voor die taak gebouwd. Maar je hebt Python nodig en het breekt op websites met veel JavaScript.

Thunderbit’s Field AI Prompt is het no-code equivalent: je kunt de AI per kolom instrueren om “alleen de hoofdtekst van het artikel te extraheren, navigatie en advertenties uit te sluiten”, en het kan tijdens de extractie ook labelen, categoriseren of samenvatten. Voor teams die schone artikeltekst nodig hebben zonder code te schrijven, is dit de meest praktische optie die ik ben tegengekomen.

Als je geïnteresseerd bent in hoe AI-gestuurde extractie zich verhoudt tot traditionele methoden, gaat ons artikel over er dieper op in.

Nieuws scrapen op verantwoorde wijze: juridische en ethische basis

Geen van de concurrerende artikelen die ik vond behandelt dit — een gemis dat het waard is om op te vullen, zeker voor enterpriselezers.

robots.txt: Controleer dit altijd. Veel grote nieuwssites verbieden expliciet het scrapen van bepaalde paden. Verantwoorde tools (waaronder Thunderbit) laten browserverzameling toe die rekening houdt met de sessiecontext, maar je moet nog steeds de robots.txt van de site bekijken vóór je grootschalige jobs start.

Gebruiksvoorwaarden: Er is een wezenlijk verschil tussen het extraheren van metadata (titels, datums, URL’s) voor intern onderzoek en het opnieuw publiceren van volledige, auteursrechtelijk beschermde artikelen. Het eerste is doorgaans minder risicovol; het tweede kan echte juridische blootstelling opleveren. Recente zaken zoals en laten zien dat het juridische landschap nog altijd in beweging is.

Best practices: Gebruik officiële API’s wanneer beschikbaar (Google News RSS, Newsdata.io, Newscatcher). Cache verantwoord. Stel rate limits in. Omzeil nooit paywalls. Verschillende tools in deze lijst — waaronder Thunderbit, ScraperAPI en Bright Data — bieden ingebouwde rate limiting of ethische scraping-functies die je helpen aan de veilige kant te blijven.

Dit artikel is informatief en geen juridisch advies. Als je op enterpriseschaal scrapt, raadpleeg dan je juridische team.

Hoe Thunderbit in jouw nieuws-scrapingworkflow past

Omdat mijn team Thunderbit heeft gebouwd, ken ik de sterke en zwakke punten voor nieuws scraping beter dan wie dan ook. Zo ziet de workflow er in de praktijk uit.

De typische workflow voor een zakelijke gebruiker ziet er zo uit:

- Open een nieuws pagina (Google News-resultaten, de homepage van een publicatie, een topicszoekpagina) in Chrome.

- Klik op de Thunderbit-extensie en kies AI Suggest Fields. Thunderbit leest de pagina en stelt kolommen voor — kop, datum, bron, URL, snippet, afbeelding, enz.

- Pas de kolommen aan indien nodig. Wil je sentimentclassificatie? Voeg een kolom toe met een Field AI Prompt zoals “classificeer sentiment als positief, neutraal of negatief.” Wil je alleen artikelen uit een specifieke categorie? Voeg dan een filterprompt toe.

- Klik op Scrape. Kies Browser mode (gebruikt je sessie, handig voor sites die cloud-IP’s blokkeren) of Cloud mode (sneller, verwerkt tot 50 pagina’s tegelijk).

- Scrape Subpages om elke artikel-URL te bezoeken en volledige tekst, auteur, publicatiedatum en afbeeldingen te extraheren.

- Exporteer naar Excel, CSV, , Airtable of Notion.

Voor doorlopende monitoring laat de Scheduled Scraper je dagelijkse of wekelijkse runs instellen met natuurlijke taalintervallen (bijv. “elke werkdag om 8:00”). En omdat Thunderbit ondersteunt, is internationale nieuwsmonitoring eenvoudig.

Waar Thunderbit minder ideaal is: miljoenen artikelen per maand scrapen tegen de laagst mogelijke kosten per eenheid — daarvoor is een enterprise API zoals Bright Data of Webz.io kostenefficiënter. En als je diepe NLP-verrijking nodig hebt (entiteitsextractie, clustering, deduplicatie) ingebakken in de API-response, dan is Newscatcher daar speciaal voor gebouwd.

Je kunt Thunderbit gratis proberen via de — geen creditcard nodig.

Hoe kies je de juiste nieuws-scraper?

Mijn spiekbriefje, samengevat uit het testen van alle 15:

- Niet-technische zakelijke gebruiker die dagelijkse nieuwsdata wil? Begin met Thunderbit. Twee klikken, geen code, AI vangt layoutwijzigingen op.

- Developer die een monitoringpipeline bouwt? SerpApi of Scrapingdog voor SERP-data. ScraperAPI of ScrapingBee voor ruwe HTML met anti-bot.

- Enterprise-team dat schaal en betrouwbaarheid nodig heeft? Bright Data of Oxylabs.

- PR-team dat merkvermeldingen volgt over duizenden bronnen? Newscatcher of Newsdata.io.

- Onderzoeker die een tekstcorpus bouwt? Newspaper4k (als je comfortabel bent met Python) of Thunderbit’s subpage scraping (als je dat niet bent).

- AI-engineer die een RAG-pipeline voedt? Thunderbit API of Webz.io voor schone, gestructureerde artikeltekst.

- Krap budget? Scrapingdog voor API, Thunderbit gratis tier voor no-code, Newspaper4k voor open-source.

De juiste tool hangt af van hoeveel onderhoud je aankunt, je budget en je technische niveau. Twijfel je? Begin met een gratis tier — de meeste van deze tools bieden die — en kijk welke workflow bij jouw praktijk past.

Voor meer opties en vergelijkingen behandelt onze roundup van de het bredere landschap. En als je eerst wilt begrijpen voordat je je vastlegt op een tool, is die gids een goed startpunt.

Conclusie

Nieuws scraping in 2026 is een opgelost probleem — kies de juiste tool voor jouw situatie en de data stroomt. One-size-fits-all aanbevelingen zijn voorbij. SERP API’s zijn geweldig voor koppen, maar leveren geen artikeltekst. Dedicated news API’s zijn fantastisch voor gestructureerde metadata, maar kunnen geen willekeurige URL’s scrapen. No-code AI-tools zoals Thunderbit geven je flexibiliteit en weinig onderhoud, terwijl open-source libraries je controle geven ten koste van je weekenden.

Mijn eerlijke aanbeveling: bepaal of je koppen, volledige artikeltekst of verrijkte metadata nodig hebt — en koppel dat aan het onderhoudsniveau en budget dat je kunt dragen. En als je wilt zien hoe moderne, AI-adaptieve nieuws scraping eruitziet zonder ook maar één regel code te schrijven, . Ik denk dat je verrast zult zijn hoeveel je in een paar klikken gedaan krijgt.

Veel succes met scrapen — en moge je artikeltekst altijd schoon zijn, je selectors nooit breken en je export in het juiste spreadsheet belanden.

FAQ’s

1. Wat is de beste nieuws-scraper voor niet-technische gebruikers?

Thunderbit is de sterkste optie voor niet-technische gebruikers. De AI-gestuurde workflow met 2 klikken vereist geen code of CSS-selectors. De AI leest automatisch de paginastructuur, stelt extractievelden voor en past zich aan wanneer layouts veranderen — dus je hoeft niets te onderhouden. Het exporteert ook direct naar Google Sheets, Airtable en Notion.

2. Kan ik volledige artikeltekst uit nieuws-scrapers halen, of alleen koppen?

Dat hangt af van de tool. SERP API’s zoals SerpApi, Scrapingdog en HasData geven alleen koppen en snippets terug. Dedicated news API’s zoals Newsdata.io en Webz.io geven volledige tekst terug op premiumplannen. No-code tools zoals Thunderbit kunnen volledige artikeltekst extraheren via subpage scraping, en Newspaper4k is speciaal gebouwd voor schone artikelextractie in Python. Controleer altijd of een tool ruwe HTML, snippets of schone artikeltekst teruggeeft voordat je kiest.

3. Gaan nieuws-scrapers kapot wanneer websites hun layout veranderen?

Selector-gebaseerde tools (ParseHub, Octoparse, Newspaper4k, custom Scrapy-pipelines) breken vaak wanneer nieuwssites hun layout updaten — en dat doen nieuwssites vaak. AI-adaptieve tools zoals Thunderbit lezen de paginastructuur elke keer opnieuw, dus layoutwijzigingen breken de workflow niet. Beheerde API’s (SerpApi, Newsdata.io, Newscatcher) handelen wijzigingen aan hun kant af. Als onderhoud een zorg is, geef dan prioriteit aan tools met 🟢 Laag in de vergelijkingstabel.

4. Wat is de goedkoopste manier om nieuws op schaal te scrapen?

Voor API-gebaseerde scraping biedt Scrapingdog de laagste kosten per request (vanaf ongeveer $0,10 per 1.000 resultaten). Voor no-code scraping dekt Thunderbit’s gratis tier kleine projecten, en betaalde plannen beginnen rond $9/maand. Voor open-source is Newspaper4k gratis — maar tel daar ontwikkeltijd en serverkosten bij op, die snel kunnen oplopen.

5. Is het legaal om nieuwswebsites te scrapen?

Het scrapen van publiek toegankelijke data voor intern onderzoek is meestal minder risicovol, maar het opnieuw publiceren van volledige auteursrechtelijk beschermde artikelen kan juridische gevolgen hebben. Controleer altijd de robots.txt en de gebruiksvoorwaarden van een site voordat je gaat scrapen. Gebruik officiële API’s wanneer beschikbaar, respecteer rate limits en omzeil nooit paywalls. Recente zaken zoals hiQ v. LinkedIn en Meta v. Bright Data laten zien dat het juridische landschap nog steeds verandert. Raadpleeg voor scraping op enterpriseschaal je juridische team.

Meer weten