Welke programmeertaal moet je gebruiken voor webscraping? Dat hangt af van je project — en ik heb ontwikkelaars al zien afhaken nadat ze de verkeerde keuze maakten.

De markt voor webscraping-software bereikte . De juiste taal kan zorgen voor snellere resultaten en minder onderhoud. De verkeerde taal betekent kapotte scrapers en verloren weekenden.

Ik bouw al jaren automatiseringstools. Hier zijn zeven talen die ik voor scraping heb gebruikt — met codefragmenten, eerlijke afwegingen en een blik op wanneer je beter helemaal geen code schrijft en in plaats daarvan gebruikt.

Hoe we de beste taal voor webscraping kozen

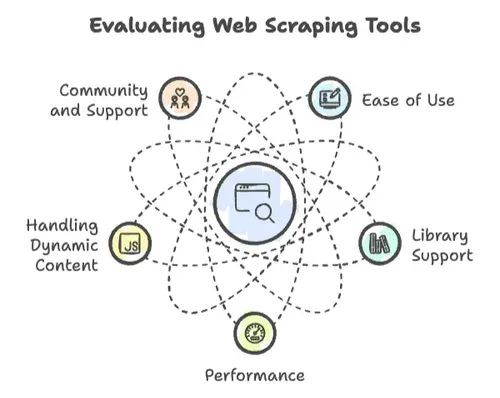

Als het om webscraping gaat, zijn niet alle programmeertalen gelijk. Ik heb projecten zien floreren — en crashen — op basis van een paar belangrijke factoren:

- Gebruiksgemak: Hoe snel kun je aan de slag? Is de syntax vriendelijk, of heb je een doctoraat informatica nodig om alleen al “Hallo, wereld” af te drukken?

- Ondersteuning voor libraries: Zijn er sterke libraries voor HTTP-verzoeken, HTML-parsing en het verwerken van dynamische content? Of ben je het wiel opnieuw aan het uitvinden?

- Prestaties: Kan de taal miljoenen pagina’s verwerken, of houdt hij het na een paar honderd al voor gezien?

- Omgaan met dynamische content: Moderne websites zijn dol op JavaScript. Kan jouw taal dat bijbenen?

- Community en ondersteuning: Als je vastloopt — en dat gebeurt — is er dan een community die je kan helpen?

Op basis van deze criteria — en veel nachtelijk testwerk — zijn dit de zeven talen die ik behandel:

- Python: De favoriet voor zowel beginners als professionals.

- JavaScript & Node.js: De koning van dynamische content.

- Ruby: Schone syntax, snelle scripts.

- PHP: Eenvoud aan de serverkant.

- C++: Voor wanneer je pure snelheid nodig hebt.

- Java