Kapotte links. Verweesde pagina’s. Een “test”-pagina uit 2019 die Google op de een of andere manier tóch heeft geïndexeerd. Als je een website beheert, ken je die frustratie maar al te goed.

Een goede crawler vangt dit soort ellende af — én zet je hele site netjes op de kaart zodat je het ook echt kunt fixen. Alleen halen veel mensen “web crawler” en “web scraper” door elkaar. Dat zijn echt twee verschillende beesten.

Ik heb 10 gratis crawlers getest op echte websites. Sommige zijn goud voor SEO-audits. Andere zijn juist sterker in data-extractie. Dit werkte — en dit vooral niet.

Wat is een websitecrawler? De basis uitgelegd

Laten we eerst één hardnekkig misverstand uit de wereld helpen: een websitecrawler is niet hetzelfde als een webscraper. Ik snap het — die termen vliegen overal door elkaar, maar in de kern doen ze iets anders. Zie een crawler als de cartograaf van je site: hij verkent elke hoek, volgt links en bouwt een kaart van alle pagina’s. Het doel is ontdekking: URL’s vinden, de sitestructuur in kaart brengen en content indexeren. Dat is precies wat zoekmachines zoals Google met hun bots doen, en wat SEO-tools gebruiken om de gezondheid van je site te checken ().

Een webscraper is juist de dataminer. Die wil niet per se de hele kaart — die wil de “goudklompjes”: productprijzen, bedrijfsnamen, reviews, e-mails, noem maar op. Scrapers halen specifieke velden uit de pagina’s die crawlers ontdekken ().

Even een vergelijking:

- Crawler: iemand die elk gangpad in de supermarkt afloopt en een inventaris maakt van alle producten.

- Scraper: iemand die rechtstreeks naar het koffieschap loopt en de prijs noteert van elke biologische blend.

Waarom is dit belangrijk? Omdat je voor verschillende doelen een ander type tool nodig hebt. Wil je alle pagina’s op je site vinden (bijvoorbeeld voor een SEO-audit), dan heb je een crawler nodig. Wil je alle productprijzen van een concurrent verzamelen, dan heb je een scraper nodig — of idealiter een tool die beide kan.

Waarom een online webcrawler gebruiken? Belangrijkste voordelen voor bedrijven

Waarom zou je überhaupt een webcrawler inzetten? Simpel: het web wordt niet kleiner. Sterker nog, meer dan om hun sites te optimaliseren, en sommige SEO-tools crawlen dagelijks .

Dit kun je met crawlers bereiken:

- SEO-audits: vind kapotte links, ontbrekende titels, dubbele content, verweesde pagina’s en meer ().

- Linkcontrole & QA: spot 404’s en redirect-loops voordat je bezoekers ze tegenkomen ().

- Sitemap-generatie: maak automatisch XML-sitemaps voor zoekmachines en planning ().

- Contentinventaris: bouw een overzicht van alle pagina’s, hiërarchie en metadata.

- Compliance & toegankelijkheid: controleer elke pagina op WCAG, SEO en juridische eisen ().

- Performance & security: markeer trage pagina’s, te grote afbeeldingen of beveiligingsissues ().

- Data voor AI & analyse: gebruik crawl-data als input voor analytics- of AI-tools ().

Hier is een snelle tabel die use-cases koppelt aan rollen:

| Use case | Ideaal voor | Voordeel / resultaat |

|---|---|---|

| SEO & site-auditing | Marketing, SEO, eigenaren van kleine bedrijven | Vind technische issues, optimaliseer structuur, verbeter rankings |

| Contentinventaris & QA | Contentmanagers, webmasters | Content auditen of migreren, kapotte links/afbeeldingen opsporen |

| Leadgeneratie (scraping) | Sales, business development | Prospecting automatiseren, CRM vullen met actuele leads |

| Concurrentie-informatie | E-commerce, productmanagers | Concurrentprijzen, nieuwe producten en voorraadwijzigingen monitoren |

| Sitemap & structuur klonen | Developers, DevOps, consultants | Sitestructuur klonen voor redesigns of backups |

| Content-aggregatie | Onderzoekers, media, analisten | Data van meerdere sites verzamelen voor analyse of trendmonitoring |

| Marktonderzoek | Analisten, AI-trainingteams | Grote datasets verzamelen voor analyse of AI-modeltraining |

()

Hoe we de beste gratis websitecrawler-tools hebben gekozen

Ik heb behoorlijk wat late avonden (en meer koffie dan ik wil toegeven) besteed aan het uitpluizen van crawler-tools, documentatie doorspitten en testcrawls draaien. Dit waren mijn criteria:

- Technische mogelijkheden: kan het moderne sites aan (JavaScript, logins, dynamische content)?

- Gebruiksgemak: is het toegankelijk voor niet-techneuten, of heb je command-line-magie nodig?

- Limieten van het gratis plan: is het echt gratis, of vooral een lokkertje?

- Online beschikbaarheid: is het cloud, desktop of een codebibliotheek?

- Unieke functies: doet het iets extra’s — zoals AI-extractie, visuele sitemaps of event-driven crawling?

Ik heb elke tool getest, gebruikersfeedback bekeken en functies naast elkaar gelegd. Als een tool me zin gaf om mijn laptop uit het raam te gooien, kwam hij niet op de lijst.

Snelle vergelijking: 10 beste gratis websitecrawlers in één oogopslag

| Tool & type | Kernfuncties | Beste use case | Technische vereisten | Details gratis plan |

|---|---|---|---|---|

| BrightData (Cloud/API) | Enterprise crawling, proxies, JS-rendering, CAPTCHA-oplossing | Dataverzameling op grote schaal | Enige technische kennis handig | Gratis proef: 3 scrapers, 100 records per scraper (±300 records totaal) |

| Crawlbase (Cloud/API) | API-crawling, anti-bot, proxies, JS-rendering | Devs die backend crawl-infra nodig hebben | API-integratie | Gratis: ~5.000 API-calls voor 7 dagen, daarna 1.000/maand |

| ScraperAPI (Cloud/API) | Proxy-rotatie, JS-rendering, async crawl, kant-en-klare endpoints | Devs, prijsmonitoring, SEO-data | Minimale setup | Gratis: 5.000 API-calls voor 7 dagen, daarna 1.000/maand |

| Diffbot Crawlbot (Cloud) | AI-crawl + extractie, knowledge graph, JS-rendering | Gestructureerde data op schaal, AI/ML | API-integratie | Gratis: 10.000 credits/maand (±10k pagina’s) |

| Screaming Frog (Desktop) | SEO-audit, link/meta-analyse, sitemap, custom extractie | SEO-audits, sitebeheer | Desktop-app, GUI | Gratis: 500 URL’s per crawl, alleen basisfuncties |

| SiteOne Crawler (Desktop) | SEO, performance, toegankelijkheid, security, offline export, Markdown | Devs, QA, migratie, documentatie | Desktop/CLI, GUI | Gratis & open-source, 1.000 URL’s in GUI-rapport (instelbaar) |

| Crawljax (Java, OpenSrc) | Event-driven crawl voor JS-zware sites, statische export | Devs, QA voor dynamische webapps | Java, CLI/config | Gratis & open-source, geen limieten |

| Apache Nutch (Java, OpenSrc) | Gedistribueerd, plugin-based, Hadoop-integratie, custom search | Eigen zoekmachines, grootschalige crawl | Java, command-line | Gratis & open-source, alleen infra-kosten |

| YaCy (Java, OpenSrc) | Peer-to-peer crawl & search, privacy, web/intranet-indexering | Private search, decentralisatie | Java, browser-UI | Gratis & open-source, geen limieten |

| PowerMapper (Desktop/SaaS) | Visuele sitemaps, toegankelijkheid, QA, browsercompatibiliteit | Bureaus, QA, visuele mapping | GUI, eenvoudig | Gratis proef: 30 dagen, 100 pagina’s (desktop) of 10 pagina’s (online) per scan |

BrightData: cloudcrawler op enterprise-niveau

BrightData is het “zware geschut” onder de crawlers. Het is een cloudplatform met een enorm proxynetwerk, JavaScript-rendering, CAPTCHA-oplossing en een IDE voor maatwerkcrawls. Voor grootschalige dataverzameling — denk aan het monitoren van prijzen op honderden e-commerce sites — is de infrastructuur van BrightData lastig te kloppen ().

Sterke punten:

- Kan lastige sites met anti-botmaatregelen aan

- Schaalbaar voor enterprise-behoeften

- Kant-en-klare templates voor veelvoorkomende sites

Beperkingen:

- Geen blijvend gratis plan (alleen proef: 3 scrapers, 100 records per scraper)

- Voor simpele audits vaak te uitgebreid

- Leercurve voor niet-technische gebruikers

Als je op schaal wilt crawlen, is BrightData alsof je een Formule 1-auto huurt. Alleen: na de proefrit is het niet gratis ().

Crawlbase: API-gedreven gratis webcrawler voor developers

Crawlbase (voorheen ProxyCrawl) draait om programmatisch crawlen. Je roept hun API aan met een URL en krijgt HTML terug — terwijl proxies, geotargeting en CAPTCHAs op de achtergrond worden afgehandeld ().

Sterke punten:

- Hoge succesratio’s (99%+)

- Kan JavaScript-zware sites aan

- Ideaal om in je eigen apps of workflows te integreren

Beperkingen:

- Vereist API- of SDK-integratie

- Gratis plan: ~5.000 API-calls voor 7 dagen, daarna 1.000/maand

Ben je developer en wil je op schaal crawlen (en eventueel scrapen) zonder proxybeheer, dan is Crawlbase een sterke keuze ().

ScraperAPI: dynamisch webcrawlen eenvoudiger gemaakt

ScraperAPI is de “haal dit even voor me op”-API. Jij geeft een URL door, zij regelen proxies, headless browsers en anti-botmaatregelen, en leveren de HTML (of bij sommige sites direct gestructureerde data). Vooral handig voor dynamische pagina’s en met een ruim gratis plan ().

Sterke punten:

- Heel eenvoudig voor developers (één API-call)

- Omgaan met CAPTCHAs, IP-bans en JavaScript

- Gratis: 5.000 API-calls voor 7 dagen, daarna 1.000/maand

Beperkingen:

- Geen visuele crawlrapporten

- Wil je links volgen, dan moet je zelf crawl-logica scripten

Wil je webcrawling in minuten in je codebase hangen, dan is ScraperAPI een logische keuze.

Diffbot Crawlbot: automatische ontdekking van websitestructuur

Diffbot Crawlbot wordt pas echt slim. Het crawlt niet alleen — het gebruikt AI om pagina’s te classificeren en gestructureerde data (artikelen, producten, events, enz.) als JSON te extraheren. Alsof je een robot-stagiair hebt die daadwerkelijk begrijpt wat hij leest ().

Sterke punten:

- AI-gedreven extractie, niet alleen crawling

- Kan JavaScript en dynamische content aan

- Gratis: 10.000 credits/maand (ongeveer 10k pagina’s)

Beperkingen:

- Gericht op developers (API-integratie)

- Minder een visuele SEO-tool; meer voor dataprojecten

Voor gestructureerde data op schaal — zeker voor AI of analytics — is Diffbot een krachtpatser.

Screaming Frog: gratis desktop SEO-crawler

Screaming Frog is de klassieker voor SEO-audits op desktop. De gratis versie crawlt tot 500 URL’s per scan en geeft je van alles: kapotte links, metatags, dubbele content, sitemaps en meer ().

Sterke punten:

- Snel, grondig en breed vertrouwd in SEO

- Geen code nodig — URL invoeren en starten

- Gratis tot 500 URL’s per crawl

Beperkingen:

- Alleen desktop (geen cloudversie)

- Geavanceerde functies (JS-rendering, planning) vereisen een betaalde licentie

Als je SEO serieus neemt, hoort Screaming Frog in je toolkit — maar verwacht niet dat je gratis een site van 10.000 pagina’s kunt crawlen.

SiteOne Crawler: statische site-export en documentatie

SiteOne Crawler is een Zwitsers zakmes voor technische audits. Open-source, cross-platform, en het kan crawlen, auditen én je site exporteren naar Markdown voor documentatie of offline gebruik ().

Sterke punten:

- Combineert SEO, performance, toegankelijkheid en security

- Exporteert sites voor archivering of migratie

- Gratis & open-source, zonder gebruikslimieten

Beperkingen:

- Technischer dan sommige pure GUI-tools

- GUI-rapport standaard beperkt tot 1.000 URL’s (instelbaar)

Voor developers, QA of consultants die diepgang willen (en van open source houden) is SiteOne een verborgen parel.

Crawljax: open-source Java-webcrawler voor dynamische pagina’s

Crawljax is een specialist: gemaakt om moderne webapps met veel JavaScript te crawlen door gebruikersinteracties te simuleren (klikken, formulieren invullen, enz.). Het is event-driven en kan zelfs een statische versie van een dynamische site genereren ().

Sterke punten:

- Onovertroffen voor SPAs en AJAX-zware sites

- Open-source en uitbreidbaar

- Geen gebruikslimieten

Beperkingen:

- Vereist Java en wat programmeer-/configwerk

- Niet bedoeld voor niet-technische gebruikers

Moet je een React- of Angular-app crawlen alsof je een echte gebruiker bent, dan is Crawljax je beste vriend.

Apache Nutch: schaalbare gedistribueerde websitecrawler

Apache Nutch is de “oervader” van open-source crawlers. Ontworpen voor enorme, gedistribueerde crawls — denk aan je eigen zoekmachine bouwen of miljoenen pagina’s indexeren ().

Sterke punten:

- Schaalbaar tot miljarden pagina’s met Hadoop

- Zeer configureerbaar en uitbreidbaar

- Gratis & open-source

Beperkingen:

- Steile leercurve (Java, command-line, configuraties)

- Niet ideaal voor kleine sites of casual gebruik

Wil je op web-schaal crawlen en schrik je niet van de command line, dan is Nutch jouw tool.

YaCy: peer-to-peer webcrawler en zoekmachine

YaCy is een bijzondere, gedecentraliseerde crawler en zoekmachine. Elke instance crawlt en indexeert sites, en je kunt deelnemen aan een peer-to-peer netwerk om indexen te delen met anderen ().

Sterke punten:

- Privacy-first, geen centrale server

- Handig voor private search of intranet-zoek

- Gratis & open-source

Beperkingen:

- Resultaten hangen af van de dekking van het netwerk

- Enige setup nodig (Java, browser-UI)

Ben je geïnteresseerd in decentralisatie of wil je je eigen zoekmachine, dan is YaCy een fascinerende optie.

PowerMapper: visuele sitemapgenerator voor UX en QA

PowerMapper draait om het zichtbaar maken van je sitestructuur. Het crawlt je site en maakt interactieve sitemaps, en controleert daarnaast toegankelijkheid, browsercompatibiliteit en SEO-basiszaken ().

Sterke punten:

- Visuele sitemaps zijn ideaal voor bureaus en designers

- Checkt toegankelijkheid en compliance

- Eenvoudige GUI, geen technische kennis nodig

Beperkingen:

- Alleen gratis proef (30 dagen, 100 pagina’s desktop/10 pagina’s online per scan)

- Volledige versie is betaald

Moet je een sitemap presenteren aan klanten of compliance checken, dan is PowerMapper erg handig.

De juiste gratis webcrawler kiezen voor jouw situatie

Met zoveel opties: hoe kies je? Mijn snelle richtlijn:

- Voor SEO-audits: Screaming Frog (kleine sites), PowerMapper (visueel), SiteOne (diepe audits)

- Voor dynamische webapps: Crawljax

- Voor grootschalig of custom search: Apache Nutch, YaCy

- Voor developers die API-toegang willen: Crawlbase, ScraperAPI, Diffbot

- Voor documentatie of archivering: SiteOne Crawler

- Voor enterprise-schaal met proefperiode: BrightData, Diffbot

Belangrijke factoren:

- Schaalbaarheid: hoe groot is je site of crawl-opdracht?

- Gebruiksgemak: wil je code, of liever point-and-click?

- Exportmogelijkheden: heb je CSV/JSON nodig of koppelingen met andere tools?

- Support: is er een community of documentatie als je vastloopt?

Wanneer webcrawling en webscraping samenkomen: waarom Thunderbit slimmer is

De realiteit: de meeste mensen crawlen niet om een mooie kaart te maken. Het echte doel is meestal gestructureerde data — productlijsten, contactgegevens of contentinventarissen. Daar komt om de hoek kijken.

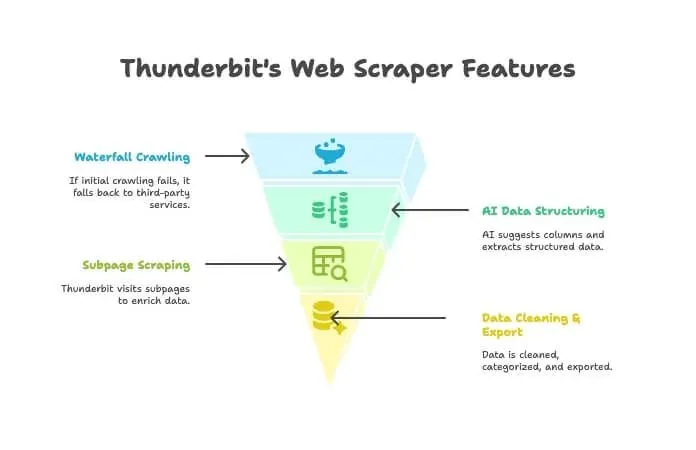

Thunderbit is niet alleen een crawler of alleen een scraper — het is een AI-gedreven Chrome-extensie die beide combineert. Zo werkt het:

- AI Crawler: Thunderbit verkent de site, net als een crawler.

- Waterfall Crawling: als Thunderbit de pagina niet kan ophalen (bijvoorbeeld door stevige anti-bot), schakelt het automatisch over op externe crawlingdiensten — zonder handmatige setup.

- AI-structurering van data: zodra de HTML binnen is, stelt Thunderbit met AI de juiste kolommen voor en haalt het gestructureerde data eruit (namen, prijzen, e-mails, enz.) zonder dat jij selectors hoeft te schrijven.

- Subpagina-scraping: details nodig van elke productpagina? Thunderbit bezoekt automatisch subpagina’s en verrijkt je tabel.

- Opschonen & exporteren: samenvatten, categoriseren, vertalen en exporteren naar Excel, Google Sheets, Airtable of Notion — met één klik.

- No-code eenvoud: als je een browser kunt gebruiken, kun je Thunderbit gebruiken. Geen code, geen proxies, geen gedoe.

Wanneer kies je Thunderbit boven een traditionele crawler?

- Als je einddoel een nette, bruikbare spreadsheet is — niet alleen een lijst met URL’s.

- Als je het hele proces wilt automatiseren (crawlen, extraheren, opschonen, exporteren) in één tool.

- Als je je tijd (en je zenuwen) belangrijk vindt.

Je kunt en zelf ervaren waarom zoveel zakelijke gebruikers overstappen.

Conclusie: haal het maximale uit gratis websitecrawlers

Websitecrawlers zijn inmiddels behoorlijk volwassen. Of je nu marketeer bent, developer, of gewoon je site gezond wilt houden: er is altijd wel een gratis (of in elk geval gratis te proberen) tool die past. Van enterprise-platforms zoals BrightData en Diffbot, tot open-source parels zoals SiteOne en Crawljax, tot visuele mappers zoals PowerMapper — de keuze is breder dan ooit.

Maar als je een slimmere, meer geïntegreerde route zoekt van “ik heb deze data nodig” naar “hier is mijn spreadsheet”, probeer Thunderbit dan eens. Het is gemaakt voor zakelijke gebruikers die output willen, niet alleen rapporten.

Klaar om te starten met crawlen? Download een tool, draai een scan en ontdek wat je hebt gemist. En als je van crawling naar bruikbare data wilt in twee klikken, .

Voor meer deep dives en praktische handleidingen: bezoek de .

FAQ

Wat is het verschil tussen een websitecrawler en een webscraper?

Een crawler ontdekt en brengt alle pagina’s van een site in kaart (denk: een inhoudsopgave maken). Een scraper haalt specifieke datavelden (zoals prijzen, e-mails of reviews) uit die pagina’s. Crawlers vinden, scrapers delven ().

Welke gratis webcrawler is het beste voor niet-technische gebruikers?

Voor kleine sites en SEO-audits is Screaming Frog gebruiksvriendelijk. Voor visuele mapping is PowerMapper sterk (tijdens de proefperiode). Thunderbit is het makkelijkst als je doel gestructureerde data is en je een no-code, browsergerichte ervaring wilt.

Zijn er websites die webcrawlers blokkeren?

Ja — sommige sites gebruiken robots.txt of anti-botmaatregelen (zoals CAPTCHAs of IP-bans) om crawlers te weren. Tools zoals ScraperAPI, Crawlbase en Thunderbit (met waterfall crawling) kunnen hier vaak omheen werken, maar crawl altijd verantwoord en respecteer de regels van de site ().

Hebben gratis websitecrawlers limieten op pagina’s of functies?

Meestal wel. Zo is de gratis versie van Screaming Frog beperkt tot 500 URL’s per crawl; PowerMapper’s proef is 100 pagina’s. API-tools werken vaak met maandelijkse credits. Open-source tools zoals SiteOne of Crawljax hebben doorgaans geen harde limieten, maar je wordt begrensd door je hardware.

Is het gebruik van een webcrawler legaal en privacy-proof?

In het algemeen is het crawlen van publieke webpagina’s legaal, maar check altijd de gebruiksvoorwaarden en robots.txt van een site. Crawl nooit privé- of afgeschermde data zonder toestemming, en houd rekening met privacywetgeving als je persoonsgegevens verzamelt ().