Webdata is de standaardinput voor sales, marketing en operations. Als je nog steeds handmatig kopieert en plakt, loop je achter.

Maar hier zit het probleem met ‘gratis’ scrapingtools: de meeste zijn niet echt gratis. Het zijn proefversies met strenge limieten, of ze verstoppen de functies die je echt nodig hebt achter een betaalmuur.

Ik heb 12 tools geëvalueerd om te ontdekken welke je ook op het gratis niveau echt werk laten doen. Ik heb Google Maps-vermeldingen, dynamische pagina’s achter logins en PDF’s gescrapet. Sommige deden wat ze moesten doen. Andere verspeelden mijn middag.

Hier is de eerlijke analyse — te beginnen met de tools die ik echt zou aanraden.

Waarom gratis scrapers belangrijker zijn dan ooit

Laten we eerlijk zijn: in 2026 is webscraping niet alleen voor hackers of data scientists. Het is een vast onderdeel geworden van moderne bedrijven, en de cijfers bevestigen dat. De markt voor webscrapingsoftware bereikte en zal naar verwachting tegen 2032 meer dan verdubbelen. Waarom? Omdat iedereen — van salesteams tot makelaars — webdata gebruikt om voorop te blijven lopen.

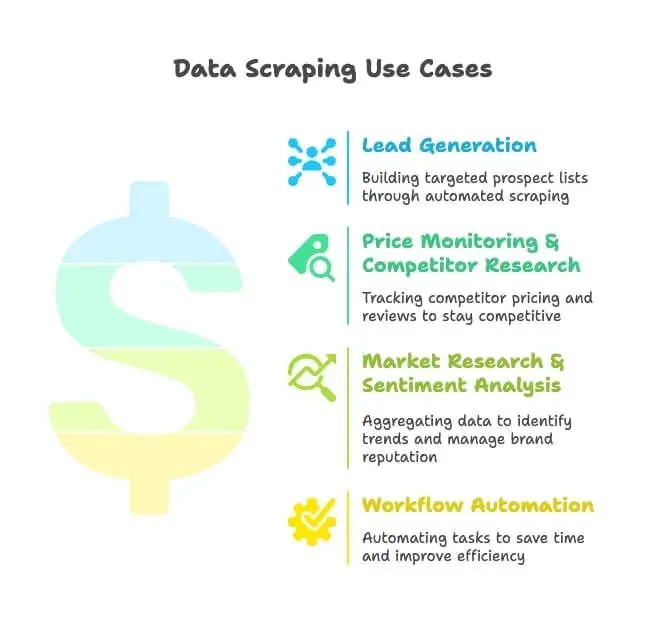

- Leadgeneratie: salesteams scrapen bedrijvengidsen, Google Maps en sociale media om gerichte prospectlijsten op te bouwen — geen handmatig speurwerk meer.

- Prijsbewaking en concurrentieonderzoek: e-commerce- en retailteams volgen SKU’s, prijzen en reviews van concurrenten om scherp te blijven (en ja, 82% van de e-commercebedrijven scrapt precies om die reden).

- Marktonderzoek en sentimentanalyse: marketeers bundelen reviews, nieuws en social buzz om trends te signaleren en de merkreputatie te bewaken.

- Workflowautomatisering: operationele teams automatiseren alles van voorraadcontroles tot periodieke rapportages en besparen zo elke week uren.

En hier is een leuke statistiek: bedrijven die AI-aangedreven webscrapers gebruiken, besparen vergeleken met handmatige methoden. Dat is niet zomaar wat tijd — dat is het verschil tussen om 18.00 uur naar huis gaan of pas om 21.00 uur.

Hoe we de beste gratis data-extractietools selecteerden

Ik heb veel lijsten met ‘beste webscraper’ gezien die gewoon marketingtekst herkauwen. Hier niet. Voor deze lijst keek ik naar:

- Werkelijke bruikbaarheid van het gratis plan: laat de gratis laag je echt werk doen, of is het alleen een teaser?

- Gebruiksgemak: kan iemand zonder code binnen minuten resultaat krijgen, of heb je een PhD in regex nodig?

- Ondersteunde type websites: statisch, dynamisch, gepagineerd, login vereist, PDF’s, sociale media — kan de tool echte scenario’s aan?

- Exportopties voor data: krijg je je data zonder gedoe in Excel, Google Sheets, Notion of Airtable?

- Extra functies: AI-gestuurde extractie, planning, sjablonen, nabewerking, integraties.

- Geschikte gebruiker: is deze tool bedoeld voor zakelijke gebruikers, analisten of ontwikkelaars?

Ik dook ook in de documentatie van elke tool, testte de onboarding en vergeleek de limieten van de gratis plannen — want ‘gratis’ is niet altijd zo gratis als het klinkt.

In één oogopslag: 12 gratis data-extractietools vergeleken

Hier is een vergelijking naast elkaar om je te helpen snel de juiste tool voor jouw situatie te vinden.

| Tool | Platform | Beperkingen gratis plan | Beste voor | Exportformaten | Unieke functies |

|---|---|---|---|---|---|

| Thunderbit | Chrome-extensie | 6 pagina’s/maand | Niet-codeerders, zakelijk gebruik | Excel, CSV | AI-prompts, scraping van PDF’s/afbeeldingen, crawl van subpagina’s |

| Browse AI | Cloud | 50 credits/maand | No-code gebruikers | CSV, Sheets | Robots met point-and-click, planning |

| Octoparse | Desktop | 10 taken, 50k rijen/maand | No-code, semi-technisch | CSV, Excel, JSON | Visuele workflow, ondersteuning voor dynamische sites |

| ParseHub | Desktop | 5 projecten, 200 pagina’s/run | No-code, semi-technisch | CSV, Excel, JSON | Visueel, ondersteuning voor dynamische sites |

| Webscraper.io | Chrome-extensie | Onbeperkt lokaal gebruik | No-code, eenvoudige taken | CSV, XLSX | Sitemap-gebaseerd, community-sjablonen |

| Apify | Cloud | $5 credits/maand | Teams, semi-technisch, devs | CSV, JSON, Sheets | Actor-marktplaats, planning, API |

| Scrapy | Python-bibliotheek | Onbeperkt (open source) | Ontwikkelaars | CSV, JSON, DB | Volledige codecontrole, schaalbaar |

| Puppeteer | Node.js-bibliotheek | Onbeperkt (open source) | Ontwikkelaars | Aangepast (code) | Headless browser, ondersteuning voor dynamische JS |

| Selenium | Meertalig | Onbeperkt (open source) | Ontwikkelaars | Aangepast (code) | Browserautomatisering, ondersteuning voor meerdere browsers |

| Zyte | Cloud | 1 spider, 1 uur/job, 7 dagen bewaartermijn | Devs, operationele teams | CSV, JSON | Gehoste Scrapy, proxybeheer |

| SerpAPI | API | 100 zoekopdrachten/maand | Devs, analisten | JSON | Zoekmachine-API’s, anti-blokkering |

| Diffbot | API | 10.000 credits/maand | Devs, AI-projecten | JSON | AI-extractie, knowledge graph |

Thunderbit: de topkeuze voor AI-aangedreven, gebruiksvriendelijke data-extractie

Laten we het hebben over waarom bovenaan mijn lijst staat. Ik zeg dit niet alleen omdat ik deel uitmaak van het team — ik geloof oprecht dat Thunderbit het dichtst in de buurt komt van een AI-stagiair die echt luistert (en niet om koffiepauzes vraagt).

Thunderbit is niet de gebruikelijke ervaring van “leer de tool en scrape dan”. Het voelt meer alsof je instructies geeft aan een slimme assistent: je beschrijft wat je wilt (“Haal alle productnamen, prijzen en links van deze pagina”), en Thunderbit’s AI doet de rest. Geen XPath, geen CSS-selectors, geen regex-gedoe. En als je subpagina’s wilt scrapen (zoals productdetailpagina’s of contactlinks van bedrijven), kan Thunderbit automatisch doorklikken en je tabel verrijken — opnieuw gewoon door op een knop te klikken.

Maar wat Thunderbit echt onderscheidt, is wat er gebeurt ná het scrapen. Moet je je data samenvatten, vertalen, categoriseren of opschonen? Thunderbit’s ingebouwde AI-nabewerking regelt het. Je krijgt niet alleen ruwe data — je krijgt gestructureerde, bruikbare informatie die meteen klaar is voor je CRM, spreadsheet of volgende grote project.

Gratis plan: met de gratis proefversie van Thunderbit kun je tot 6 pagina’s scrapen (of 10 met de trial boost), inclusief PDF’s, afbeeldingen en zelfs sjablonen voor sociale media. Je kunt gratis exporteren naar Excel of CSV en functies uitproberen zoals e-mail-/telefoon-/afbeeldingsextractie. Voor grotere taken ontgrendelen betaalde plannen meer pagina’s, directe export naar Google Sheets/Notion/Airtable, geplande scraping en directe sjablonen voor populaire sites zoals Amazon, Google Maps en Instagram.

Als je Thunderbit in actie wilt zien, bekijk dan de of bezoek ons voor snelle startvideo’s.

Opvallende functies van Thunderbit

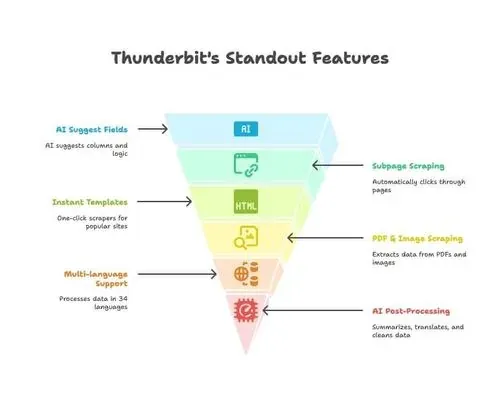

- AI-velden voorstellen: beschrijf gewoon de data die je wilt, en Thunderbit’s AI stelt de juiste kolommen en extractielogica voor.

- Scraping van subpagina’s: klik automatisch door detailpagina’s of links heen en verrijk je hoofdtabel — zonder handmatige setup.

- Directe sjablonen: scrapers met één klik voor Amazon, Google Maps, Instagram en meer.

- PDF- en afbeeldingsextractie: haal tabellen en data uit PDF’s en afbeeldingen met AI — geen extra tools nodig.

- Meertalige ondersteuning: scrape en verwerk data in 34 talen.

- Directe export: stuur je data rechtstreeks naar Excel, Google Sheets, Notion of Airtable (betaalde plannen).

- AI-nabewerking: vat samen, vertaal, categoriseer en reinig data terwijl je scrape.

- Gratis e-mail-/telefoon-/afbeeldingsextractie: haal contactgegevens of afbeeldingen van elke site met één klik op.

Thunderbit overbrugt de kloof tussen “gewoon data scrapen” en “data krijgen die je echt kunt gebruiken”. Het is het dichtst bij een echte AI-datassistent voor zakelijke gebruikers dat ik heb gezien.

De rest van de top 12: gratis data-extractietools beoordeeld

Laten we de rest van het veld uitsplitsen, gegroepeerd op wie er het meeste profijt van heeft.

Voor no-code- en zakelijke gebruikers

Thunderbit

Hierboven al behandeld. De makkelijkste instap voor niet-codeerders, met AI-functies en directe sjablonen.

Webscraper.io

- Platform: Chrome-extensie

- Beste voor: eenvoudige, statische sites; niet-codeerders die niet erg vinden om wat te experimenteren.

- Belangrijkste functies: sitemap-gebaseerde scraping, ondersteunt paginering, CSV/XLSX-export.

- Gratis plan: onbeperkt lokaal gebruik, maar geen cloud-runs of planning. Alleen handmatig gebruik.

- Beperkingen: geen ingebouwde ondersteuning voor logins, PDF’s of complexe dynamische content. Alleen communitysupport.

ParseHub

- Platform: desktop-app (Windows, Mac, Linux)

- Beste voor: niet-codeerders en semi-technische gebruikers die tijd willen investeren in leren.

- Belangrijkste functies: visuele workflowbouwer, ondersteunt dynamische sites, AJAX, logins, paginering.

- Gratis plan: 5 openbare projecten, 200 pagina’s per run, alleen handmatige runs.

- Beperkingen: projecten zijn openbaar op het gratis plan (wees voorzichtig met gevoelige data), geen planning, lagere extractiesnelheden.

Octoparse

- Platform: desktop-app (Windows/Mac), cloud (betaald)

- Beste voor: niet-codeerders en analisten die kracht en flexibiliteit willen.

- Belangrijkste functies: visueel point-and-click, ondersteuning voor dynamische content, sjablonen voor populaire sites.

- Gratis plan: 10 taken, tot 50.000 rijen/maand, alleen desktop (geen cloud/planning).

- Beperkingen: geen API, IP-rotatie of planning op de gratis laag. De leercurve kan steil zijn voor complexe sites.

Browse AI

- Platform: cloud

- Beste voor: no-code gebruikers die eenvoudige scraping en monitoring willen automatiseren.

- Belangrijkste functies: robotopname met point-and-click, planning, integraties (Sheets, Zapier).

- Gratis plan: 50 credits/maand, 1 website, tot 5 robots.

- Beperkingen: beperkte capaciteit, bij complexe sites is er wat initiële leercurve.

Voor ontwikkelaars en technische gebruikers

Scrapy

- Platform: Python-bibliotheek (open source)

- Beste voor: ontwikkelaars die volledige controle en schaalbaarheid willen.

- Belangrijkste functies: sterk aanpasbaar, ondersteunt grootschalige crawls, middleware, pipelines.

- Gratis plan: onbeperkt (open source).

- Beperkingen: geen GUI, vereist Python-codering. Niet voor niet-codeerders.

Puppeteer

- Platform: Node.js-bibliotheek (open source)

- Beste voor: ontwikkelaars die dynamische, JavaScript-zware sites scrapen.

- Belangrijkste functies: headless browserautomatisering, volledige controle over navigatie en extractie.

- Gratis plan: onbeperkt (open source).

- Beperkingen: vereist JavaScript-codering, geen GUI.

Selenium

- Platform: meertalig (Python, Java, enz.), open source

- Beste voor: ontwikkelaars die browsers automatiseren voor scraping of testen.

- Belangrijkste functies: ondersteuning voor meerdere browsers, automatiseert klikken, scrollen en inloggen.

- Gratis plan: onbeperkt (open source).

- Beperkingen: trager dan headless libraries, scripting vereist.

Zyte (Scrapy Cloud)

- Platform: cloud

- Beste voor: ontwikkelaars en operationele teams die Scrapy-spiders op schaal uitrollen.

- Belangrijkste functies: gehoste Scrapy, proxybeheer, jobs plannen.

- Gratis plan: 1 gelijktijdige spider, 1 uur/job, 7 dagen databewaring.

- Beperkingen: geen geavanceerde planning op het gratis plan, kennis van Scrapy vereist.

Voor team- en enterprisegebruik

Apify

- Platform: cloud

- Beste voor: teams, semi-technische gebruikers en ontwikkelaars die kant-en-klare of aangepaste scrapers willen.

- Belangrijkste functies: actor-marktplaats (vooraf gebouwde bots), planning, API, integraties.

- Gratis plan: $5 credits/maand (genoeg voor kleine taken), 7 dagen databewaring.

- Beperkingen: enige leercurve, gebruik begrensd door credits.

SerpAPI

- Platform: API

- Beste voor: ontwikkelaars en analisten die zoekmachinedata nodig hebben (Google, Bing, YouTube).

- Belangrijkste functies: zoek-API’s, anti-blokkering, gestructureerde JSON-output.

- Gratis plan: 100 zoekopdrachten/maand.

- Beperkingen: niet voor willekeurige websites, alleen API-gebruik.

Diffbot

- Platform: API

- Beste voor: ontwikkelaars, AI/ML-teams en ondernemingen die gestructureerde webdata op schaal nodig hebben.

- Belangrijkste functies: AI-aangedreven extractie, knowledge graph, artikelen-/producten-API’s.

- Gratis plan: 10.000 credits/maand.

- Beperkingen: alleen via API, technische vaardigheden vereist, throughput met limiet.

Beperkingen van het gratis plan: wat ‘gratis’ echt betekent voor elke data-extractietool

Laten we eerlijk zijn — ‘gratis’ kan van alles betekenen, van “onbeperkt voor hobbyisten” tot “net genoeg om je te laten wennen”. Hier is een overzicht van wat je echt krijgt:

| Tool | Pagina’s/rijen per maand | Exportformaten | Planning | API-toegang | Opvallende gratis beperkingen |

|---|---|---|---|---|---|

| Thunderbit | 6 pagina’s | Excel, CSV | Nee | Nee | AI-veldvoorstellen beperkt, geen directe export naar Sheets/Notion op gratis plan |

| Browse AI | 50 credits | CSV, Sheets | Ja | Ja | 1 website, 5 robots, 15 dagen bewaartermijn |

| Octoparse | 50.000 rijen | CSV, Excel, JSON | Nee | Nee | Alleen desktop, geen cloud/planning |

| ParseHub | 200 pagina’s/run | CSV, Excel, JSON | Nee | Nee | 5 openbare projecten, trage snelheid |

| Webscraper.io | Onbeperkt lokaal | CSV, XLSX | Nee | Nee | Handmatige runs, geen cloud |

| Apify | $5 credits (~klein) | CSV, JSON, Sheets | Ja | Ja | 7 dagen bewaartermijn, creditlimiet |

| Scrapy | Onbeperkt | CSV, JSON, DB | Nee | n.v.t. | Coderen vereist |

| Puppeteer | Onbeperkt | Aangepast (code) | Nee | n.v.t. | Coderen vereist |

| Selenium | Onbeperkt | Aangepast (code) | Nee | n.v.t. | Coderen vereist |

| Zyte | 1 spider, 1 uur/job | CSV, JSON | Beperkt | Ja | 7 dagen bewaartermijn, 1 gelijktijdige job |

| SerpAPI | 100 zoekopdrachten | JSON | Nee | Ja | Alleen zoek-API’s |

| Diffbot | 10.000 credits | JSON | Nee | Ja | Alleen API, met snelheidslimiet |

Kortom: voor echte projecten bieden Thunderbit, Browse AI en Apify de meest bruikbare gratis proefversies voor zakelijke gebruikers. Voor doorlopende of grootschalige scraping loop je al snel tegen limieten aan en moet je upgraden of overstappen op open-source- of code-oplossingen.

Welke data-extractietool past het best bij jouw behoeften? (gids op basis van gebruikerstype)

Hier is een handige samenvatting om je te helpen de juiste tool te kiezen op basis van je rol en je gemak met technologie:

| Gebruikerstype | Beste tools (gratis) | Waarom |

|---|---|---|

| Niet-codeerder (Sales/Marketing) | Thunderbit, Browse AI, Webscraper.io | Snelst te leren, point-and-click, AI-hulp |

| Semi-technisch (Operations/Analist) | Octoparse, ParseHub, Apify, Zyte | Meer kracht, kan complexe sites aan, deels scripting mogelijk |

| Ontwikkelaar/Engineer | Scrapy, Puppeteer, Selenium, Diffbot, SerpAPI | Volledige controle, onbeperkt, API-first |

| Team/Enterprise | Apify, Zyte | Samenwerking, planning, integraties |

Praktijkscenario’s voor webscraping: vergelijking van de aanpasbaarheid van tools

Laten we zien hoe deze tools presteren in vijf veelvoorkomende scraping-scenario’s:

| Scenario | Thunderbit | Browse AI | Octoparse | ParseHub | Webscraper.io | Apify | Scrapy | Puppeteer | Selenium | Zyte | SerpAPI | Diffbot |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Lijsten met paginering | Makkelijk | Makkelijk | Gemiddeld | Gemiddeld | Gemiddeld | Makkelijk | Makkelijk | Makkelijk | Makkelijk | Makkelijk | n.v.t. | Gemiddeld |

| Google Maps-vermeldingen | Makkelijk* | Moeilijk | Gemiddeld | Gemiddeld | Moeilijk | Makkelijk | Moeilijk | Moeilijk | Moeilijk | Moeilijk | Makkelijk | n.v.t. |

| Pagina’s met loginvereiste | Makkelijk | Gemiddeld | Gemiddeld | Gemiddeld | Handmatig | Gemiddeld | Makkelijk | Makkelijk | Makkelijk | Makkelijk | n.v.t. | n.v.t. |

| PDF-data-extractie | Makkelijk | Nee | Nee | Nee | Nee | Gemiddeld | Moeilijk | Moeilijk | Moeilijk | Moeilijk | Nee | Beperkt |

| Content van sociale media | Makkelijk* | Gedeeltelijk | Moeilijk | Moeilijk | Moeilijk | Makkelijk | Moeilijk | Moeilijk | Moeilijk | Moeilijk | YouTube | Beperkt |

- Thunderbit en Apify bieden vooraf gebouwde sjablonen/actors voor Google Maps en scraping van sociale media, waardoor deze scenario’s veel makkelijker worden voor niet-technische gebruikers.

Plug-in vs. desktop vs. cloud: wat is de beste ervaring met een webscraper?

- Chrome-extensies (Thunderbit, Webscraper.io):

- Voordelen: snel te starten, draait in je browser, minimale setup.

- Nadelen: handmatig gebruik, kan beïnvloed worden door wijzigingen op de site, beperkte automatisering.

- Thunderbit’s pluspunt: AI verwerkt structuurwijzigingen, navigatie door subpagina’s en zelfs scraping van PDF’s/afbeeldingen — veel robuuster dan traditionele extensies.

- Desktop-apps (Octoparse, ParseHub):

- Voordelen: krachtig, visuele workflows, ondersteunt dynamische sites en logins.

- Nadelen: steilere leercurve, geen cloudautomatisering op gratis plannen, afhankelijk van het besturingssysteem.

- Cloudplatformen (Browse AI, Apify, Zyte):

- Voordelen: planning, teamwerk, schaalbaar, integraties.

- Nadelen: gratis plannen vaak beperkt door credits, wat opzet vereist, soms API-kennis nodig.

- Open-source bibliotheken (Scrapy, Puppeteer, Selenium):

- Voordelen: onbeperkt, aanpasbaar, ideaal voor developers.

- Nadelen: coderen vereist, niet voor zakelijke gebruikers.

Webscrapingtrends in 2026: wat moderne tools onderscheidt

Webscraping in 2026 draait helemaal om AI, automatisering en integratie. Dit is er nieuw:

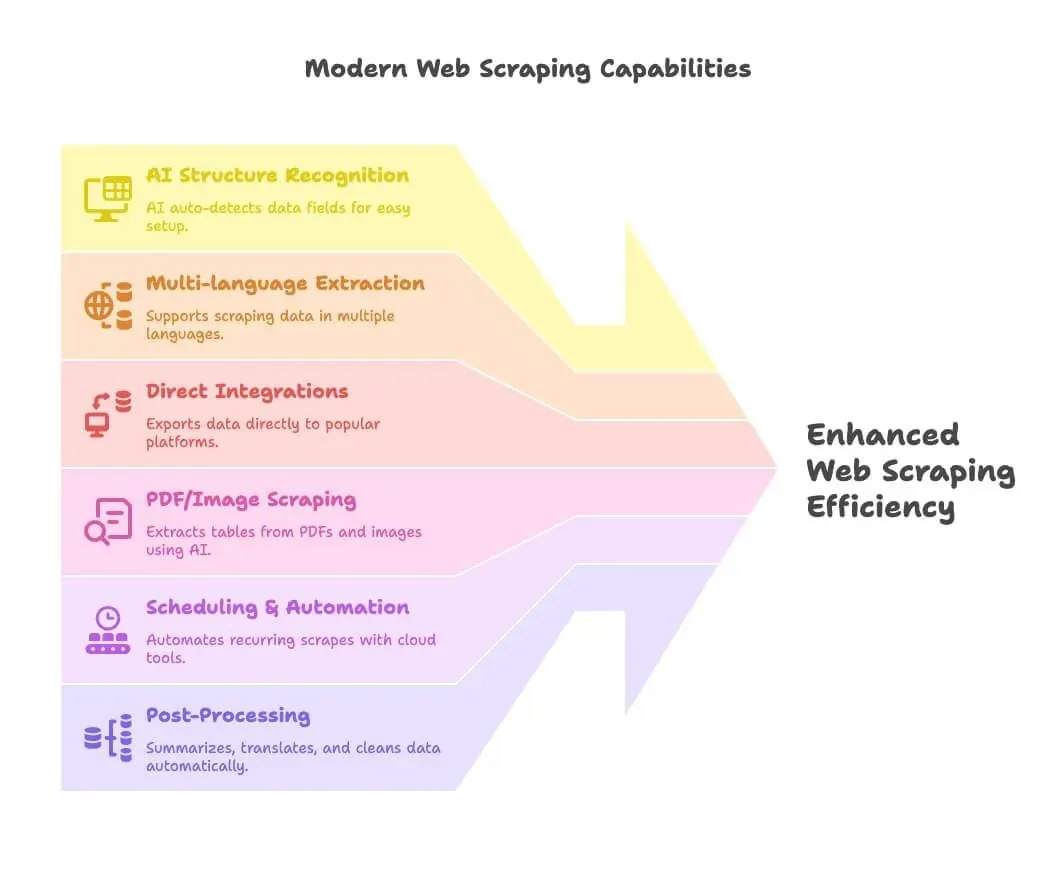

- AI-structuurherkenning: tools zoals Thunderbit gebruiken AI om datavelden automatisch te detecteren, waardoor de setup voor niet-codeerders een fluitje van een cent wordt.

- Meertalige extractie: Thunderbit en andere tools ondersteunen scraping en verwerking van data in tientallen talen.

- Directe integraties: exporteer gescrapete data rechtstreeks naar Google Sheets, Notion of Airtable — geen gevecht meer met CSV-bestanden.

- PDF-/afbeeldingsextractie: Thunderbit loopt hier voorop en laat je tabellen uit PDF’s en afbeeldingen halen met AI.

- Planning en automatisering: cloudtools (Apify, Browse AI) laten je terugkerende scrapes instellen en vervolgens vergeten.

- Nabewerking: vat samen, vertaal, categoriseer en reinig data terwijl je scrape — geen rommelige spreadsheets meer.

Thunderbit, Apify en SerpAPI lopen voorop in deze trends, maar Thunderbit valt op omdat het AI-aangedreven scraping toegankelijk maakt voor iedereen, niet alleen voor developers.

Verder dan scrapen: dataverwerking en meerwaarde

Het gaat niet alleen om data binnenhalen — het gaat erom dat je er iets bruikbaars van maakt. Zo presteren de toptools op nabewerking:

| Tool | Opschonen | Vertaling | Categorisatie | Samenvatting | Opmerkingen |

|---|---|---|---|---|---|

| Thunderbit | Ja | Ja | Ja | Ja | Ingebouwde AI-nabewerking |

| Apify | Gedeeltelijk | Gedeeltelijk | Gedeeltelijk | Gedeeltelijk | Hangt af van de gebruikte actor |

| Browse AI | Nee | Nee | Nee | Nee | Alleen ruwe data |

| Octoparse | Gedeeltelijk | Nee | Gedeeltelijk | Nee | Enige veldverwerking |

| ParseHub | Gedeeltelijk | Nee | Gedeeltelijk | Nee | Enige veldverwerking |

| Webscraper.io | Nee | Nee | Nee | Nee | Alleen ruwe data |

| Scrapy | Ja* | Ja* | Ja* | Ja* | Als het door een developer wordt gecodeerd |

| Puppeteer | Ja* | Ja* | Ja* | Ja* | Als het door een developer wordt gecodeerd |

| Selenium | Ja* | Ja* | Ja* | Ja* | Als het door een developer wordt gecodeerd |

| Zyte | Gedeeltelijk | Nee | Gedeeltelijk | Nee | Enkele automatische extractiefuncties |

| SerpAPI | Nee | Nee | Nee | Nee | Alleen gestructureerde zoekdata |

| Diffbot | Ja | Ja | Ja | Ja | AI-aangedreven, maar alleen via API |

- De developer moet de verwerkingslogica implementeren.

Thunderbit is de enige tool waarmee niet-technische gebruikers van ruwe webdata naar bruikbare, gestructureerde inzichten kunnen gaan — alles in één workflow.

Community, support en leermiddelen: snel op niveau komen

Documentatie en onboarding zijn erg belangrijk. Zo verhouden de tools zich tot elkaar:

| Tool | Documentatie & tutorials | Community | Sjablonen | Leercurve |

|---|---|---|---|---|

| Thunderbit | Uitstekend | Groeit | Ja | Zeer laag |

| Browse AI | Goed | Goed | Ja | Laag |

| Octoparse | Uitstekend | Groot | Ja | Gemiddeld |

| ParseHub | Uitstekend | Groot | Ja | Gemiddeld |

| Webscraper.io | Goed | Forum | Ja | Gemiddeld |

| Apify | Uitstekend | Groot | Ja | Gemiddeld-hoog |

| Scrapy | Uitstekend | Enorm | n.v.t. | Hoog |

| Puppeteer | Goed | Groot | n.v.t. | Hoog |

| Selenium | Goed | Enorm | n.v.t. | Hoog |

| Zyte | Goed | Groot | Ja | Gemiddeld-hoog |

| SerpAPI | Goed | Gemiddeld | n.v.t. | Hoog |

| Diffbot | Goed | Gemiddeld | n.v.t. | Hoog |

Thunderbit en Browse AI zijn het makkelijkst voor beginners. Octoparse en ParseHub hebben geweldige bronnen, maar vragen meer geduld. Apify en developer-tools hebben steile leercurves, maar zijn goed gedocumenteerd.

Conclusie: de juiste gratis data-extractietool kiezen voor 2026

Kort samengevat: niet alle ‘gratis’ data-extractietools zijn even bruikbaar, en je keuze moet afhangen van je rol, je technische comfort en je daadwerkelijke scrapingbehoefte.

- Ben je een zakelijke gebruiker of niet-codeerder die snel data wil verzamelen — vooral van lastige sites, PDF’s of afbeeldingen — dan is Thunderbit de beste plek om te beginnen. De AI-aanpak, prompts in natuurlijke taal en nabewerkingsfuncties maken het het dichtst in de buurt van een echte AI-datassistent. Probeer de gratis en ontdek hoe snel je van “ik heb deze data nodig” naar “hier is mijn spreadsheet” gaat.

- Ben je developer of heb je onbeperkte, aanpasbare scraping nodig, dan zijn open-source tools zoals Scrapy, Puppeteer en Selenium je beste keuze.

- Voor teams en semi-technische gebruikers bieden Apify en Zyte schaalbare, samenwerkingsgerichte oplossingen met royale gratis tiers voor kleine taken.

Welke workflow je ook hebt, begin met de tool die past bij je vaardigheden en behoeften. En onthoud: in 2026 hoef je geen codeerder te zijn om de kracht van webdata te benutten — je hebt alleen de juiste assistent nodig (en misschien een gevoel voor humor wanneer de robots je inhalen).

Wil je dieper graven? Bekijk meer gidsen en vergelijkingen op de , waaronder: