Laat me je een geheim vertellen: ik dacht vroeger dat webscraping alleen was weggelegd voor hackers met hoodies of datawetenschappers met meer monitoren dan gezond is. Maar tegenwoordig is data van een website halen in het bedrijfsleven net zo normaal als je ochtendkoffie pakken — met dit verschil dat je er gelukkig geen Python voor hoeft te kennen of drie espresso’s hoeft te drinken vóór de middag. Dankzij AI-webscraper-tools kan zelfs iemand die denkt dat “HTML” een nieuwe sandwich bij Subway is, gestructureerde data uit het wilde web halen.

Als je ooit rijen productinformatie, sales leads of prijslijsten hebt zitten kopiëren en plakken in een spreadsheet, ben je niet de enige. Bijna gebruikt webscraping inmiddels voor marktinzicht en het volgen van concurrenten. En met een verwachte groei van de webscraping-softwaremarkt tot is één ding duidelijk: data-extractie van het web is allang niet meer alleen iets voor de tech-elite. Dus of je nu in sales werkt, marketeer bent of gewoon wilt stoppen met handmatig data invoeren: deze gids is voor jou. Ik neem je mee langs de basis, vergelijk traditionele en AI-gestuurde aanpakken en laat zien hoe je kunt beginnen — met of zonder hoodie.

Basis van webscraping: wat betekent data van een website scrapen?

Laten we bij het begin beginnen. Een webscraper is gewoon een tool (of script, of Chrome-extensie) die automatisch data van websites verzamelt. Zie het als een supersnelle stagiair die nooit klaagt over repetitief werk. In plaats van zelf informatie rij voor rij te kopiëren en plakken, doet een webscraper dat in enkele seconden — en hij vraagt niet eens om koffiepauze.

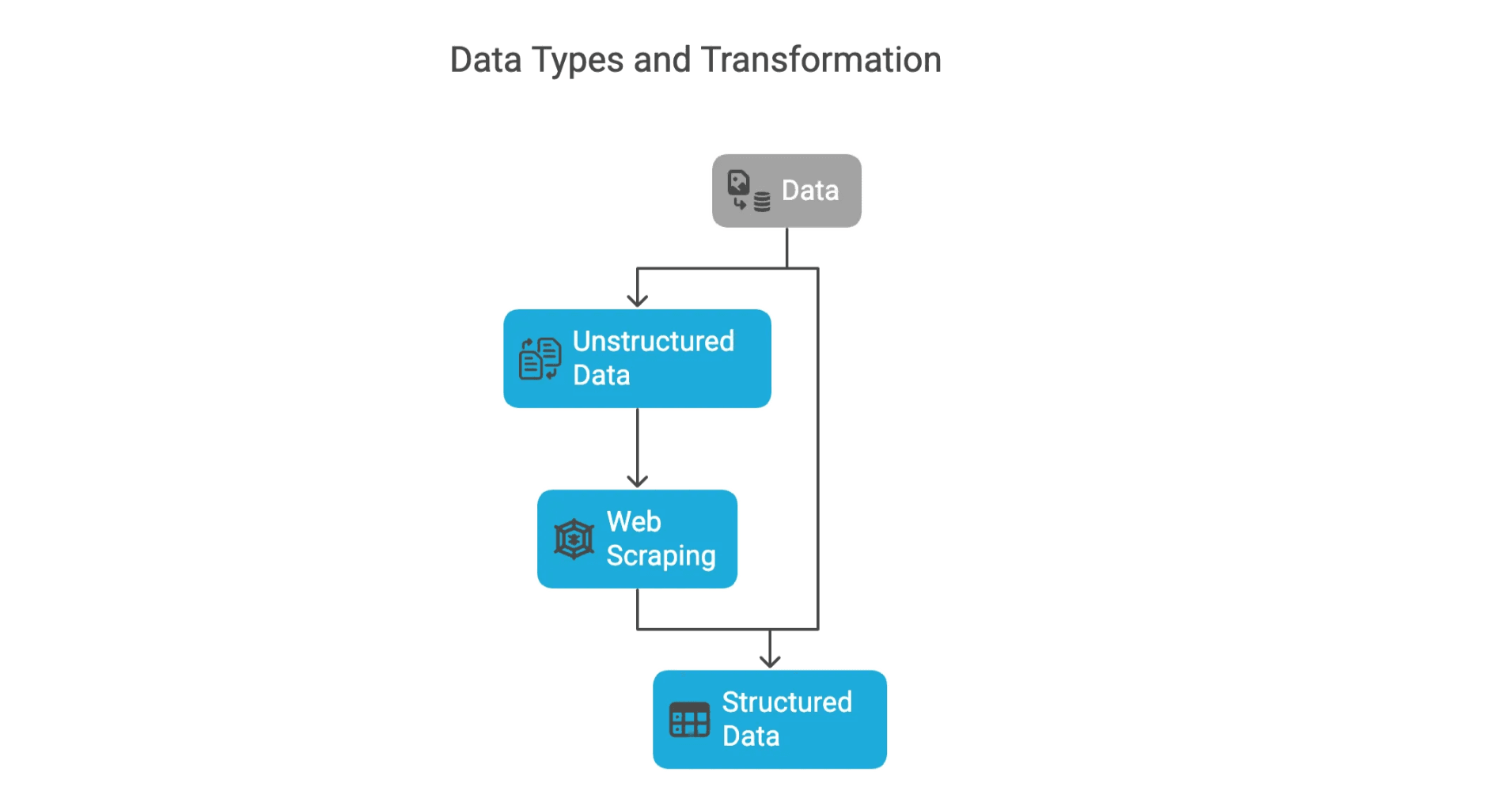

Er zijn twee hoofdsoorten data die je tegenkomt:

- Gestructureerde data: Dit is de nette, spreadsheet-klare data — denk aan tabellen met productnamen, prijzen of e-mails. Alles is georganiseerd, gelabeld en makkelijk te analyseren.

- Ongestructureerde data: Dit is het wilde westen — blogposts, reviews, afbeeldingen of alles wat niet netjes in rijen en kolommen past. De meeste webscraping-projecten proberen ongestructureerde data om te zetten in gestructureerde data, zodat je er echt iets mee kunt doen.

Als je ooit een tabel van een website naar Excel hebt gekopieerd, gefeliciteerd — dan heb je handmatig gescrapet. Stel je nu voor dat je dat doet voor 10.000 pagina’s. (Doe dat vooral niet echt. Daar zijn webscrapers voor.)

Waarom data van websites scrapen? Belangrijkste zakelijke voordelen

Dus, waarom zou je überhaupt data scrapen? Kort gezegd: bedrijven draaien op data, en het web is de grootste database ter wereld. Of je nu in sales, marketing, ecommerce of vastgoed zit, data-extractie van het web kan je een serieus voordeel geven.

Dit zijn enkele van de meest voorkomende zakelijke toepassingen:

| Toepassing | Beschrijving | Voorbeeld van ROI/voordeel |

|---|---|---|

| Leadgeneratie | Contactgegevens, e-mails of bedrijfslijsten verzamelen uit directories of sociale sites | Sales teams besparen uren en vinden meer gekwalificeerde leads |

| Prijsmonitoring | Prijzen van concurrenten, voorraadniveaus of promoties in realtime volgen | Retailers passen prijzen dynamisch aan en verhogen de omzet met 4% |

| Marktonderzoek | Reviews, nieuws of social sentiment bundelen om trends te ontdekken | Marketeers stemmen campagnes af op realtime consumenteninzichten |

| Concurrentieanalyse | Productcatalogi, lanceringen of content van rivalen volgen | Bedrijven reageren sneller op marktveranderingen |

| Vastgoedinformatie | Vastgoedaanbiedingen, prijzen en beschikbaarheid scrapen | Makelaars en investeerders zien kansen vóór de markt dat doet |

In feite gebruikt in het VK en Europa dynamische prijsstrategieën op basis van prijsdata uit webscraping van concurrenten. En bedrijven zoals John Lewis en ASOS hebben meetbare omzetstijgingen gezien door webdata in te zetten voor slimmere beslissingen.

Traditionele webscraper-tools: hoe werken ze?

Laten we teruggaan naar de “klassieke” manier van data scrapen — voordat AI zijn spierballen begon te tonen. Traditionele webscrapers zijn meestal scripts (vaak geschreven in Python) of browserextensies die een set regels volgen om de data te pakken die je wilt.

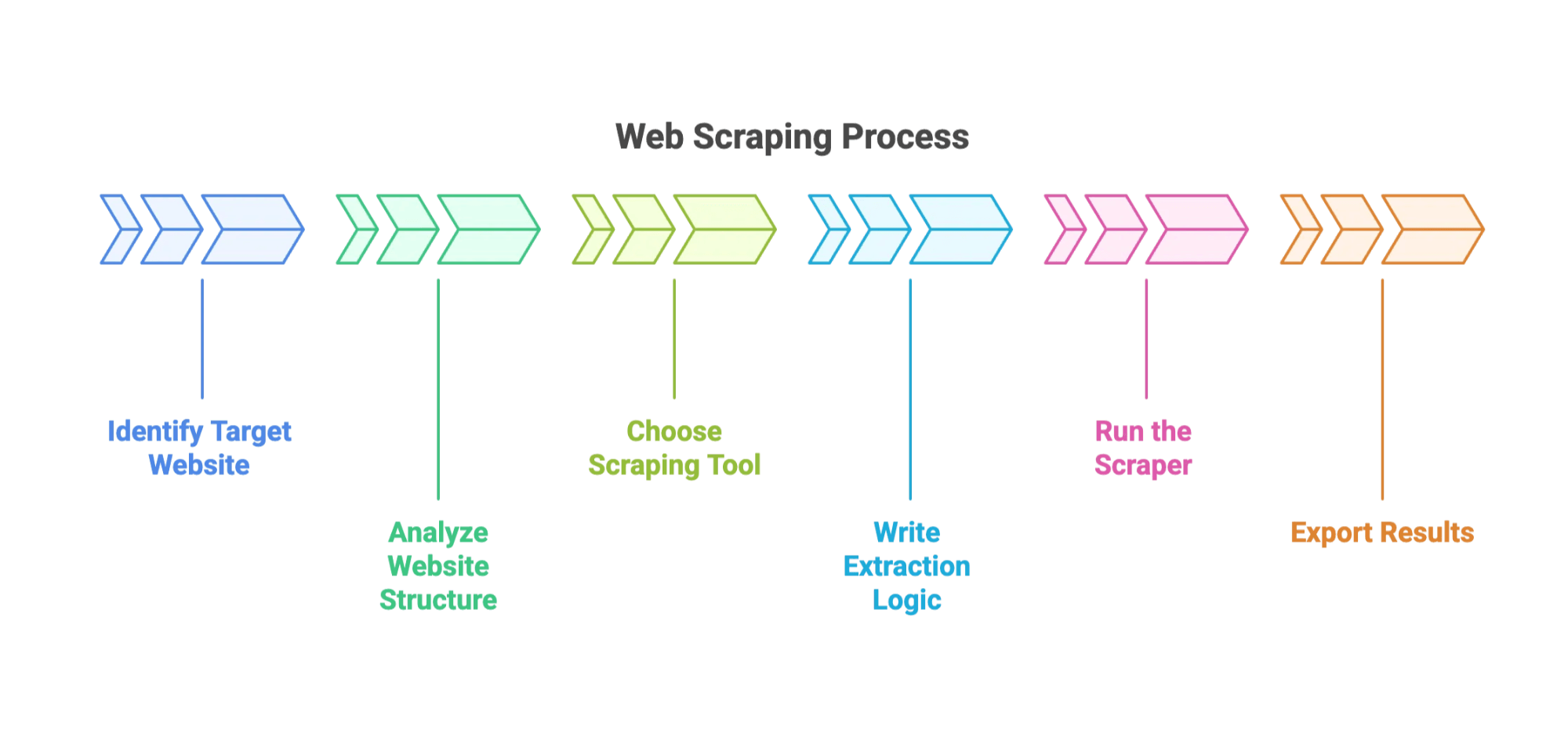

Zo verloopt dat proces meestal:

- Bepaal je doelwebsite en datavelden.

- Analyseer de structuur van de website. (Dat betekent rondneuzen in de HTML met de Developer Tools van je browser. Een soort digitale archeologie.)

- Kies je tool: Populaire opties zijn , of browserplugins.

- Schrijf de extractielogica: Vertel je tool hoe hij de data moet vinden — meestal via CSS-selectors of XPath.

- Laat de scraper draaien: Kijk hoe hij data van meerdere pagina’s verzamelt.

- Exporteer de resultaten: Meestal als CSV, JSON of direct naar Excel.

Stap voor stap: data extraheren met een traditionele webscraper

Stel dat je productvermeldingen van een ecommerce-site wilt scrapen. Hier is een toegankelijke uitleg voor beginners:

- Stap 1: Installeer Python en de BeautifulSoup-bibliotheek.

- Stap 2: Gebruik je browser om de productpagina te inspecteren. Zoek de HTML-tags die de productnaam en prijs bevatten.

- Stap 3: Schrijf een kort script om de pagina op te halen, de HTML te parseren en de relevante velden te extraheren.

- Stap 4: Loop door meerdere pagina’s heen (met paginering).

- Stap 5: Exporteer de data naar een CSV-bestand.

Het klinkt eenvoudig, maar geloof me — je eerste script breekt waarschijnlijk minstens één keer. (Mijn eerste poging scrape-de 500 rijen met “None”, omdat ik een classnaam verkeerd had gespeld. Oeps.)

Veelvoorkomende uitdagingen bij traditionele webscraper-oplossingen

Hier wordt het lastig:

- Wijzigingen op de website: Zelfs een kleine aanpassing in de opmaak kan je scraper breken. breekt elke week door veranderingen.

- Anti-botmaatregelen: CAPTCHA’s, IP-bans en snelheidslimieten kunnen je meteen tegenhouden. Je moet proxies, vertragingen en soms zelfs CAPTCHA’s oplossen.

- Technische kennis vereist: Je moet iets weten van coderen en HTML/CSS.

- Onderhoud: Scrapers hebben voortdurend aandacht en updates nodig.

- Rommelige data: Je bent veel tijd kwijt aan het opschonen van inconsistente formaten, ontbrekende waarden of vreemde coderingen.

Voor een beginner kan dit voelen alsof je een taart probeert te bakken terwijl het recept steeds verandert en de oven je af en toe buitensluit.

Maak kennis met de AI-webscraper: data-extractie toegankelijk gemaakt

En nu het leuke gedeelte. AI-webscrapers veranderen het spel (oeps, bijna die verboden uitdrukking gebruikt). In plaats van code te schrijven of met selectors te rommelen, kun je de tool gewoon in alledaags Nederlands vertellen wat je wilt. De AI regelt de rest.

Thunderbit (dat zijn wij!) is een mooi voorbeeld van deze nieuwe generatie. Met kun je gestructureerde data van elke website halen met natuurlijke taal — zonder code. Of je nu in sales, marketing of ecommerce werkt, je verzamelt de data die je nodig hebt in minuten in plaats van dagen.

Thunderbit AI Web Scraper: hoe het data-extractie eenvoudiger maakt

Laat me je laten zien hoe Thunderbit het leven makkelijker maakt:

- AI Suggest Fields: Klik gewoon op “AI Suggest Fields” en Thunderbit leest de website, stelt kolomnamen voor en geeft zelfs suggesties voor het extraheren van elk veld.

- Subpage Scraping: Meer details nodig? Thunderbit kan elke subpagina bezoeken (zoals afzonderlijke productpagina’s) en je datatabel automatisch verrijken.

- Directe sjablonen: Voor populaire sites zoals Amazon of Zillow kun je vooraf gebouwde sjablonen gebruiken — geen installatie nodig.

- Gratis data-export: Exporteer je data naar Excel, Google Sheets, Airtable of Notion. Download als CSV of JSON. Geen verborgen kosten.

- Geplande scraping: Stel terugkerende scraping-runs in om je data actueel te houden — ideaal voor prijsmonitoring of lead-updates.

- AI Autofill: Laat AI online formulieren voor je invullen (ja, zelfs dat 10-pagina’s tellende vendor-onboardingformulier).

- E-mail-, telefoon- en afbeeldingsextractors: Verzamel contactgegevens of afbeeldingen met één klik.

En het mooiste? Je hoeft echt geen code te kennen. De Chrome-extensie van Thunderbit is beschikbaar, en je leest meer op onze .

Traditionele versus AI-webscraper-oplossingen vergelijken

Laten we zien hoe de twee aanpakken zich tot elkaar verhouden:

| Aspect | Traditionele webscraper | AI-webscraper (Thunderbit) |

|---|---|---|

| Gebruiksgemak | Code of complexe installatie vereist | No-code, natuurlijke-taalinterface |

| Aanpasbaarheid | Breekt snel bij wijzigingen op de site | AI past zich automatisch aan lay-outwijzigingen aan |

| Onderhoud | Hoog — frequente updates nodig | Laag — AI verwerkt de meeste wijzigingen |

| Technische kennis | Vereist programmeer- en HTML-kennis | Ontworpen voor zakelijke gebruikers |

| Instelsnelheid | Uren tot dagen | Minuten |

| Dataverwerking | Handmatig opschonen nodig | AI maakt data automatisch schoon en gestructureerd |

| Kosten | Gratis (open source), maar veel tijdsinvestering | Betaalbare abonnementen, gratis exportopties |

Voor de meeste zakelijke gebruikers, zeker beginners, zijn AI-webscrapers zoals Thunderbit de duidelijke winnaar op het gebied van snelheid, eenvoud en betrouwbaarheid. Traditionele tools blijven nuttig voor sterk maatwerk of grootschalige projecten — maar voor 95% van de use cases is AI de beste keuze.

Stapsgewijze gids: hoe je als beginner data van een website scrapt

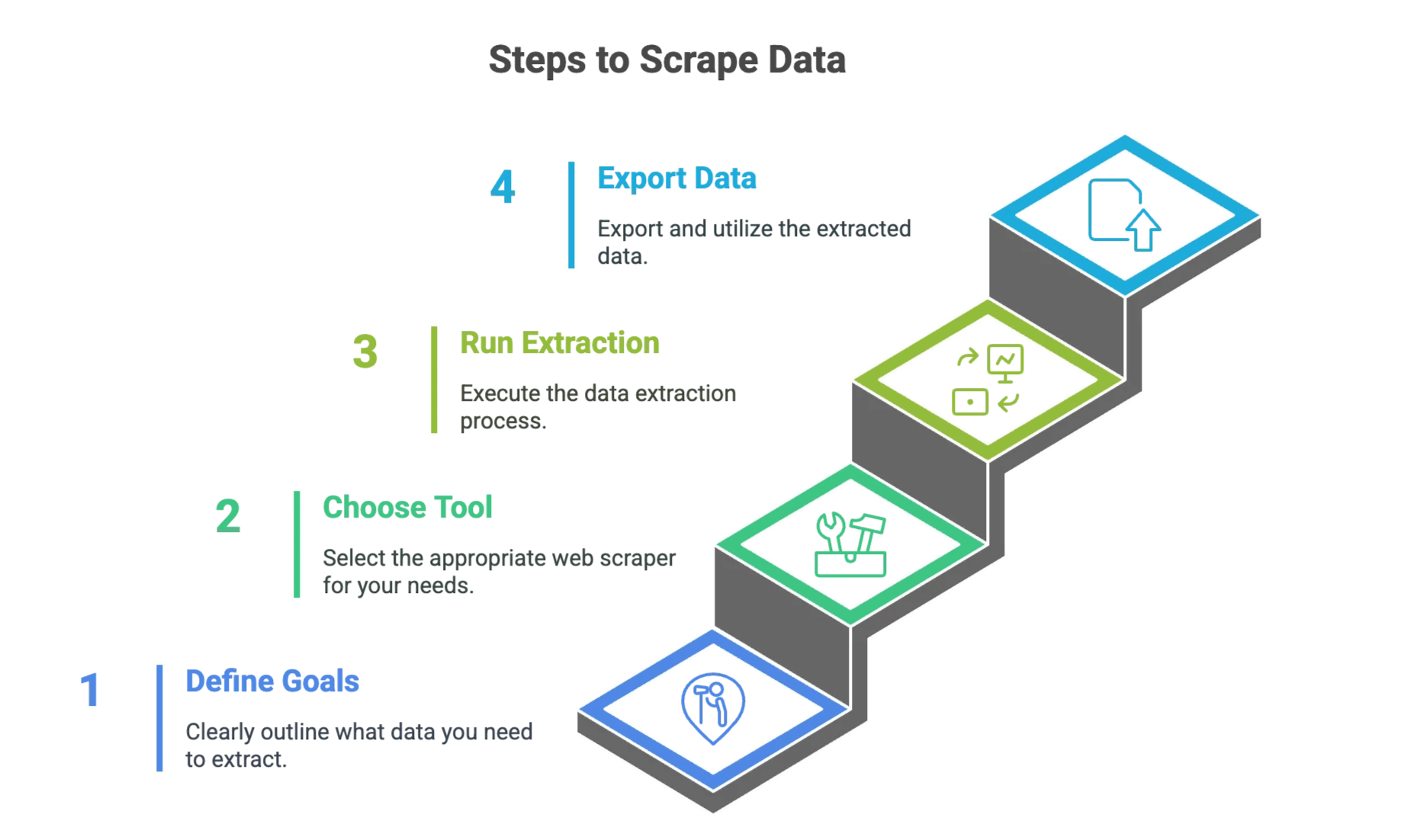

Stap 1: Bepaal je doelen voor data-extractie

Voordat je begint, moet je scherp hebben wat je nodig hebt. Stel jezelf deze vragen:

- Welke website(s) wil ik scrapen?

- Welke datavelden zijn belangrijk? (bijv. productnaam, prijs, e-mail, telefoon)

- Hoe vaak heb ik deze data nodig? (eenmalig of terugkerend?)

Maak een checklist. Bijvoorbeeld: “Ik wil productnamen, prijzen en beoordelingen verzamelen van de eerste 5 pagina’s van .”

Stap 2: Kies de juiste webscraper-tool

Hier is een snelle beslisroute:

- Voel je je prettig bij code en wil je volledige controle? Probeer een traditionele tool zoals BeautifulSoup of Scrapy.

- Wil je snelheid, gebruiksgemak en geen code? Kies dan voor een AI-webscraper zoals .

Als je twijfelt, begin dan met AI. Je kunt later altijd dieper gaan.

Stap 3: Stel je data-extractie in en voer die uit

Traditionele aanpak

- Installeer je tool: Zet Python en de benodigde bibliotheken op.

- Inspecteer de website: Gebruik browser-DevTools om de HTML-structuur te vinden.

- Schrijf je script: Bepaal hoe je elk dataveld vindt en extraheert.

- Test op één pagina: Controleer of je de juiste data krijgt.

- Schaal op: Voeg paginering of loops toe om meer pagina’s te bestrijken.

- Exporteer je data: Sla op als CSV of JSON.

AI-aanpak (Thunderbit)

- Installeer de Thunderbit Chrome-extensie: .

- Open de doelwebsite: Ga naar de pagina die je wilt scrapen.

- Klik op “AI Suggest Fields”: Thunderbit leest de pagina en stelt kolommen voor.

- Bekijk de preview: Controleer of de data er goed uitziet. Pas kolommen aan indien nodig.

- Klik op “Scrape”: Thunderbit verzamelt de data voor je.

- Exporteer je data: Download naar Excel, Google Sheets, Airtable of Notion.

Voor een visuele uitleg kun je ons bekijken.

Stap 4: Exporteer en gebruik je data

Zodra je je data hebt:

- Exporteer naar je favoriete tool: Excel, Google Sheets, Airtable, Notion, CSV of JSON.

- Integreer in je workflow: Gebruik de data voor sales outreach, prijsanalyse, marktonderzoek of wat je bedrijf ook nodig heeft.

- Opschonen en valideren: Ook met AI is het slim om je data steekproefsgewijs te controleren op nauwkeurigheid.

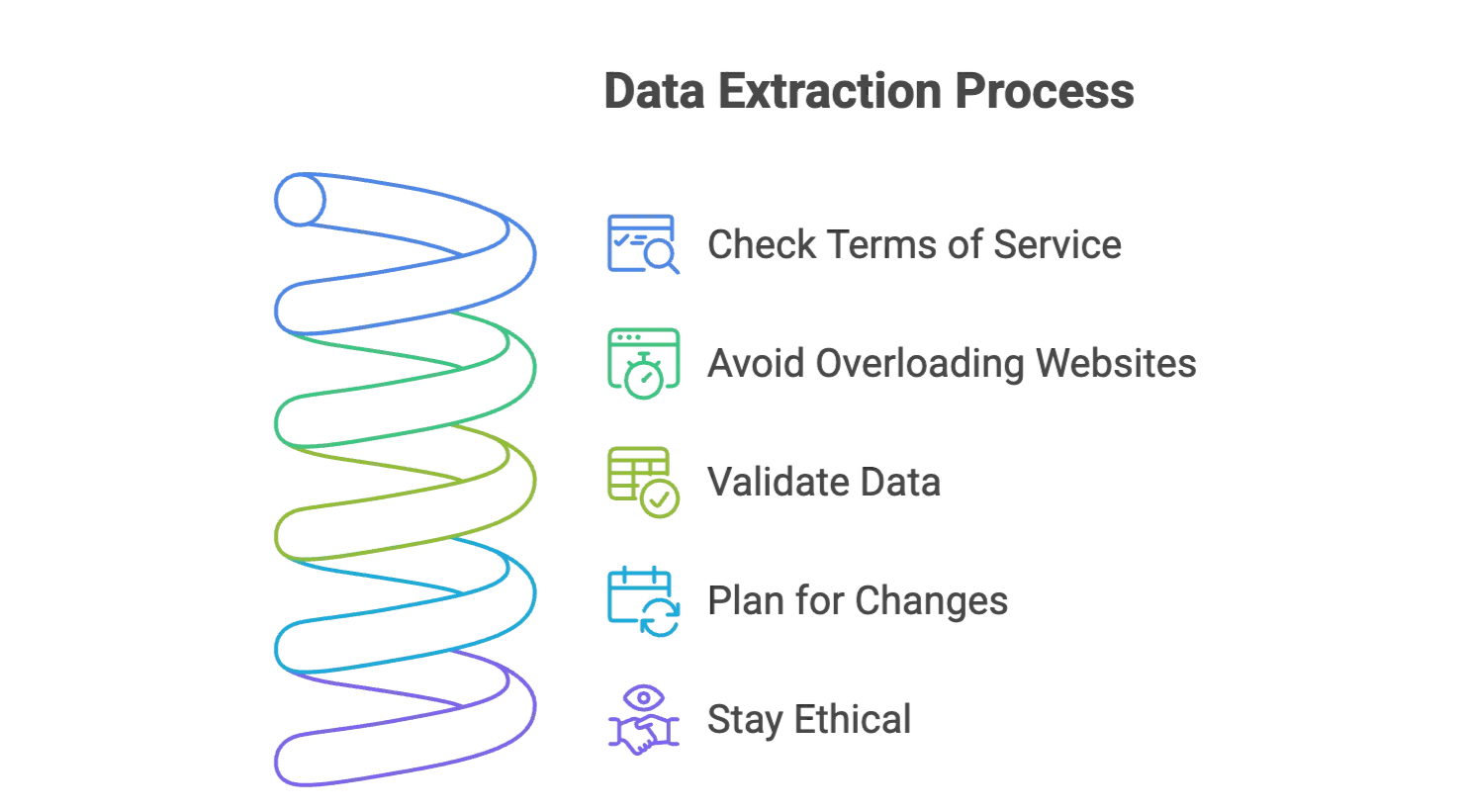

Tips voor succesvolle data-extractie: veelvoorkomende valkuilen vermijden

- Controleer de gebruiksvoorwaarden van de website: Zorg dat je de data mag scrapen. Houd je aan openbare informatie en vermijd gevoelige persoonlijke gegevens.

- Overbelast websites niet: Voeg vertragingen toe tussen verzoeken (bij traditionele tools) of laat Thunderbit het voor je regelen.

- Valideer je data: Controleer altijd een steekproef van je resultaten op nauwkeurigheid.

- Houd rekening met veranderingen: Websites worden voortdurend bijgewerkt. AI-scrapers zoals Thunderbit passen zich automatisch aan, maar het is verstandig om grote wijzigingen te monitoren.

- Blijf ethisch: Scrape alleen wat je nodig hebt en geef bronvermelding als je de data gebruikt in rapporten of publicaties.

Voor meer tips, zie onze en .

Conclusie en belangrijkste inzichten

Webscraping heeft een lange weg afgelegd — van de tijd van handgeschreven scripts tot de huidige AI-gestuurde, beginnersvriendelijke tools. De belangrijkste verschillen?

- Traditionele scrapers geven je controle, maar vereisen coderen, onderhoud en geduld.

- AI-webscrapers zoals maken data-extractie toegankelijk voor iedereen, met opdrachten in natuurlijke taal, directe previews en krachtige functies zoals subpage- en geplande scraping.

Als je nieuw bent met webscraping, laat je dan niet intimideren. De tools waren nog nooit zo toegankelijk, en de zakelijke waarde is onmiskenbaar. Of je nu leads wilt genereren, prijzen wilt monitoren of gewoon wilt stoppen met kopiëren en plakken: AI-webscrapers zijn je nieuwe beste vriend.

Dus de volgende keer dat je tegen een berg webdata aankijkt, denk dan hieraan: je hebt geen PhD in computerwetenschappen nodig — zelfs geen hoodie. Alleen een helder doel, de juiste tool en misschien een goede kop koffie.

Klaar om het zelf te proberen? en ontdek hoe eenvoudig data-extractie van het web kan zijn.

Meer weten? Bekijk de voor verdiepingen over Amazon, Google, PDF’s en meer. Veel scrape-plezier!

Veelgestelde vragen

V1: Is webscraping legaal? A: Ja, het scrapen van openbare data is in veel landen over het algemeen legaal. Controleer wel altijd de gebruiksvoorwaarden van een website en vermijd het scrapen van gevoelige of persoonlijke data.

V2: Kan ik websites scrapen waarvoor je moet inloggen? A: Ja, maar dat is complexer en kan in strijd zijn met het beleid van de site. Je hebt sessiebeheer of geauthenticeerde scraping-tools nodig, en het is belangrijk om de juridische gevolgen te bekijken.

V3: Hoe kan ik data scrapen van websites met veel JavaScript? A: Gebruik tools die dynamische rendering ondersteunen, zoals headless browsers of AI-scrapers die menselijke interacties simuleren en JavaScript-gerenderde content parseren.

V4: Wat zijn de beste praktijken om te voorkomen dat je wordt geblokkeerd? A: Gebruik rate limiting, willekeurige vertragingen, rotatie van user agents en scrape niet agressief. AI-gebaseerde scrapers verwerken deze strategieën vaak automatisch.

Meer lezen

-

Overzicht van juridische richtlijnen, branchecijfers en ethische best practices.

-

Trends, marktgroei en de rol van AI in data-extractie van het web (2024–2025).

-

Leer hoe je robots.txt-bestanden interpreteert om ethisch en legaal scrapen te sturen.