Het web van 2025 is een levendige, altijd veranderende plek—een digitale schatkamer, maar ook een ware survivaltocht. Dagelijks spreek ik teams die van chaotische websites bruikbare, gestructureerde data moeten maken voor sales, operations of marktonderzoek. Maar laten we eerlijk zijn: de tijd van simpelweg kopiëren en plakken of simpele scripts is echt voorbij. Moderne sites zitten vol JavaScript, eindeloos scrollen en anti-botmaatregelen waar zelfs Fort Knox van zou opkijken. Toch is de honger naar webdata groter dan ooit— vertrouwt inmiddels op webscraping voor realtime beslissingen, en de wereldwijde markt voor data-extractie zal naar verwachting verdubbelen tegen 2030.

Hoe blijf je bij? Of je nu geen programmeur bent en gewoon een spreadsheet wilt, of juist een developer die een datastroom bouwt: de juiste webscraping-techniek kiezen maakt het verschil tussen uren frustratie of in een paar klikken resultaat. Met jaren ervaring in SaaS en automatisering heb ik gezien hoe de juiste tool een uitdaging kan omtoveren tot een voorsprong op de concurrentie. In deze gids deel ik de 5 beste geavanceerde webscraping-technieken voor 2025—elk met hun eigen pluspunten, eigenaardigheden en ideale toepassingen. Laten we erin duiken.

Hoe blijf je bij? Of je nu geen programmeur bent en gewoon een spreadsheet wilt, of juist een developer die een datastroom bouwt: de juiste webscraping-techniek kiezen maakt het verschil tussen uren frustratie of in een paar klikken resultaat. Met jaren ervaring in SaaS en automatisering heb ik gezien hoe de juiste tool een uitdaging kan omtoveren tot een voorsprong op de concurrentie. In deze gids deel ik de 5 beste geavanceerde webscraping-technieken voor 2025—elk met hun eigen pluspunten, eigenaardigheden en ideale toepassingen. Laten we erin duiken.

Waarom Webscraping-technieken Onmisbaar Zijn voor Moderne Bedrijven

Webscraping is allang geen hobby meer—het is een kernonderdeel van veel bedrijven. Sales-teams automatiseren leadgeneratie door contactgegevens uit directories en social media te halen. E-commerce managers houden realtime de prijzen en voorraad van concurrenten in de gaten en passen hun strategie direct aan. Marktonderzoekers verzamelen reviews en discussies op fora om trends te spotten voordat ze mainstream worden. Zelfs vastgoedanalisten scrapen woningaanbod om marktontwikkelingen per regio te volgen ().

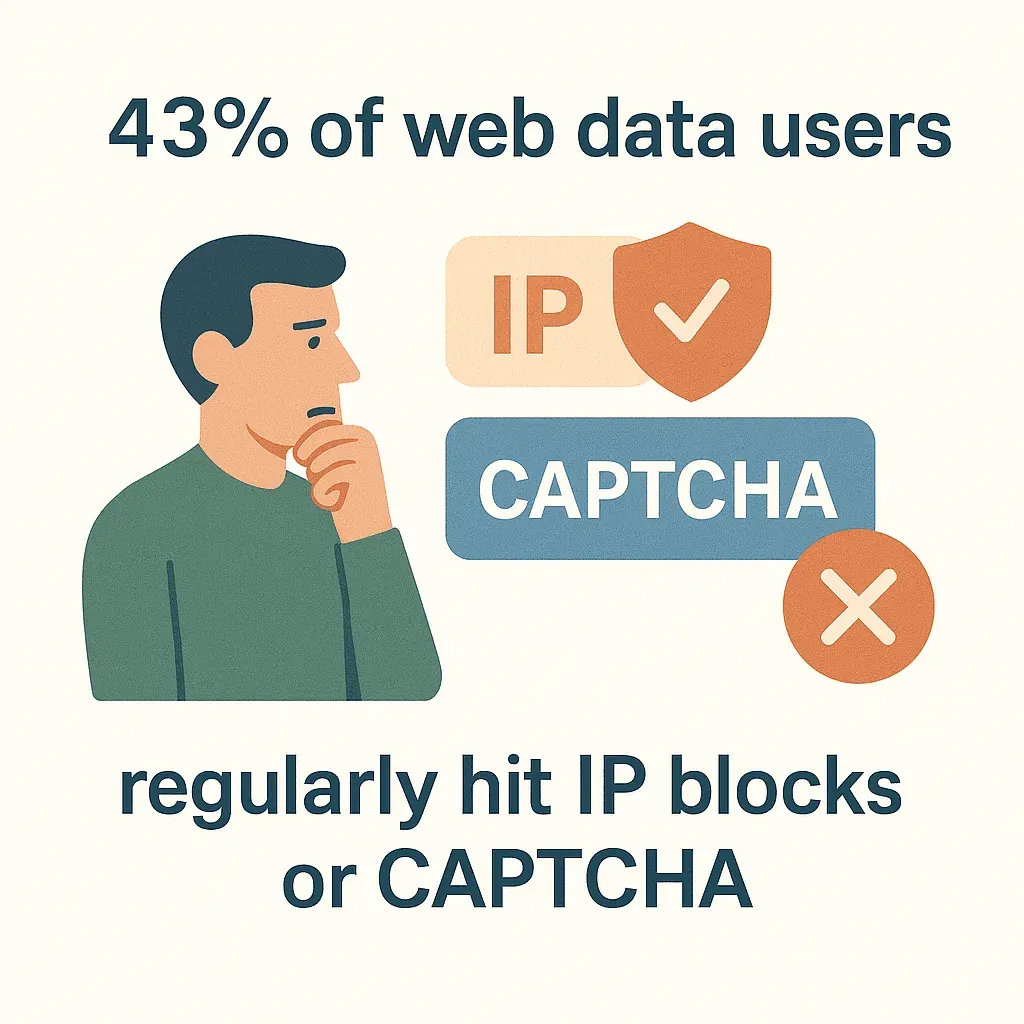

Maar er zit een addertje onder het gras: websites worden steeds ingewikkelder. Dynamische content, anti-botmaatregelen en navigatie over meerdere pagina’s zijn nu standaard. Volgens recente cijfers tijdens het scrapen. En wie ooit een simpel script heeft opgeschaald, weet: wat werkt op één pagina, kan op duizend pagina’s zomaar crashen.

Daarom is het kiezen van de juiste scraping-techniek—die past bij je technische skills, zakelijke doelen en de grillen van je doelwebsites—essentieel. Het goede nieuws? Of je nu een “geef me gewoon de data”-gebruiker bent of een Python-expert, er is een oplossing voor jou.

Daarom is het kiezen van de juiste scraping-techniek—die past bij je technische skills, zakelijke doelen en de grillen van je doelwebsites—essentieel. Het goede nieuws? Of je nu een “geef me gewoon de data”-gebruiker bent of een Python-expert, er is een oplossing voor jou.

Hoe We de Top 5 Webscraping-technieken Hebben Geselecteerd

Met zoveel tools op de markt was het lastig kiezen. Hier heb ik op gelet:

- Aanpasbaarheid: Kan het zowel statische als dynamische sites aan? Werkt het met paginering, subpagina’s en lastige lay-outs?

- Gebruiksgemak: Is het toegankelijk voor niet-programmeurs, of heb je ontwikkelvaardigheden nodig? Tools met natuurlijke taal en visuele workflows kregen extra punten.

- Schaalbaarheid: Kan het grote hoeveelheden data aan, plannen en automatiseren? Is het cloud-ready?

- Data-output & Integratie: Exporteert het schone data naar Excel, Google Sheets, Airtable of databases? Bonuspunten voor API’s en workflow-integraties.

- Bewezen Resultaten: Heeft het impact gehad bij echte bedrijven? Ik keek naar gebruikersreviews, recente ontwikkelingen en community-acceptatie.

Elke techniek hieronder heeft unieke voordelen. Of je nu direct resultaat wilt, diepgaande aanpassingen zoekt of gewoon geen zin hebt in nog een CAPTCHA, je vindt hieronder jouw match.

1. Thunderbit: AI-gedreven Webscraping voor Iedereen

is de tool waarvan ik wou dat ik ‘m jaren geleden had gehad. Het is een Chrome-extensie die AI centraal zet—geen code, geen sjablonen, gewoon beschrijven wat je wilt en de AI regelt het. Je kunt letterlijk typen: “Haal alle productnamen en prijzen van deze pagina”, op “AI Suggest Fields” klikken en Thunderbit doet de rest. Het is alsof je een data-assistent hebt die nooit moe wordt.

Waarom is Thunderbit uniek?

- Natuurlijke taal prompts: Beschrijf je databehoefte gewoon in het Nederlands. De AI leest de pagina, stelt kolommen voor en maakt zelfs extractielogica voor je aan.

- AI Suggest Fields: Met één klik scant Thunderbit de site en raadt de beste velden en gegevenstypen aan—geen gedoe meer met selectors.

- Subpagina-scraping: Meer details nodig? Thunderbit bezoekt automatisch elke subpagina (zoals productdetails of LinkedIn-profielen) en verrijkt je tabel.

- Paginering en oneindig scrollen: Of het nu een “Volgende”-knop is of eindeloos scrollen, Thunderbit blijft doorgaan tot alle data binnen is.

- Cloud- of browser-scraping: Kies Cloud-modus voor snelheid (tot 50 pagina’s tegelijk), of Browser-modus voor sites achter een login of CAPTCHA.

- Direct exporteren: Stuur je data direct naar Excel, Google Sheets, Airtable of Notion—zonder extra stappen of verborgen kosten.

- Gratis data-extractors: Haal direct alle e-mails, telefoonnummers of afbeeldingen van elke pagina, helemaal gratis.

- Betaalbaar en toegankelijk: Gratis tot 6 pagina’s scrapen (of 10 met een proefboost), en betaalde plannen vanaf slechts $15/maand voor 500 credits.

Voor wie? Thunderbit is perfect voor niet-technische zakelijke gebruikers—sales, operations, marketing, vastgoed—die snel data willen zonder technische drempel. Ik heb iedereen van kleine webwinkeliers tot makelaars ermee zien werken om concurrenten te volgen, leads te genereren en saaie webtaken te automatiseren ().

Praktijkvoorbeeld: Gebruikers vervangen urenlang kopiëren en plakken door een paar klikken—van het scrapen van bedrijvengidsen en productlijsten tot het extraheren van tekst uit PDF’s en afbeeldingen met ingebouwde OCR. En omdat het AI-gestuurd is, past het zich automatisch aan lay-outwijzigingen aan—geen kapotte sjablonen meer.

Kortom: Wil je razendsnel van “ik heb deze data nodig” naar “hier is mijn spreadsheet”? Dan is Thunderbit je beste vriend. Probeer de zelf uit.

2. Beautiful Soup: Flexibele HTML-analyse voor Python-gebruikers

is een klassieker. Het is een Python-bibliotheek waarmee je makkelijk HTML en XML kunt doorzoeken en analyseren. Als je een beetje kunt programmeren, geeft Beautiful Soup je volledige controle over het extraheren, opschonen en structureren van data.

Wat maakt Beautiful Soup bijzonder?

- Flexibele parsing: Navigeer door HTML-structuren, zoek op tag, klasse of CSS-selector en haal precies de data die je nodig hebt—zelfs van rommelige pagina’s.

- Eigen logica: Schrijf je eigen scripts om unieke paginavormen te verwerken, data te filteren of tekst direct te bewerken.

- Integratie met Python-stack: Combineer met

requests,pandasofcsvom pagina’s op te halen, data te analyseren en resultaten te exporteren. - Tolerant voor slechte HTML: Veel websites zijn niet perfect opgebouwd—Beautiful Soup haalt er toch het beste uit.

- Open source en gratis: Geen licentiekosten, gewoon pure Python.

Voor wie? Developers, analisten en data scientists die volledige controle willen over het scrapen. Vooral handig voor kleinschalige, maatwerkprojecten of het snel testen van nieuwe datastromen ().

Voorbeeld: Een tabel van Wikipedia halen of snel koppen van een nieuwssite verzamelen? Met een paar regels Beautiful Soup-code is het zo gepiept.

Beperkingen: Het is geen crawler—je moet zelf navigatie en requests regelen. En voor JavaScript-rijke sites heb je extra tools nodig (zoals Selenium of Playwright).

Wanneer gebruiken? Als je al in Python werkt en volledige controle wilt, of lastige statische pagina’s moet parseren, is Beautiful Soup ideaal.

3. Scrapy: Schaalbare Webcrawling voor Complexe Projecten

is het zware geschut van webscraping. Het is een Python-framework voor grootschalig, geautomatiseerd crawlen—denk aan duizenden of miljoenen pagina’s, terugkerende taken en complexe datastromen.

Waarom is Scrapy zo krachtig?

- Asynchroon, razendsnel crawlen: Haal tientallen pagina’s tegelijk op, efficiënt en schaalbaar.

- Volledige crawl-architectuur: Definieer “spiders” die sites doorlopen, links volgen en data op meerdere niveaus verzamelen.

- Ingebouwde middlewares: Wissel proxies, randomiseer user agents, regel retries en integreer headless browsers voor dynamische content.

- Datapijplijnen: Reinig, valideer en exporteer data automatisch naar JSON, CSV of databases.

- Plannen en automatiseren: Draai crawls op schema, integreer met cloudplatforms en houd je data actueel.

- Open source: Geen licentiekosten—alleen je eigen infrastructuur en codeervaardigheden.

Voor wie? Developers en technische teams die grootschalige, terugkerende scraping-projecten bouwen—zoals prijsvergelijkers, vacaturebanken of social media-analyses ().

Praktijkvoorbeeld: Stel je voor dat je elke productpagina van een grote webshop crawlt, paginering en subpagina’s volgt en je database dagelijks bijwerkt. Scrapy kan het aan—maar er is wel een leercurve.

Beperkingen: Niet voor beginners. Je hebt goede Python-kennis nodig, en voor JavaScript-rijke sites is extra setup vereist (zoals Splash of Playwright).

Ideaal voor: Als je schaal, betrouwbaarheid en maatwerk nodig hebt—en de technische kennis in huis hebt.

4. ParseHub: Visueel Scrapen van Dynamische en Interactieve Sites

is een visuele, no-code webscraper die draait om eenvoud. Het is een desktop-app (Windows, Mac, Linux) waarmee je naar je doelwebsite navigeert, op de gewenste data klikt en ParseHub de rest laat doen.

Waarom is ParseHub populair?

- Dynamische content aan: Ingebouwde browser voert JavaScript uit, klikt knoppen, vult formulieren in en scrollt—perfect voor sites met dropdowns, oneindig scrollen of AJAX-content.

- Visuele workflow: Stel stap voor stap acties in—selecteer elementen, klik door subpagina’s, navigeer door paginering en extraheer data.

- Cloudplanning: Laat scrapes draaien op de servers van ParseHub, plan terugkerende taken en houd je eigen computer vrij.

- API-toegang: Integreer gescrapete data in je workflows of start projecten automatisch.

- Royale gratis versie: Tot 5 openbare projecten en 200 pagina’s per run—ideaal voor kleine klussen of testen.

- Betaalde plannen: Standaard vanaf $189/maand voor meer projecten, privé-runs en geavanceerde functies.

Voor wie? Semi-technische gebruikers—analisten, marketeers, journalisten—die dynamische, interactieve sites willen scrapen zonder te coderen ().

Leercurve: Hoewel het no-code is, kost het wat oefening om complexe workflows (zoals conditionele selectors of Regex) onder de knie te krijgen. Maar als je het eenmaal doorhebt, kan ParseHub sites aan die andere tools niet aankunnen.

Ideaal voor: Als je data wilt scrapen achter veel klikken, logins of dynamische elementen—en alles visueel wilt doen.

5. Octoparse: Gebruiksvriendelijke Sjablonen en Cross-platform Ondersteuning

is de “easy button” voor webscraping—vooral als je populaire sites wilt targeten. Het is een no-code platform met een enorme bibliotheek aan kant-en-klare sjablonen (meer dan 100), zodat je vaak met één klik kunt beginnen.

Wat maakt Octoparse sterk?

- Sjabloonbibliotheek: 100+ voorgebouwde sjablonen voor sites als Amazon, eBay, LinkedIn, Zillow en meer—selecteer, vul je parameters in en start.

- Auto-Detect-modus: Plak een URL en Octoparse’s AI markeert automatisch tabellen, lijsten en velden.

- Visuele designer: Voor maatwerksites kun je zelf je scraper samenstellen—zonder te coderen.

- Cloudscraping: Draai meerdere taken tegelijk op de servers van Octoparse, plan terugkerende jobs en houd je data actueel.

- Meerdere exportformaten: Excel, CSV, JSON of direct naar databases zoals MySQL of SQL Server.

- Betaalbare plannen: Gratis tot 10 lokale taken, standaard $75/maand, en professioneel $249/maand voor meer kracht en samenwerking.

Voor wie? Zakelijke gebruikers—e-commerce managers, marktonderzoekers, sales-teams—die snel en betrouwbaar data willen van bekende websites, of bulkdata willen automatiseren ().

Praktijkvoorbeeld: Wil je concurrentieprijzen op Amazon volgen? Gebruik het Amazon-sjabloon, voer je zoekopdracht in en je hebt binnen enkele minuten een spreadsheet—zonder setup of code.

Beperkingen: Voor zeer maatwerk of onvoorspelbare sites moet je soms de workflow aanpassen of XPath/Regex gebruiken. En hoewel Octoparse’s cloud snel is, kunnen sites met zware anti-botmaatregelen extra aandacht vereisen.

Ideaal voor: Als snelheid, eenvoud en sjablonen belangrijk zijn—vooral bij e-commerce en leadgeneratie.

Vergelijking van de Top 5 Webscraping-technieken

Hier een overzicht van de verschillen tussen deze tools:

| Tool | Gebruiksgemak | Mogelijkheden & Sterke Punten | Beste Toepassing | Technische Vereisten | Prijs (2025) |

|---|---|---|---|---|---|

| Thunderbit | Zeer eenvoudig (AI, 2 klikken) | AI detecteert velden automatisch, subpagina’s/paginering, direct exporteren | Niet-technische gebruikers, snelle data, sales/ops | Chrome-browser, geen code nodig | Gratis (6 pagina’s), $15/mnd (500 rijen) |

| Beautiful Soup | Gemiddeld (Python-scripting) | Flexibele HTML/XML-analyse, eigen scripts | Ontwikkelaars, analisten, statische sites | Python-kennis | Gratis (open source) |

| Scrapy | Steile leercurve (voor ontwikkelaars) | Razendsnel, schaalbaar crawlen, plugins, automatisering | Technische teams, big data, doorlopende projecten | Python, setup, scraping-kennis | Gratis (open source) |

| ParseHub | Gebruiksvriendelijke GUI | Visuele workflow, dynamische sites, cloudplanning | Semi-technische gebruikers, dynamische/interactieve sites | Desktop-app, logica-inzicht | Gratis (5 projecten), $189/mnd+ |

| Octoparse | No-code, beginnersvriendelijk | Sjablonen, auto-detectie, cloudscraping, multi-export | Zakelijke gebruikers, e-commerce, snelle data | Desktop/web-app, geen code nodig | Gratis (10 taken), $75/mnd+ |

Meer weten? Bekijk de .

Conclusie: De Juiste Webscraping-techniek Kiezen voor 2025

Webscraping in 2025 is krachtiger én toegankelijker dan ooit. Mijn advies in het kort:

- Wil je supersnel en zonder code data verzamelen? Kies voor . De AI-aanpak is ideaal voor zakelijke gebruikers die direct resultaat willen.

- Wil je volledige controle en kun je wat Python schrijven? is flexibel en lichtgewicht.

- Bouw je een grootschalige, doorlopende datastroom? is industrieel sterk—mits je de technische kennis hebt.

- Wil je visueel scrapen op lastige, dynamische sites? biedt een GUI met veel aanpassingsmogelijkheden.

- Wil je direct resultaat op bekende sites, met sjablonen en cloud-snelheid? is ideaal voor e-commerce en onderzoek.

Mijn tip? Probeer een paar van deze tools uit voor je volgende project. De meeste hebben een gratis versie, zodat je kunt ontdekken wat het beste bij jouw workflow en technische niveau past. De juiste techniek bespaart je uren (of dagen), levert nieuwe inzichten op en geeft je bedrijf een voorsprong.

Veel succes met scrapen—en moge je data altijd schoon, gestructureerd en klaar voor gebruik zijn. Meer tips, tutorials of verdiepingen? Bekijk de .

Veelgestelde Vragen

1. Wat is het verschil tussen statisch en dynamisch webscrapen?

Statisch scrapen betekent dat je data direct uit de HTML haalt. Dynamisch scrapen is nodig voor sites waar content via JavaScript wordt geladen—daarvoor heb je tools nodig die scripts kunnen uitvoeren of met de pagina kunnen interacteren (zoals Thunderbit, ParseHub of Octoparse).

2. Kunnen niet-technische gebruikers echt data van elke website scrapen?

Zeker! Tools als en zijn speciaal gemaakt voor niet-programmeurs. Dankzij AI-veldherkenning en sjablonen kun je met een paar klikken gestructureerde data extraheren.

3. Welke tool is het beste voor grootschalige, terugkerende scraping-projecten?

is ideaal voor developers die grote, doorlopende scrapes beheren. Het is gebouwd voor snelheid, automatisering en betrouwbaarheid—maar vereist wel Python-kennis.

4. Hoe gaan deze tools om met anti-botmaatregelen zoals CAPTCHA’s?

De meeste tools bieden oplossingen: Thunderbit’s Browser-modus laat je scrapen terwijl je bent ingelogd, Scrapy ondersteunt proxy-rotatie en plugins, en ParseHub/Octoparse kunnen gebruikersacties nabootsen. Bij zware beveiliging kan handmatige tussenkomst of een gespecialiseerde proxy nodig zijn.

5. Wat is de meest kostenefficiënte optie voor kleine bedrijven?

Voor snelle, eenmalige klussen zijn de gratis versies van Thunderbit, ParseHub of Octoparse vaak voldoende. Voor doorlopende behoeften is Thunderbit’s $15/maand-plan erg betaalbaar, terwijl Beautiful Soup en Scrapy gratis zijn als je kunt programmeren.

Benieuwd wat moderne webscraping voor jouw bedrijf kan betekenen? en maak van het web je volgende concurrentievoordeel.

Meer weten