הייתי צריך לעקוב אחרי יותר מ־200 מקורות חדשות כדי לזהות מאמרים טרנדיים. ידנית? זה לגמרי 풀타임 ג׳וב. מגרד “קלאסי”? הוא נשבר כל פעם שאתר עושה 리디자인 או משנה מבנה.

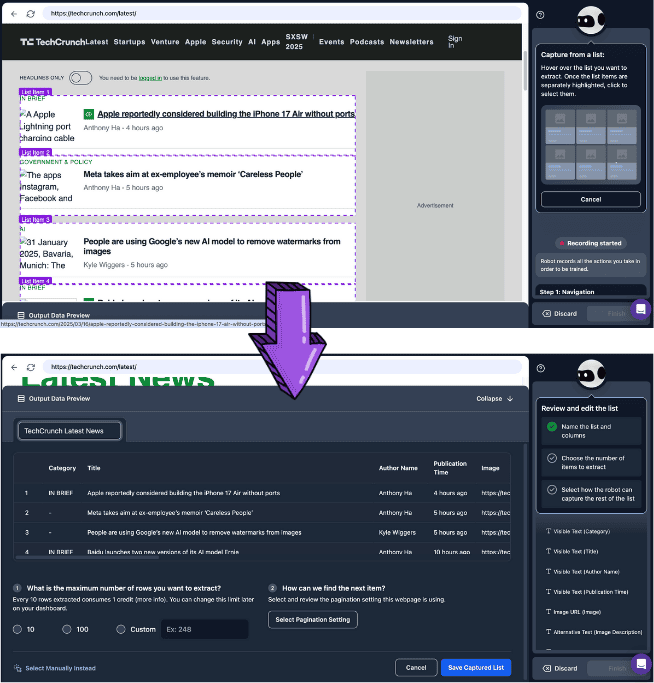

ואז ניסיתי מגרדי מאמרים מבוססי AI. קליק אחד, נתונים נקיים, בלי להתעסק עם סלקטורים של CSS. ההבדל היה וואו.

אם אתם עיתונאים, מומחי SEO או חוקרים שצריכים למשוך מאמרים בהיקף גדול, ההשוואה הזו תחסוך לכם המון ניסוי וטעייה. בדקתי גם מגרדים מסורתיים ללא קוד וגם כלים שמונעים ב־AI — הנה מה שבאמת עובד.

TL;DR

| יתרונות | חסרונות | הכי מתאים ל… | |

|---|---|---|---|

| AI Article Scraper | - יכול לגרד כמה אתרים בדיוק גבוה - מסיר “רעש” אוטומטית - מסתגל לשינויים במבנה האתר - תומך בטעינה דינמית של תוכן - עלות נמוכה יותר לניקוי נתונים | - עלות חישובית גבוהה יותר - זמן עיבוד ארוך יותר - חלק מהעמודים עשויים לדרוש התערבות ידנית - עלול להפעיל מנגנוני אנטי-גרידה | - גרידה של אתרים מורכבים או דינמיים (למשל פורטלי חדשות, רשתות חברתיות) - איסוף נתונים בהיקף גדול |

| Traditional No-code Article Scraper | - ריצה מהירה - עלות נמוכה יותר - צריכת משאבי שרת/מחשב נמוכה - שליטה גבוהה בתהליך | - תחזוקה תכופה בגלל שינויי מבנה באתר - לא יכול לגרד כמה אתרים במקביל - מתקשה עם תוכן דינמי - עלות גבוהה לניקוי נתונים | - גרידה מהירה ובהיקף גדול של דפי אינטרנט סטטיים ופשוטים - משאבי מחשוב מוגבלים/תקציב מצומצם |

מהו מגרד מאמרים? ולמה מגרד מאמרים מבוסס AI חשוב?

מגרד מאמרים (https://oxylabs.io/blog/news-scraping) הוא סוג של Web Scraper (https://thunderbit.com/blog/best-web-scraping-tools) שמאתר ושולף מידע מאתרי חדשות — כמו כותרות, מחברים, תאריכי פרסום, תוכן, מילות מפתח, תמונות וסרטונים — ומסדר אותו לפורמטים מובנים כמו JSON, CSV או Excel.

מגרדי מאמרים מסורתיים ללא קוד (https://iproyal.com/blog/no-code-web-scraper/) נשענים על סלקטורים של CSS (https://developer.mozilla.org/en-US/docs/Learn_web_development/Core/Styling_basics/Basic_selectors) כדי לחלץ תוכן לפי מבנה ה־HTML (https://www.w3schools.com/html/html_intro.asp) של הדף. אבל לגישה הזו יש כמה מגבלות:

- לא אוניברסלי: לכל אתר יש מבנה שונה ולכן צריך סלקטורים ייעודיים לכל אתר; שינוי במבנה הדף עלול לשבור את ההגדרה ולחייב עדכונים תכופים.

- קושי עם תוכן דינמי: אתרים רבים טוענים תוכן באמצעות AJAX או JavaScript — וסלקטורים של CSS לא תמיד יכולים “לתפוס” את זה ישירות.

- עיבוד נתונים מוגבל: סלקטורים של CSS שולפים מקטעי HTML, אבל לא מבצעים ניקוי, עיצוב, ניתוח סמנטי או ניתוח סנטימנט בלי שלבים נוספים.

הכירו את מגרד המאמרים מבוסס ה־AI (https://thunderbit.com/blog/scrape-any-website-using-ai).

הכירו את מגרד המאמרים מבוסס ה־AI (https://thunderbit.com/blog/scrape-any-website-using-ai).

-

הטכנולוגיה הזו משתמשת ב־LLM כדי להבין דפי אינטרנט, ומספקת:

- זיהוי חכם: איתור כותרות, מחברים, תקצירים והתוכן המרכזי.

- הסרת רעש אוטומטית: הפרדה בין התוכן העיקרי לבין ניווט, פרסומות ומאמרים קשורים — לשיפור איכות הנתונים ויעילות הגרידה.

- הסתגלות לשינויים באתר: גם אם המבנה או העיצוב משתנים, ה־AI יכול להמשיך לגרד בזכות הבנה סמנטית ומאפיינים חזותיים.

- הכללה בין אתרים: בניגוד למגרדים מסורתיים (https://iproyal.com/blog/no-code-web-scraper/), מגרדי AI יכולים לעבוד על אתרים שונים בלי התאמות ידניות.

- שילוב עם NLP ולמידה עמוקה: מאפשר לבצע גם תרגום, סיכום וניתוח סנטימנט.

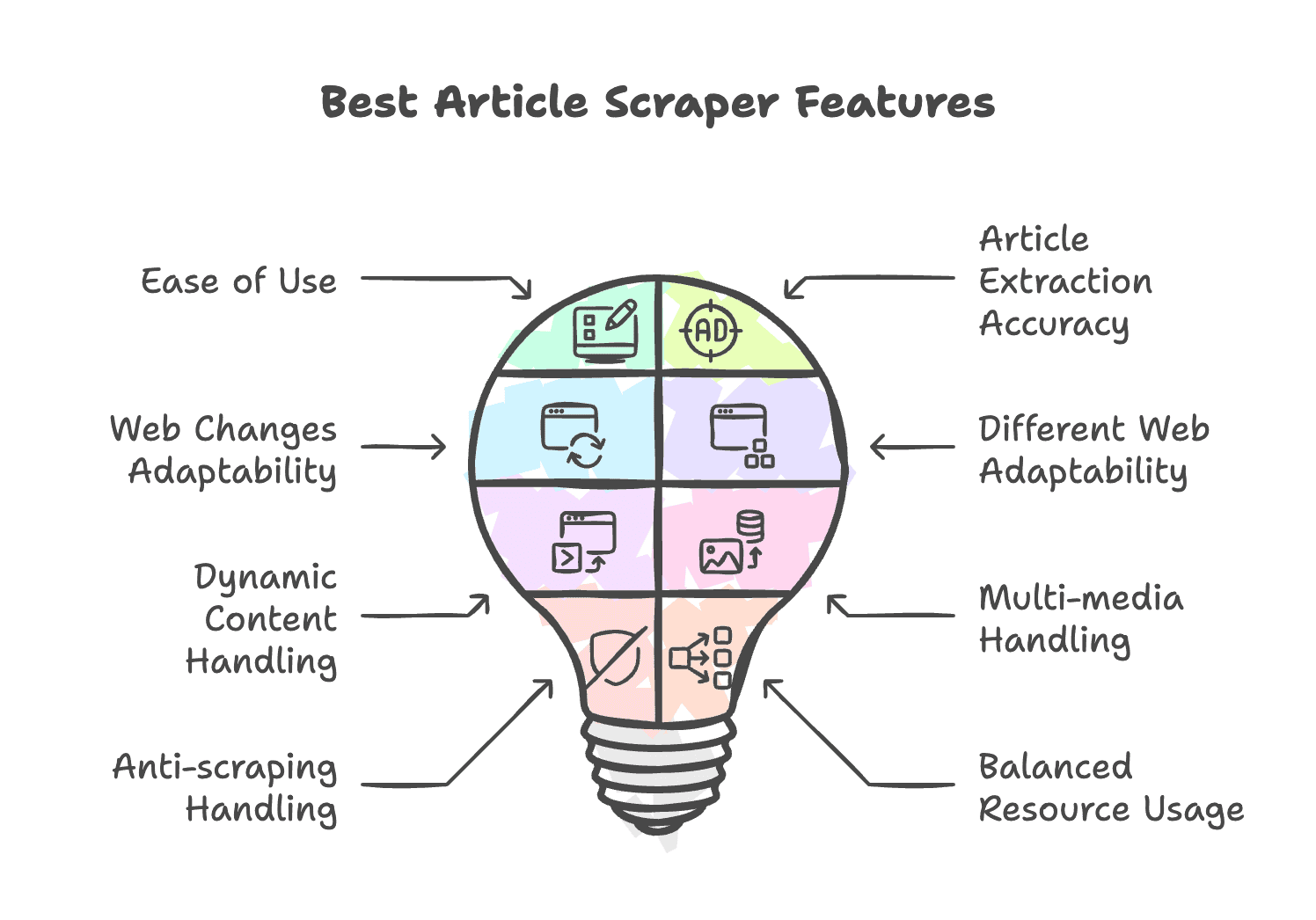

מה הופך מגרד מאמרים למצוין ב־2026?

מגרד מאמרים מוביל צריך לאזן בין ביצועים, עלות, נוחות שימוש, גמישות ויכולת סקייל. אלו הקריטריונים לבחירה ב־2026:

- נוחות שימוש: ממשק ברור ואינטואיטיבי, בלי צורך בקוד.

- דיוק בחילוץ מאמרים: זיהוי מדויק של המידע הרלוונטי בלי פרסומות או תפריטי ניווט.

- הסתגלות לשינויים באתר: התאמה אוטומטית לשינויים במבנה/עיצוב בלי תחזוקה תכופה.

- התאמה למגוון אתרים: עבודה טובה על מבנים שונים של אתרים.

- תמיכה בתוכן דינמי: תמיכה בטעינה דינמית באמצעות JavaScript או AJAX.

- תמיכה במדיה: זיהוי תמונות, וידאו ואודיו.

- התמודדות עם אנטי-גרידה: שימוש בסבב IP, פתרונות CAPTCHA ופרוקסים כדי לעקוף חסימות.

- איזון משאבים: לא “שורף” זיכרון ומשאבי מחשוב מעבר לנדרש.

מגרדי מאמרים וחדשות מובילים — מבט מהיר

| כלים | יכולות מרכזיות | הכי מתאים ל… | מחיר |

|---|---|---|---|

| Thunderbit | מגרד מבוסס AI (https://thunderbit.com/web-scraper-chrome-extension); תבניות מוכנות מראש (https://thunderbit.com/template/news-scraper); תמיכה בגרידת PDF/תמונות/מסמכים; יכולות מתקדמות לעיבוד נתונים | משתמשים ללא רקע טכני שצריכים לגרד כמה אתרי נישה | ניסיון חינם ל־7 ימים, החל מ־$9 לחודש (תוכנית שנתית) (https://thunderbit.com/pricing) |

| WebScraper.io | תוסף דפדפן; תמיכה בתוכן דינמי; ללא אינטגרציה מובנית לפרוקסים | משתמשים שלא עובדים עם דפים מורכבים או פיצ’רים מתקדמים | ניסיון חינם ל־7 ימים, החל מ־$40 לחודש (תוכנית שנתית) |

| Browse.ai | מגרד ומוניטור ללא קוד; “רובוטים” מוכנים; דפדפן וירטואלי; שיטות שונות לפאג’ינציה; אינטגרציות חזקות | ארגונים שצריכים גרידה מורכבת ובהיקף גדול | $19 לחודש (תוכנית שנתית) |

| Octoparse | מגרד ללא קוד המבוסס על סלקטורים של CSS; זיהוי אוטומטי ובניית זרימת עבודה; תבניות מוכנות למאמרים; דפדפן וירטואלי; מנגנוני אנטי-אנטי-גרידה | עסקים שצריכים גרידה של אתרים מורכבים | החל מ־$99 לחודש (תוכנית שנתית) |

| Bardeen | אוטומציה מקיפה; תבניות מוכנות; מגרד ללא קוד; אינטגרציה חלקה עם סביבת העבודה | צוותי GTM שמטמיעים גרידת מאמרים בתוך תהליכים קיימים | ניסיון חינם ל־7 ימים, החל מ־$99 לחודש (תוכנית שנתית) |

| PandaExtract | ממשק ידידותי; זיהוי ותיוג אוטומטיים | משתמשים שרוצים חילוץ מהיר בקליק בלי הגדרות מורכבות | $49 תשלום חד-פעמי (LTD) |

מגרד המאמרים מבוסס ה־AI החזק ביותר למשתמשים עסקיים

- יתרונות:

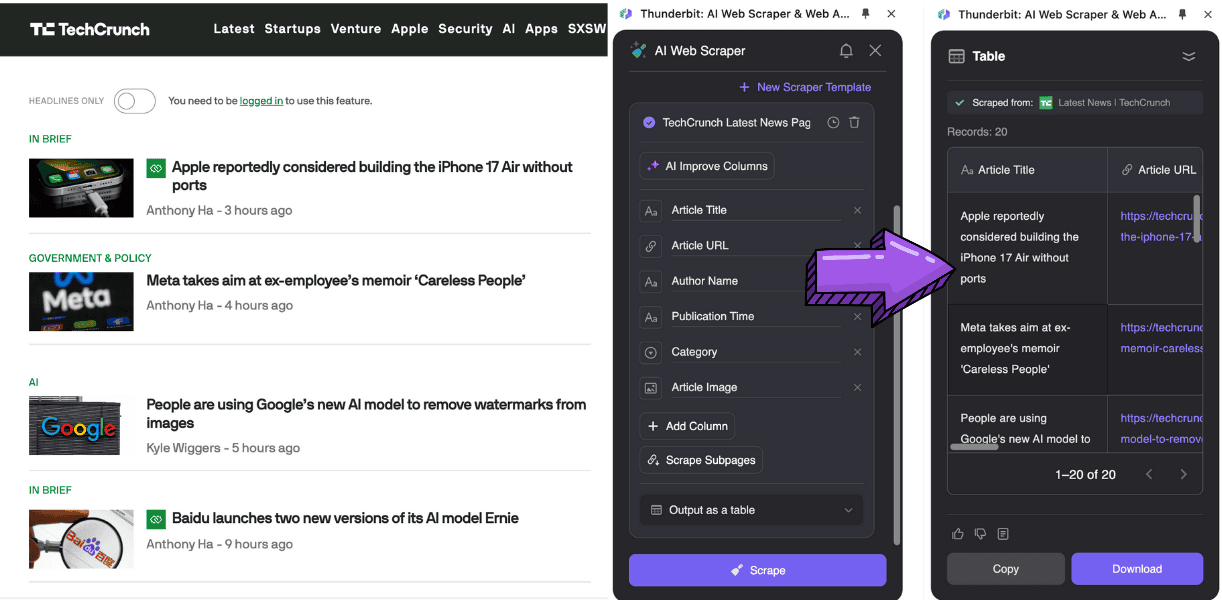

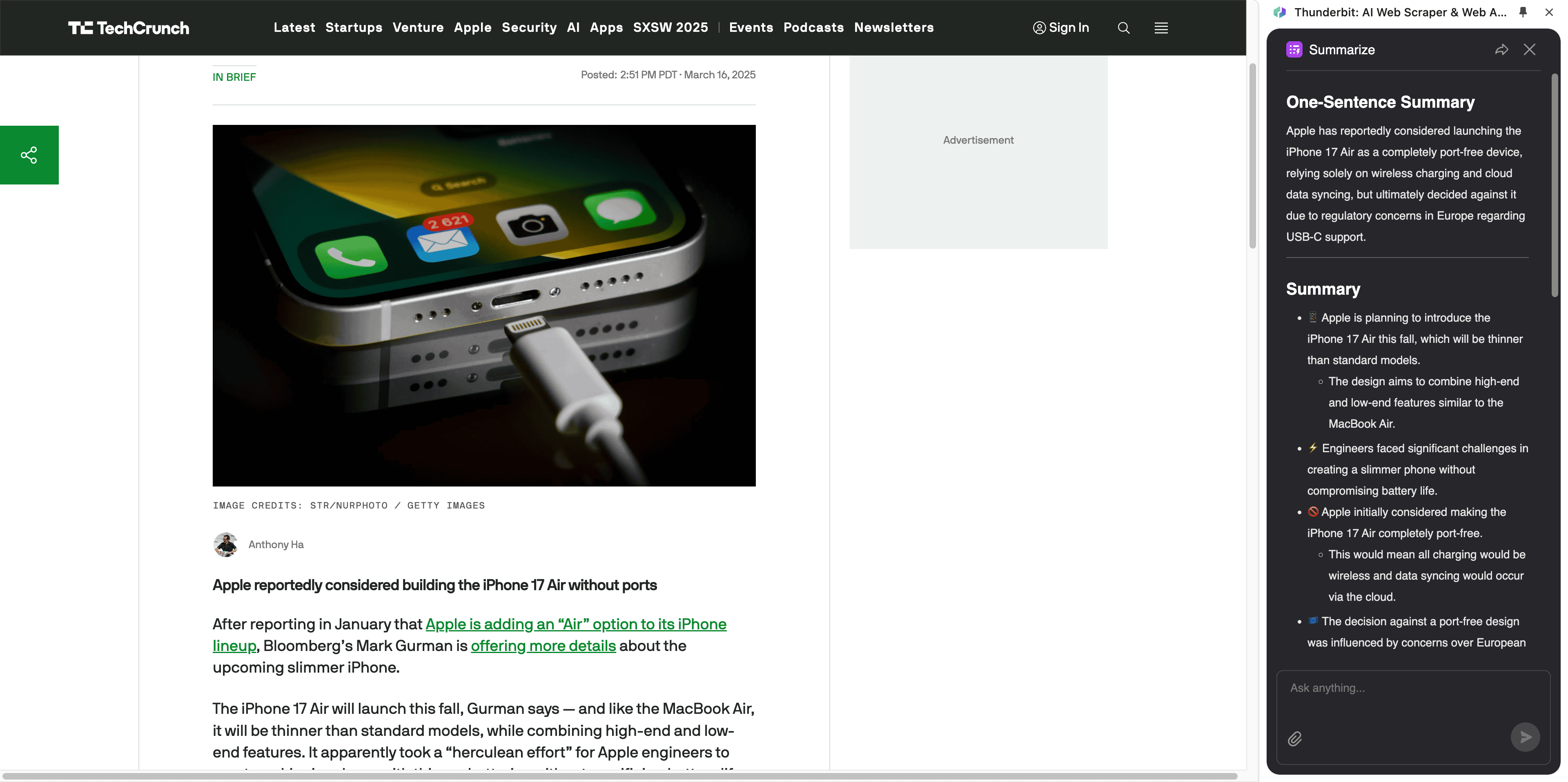

- שימוש בשפה טבעית כדי להפעיל AI לזיהוי וניתוח מידע בדף — בלי סלקטורים של CSS

- ניתוח נתונים בסיוע AI: המרת פורמטים, סיכום (https://thunderbit.com/summarize), סיווג, תרגום ותיוג

- תבניות מוכנות למאמרים (https://thunderbit.com/template/article-scraper) לגרידה בקליק של רשימות מאמרים ותוכן מלא

- תמחור נגיש עם תמורה גבוהה למחיר (https://thunderbit.com/pricing)

- חסרונות:

- זמין כרגע רק כתוסף Chrome (https://chromewebstore.google.com/detail/thunderbit-ai-web-scraper/hbkblmodhbmcakopmmfbaopfckopccgp)

- פחות מתאים לגרידת נתונים בהיקפים עצומים

- גרידה מרובת עמודים איטית יותר, אך ניתן להריץ ברקע כדי לקבל תוצאות מהר יותר

מגרד מאמרים מבוסס AI לשימוש ארגוני

Browse.ai

- יתרונות:

- מגרד ומוניטור ללא קוד

- תמיכה בדפדפן וירטואלי כדי להפחית סיכון להפעלת מנגנוני אנטי-גרידה

- מגוון “רובוטים” מוכנים לגרידה בקליק של Google News (https://news.google.com/home?hl=en-US&gl=US&ceid=US:en), Medium (https://medium.com/), Hacker News (https://news.ycombinator.com/) ועוד

- אינטגרציה עמוקה עם Zapier (https://zapier.com/) ו־Make (https://www.make.com/en) לחיבור בין כלים

- חסרונות:

- שימוש ב־deep extract דורש יצירת שני רובוטים — תהליך מסורבל

- סלקטורים של CSS פחות מדויקים באתרי נישה

- יקר, ומתאים יותר למשימות גרידה רציפות ובהיקף גדול

מגרד ללא קוד לחילוץ נתונים בהיקף קטן

PandaExtract

- יתרונות:

- מזהה אוטומטית רשימות מאמרים ועמודי פרטים, עם ממשק נוח

- יכול לחלץ רשימות, פרטים, אימיילים ותמונות — מתאים לגרידה מובנית בהיקף קטן

- תשלום חד-פעמי לשימוש לכל החיים

- חסרונות:

- זמין רק כתוסף דפדפן, לא ניתן להריץ בענן

- הגרסה החינמית מאפשרת רק העתקה, לא ייצוא ל־CSV/JSON וכו׳

מגרד מאמרים “מוכן מהקופסה” לארגונים

Octoparse

- יתרונות:

- מגרד ללא קוד עם זיהוי אוטומטי של מבנה האתר ויצירת תהליך גרידה

- הרבה תבניות מוכנות למגרד מאמרים — מתחילים לעבוד מיד

- דפדפן וירטואלי עם סבב IP, פתרונות CAPTCHA ופרוקסים לעקיפת מנגנוני אנטי-גרידה

- חסרונות:

- הזיהוי האוטומטי עדיין נשען על לוגיקה של סלקטורים, והדיוק בינוני

- פיצ’רים מתקדמים דורשים למידה ומיומנות טכנית

- יקר לגרידה בהיקפים גדולים

האוטומציה המקיפה ביותר לצוותי GTM

Bardeen

- יתרונות:

- מגרד מאמרים ללא קוד שמנצל LLM לאוטומציה בקליק

- מתחבר ליותר מ־100 אפליקציות, כולל Google Sheets (https://workspace.google.com/products/sheets/), Slack (https://slack.com/) ו־Zoom (https://www.zoom.com/)

- כלי אוטומציה חזקים לניתוח AI אחרי הגרידה

- מצוין לשילוב גרידה בתוך תהליכי עבודה קיימים

- חסרונות:

- תלות גבוהה ב־playbooks מוכנים; תהליכים מותאמים דורשים ניסוי וטעייה

- למרות שזה No-code, אוטומציות מורכבות עשויות לדרוש זמן למידה למשתמשים לא טכניים

- הגדרת חילוץ מתתי-עמודים מורכבת

- יקר מאוד

מגרד מאמרים קליל לחילוץ נתונים מיידי

Webscraper.io

- יתרונות:

- מגרד ללא קוד עם ממשק point-and-click

- תומך בטעינה דינמית של תוכן

- עבודה בענן

- אינטגרציה עם Dropbox (https://www.dropbox.com/), Google Sheets (https://workspace.google.com/products/sheets/) ו־Amazon (https://www.amazon.com/)

- חסרונות:

- אין תבניות מוכנות; צריך לבנות sitemap מותאם

- עקומת למידה למי שלא מכיר סלקטורים של CSS

- הגדרה מורכבת לפאג’ינציה וחילוץ מתתי-עמודים

- גרסת הענן יקרה

פתרונות מתקדמים יותר למהנדסים

למי שיש רקע טכני, קיימים גם APIs למגרד מאמרים (https://www.nimbleway.com/blog/how-article-scraper-apis-enhance-research). פתרונות כאלה מציעים:

- גמישות: קריאות API ישירות לגרידה מותאמת, כולל רינדור דינמי וסבב IP

- סקייל: שילוב בצינורות נתונים מותאמים לצרכים ארגוניים בתדירות גבוהה ובהיקפים גדולים

- עלות תחזוקה נמוכה: אין צורך לנהל מאגרי פרוקסים או אסטרטגיות אנטי-גרידה — חוסך זמן תפעולי

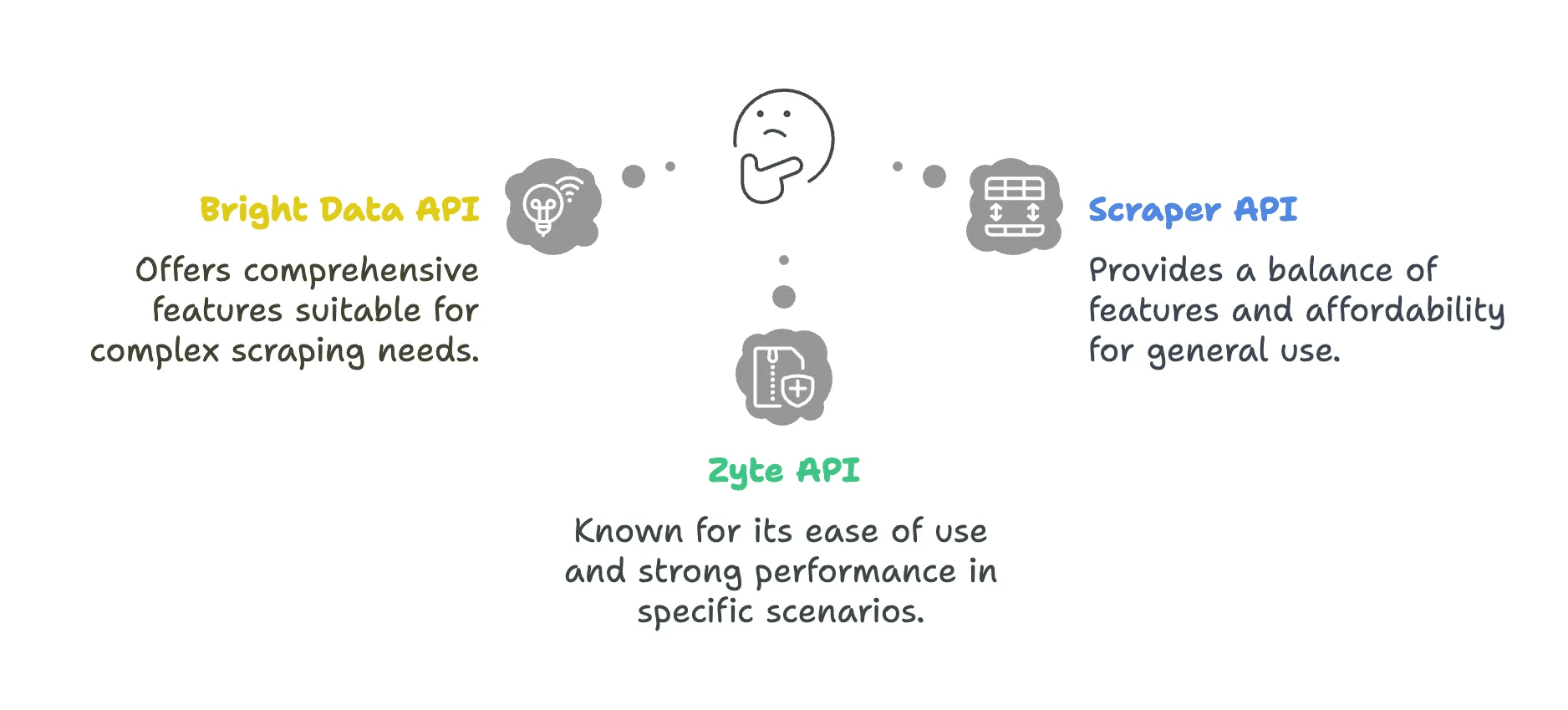

סקירה מהירה של פתרונות API

| API | יתרונות | חסרונות |

|---|---|---|

| Bright Data API | - רשת פרוקסים עצומה (72M+ כתובות IP ב־195 מדינות) - טירגוט גיאוגרפי מתקדם עד רמת עיר/מיקוד - Proxy Manager חזק לסבב IP | - זמני תגובה איטיים יותר (ממוצע 22.08 שנ׳) - תמחור גבוה שלא מתאים לצוותים קטנים - עקומת למידה גבוהה יותר בהגדרות |

| ScraperAPI | - נקודת כניסה נמוכה יותר החל מ־$49 - Autoparse לחילוץ נתונים אוטומטי - Web UI player לבדיקות | - לעיתים מחייב גם על בקשות שנחסמו - יכולות רינדור JavaScript מוגבלות - העלויות עלולות לעלות עם פרמטרים “פרימיום” |

| Zyte API | - יכולות parsing מבוססות AI - לא מחייב על בקשות שנכשלו | - עלות התחלתית גבוהה יותר (~$450 לחודש) - קרדיטים לא עוברים מחודש לחודש |

- Bright Data Web Scraper API

- יתרונות:

- כיסוי של 195 מדינות עם 72M+ כתובות IP ביתיות; סבב IP אוטומטי וסימולציית מיקום — מצוין לאתרים עם אנטי-גרידה קשוח (למשל Amazon (https://www.amazon.com/), Instagram (https://www.instagram.com/))

- תמיכה בטעינה דינמית ב־JavaScript ובצילום snapshot של עמודים

- חסרונות:

- יקר (חיוב לפי בקשה ורוחב פס), פחות משתלם לפרויקטים קטנים

- יתרונות:

- Scraper API

- יתרונות:

- 40M פרוקסים גלובליים; מעבר אוטומטי בין data center ל־residential; עקיפת אימות Cloudflare; אינטגרציה עם פתרונות CAPTCHA צד ג׳ (למשל 2Captcha (https://2captcha.com/))

- endpoints מובנים ומגרדים אסינכרוניים לשיפור מהירות

- חסרונות:

- רינדור דפים דינמיים עולה יותר; תמיכה מוגבלת באתרים מורכבים מבוססי AJAX

- יתרונות:

- Zyte API

- יתרונות:

- חילוץ נתוני רשת אוטומטי מבוסס AI — בלי לפתח ולתחזק כללי חילוץ לכל אתר

- תמחור גמיש לפי שימוש

- חסרונות:

- פיצ’רים מתקדמים (כמו ניהול סשנים ודפדפן סקריפטבילי) דורשים למידה

- יתרונות:

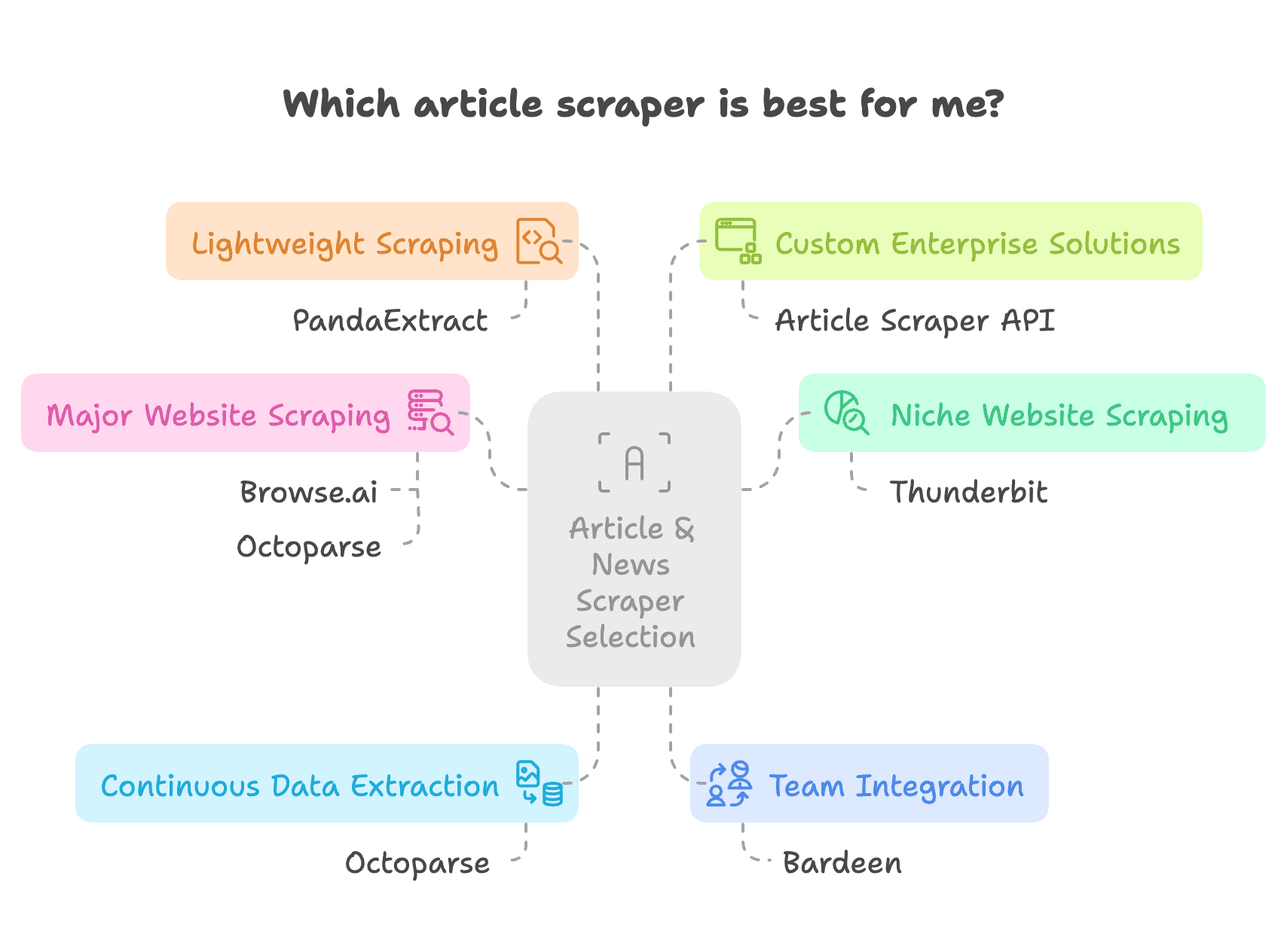

איך לבחור מגרד מאמרים וחדשות?

כשבוחרים מגרד מאמרים/חדשות, כדאי לחשוב על הצרכים העסקיים, הרקע הטכני והתקציב.

- אם אתם צריכים לגרד כמה אתרי נישה בלי לבנות מגרד לכל עמוד ויש לכם תקציב, Thunderbit (https://thunderbit.com/) הוא הבחירה הטובה ביותר. הוא לא תלוי בסלקטורים של CSS (https://developer.mozilla.org/en-US/docs/Learn_web_development/Core/Styling_basics/Basic_selectors), אלא משתמש ב־AI כדי לנתח את מבנה האתר — וגם מאפשר ניתוח AI אחרי הגרידה. מבחינת Thunderbit AI כל האתרים “נראים אותו דבר”, ולכן הוא יודע ללכוד מאמרים שלמים בדיוק גבוה.

- לגרידה מאתרים גדולים כמו Wall Street Journal (https://www.wsj.com/) או Google News (https://news.google.com/home?hl=en-US&gl=US&ceid=US:en), תצטרכו כלי עם מנגנוני אנטי-גרידה חזקים ותבניות מוכנות, כמו Browse.ai או Octoparse. עם זאת, לעיתים האפשרות הטובה ביותר היא תוסף Chrome כמו Thunderbit (https://thunderbit.com/web-scraper-chrome-extension): תהליך הגרידה מדמה גלישה והעתקה של משתמש אמיתי, כולל אפשרות לעבוד עם התחברות — בלי הגדרות מסובכות.

- אם אתם צריכים גרידה רציפה ובהיקף גדול, כלים עם יכולות תזמון כמו Octoparse יתאימו יותר.

- לשימוש צוותי ואינטגרציה חלקה לתהליכים קיימים, Bardeen מצוין ומציע כלי אוטומציה רבים מעבר לגרידת מאמרים.

- אם אתם רוצים כלי קליל לחילוץ קטן ומהיר בלי להשקיע זמן בלמידה, בחרו מגרד point-and-click כמו PandaExtract.

- אם יש לכם רקע טכני או שאתם בונים פתרון ארגוני, שקלו כלי API או בניית מגרד משלכם בנוסף למגרדים ללא קוד (https://iproyal.com/blog/no-code-web-scraper/).

סיכום

במאמר הזה הצגנו את הרעיון והתרחישים העסקיים של מגרדי מאמרים וחדשות. מגרדים מסורתיים (https://iproyal.com/blog/no-code-web-scraper/) בנויים על סלקטורים של CSS (https://developer.mozilla.org/en-US/docs/Learn_web_development/Core/Styling_basics/Basic_selectors), ולכן דורשים היכרות מסוימת עם HTML (https://www.w3schools.com/html/html_intro.asp) ו־CSS (https://developer.mozilla.org/en-US/docs/Learn_web_development/Core/Styling_basics/Basic_selectors) — במיוחד בפעולות מתקדמות. הדור החדש של מגרדי מאמרים מבוססי AI (https://thunderbit.com/) נשען על הבנה סמנטית וזיהוי חזותי של AI, ומוביל על פני מגרדים מסורתיים (https://iproyal.com/blog/no-code-web-scraper/) בהסתגלות לשינויים במבנה האתר, הכללה בין אתרים, טיפול בתוכן דינמי, וגם בניקוי וניתוח נתונים לאחר הגרידה.

בנוסף, הצגנו שישה מגרדי מאמרים/חדשות שימושיים וכלי API למפתחים, והשווינו יתרונות וחסרונות, היקפי נתונים מתאימים, מאפייני אתרים וקהל יעד. כששוקלים גרידת מאמרים וחדשות, בחרו פתרון שמתאים לצרכים העסקיים שלכם — תוך איזון בין ביצועים לעלות.

שאלות נפוצות

1. מהו מגרד מאמרים מבוסס AI, ואיך הוא עובד?

- משתמש ב־AI כדי לנתח דפי אינטרנט ולחלץ תוכן בלי צורך בסלקטורים של CSS.

- מזהה כותרות, מחברים, תאריכי פרסום והתוכן המרכזי בדיוק גבוה.

- מסיר אוטומטית פרסומות, תפריטי ניווט ורכיבים לא רלוונטיים.

- מסתגל לשינויים במבנה האתר ועובד על מגוון אתרים.

2. מה היתרונות של מגרד מאמרים מבוסס AI לעומת מגרדים מסורתיים?

- מאפשר לחלץ תוכן ממספר אתרים באמצעות כלי אחד.

- מתמודד עם תוכן דינמי, כולל דפים שנטענים ב־JavaScript וב־AJAX.

- דורש פחות הגדרה ותחזוקה לעומת מגרדים מבוססי CSS.

- מוסיף יכולות כמו סיכום, תרגום וניתוח סנטימנט.

3. האם אפשר להשתמש ב־Thunderbit לגרידת מאמרים עם AI בלי ידע בתכנות?

- כן. Thunderbit מיועד למשתמשים לא טכניים עם ממשק פשוט ללא קוד.

- משתמש ב־AI כדי לזהות ולחלץ תוכן מאמרים באופן אוטומטי.

- כולל תבניות מוכנות לגרידה מהירה ויעילה.

- מאפשר ייצוא נתונים לפורמטים שונים כמו CSV, JSON ו־Google Sheets.

לקריאה נוספת:

- What is Web Scraping (https://en.wikipedia.org/wiki/Web_scraping)

- How to Use AI for Web Scraping (https://brightdata.com/blog/web-data/ai-web-scraping)

- Modern Web Scraping: A Deep Dive into AI-Powered Tools (https://medium.com/@kram254/modern-web-scraping-a-deep-dive-into-ai-powered-tools-79dd12ee2267)

- News Scraping: Tools, Use Cases, and Challenges (https://infatica.io/blog/news-scraping/)