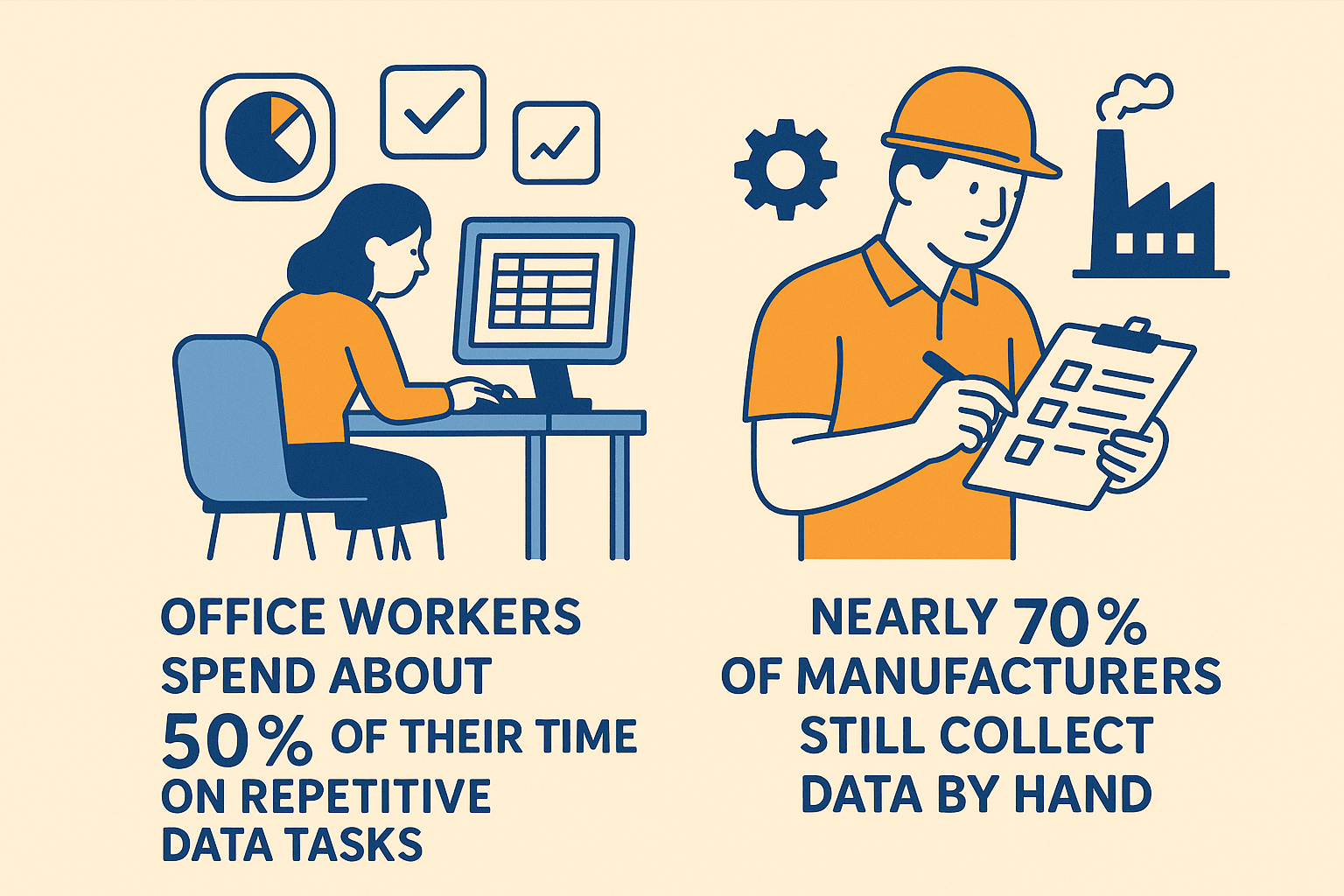

Si tu as déjà tenté d’arroser ton jardin avec un vieux tuyau qui fuit, tu sais à quel point c’est rageant de ne pas avoir l’eau là où tu en as besoin, au bon moment. Imagine maintenant que ce tuyau, ce sont les données de ta boîte — et qu’au lieu de quelques gouttes, tu dois faire passer un vrai torrent d’infos, venant de partout, en même temps. Bienvenue dans la gestion des données à la sauce 2024 ! Avec de données attendus d’ici 2025, les entreprises galèrent à suivre le rythme. Le problème est bien réel : les employés de bureau passent environ sur des tâches répétitives liées aux données, et près de saisissent encore tout à la main. Pas étonnant que beaucoup aient l’impression de vider un bateau qui prend l’eau… à la petite cuillère.

C’est là que les pipelines de données entrent en jeu. Imagine-les comme la plomberie de ton système d’info : ils relient, nettoient et font circuler les données là où il faut — vite, bien, et sans fuite. Après des années à bosser dans le SaaS et l’automatisation (et avoir monté plus d’un « tuyau » qui a fini par exploser sous la pression), je peux te dire qu’un bon pipeline de données, ça change tout : du chaos à la clarté. On va voir ensemble ce qu’est vraiment un pipeline de données, pourquoi c’est devenu indispensable, et comment des outils récents — comme les extracteurs web IA type — révolutionnent la donne, que tu sois commercial ou agent immo.

C’est là que les pipelines de données entrent en jeu. Imagine-les comme la plomberie de ton système d’info : ils relient, nettoient et font circuler les données là où il faut — vite, bien, et sans fuite. Après des années à bosser dans le SaaS et l’automatisation (et avoir monté plus d’un « tuyau » qui a fini par exploser sous la pression), je peux te dire qu’un bon pipeline de données, ça change tout : du chaos à la clarté. On va voir ensemble ce qu’est vraiment un pipeline de données, pourquoi c’est devenu indispensable, et comment des outils récents — comme les extracteurs web IA type — révolutionnent la donne, que tu sois commercial ou agent immo.

Qu’est-ce qu’un pipeline de données ? Version simple

Un pipeline de données, c’est tout simplement une série d’étapes automatisées qui font voyager les données d’un point A à un point B, en les transformant pour qu’elles soient vraiment utiles. Si tu aimes les images (et franchement, qui n’aime pas ?), en voici deux :

- La plomberie : Comme des tuyaux qui amènent l’eau du château d’eau à ton robinet — en filtrant et purifiant au passage — un pipeline de données fait voyager les données brutes (bases de données, API, sites web) vers leur destination (tableaux de bord, entrepôts de données), en les transformant selon les besoins ().

- La pizzeria : Imagine une pizza : pâte, sauce, garniture, cuisson, emballage. Un pipeline de données, c’est pareil : les « ingrédients » bruts entrent, chaque étape ajoute de la valeur, et à la sortie, tu as une « pizza » prête à être dégustée/analyse ().

En clair : un pipeline de données récupère des infos de différentes sources, les traite (nettoyage, fusion, transformation) et les dépose là où ton équipe pourra vraiment s’en servir — automatiquement, souvent en temps réel.

Les grandes étapes d’un pipeline de données

- Collecte des données (ingestion) : On va chercher les données à la source — bases de données, API, fichiers, ou même sites web via l’extraction web.

- Traitement/Transformation : On nettoie, on standardise, on enrichit (corriger les fautes, fusionner des listes, calculer des totaux, etc.).

- Stockage et livraison : On range les données traitées dans un entrepôt, un dashboard ou une appli, prêtes à être analysées ou utilisées.

Sans pipeline, tu te tapes les exports manuels, les tableurs à rallonge, et tu croises les doigts pour que rien ne se perde en route.

Pourquoi les pipelines de données sont-ils devenus incontournables en entreprise ?

Concrètement, pourquoi s’y intéresser même si tu n’es pas dans l’IT ? Parce que c’est le moteur caché de toutes les décisions rapides et data-driven de ta boîte. Voilà comment ça change la donne pour tout le monde :

- Des analyses express pour des décisions plus réactives : Grâce aux pipelines, les données sont dispo quasi instantanément. Par exemple, une équipe commerciale peut voir les nouveaux leads en temps réel — les contacter dans les 5 minutes, c’est de les qualifier.

- Fini les silos de données : Les pipelines rassemblent les infos de tous les services (ventes, marketing, ops), pour une vision unifiée et plus de débats sur « c’est quel fichier le bon ? ». pensent que les silos freinent leur boîte.

- Efficacité et automatisation : Automatiser les tâches liées aux données, c’est du temps gagné. Une équipe marketing a économisé rien qu’en automatisant ses reportings.

- Culture data-driven : Quand tout le monde a accès à des données fraîches, l’analyse en self-service devient la norme — fini d’attendre deux semaines pour un rapport du service IT.

- ROI et avantage concurrentiel : Les boîtes qui passent aux pipelines modernes voient un en trois ans, grâce à l’efficacité et à de meilleures décisions.

Petit récap des bénéfices selon les équipes :

Petit récap des bénéfices selon les équipes :

| Équipe | Bénéfice du pipeline | Impact concret |

|---|---|---|

| Ventes | Données clients/prospects en temps réel, CRM à jour | Réponse plus rapide = 21× plus de prospects qualifiés (Voiso) |

| Opérations | Indicateurs unifiés et à jour | Stocks plus précis, meilleure prévision (Aampe) |

| Marketing | Analyses intégrées, optimisation des campagnes | 80 h/mois gagnées sur le reporting (Coupler) |

| Finance | Consolidation automatisée, reporting accéléré | Suivi des profits en temps réel, clôtures mensuelles plus rapides |

| Analytics/BI | Données centralisées et propres pour l’analyse | Moins de temps à nettoyer, plus à produire des insights |

En bref : les pipelines de données transforment tes données d’un casse-tête en un vrai atout stratégique.

Pourquoi la gestion des données « à l’ancienne » ne tient plus la route

Avant les pipelines, gérer les données, c’était un peu comme jouer à cache-cache — manuel, désordonné, lent. Voilà à quoi ça ressemblait :

- Transferts manuels de données : Les équipes exportaient des CSV, s’envoyaient des fichiers par mail, copiaient-collaient entre applis. Chronophage et plein d’erreurs. partait là-dedans.

- Silos de données : Chaque service avait ses propres chiffres, d’où des rapports contradictoires et des réunions sans fin pour tout recouper. avouent que les silos sont bien là.

- Mises à jour lentes et périodiques : Les rapports étaient mis à jour chaque semaine ou chaque mois, donc les décisions étaient toujours à la bourre. Dans le retail, .

- Processus sujets aux erreurs : Les étapes manuelles, c’est la porte ouverte aux boulettes — erreurs de copier-coller, fichiers obsolètes, bugs de logique. contiennent au moins une erreur critique.

- Manque d’agilité : Besoin d’un nouveau rapport ou indicateur ? Ça pouvait prendre des semaines de boulot manuel ou de dev spécifique.

Avec la masse de données qui explose, ces méthodes « old school » ne tiennent plus la route. C’est comme courir un marathon en tongs — lent, douloureux, et franchement à éviter si tu veux garder tes soirées sans tableur.

Comment les pipelines de données changent la donne

Les pipelines de données, c’est la révolution : tout le flux d’infos est automatisé et fluide. Voilà la différence :

Avant (manuel) :

- Les rapports de ventes hebdo prennent 8 heures à compiler.

- Les données ont toujours une semaine de retard.

- Les erreurs passent à la trappe, chaque nouvelle demande = plus de boulot manuel.

Après (pipeline) :

- Les données sont collectées, nettoyées et livrées chaque jour (voire en temps réel).

- Les rapports se mettent à jour tout seuls — adieu les nuits blanches sur Excel.

- Les erreurs sont repérées tôt, tout le monde bosse sur des données fraîches.

Par exemple, un distributeur qui a un pipeline peut voir chaque matin ses ventes, stocks et perfs marketing sur un dashboard. Si un produit dégringole, l’équipe le sait tout de suite — pas une semaine plus tard. C’est ça, la vraie réactivité.

Les briques essentielles d’un pipeline de données

Peu importe la complexité, tout pipeline de données repose sur quelques bases :

- Sources de données : D’où viennent tes données — bases de données, applis, fichiers, API, ou sites web (via extraction web).

- Ingestion/Extraction : Le process qui fait entrer les données dans le pipeline.

- Transformation/Traitement : On nettoie, fusionne, formate pour rendre les données exploitables.

- Stockage : On range les données traitées dans un entrepôt, un data lake ou une base.

- Livraison (consommation) : On met les données à dispo dans des dashboards, rapports ou autres applis.

En résumé : Source → Ingestion → Transformation → Stockage → Livraison.

Exemple : un pipeline commercial peut extraire des leads d’un site web (source), les importer (ingestion), corriger les numéros de téléphone (transformation), les stocker dans un CRM (stockage), puis envoyer des alertes aux commerciaux (livraison).

Les deux grandes familles de pipelines : batch ou temps réel

| Aspect | Pipeline batch | Pipeline temps réel |

|---|---|---|

| Fréquence | Périodique (quotidien, horaire, hebdo) | Continue (en secondes ou millisecondes) |

| Latence | Plus élevée (minutes à heures) | Faible (quasi instantané) |

| Cas d’usage | Reporting régulier, finance mensuelle, gros volumes | Tableaux de bord live, détection de fraude, personnalisation en temps réel |

| Avantages | Plus simple, fiable, idéal pour l’historique | Analyses immédiates, réactions rapides, parfait pour l’opérationnel |

| Défis | Données obsolètes entre deux exécutions | Plus complexe, nécessite une infrastructure robuste de streaming |

La plupart des boîtes mixent les deux : batch pour la paie ou l’analyse historique, temps réel pour tout ce qui demande de la réactivité (bourse, stocks, alertes fraude…).

L’extraction web, la porte d’entrée des données externes dans un pipeline

C’est là que ça devient fun (et que Thunderbit brille). Toutes les données ne sont pas bien rangées dans des bases ou accessibles via API. Parfois, l’info dont tu as besoin est planquée sur des sites web, dans des PDF ou des images — non structurée, en vrac, impossible à exporter facilement.

L’extraction web, c’est le fait d’aller chercher automatiquement des données sur des sites internet. Dans un pipeline de données, c’est la méthode d’ingestion pour les sources externes ou non structurées.

Exemples concrets d’extraction web dans un pipeline

- Veille tarifaire concurrentielle : Les distributeurs extraient les prix des concurrents pour ajuster les leurs en temps réel ().

- Génération de leads : Les commerciaux collectent des contacts sur des annuaires, LinkedIn ou des sites d’événements, et les intègrent direct dans leur CRM.

- Études de marché : Les marketeurs extraient des avis, posts de forums ou commentaires sur les réseaux sociaux pour analyser les tendances et le ressenti.

- Immobilier : Les agents agrègent les annonces de plusieurs sites pour suivre le marché local ou se constituer leur propre base ().

- Collecte de données publiques : Extraction de portails gouvernementaux, académiques ou publics pour la recherche ou la conformité.

L’extraction web, c’est donc la « première étape » du pipeline pour les données externes, transformant des pages web en infos structurées et prêtes à l’emploi.

Thunderbit : la collecte de données nouvelle génération avec l’Extracteur Web IA

Je ne vais pas faire semblant d’être neutre, mais voyons comment rend la collecte de données non seulement plus simple, mais carrément plus futée.

Pourquoi Thunderbit sort du lot ?

- Extraction en 2 clics avec IA Suggest : Clique sur « IA Suggérer les champs » et l’IA de Thunderbit scanne la page, propose les meilleures colonnes (genre « Nom du produit », « Prix », « Note »), puis extrait les données. Pas de code, pas de prise de tête — juste le résultat ().

- Compatible avec tout site, PDF ou image : Thunderbit extrait aussi bien des pages web que des PDF ou images grâce à l’OCR IA — et ce, dans .

- Extraction de sous-pages et pagination : Besoin d’infos sur des sous-pages (profils, fiches produits) ? L’IA de Thunderbit navigue, collecte les détails et les regroupe dans ton jeu de données — sans rien configurer.

- Modèles instantanés pour les sites connus : Pour Amazon, Zillow, LinkedIn, etc., Thunderbit propose des modèles prêts à l’emploi. Tu choisis, tu lances — c’est tout.

- Export direct vers tes outils : Exporte tes données direct dans Excel, Google Sheets, Airtable ou Notion. Ou télécharge-les en CSV/JSON pour la suite.

- Extraction programmée : Planifie des extractions récurrentes (« chaque lundi à 9h ») pour alimenter ton pipeline en données fraîches — plus besoin de tout refaire à la main.

- Enrichissement IA des données : Utilise les prompts IA pour taguer, catégoriser ou même traduire les données à la volée.

Thunderbit en action : exemple de pipeline concret

Imaginons que tu sois analyste marketing et que tu veuilles suivre les avis clients de trois sites e-commerce concurrents. Avec Thunderbit :

- Tu ouvres chaque site, tu lances l’extension, tu laisses l’IA suggérer les champs « Avis », « Note », « Date ».

- Tu programmes des extractions hebdo — Thunderbit récupère les nouveaux avis et les balance dans Google Sheets.

- Tu utilises les prompts IA pour taguer le sentiment (positif/négatif/neutre) direct dans le fichier.

- Ton pipeline te sort un dashboard consolidé et à jour chaque semaine — sans copier-coller, sans trou dans les données.

J’ai vu des équipes passer de plusieurs heures de collecte manuelle à quelques minutes pour tout avoir. Et comme Thunderbit est ultra simple, même les non-techs peuvent créer et gérer leur pipeline de données.

L’avenir : des pipelines de données boostés à l’IA pour des décisions plus malines

C’est là que ça devient vraiment excitant. La nouvelle génération de pipelines ne se contente plus de déplacer les données — elle les rend plus intelligentes au fil de l’eau.

- Préparation automatisée des données : L’IA peut nettoyer, enrichir, voire fusionner des jeux de données toute seule. Imagine demander à ton pipeline : « Croise les ventes et la météo par région », et l’IA gère tout ().

- Analyse en temps réel : Les pipelines peuvent analyser les données à la volée, détecter des anomalies, voire déclencher des actions (alerter les ventes si un concurrent baisse ses prix, par exemple).

- Recommandations IA : Au lieu de sortir des chiffres bruts, les pipelines peuvent mettre en avant des insights — « Les ventes en région X ont chuté de 15 % ; probablement à cause d’une promo concurrente ».

- Interfaces en langage naturel : Bientôt, tu pourras créer ou modifier un pipeline juste en le décrivant en français.

Thunderbit est déjà dans la course, avec la suggestion de champs par IA, l’enrichissement automatisé et la planification en langage naturel. Le but ? Des pipelines qui ne font pas que déplacer les données, mais t’aident à comprendre et à agir — sans avoir besoin d’être ingénieur data.

À retenir : pourquoi chaque boîte doit s’intéresser aux pipelines de données

En résumé :

- Un pipeline de données, c’est la logistique de tes infos — il automatise le passage du bazar à l’insight exploitable.

- Les pipelines font sauter les galères classiques : boulot manuel, silos, reporting lent et erreurs à gogo.

- Tous les services y gagnent : Ventes = leads plus rapides, marketing = analytics en temps réel, ops = stocks à jour, direction = vision globale.

- L’extraction web devient incontournable grâce à des outils IA comme Thunderbit qui rendent les données externes accessibles à tous.

- L’avenir, c’est l’IA : Les pipelines deviennent plus malins, plus automatisés et plus simples à utiliser — permettant à tous de créer, gérer et exploiter les flux de données sans dépendre de l’IT.

Si ta boîte est encore bloquée à l’ère du copier-coller, il est temps de changer de braquet. Commence petit — automatise un rapport hebdo, teste un outil comme , et vois combien de temps (et de stress) tu peux économiser. Passer du chaos des tableurs à la clarté des pipelines, c’est plus simple — et plus proche — que tu ne le penses.

Envie d’aller plus loin ? Va jeter un œil au pour d’autres guides, ou découvre comment et .

FAQ

1. C’est quoi un pipeline de données, en mode simple ?

Un pipeline de données, c’est un process automatisé qui collecte, transforme et livre des données de différentes sources vers un endroit où elles peuvent être exploitées — comme la plomberie de l’info dans ta boîte.

2. Pourquoi les pipelines de données sont-ils importants pour les équipes métier ?

Ils font gagner du temps, réduisent les erreurs et garantissent que tout le monde bosse sur des données fraîches. Résultat : décisions plus rapides, meilleure collaboration et ROI boosté pour les ventes, le marketing, les ops, etc.

3. Quel est le rôle de l’extraction web dans un pipeline de données ?

L’extraction web sert de source, en allant chercher des infos sur des sites qui n’offrent pas d’export ou d’API. C’est clé pour collecter des données externes et non structurées — comme les prix concurrents, les avis ou les annuaires publics.

4. Pourquoi choisir Thunderbit pour la collecte de données dans un pipeline ?

Thunderbit utilise l’IA pour rendre l’extraction web simple et puissante — deux clics suffisent pour extraire des données structurées de n’importe quel site, avec des fonctions comme l’extraction de sous-pages, des modèles instantanés et l’export direct vers tes outils préférés.

5. Quel avenir pour les pipelines de données avec l’IA ?

Les pipelines boostés à l’IA vont automatiser non seulement le transfert, mais aussi le nettoyage, l’enrichissement et même l’analyse des données — permettant à tous de créer et gérer des pipelines en langage naturel, et d’accéder à des décisions proactives en temps réel.

Prêt à voir ce qu’un pipeline de données moderne peut apporter à ta boîte ? et commence à bâtir tes propres flux de données, plus malins et plus rapides, dès aujourd’hui. Pour aller plus loin