Le web grandit à une vitesse franchement difficile à imaginer. Chaque jour, des milliards de nouvelles pages, de produits, d’avis et de jeux de données sont publiés, alimentant tout, de l’étude de marché à l’entraînement de l’IA, sans oublier votre prochaine virée shopping sur Amazon. Après des années passées dans le SaaS et l’automatisation, j’ai vu de mes propres yeux à quel point une bonne donnée peut faire basculer une décision business. Mais voilà le souci : collecter, mettre à jour et donner du sens à toutes ces données web devient de plus en plus complexe, et non l’inverse. Les extracteurs web traditionnels ont du mal à suivre, et les entreprises cherchent une solution plus intelligente et plus rapide pour transformer Internet en insights exploitables. C’est là qu’entre en scène le cloud crawler — un outil qui révolutionne discrètement la façon dont les organisations découvrent et exploitent les données web à grande échelle.

Alors, qu’est-ce qu’un cloud crawler exactement ? En quoi se distingue-t-il des extracteurs web que vous connaissez peut-être déjà ? Et pourquoi des équipes commerciales aux opérations misent-elles sur cette technologie pour garder une longueur d’avance dans un monde piloté par la donnée ? Décortiquons tout ça, clarifions les termes à la mode, et voyons comment les cloud crawlers — en particulier la solution de Thunderbit — changent la donne pour les entreprises modernes.

Qu’est-ce qu’un cloud crawler ? La nouvelle étape de la découverte de données

Voyons ça simplement : un cloud crawler n’est pas juste un extracteur web hébergé dans le cloud. C’est plutôt un moteur de découverte de données — un système intelligent, basé sur le cloud, conçu pour repérer, extraire et analyser automatiquement d’énormes volumes de données sur Internet. Là où un extracteur web classique récupère des informations sur quelques pages (souvent une par une, et en général depuis une seule machine), un cloud crawler joue dans une autre catégorie. Il fonctionne dans de puissants centres de données cloud, parcourt des milliers, voire des millions de pages en simultané, et peut traiter aussi bien du texte que des images ou des PDF — quelle que soit la complexité ou l’ampleur du site ciblé.

Imaginez : si un extracteur web ressemble à un bibliothécaire seul qui recopie quelques passages d’un livre, un cloud crawler ressemble à une équipe de superordinateurs qui scanne tous les livres de la bibliothèque en même temps, en taguant, organisant et analysant le contenu au fur et à mesure. Le résultat ? Les entreprises récupèrent des données plus riches, plus fraîches et plus exploitables — sans les limites du matériel local ni les tâches manuelles (, ).

Cloud crawler vs extracteur web traditionnel : quelle est la vraie différence ?

Si vous avez déjà utilisé un extracteur web, vous connaissez le principe : vous lui donnez une page, vous définissez ce que vous voulez, et il extrait les données. Mais à mesure que le web grandit et se complexifie, l’ancienne approche montre ses limites. Voici comment se comparent les cloud crawlers et les extracteurs web traditionnels :

| Aspect/Fonction | Extracteur Web traditionnel | Cloud Crawler |

|---|---|---|

| Déploiement | Fonctionne sur votre appareil local ou serveur | Fonctionne dans le cloud (centres de données distants) |

| Échelle | Limité par la puissance de votre ordinateur | Massivement parallèle — des milliers de pages à la fois |

| Vitesse | Plus lent, surtout pour les gros volumes | Traitement par lots à haute vitesse |

| Maintenance | Nécessite des mises à jour fréquentes, casse en cas de changement du site | Basé sur le cloud, se met à jour automatiquement, moins fragile |

| Types de données | Généralement du texte, parfois des images | Texte, images, PDF, mises en page complexes |

| Accès | Lié à votre appareil/réseau | Accessible de partout, sur n’importe quel appareil |

| Planification | Manuelle ou automatisation basique | Planification avancée, tâches récurrentes |

| Idéal pour | Petits projets, sites simples | Besoins de données à grande échelle, fréquents ou complexes |

Les cloud crawlers sont pensés pour le web d’aujourd’hui — un environnement où la donnée est partout, et où la vitesse comme l’échelle ne sont pas négociables (, ).

Comment les cloud crawlers boostent l’efficacité de la collecte de données

C’est là que les choses deviennent vraiment intéressantes. Les cloud crawlers exploitent la puissance du cloud computing pour traiter des milliers de pages web en parallèle. Résultat : vous pouvez extraire tout un catalogue e-commerce, surveiller les prix de vos concurrents sur des dizaines de sites, ou regrouper des annonces immobilières provenant de tous les grands portails — le tout en une fraction du temps qu’il faudrait avec un extracteur classique.

Pourquoi est-ce important ? Parce que dans des secteurs comme l’e-commerce, la finance ou l’immobilier, la fraîcheur des données est essentielle. Les prix, les stocks et les tendances du marché changent parfois minute par minute. Attendre des heures, voire des jours, qu’un extracteur local termine son travail n’est tout simplement pas envisageable. Les cloud crawlers ne sont pas limités par la RAM de votre ordinateur portable ni par le Wi-Fi du bureau : ils montent en puissance selon les besoins, pour gérer des volumes massifs sans effort (, ).

Les secteurs qui en profitent le plus sont notamment :

- E-commerce : suivi des prix, agrégation de catalogues produits, analyse des avis

- Immobilier : regroupement d’annonces, suivi des tendances du marché, comparaison de biens

- Finance : analyse de l’actualité et du sentiment, suivi des actions/crypto, veille réglementaire

- Ventes & marketing : génération de leads, veille concurrentielle, détection de tendances

Et franchement, ce n’est qu’un aperçu. Si vous avez besoin de données web à grande échelle, un cloud crawler devient vite un allié indispensable.

La solution cloud crawler de Thunderbit : rapide, flexible et puissante

Laissez-moi remettre ma casquette Thunderbit deux secondes (bon, en vrai, je ne l’enlève jamais vraiment). Le mode de scraping cloud de est notre réponse au défi moderne de la donnée — un cloud crawler conçu pour les utilisateurs métier qui veulent des résultats, pas des complications.

Voici ce qui distingue le cloud crawler de Thunderbit :

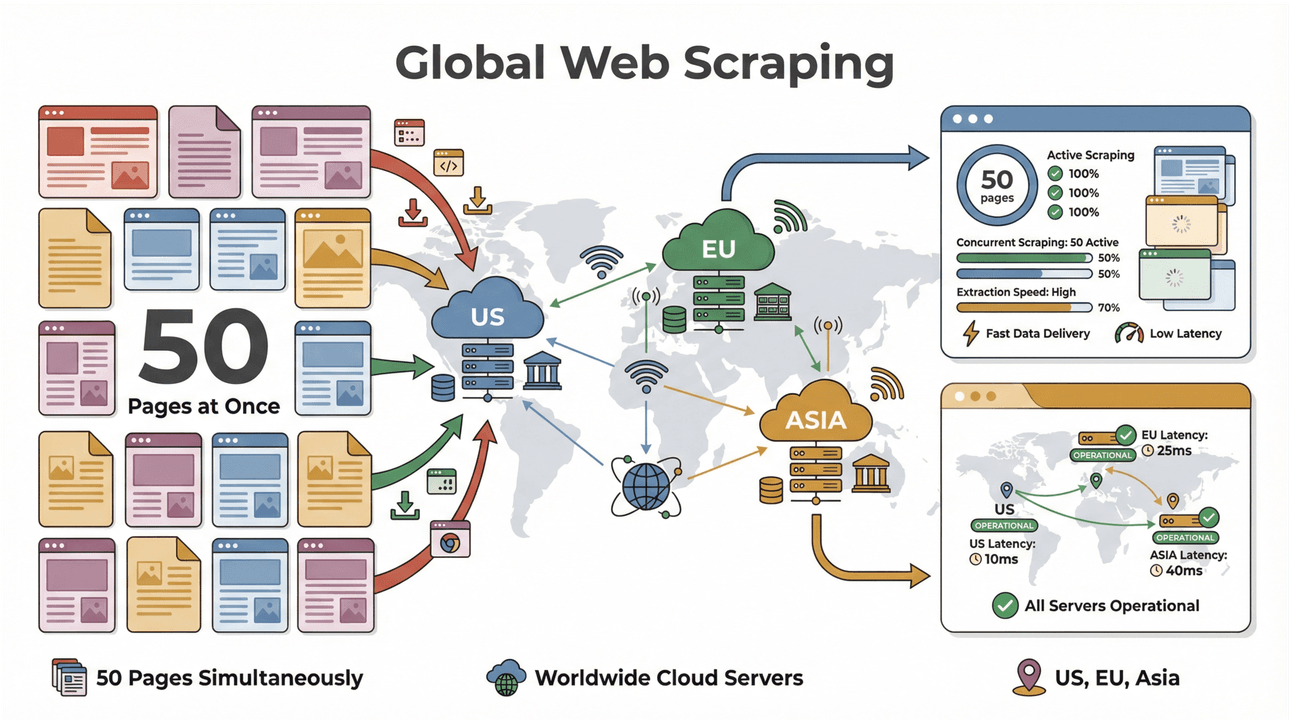

- Scraping par lots à haute vitesse : extrayez jusqu’à 50 pages en même temps, avec des serveurs cloud aux États-Unis, en Europe et en Asie pour une couverture mondiale. Plus besoin d’attendre que votre ordinateur rame sur une longue liste.

- Prise en charge des pages complexes : l’IA de Thunderbit gère aussi bien les sites e-commerce dynamiques que les PDF difficiles, sans oublier l’extraction d’images. Si c’est sur le web, Thunderbit peut probablement l’extraire ().

- Exploration des sous-pages : besoin d’enrichir vos données avec des détails présents sur des sous-pages (comme des fiches techniques produit ou des biographies d’auteurs) ? L’IA de Thunderbit peut visiter chaque sous-page et fusionner les résultats dans votre jeu de données principal ().

- Structuration intelligente des données : utilisez « AI Suggest Fields » pour laisser Thunderbit analyser le site et recommander les meilleures colonnes — sans code ni création de modèle.

- Export partout : envoyez vos données directement vers Excel, Google Sheets, Airtable ou Notion. Ou téléchargez simplement en CSV/JSON — selon votre flux de travail ().

- Aucune maintenance requise : l’IA de Thunderbit s’adapte aux changements du site, ce qui vous évite de réparer sans cesse des extracteurs cassés ().

Et oui, vous pouvez tout essayer avec une — pas besoin de me croire sur parole.

Déploiement d’un cloud crawler : cloud ou local, que choisir ?

L’un des plus grands atouts des cloud crawlers, c’est leur flexibilité de déploiement. Avec un crawler traditionnel (local), vous êtes lié à un appareil précis, à un réseau donné, et souvent à une bonne dose de configuration fastidieuse. Si votre ordinateur se met en veille ou si votre connexion Internet coupe, l’extraction s’arrête. Pour monter en capacité, il faut acheter plus de matériel ou lancer plusieurs scripts.

Les cloud crawlers changent complètement la donne :

- Aucun matériel spécial nécessaire : tout le travail lourd est effectué dans le cloud. Vous pouvez lancer d’énormes extractions depuis un Chromebook, un Mac, ou même votre téléphone.

- Accès depuis n’importe où : en déplacement ? En télétravail ? Aucun souci — votre cloud crawler reste disponible en permanence.

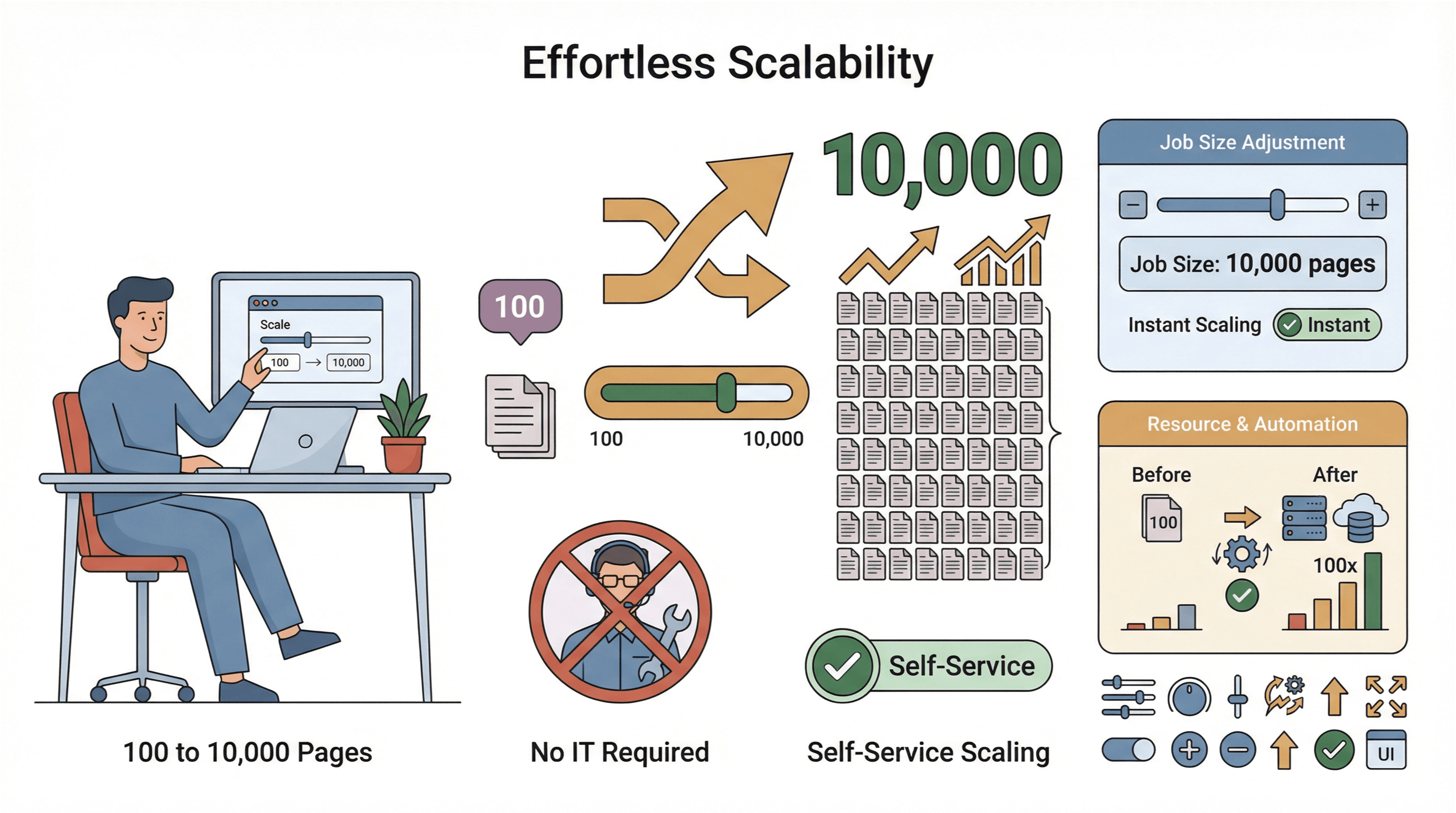

- Montée en charge facile : vous devez extraire 10 000 pages au lieu de 100 ? Il suffit d’augmenter la taille du job — sans passer par l’informatique.

- Collecte mondiale de données : avec des serveurs cloud dans plusieurs régions, vous pouvez accéder à des contenus géorestreints et gérer plus facilement la conformité ().

Bien sûr, la sécurité et la conformité restent des priorités majeures. Les meilleurs cloud crawlers (Thunderbit inclus) utilisent des connexions chiffrées, respectent les conditions d’utilisation des sites et proposent des fonctionnalités pour gérer les données sensibles de manière responsable.

Impact concret : comment les cloud crawlers transforment les stratégies pilotées par la donnée

Passons au concret. Pourquoi les entreprises passent-elles aux cloud crawlers ? Parce qu’elles constatent un impact réel et mesurable :

- Analyse de marché en temps réel : les retailers surveillent les prix et les stocks des concurrents en temps réel, ce qui permet une tarification dynamique et des réactions plus rapides aux évolutions du marché ().

- Anticipation des tendances consommateurs : les marques regroupent avis, publications sur les réseaux sociaux et discussions de forums pour repérer les signaux émergents et ajuster leurs campagnes à la volée.

- Ventes & génération de leads : les équipes commerciales construisent des listes de prospects à jour à partir d’annuaires, de sites d’événements et même de PDF — en alimentant les CRM avec des contacts frais et qualifiés ().

- Opérations & conformité : les institutions financières utilisent les cloud crawlers pour suivre les évolutions réglementaires, l’actualité et les dépôts officiels dans plusieurs juridictions — réduisant les risques et gardant une longueur d’avance sur les changements.

Le fil conducteur ? Les cloud crawlers permettent aux équipes d’aller plus vite, de prendre de meilleures décisions et de dépasser des concurrents encore bloqués sur la voie lente.

Les fonctionnalités essentielles à rechercher dans un cloud crawler

Tous les cloud crawlers ne se valent pas. Si vous comparez plusieurs solutions, voici les fonctionnalités les plus importantes — et celles où Thunderbit se démarque :

- Scalabilité : peut-il gérer des milliers de pages en même temps ? Ralentit-il lorsque les jobs grossissent ?

- Facilité d’utilisation : l’interface est-elle accessible aux non-techniciens ? Peut-on lancer une extraction en quelques clics ?

- Prise en charge multi-formats : texte, images, PDF, sous-pages — sait-il tout gérer ?

- Intégrations : exporte-t-il vers vos outils préférés (Excel, Sheets, Notion, Airtable) ?

- Planification : pouvez-vous programmer des tâches récurrentes pour garder des données toujours fraîches ?

- Assistance IA : propose-t-il des suggestions intelligentes de champs, l’enrichissement des données et l’adaptation automatique aux changements du site ?

- Sécurité & conformité : vos données et identifiants sont-ils protégés ? Aide-t-il à rester conforme aux lois sur la confidentialité ?

Thunderbit coche toutes ces cases, ce qui en fait une excellente option pour les équipes qui veulent de la puissance sans la complexité.

Premiers pas : comment utiliser un cloud crawler pour votre activité

Prêt à vous lancer ? Voici comment un utilisateur métier peut généralement démarrer avec un cloud crawler comme Thunderbit :

- Installez l’ : installation rapide, sans intervention IT.

- Choisissez votre cible : ouvrez le site, la liste ou le document que vous souhaitez extraire.

- Cliquez sur « AI Suggest Fields » : laissez l’IA de Thunderbit analyser la page et recommander les meilleures colonnes à extraire.

- Personnalisez si nécessaire : ajoutez, supprimez ou renommez les champs selon vos besoins.

- Sélectionnez le mode de scraping cloud : pour les gros volumes ou les sites complexes, passez en mode cloud pour une vitesse maximale.

- Lancez l’extraction : Thunderbit traitera jusqu’à 50 pages à la fois dans le cloud.

- Vérifiez et exportez : prévisualisez vos résultats, puis exportez vers Excel, Google Sheets, Notion ou Airtable.

- Programmez des tâches récurrentes : pour vos besoins continus, mettez en place des extractions planifiées — vos données se mettront à jour automatiquement ().

Conseil pro : commencez par une petite tâche pour vous faire la main, puis augmentez progressivement une fois à l’aise. Et n’hésitez pas à utiliser le support ou la documentation Thunderbit — ils sont là pour vous aider.

L’avenir de la collecte de données : quelle est la suite pour les cloud crawlers ?

La révolution des cloud crawlers ne fait que commencer. Voici ce que je surveille dans les prochaines années :

- Extraction IA plus intelligente : les cloud crawlers deviennent meilleurs pour comprendre le contexte, les relations et même le sentiment — ce qui rend les données collectées encore plus précieuses ().

- Prise en charge de nouveaux types de données : attendez-vous à une meilleure gestion de la vidéo, de l’audio et des contenus interactifs — pas seulement du texte et des images statiques.

- Automatisation plus poussée : de la planification automatique aux alertes en temps réel, les cloud crawlers deviendront encore plus autonomes pour les utilisateurs métier.

- Conformité renforcée : à mesure que les lois sur la vie privée évoluent, les cloud crawlers intégreront davantage d’outils pour aider les équipes à rester dans les clous.

- Intégration avec les outils BI et IA : des flux directs depuis les cloud crawlers vers les plateformes d’analyse, de tableaux de bord et de machine learning.

En bref, les cloud crawlers sont bien partis pour devenir la colonne vertébrale de la stratégie digitale des entreprises — en alimentant tout, des lancements produits aux prévisions boostées par l’IA ().

Conclusion : pourquoi les cloud crawlers sont indispensables aux entreprises modernes

Pour résumer : le web explose en volumes de données, et les anciennes méthodes de collecte ne peuvent plus suivre. Les cloud crawlers sont l’étape suivante — ils offrent une vitesse, une échelle et une intelligence que les extracteurs traditionnels ne peuvent tout simplement pas égaler. Des outils comme permettent à n’importe quelle équipe, technique ou non, d’exploiter tout le potentiel des données web — pour prendre de meilleures décisions, réagir plus vite et obtenir un vrai avantage concurrentiel.

Si vous êtes prêt à laisser de côté l’extraction manuelle et les données qui arrivent trop lentement, c’est le moment d’explorer ce qu’un cloud crawler peut apporter à votre entreprise. Essayez le mode de scraping cloud de Thunderbit et voyez à quel point la découverte de données moderne peut être simple — et puissante. Et si vous voulez aller plus loin, consultez le pour plus de guides, de conseils et d’exemples concrets.

FAQ

1. Qu’est-ce qu’un cloud crawler, simplement ?

Un cloud crawler est un outil basé sur le cloud qui découvre, extrait et analyse automatiquement de grandes quantités de données sur le web. Contrairement aux extracteurs traditionnels qui tournent sur votre appareil local, les cloud crawlers fonctionnent dans de puissants centres de données, ce qui permet une échelle et une vitesse considérables.

2. En quoi un cloud crawler est-il différent d’un extracteur web classique ?

Les cloud crawlers fonctionnent dans le cloud, traitent des milliers de pages en même temps, prennent en charge des types de données complexes (comme les images et les PDF) et ne nécessitent ni maintenance ni matériel local. Les extracteurs classiques sont limités par la puissance de votre appareil et conviennent mieux à des tâches plus petites et plus simples.

3. Quels sont les principaux avantages d’un cloud crawler ?

Les cloud crawlers offrent une collecte de données rapide et à grande échelle, prennent en charge les sites complexes, sont accessibles de partout et proposent des fonctionnalités avancées comme la planification et l’extraction alimentée par l’IA. Ils sont parfaits pour les entreprises qui ont besoin de données fraîches et exploitables rapidement.

4. Comment fonctionne le cloud crawler de Thunderbit pour les utilisateurs métier ?

Le cloud crawler de Thunderbit vous permet de configurer une extraction en quelques clics, sans code. Vous pouvez extraire des données de sites web, de PDF et d’images, les enrichir avec l’IA, puis les exporter directement vers Excel, Google Sheets, Notion ou Airtable. Il est conçu pour les non-techniciens qui veulent des résultats, pas de la complexité.

5. Le cloud crawling est-il sécurisé et conforme aux lois sur la protection des données ?

Oui, les principaux cloud crawlers comme Thunderbit utilisent des connexions chiffrées et les meilleures pratiques en matière de sécurité des données. Veillez toujours à n’extraire que des données publiques et à respecter les conditions d’utilisation des sites ainsi que les réglementations sur la vie privée.

Prêt à voir ce qu’un cloud crawler peut faire ? et commencez dès aujourd’hui à explorer la collecte de données à grande échelle, propulsée par le cloud.

En savoir plus