Si tu as déjà essayé de récupérer des données sur le web avec Python, tu connais sûrement la galère : tout roule, tu chopes des prix ou des contacts, puis d’un coup… ton script se fait griller, ton IP saute, et tu te retrouves devant une avalanche de CAPTCHA qui ferait craquer n’importe qui. En 2025, ce n’est plus juste un petit souci : c’est le quotidien de tous ceux qui bossent en vente, marketing ou opérations et qui misent sur les données publiques du web pour garder une longueur d’avance.

Le plus dingue ? Plus de sont causés par des défenses anti-bot comme les blocages d’IP et les CAPTCHA, et environ se cognent régulièrement à ces obstacles. Avec quasiment la moitié du trafic internet généré par des bots, les sites web sortent l’artillerie lourde pour se protéger. Mais pas de panique : que tu sois un pro de Python ou que tu cherches une solution express, je vais te montrer comment éviter les blocages, utiliser les proxies comme un chef, et même booster tes extractions avec des outils IA comme .

Extraire des Données sans Blocage en Python : Les Bases à Connaître

On commence simple. L’extraction web, c’est juste automatiser la collecte de données sur des sites. Python, c’est la star du domaine : bossent avec des outils Python. Mais les sites ne déroulent pas le tapis rouge aux robots. Pourquoi ? Trop de requêtes automatiques, ça peut saturer les serveurs, piquer du contenu ou filer un avantage à la concurrence.

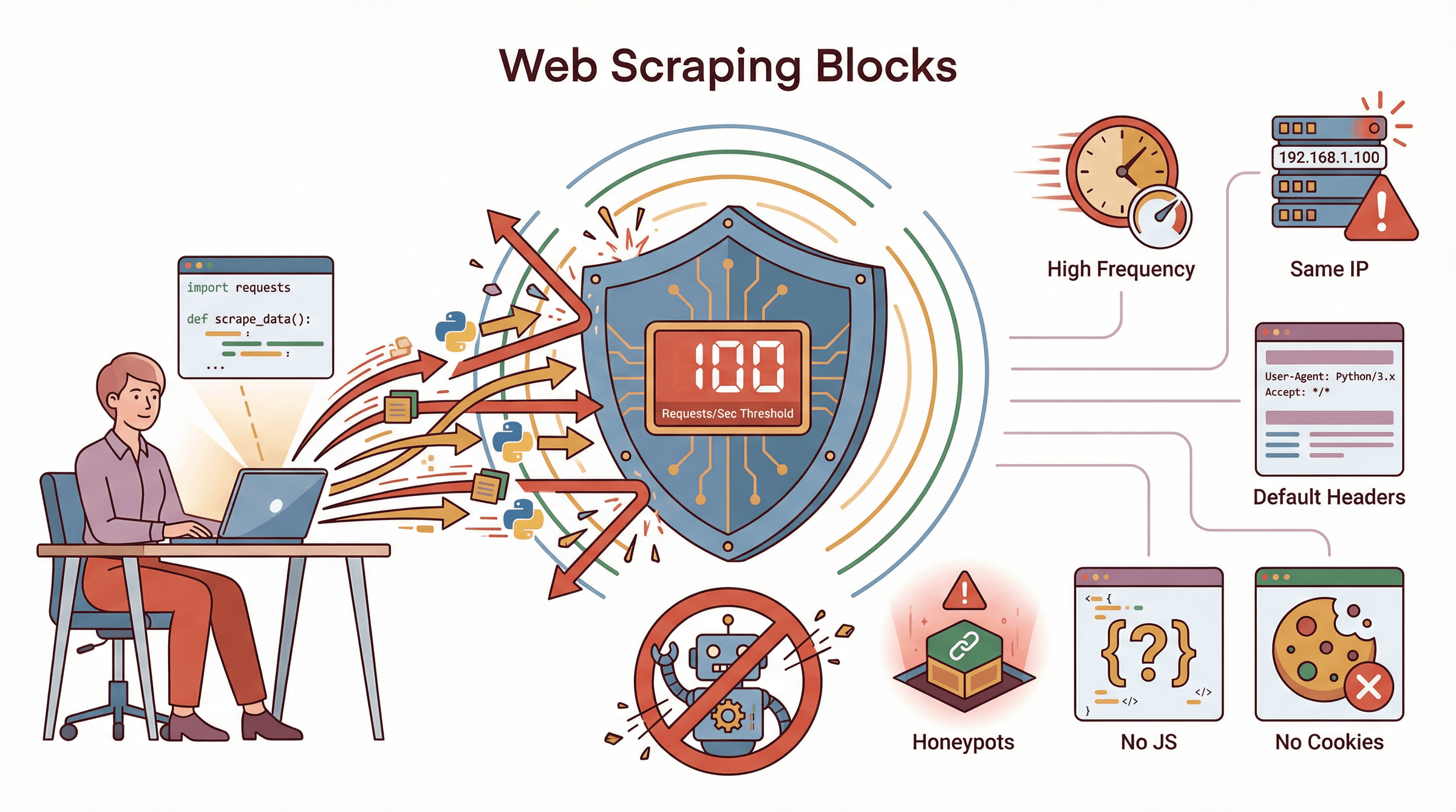

Comment les sites se protègent ? Voilà les techniques les plus répandues :

- Blocage d’IP & Limitation de débit : Trop de requêtes de la même IP ? Attends-toi à te faire bannir ou ralentir.

- CAPTCHA : Les fameux « prouvez que vous êtes humain » qui font rager tout le monde.

- Filtrage User-Agent et Headers : Si ton script s’annonce comme « python-requests/2.x », c’est grillé.

- Défis JavaScript & Empreinte Navigateur : Certains sites veulent du JavaScript ou vérifient ton navigateur en douce.

- Honeypots : Des liens ou champs cachés que seuls les bots vont activer.

Si tu fais pas gaffe, ton script Python va déclencher toutes ces alarmes plus vite que tu ne peux dire « 403 Interdit ».

Pourquoi Éviter le Blocage d’IP est Vital pour l’Extraction Web en Python

Se faire bloquer, ce n’est pas juste un souci technique : c’est un vrai risque business. Imagine ton équipe commerciale incapable de récupérer de nouveaux leads, ton analyste prix qui rate une baisse chez un concurrent, ou tes études de marché faussées par des données incomplètes. Ce n’est pas juste agaçant : ça peut coûter cher.

Regarde un peu plus en détail :

| Cas d’usage | Exemple de scénario | Risque en cas de blocage | Avantage d’une extraction fiable |

|---|---|---|---|

| Génération de leads | Extraire des contacts depuis des annuaires ou LinkedIn | Listes incomplètes, opportunités perdues | Flux continu de prospects à jour pour la prospection |

| Veille tarifaire | Suivi quotidien des prix concurrents | Données obsolètes, changements de prix manqués | Intelligence tarifaire en temps réel, réactivité accrue |

| Analyse concurrentielle | Collecte de détails produits ou d’avis | Manque de visibilité, lancements ratés | Vision complète du marché, stratégie optimisée |

| Études de marché & SEO | Agrégation de news, forums ou résultats de recherche | Analyses biaisées, perte de temps pour les analystes | Jeux de données complets et à jour pour l’analyse |

Pour , les données web sont tout simplement vitales.

Comment les Sites Repèrent et Bloquent l’Extraction Python : Les Pièges Classiques

Qu’est-ce qui fait qu’un extracteur Python se fait griller ? Voici les causes les plus fréquentes :

Qu’est-ce qui fait qu’un extracteur Python se fait griller ? Voici les causes les plus fréquentes :

- Trop de requêtes trop vite : Un humain ne visite pas 100 pages à la seconde. Si tu le fais, tu te fais repérer direct.

- Toujours la même IP : Toutes les requêtes du même endroit ? Surtout si ça vient d’un datacenter, c’est louche.

- Headers par défaut : Utiliser le user-agent Python ou zapper certains headers, c’est la signature du bot.

- Pas de cookies ou de sessions : Les vrais utilisateurs récupèrent des cookies en surfant. Les bots sans cookies, ça se voit.

- Ignorer le rendu JavaScript : Si ton extracteur gère pas le JS, tu risques de louper des données ou de te faire bloquer.

- Ignorer le robots.txt : Ce n’est pas un blocage technique, mais c’est un moyen rapide de se faire repérer.

- Honeypots : Cliquer sur des liens cachés ou remplir des champs invisibles ? Bannissement assuré.

Les erreurs classiques des débutants : bombarder les sites, pas faire tourner les proxies, oublier de varier les user-agents et les délais. J’ai vu des étudiants faire bannir toute la plage IP de leur fac du NASDAQ en envoyant des milliers de requêtes d’un coup. Oups.

Utiliser des Proxies pour l’Extraction Python et Éviter les Blocages d’IP

C’est là que les proxies entrent en scène : tes meilleurs potes contre les bannissements d’IP. Un proxy sert d’intermédiaire, il envoie tes requêtes via une autre IP. Pour le site, le trafic semble venir d’ailleurs.

Les Différents Types de Proxies

- Proxies Datacenter : Pas chers, rapides, mais faciles à repérer. Parfaits pour les extractions simples.

- Proxies Résidentiels : De vraies IP de particuliers, plus difficiles à bloquer, mais plus lents et plus chers.

- Proxies Rotatifs : L’IP change à chaque requête. Idéal pour l’extraction à grande échelle.

- Proxies Mobiles : Utilisent des IP d’opérateurs mobiles. Rarement nécessaires, sauf pour les sites les plus coriaces.

Pour la plupart des pros, les proxies résidentiels rotatifs sont le top : ils inspirent confiance et changent assez souvent pour éviter les blocages.

Intégrer des Proxies avec Requests, Selenium et Beautiful Soup en Python

Passons à la pratique. Voilà comment tu ajoutes des proxies à tes scripts Python :

Avec Requests :

1import requests

2proxy = "http://USERNAME:PASSWORD@PROXY_IP:PORT"

3proxies = {"http": proxy, "https": proxy}

4headers = {"User-Agent": "Mozilla/5.0 ..."}

5response = requests.get("https://target-website.com/data", proxies=proxies, headers=headers)

6html = response.textAvec Beautiful Soup :

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3data_items = soup.find_all('div', class_='item')Avec Selenium :

1from selenium import webdriver

2proxy = "PROXY_IP:PORT"

3chrome_options = webdriver.ChromeOptions()

4chrome_options.add_argument(f'--proxy-server=http://{proxy}')

5driver = webdriver.Chrome(options=chrome_options)

6driver.get("https://target-website.com")Pour les proxies rotatifs, il suffit de boucler sur une liste ou d’utiliser un service qui gère la rotation. Si un proxy plante, gère l’erreur et retente avec un autre.

Les Bons Réflexes pour Gérer et Faire Tourner les Proxies

- Avoir un gros pool : Plus tu as de proxies, mieux c’est. Fais tourner après chaque requête ou lot.

- Surveille la santé des proxies : Vire les proxies qui déconnent. Retente avec une nouvelle IP si ça plante.

- Ne surcharge pas un proxy : Répartis tes requêtes. Ne laisse pas une seule IP tout faire.

- Cible géographiquement : Utilise des proxies du même pays que ta cible si besoin.

- Mélange les types de proxies : Commence par des datacenter, passe aux résidentiels si tu te fais bloquer.

- Évite les proxies gratuits : Ils sont lents, pas fiables et souvent déjà blacklistés.

- Respecte les limites de ton fournisseur : Ne grille pas ton quota trop vite.

Gérer les proxies, c’est presque un art. Mais même la meilleure config ne suffit pas à elle seule.

Aller Plus Loin que les Proxies : Astuces de Ninja pour Éviter les Blocages en Python

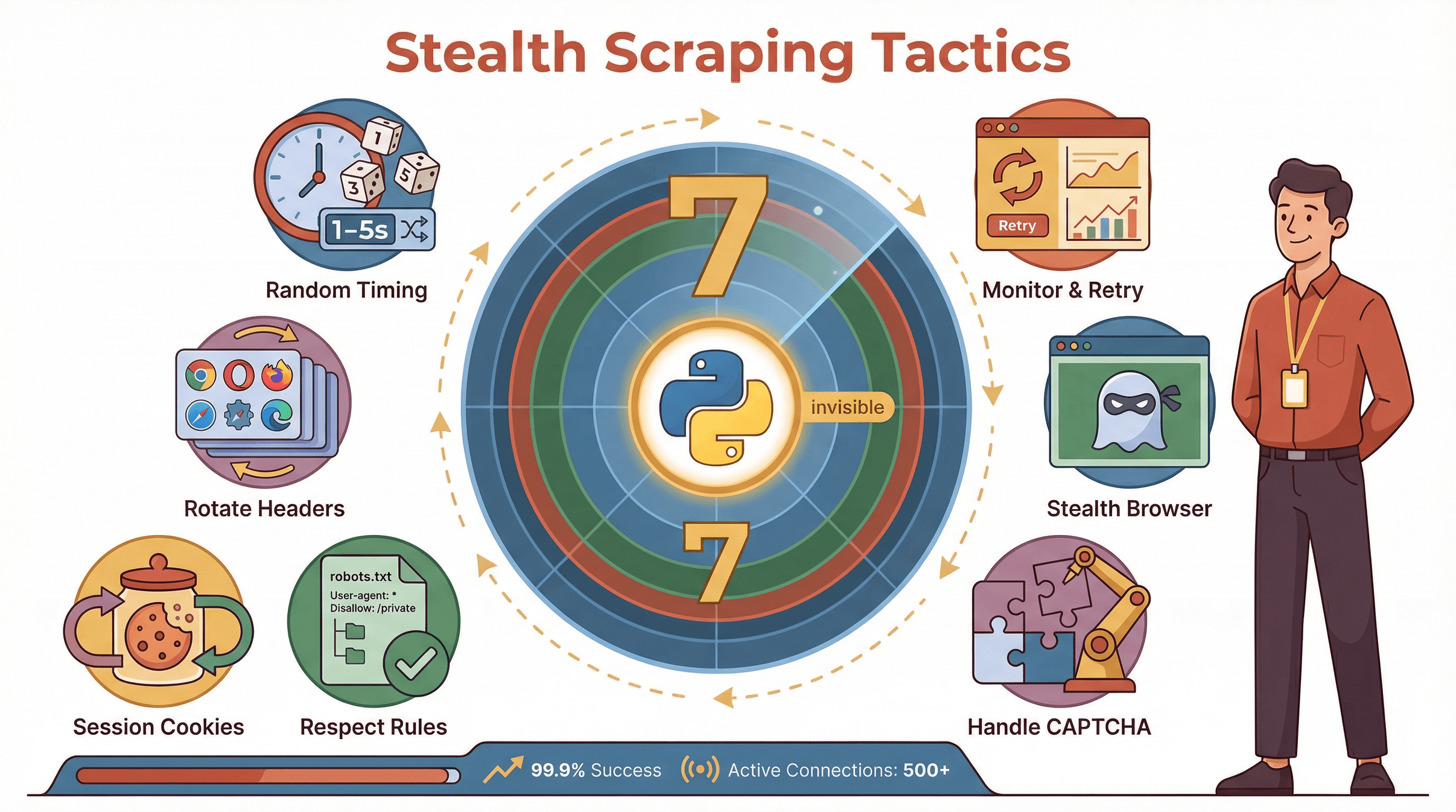

Tu veux vraiment passer sous les radars ? Combine ces astuces à ta stratégie proxy :

Tu veux vraiment passer sous les radars ? Combine ces astuces à ta stratégie proxy :

- Varie le timing des requêtes : N’envoie pas tes requêtes à intervalles fixes. Ajoute des pauses aléatoires (genre 1 à 5 secondes).

- Fais tourner les user-agents et headers : Utilise une liste de vrais user-agents de navigateurs. Varie Accept-Language, Referer, etc.

- Utilise sessions et cookies : Garde les cookies d’une requête à l’autre pour simuler une vraie navigation.

- Respecte le robots.txt et ralentis en cas d’erreur : Ne zappe pas les règles du site. Si tu reçois des erreurs 429 ou 503, ralentis.

- Gère les CAPTCHA : Intègre un service de résolution de CAPTCHA ou retente avec un nouveau proxy si besoin.

- Navigateurs furtifs sans interface : Utilise des outils comme undetected-chromedriver ou les plugins stealth de Playwright.

- Surveille et relance : Garde des logs, surveille les pics d’échecs, et relance automatiquement avec de nouveaux proxies.

Il existe d’excellentes bibliothèques Python pour ça : fake-useragent, requests.Session(), et les plugins de navigateurs furtifs sont tes alliés.

Passe à la Vitesse Supérieure : Outils IA vs. Méthodes Python Classiques avec Proxies

Là, ça devient vraiment cool. Et si tu pouvais zapper la gestion des proxies, la config des headers et les galères de blocage ? C’est exactement ce que propose .

Thunderbit, c’est une extension Chrome d’extraction web boostée à l’IA, qui te permet de collecter des données sur n’importe quel site en deux clics—pas de code, pas de proxy à configurer, pas de maintenance. Clique sur « Suggestion IA de champs », laisse l’IA repérer les données à extraire, puis lance l’extraction. Thunderbit gère tout : proxies, blocages, pagination, navigation sur les sous-pages, tout ça en arrière-plan.

Comparons les deux approches :

| Aspect | Extraction Python (Proxies) | Extracteur Web IA Thunderbit |

|---|---|---|

| Temps de mise en place | Plusieurs heures (code, proxies, parsing) | Quelques minutes (pointer, cliquer, terminé) |

| Compétences requises | Élevées (code, HTTP, proxies) | Faibles (accessible à tous) |

| Évitement des blocages | Manuel (rotation proxies, headers) | Automatisé (IA + gestion proxy intégrée) |

| Maintenance | Continue (mise à jour code, proxies) | Minime (IA s’adapte, modèles maintenus) |

| Pagination/Sous-pages | Code manuel nécessaire | Un clic, l’IA s’en charge |

| Export des données | Manuel (CSV, Excel via code) | Un clic vers Sheets, Excel, Notion, Airtable |

| Scalabilité | Dépend de votre infra/proxies | Élevée (cloud, pages parallèles) |

| Coût | Frais de proxy + temps de dev | Offre gratuite, puis abonnements abordables |

| Fiabilité | Variable (selon la config) | Élevée (optimisé pour les pros) |

Thunderbit est parfait pour les équipes non techniques ou tous ceux qui veulent des données, vite fait bien fait.

Pas à Pas : Extraire sans Blocage avec Thunderbit

Voilà comment j’utiliserais Thunderbit pour extraire des données d’un site qui bloque d’habitude les scripts Python :

- Installe l’extension Chrome Thunderbit : .

- Va sur le site cible : Connecte-toi si besoin—Thunderbit utilise ta session navigateur.

- Clique sur « Suggestion IA de champs » : Thunderbit analyse la page et propose les colonnes à extraire (genre « Nom », « Prix », « Email »).

- Clique sur « Extraire » : Thunderbit récupère les données dans un tableau structuré.

- Gère la pagination : Active « Extraire toutes les pages » et Thunderbit va tout chercher, page par page.

- Extraction sur sous-pages : Utilise « Extraire les sous-pages » pour visiter chaque fiche détail et enrichir tes données.

- Exporte : Un clic pour envoyer tes données vers Google Sheets, Excel, Notion ou Airtable.

Thunderbit s’occupe de toute la magie anti-blocage : rotation d’IP, gestion du rythme, résolution de petits CAPTCHA… Pour la plupart des pros, ça marche nickel.

Comment Thunderbit Gère la Pagination et les Sous-pages

Thunderbit ne s’arrête pas à la première page. Il peut :

- Scroller et cliquer comme un vrai utilisateur : Pour l’infinite scroll ou les boutons « page suivante », Thunderbit imite la navigation humaine.

- Garder la session : Si tu es connecté, Thunderbit garde ta session sur toutes les pages.

- Répartir la charge : En mode cloud, Thunderbit extrait plusieurs pages en même temps, chacune via une IP différente.

- Gérer le contenu dynamique : Thunderbit exécute le JavaScript, donc il récupère toutes les données, même celles chargées après coup.

- Extraction sur sous-pages : Thunderbit peut cliquer sur chaque fiche détail, extraire des infos en plus et les fusionner dans ton tableau principal.

Pour le site web, ça ressemble à de vrais utilisateurs qui surfent normalement—pas à une armée de bots.

Python + Proxies ou Thunderbit : Quel Choix pour les Pros ?

Alors, tu choisis quoi ? Voilà un résumé :

| Critère | Python + Proxies | Thunderbit |

|---|---|---|

| Rapidité | Mise en place plus lente | Résultats instantanés |

| Maintenance | Élevée (code, proxies) | Faible (IA, modèles mis à jour) |

| Compétences | Développeur | Accessible à tous |

| Risque de blocage | Moyen (si mal géré) | Faible (IA/automatisation proxy) |

| Coût | Frais proxies + dev | Gratuit, puis à partir de 15 €/mois |

| Idéal pour | Extraction complexe sur-mesure | Équipes commerciales, marketing, études |

Si tu es développeur, que tu veux tout personnaliser et garder la main, Python + proxies reste une super option. Mais pour la majorité des pros—surtout ceux qui veulent éviter la galère des proxies—Thunderbit est un vrai boost de productivité.

À Retenir : Extraire Plus Malin, Pas Plus Durement

Voilà ce que j’ai retenu (et que j’aurais aimé savoir plus tôt) :

- Les proxies sont incontournables pour éviter les blocages d’IP en Python, mais leur gestion, c’est du sport.

- Les techniques anti-blocage malignes (délais aléatoires, rotation des headers, sessions) font toute la différence.

- Les outils IA comme Thunderbit automatisent tout : proxies, anti-blocage, pagination, sous-pages, export… Tu peux te concentrer sur l’essentiel : la donnée.

- Choisis l’outil adapté à ton équipe : Pour la rapidité et la fiabilité, Thunderbit est imbattable. Pour les workflows sur-mesure, Python + proxies reste puissant.

Envie de voir à quel point l’extraction peut être simple ? et teste-le sur ton prochain projet. Pour plus d’astuces, va faire un tour sur le .

Bonne extraction—que tes IP restent libres et tes données toujours fraîches !

FAQ

1. Pourquoi les extracteurs Python se font-ils bloquer le plus souvent ?

La raison principale, c’est l’envoi de trop de requêtes depuis la même IP ou l’utilisation de headers par défaut qui trahissent le bot. Les sites repèrent vite ces schémas et bloquent l’accès.

2. Comment les proxies aident-ils à éviter le blocage d’IP en extraction Python ?

Les proxies font passer tes requêtes par différentes IP, ce qui donne l’impression que le trafic vient de plusieurs utilisateurs. Les proxies rotatifs sont particulièrement efficaces pour l’extraction à grande échelle.

3. Quelles sont les bonnes pratiques pour gérer les proxies en Python ?

Utilise un gros pool de proxies, fais-les tourner souvent, surveille les échecs, évite les proxies gratuits et adapte la localisation à celle du site cible. Varie toujours le timing et les headers de tes requêtes.

4. Comment Thunderbit évite-t-il les blocages sans config manuelle de proxies ?

Thunderbit automatise la rotation des proxies, le rythme des requêtes et les techniques anti-blocage en arrière-plan. Son agent IA imite le comportement humain, gère la pagination et les sous-pages, et exporte les données en un clic—aucune ligne de code à écrire.

5. Dois-je utiliser Python ou Thunderbit pour mes besoins d’extraction pro ?

Si tu es développeur avec des besoins complexes et sur-mesure, Python + proxies te donne de la flexibilité. Mais pour la plupart des équipes commerciales, marketing ou études qui veulent des données fiables et rapides sans prise de tête technique, Thunderbit est le choix le plus simple et efficace.

Prêt à extraire plus intelligemment ? et dis adieu aux blocages.

En savoir plus