Le web croît à un rythme franchement difficile à suivre — d’ici 2026, près de , et une énorme part de ce volume vient d’entreprises qui extraient des données pour alimenter leurs ventes, leurs opérations et leur veille concurrentielle. J’ai pu constater de première main à quel point le web scraping est passé d’un “plus” pour les techniciens à un indispensable absolu, que l’on travaille dans la vente ou dans l’immobilier. Mais voilà le piège : toutes les sociétés de web scraping ne se valent pas, et choisir la bonne peut faire la différence entre un flux de travail fluide et automatisé, et une semaine de copier-coller à répétition.

Alors, j’ai retroussé mes manches et creusé en profondeur pour identifier les meilleures entreprises de web scraping pour 2026. Que vous soyez un utilisateur non technique qui veut simplement des données en deux clics, ou un développeur à la recherche d’un contrôle total, cette liste réunit ce qui se fait de mieux — avec aussi un regard honnête sur les points forts de chacune… et leurs limites. Allons-y.

Pourquoi les entreprises ont besoin des meilleures sociétés de web scraping

Si vous avez déjà essayé de constituer une liste de prospects, de surveiller les prix des concurrents ou de récupérer des données produits sur des dizaines — voire des milliers — de pages, vous connaissez la douleur de la collecte manuelle. C’est lent, source d’erreurs et, soyons honnêtes, ce n’est l’idée de personne d’un bon moment. C’est pourquoi , avec des entreprises qui l’utilisent pour tout : , le suivi des prix, l’étude de marché ou encore l’analyse de sentiment.

La vraie magie ? L’automatisation. Les sociétés modernes de web scraping vous permettent de :

- Automatiser les recherches répétitives (finies les marathons de copier-coller)

- Passer à l’échelle jusqu’à des milliers de pages sans effort supplémentaire

- Intégrer les données directement dans vos outils préférés (Excel, Google Sheets, Notion, CRM)

- Garder une longueur d’avance sur vos concurrents grâce à des données plus fraîches et plus riches, plus rapidement

Mais avec autant d’options, comment choisir ? C’est là que ce guide entre en jeu.

Comment nous avons évalué les meilleures sociétés de web scraping

Tous les extracteurs ne sont pas conçus pour le même utilisateur — ni pour le même usage. Voici comment j’ai évalué le marché :

- Facilité d’utilisation : un non-développeur peut-il obtenir des résultats rapidement ? L’interface est-elle intuitive ?

- Automatisation et fonctionnalités : gère-t-il la pagination, les sous-pages, la planification et le contenu dynamique ?

- Scalabilité : peut-il gérer de gros projets ou convient-il mieux à des tâches modestes ?

- Intégration : à quel point est-il simple d’exporter ou de connecter les données à d’autres outils ?

- Tarification : existe-t-il une formule gratuite ? Est-ce abordable pour les PME et évolutif pour les grandes entreprises ?

- Support et communauté : y a-t-il des tutoriels, des modèles et une vraie aide quand vous en avez besoin ?

J’ai aussi regardé ce qui rend chaque société unique — car parfois, le “meilleur” outil est simplement celui qui s’adapte à votre flux de travail, et pas seulement celui qui affiche le plus de fonctionnalités.

Très bien, passons à la liste.

1. Thunderbit

est l’extracteur web dopé à l’IA qui m’enthousiasme le plus pour 2026 — et pas seulement parce que j’ai contribué à le construire ! Thunderbit est conçu pour les utilisateurs métier qui veulent des données, pas des migraines. Son extension Chrome vous permet d’extraire n’importe quel site web à l’aide de prompts en langage naturel et de suggestions de champs alimentées par l’IA. Pas de code, pas de modèles, pas de stress.

est l’extracteur web dopé à l’IA qui m’enthousiasme le plus pour 2026 — et pas seulement parce que j’ai contribué à le construire ! Thunderbit est conçu pour les utilisateurs métier qui veulent des données, pas des migraines. Son extension Chrome vous permet d’extraire n’importe quel site web à l’aide de prompts en langage naturel et de suggestions de champs alimentées par l’IA. Pas de code, pas de modèles, pas de stress.

Pourquoi Thunderbit se démarque :

- Extraction en 2 clics : il suffit de cliquer sur “AI Suggest Fields” puis “Scrape” — l’IA de Thunderbit s’occupe du reste.

- Gestion des sous-pages et de la pagination : extrayez facilement des listes, puis laissez l’IA visiter chaque sous-page pour obtenir plus de détails.

- Modèles instantanés : pour les sites populaires (Amazon, Zillow, Shopify, etc.), utilisez des modèles prêts à l’emploi pour une extraction en un clic.

- Exportation gratuite des données : exportez vers Excel, Google Sheets, Notion ou Airtable — sans paywall sur vos propres données.

- Enrichissement des données par IA : étiquetez, catégorisez et traduisez les données au fur et à mesure de l’extraction.

- Extraction planifiée et dans le cloud : configurez des tâches récurrentes ou lancez les extractions dans le cloud pour plus de rapidité.

- Offre totalement gratuite : extrayez jusqu’à 6 pages gratuitement, ou 10 avec le bonus d’essai. Les forfaits payants commencent à 15 $/mois.

Thunderbit est utilisé par plus de , des équipes commerciales aux opérateurs e-commerce. Si vous voulez l’expérience de web scraping la plus simple et la plus conviviale en 2026, Thunderbit est difficile à battre.

Vous voulez voir comment cela fonctionne ? et essayez-la par vous-même.

2. Scrapy

est le framework Python open source de référence pour les développeurs qui veulent un contrôle total. Il est puissant, flexible et éprouvé pour tout, du crawl de petits sites à l’extraction de millions de pages.

est le framework Python open source de référence pour les développeurs qui veulent un contrôle total. Il est puissant, flexible et éprouvé pour tout, du crawl de petits sites à l’extraction de millions de pages.

Idéal pour : les équipes techniques, les data engineers et toute personne à l’aise avec Python.

Fonctionnalités clés :

- Création de règles personnalisées : construisez des spiders capables de gérer n’importe quelle structure de site.

- Évolutif et rapide : gère l’extraction à grande échelle avec une gestion robuste des erreurs.

- Intégration à l’écosystème Python : connectez-le à Pandas, Jupyter, et bien plus.

- Gratuit et open source : pas de frais de licence, avec un énorme soutien communautaire.

À savoir : Scrapy a une courbe d’apprentissage. Si vous ne codez pas, mieux vaut regarder ailleurs. Mais pour les développeurs, c’est une machine de guerre ().

3. ParseHub

est une application de bureau qui rend le web scraping visuel et accessible. Son interface de type pointer-cliquer vous permet de créer des extracteurs sans écrire de code.

est une application de bureau qui rend le web scraping visuel et accessible. Son interface de type pointer-cliquer vous permet de créer des extracteurs sans écrire de code.

Idéal pour : les PME, les chercheurs et les non-développeurs qui veulent de la flexibilité.

Fonctionnalités clés :

- Flux de travail visuel : cliquez pour sélectionner les données et construisez la logique de pagination et de sous-pages.

- Planification dans le cloud : lancez des extractions selon un calendrier, même lorsque votre ordinateur est éteint.

- Options d’exportation : téléchargement en CSV, Excel ou JSON.

- Formule gratuite : 5 projets, jusqu’à 200 pages par exécution ; les forfaits payants commencent à 39 $/mois.

ParseHub est particulièrement apprécié pour l’extraction d’annonces, d’avis et de données e-commerce ().

4. Octoparse

est une plateforme de web scraping sans code, en glisser-déposer, pensée pour l’automatisation à grande échelle. Elle est idéale pour les équipes qui veulent mettre en place des tâches complexes sans écrire de scripts.

est une plateforme de web scraping sans code, en glisser-déposer, pensée pour l’automatisation à grande échelle. Elle est idéale pour les équipes qui veulent mettre en place des tâches complexes sans écrire de scripts.

Idéal pour : les équipes marketing, recherche et opérations.

Fonctionnalités clés :

- Flux de travail par glisser-déposer : créez visuellement des extracteurs, gérez le contenu dynamique et le défilement infini.

- Extraction et planification dans le cloud : exécutez des tâches dans le cloud, planifiez des opérations récurrentes.

- Rotation d’IP et anti-blocage : fonctions intégrées pour extraire des sites difficiles.

- Export vers Excel, Sheets, bases de données : intégration simple à votre flux de travail.

- Offre gratuite : jusqu’à 10 000 enregistrements/mois ; les forfaits payants commencent à 75 $/mois.

Octoparse est particulièrement apprécié pour sa rapidité et sa capacité à gérer des projets de grande ampleur ().

5. DataMiner

est une extension Chrome qui apporte le web scraping directement dans votre navigateur. Elle est parfaite pour des extractions rapides, basées sur des modèles, de tableaux, de listes et de sites simples.

est une extension Chrome qui apporte le web scraping directement dans votre navigateur. Elle est parfaite pour des extractions rapides, basées sur des modèles, de tableaux, de listes et de sites simples.

Idéal pour : les utilisateurs du quotidien, les équipes commerciales et toute personne qui vit dans Chrome.

Fonctionnalités clés :

- Place de marché de modèles : plus de 60 000 recettes prêtes à l’emploi pour les sites populaires.

- Extraction par pointer-cliquer : sélectionnez les données visuellement, sans code.

- Export vers Excel/Google Sheets : export en un clic.

- Formule gratuite : 500 pages/mois ; forfaits payants à partir de 19 $/mois.

DataMiner est très apprécié pour les tâches rapides et les utilisateurs non techniques ().

6. Import.io

est une plateforme de niveau entreprise, centrée sur la transformation du contenu web en données structurées pour l’analytics et la business intelligence.

est une plateforme de niveau entreprise, centrée sur la transformation du contenu web en données structurées pour l’analytics et la business intelligence.

Idéal pour : les entreprises ayant d’importants besoins en données et en intégration.

Fonctionnalités clés :

- Modèle de service managé : l’équipe d’Import.io peut concevoir et maintenir les extracteurs pour vous.

- Interface visuelle : créez des workflows d’extraction sans code.

- Accès API : intégrez directement les données extraites dans vos applications et tableaux de bord.

- Conformité et sécurité : contrôles de niveau entreprise, masquage des données personnelles, et plus encore.

Tarification : devis personnalisés, généralement à partir d’environ 299 $/mois ().

7. Apify

est une plateforme d’automatisation conviviale pour les développeurs, avec une immense place de marché d’“Actors” prêts à l’emploi (bots d’extraction) et la possibilité de créer des workflows personnalisés.

est une plateforme d’automatisation conviviale pour les développeurs, avec une immense place de marché d’“Actors” prêts à l’emploi (bots d’extraction) et la possibilité de créer des workflows personnalisés.

Idéal pour : les développeurs, les agences et les équipes qui veulent de la flexibilité.

Fonctionnalités clés :

- Place de marché d’Actors : extracteurs prêts à l’emploi pour les sites populaires, ou création du vôtre.

- Infrastructure cloud : exécutez des extractions à grande échelle, planifiez des tâches et intégrez des API.

- Intégration GitHub : automatisez les workflows et la CI/CD.

- Paiement à l’usage : crédits gratuits, puis facturation à la consommation ; forfaits payants à partir de 39 $/mois.

Apify convient aussi bien aux projets simples qu’aux projets complexes ().

8. Diffbot

utilise l’IA et les graphes de connaissances pour transformer du contenu web non structuré en données structurées et lisibles par machine. Voyez-le comme le “cerveau” du web scraping.

utilise l’IA et les graphes de connaissances pour transformer du contenu web non structuré en données structurées et lisibles par machine. Voyez-le comme le “cerveau” du web scraping.

Idéal pour : les entreprises, les chercheurs et toute personne ayant besoin d’une extraction automatisée à grande échelle.

Fonctionnalités clés :

- Extraction pilotée par l’IA : identifie automatiquement les articles, produits, organisations, et plus encore.

- Graphe de connaissances : accès via API au plus grand graphe de données web au monde.

- Enrichissement des données : récupérez des entités liées, des actualités et du contexte.

- API-first : intégrez-le aux outils BI et aux pipelines de données.

Tarification : à partir de 299 $/mois ().

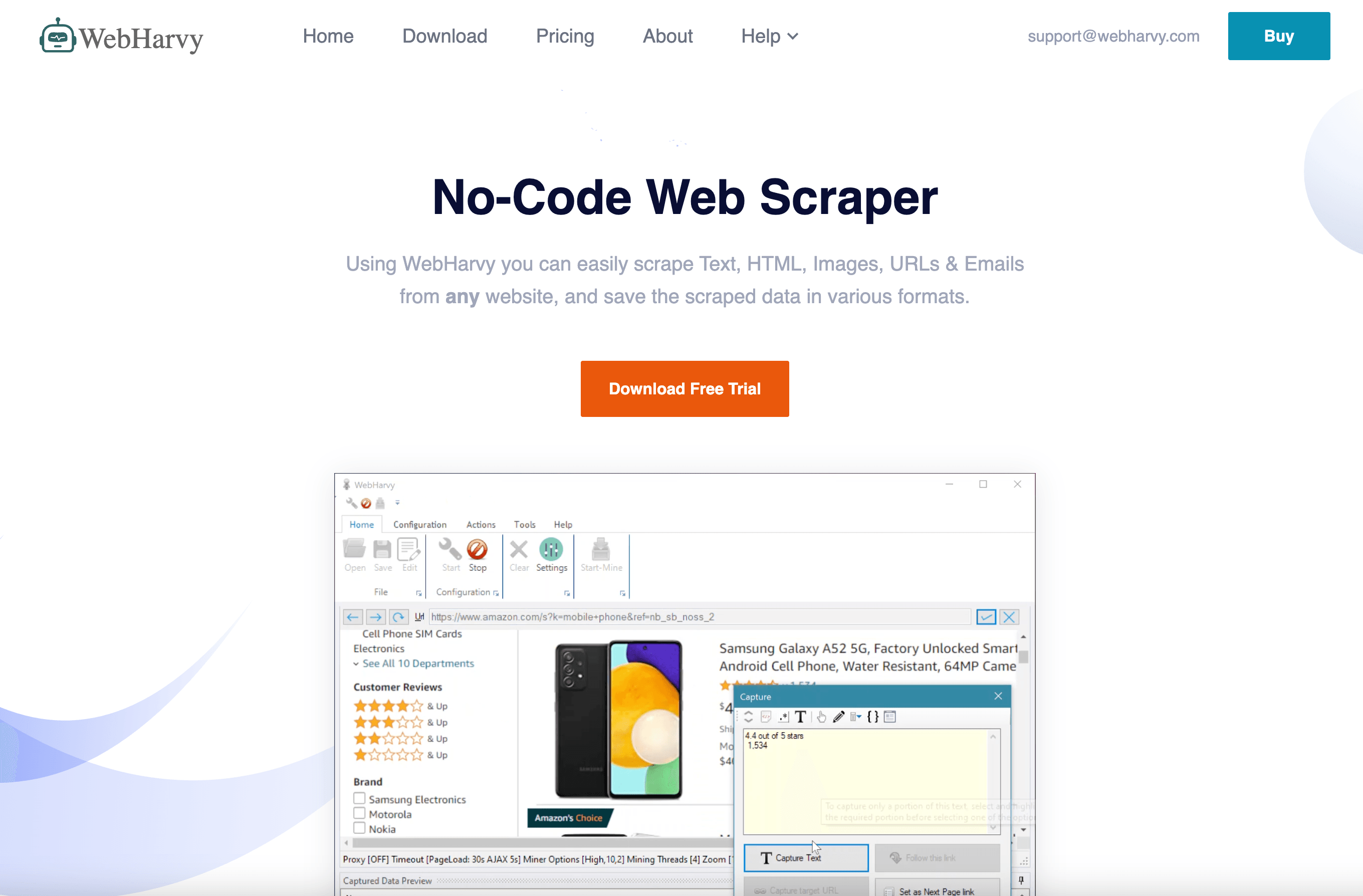

9. WebHarvy

est un extracteur de bureau sous Windows avec une interface visuelle de type pointer-cliquer. Il est parfait pour les utilisateurs qui veulent éviter le code et préfèrent une application de bureau.

est un extracteur de bureau sous Windows avec une interface visuelle de type pointer-cliquer. Il est parfait pour les utilisateurs qui veulent éviter le code et préfèrent une application de bureau.

Idéal pour : les utilisateurs Windows, les chercheurs et les PME.

Fonctionnalités clés :

- Sélection visuelle : cliquez sur les données pour définir les champs — sans code.

- Gestion des images et de la navigation multi-pages : extrayez du texte, des images et suivez la pagination.

- Export vers Excel, XML, bases de données : options de sortie flexibles.

- Licence unique : payez une fois, utilisez à vie ().

WebHarvy est particulièrement apprécié pour l’extraction de sites e-commerce et de petites annonces ().

10. Mozenda

est une plateforme cloud conçue pour l’extraction de données et l’automatisation à l’échelle de l’entreprise.

est une plateforme cloud conçue pour l’extraction de données et l’automatisation à l’échelle de l’entreprise.

Idéal pour : les grandes organisations et les secteurs à fortes contraintes de conformité.

Fonctionnalités clés :

- Automatisation cloud : planifiez, surveillez et gérez les tâches d’extraction de manière centralisée.

- Transformation des données : nettoyez, enrichissez et exportez les données dans plusieurs formats.

- Collaboration d’équipe : prise en charge de plusieurs utilisateurs et gestion des workflows.

- Support entreprise : conformité, fiabilité et assistance dédiée ().

Tarification : autour de 99 $/mois ; tarifs entreprise disponibles.

11. Sequentum

est un extracteur web/bureau avancé pour les professionnels de la donnée et les agences.

est un extracteur web/bureau avancé pour les professionnels de la donnée et les agences.

Idéal pour : les spécialistes de la donnée, les agences et toute personne ayant besoin d’une automatisation poussée.

Fonctionnalités clés :

- Scripting avancé : automatisez une logique d’extraction complexe.

- Reporting et surveillance : suivez les tâches, recevez des alertes et gérez de grands projets.

- Intégration : exportez vers des bases de données, des API ou du stockage cloud.

- Pas de formule gratuite : licences payantes uniquement ().

Sequentum est conçu pour une extraction personnalisable à très fort volume.

12. Helium Scraper

est un outil de bureau doté d’un générateur de workflow visuel, idéal pour extraire des données de sites complexes et dynamiques.

est un outil de bureau doté d’un générateur de workflow visuel, idéal pour extraire des données de sites complexes et dynamiques.

Idéal pour : les utilisateurs avancés, les analystes et toute personne qui veut de la flexibilité sans code.

Fonctionnalités clés :

- Workflow visuel : interface de glisser-déposer pour construire la logique d’extraction.

- Gestion du contenu dynamique : fonctionne avec les sites lourds en JavaScript.

- Transformation des données : nettoyez et organisez les données avant export.

- Options d’exportation : Excel, CSV, bases de données, et plus encore.

- Frais unique : environ 199 $ pour une licence perpétuelle ().

Helium Scraper est particulièrement adapté aux sites non standard et aux workflows personnalisés.

Comparer les meilleures sociétés de web scraping : aperçu des fonctionnalités

Voici un comparatif rapide côte à côte pour vous aider à choisir l’outil le plus adapté :

| Entreprise | Idéal pour | Facilité d’utilisation | Automatisation et IA | Scalabilité | Options d’exportation | Offre gratuite / Tarifs |

|---|---|---|---|---|---|---|

| Thunderbit | Non-développeurs, PME | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Excel, Sheets, Notion | Gratuit (6 pages), 15 $/mois+ |

| Scrapy | Développeurs | ⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | Python, CSV, BD | Gratuit, open source |

| ParseHub | PME, chercheurs | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | CSV, Excel, JSON | Gratuit (5 projets), 39 $+ |

| Octoparse | Opérations, marketing | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Excel, BD, API | Gratuit (10k lignes), 75 $+ |

| DataMiner | Utilisateurs Chrome | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ | Excel, Sheets | Gratuit (500 pages), 19 $+ |

| Import.io | Entreprises | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, BD, Cloud | Sur devis, 299 $+/mois |

| Apify | Dévs, agences | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, BD, Sheets | Crédits gratuits, 39 $+/mois |

| Diffbot | Recherche, analytics | ⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, graphe de connaissances | 299 $+/mois |

| WebHarvy | Utilisateurs Windows | ⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ | Excel, XML, BD | Paiement unique, 139 $+ |

| Mozenda | Entreprises | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | Excel, API, Cloud | 99 $+/mois, entreprise |

| Content Grabber | Pros de la donnée, agences | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | BD, API, Cloud | Licence payante uniquement |

| Helium Scraper | Utilisateurs avancés, analystes | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | Excel, CSV, BD | Paiement unique, 199 $ |

Choix rapides :

- Pour les non-développeurs : Thunderbit, DataMiner, ParseHub, WebHarvy

- Pour les développeurs : Scrapy, Apify, Content Grabber

- Pour les entreprises : Import.io, Diffbot, Mozenda

- Pour des workflows visuels et flexibles : Thunderbit, Octoparse, Helium Scraper

Conclusion : choisir le bon partenaire de web scraping pour votre entreprise

En 2026, le web scraping ne sera pas réservé aux techniciens — c’est une compétence métier essentielle pour toute personne qui a besoin de données pour prendre de meilleures décisions, plus vite. La bonne société de web scraping peut vous faire gagner des heures, augmenter votre ROI et révéler des insights que vos concurrents pourraient manquer.

Mon conseil :

- Faites correspondre l’outil à votre équipe : les utilisateurs non techniques adoreront Thunderbit ou DataMiner. Les développeurs devraient regarder du côté de Scrapy ou Apify. Pour les entreprises, tournez-vous vers Import.io ou Diffbot.

- Pensez à l’échelle et à l’intégration : devrez-vous extraire des milliers de pages ? Voulez-vous les données dans Sheets, Notion ou votre CRM ?

- Commencez par un essai gratuit : la plupart des outils proposent une offre gratuite — testez-les sur un vrai projet avant de vous engager.

- N’ayez pas peur de combiner plusieurs outils : parfois, le meilleur workflow repose sur une combinaison de quelques solutions.

Et si vous êtes prêt à voir à quel point le web scraping peut être simple, . Vos feuilles de calcul (et votre santé mentale) vous remercieront.

Pour aller plus loin, découvrir des astuces et des tutoriels, consultez le .

FAQ

1. Qu’est-ce que le web scraping et pourquoi est-il important pour les entreprises en 2026 ?

Le web scraping est le processus automatisé d’extraction de données à partir de sites web. Il est essentiel pour les entreprises, car il permet une collecte de données rapide et à grande échelle pour la génération de leads, le suivi des prix, l’étude de marché et bien plus encore — tout en faisant gagner du temps et en améliorant la prise de décision.

2. Quelle société de web scraping est la meilleure pour les utilisateurs non techniques ?

Thunderbit et DataMiner sont d’excellents choix pour les non-développeurs, grâce à leurs interfaces visuelles et pilotées par l’IA. Les deux permettent d’extraire des données en quelques clics, sans écrire de code.

3. Quelles fonctionnalités dois-je rechercher dans une société de web scraping ?

Privilégiez la facilité d’utilisation, l’automatisation (pagination, sous-pages, planification), la scalabilité, les options d’exportation (Excel, Sheets, API) et un bon support client. Choisissez un outil adapté à vos compétences techniques et à vos besoins métier.

4. Existe-t-il des solutions gratuites de web scraping ?

Oui ! Thunderbit, DataMiner, ParseHub et Octoparse proposent tous des offres gratuites. Scrapy est open source et gratuit pour les développeurs. Les formules gratuites sont idéales pour les petits projets ou pour tester avant de passer à l’échelle.

5. Comment rester conforme et éthique lors de l’extraction de données ?

Respectez toujours les conditions d’utilisation et les politiques de confidentialité des sites web. N’extrayez que des données publiquement accessibles, évitez de surcharger les sites et tenez compte des réglementations sur la confidentialité des données comme le RGPD. De nombreuses grandes sociétés de web scraping proposent des fonctionnalités de conformité et des guides de bonnes pratiques.

Prêt à commencer à extraire plus intelligemment ? ou explorez d’autres guides sur le .

En savoir plus