Si vous évaluez des outils de web scraping en 2026, vous ne cherchez généralement pas un cours de philosophie. Vous voulez une sélection fiable, un moyen rapide de distinguer les outils pensés pour les utilisateurs métier des stacks plus techniques, et suffisamment de preuves concrètes pour éviter d’acheter le mauvais outil. C’est précisément l’objectif de cette page.

Je suis Shuai Guan, cofondateur et CEO de . Je travaille tous les jours sur le scraping alimenté par l’IA et l’automatisation de navigateur, donc je m’intéresse moins aux classements génériques qu’à l’adéquation réelle : quels outils aident une équipe commerciale ou opérations à avancer cette semaine, lesquels s’intègrent à un workflow de développement, et lesquels ne prennent vraiment tout leur sens que lorsque l’échelle et l’infrastructure anti-bot deviennent le problème principal.

Réponse rapide

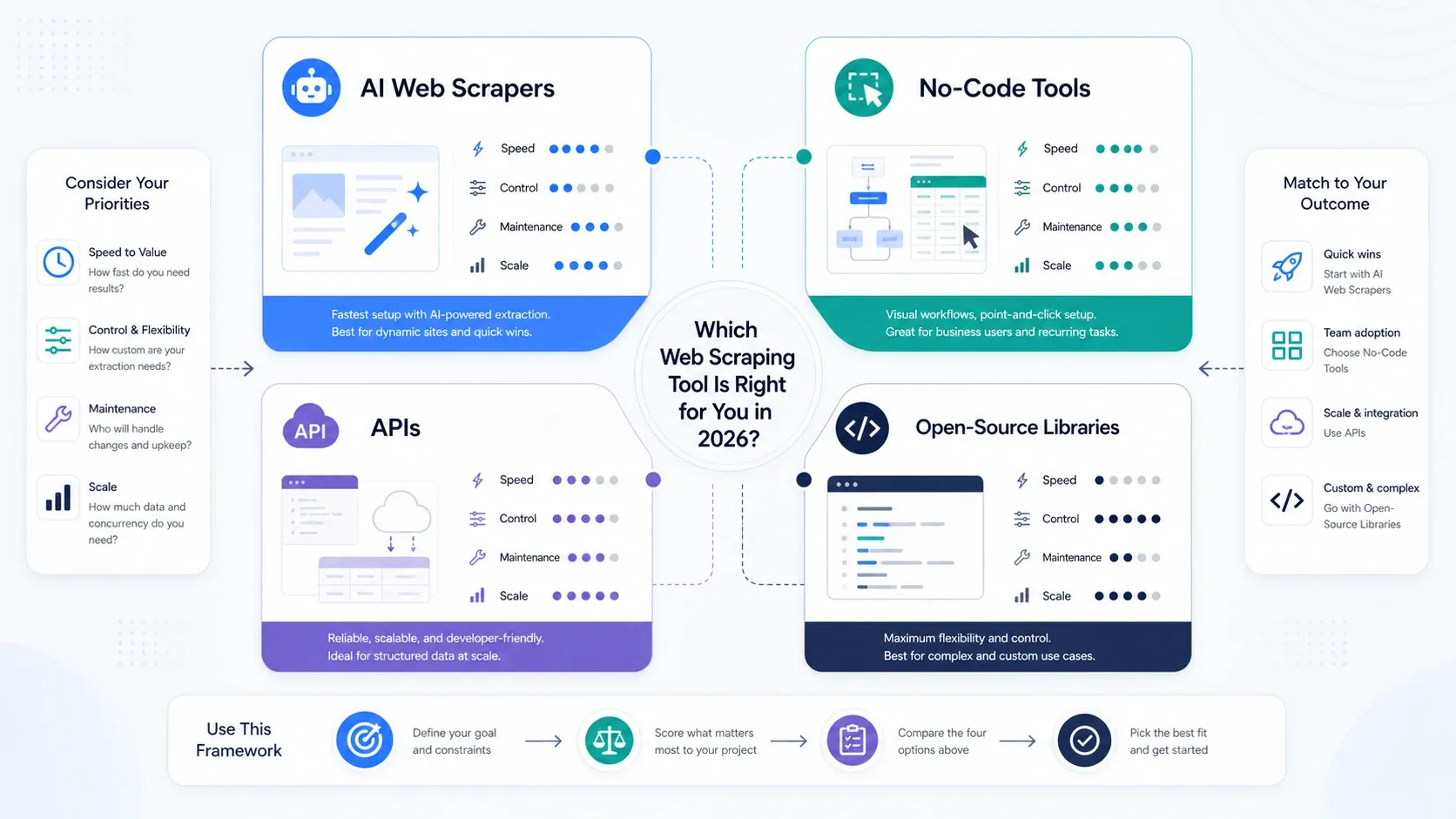

Si vous n’avez besoin que de la logique de choix, retenez ceci :

- Choisissez un extracteur Web IA si vous voulez le chemin le plus rapide du site web au tableur, avec un minimum de configuration.

- Choisissez un scraper no-code si vous avez besoin de plus de contrôle sur les tâches, de planification ou d’exécutions dans le cloud sans écrire de code.

- Choisissez une plateforme API si votre équipe a besoin de rendu, de rotation de proxies, de gestion anti-bot ou d’une intégration dans un produit interne.

- Choisissez une bibliothèque open source si vous voulez un contrôle total et que vous pouvez assumer la maintenance, les sélecteurs, l’infrastructure et les échecs.

Cet article conserve les 20 outils, mais la logique de recommandation est volontairement simple : commencez avec l’outil le plus léger capable de gérer votre workflow de manière fiable, puis descendez dans la pile uniquement lorsque la maintenance, le blocage ou l’échelle vous y obligent.

Tableau comparatif rapide : les meilleurs outils de web scraping en 2026

Les prix et modèles tarifaires ci-dessous ont été vérifiés sur les pages officielles des produits ou des tarifs le 7 mai 2026. Lorsque les fournisseurs utilisent une facturation à l’usage ou un devis enterprise personnalisé, je décris le modèle de tarification plutôt que de prétendre qu’il existe un prix affiché universellement fiable.

| Outil | Type | Cas d’usage idéal | Pourquoi il figure dans la liste 2026 | Modèle tarifaire (vérifié en mai 2026) |

|---|---|---|---|---|

| Thunderbit | Extracteur Web IA | Ventes, opérations, e-commerce, immobilier | Le chemin le plus rapide pour les non-développeurs ; suggestion de champs par IA, sous-pages, exports, workflow navigateur + cloud | Offre gratuite, abonnements payants, tarification entreprise personnalisée |

| Browse AI | Extracteur Web IA | Utilisateurs métier qui surveillent des sites web | Robots no-code puissants, surveillance et sorties de type tableur/API | Offre gratuite, abonnements payants, formule premium gérée |

| Bardeen | Automatisation IA + scraping | RevOps et workflows navigateur | Plus pertinent lorsque le scraping n’est qu’une étape d’un workflow d’automatisation plus large | Offre gratuite et abonnements payants |

| Diffbot | Plateforme d’extraction IA | Entreprise et équipes data | Le meilleur choix quand vous voulez une extraction IA et des workflows de données structurées à grande échelle | Tarification de type enterprise |

| Instant Data Scraper | Scraper navigateur léger | Utilisateurs occasionnels et extraction rapide de tableaux | Reste l’un des moyens les plus simples de récupérer rapidement une liste ou un tableau visibles vers CSV | Gratuit |

| Octoparse | Scraper no-code | Analystes et équipes ops avec des tâches récurrentes plus lourdes | Constructeur visuel mature avec extraction cloud, anti-blocage et modèles | Offre gratuite, payant à partir de 69 $/mois, entreprise sur devis |

| ParseHub | Scraper low-code | Analystes ayant besoin de logique et de contrôle sur desktop | Logique de projet flexible et navigation imbriquée, avec une courbe d’apprentissage plus raide que les outils IA plus récents | Offre gratuite et abonnements payants |

| Web Scraper | Scraper no-code | Débutants et tâches cloud légères | Bon point d’entrée si vous aimez le scraping basé sur sitemap et une configuration d’abord dans le navigateur | Extension gratuite, offres cloud payantes |

| Data Miner | Scraper navigateur | Chercheurs et growth operators | Reste utile pour une extraction rapide basée sur des recettes directement dans le navigateur | Offre gratuite et abonnements payants |

| Apify | Plateforme API + Actors | Équipes techniques et opérateurs hybrides | Excellent écosystème d’Actors et exécution personnalisée quand les extensions navigateur ne suffisent plus | Offre gratuite, formule starter à partir de 29 $/mois + usage, niveaux supérieurs payants |

| ScrapingBee | API de scraping | Développeurs qui extraient des sites riches en JavaScript | Bon choix quand vous voulez le rendu et la gestion des proxies sans construire vous-même la couche navigateur | Essai gratuit et abonnements payants |

| ScraperAPI | API de scraping | Développeurs qui veulent monter vite en volume | API simple, crédits d’essai, produits structurés et meilleure délégation de l’infrastructure | Essai de 7 jours avec 5 000 crédits, payant à partir de 49 $/mois |

| Bright Data | API entreprise + plateforme de proxies | Programmes à gros volume et très exigeants en conformité | Stack de collecte de données la plus large quand le déblocage, les proxies et l’acquisition gérée comptent plus que la simplicité | Tarification à l’usage et selon les produits |

| Oxylabs | API entreprise + plateforme de proxies | Équipes qui achètent le scraping comme infrastructure | Très solide pour la collecte à grande échelle, en particulier pour les prix, le SEO et les études de marché | Web Scraper API à partir de 49 $/mois ; les prix des autres proxies varient |

| Zyte | API + stack anti-bot | Équipes développeurs et data | Bon choix si vous voulez une extraction orientée API avec de solides briques de navigateur, de rotation et d’anti-détection | Essai avec 5 $ de crédit offert, engagements à l’usage |

| Selenium | Automatisation de navigateur open source | Automatisation de type QA et flux d’interaction complexes | Toujours utile quand la fidélité des interactions utilisateur compte davantage que le débit du scraper | Gratuit et open source |

| BeautifulSoup4 | Parseur open source | Débutants et parsing léger | Le meilleur usage est celui d’un parseur dans une pile simple, pas d’une plateforme de scraping complète | Gratuit et open source |

| Scrapy | Framework de crawling open source | Crawler personnalisés en production | Meilleur équilibre entre puissance et maturité si vous voulez gérer vous-même le pipeline | Gratuit et open source |

| Puppeteer | Automatisation de navigateur open source | Scraping orienté Node et scripts navigateur | Excellent si votre équipe est déjà à l’aise dans l’écosystème Chrome/Node | Gratuit et open source |

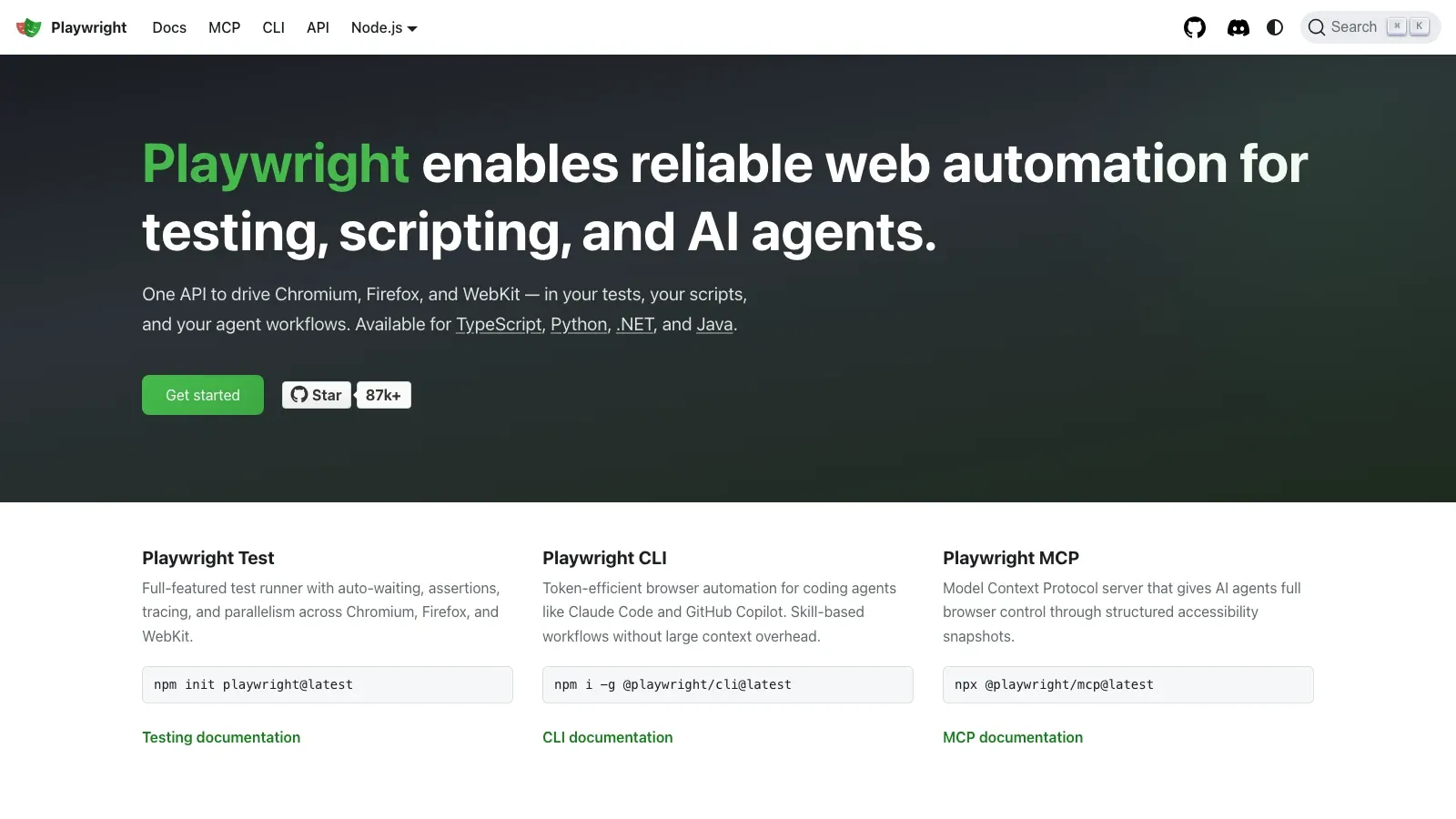

| Playwright | Automatisation de navigateur open source | Automatisation moderne multi-navigateurs | Souvent le choix le plus propre pour l’automatisation de navigateur moderne, avec une très bonne ergonomie développeur | Gratuit et open source |

Comment j’ai évalué ces outils

J’ai utilisé quatre filtres :

- Temps jusqu’au premier scraping réussi

Si un opérateur non technique ne peut pas obtenir rapidement des données utiles, cela compte. - Charge de maintenance

Une configuration rapide ne veut rien dire si le workflow casse à chaque changement du site. - Plafond d’échelle

Certains outils sont idéaux pour 50 pages par semaine et catastrophiques pour 5 millions de requêtes par mois. - Adéquation au workflow

Le meilleur outil pour une équipe RevOps est rarement le meilleur pour une équipe data platform.

Le résultat n’est pas un classement universel. C’est une page d’aide à la décision pour choisir d’abord la bonne catégorie d’outil, puis le bon produit dans cette catégorie.

De quel type d’outil de web scraping avez-vous vraiment besoin ?

- Choisissez des extracteurs Web IA si votre objectif principal est la rapidité opérationnelle.

- Choisissez des outils no-code si vous avez besoin de pagination, de planification et d’un contrôle répétable des tâches.

- Choisissez des API et plateformes de scraping si le rendu, la rotation et la capacité de déblocage sont désormais le goulot d’étranglement.

- Choisissez des bibliothèques open source si votre équipe valorise davantage le contrôle que la simplicité d’usage et peut supporter la pile en interne.

Si votre équipe hésite encore sur l’endroit où faire vivre le scraping — côté opérations ou côté ingénierie — commencez d’abord par un outil IA ou no-code. Vous apprendrez plus vite ce qui compte en lançant de vrais jobs qu’en surconcevant la stack dès le départ.

Meilleurs extracteurs Web IA pour les équipes métier

Voici les outils que j’examinerais en premier si le résultat recherché est une donnée prête à être placée dans un tableur, avec le moins de configuration possible.

1. Thunderbit

Thunderbit est ici l’option la plus simple si votre équipe veut extraire des données structurées sans apprendre les sélecteurs, les scripts navigateur ou l’infrastructure de scraping. Le workflow repose sur la suggestion de champs par IA, l’enrichissement des sous-pages et l’export direct vers les outils que les utilisateurs métier utilisent déjà.

- Idéal pour : ventes, opérations, e-commerce, immobilier et autres équipes qui travaillent beaucoup dans le navigateur.

- Ce qui le distingue : il réduit le temps de configuration mieux que n’importe quel autre outil de cette liste pour les non-développeurs.

- À surveiller : si vous avez besoin d’une logique de crawler très personnalisée ou d’un contrôle d’ingénierie hautement spécialisé, vous finirez par descendre dans la pile.

- Modèle tarifaire : offre gratuite, abonnements en libre-service et tarification entreprise.

2. Browse AI

Browse AI reste un excellent choix pour les utilisateurs métier qui veulent une configuration par clics et un suivi récurrent. Son modèle de robots est particulièrement utile lorsque le scraping et la détection de changements sont tout aussi importants.

- Idéal pour : surveiller les pages de prix, les pages concurrents et l’extraction répétable de listes.

- Ce qui le distingue : onboarding soigné, robots préconstruits et chemin clair du site web vers un tableur ou une sortie de type API.

- À surveiller : les jobs complexes à fort volume peuvent devenir coûteux ou opérationnellement peu pratiques plus vite que dans les stacks orientées API.

- Modèle tarifaire : offre gratuite, abonnements payants, niveau premium/géré.

3. Bardeen

Bardeen est surtout convaincant lorsque le scraping n’est qu’une action parmi d’autres dans un flux plus large d’automatisation de navigateur. Si vous transférez des données vers un CRM, un tableur ou des workflows outbound, son angle automatisation compte davantage que la profondeur brute du scraping.

- Idéal pour : RevOps, workflows de leads et automatisation native au navigateur.

- Ce qui le distingue : une histoire d’automatisation de workflow plus solide que celle des outils d’extraction pure.

- À surveiller : ce n’est pas le meilleur choix quand le scraping lui-même est complexe et critique.

- Modèle tarifaire : offre gratuite et abonnements payants.

4. Diffbot

Diffbot s’adresse aux équipes qui ont besoin d’une extraction IA à l’échelle enterprise, pas à celles qui cherchent la voie la moins chère ou la plus simple. Il prend davantage de sens lorsque la qualité des données structurées et l’ingestion à grande échelle priment sur le contrôle manuel.

- Idéal pour : équipes data d’entreprise, intelligence de contenu et grands programmes d’extraction.

- Ce qui le distingue : extraction de type vision par ordinateur et forte orientation vers les sorties structurées.

- À surveiller : trop lourd pour les petites équipes et peu adapté si votre cas d’usage est léger.

- Modèle tarifaire : offres de type enterprise et cycle commercial personnalisé.

5. Instant Data Scraper

Instant Data Scraper mérite encore sa place, car il existe de nombreux cas où vous avez simplement besoin, tout de suite, du tableau visible, de l’annuaire ou de la liste affichée. Ce n’est pas une plateforme, mais c’est souvent suffisant.

- Idéal pour : extraction ponctuelle, listes de leads rapides, annuaires simples et tableaux visibles.

- Ce qui le distingue : une friction quasi nulle sur les bonnes pages.

- À surveiller : automatisation limitée, profondeur limitée et faible adéquation aux workflows avancés.

- Modèle tarifaire : gratuit.

Meilleurs outils de web scraping no-code pour les tâches répétables

Dès que le travail devient plus qu’un scraping occasionnel, les constructeurs visuels et l’exécution dans le cloud commencent à compter.

6. Octoparse

Octoparse reste l’une des plateformes no-code les plus solides si vous avez besoin d’exécutions cloud, de couverture de modèles et d’une gestion des tâches plus sophistiquée que ce qu’une extension navigateur peut offrir.

- Idéal pour : analystes, équipes pricing et opérateurs qui lancent des collectes récurrentes.

- Ce qui le distingue : constructeur de tâches mature, extraction cloud, anti-blocage et vaste écosystème de modèles.

- À surveiller : c’est plus puissant que les outils navigateur d’abord orientés IA, mais cela implique aussi davantage de configuration.

- Modèle tarifaire : offre gratuite, payant à partir de 69 $/mois, entreprise sur mesure.

7. ParseHub

ParseHub reste pertinent pour les utilisateurs qui veulent davantage de contrôle qu’un scraper IA, sans pour autant écrire une base de code complète. Il récompense la patience, pas la vitesse.

- Idéal pour : analystes et opérateurs curieux techniquement, capables d’accepter une courbe d’apprentissage plus raide.

- Ce qui le distingue : logique de navigation flexible et meilleur contrôle que les outils navigateur légers.

- À surveiller : l’expérience produit paraît plus lourde que celle des entrants plus récents, surtout pour les équipes métier qui vont vite.

- Modèle tarifaire : offre gratuite et abonnements payants.

8. Web Scraper

Web Scraper reste une entrée de gamme raisonnable si vous aimez le modèle sitemap et voulez quelque chose qui démarre dans le navigateur, puis évolue plus tard vers la planification cloud.

- Idéal pour : débutants, projets de loisir et petites tâches récurrentes.

- Ce qui le distingue : workflow sitemap accessible et adoption facile d’abord dans le navigateur.

- À surveiller : il devient limitant dès que vous avez besoin d’une logique d’extraction plus adaptative.

- Modèle tarifaire : extension navigateur gratuite et offres cloud payantes.

9. Data Miner

Data Miner doit plutôt être compris comme un utilitaire d’extraction rapide que comme une plateforme de scraping complète. Il mérite néanmoins sa place, car le travail basé sur des recettes est très utile pour de nombreuses tâches de recherche et de prospection.

- Idéal pour : chercheurs, équipes growth et export rapide côté navigateur.

- Ce qui le distingue : modèle de recettes, faible friction et export facile depuis le navigateur.

- À surveiller : ce n’est pas l’outil adapté à un scraping de niveau plateforme.

- Modèle tarifaire : offre gratuite et abonnements payants.

Meilleures plateformes API lorsque l’échelle et le blocage deviennent le vrai problème

C’est le niveau où les équipes d’ingénierie cessent de se demander « comment scraper cette page ? » et commencent à se demander « comment rendre cela fiable à grande échelle ? »

10. Apify

Apify est la plateforme la plus flexible de ce groupe si vous voulez à la fois une marketplace de scrapers réutilisables et un environnement pour exécuter votre propre code. Elle fait le pont entre découverte no-code et exécution développeur mieux que la plupart de ses concurrents.

- Idéal pour : équipes hybrides, scraping piloté par les développeurs et workflows d’automatisation réutilisables.

- Ce qui le distingue : l’écosystème d’Actors plus un runtime personnalisé lui donnent une amplitude inhabituelle.

- À surveiller : dès que vous passez en mode custom, vous retournez dans le monde de l’ingénierie et l’avantage de simplicité s’estompe.

- Modèle tarifaire : offre gratuite, formule starter à partir de 29 $/mois + usage, niveaux d’utilisation supérieurs et enterprise.

11. ScrapingBee

ScrapingBee est un bon choix lorsque votre vrai besoin est : « donnez-moi une page rendue et gérez-moi l’infrastructure pénible ». Il convient bien aux cibles très riches en JavaScript.

- Idéal pour : développeurs qui extraient des sites dynamiques sans vouloir trop investir dans l’infrastructure.

- Ce qui le distingue : API simple autour du rendu, des proxies et de l’automatisation du navigateur.

- À surveiller : c’est un service d’infrastructure, donc vous gardez la responsabilité du parsing, de la logique de retry et de la qualité en aval.

- Modèle tarifaire : essai et abonnements payants.

12. ScraperAPI

ScraperAPI reste l’un des moyens les plus simples de déléguer la gestion des proxies et le taux de réussite des requêtes quand vous voulez monter en volume rapidement.

- Idéal pour : développeurs qui doivent passer vite du prototype au volume.

- Ce qui le distingue : API simple, crédits d’essai, produits structurés et paliers de montée en charge.

- À surveiller : comme tous les produits API-first, il ne supprime pas le besoin de jugement technique sur le parsing et la validation des données.

- Modèle tarifaire : essai de 7 jours avec 5 000 crédits, payant à partir de 49 $/mois.

13. Bright Data

Bright Data est l’option la plus lourde quand la capacité de déblocage, l’inventaire de proxies et l’acquisition gérée priment sur la simplicité de l’outil.

- Idéal pour : programmes enterprise, collecte à grande échelle sensible à la conformité et acquisition de données gérée.

- Ce qui le distingue : ampleur de l’offre proxies, scraper, browser et datasets.

- À surveiller : cher et facile à surdimensionner si votre workflow principal reste relativement simple.

- Modèle tarifaire : tarification à l’usage et selon les produits pour les API, proxies et services gérés.

14. Oxylabs

Oxylabs reste un très bon choix pour les équipes qui achètent le scraping comme infrastructure plutôt que comme outil navigateur. C’est particulièrement pertinent lorsque la fiabilité et la maturité des achats comptent.

- Idéal pour : collecte enterprise, surveillance des prix, surveillance SEO et études de marché.

- Ce qui le distingue : infrastructure robuste, profondeur des proxies et parcours d’achat plus clairement orienté enterprise.

- À surveiller : pas idéal si votre équipe veut un workflow libre-service très simple.

- Modèle tarifaire : Web Scraper API à partir de 49 $/mois ; les autres produits varient selon l’unité et l’usage.

15. Zyte

Zyte mérite encore une vraie considération de la part des équipes développeurs et data qui veulent la détection anti-bot, des actions navigateur, le rendu JavaScript et la rotation d’IP derrière une seule approche API-first.

- Idéal pour : équipes techniques qui construisent des systèmes d’extraction répétables.

- Ce qui le distingue : actions navigateur, rendu JavaScript, rotation d’IP et posture anti-bot dans une seule stack.

- À surveiller : mieux adapté aux équipes ayant la main sur l’ingénierie qu’aux opérateurs non techniques.

- Modèle tarifaire : essai avec 5 $ de crédit offert et engagements mensuels à l’usage.

Meilleures bibliothèques open source pour les développeurs qui veulent un contrôle total

Si vous voulez gérer la stack de scraping de bout en bout, voici les briques les plus utiles en 2026.

16. Selenium

Selenium reste utile lorsque vous avez besoin d’une fidélité d’interaction de type QA, de workflows d’automatisation de navigateur hérités ou d’un contrôle utilisateur très explicite.

- Idéal pour : automatisations riches en interactions, chevauchement avec la QA et sites où le comportement du navigateur compte plus que le débit de crawling.

- Ce qui le distingue : écosystème mature et large compatibilité navigateur.

- À surveiller : plus lourd et plus lent que les outils navigateur plus récents pour de nombreuses charges de scraping.

- Modèle tarifaire : gratuit et open source.

17. BeautifulSoup4

BeautifulSoup n’est pas une plateforme de scraping complète, mais cela reste l’un des moyens les plus simples de parser du HTML sale dans des workflows légers.

- Idéal pour : débutants, scripts rapides et tâches centrées sur le parsing.

- Ce qui le distingue : API simple et faible charge cognitive.

- À surveiller : associez-le à des outils de requête, de navigateur ou de crawler ; seul, ce n’est qu’un parseur.

- Modèle tarifaire : gratuit et open source.

18. Scrapy

Scrapy reste la meilleure réponse lorsque vous avez besoin d’un vrai framework de crawler plutôt que d’une poignée de scripts.

- Idéal pour : crawlers personnalisés en production et pipelines de données détenus en interne.

- Ce qui le distingue : hautes performances, pipelines, middleware et extensibilité sur le long terme.

- À surveiller : la charge d’ingénierie est réelle, et les cibles riches en JavaScript nécessitent souvent des outils complémentaires.

- Modèle tarifaire : gratuit et open source.

19. Puppeteer

Puppeteer reste un très bon choix pour les équipes Node-first qui veulent un contrôle direct de Chromium et des scripts navigateur.

- Idéal pour : scraping en Node, captures d’écran et tâches d’automatisation de navigateur.

- Ce qui le distingue : contrôle direct et puissant du comportement de Chromium.

- À surveiller : couverture navigateur plus limitée que Playwright et consommation de ressources encore élevée à grande échelle.

- Modèle tarifaire : gratuit et open source.

20. Playwright

Playwright est ma recommandation par défaut pour l’automatisation de navigateur moderne si votre équipe écrit du code et veut une abstraction plus récente que Selenium.

- Idéal pour : automatisation de navigateur moderne, sites riches en JavaScript et équipes qui attachent de l’importance à l’ergonomie développeur.

- Ce qui le distingue : modèle multi-navigateurs solide, comportement d’attente fiable et API propres.

- À surveiller : vous gardez la responsabilité de l’infrastructure navigateur, de la concurrence, des dérives de sélecteurs et de la validation des données.

- Modèle tarifaire : gratuit et open source.

Ma sélection par type d’équipe

- Équipes ventes et opérations : commencez avec Thunderbit, puis regardez Browse AI si la surveillance compte plus que l’enrichissement des sous-pages.

- Analystes et équipes de recherche : Octoparse en premier si les tâches récurrentes dépassent ce que les outils d’extension navigateur peuvent gérer confortablement.

- Équipes GTM très orientées automatisation : Bardeen si le scraping n’est qu’une étape d’un workflow plus large.

- Équipes développeurs qui construisent des outils internes : Apify, Zyte, ScraperAPI ou Playwright selon le niveau de maîtrise de la stack que vous souhaitez.

- Programmes data enterprise : Bright Data, Oxylabs, Diffbot et Zyte sont les vraies discussions d’infrastructure.

Quand descendre dans la pile

Appliquez cette règle :

- Restez sur des outils IA jusqu’à atteindre les limites de répétabilité ou de cas limites.

- Passez à des outils no-code lorsque la planification, la pagination, l’anti-blocage ou les exécutions cloud comptent plus que la simplicité en un clic.

- Passez aux API lorsque le taux de déblocage, le rendu JavaScript et la concurrence deviennent les vrais goulots d’étranglement.

- Passez aux bibliothèques open source lorsque le coût de l’abstraction d’un fournisseur devient supérieur au coût d’assumer toute la stack.

La plupart des équipes descendent dans la pile trop tôt. C’est l’une des erreurs les plus fréquentes que j’observe.

Conclusion

Pour la plupart des équipes non techniques, la bonne réponse en 2026 n’est pas « le scraper le plus puissant ». C’est l’outil qui permet d’acheminer des données exactes vers le workflow suivant avec le moins de maintenance possible. C’est pourquoi les outils IA continuent de gagner chez les opérateurs, tandis que les API et les stacks open source restent mieux adaptées aux équipes techniques ayant des besoins d’échelle clairement définis.

Si vous voulez le chemin le plus court de la page à une sortie structurée, commencez avec Thunderbit. Si vous savez déjà que votre travail exige une infrastructure lourde, passez directement aux couches API et développeur. Ne confondez simplement pas complexité et sophistication.

FAQ

1. Quel est le meilleur outil de web scraping pour les utilisateurs non techniques en 2026 ?

Pour la plupart des utilisateurs non techniques, des outils orientés IA comme Thunderbit et Browse AI offrent le chemin le plus rapide vers des données utiles, car ils réduisent le travail sur les sélecteurs, la friction de configuration et la charge de maintenance.

2. Que choisir si mes sites sont riches en JavaScript ou bloquent agressivement les requêtes ?

Orientez-vous vers ScrapingBee, ScraperAPI, Zyte, Bright Data, Oxylabs, Playwright ou Selenium selon que vous voulez un service géré ou un contrôle d’ingénierie direct.

3. Les outils no-code sont-ils encore pertinents maintenant que les extracteurs Web IA sont meilleurs ?

Oui. Les outils no-code comme Octoparse et ParseHub restent importants lorsque vous avez besoin d’un contrôle plus explicite sur la logique des tâches, l’exécution cloud et la gestion répétable des jobs.

4. Quels outils conviennent le mieux aux équipes d’ingénierie ?

Apify, Zyte, ScraperAPI, Scrapy, Playwright, Puppeteer et Selenium sont les choix les plus naturels lorsque les développeurs possèdent le workflow.

5. Comment faire une sélection rapide sans trop de recherche ?

Commencez par choisir le type d’outil, pas le fournisseur. Décidez si vous avez besoin de la simplicité de l’IA, du contrôle no-code, de l’infrastructure API ou de la propriété open source. Puis comparez les produits à l’intérieur de cette couche.

Lectures associées