Les images sont partout — galeries produits, annonces immobilières, catalogues de la concurrence. Si vous travaillez dans la vente, le marketing ou la recherche, vous avez sans doute déjà eu besoin de récupérer des dizaines, voire des centaines d’images depuis des sites web.

Personne n’a envie de faire clic droit > enregistrer pour 500 images. C’est précisément le rôle des outils de scraping d’images.

J’ai testé 10 solutions chez — des extensions de navigateur aux bibliothèques Python. Voici ce qui fonctionne le mieux selon les besoins.

Pourquoi vous avez besoin d’un Scraper d’images en 2026

Le contenu visuel n’est pas qu’un simple habillage : c’est aussi un levier de veille business. Les publications avec images obtiennent jusqu’à , et l’engagement sur les réseaux sociaux peut grimper de quand on ajoute des visuels. Les entreprises extraient des images pour tout : étude de marché (repérer les tendances dans les catalogues concurrents), création de contenu (constituer une banque d’images produit) et même entraînement de l’IA (alimenter les modèles avec des photos étiquetées).

Mais voilà le problème : les sites web deviennent de plus en plus difficiles à exploiter. Les images se chargent dynamiquement, se cachent derrière un défilement infini ou se nichent dans des sous-pages. Le téléchargement manuel est lent, source d’erreurs et, soyons honnêtes, épuisant. Et pour les équipes non techniques, écrire un crawler sur mesure relève presque de la science-fiction.

C’est là que les outils modernes de scraping d’images entrent en jeu. Ils automatisent les tâches répétitives, gèrent les sites complexes et permettent à n’importe qui — oui, même à votre collègue qui dit « je n’utilise qu’Excel » — de collecter des images à grande échelle. Le marché des logiciels de web scraping est en plein essor et devrait , tandis que plus de utilisent désormais le web scraping pour obtenir des informations métier. En clair ? Si vous n’utilisez pas un scraper d’images, vous êtes déjà en retard.

Comment nous avons choisi les meilleurs outils de scraping d’images

Tous les scrapers d’images ne se valent pas. Voici les critères que j’ai retenus pour sélectionner le top 10 :

- Facilité d’utilisation : une personne non développeuse peut-elle obtenir des résultats en quelques minutes ? Les commandes en langage naturel, les interfaces par clic et les retours instantanés sont de vrais atouts.

- Options d’export : l’outil permet-il de télécharger les images ou leurs URL vers Excel, Google Sheets, Notion ou via API ? L’intégration est essentielle dans les workflows métier.

- Personnalisation et flexibilité : sait-il gérer les connexions, le contenu dynamique ou une logique d’extraction personnalisée ? Les utilisateurs avancés ont besoin de plus qu’un simple « Enregistrer sous ».

- Automatisation et planification : peut-on le configurer une fois puis l’oublier ? Les extractions programmées et le traitement dans le cloud sont de véritables sauveurs pour les tâches récurrentes.

- Scalabilité : tiendra-t-il le coup sur 10 000 images ? Les outils doivent savoir gérer aussi bien les petits que les très gros volumes.

- Prix et rapport qualité-prix : existe-t-il une offre gratuite ? Le coût est-il adapté aux petites équipes ou vise-t-il plutôt les budgets d’entreprise ?

Avec cela en tête, voici les 10 meilleurs outils de scraping d’images à considérer en 2026 — chacun avec ses forces, ses particularités et ses cas d’usage idéaux.

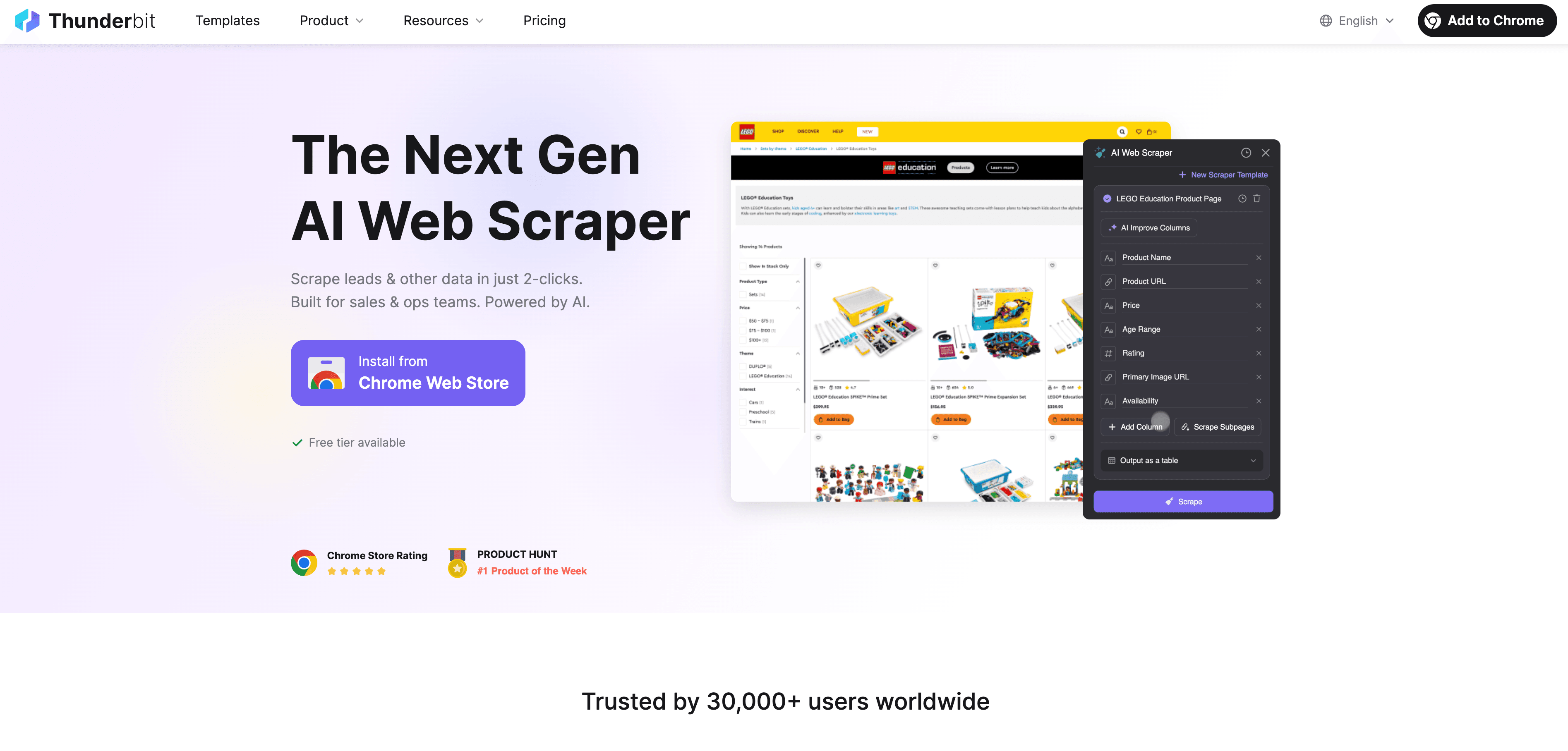

1. Thunderbit

est mon outil de prédilection pour les équipes non techniques et pour toute personne qui veut extraire des images avec le moins de friction possible. En tant que cofondateur, je manque peut-être d’objectivité — mais notre mission a toujours été de rendre le web scraping si simple que même votre grand-mère pourrait s’en servir (en supposant qu’elle aime l’analyse concurrentielle).

Qu’est-ce qui distingue Thunderbit ? Tout repose sur la simplicité. Il suffit de cliquer sur « AI Suggest Fields », de laisser l’IA détecter toutes les images (et toutes les autres données souhaitées), puis d’appuyer sur « Scrape ». Thunderbit navigue automatiquement dans les sous-pages, gère le défilement infini et exporte les images directement vers Excel, Google Sheets, Airtable ou Notion. Vous pouvez même utiliser gratuitement l’ pour extraire chaque image d’une page en un clic — aucune configuration, aucun code.

Fonctionnalités clés :

- Extraction d’images en 2 clics (l’IA fait le gros du travail)

- Scraping de sous-pages (récupérez automatiquement les images des pages de détail)

- Extracteurs gratuits d’images, d’emails et de numéros de téléphone

- Export instantané vers Sheets, Notion, Airtable, Excel, CSV ou JSON

- Offre gratuite (6 pages, lignes illimitées), offres payantes à partir de 15 $/mois

- Prise en charge multilingue (34 langues)

- Aucune maintenance — l’IA s’adapte aux changements du site

Idéal pour : les équipes commerciales, marketing et opérations qui veulent des données d’images rapides et fiables, sans code ni configuration. Parfait pour cataloguer des produits concurrents, collecter des photos immobilières ou construire des bibliothèques de contenu.

Pour en savoir plus sur la comparaison entre Thunderbit et les autres solutions, consultez notre .

2. ParseHub

est une solution puissante pour les utilisateurs qui doivent extraire des images de sites complexes et dynamiques — pensez au défilement infini, aux galeries chargées en AJAX ou aux sites qui exigent de cliquer à travers des filtres et des fenêtres contextuelles.

Pourquoi ParseHub se démarque : son éditeur visuel de workflows vous permet de modéliser une logique d’extraction en plusieurs étapes sans écrire de code. Vous pouvez ajouter des conditions, des boucles et même des variables pour gérer les sites difficiles. ParseHub peut interagir avec des formulaires, cliquer sur des boutons et extraire des images qui n’apparaissent qu’après certaines actions.

Fonctionnalités clés :

- Éditeur visuel avec logique avancée (conditions, boucles)

- Gère le contenu dynamique et fortement dépendant de JavaScript

- Planification dans le cloud et accès API

- Rotation automatique des IP pour éviter les blocages

- Export vers CSV, JSON et intégration avec Tableau

Idéal pour : les analystes de données, journalistes ou chercheurs qui extraient des sites complexes et veulent un contrôle fin sans coder. Une offre gratuite existe (jusqu’à 200 pages par exécution), mais les utilisateurs intensifs préféreront le plan à 189 $/mois pour le cloud et les volumes supérieurs.

3. Octoparse

est le champion du no-code pour l’extraction massive d’images. Son interface proche d’un tableur et sa détection automatique le rendent très accessible aux utilisateurs non techniques.

Pourquoi Octoparse est populaire : il suffit de pointer et cliquer sur une image ou une liste, et l’IA d’Octoparse vous suggère quoi extraire. Il gère particulièrement bien la pagination, le défilement infini et les pages nécessitant une connexion. Le scraping dans le cloud et la planification sont disponibles sur les offres payantes, ce qui permet d’exécuter de gros volumes sans monopoliser votre ordinateur.

Fonctionnalités clés :

- Configuration no-code par clic

- Détecte automatiquement les listes et les images

- Gère la pagination, le défilement infini et les connexions

- Scraping et planification dans le cloud

- Export vers CSV, Excel, JSON et bases de données

Idéal pour : les équipes marketing, les petites entreprises ou toute personne ayant besoin d’extraire rapidement beaucoup d’images sans coder. Offre gratuite pour les petits projets ; offres payantes à partir de 119 $/mois.

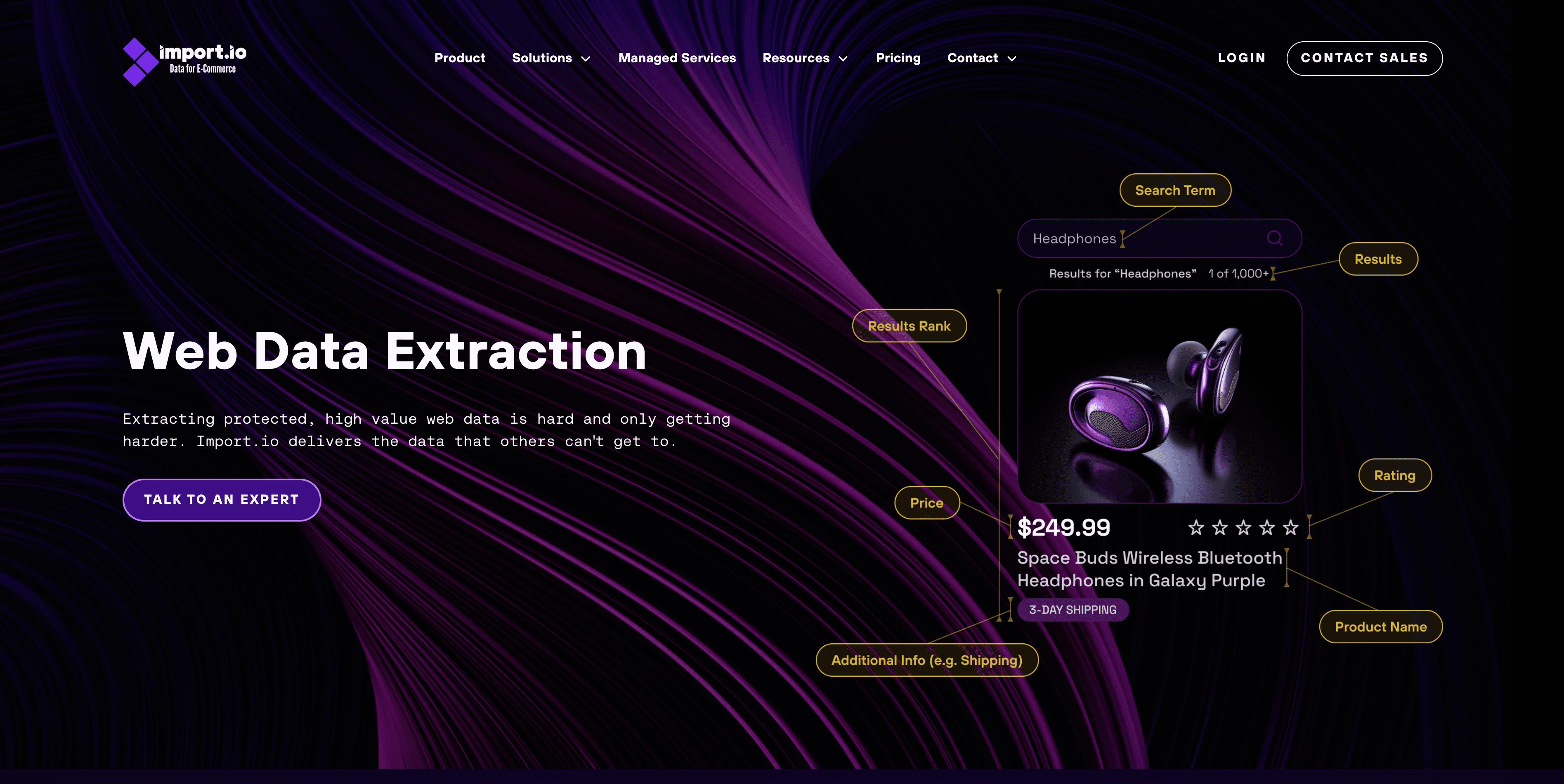

4.

est une plateforme d’extraction de données de niveau entreprise qui fait aussi office de scraper d’images robuste. Son interface interactive permet d’enregistrer des workflows (comme se connecter, filtrer et parcourir des galeries), puis de les exécuter à grande échelle dans le cloud.

Ce qui distingue : l’outil est pensé pour l’intégration — les images et les données extraites peuvent alimenter directement des tableaux de bord d’analyse, des outils BI ou des bases de données via API et webhooks. gère également très bien les contenus protégés ou dynamiques.

Fonctionnalités clés :

- Enregistreur de workflow interactif

- Gère les connexions, les contenus dynamiques et les pages protégées

- Intégration API/webhook pour les workflows d’analyse

- Services managés pour les clients entreprise

Idéal pour : les entreprises de taille moyenne à grande ayant besoin d’une extraction d’images fiable et scalable dans le cadre d’un pipeline de données plus large. Les tarifs commencent autour de 299 $/mois, avec un essai gratuit disponible.

5. Apify

est une plateforme d’automatisation pensée pour les développeurs, avec une place de marché d’« Actors » prêts à l’emploi (scrapers préconstruits) et la possibilité de coder les vôtres en Node.js ou Python.

Pourquoi Apify est flexible : vous pouvez trouver un Actor pour des sites courants (comme Instagram ou Amazon) ou construire un scraper sur mesure pour tout autre besoin. L’infrastructure cloud d’Apify gère la planification, la gestion des proxy et la montée en charge — vous pouvez donc scraper des milliers de pages en parallèle.

Fonctionnalités clés :

- Place de marché d’Actors (scrapers préconstruits pour les sites populaires)

- Scripts personnalisés en Node.js/Python

- Planification et stockage dans le cloud

- Intégration API robuste

Idéal pour : les développeurs, startups ou data engineers qui veulent un scraping programmable et scalable. Offre gratuite pour un usage léger ; offres payantes à partir de 49 $/mois.

6. Mozenda

est une solution de niveau entreprise axée sur l’extraction de données structurées, y compris les images, fichiers et PDF. Son interface par clic reste accessible, mais sa vraie force réside dans l’automatisation, la planification et la gestion d’équipe.

Pourquoi Mozenda est prêt pour l’entreprise : l’outil est conçu pour la fiabilité — planification robuste, notifications et automatisation des workflows. Mozenda peut fusionner des données provenant de plusieurs sources, exporter dans différents formats et même fonctionner sur site pour les projets sensibles.

Fonctionnalités clés :

- Créateur visuel d’agents (sans code)

- Gère les sites complexes, les données à plusieurs niveaux et les images

- Planification, notifications et automatisation des workflows

- Collaboration d’équipe et services managés

Idéal pour : les grandes organisations ou les équipes ayant des besoins récurrents et critiques en matière de scraping. Les tarifs commencent autour de 99 $/mois, avec des offres entreprise personnalisées.

7. VisualScraper

est un outil léger et convivial pour les tâches rapides de scraping d’images. Son interface est minimaliste : pointer, cliquer, extraire.

Pourquoi VisualScraper est pratique : il est parfait pour les petits projets ou les besoins ponctuels. Vous pouvez planifier des tâches, exporter vers CSV/JSON/XML et même recevoir les résultats par email ou FTP. Il n’a pas la puissance des grands acteurs, mais pour des besoins simples, difficile de battre sa simplicité — ni son prix, puisqu’il est gratuit pour la plupart des utilisateurs.

Fonctionnalités clés :

- Interface simple par clic

- Aperçu des données en temps réel

- Planification et export multi-format

- Application Windows gratuite pour les petits projets

Idéal pour : les particuliers, les passionnés ou les petits entrepreneurs qui doivent extraire des images de temps en temps, sans courbe d’apprentissage.

8. WebHarvy

est un scraper visuel sous Windows connu pour sa détection intelligente des motifs. Cliquez sur une image, et WebHarvy trouvera et extraiera automatiquement toutes les images similaires sur la page.

Pourquoi WebHarvy est malin : il gère le scraping multi-niveaux (par exemple récupérer les images de galerie sur des pages produit), remplir des formulaires, cliquer sur des boutons et même exécuter du JavaScript personnalisé pour les sites délicats. C’est un achat unique, donc pas d’abonnement mensuel.

Fonctionnalités clés :

- Reconnaissance intelligente des motifs

- Scraping d’images de galerie et multi-niveaux

- Export vers Excel, CSV, JSON, SQL

- Licence à vie (sans abonnement)

Idéal pour : les non-programmeurs qui veulent un bon équilibre entre simplicité et fonctionnalités avancées, en particulier sous Windows. Très utile pour les chercheurs et les petites entreprises.

9. Diffbot

est le cerveau IA de l’extraction de données web. Donnez-lui une URL (ou un million), et sa vision par ordinateur ainsi que son NLP identifieront et extraieront toutes les images principales — sans règles ni sélecteurs.

Pourquoi Diffbot est unique : l’outil est centré sur l’API, extrêmement scalable et résistant aux changements de site (l’IA s’adapte automatiquement). Le Knowledge Graph de Diffbot permet même d’interroger une base de données d’images et de données structurées à l’échelle du web.

Fonctionnalités clés :

- Extraction pilotée par l’IA (aucune configuration requise)

- Gère des millions de pages via API

- Renvoie les URL d’images, les métadonnées et les tags

- Knowledge Graph pour les requêtes à l’échelle du web

Idéal pour : les entreprises, les sociétés d’IA ou les fournisseurs de données ayant besoin d’énormes jeux de données d’images sans maintenance. Gratuit pour 10 000 appels API par mois ; offres payantes à partir de 299 $/mois. Nécessite un minimum de code pour être utilisé.

10. Scrapy

est le framework Python open source pour le web scraping personnalisé. Si vous êtes développeur, Scrapy vous donne un contrôle total : écrivez des spiders pour explorer n’importe quel site, extraire des images et les traiter comme vous le souhaitez.

Pourquoi Scrapy est puissant : son Images Pipeline intégré automatise le téléchargement des images, la création de miniatures et le filtrage par taille ou format. Scrapy est rapide, scalable et dispose d’un vaste écosystème d’extensions pour les proxy, le crawling dans le cloud, et plus encore.

Fonctionnalités clés :

- Approche code-first, flexibilité maximale

- Scraping asynchrone et rapide

- Téléchargement et traitement d’images intégrés

- Gratuit et open source

Idéal pour : les développeurs et les équipes techniques ayant des besoins de scraping personnalisés ou à grande échelle. Le seul coût est votre temps et vos ressources serveur.

Tableau comparatif des outils de scraping d’images

| Outil | Facilité d’utilisation | Formats d’export | Automatisation/planification | Idéal pour | Tarifs (env.) |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Excel, Sheets, Notion | Oui | Équipes non techniques, PME | Gratuit, 15 $/mois+ |

| ParseHub | ★★★★☆ | CSV, JSON, Tableau | Oui (cloud) | Analystes, sites complexes | Gratuit, 189 $/mois+ |

| Octoparse | ★★★★☆ | CSV, Excel, JSON | Oui (cloud) | Sans code, extraction en masse | Gratuit, 119 $/mois+ |

| Import.io | ★★★★☆ | API, CSV, BD | Oui (cloud) | Entreprise, intégration BI | 299 $/mois+ |

| Apify | ★★★☆☆ | JSON, CSV, API | Oui (cloud) | Développeurs, projets scalables | Gratuit, 49 $/mois+ |

| Mozenda | ★★★★☆ | CSV, Excel, API, BD | Oui | Entreprise, workflows d’équipe | 99 $/mois+ |

| VisualScraper | ★★★★☆ | CSV, JSON, XML, email | Oui | Particuliers, petits projets | Gratuit, 49 $/mois+ (cloud) |

| WebHarvy | ★★★★☆ | Excel, CSV, JSON, SQL | Oui | Non-développeurs, utilisateurs Windows | 99 $ achat unique |

| Diffbot | ★★★☆☆ | API (JSON, métadonnées) | Oui (API) | Entreprise, IA, développeurs | Gratuit, 299 $/mois+ |

| Scrapy | ★★★☆☆ | Tout format (code personnalisé) | Oui (personnalisé) | Développeurs, pipelines sur mesure | Gratuit |

Comment choisir le bon scraper d’images pour votre entreprise

Voici mon guide de décision rapide :

- Vous n’êtes pas technique et voulez de la vitesse et de la simplicité ? Commencez avec ou .

- Vous devez extraire des sites complexes et dynamiques ? Essayez ou .

- Entreprise, besoin d’intégration et de support ? Regardez du côté de , ou .

- Vous êtes développeur et voulez un contrôle total ? ou sont vos meilleures options.

- Vous avez juste besoin d’un outil rapide et gratuit pour des petits besoins ? est un excellent choix.

Profitez toujours des essais ou des offres gratuites : faites un petit test sur votre site cible pour voir quel outil correspond le mieux à votre workflow et à vos besoins en données.

Conclusion : trouvez votre scraper d’images idéal pour 2026

Le trésor visuel du web n’attend que vous — à condition d’avoir le bon scraper d’images. Que vous constituiez un catalogue produit, suiviez la concurrence ou alimentiez votre prochaine campagne virale, ces outils peuvent vous faire gagner des heures, et vous épargner bien des frustrations. Mon conseil ? Commencez par votre cas d’usage réel, associez-le à l’outil qui correspond à vos compétences et à votre budget, et n’ayez pas peur d’expérimenter.

Et si vous voulez voir à quel point l’extraction d’images peut être simple, et testez-la. Votre doigt habitué à Ctrl+S vous remerciera.

Pour approfondir le sujet du scraping, consultez le .

FAQ

1. Qu’est-ce qu’un outil de scraping d’images et comment fonctionne-t-il ?

Un outil de scraping d’images automatise l’extraction d’images, ou de leurs URL, depuis des sites web. La plupart des outils vous permettent de définir quoi extraire (via l’IA, le clic visuel ou le code), puis collectent et exportent les images en masse — ce qui vous fait gagner des heures de travail manuel.

2. Puis-je utiliser des outils de scraping d’images sans savoir coder ?

Absolument. Des outils comme , et sont conçus pour les utilisateurs non techniques, avec des commandes en langage naturel ou des interfaces visuelles.

3. Quelle est la différence entre les outils de scraping d’images gratuits et payants ?

Les outils gratuits sont très bien pour des tâches ponctuelles et de faible volume, mais ils peuvent avoir des limites de volume, de fonctionnalités ou de support. Les outils payants offrent davantage d’automatisation, de traitement cloud et de fonctions avancées — idéales pour les besoins métier ou entreprise.

4. Comment exporter des images vers Excel, Google Sheets ou Notion ?

La plupart des scrapers modernes (comme ) vous permettent d’exporter les résultats directement vers Excel, Sheets, Notion ou Airtable en un clic. D’autres proposent des téléchargements CSV/JSON ou une intégration API pour des workflows personnalisés.

5. Est-il légal d’extraire des images depuis n’importe quel site web ?

Vous devez toujours respecter les conditions d’utilisation du site et les lois sur le droit d’auteur. N’extrayez que des images librement accessibles et évitez d’utiliser du contenu récupéré à des fins commerciales sans autorisation. En cas de doute, consultez un juriste ou limitez l’usage aux analyses internes.

Prêt à faire de l’extraction d’images la partie la plus simple de votre workflow ? Essayez quelques outils de cette liste et voyez lequel vous convient le mieux — votre prochain gros projet n’est peut-être qu’à un scraping de distance.

En savoir plus :