Si vous avez déjà essayé de monter une liste de prospects B2B, de faire une analyse concurrentielle ou simplement de garder votre CRM à jour, vous savez à quel point LinkedIn est une vraie mine d’or. Mais soyons francs : copier manuellement les infos d’un profil, c’est à peu près aussi fun que regarder de la peinture sécher. Et les outils natifs de LinkedIn donnent rarement exactement les données dont vous avez besoin. C’est pour ça qu’en 2026, de plus en plus d’équipes commerciales et d’opérations cherchent à extraire LinkedIn avec Python — en transformant des heures de clics pénibles en quelques lignes de code et un tableur bien rempli de prospects.

Mais il y a un os : LinkedIn est devenu le Fort Knox des données pro. Avec plus de 1,3 milliard de membres et pas moins de 310 millions d’utilisateurs actifs mensuels (), c’est la source n°1 pour les leads B2B — mais aussi la plateforme la mieux blindée contre les bots et les scrapers. D’ailleurs, LinkedIn a restreint plus de 30 millions de comptes en 2025 rien que pour du scraping ou de l’automatisation (). Alors, comment extraire des données LinkedIn avec Python en 2026 — sans voir votre compte finir au goulag numérique ? Détaillons tout ça, étape par étape, de la configuration au scraping sécurisé, en passant par le nettoyage des données, et voyons comment des outils comme Thunderbit peuvent accélérer votre workflow.

Que signifie extraire LinkedIn avec Python ?

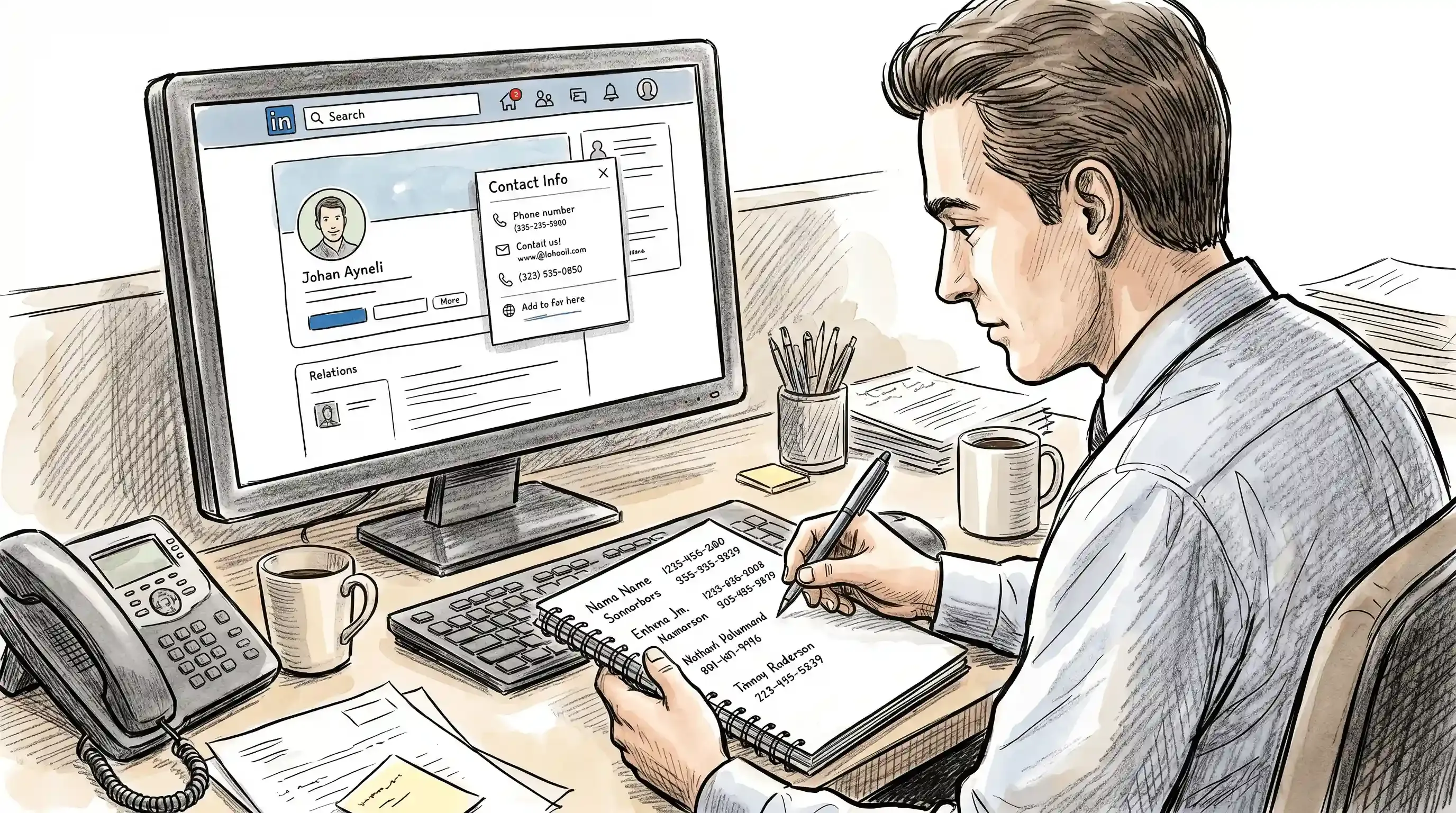

Quand on parle de scraper LinkedIn avec Python, il s’agit en réalité d’utiliser des scripts et des bibliothèques Python pour automatiser la collecte de données depuis les pages web de LinkedIn. Au lieu de copier-coller un nom, un poste ou une entreprise un par un, vous écrivez un script qui fait le boulot à votre place : il visite les profils, récupère les champs voulus et les enregistre dans un format structuré.

La collecte manuelle de données, c’est un peu comme cueillir des pommes une par une. L’extraction de données LinkedIn avec Python, c’est comme secouer l’arbre entier et récupérer les pommes dans un panier. Les mots-clés principaux ici — linkedin data extraction python, python linkedin scraper et automate linkedin scraping — renvoient tous à la même idée : utiliser du code pour collecter des données LinkedIn à grande échelle, plus vite et, idéalement, plus sûrement qu’un humain.

Exemples d’usage en entreprise pour le scraping LinkedIn :

- Constituer des listes ciblées de prospects pour la prospection commerciale

- Enrichir les fiches CRM avec des postes et entreprises à jour

- Surveiller les tendances de recrutement chez les concurrents ou les mouvements de dirigeants

- Cartographier des réseaux sectoriels pour des études de marché

- Regrouper des publications d’entreprise ou des offres d’emploi pour analyse

En bref, si vous avez besoin de données LinkedIn structurées et que vous n’avez pas envie de passer votre week-end à cliquer sur « Se connecter », Python est votre allié.

Pourquoi automatiser le scraping LinkedIn ? Cas d’usage business clés

Soyons lucides : LinkedIn n’est pas juste un réseau social — c’est la colonne vertébrale de la vente et du marketing B2B modernes. Voilà pourquoi les équipes misent autant sur l’automatisation du scraping LinkedIn en 2026 :

- Génération de leads : et 62 % disent que cela produit réellement des opportunités. LinkedIn génère 277 % de leads de plus que Facebook et Twitter réunis.

- Études de marché et analyse concurrentielle : LinkedIn est le seul endroit où vous pouvez voir à grande échelle des organigrammes en temps réel, les tendances de recrutement et l’actualité des entreprises.

- Enrichissement CRM : Garder son CRM à jour est un vrai cauchemar sans automatisation. Le scraping LinkedIn permet de mettre à jour en masse les postes, entreprises et coordonnées.

- Analyse de contenu et d’événements : Vous voulez savoir qui publie, intervient ou recrute dans votre secteur ? Le scraping LinkedIn vous donne les données.

Voici un tableau rapide des usages les plus fréquents :

| Équipe | Cas d’usage | Valeur apportée |

|---|---|---|

| Vente | Création de listes de prospects, préparation de la prospection | Plus de rendez-vous, meilleur taux de conversion |

| Marketing | Étude d’audience, curation de contenu | Ciblage plus précis, engagement accru |

| Opérations | Enrichissement CRM, cartographie d’organisations | Données plus propres, moins de saisie manuelle |

| Recrutement | Sourcing de talents, suivi des concurrents | Recrutement plus rapide, pipeline plus intelligent |

Et côté retour sur investissement ? Les équipes qui utilisent l’automatisation par IA pour la prospection déclarent économiser 2 à 3 heures par jour (), et des entreprises comme TripMaster ont constaté un ROI de 650 % grâce à la génération de leads via LinkedIn (). Ce n’est pas seulement un gain de temps — c’est un vrai multiplicateur de pipeline.

Python ou autres solutions pour scraper LinkedIn : ce qu’il faut savoir

Pourquoi choisir Python plutôt qu’une extension de navigateur ou un outil SaaS ? Voici un comparatif simple et direct :

Copier-coller manuel

- Avantages : aucune configuration, aucun risque (sauf les TMS)

- Inconvénients : lent, source d’erreurs, impossible à faire passer à l’échelle

Extensions de navigateur (comme PhantomBuster, Evaboot)

- Avantages : installation simple, sans code, adaptées aux petits volumes

- Inconvénients : montée en charge limitée, risque de bannissement élevé, nécessitent souvent Sales Navigator, abonnement mensuel

API SaaS (comme Bright Data, Apify)

- Avantages : forte capacité, faible maintenance, conformité gérée par le fournisseur

- Inconvénients : coûteux à grande échelle, données parfois en cache ou moins fraîches, moins de flexibilité

Scripts Python

- Avantages : flexibilité maximale, coût par ligne le plus bas à grande échelle, données en temps réel

- Inconvénients : niveau technique élevé requis, risque de bannissement élevé, maintenance continue

Voici une comparaison côte à côte :

| Critère | Python en DIY | Extension navigateur | API SaaS |

|---|---|---|---|

| Temps de mise en place | Jours à semaines | Minutes | Heures |

| Compétences techniques | Élevées | Faibles | Moyennes |

| Coût (10K lignes) | ~200 $ (proxies) | 50–300 $ | 300–500 $ |

| Capacité d’échelle | Élevée | Faible à moyenne | Élevée |

| Risque de bannissement | Le plus élevé | Élevé | Le plus faible |

| Fraîcheur des données | Temps réel | Temps réel | En cache |

| Maintenance | Continue | Faible | Aucune |

| Conformité | Risque à la charge de l’utilisateur | Risque à la charge de l’utilisateur | Risque à la charge du fournisseur |

En résumé : si vous êtes technique et que vous voulez un contrôle total, Python est imbattable. Mais pour la plupart des utilisateurs métier, des outils comme offrent une voie bien plus rapide et plus sûre pour exploiter les données LinkedIn — d’autant plus que les défenses de LinkedIn se durcissent chaque année.

Pour commencer : configurer votre scraper LinkedIn en Python

Prêt à mettre les mains dans le cambouis ? Voici comment préparer votre environnement Python pour le scraping LinkedIn en 2026 :

1. Installer Python et les bibliothèques clés

- Python 3.10+ est recommandé pour une meilleure compatibilité.

- Bibliothèques essentielles :

- Playwright (la nouvelle référence pour l’automatisation de navigateur)

- Selenium (toujours populaire, mais plus lent et plus facile à détecter)

- Beautiful Soup (pour analyser le HTML)

- Requests (pour les requêtes HTTP simples ; usage limité sur LinkedIn)

- pandas (pour le nettoyage et l’export des données)

Installation via pip :

1pip install playwright selenium beautifulsoup4 pandasPour Playwright, il faut aussi installer les binaires du navigateur :

1playwright install2. Configurer les pilotes de navigateur

- Playwright gère ses propres drivers.

- Selenium nécessite ou .

- Vérifiez que les versions du navigateur et du driver correspondent.

3. Préparer la connexion

- Vous aurez besoin d’un compte LinkedIn (idéalement ancien, avec une activité réelle).

- Pour la plupart des scripts, vous devrez soit :

- automatiser le flux de connexion (avec risque de CAPTCHA)

- injecter votre cookie de session

li_at(plus rapide, mais toujours risqué)

4. Respecter les conditions de LinkedIn

Attention : le scraping de LinkedIn, même avec votre propre compte, viole leurs conditions d’utilisation. Le cadre juridique est complexe (voir l’affaire hiQ contre LinkedIn), et LinkedIn applique désormais ses règles de manière très agressive. Utilisez ces scripts à des fins pédagogiques ou de recherche interne, et ne vendez jamais ni ne diffusez publiquement des données collectées.

Gérer les restrictions de LinkedIn : comment réduire les bannissements en 2026

C’est là que les choses se corsent. Les défenses anti-bot de LinkedIn en 2026 sont redoutables. La plateforme a mis fin à des activités entières (RIP Proxycurl) et a restreint plus de 30 millions de comptes en 2025 rien que pour du scraping (). Alors, comment scraper sans se faire repérer ?

Les principaux risques

- Limites de fréquence : les utilisateurs non authentifiés obtiennent environ 50 vues de profil par jour et par IP. Les comptes connectés peuvent en effectuer quelques centaines avant d’atteindre les CAPTCHA ou les blocages ().

- CAPTCHA : fréquents, surtout après des consultations rapides de profils ou des connexions répétées.

- Restrictions de compte : LinkedIn peut verrouiller, restreindre ou bannir définitivement un compte en cas d’activité suspecte.

Stratégies éprouvées pour réduire le risque

- Utiliser des proxies mobiles ou résidentiels anciens : les proxies mobiles affichent un taux de survie de 85 % sur LinkedIn, contre 50 % pour les proxies résidentiels et quasiment zéro pour les IP de datacenter ().

- Introduire des délais aléatoires : n’utilisez pas un

time.sleep(5)fixe. Préférez des pauses aléatoires entre 2 et 8 secondes. - Faire monter les comptes progressivement : ne consultez pas 100 profils avec un compte fraîchement créé. Avancez doucement et reproduisez un comportement humain.

- Scraper pendant les heures de bureau : alignez-vous sur le fuseau horaire de votre compte.

- Faire tourner les user agents par session : mais ne les changez pas en plein milieu d’une session, LinkedIn le repère.

- Faire défiler naturellement : utilisez l’automatisation du navigateur pour scroller et déclencher le chargement différé.

- Associer une IP à chaque compte : n’exécutez jamais plusieurs comptes derrière un seul proxy.

- Surveiller les alertes précoces : les erreurs 429, les redirections vers

/authwallou des corps de page vides indiquent que vous vous rapprochez du bannissement.

Astuce de pro : même les meilleurs plugins de furtivité (Playwright Stealth, undetected-chromedriver) ne corrigent que les empreintes superficielles. La détection de LinkedIn va beaucoup plus loin — ne confondez pas confiance et compétence.

Choisir les bonnes bibliothèques Python pour l’extraction de données LinkedIn

En 2026, le paysage des bibliothèques Python pour le scraping est plus clair que jamais. Voici comment les principales solutions se comparent :

| Bibliothèque | HTML statique | JS rendu | Flux de connexion | Vitesse | Idéal pour |

|---|---|---|---|---|---|

| Requests + BS4 | ✅ | ❌ | ❌ | La plus rapide | Petites pages publiques |

| Selenium 4.x | ✅ | ✅ | ✅ | Lent | Legacy, large compatibilité navigateur |

| Playwright (Python) | ✅ | ✅ | ✅ | Rapide | Choix par défaut pour LinkedIn en 2026 |

| Scrapy | ✅ | Avec plugin | Avec effort | Rapide | Explorations structurées à gros volume |

Pourquoi Playwright gagne pour LinkedIn :

- 12 % plus rapide au chargement des pages et 15 % de consommation mémoire en moins que Selenium ()

- Gère le chargement asynchrone de LinkedIn sans bricolage manuel

- Gestion native des onglets pour le scraping parallèle

- Plugin stealth officiel pour contourner les empreintes de base

Conseil pour débutants : si vous démarrez, Playwright est votre meilleur choix. Selenium reste utile pour des projets hérités, mais il est plus lent et plus facile à détecter.

Pas à pas : votre premier script Python de scraping LinkedIn

Voyons un exemple simple avec Selenium (pour débuter) et Playwright (pour la production). Rappel : ces scripts sont uniquement destinés à un usage pédagogique.

Exemple 1 : connexion minimale avec Selenium et extraction d’un profil

1from selenium import webdriver

2from selenium.webdriver.common.by import By

3from selenium.webdriver.common.keys import Keys

4import time, random

5driver = webdriver.Chrome()

6driver.get("https://www.linkedin.com/login")

7driver.find_element(By.ID, "username").send_keys("you@example.com")

8driver.find_element(By.ID, "password").send_keys("yourpassword" + Keys.RETURN)

9time.sleep(random.uniform(3, 6)) # délai aléatoire

10# Visiter un profil

11driver.get("https://www.linkedin.com/in/some-profile/")

12time.sleep(random.uniform(4, 8))

13# Faire défiler pour déclencher le chargement différé

14driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

15# Extraire les données (simplifié)

16name = driver.find_element(By.CSS_SELECTOR, "h1").text

17print("Nom :", name)

18driver.quit()Remarque : en production, il vaut mieux injecter votre cookie li_at plutôt que de vous connecter à chaque fois (pour éviter les CAPTCHA).

Exemple 2 : scraper asynchrone avec Playwright (recommandé en 2026)

1import asyncio

2from linkedin_scraper import BrowserManager, PersonScraper

3async def main():

4 async with BrowserManager() as browser:

5 await browser.load_session("session.json") # stocke votre session de connexion

6 scraper = PersonScraper(browser.page)

7 person = await scraper.scrape("https://linkedin.com/in/username")

8 print(person.name, person.experiences)

9asyncio.run(main())()

Où ajouter les mesures anti-bannissement :

- Utilisez des proxies mobiles dans votre gestionnaire de navigateur

- Randomisez les délais entre les actions

- Travaillez par petits lots, pas en une seule fois

Attention : tout scraper basé sur des sélecteurs cassera quand LinkedIn modifiera son DOM (ce qui arrive toutes les quelques semaines). Préparez-vous à maintenir vos scripts.

Nettoyer et mettre en forme les données LinkedIn avec Python

Le scraping n’est que la moitié du travail. Les données LinkedIn sont souvent sales : noms en double, intitulés de poste incohérents, caractères Unicode bizarres. Voici comment les nettoyer :

1. Utiliser pandas pour manipuler les tableaux

1import pandas as pd

2df = pd.read_csv("linkedin_raw.csv")

3df = df.drop_duplicates(subset=["email", "phone"]) # déduplication exacte

4df["name"] = df["name"].str.lower().str.strip()2. Faire du rapprochement flou pour les noms d’entreprise

1from rapidfuzz import fuzz

2def is_similar(a, b):

3 return fuzz.ratio(a, b) > 90

4# Exemple : "Acme Corp" vs "ACME Corporation"3. Normaliser les numéros de téléphone et les e-mails

1import phonenumbers

2from email_validator import validate_email, EmailNotValidError

3# Normalisation du téléphone

4num = phonenumbers.parse("+1 415-555-1234", None)

5print(phonenumbers.format_number(num, phonenumbers.PhoneNumberFormat.E164))

6# Validation de l’e-mail

7try:

8 v = validate_email("someone@example.com")

9 print(v.email)

10except EmailNotValidError as e:

11 print("E-mail invalide :", e)4. Exporter vers Excel, Google Sheets ou un CRM

- Excel :

df.to_excel("cleaned_data.xlsx") - Google Sheets : utiliser la bibliothèque

gspread - Airtable : utiliser

pyairtable - Salesforce/HubSpot : utiliser leurs clients Python respectifs

Astuce de pro : nettoyez et dédupliquez toujours avant l’import dans votre CRM. Rien ne plombe plus le moral d’un commercial que d’appeler deux fois le même prospect.

Booster l’efficacité du scraping LinkedIn avec Thunderbit

Parlons maintenant d’une façon de vous simplifier encore un peu la vie. Même si j’adore Python, maintenir des scrapers LinkedIn revient souvent à jouer à la taupe sans fin. C’est pourquoi, chez Thunderbit, nous avons créé une qui enlève une bonne partie de la galère liée à l’extraction de données LinkedIn.

Pourquoi Thunderbit ?

- Scraping en 2 clics : cliquez simplement sur « AI Suggest Fields » et Thunderbit lit la page, propose les colonnes puis extrait les données — sans code, sans sélecteurs, sans casse-tête.

- Scraping de sous-pages : récupérez une page de résultats, puis laissez Thunderbit visiter chaque profil et enrichir automatiquement votre tableau.

- Modèles instantanés : prêts à l’emploi pour LinkedIn, Amazon, Google Maps et bien plus — démarrez en quelques secondes.

- Export gratuit : envoyez les données vers Excel, Google Sheets, Airtable, Notion ou téléchargez-les en CSV/JSON.

- AI Autofill : automatisez le remplissage de formulaires et les tâches répétitives — parfait pour les opérations commerciales et les admins CRM.

- Scraping cloud ou navigateur : choisissez le mode qui colle à votre cas d’usage et à vos besoins de connexion.

- Aucune maintenance : l’IA de Thunderbit s’adapte aux changements d’interface de LinkedIn, donc plus besoin de réparer des scripts cassés tout le temps.

Thunderbit est utilisé par plus de 100 000 utilisateurs dans le monde et affiche une note de 4,4★ sur le Chrome Web Store (). Pour la plupart des utilisateurs métier, c’est la manière la plus rapide et la plus sûre d’extraire des données LinkedIn — sans mettre votre compte ni votre santé mentale en danger.

Conseils avancés : faire monter en puissance et automatiser les workflows de scraping LinkedIn

Si vous êtes prêt à passer en mode expert, voici comment faire évoluer votre scraping LinkedIn :

1. Planifier les scripts

- cron (Linux/Mac) ou Task Scheduler (Windows) pour les tâches simples

- APScheduler ou Prefect 3 pour une planification et des relances natives en Python

- Airflow pour une orchestration de niveau entreprise

2. Déployer dans le cloud

- AWS Lambda (avec Playwright dans un conteneur)

- GCP Cloud Run

- Railway / Fly.io / Render pour héberger Playwright facilement

- Apify pour des workflows cloud dédiés au scraping

3. Surveillance et détection des dérives

- Sentry pour le suivi des erreurs

- Alertes personnalisées en cas de pics d’erreurs 429 ou de changements du DOM

- Comparaison par hash pour détecter les modifications de mise en page de LinkedIn

4. Intégration CRM

- Utilisez les API de Salesforce, HubSpot, Notion ou Airtable pour pousser automatiquement les données nettoyées

- Construisez une chaîne : Planificateur → Scraper → nettoyage/déduplication avec pandas → enrichissement → envoi CRM → alertes

5. Rester conforme

- Ne scrappez jamais plus de quelques centaines de profils par compte et par jour

- Faites tourner les proxies et les user agents

- Surveillez les signaux précoces de bannissement et suspendez les scripts si vous en voyez

Astuce de pro : même avec toute cette automatisation, LinkedIn peut changer les règles — et le fera. Prévoyez toujours un plan B, et pensez à Thunderbit pour les workflows les plus critiques.

Conclusion et points clés à retenir

Extraire LinkedIn avec Python en 2026 est à la fois plus puissant et plus risqué que jamais. Voici ce qu’il faut retenir :

- LinkedIn est la source n°1 de données B2B — mais aussi la plateforme la mieux protégée contre les scrapers.

- Python offre une flexibilité maximale pour l’extraction de données LinkedIn, mais avec un risque de bannissement élevé et une maintenance continue.

- Playwright est désormais la référence pour le scraping LinkedIn — plus rapide et plus fiable que Selenium.

- Réduire le risque de bannissement repose sur les proxies, les délais et un comportement proche d’un vrai utilisateur — les proxies mobiles survivent à 85 %, les résidentiels à 50 %, les datacenter à 0 %.

- Le nettoyage des données est indispensable — utilisez pandas, le fuzzy matching et des bibliothèques de validation avant l’import dans votre CRM.

- Thunderbit propose une alternative plus sûre et plus rapide — avec extraction alimentée par l’IA, enrichissement des sous-pages, export instantané et aucun code requis.

- Passer à l’échelle signifie tout automatiser — de la planification à la surveillance, jusqu’à l’intégration CRM.

Et surtout : scrapez de manière éthique et responsable. L’équipe juridique de LinkedIn n’est pas particulièrement connue pour son sens de l’humour.

Si vous en avez assez de vous battre contre les défenses changeantes de LinkedIn, . C’est l’outil que j’aurais aimé avoir à mes débuts — et il pourrait bien vous éviter, à vous et à votre compte LinkedIn, pas mal de galères.

Vous voulez aller plus loin ? Consultez le pour davantage de guides sur le web scraping, l’automatisation et les bonnes pratiques des opérations commerciales.

FAQ

1. Est-ce légal d’extraire LinkedIn avec Python en 2026 ?

Le cadre juridique est complexe. Si l’affaire hiQ contre LinkedIn a estimé que le scraping de données publiques ne violait pas le CFAA, LinkedIn peut toujours faire appliquer ses conditions d’utilisation, qui interdisent le scraping. En 2025, LinkedIn a fermé Proxycurl et restreint plus de 30 millions de comptes pour scraping. Utilisez toujours ces scripts à des fins internes ou pédagogiques, et ne vendez ni ne diffusez jamais publiquement des données collectées.

2. Quelle est la manière la plus sûre d’automatiser le scraping LinkedIn ?

Utilisez des comptes anciens, des proxies mobiles (taux de survie de 85 %), randomisez les délais et scrapez pendant les heures de bureau. N’utilisez jamais d’IP de datacenter et surveillez les signaux précoces de bannissement. Pour la plupart des utilisateurs métier, des outils comme offrent une alternative nettement moins risquée que des scripts Python faits maison.

3. Quelle bibliothèque Python est la meilleure pour scraper LinkedIn en 2026 ?

Playwright est désormais le choix par défaut — plus rapide, plus fiable et plus à l’aise avec le contenu dynamique de LinkedIn que Selenium. Pour des pages publiques simples, Requests + Beautiful Soup fonctionne encore, mais pour tout ce qui implique une connexion ou du JavaScript, privilégiez Playwright.

4. Comment nettoyer et mettre en forme les données LinkedIn après le scraping ?

Utilisez pandas pour manipuler les tableaux et dédupliquer, RapidFuzz pour le fuzzy matching, phonenumbers et email-validator pour les coordonnées, puis exportez vers Excel, Google Sheets ou votre CRM via les bibliothèques Python correspondantes.

5. Comment Thunderbit améliore-t-il l’extraction de données LinkedIn ?

Thunderbit utilise l’IA pour suggérer les champs, gérer le scraping des sous-pages et exporter les données directement vers vos outils préférés — sans code. Il s’adapte aux changements fréquents de mise en page de LinkedIn, ce qui réduit la maintenance et le risque de bannissement. En plus, l’essai est gratuit et l’outil est utilisé par plus de 100 000 personnes dans le monde.

Curieux de voir le scraping LinkedIn en action, sans les galères ? et commencez à extraire des données en seulement deux clics. Votre équipe commerciale — et votre compte LinkedIn — vous remercieront.

En savoir plus