Le web scraping est passé d’une compétence de niche à un véritable superpouvoir pour toute personne qui travaille dans la vente, les opérations ou l’étude de marché. Avec l’explosion du volume de données sur le web — la création mondiale de données a bondi de près de — il n’est pas étonnant que considèrent désormais la donnée comme le « cœur » de leur prise de décision. Mais voici le hic : disent que la gestion des données non structurées (comme du HTML mal organisé) est un défi majeur. J’ai vu plus d’une équipe s’enliser dans des marathons de copier-coller, à essayer de remettre des infos de sites web en ordre dans des feuilles de calcul — croyez-moi, ce n’est pas joli à voir.

C’est là qu’intervient BeautifulSoup en Python. Dans ce tutoriel pratique, je vais vous montrer comment utiliser BeautifulSoup pour le web scraping, avec un exemple Python concret que vous pourrez adapter à vos besoins métier. Et comme j’aime travailler plus intelligemment, pas plus durement, je vous montrerai aussi comment combiner BeautifulSoup avec , notre extracteur Web IA, pour accélérer votre flux de travail et obtenir des données plus propres et mieux structurées, quel que soit votre niveau en code.

Qu’est-ce que BeautifulSoup et pourquoi l’utiliser pour le web scraping ?

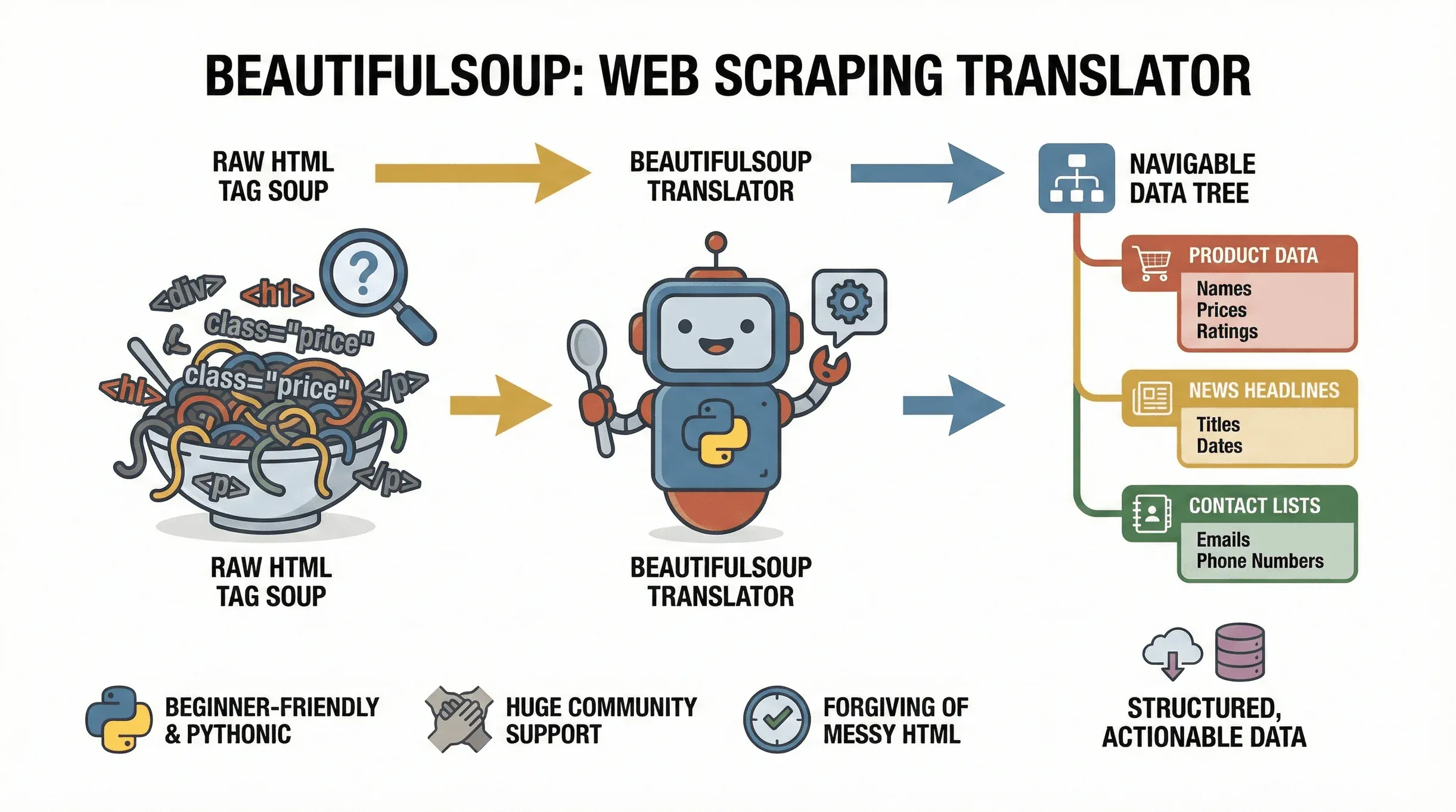

Commençons par les bases. est une bibliothèque Python qui facilite l’analyse de documents HTML et XML. Voyez-la comme un traducteur : elle prend le « tag soup » d’une page web et le transforme en arborescence navigable, ce qui vous permet de trouver, extraire et manipuler facilement les données dont vous avez besoin. Le projet est toujours activement maintenu —

Commençons par les bases. est une bibliothèque Python qui facilite l’analyse de documents HTML et XML. Voyez-la comme un traducteur : elle prend le « tag soup » d’une page web et le transforme en arborescence navigable, ce qui vous permet de trouver, extraire et manipuler facilement les données dont vous avez besoin. Le projet est toujours activement maintenu — beautifulsoup4 4.14.3 a été publié sur PyPI fin 2025 — donc tout ce que vous apprenez ici est à jour. Que vous récupériez des prix de produits sur un site e-commerce, des gros titres d’actualité ou des annuaires professionnels pour générer des leads, BeautifulSoup est l’outil de référence pour transformer des pages web en données structurées et exploitables.

Pourquoi est-il si populaire ? D’abord, il est extrêmement accessible aux débutants. BeautifulSoup tolère bien le HTML mal formé (et, soyons honnêtes, le web en est rempli), et sa syntaxe très Python permet de passer de zéro au scraping en seulement quelques lignes de code. Il est aussi largement supporté, avec des millions de téléchargements et une immense communauté — si vous bloquez, une recherche Google suffit souvent à trouver de l’aide.

Cas d’usage typiques de BeautifulSoup :

- Extraire les noms de produits, les prix et les notes depuis des pages e-commerce

- Récupérer les titres d’actualité, les auteurs et les dates de publication depuis des sites d’information

- Analyser des tableaux ou des annuaires (comme des listes d’entreprises ou de contacts)

- Collecter des e-mails ou des numéros de téléphone depuis des sites d’annonces

- Surveiller des mises à jour (changements de prix, nouvelles offres d’emploi, etc.)

Si vos données se trouvent dans du HTML statique, BeautifulSoup est votre meilleur allié pour le web scraping.

Les avantages uniques de BeautifulSoup pour le web scraping

Il existe de nombreuses bibliothèques Python pour le web scraping — alors pourquoi choisir BeautifulSoup ? Voici comment il se compare à la concurrence :

- Simplicité : BeautifulSoup est léger et facile à apprendre. Vous n’avez pas besoin de mettre en place tout un framework ni d’écrire une tonne de code répétitif. C’est parfait pour des tâches de scraping rapides et ponctuelles, ou pour les débutants qui démarrent.

- Tolérance : Il sait gérer un HTML cassé ou mal formé, ce qui est plus courant qu’on ne le pense.

- Flexibilité : Vous n’êtes pas enfermé dans une architecture de crawl rigide. Il suffit de lui fournir du HTML et d’en extraire ce qu’il vous faut.

- Intégration : BeautifulSoup fonctionne très bien avec d’autres bibliothèques Python comme

requests(pour récupérer les pages web),csv(pour enregistrer les données) etpandas(pour l’analyse de données).

Comment se compare-t-il aux autres outils ?

| Outil | Idéal pour | Avantages | Inconvénients |

|---|---|---|---|

| BeautifulSoup | Analyse de HTML statique, débutants | Simple, mise en route rapide, tolérant, flexible | Pas adapté aux sites très chargés en JavaScript |

| Scrapy | Tâches à grande échelle, asynchrones | Puissant, scalable, crawl intégré | Courbe d’apprentissage plus raide, plus de configuration |

| Selenium | Contenu JavaScript/dynamique | Interagit avec le JS, remplit des formulaires, clique sur des boutons | Plus lent, plus lourd, plus gourmand en ressources |

Si vous débutez ou que vous devez analyser rapidement des pages statiques, BeautifulSoup est le « couteau suisse » du web scraping (). Pour des sites plus complexes ou dynamiques, vous pouvez le combiner avec Selenium ou Scrapy — mais BeautifulSoup reste la meilleure façon d’apprendre les bases.

Configuration de votre environnement Python pour BeautifulSoup

Prêt à commencer ? Voici comment configurer votre environnement :

-

Installez Python : téléchargez la dernière version depuis .

-

Créez un environnement virtuel (facultatif, mais recommandé) :

1python -m venv venv 2source venv/bin/activate # Sous Windows : venv\Scripts\activate -

Installez BeautifulSoup et ses dépendances :

1pip install beautifulsoup4 requests lxml html5libbeautifulsoup4: la bibliothèque principalerequests: pour récupérer les pages weblxmlouhtml5lib: des analyseurs HTML plus rapides et/ou plus fiables

-

Conseils de dépannage :

- Si vous obtenez l’erreur « pip not found », essayez

pip3oupy -m pip. - Sur Mac/Linux, vous pourriez avoir besoin de

sudopour les permissions. - Sous Windows, vérifiez que Python est bien ajouté à votre PATH.

- Si vous obtenez l’erreur « pip not found », essayez

Pour vérifier votre installation, lancez ce test rapide :

1from bs4 import BeautifulSoup

2import requests

3html = requests.get("http://example.com").text

4soup = BeautifulSoup(html, "html.parser")

5print(soup.title)Si vous voyez <title>Example Domain</title>, tout est bon ().

Exemple Python Beautiful Soup, pas à pas

Plongeons dans un véritable exemple Python BeautifulSoup. Imaginez que vous souhaitiez extraire les derniers titres d’actualité d’un site d’information public. Voici comment procéder :

1. Récupérer la page web

1import requests

2from bs4 import BeautifulSoup

3url = "https://www.bbc.com/news"

4response = requests.get(url)

5html = response.text2. Analyser le HTML

1soup = BeautifulSoup(html, "html.parser")3. Inspecter la structure HTML

Ouvrez les outils de développement de votre navigateur (clic droit → Inspecter) et repérez les balises qui contiennent les titres. Sur de nombreux sites d’actualité, les titres se trouvent dans des balises <h3> avec des classes spécifiques.

Par exemple, vous pourriez voir :

1<h3 class="gs-c-promo-heading__title">Titre du titre</h3>4. Extraire les données

1headlines = soup.find_all("h3", class_="gs-c-promo-heading__title")

2for h in headlines:

3 print(h.get_text(strip=True))Cela affichera tous les titres d’actualité présents sur la page.

5. Enregistrer les données en CSV

Enregistrons ces titres pour une analyse ultérieure :

1import csv

2with open("headlines.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.writer(file)

4 writer.writerow(["titre"])

5 for h in headlines:

6 writer.writerow([h.get_text(strip=True)])Vous disposez maintenant d’un fichier CSV prêt à être ouvert dans Excel ou Google Sheets.

Comprendre la structure HTML pour extraire efficacement les données

Avant d’écrire une seule ligne de code, inspectez toujours le HTML de la page. Voici comment faire :

- Ouvrez les outils de développement : cliquez avec le bouton droit sur la page et sélectionnez « Inspecter ».

- Repérez les données : survolez les éléments pour voir quelles balises contiennent les informations recherchées (titres, prix, auteurs, etc.).

- Notez les balises et les classes : recherchez des identifiants uniques comme

class="product-title"ouid="main-content". - Testez vos sélecteurs : utilisez les méthodes

.find(),.find_all()ou.select()de BeautifulSoup pour cibler ces éléments.

Astuce : utilisez soup.prettify() pour afficher une version lisible du HTML dans votre console Python.

Extraire et structurer des données avec BeautifulSoup

Supposons que vous souhaitiez extraire à la fois les titres et les auteurs d’une page de blog :

1articles = soup.find_all("article")

2data = []

3for article in articles:

4 title = article.find("h2").get_text(strip=True)

5 author = article.find("span", class_="author").get_text(strip=True)

6 data.append({"title": title, "author": author})Vous avez maintenant une liste de dictionnaires — parfaite pour l’export en CSV ou pour une analyse plus poussée.

Vous pouvez extraire des liens, des images ou n’importe quel attribut de cette manière :

1for link in soup.find_all("a"):

2 print(link.get("href"))Ou pour les images :

1for img in soup.find_all("img"):

2 print(img.get("src"))Enregistrer les données extraites : de Python vers Excel ou CSV

Une fois vos données structurées, l’export est simple. Voici comment faire avec le module csv :

1import csv

2with open("articles.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.DictWriter(file, fieldnames=["title", "author"])

4 writer.writeheader()

5 for row in data:

6 writer.writerow(row)Ou, si vous êtes adepte de pandas :

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv("articles.csv", index=False)

4df.to_excel("articles.xlsx", index=False)Utilisez toujours l’encodage UTF-8 pour éviter les problèmes de caractères, surtout avec des données internationales.

Étude de cas : extraire des données d’un site d’actualité avec BeautifulSoup

Voyons un exemple Python BeautifulSoup concret : extraire les titres d’articles, les auteurs et les dates de publication depuis un site d’actualité.

Supposons que vous souhaitiez extraire des données d’articles depuis :

1import requests

2from bs4 import BeautifulSoup

3import csv

4url = "https://edition.cnn.com/world"

5response = requests.get(url)

6soup = BeautifulSoup(response.content, "html.parser")

7articles = soup.find_all("article")

8data = []

9for article in articles:

10 title_tag = article.find("h3")

11 date_tag = article.find("span", class_="date")

12 author_tag = article.find("span", class_="author")

13 title = title_tag.get_text(strip=True) if title_tag else ""

14 date = date_tag.get_text(strip=True) if date_tag else ""

15 author = author_tag.get_text(strip=True) if author_tag else ""

16 data.append({"title": title, "date": date, "author": author})

17with open("cnn_articles.csv", "w", newline='', encoding="utf-8") as file:

18 writer = csv.DictWriter(file, fieldnames=["title", "date", "author"])

19 writer.writeheader()

20 for row in data:

21 writer.writerow(row)Ce script récupérera les derniers articles, extraira le titre, la date et l’auteur, puis les enregistrera dans un CSV — à condition que le balisage actuel de CNN corresponde toujours aux balises ci-dessus. Les grands sites d’information font souvent évoluer leurs noms de classes et la structure du DOM, donc réinspectez la page avant d’exécuter ce script sur des données de production. La structure (<article> comme conteneur, puis find sur les balises enfants) est le schéma robuste ; les noms de classes précis comme "date" et "author" sont des exemples à adapter à ce que la page renvoie au moment où vous l’utilisez.

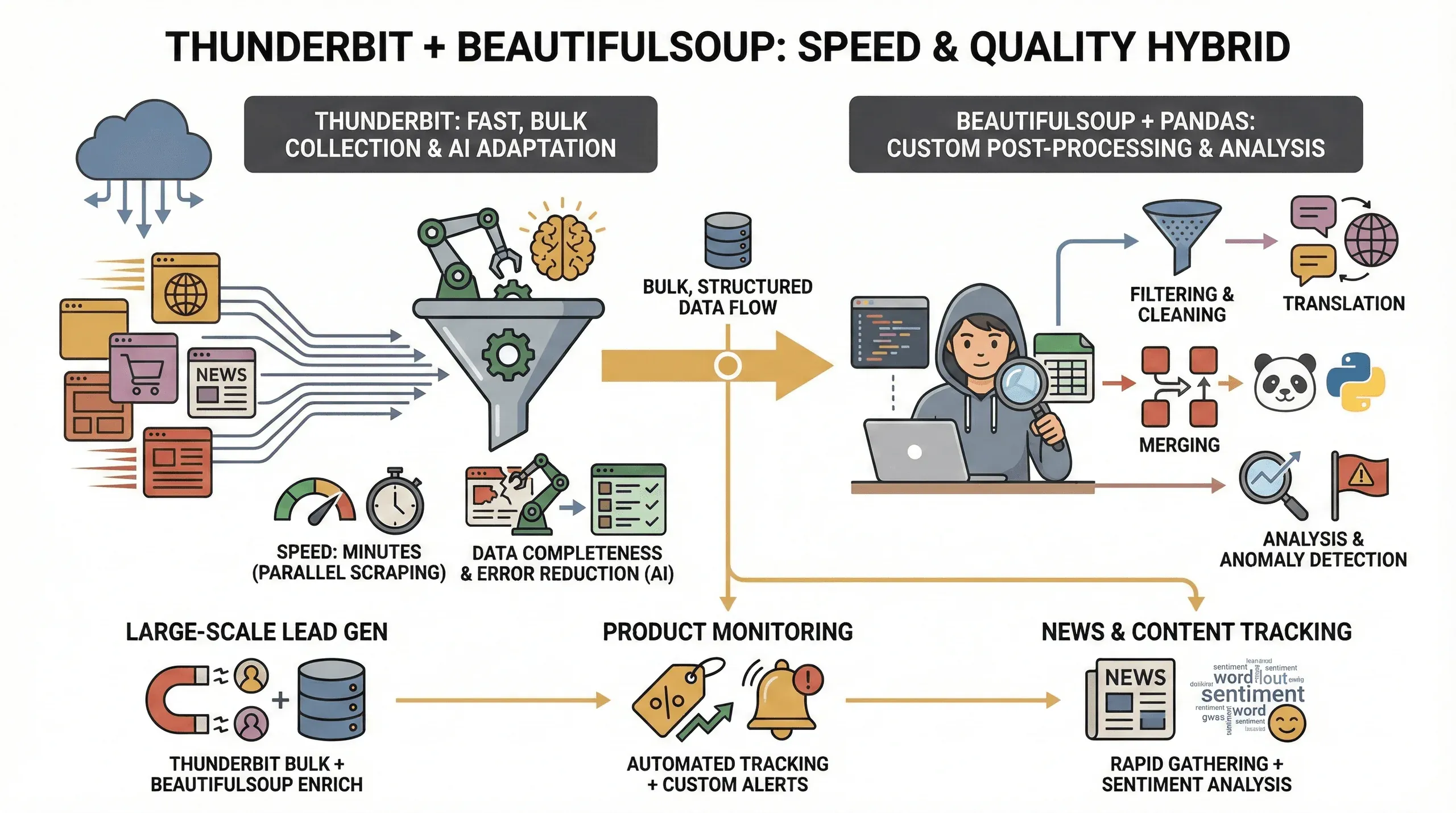

Améliorer votre flux de travail : combiner BeautifulSoup avec Thunderbit

Voyons maintenant comment rendre votre flux de scraping encore plus fluide. est une extension Chrome d’extraction Web IA qui élimine les approximations liées à l’extraction de données. Avec Thunderbit, vous pouvez :

- Utiliser « AI Suggest Fields » : Thunderbit lit la page et suggère automatiquement les champs à extraire — fini de fouiller dans le HTML ou de retoucher des sélecteurs.

- Extraire des sous-pages : Thunderbit peut suivre des liens vers des sous-pages (comme des pages produit ou article individuelles) et enrichir votre jeu de données avec des informations supplémentaires.

- Exporter instantanément : envoyez vos données directement vers Excel, Google Sheets, Airtable ou Notion en un clic.

- Gérer la pagination : Thunderbit peut extraire des données sur plusieurs pages, y compris le défilement infini.

- Planifier des extractions : mettez en place des tâches récurrentes pour garder vos données à jour.

Voici un flux hybride que j’adore :

- Commencez avec Thunderbit : ouvrez votre site cible, cliquez sur l’icône Thunderbit et laissez « AI Suggest Fields » identifier les bonnes colonnes (comme le titre, l’auteur, la date).

- Exportez les données : téléchargez les résultats en CSV ou envoyez-les dans Google Sheets.

- Utilisez BeautifulSoup pour un traitement personnalisé : si vous avez besoin d’analyses plus poussées (nettoyage de texte, déduplication ou fusion avec d’autres sources), importez le CSV exporté dans Python et utilisez BeautifulSoup ou pandas pour le post-traitement.

Cette combinaison vous offre le meilleur des deux mondes : la vitesse de Thunderbit et sa détection de champs basée sur l’IA, plus la flexibilité de BeautifulSoup pour votre logique sur mesure.

Vitesse et qualité des données : pourquoi utiliser Thunderbit et BeautifulSoup ensemble ?

Pourquoi utiliser les deux outils ? Voici ce que j’ai constaté :

Pourquoi utiliser les deux outils ? Voici ce que j’ai constaté :

- Vitesse : Thunderbit peut extraire des dizaines de pages en parallèle (jusqu’à 50 à la fois en mode cloud), ce qui vous permet d’obtenir vos données en quelques minutes au lieu de plusieurs heures.

- Complétude des données : l’IA de Thunderbit s’adapte aux changements de mise en page et peut extraire des données structurées même sur des sites délicats, réduisant ainsi le risque d’oublier des champs.

- Réduction des erreurs : fini les scripts cassés dès qu’un nom de classe change — l’IA de Thunderbit réévalue la page à chaque fois.

- Post-traitement personnalisé : pour des besoins avancés (filtrage, traduction ou fusion de jeux de données), BeautifulSoup et pandas vous donnent un contrôle total.

Cette approche hybride est particulièrement utile pour :

- La génération de leads à grande échelle : utilisez Thunderbit pour collecter le gros des données, puis BeautifulSoup pour les nettoyer et les enrichir.

- Le suivi de produits : Thunderbit gère le scraping répétitif, tandis que BeautifulSoup vous permet d’analyser les tendances ou de détecter les anomalies.

- Le suivi d’actualités et de contenus : collectez rapidement des articles avec Thunderbit, puis utilisez Python pour l’analyse de sentiments ou l’extraction de mots-clés.

Résoudre les problèmes courants du web scraping avec BeautifulSoup

Le web scraping n’est pas toujours un long fleuve tranquille — voici quelques pièges courants et comment les corriger :

- Contenu dynamique : si un site charge les données avec JavaScript (défilement infini, AJAX), BeautifulSoup seul ne les verra pas. Utilisez Selenium ou le mode navigateur de Thunderbit dans ces cas-là.

- Mesures anti-bot : certains sites bloquent les requêtes automatisées. Essayez d’ajouter un en-tête User-Agent personnalisé, d’insérer des pauses entre les requêtes ou d’utiliser l’extraction cloud de Thunderbit pour contourner les blocages simples.

- Changements de structure HTML : si votre script casse soudainement, c’est probablement que le HTML du site a changé. Réinspectez la page et mettez vos sélecteurs à jour. L’IA de Thunderbit peut aider ici en s’adaptant à la volée.

- Données manquantes : vérifiez toujours qu’un élément existe avant d’appeler

.get_text(). Utilisez.get()plutôt que[]pour les attributs afin d’éviter lesKeyError. - Problèmes d’encodage : enregistrez vos fichiers en UTF-8 pour gérer correctement les caractères spéciaux.

Et surtout, respectez toujours robots.txt et les conditions d’utilisation du site. Faites du scraping de manière responsable — personne n’aime un robot mal élevé.

Conclusion et points clés à retenir

Le web scraping avec BeautifulSoup est l’une des compétences les plus utiles que vous puissiez acquérir dans le monde actuel guidé par la donnée. Voici ce que nous avons vu dans ce tutoriel de web scraping avec BeautifulSoup :

- BeautifulSoup est le point de départ idéal pour analyser du HTML statique et extraire des données structurées avec Python.

- La configuration est un jeu d’enfant : installez simplement Python, pip et quelques bibliothèques.

- Inspecter le HTML est essentiel pour cibler les bonnes données.

- Exporter vers CSV/Excel rend vos données immédiatement exploitables pour l’analyse métier.

- La combinaison avec Thunderbit vous apporte une détection de champs par IA, un scraping plus rapide et des exports plus simples — parfait pour les utilisateurs métier et les non-développeurs.

- Les workflows hybrides (Thunderbit pour l’extraction en volume, BeautifulSoup pour le traitement personnalisé) offrent le meilleur en matière de vitesse, de qualité des données et de flexibilité.

Si vous êtes prêt à passer au niveau supérieur en web scraping, essayez les deux outils : testez d’abord un simple script BeautifulSoup, puis voyez à quelle vitesse vous pouvez aller avec . Et pour d’autres guides pratiques, consultez le .

Bon scraping — et que vos données soient toujours propres, structurées et prêtes à l’emploi.

FAQ

1. Qu’est-ce que BeautifulSoup et à quoi sert-il ?

BeautifulSoup est une bibliothèque Python conçue pour analyser des documents HTML et XML. Elle vous aide à extraire des données de pages web et à les transformer en formats structurés comme des listes ou des tableaux, ce qui la rend idéale pour les projets de web scraping.

2. Comment BeautifulSoup se compare-t-il à Selenium et Scrapy ?

BeautifulSoup est léger et facile à utiliser pour les pages HTML statiques. Selenium est plus adapté aux sites dynamiques et riches en JavaScript, tandis que Scrapy est un framework complet pour le scraping asynchrone à grande échelle. BeautifulSoup est le meilleur choix pour les débutants et les tâches rapides.

3. Puis-je utiliser BeautifulSoup et Thunderbit ensemble ?

Absolument. Thunderbit peut identifier et extraire rapidement des champs depuis des pages web grâce à l’IA, et vous pouvez utiliser BeautifulSoup pour un post-traitement personnalisé ou une analyse plus approfondie des données exportées.

4. Quels sont les défis courants du web scraping avec BeautifulSoup ?

Les problèmes fréquents incluent la gestion du contenu dynamique, les mesures anti-bot et l’adaptation aux changements de structure HTML. Les fonctionnalités IA ou le mode navigateur de Thunderbit peuvent aider à surmonter bon nombre de ces défis.

5. Comment exporter vers Excel ou CSV les données extraites avec BeautifulSoup ?

Vous pouvez utiliser le module csv intégré à Python ou la bibliothèque pandas pour écrire vos données extraites dans des fichiers CSV ou Excel. Utilisez toujours l’encodage UTF-8 pour gérer les caractères spéciaux et garantir la compatibilité avec les tableurs.

Prêt à essayer par vous-même ? Téléchargez et commencez dès aujourd’hui à faire du scraping plus intelligemment. Pour plus de tutoriels et d’astuces, rendez-vous sur le .

En savoir plus