L’extraction de données web, autrefois réservée à quelques initiés, est aujourd’hui devenue un vrai super-pouvoir pour tous ceux qui bossent dans la vente, les opérations ou l’analyse de marché. Avec la quantité de données en ligne qui explose — la création de données mondiales a grimpé de près de — c’est logique que voient la data comme le « cœur » de leurs décisions. Mais il y a un hic : galèrent avec la gestion des données non structurées (genre du HTML en vrac). J’ai vu pas mal d’équipes s’user à copier-coller des infos de sites web dans des tableurs — franchement, c’est pas la joie.

C’est là que BeautifulSoup pour Python entre en scène. Dans ce tuto, je vais te montrer comment utiliser BeautifulSoup pour l’extraction de données web, avec un exemple concret en Python que tu pourras adapter à tes propres besoins pro. Et comme je suis pour l’efficacité, je t’explique aussi comment combiner BeautifulSoup avec , notre extracteur web IA, pour booster ton workflow et obtenir des données propres et bien rangées — même si tu n’es pas un as du code.

C’est quoi BeautifulSoup et pourquoi l’utiliser pour l’extraction web ?

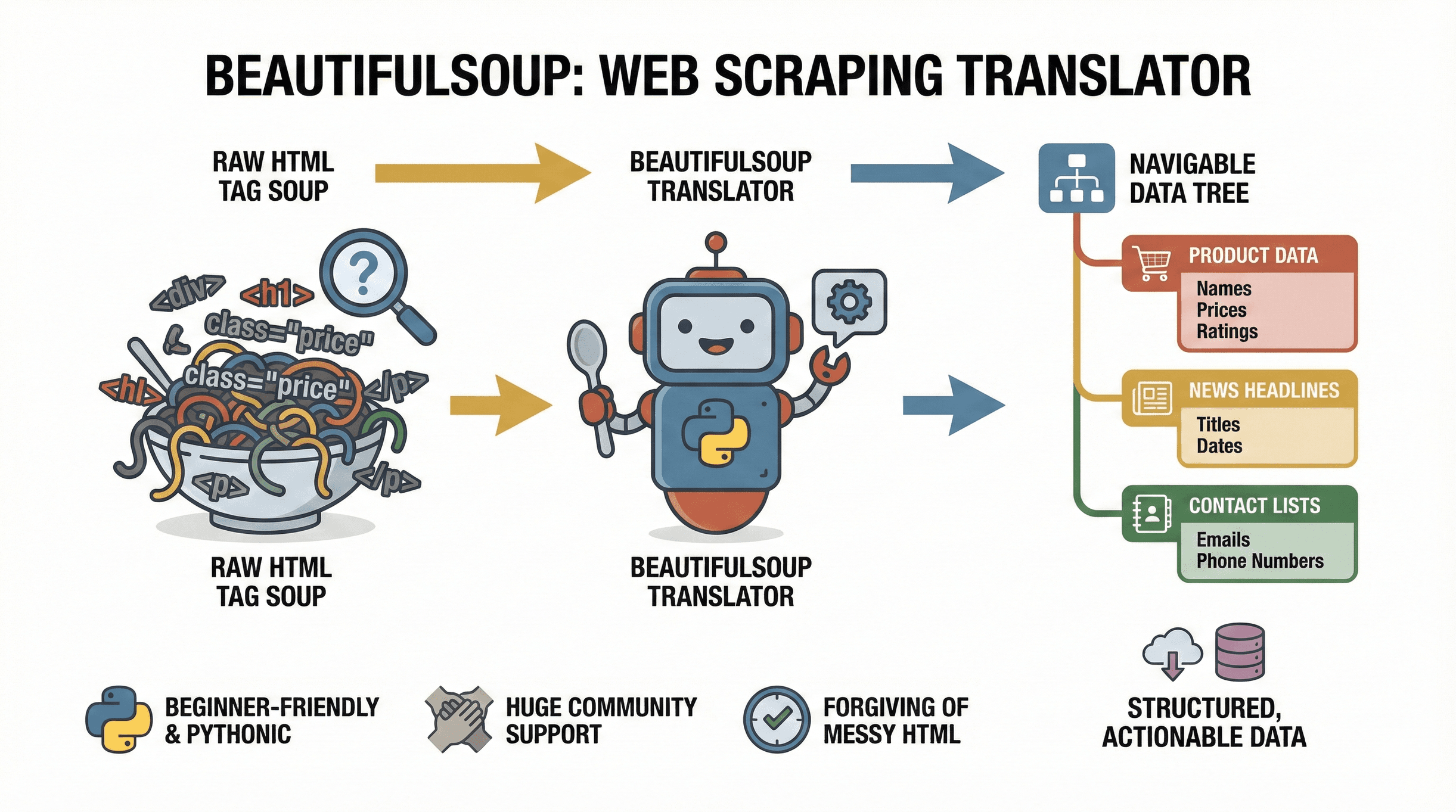

On commence par la base. c’est une bibliothèque Python qui rend l’analyse des documents HTML et XML super simple. Imagine-la comme un traducteur : elle transforme le « brouillard de balises » d’une page web en une structure claire, facile à explorer, pour que tu puisses repérer, extraire et manipuler les infos qui t’intéressent. Que tu veuilles récupérer les prix sur un site e-commerce, choper des titres d’actu ou extraire des contacts depuis un annuaire, BeautifulSoup est l’outil parfait pour transformer des pages web en données exploitables.

On commence par la base. c’est une bibliothèque Python qui rend l’analyse des documents HTML et XML super simple. Imagine-la comme un traducteur : elle transforme le « brouillard de balises » d’une page web en une structure claire, facile à explorer, pour que tu puisses repérer, extraire et manipuler les infos qui t’intéressent. Que tu veuilles récupérer les prix sur un site e-commerce, choper des titres d’actu ou extraire des contacts depuis un annuaire, BeautifulSoup est l’outil parfait pour transformer des pages web en données exploitables.

Pourquoi tout le monde l’adore ? Déjà, elle est ultra accessible pour les débutants. BeautifulSoup gère sans broncher le HTML mal fichu (et sur le web, c’est monnaie courante), et sa syntaxe « pythonic » te permet de passer de zéro à l’extraction en quelques lignes. En plus, la communauté est énorme et il y a des millions de téléchargements — donc si tu bloques, Google a sûrement la réponse.

Quelques exemples d’utilisation de BeautifulSoup :

- Extraire noms de produits, prix et notes sur des sites e-commerce

- Récupérer titres, auteurs et dates sur des sites d’actualités

- Analyser des tableaux ou des annuaires (listes d’entreprises, de contacts…)

- Choper des emails ou numéros de téléphone sur des sites d’annonces

- Suivre des mises à jour (changements de prix, nouvelles offres d’emploi, etc.)

Si tes données sont dans du HTML statique, BeautifulSoup est ton meilleur pote pour l’extraction web.

Les atouts de BeautifulSoup pour l’extraction web

Il existe plein de bibliothèques Python pour le scraping — alors pourquoi BeautifulSoup ? Voilà ses points forts :

- Simplicité : BeautifulSoup est légère et super facile à prendre en main. Pas besoin de framework compliqué ni de tonnes de code. Parfait pour des petits besoins ou pour débuter.

- Tolérance : Elle gère le HTML cassé ou mal structuré sans souci, ce qui arrive plus souvent qu’on ne le pense.

- Flexibilité : Tu n’es pas coincé dans une architecture rigide. Tu lui files du HTML et tu extrais ce que tu veux.

- Intégration : BeautifulSoup marche nickel avec d’autres bibliothèques Python comme

requests(pour choper les pages),csv(pour sauvegarder les données) oupandas(pour l’analyse).

Comment elle se compare aux autres outils ?

| Outil | Idéal pour | Avantages | Inconvénients |

|---|---|---|---|

| BeautifulSoup | Analyse HTML statique, débutants | Simple, rapide à configurer, tolérante, flexible | Pas adaptée aux sites très dynamiques (JavaScript) |

| Scrapy | Projets à grande échelle, asynchrones | Puissante, évolutive, crawling intégré | Courbe d’apprentissage plus raide, configuration plus lourde |

| Selenium | Contenu dynamique/JavaScript | Peut interagir avec le JS, remplir des formulaires, cliquer | Plus lent, plus lourd, consomme plus de ressources |

Si tu débutes ou veux extraire vite fait des pages statiques, BeautifulSoup c’est le « couteau suisse » de l’extraction web (). Pour des sites plus complexes ou dynamiques, tu peux la coupler avec Selenium ou Scrapy — mais BeautifulSoup reste la meilleure porte d’entrée.

Préparer ton environnement Python pour BeautifulSoup

Prêt à te lancer ? Voilà comment préparer ton environnement :

-

Installer Python : Télécharge la dernière version sur .

-

Créer un environnement virtuel (optionnel mais conseillé) :

1python -m venv venv 2source venv/bin/activate # Sous Windows : venv\Scripts\activate -

Installer BeautifulSoup et ses dépendances :

1pip install beautifulsoup4 requests lxml html5libbeautifulsoup4: la bibliothèque principalerequests: pour choper les pages weblxmlouhtml5lib: parseurs HTML plus rapides/fiables

-

Astuces si tu galères :

- Si tu as une erreur « pip not found », tente

pip3oupy -m pip. - Sur Mac/Linux, il faut parfois utiliser

sudo. - Sous Windows, vérifie que Python est bien dans ton PATH.

- Si tu as une erreur « pip not found », tente

Pour vérifier que tout roule, fais ce test rapide :

1from bs4 import BeautifulSoup

2import requests

3html = requests.get("http://example.com").text

4soup = BeautifulSoup(html, "html.parser")

5print(soup.title)Si tu vois <title>Example Domain</title>, c’est que tout est prêt ().

Exemple pas à pas : BeautifulSoup en Python

Passons à du concret. Imaginons que tu veux extraire les derniers titres d’actu d’un site d’infos. Voilà comment faire :

1. Récupérer la page web

1import requests

2from bs4 import BeautifulSoup

3url = "https://www.bbc.com/news"

4response = requests.get(url)

5html = response.text2. Analyser le HTML

1soup = BeautifulSoup(html, "html.parser")3. Inspecter la structure HTML

Ouvre les outils de développement de ton navigateur (clic droit → Inspecter) et repère les balises qui contiennent les titres. Sur beaucoup de sites d’actu, les titres sont dans des balises <h3> avec des classes spécifiques.

Par exemple :

1<h3 class="gs-c-promo-heading__title">Titre de l’article</h3>4. Extraire les données

1headlines = soup.find_all("h3", class_="gs-c-promo-heading__title")

2for h in headlines:

3 print(h.get_text(strip=True))Ça va afficher tous les titres d’actu de la page.

5. Sauvegarder les données en CSV

On enregistre ces titres pour les analyser plus tard :

1import csv

2with open("headlines.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.writer(file)

4 writer.writerow(["headline"])

5 for h in headlines:

6 writer.writerow([h.get_text(strip=True)])Tu obtiens un fichier CSV prêt à être ouvert dans Excel ou Google Sheets.

Comprendre la structure HTML pour une extraction efficace

Avant de coder, inspecte toujours le HTML de la page. Voici comment faire :

- Ouvre les outils de développement : Clic droit sur la page, puis « Inspecter ».

- Repère les données : Survole les éléments pour trouver les balises qui contiennent ce que tu cherches (titres, prix, auteurs…).

- Note les balises et classes : Cherche des identifiants uniques comme

class="product-title"ouid="main-content". - Teste tes sélecteurs : Utilise

.find(),.find_all()ou.select()de BeautifulSoup pour cibler ces éléments.

Astuce : soup.prettify() te donne une version lisible du HTML dans ta console Python.

Extraire et structurer les données avec BeautifulSoup

Supposons que tu veuilles extraire à la fois les titres et les auteurs d’un blog :

1articles = soup.find_all("article")

2data = []

3for article in articles:

4 title = article.find("h2").get_text(strip=True)

5 author = article.find("span", class_="author").get_text(strip=True)

6 data.append({"title": title, "author": author})Tu obtiens une liste de dictionnaires — parfait pour l’export en CSV ou une analyse plus poussée.

Pour extraire des liens, images ou autres attributs :

1for link in soup.find_all("a"):

2 print(link.get("href"))Ou des images :

1for img in soup.find_all("img"):

2 print(img.get("src"))Sauvegarder les données extraites : de Python vers Excel ou CSV

Une fois tes données structurées, l’export est simple. Voilà comment faire avec le module csv :

1import csv

2with open("articles.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.DictWriter(file, fieldnames=["title", "author"])

4 writer.writeheader()

5 for row in data:

6 writer.writerow(row)Ou, si tu préfères pandas :

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv("articles.csv", index=False)

4df.to_excel("articles.xlsx", index=False)Pense toujours à utiliser l’encodage UTF-8 pour éviter les soucis de caractères, surtout avec des données internationales.

Cas pratique : extraire des données d’un site d’actualités avec BeautifulSoup

Prenons un exemple concret : extraire titres, auteurs et dates de publication d’un site d’actu.

Supposons que tu veuilles extraire ces infos sur :

1import requests

2from bs4 import BeautifulSoup

3import csv

4url = "https://edition.cnn.com/world"

5response = requests.get(url)

6soup = BeautifulSoup(response.content, "html.parser")

7articles = soup.find_all("article")

8data = []

9for article in articles:

10 title_tag = article.find("h3")

11 date_tag = article.find("span", class_="date")

12 author_tag = article.find("span", class_="author")

13 title = title_tag.get_text(strip=True) if title_tag else ""

14 date = date_tag.get_text(strip=True) if date_tag else ""

15 author = author_tag.get_text(strip=True) if author_tag else ""

16 data.append({"title": title, "date": date, "author": author})

17with open("cnn_articles.csv", "w", newline='', encoding="utf-8") as file:

18 writer = csv.DictWriter(file, fieldnames=["title", "date", "author"])

19 writer.writeheader()

20 for row in data:

21 writer.writerow(row)Ce script récupère les derniers articles, extrait le titre, la date et l’auteur, puis les enregistre dans un CSV. Tu peux ensuite utiliser ces données pour surveiller la concurrence, analyser les tendances ou faire de la veille de contenu.

Optimiser ton workflow : combiner BeautifulSoup et Thunderbit

Voyons comment rendre ton extraction de données encore plus fluide. est une extension Chrome d’extraction web IA qui simplifie l’identification et l’extraction des données. Avec Thunderbit, tu peux :

- Utiliser la « Suggestion de champs IA » : Thunderbit analyse la page et te propose direct les champs à extraire — plus besoin de fouiller dans le HTML ou de bidouiller les sélecteurs.

- Extraire les sous-pages : Thunderbit peut suivre les liens vers des sous-pages (fiches produits, articles…) et enrichir ton jeu de données.

- Exporter instantanément : Envoie tes données en un clic vers Excel, Google Sheets, Airtable ou Notion.

- Gérer la pagination : Thunderbit extrait les données sur plusieurs pages (même avec scroll infini).

- Planifier des extractions : Programme des tâches récurrentes pour garder tes données à jour.

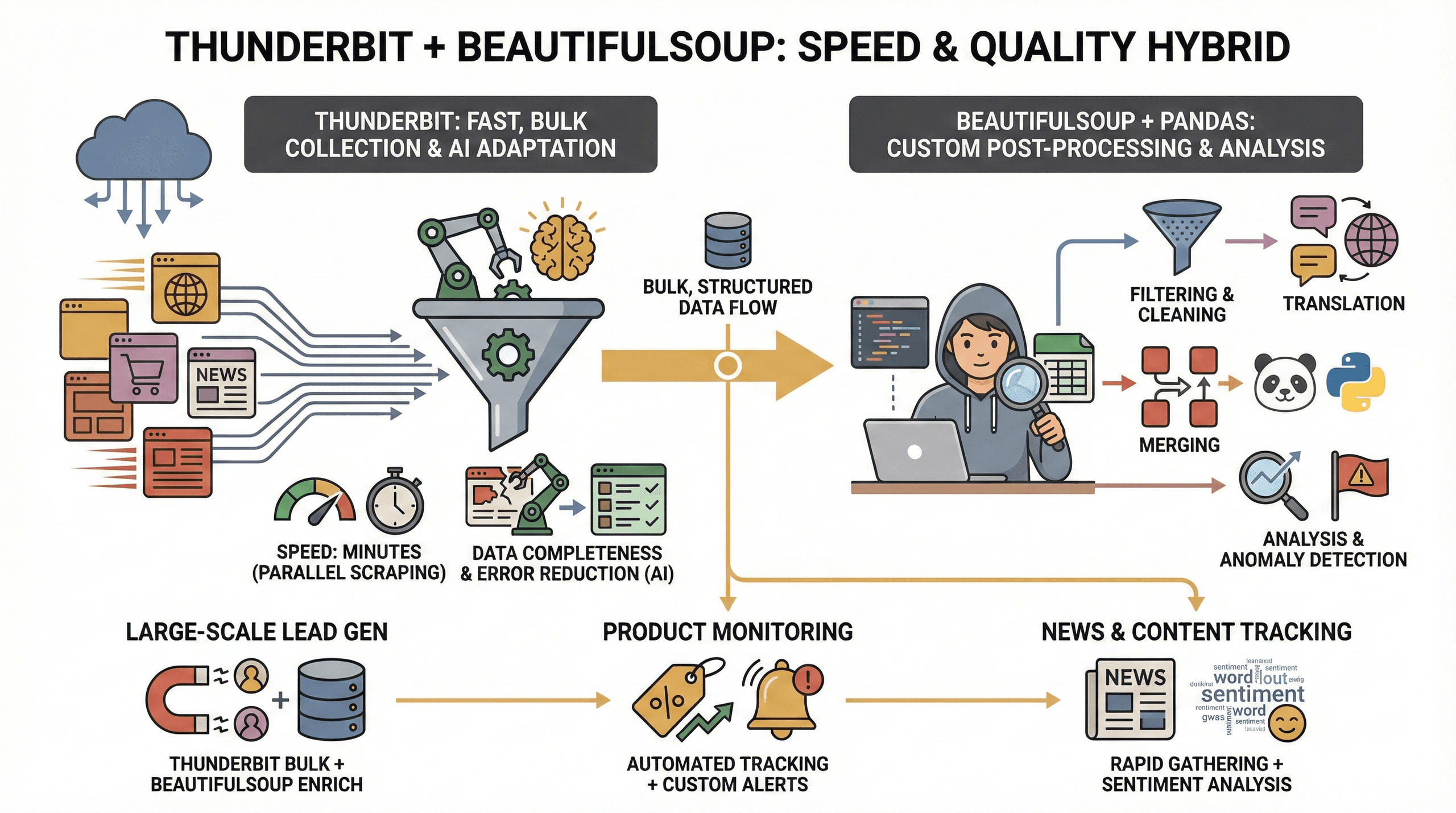

Voici un workflow hybride que j’adore :

- Commence avec Thunderbit : Ouvre le site cible, clique sur l’icône Thunderbit et laisse la « Suggestion de champs IA » détecter les bonnes colonnes (titre, auteur, date…).

- Exporte les données : Télécharge les résultats en CSV ou envoie-les vers Google Sheets.

- Utilise BeautifulSoup pour un traitement sur mesure : Pour des analyses plus poussées (nettoyage, déduplication, fusion avec d’autres sources…), charge le CSV exporté dans Python et utilise BeautifulSoup ou pandas pour le post-traitement.

Cette combinaison te donne le meilleur des deux mondes : la rapidité et l’intelligence de Thunderbit, et la flexibilité de BeautifulSoup pour des traitements personnalisés.

Vitesse et qualité des données : pourquoi associer Thunderbit et BeautifulSoup ?

Pourquoi utiliser les deux ? Voilà ce que j’ai remarqué :

Pourquoi utiliser les deux ? Voilà ce que j’ai remarqué :

- Vitesse : Thunderbit peut extraire des dizaines de pages en même temps (jusqu’à 50 en mode cloud), donc tu récupères tes données en quelques minutes.

- Données complètes : L’IA de Thunderbit s’adapte aux changements de mise en page et extrait des données structurées même sur des sites compliqués, avec moins de champs manquants.

- Moins d’erreurs : Fini les scripts qui plantent à chaque changement de classe — l’IA de Thunderbit réévalue la page à chaque extraction.

- Post-traitement sur mesure : Pour des besoins avancés (filtrage, traduction, fusion de jeux de données…), BeautifulSoup et pandas te donnent un contrôle total.

Cette approche hybride est top pour :

- Génération de leads à grande échelle : Utilise Thunderbit pour collecter la masse de données, puis BeautifulSoup pour les nettoyer et les enrichir.

- Veille produits : Thunderbit gère l’extraction répétitive, BeautifulSoup permet d’analyser les tendances ou de détecter les anomalies.

- Suivi de contenus et d’actualités : Récupère rapidement les articles avec Thunderbit, puis analyse-les en Python (analyse de sentiment, extraction de mots-clés…).

Résoudre les problèmes courants avec BeautifulSoup

L’extraction web, c’est pas toujours un long fleuve tranquille — voici les galères fréquentes et comment les éviter :

- Contenu dynamique : Si un site charge ses données en JavaScript (scroll infini, AJAX…), BeautifulSoup seul ne verra rien. Utilise Selenium ou le mode navigateur de Thunderbit dans ces cas-là.

- Anti-bots : Certains sites bloquent les requêtes automatiques. Essaie de personnaliser l’en-tête User-Agent, d’ajouter des pauses entre les requêtes, ou utilise le mode cloud de Thunderbit pour contourner les blocages simples.

- Changements de structure HTML : Si ton script ne marche plus, le HTML du site a sûrement changé. Inspecte à nouveau la page et ajuste tes sélecteurs. L’IA de Thunderbit peut aussi s’adapter toute seule.

- Données manquantes : Vérifie toujours qu’un élément existe avant d’appeler

.get_text(). Utilise.get()plutôt que[]pour les attributs, ça évite les plantages. - Problèmes d’encodage : Enregistre tes fichiers en UTF-8 pour gérer les caractères spéciaux.

Et surtout, respecte toujours le robots.txt et les conditions d’utilisation du site. Scrape de façon responsable — personne n’aime les robots malpolis.

Conclusion & points clés à retenir

L’extraction web avec BeautifulSoup, c’est vraiment une compétence à avoir dans un monde où la data est reine. Voilà ce qu’il faut retenir de ce tuto :

- BeautifulSoup est la solution idéale pour débuter et extraire des données structurées à partir de HTML statique avec Python.

- La mise en place est rapide : installe Python, pip et quelques bibliothèques.

- L’inspection du HTML est essentielle pour cibler les bonnes données.

- L’export en CSV/Excel rend tes données tout de suite exploitables pour l’analyse métier.

- La combinaison avec Thunderbit te permet de détecter automatiquement les champs, d’extraire plus vite et d’exporter facilement — parfait pour les pros et ceux qui ne codent pas.

- Les workflows hybrides (Thunderbit pour l’extraction massive, BeautifulSoup pour le traitement sur mesure) offrent le meilleur compromis entre rapidité, qualité et flexibilité.

Prêt à passer à la vitesse supérieure ? Teste les deux outils : commence par un script BeautifulSoup simple, puis découvre comment Thunderbit peut accélérer tes extractions grâce à l’IA. Pour plus de guides pratiques, va faire un tour sur le .

Bonne extraction — et que tes données soient toujours propres, structurées et prêtes à l’emploi !

FAQ

1. C’est quoi BeautifulSoup et à quoi ça sert ?

BeautifulSoup est une bibliothèque Python pour analyser des documents HTML et XML. Elle permet d’extraire des données de pages web et de les structurer sous forme de listes ou de tableaux, parfaite pour les projets d’extraction web.

2. Comment BeautifulSoup se compare à Selenium et Scrapy ?

BeautifulSoup est léger et facile à utiliser pour les pages HTML statiques. Selenium est plus adapté aux sites dynamiques bourrés de JavaScript, tandis que Scrapy est un framework complet pour l’extraction à grande échelle et asynchrone. BeautifulSoup est le choix idéal pour débuter ou pour des tâches rapides.

3. Peut-on utiliser BeautifulSoup et Thunderbit ensemble ?

Carrément. Thunderbit identifie et extrait rapidement les champs d’une page grâce à l’IA, et tu peux utiliser BeautifulSoup pour un post-traitement ou une analyse plus poussée des données exportées.

4. Quels sont les défis courants avec BeautifulSoup ?

Les galères fréquentes : gérer le contenu dynamique, les protections anti-bots et s’adapter aux changements de structure HTML. Les fonctions IA ou le mode navigateur de Thunderbit peuvent t’aider à passer ces obstacles.

5. Comment exporter les données extraites avec BeautifulSoup vers Excel ou CSV ?

Tu peux utiliser le module csv de Python ou la bibliothèque pandas pour écrire tes données extraites dans des fichiers CSV ou Excel. Utilise toujours l’encodage UTF-8 pour gérer les caractères spéciaux et garantir la compatibilité avec les tableurs.

Envie d’essayer par toi-même ? Télécharge et commence à extraire plus intelligemment dès aujourd’hui. Pour plus de tutos et d’astuces, passe sur le .

En savoir plus