Le web déborde de données, et si vous travaillez dans le business, la tech, ou si vous êtes simplement un peu curieux, vous avez sans doute déjà rêvé de récupérer en masse des informations depuis un site web — sans passer tout votre après-midi à copier-coller. Et voici le plus intéressant : d’ici 2025, près de la moitié du trafic Internet sera constituée de bots qui parcourent et extraient des données sur le web, et plus de 70 % des entreprises numériques s’appuieront sur des données web publiques pour l’intelligence de marché et leurs opérations (). Mais si le besoin en données web a explosé, le processus pour les extraire peut être, disons, un peu pénible — surtout avec les sites web dynamiques d’aujourd’hui, propulsés par JavaScript.

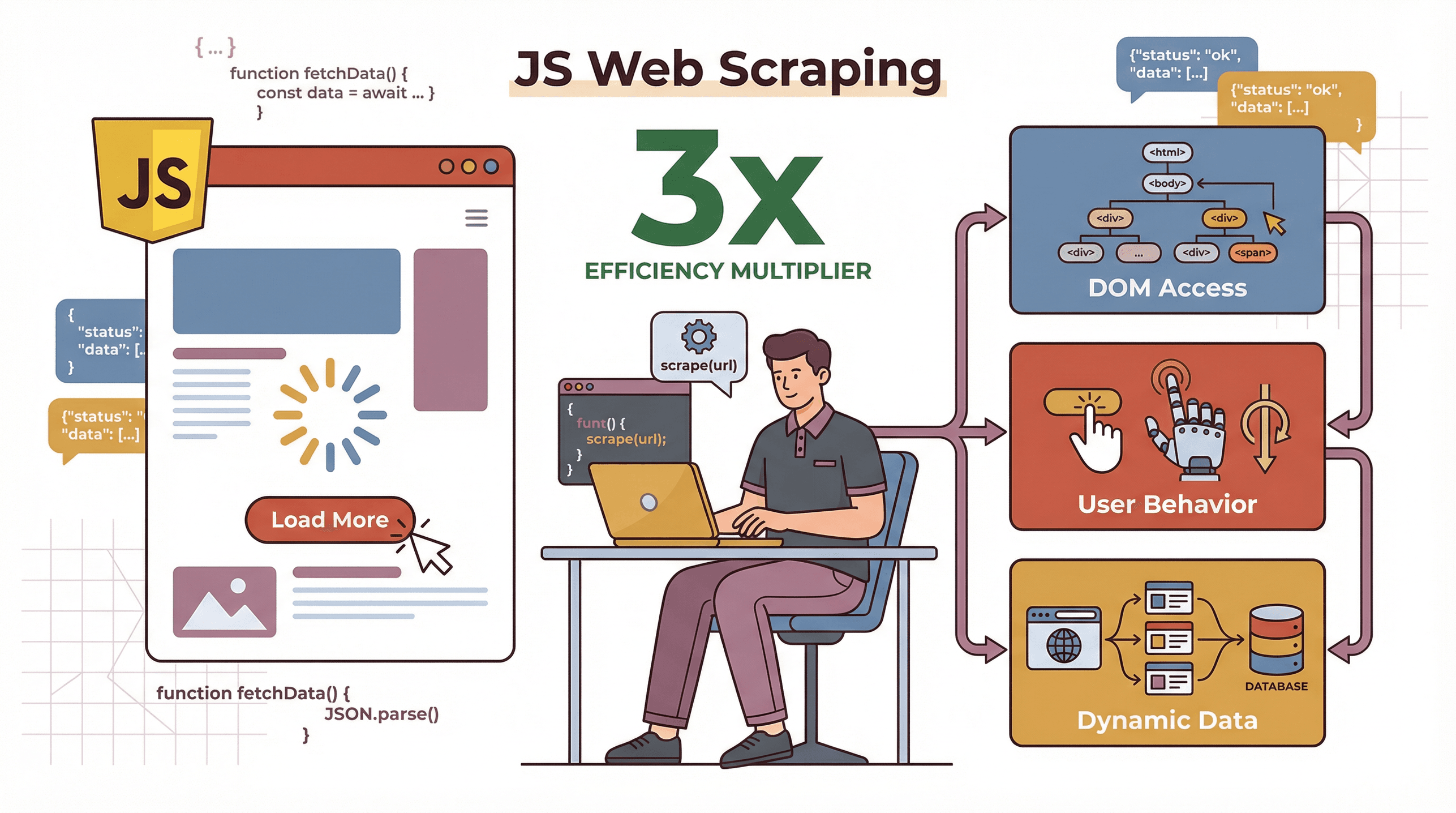

C’est là qu’intervient JavaScript. En tant que langage du web, JavaScript est particulièrement adapté pour gérer les pages dynamiques et interactives qui font trébucher les extracteurs à l’ancienne. Que vous soyez développeur et cherchiez à automatiser une veille, commercial en train de constituer des listes de prospects, ou simplement bricoleur dans l’âme, ce guide vous accompagnera sur l’essentiel de la création d’un extracteur Web JavaScript — des bases aux techniques avancées, et même jusqu’à l’option de se passer totalement de code avec des outils d’IA comme .

Bases d’un extracteur JavaScript : qu’est-ce que l’extraction Web avec JavaScript ?

Commençons par les bases. L’extraction Web consiste à récupérer automatiquement des informations depuis des sites web. Imaginez un assistant ultra-rapide capable de visiter des centaines de pages, de copier les données dont vous avez besoin et de les organiser dans un tableur bien propre — sans jamais se plaindre du syndrome du canal carpien.

Un extracteur JavaScript est tout simplement un extracteur Web construit avec JavaScript. Vous pouvez l’exécuter de deux grandes façons :

- Dans le navigateur : exécuter des scripts directement dans la console de votre navigateur ou utiliser des extensions pour récupérer des données sur la page que vous consultez.

- Côté serveur (Node.js) : utiliser JavaScript en dehors du navigateur (grâce à Node.js) pour récupérer des pages web, analyser leur contenu et extraire les données de manière programmatique.

Pourquoi est-ce important pour les utilisateurs métier ? Parce que l’extraction Web alimente tout, de la génération de leads (récupérer des contacts depuis des annuaires), à la surveillance des prix (suivre les concurrents), en passant par la veille marché (collecter avis, actualités ou tendances). En réalité, 48 % des utilisateurs d’extraction Web travaillent dans l’e-commerce à eux seuls (). Si vous pouvez le voir dans votre navigateur, un extracteur JavaScript peut probablement le récupérer pour vous.

Pourquoi l’extraction Web avec JavaScript ? Les avantages clés pour les sites modernes

Alors, pourquoi utiliser JavaScript pour l’extraction, surtout quand Python semble monopoliser toute l’attention dans les cercles de data science ? Le secret est simple : les sites web modernes reposent sur JavaScript. Ils chargent du contenu de manière dynamique, récupèrent des données après le chargement de la page et exigent souvent des interactions utilisateur (comme cliquer sur « Charger plus » ou faire défiler la page). Les extracteurs JavaScript peuvent :

Alors, pourquoi utiliser JavaScript pour l’extraction, surtout quand Python semble monopoliser toute l’attention dans les cercles de data science ? Le secret est simple : les sites web modernes reposent sur JavaScript. Ils chargent du contenu de manière dynamique, récupèrent des données après le chargement de la page et exigent souvent des interactions utilisateur (comme cliquer sur « Charger plus » ou faire défiler la page). Les extracteurs JavaScript peuvent :

- Gérer le contenu dynamique : comme JavaScript est le langage qui s’exécute dans votre navigateur, il peut voir et interagir avec du contenu qui n’apparaît qu’après l’exécution des scripts.

- Imiter le comportement réel d’un utilisateur : des outils comme Puppeteer permettent d’automatiser des clics, des défilements et même des connexions, comme le ferait une personne.

- Travailler nativement avec le DOM : JavaScript peut accéder directement à la structure de la page et la manipuler, ce qui facilite l’extraction précise de ce dont vous avez besoin.

Comment JavaScript se compare-t-il aux autres langages ? Voici un aperçu rapide :

| Facteur | JavaScript (Node.js) | Python | PHP |

|---|---|---|---|

| Contenu dynamique | Excellent — s’exécute nativement dans le navigateur, idéal pour les sites riches en JS | Nécessite des outils supplémentaires (Selenium/Playwright) pour le contenu dynamique | Limité |

| Vitesse/Concurrence | Élevée — modèle asynchrone, récupère de nombreuses pages en parallèle | Bon, mais nécessite asyncio/Scrapy pour la concurrence | Plus lent, moins courant |

| Facilité d’utilisation | Moyenne — les développeurs web s’y sentent chez eux, l’asynchrone peut piéger les débutants | Plus facile pour les débutants, beaucoup de tutoriels | Basique, moins flexible |

| Automatisation du navigateur | Au plus haut niveau (Puppeteer, Playwright) | Bonne (Selenium, Playwright) | Rare |

| Idéal pour | Sites dynamiques, interactifs ou SPA ; workflows de développement web | Analyse de données, sites statiques, scripts rapides | Sites statiques simples |

Si votre site cible est une application monopage ou charge ses données au défilement ou au clic, JavaScript est souvent l’outil le plus adapté ().

Configurer votre premier extracteur JavaScript : outils et environnement

Prêt à mettre les mains dans le cambouis ? Voici comment configurer un environnement d’extraction JavaScript de base — sans framework requis.

-

Installer Node.js

Téléchargez et installez Node.js depuis . Cela vous permet d’exécuter JavaScript en dehors du navigateur. -

Initialiser un projet

Ouvrez votre terminal et lancez :1mkdir my-scraper 2cd my-scraper 3npm init -y -

Installer les bibliothèques essentielles

Vous aurez besoin de :- ou

node-fetchpour les requêtes HTTP - pour analyser le HTML (en quelque sorte, le jQuery du serveur)

1npm install axios cheerio - ou

-

Inspecter le site cible

Ouvrez Chrome DevTools (clic droit > Inspecter) et repérez les éléments HTML qui contiennent vos données. Notez leurs classes, IDs ou balises.

Voici un script de démarrage simple :

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapePage(url) {

4 try {

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const pageTitle = $('head > title').text();

8 console.log("Titre de la page :", pageTitle);

9 } catch (err) {

10 console.error("L’extraction a échoué :", err);

11 }

12}

13scrapePage('https://example.com');Lancez-le avec node scrape.js et vous verrez le titre de la page s’afficher. Pas mal pour quelques lignes de code !

Construire un extracteur Web JavaScript de base : guide pas à pas

Construisons quelque chose d’un peu plus utile. Supposons que vous vouliez extraire les titres et les prix de livres depuis , un site d’entraînement classique.

Étape 1 : inspecter la page

Chaque livre se trouve dans un <article class="product_pod">. Le titre est dans <h3><a title="Book Title"></a></h3>, et le prix dans <p class="price_color">.

Étape 2 : écrire l’extracteur

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapeBooks() {

4 const url = 'http://books.toscrape.com/';

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const books = [];

8 $('article.product_pod').each((i, elem) => {

9 const title = $(elem).find('h3 a').attr('title');

10 const price = $(elem).find('.price_color').text();

11 books.push({ title, price });

12 });

13 console.log(books);

14}

15scrapeBooks();Ce script récupère la page, analyse le HTML, parcourt chaque livre et extrait le titre ainsi que le prix. Le résultat ? Un tableau propre d’objets livre :

1[

2 { "title": "A Light in the Attic", "price": "£51.77" },

3 { "title": "Tipping the Velvet", "price": "£53.74" }

4]Étape 3 : étendre à la pagination

Vous voulez extraire plusieurs pages ? Cherchez le lien « Suivant » et bouclez sur les pages en mettant à jour l’URL à chaque tour. Avec un peu plus de code, vous pouvez extraire tout le site.

Aller plus loin : gérer le contenu dynamique et les interactions utilisateur avec JavaScript

Passons maintenant à la partie amusante — et parfois frustrante : le contenu dynamique. De nombreux sites modernes n’affichent pas toutes leurs données dans le HTML initial. À la place, ils les chargent avec JavaScript après l’ouverture de la page, ou exigent que vous cliquiez sur des boutons ou que vous fassiez défiler pour voir davantage.

Cheerio et Axios ne verront pas ce contenu — ils ne récupèrent que le HTML brut. Pour extraire des sites dynamiques, il vous faut un navigateur headless comme .

Utiliser Puppeteer pour une extraction Web JavaScript avancée

Puppeteer vous permet de contrôler Chrome (ou Chromium) par le code. Vous pouvez :

- ouvrir des pages

- attendre le chargement d’éléments

- cliquer sur des boutons, remplir des formulaires, faire défiler

- extraire le contenu après l’exécution complète des scripts

Voici un script Puppeteer simple :

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com', { waitUntil: 'networkidle0' });

6 await page.waitForSelector('.dynamic-content');

7 const data = await page.evaluate(() => {

8 return Array.from(document.querySelectorAll('.dynamic-content'))

9 .map(el => el.textContent.trim());

10 });

11 console.log(data);

12 await browser.close();

13})();Vous pouvez même automatiser des connexions, cliquer sur des boutons « Charger plus » ou gérer le défilement infini en faisant défiler la page par programme et en attendant l’apparition de nouveaux contenus ().

Thunderbit : simplifier et améliorer l’extraction JavaScript

Soyons francs : écrire des extracteurs de zéro, c’est puissant, mais cela demande du temps, des compétences techniques et de la maintenance continue. C’est pourquoi j’aime autant , notre extension Chrome alimentée par l’IA qui transforme l’extraction Web en une affaire de deux clics.

Thunderbit est conçu pour les utilisateurs métier — sans code requis. Voici comment cela fonctionne :

- Suggestions de champs par IA : cliquez sur un bouton et l’IA de Thunderbit analyse la page pour suggérer les meilleures colonnes à extraire (comme « Nom du produit », « Prix », « Email », etc.).

- Extraction en 2 clics : vérifiez les champs suggérés, cliquez sur « Extraire », et Thunderbit récupère toutes les données — en gérant automatiquement la pagination et les sous-pages.

- Gestion des sous-pages et de la pagination : besoin de plus de détails ? Thunderbit peut suivre les liens vers des sous-pages (comme des fiches produit ou des profils) et fusionner ces données dans votre tableau.

- Mode cloud ou navigateur : extrayez dans votre navigateur (idéal pour les pages connectées) ou utilisez le cloud de Thunderbit pour aller plus vite (jusqu’à 50 pages d’un coup).

- Export structuré et gratuit : exportez vos données vers Excel, Google Sheets, Airtable, Notion, CSV ou JSON — toujours gratuitement, quelle que soit la quantité extraite.

Thunderbit en action : de l’extraction à l’export

Supposons que vous vouliez extraire les coordonnées depuis un annuaire d’entreprises :

- Installez Thunderbit ().

- Ouvrez la page de l’annuaire.

- Cliquez sur « Suggestions de champs par IA ». L’IA de Thunderbit propose des colonnes comme « Nom », « Téléphone », « Entreprise ».

- Cliquez sur « Extraire ». Thunderbit collecte toutes les données, même sur plusieurs pages.

- Exportez vers Sheets ou Excel. C’est terminé.

Ce qui prenait des heures — ou nécessitait un développeur — prend désormais quelques minutes. Et comme Thunderbit utilise l’IA, il résiste mieux aux changements de mise en page des sites web : plus besoin de scripts cassés à chaque mise à jour ().

Voici comment une extraction JavaScript traditionnelle se compare à Thunderbit :

| Critère | Extracteur JS manuel | JS avancé (Puppeteer) | Extracteur IA Thunderbit |

|---|---|---|---|

| Compétence requise | Codage | Codage avancé | Aucune (pointer-cliquer) |

| Contenu dynamique | Limité | Excellent | Intégré |

| Temps de configuration | Des heures par site | Des heures à des jours | De quelques secondes à quelques minutes |

| Maintenance | Élevée | Élevée | Faible (l’IA s’adapte) |

| Options d’export | Code personnalisé | Code personnalisé | Export en 1 clic vers Excel/Sheets/etc. |

| Coût | Gratuit (mais chronophage) | Gratuit (matériel, temps) | Offre gratuite, puis à partir de 15 $/mois |

Techniques avancées : extraction Web complexe avec les bibliothèques JavaScript

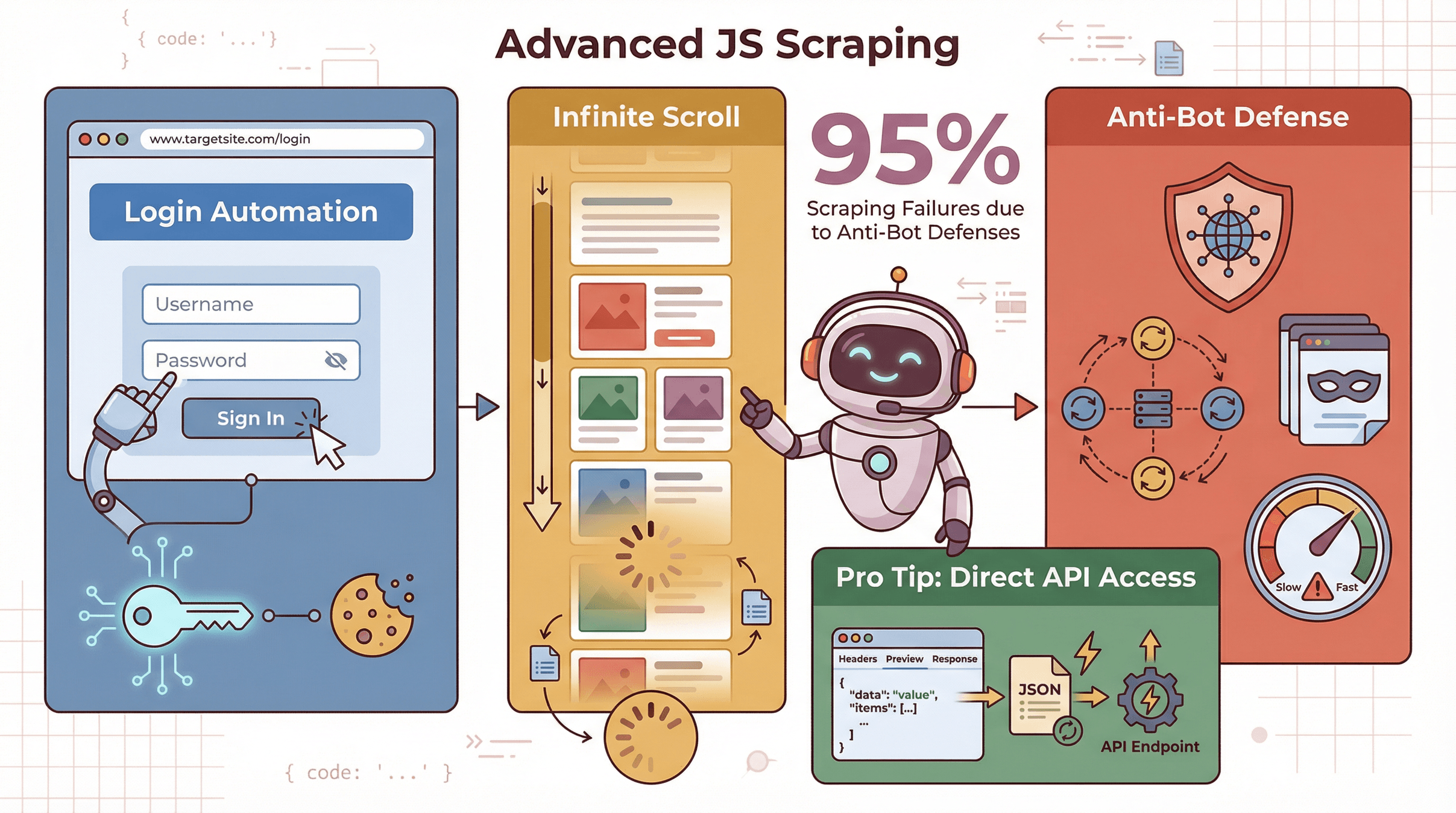

Parfois, il faut aller plus loin — extraire des données derrière une connexion, gérer le défilement infini ou contourner des protections anti-extraction.

Parfois, il faut aller plus loin — extraire des données derrière une connexion, gérer le défilement infini ou contourner des protections anti-extraction.

- Connexions/sessions : avec Puppeteer, vous pouvez automatiser la connexion en remplissant des formulaires et en cliquant sur des boutons, puis extraire les données en tant qu’utilisateur authentifié.

- Défilement infini : faites défiler la page par programme, attendez de nouveaux contenus, puis recommencez jusqu’à ce que toutes les données soient chargées ().

- Mesures anti-extraction : utilisez des proxys, faites tourner les user agents et limitez le rythme de vos requêtes pour éviter le blocage. Plus de 95 % des échecs d’extraction sont dus à des défenses anti-bot ().

Astuce de pro : parfois, vous pouvez même éviter totalement le navigateur en trouvant les points de terminaison API cachés du site (vérifiez l’onglet Network dans DevTools). Si vous pouvez récupérer des données JSON directement, votre extracteur sera beaucoup plus rapide.

Optimiser et maintenir votre robot d’extraction Web JavaScript

Construire un extracteur n’est que la moitié du travail — l’autre moitié consiste à le faire tourner sans accroc.

- Traitement asynchrone : utilisez async/await et récupérez les pages en parallèle (sans surcharger le serveur).

- Traitement par lots : traitez les données par blocs pour éviter les problèmes de mémoire.

- Gestion des erreurs : attrapez les erreurs, relancez les requêtes échouées et journalisez les incidents pour le débogage.

- Pagination : détectez les liens ou boutons « Suivant » et bouclez sur les pages.

- Robustesse des sélecteurs : utilisez des IDs ou des classes uniques ; évitez les sélecteurs fragiles qui cassent si la mise en page change.

- Surveillance : mettez en place des alertes si votre extracteur commence à renvoyer des données vides ou des erreurs.

Bonne pratique : l’extraction n’est jamais du type « on configure et on oublie ». Prévoyez des mises à jour régulières et de la surveillance ().

Comparer les solutions d’extraction JavaScript : traditionnel vs Thunderbit

Voici un comparatif rapide pour les utilisateurs métier :

| Approche | Temps avant résultat | Compétence requise | Gère le contenu dynamique | Maintenance | Options d’export | Scalabilité |

|---|---|---|---|---|---|---|

| JS manuel (Cheerio) | Lent | Codage | Non | Élevée | À coder soi-même | Bon pour le statique |

| JS avancé (Puppeteer) | Modéré | Codage+ | Oui | Élevée | À coder soi-même | Plus lent par page |

| Thunderbit | Rapide | Aucune | Oui (alimenté par l’IA) | Faible | Export en 1 clic vers Sheets/CSV | Cloud ou navigateur |

Pour la plupart des utilisateurs métier, Thunderbit est le moyen le plus rapide de passer de « j’ai besoin de ces données » à « voici mon tableur ».

Conclusion et points clés à retenir

Créer un extracteur Web JavaScript est un superpouvoir dans le monde actuel piloté par la donnée. Voici ce que j’ai retenu — et ce que je vous recommande :

- Commencez simple : utilisez Cheerio et Axios pour les sites statiques.

- Passez au niveau avancé si nécessaire : utilisez Puppeteer pour les sites dynamiques, interactifs ou nécessitant une connexion.

- Gagnez du temps avec les outils d’IA : pour la plupart des besoins métier, vous permet d’éviter le code et d’obtenir des résultats en quelques minutes.

- Anticipez la maintenance : les sites changent — vos extracteurs doivent pouvoir s’adapter.

- Extrayez toujours de façon éthique : respectez les conditions du site, évitez de surcharger les serveurs et utilisez les données de manière responsable.

Si vous êtes curieux d’essayer l’extraction sans les tracas, et voyez à quel point cela peut être simple. Et si vous voulez aller plus loin, consultez le pour davantage de guides, de conseils et d’exemples concrets.

Bonne extraction — et que vos sélecteurs soient toujours uniques !

FAQ

1. Qu’est-ce qu’un extracteur Web JavaScript ?

Un extracteur Web JavaScript est un programme (ou script) écrit en JavaScript qui extrait automatiquement des données depuis des sites web. Il peut s’exécuter dans le navigateur ou sur le serveur (avec Node.js), et il est particulièrement efficace pour gérer les sites dynamiques riches en JavaScript.

2. Pourquoi choisir JavaScript plutôt que Python pour l’extraction Web ?

JavaScript est le langage du web, ce qui en fait un choix idéal pour extraire des sites qui chargent du contenu de manière dynamique ou qui exigent des interactions utilisateur. Python est excellent pour les sites statiques et l’analyse de données, mais il nécessite des outils supplémentaires pour le contenu dynamique.

3. De quels outils ai-je besoin pour créer un extracteur JavaScript ?

Pour les sites statiques : Node.js, Axios (ou fetch) et Cheerio. Pour les sites dynamiques : ajoutez Puppeteer ou Playwright pour l’automatisation d’un navigateur headless. Pour l’extraction sans code, essayez .

4. Comment Thunderbit simplifie-t-il l’extraction Web ?

Thunderbit utilise l’IA pour détecter et extraire automatiquement les données depuis n’importe quel site web. Il suffit de cliquer sur « Suggestions de champs par IA », puis sur « Extraire », et d’exporter vos données — sans coder ni devoir jongler avec des sélecteurs.

5. L’extraction Web est-elle légale et éthique ?

L’extraction Web est légale lorsqu’elle est réalisée de façon responsable — extrayez uniquement des données publiques, respectez les conditions d’utilisation du site et ne surchargez pas les serveurs. Évitez d’extraire des données personnelles sans consentement, et utilisez toujours les données de manière éthique.

Vous voulez voir l’extraction JavaScript en action ? Consultez la de Thunderbit pour des tutoriels, ou explorez davantage le .

En savoir plus