Je vais être honnête : la première fois que j’ai essayé de récupérer toutes les URL d’un gros site web, je me suis dit : « Ça peut être si compliqué que ça ? » Quelques heures plus tard, je cliquais encore de page en page, je copiais-collais des liens dans un tableur, et je remettais sérieusement en question mes choix de vie. Si vous avez déjà essayé de trouver toutes les pages d’un site web — pour un audit de contenu, une liste de prospects ou une veille concurrentielle — vous connaissez la galère. C’est fastidieux, source d’erreurs et, franchement, une perte de temps et de talent.

Mais voici la bonne nouvelle : vous n’êtes plus obligé de faire ça à la main. Des outils propulsés par l’IA comme changent la donne pour les utilisateurs métiers, en rendant possible le fait de trouver toutes les URL d’un domaine en quelques minutes, et non en plusieurs jours. En réalité, les entreprises qui utilisent des outils d’extraction web pilotés par l’IA constatent sur les tâches de collecte de données, et certaines rapportent jusqu’à par rapport aux méthodes manuelles. Ce n’est pas qu’une statistique : ce sont des heures, voire des jours, de votre vie récupérés.

Alors, voyons pourquoi trouver toutes les pages d’un site web est si difficile, pourquoi des modèles d’IA génériques comme GPT ou Claude ne peuvent pas vraiment vous aider, et comment des agents IA spécialisés — comme Thunderbit — rendent ce processus d’une simplicité déconcertante. Et oui, je vais vous montrer les étapes exactes pour extraire chaque URL dont vous avez besoin, même si vous n’êtes pas développeur.

Pourquoi il est si difficile de trouver toutes les URL d’un domaine

Avouons-le : les sites web ne sont pas conçus pour vous remettre une liste propre de toutes leurs pages. Ils sont pensés pour les visiteurs, pas pour les personnes qui veulent trouver toutes les pages d’un site web d’un coup. Voici pourquoi cette tâche est si pénible :

- La folie du copier-coller manuel : cliquer sur chaque menu, chaque liste et chaque répertoire, copier les URL une par une, c’est la recette parfaite pour le syndrome du canal carpien… et pour en rater la moitié.

- Pagination et défilement infini : de nombreux sites répartissent le contenu sur plusieurs pages ou chargent davantage de résultats au fur et à mesure que vous faites défiler. Il suffit d’ignorer un bouton « Suivant » ou de ne pas faire défiler assez loin pour passer à côté de sections entières.

- Structures de pages incohérentes : certaines pages affichent les liens dans un format, d’autres utilisent une mise en page différente. Tout suivre devient vite un cauchemar.

- Pages cachées ou orphelines : toutes les pages ne sont pas reliées depuis la navigation principale. Certaines sont profondément enfouies, accessibles seulement via un sitemap ou une recherche interne.

- Erreur humaine : plus vous devez copier de pages, plus vous risquez de faire des erreurs — URL dupliquées, fautes de frappe ou simple oubli.

Et si vous travaillez sur un site avec des centaines ou des milliers de pages ? Oubliez ça. L’extraction manuelle ne passe tout simplement pas à l’échelle. Comme l’a dit une équipe data : au-delà des cas triviaux, .

Que signifie « trouver toutes les pages d’un site web » ?

Avant de passer aux solutions, clarifions ce que nous cherchons réellement.

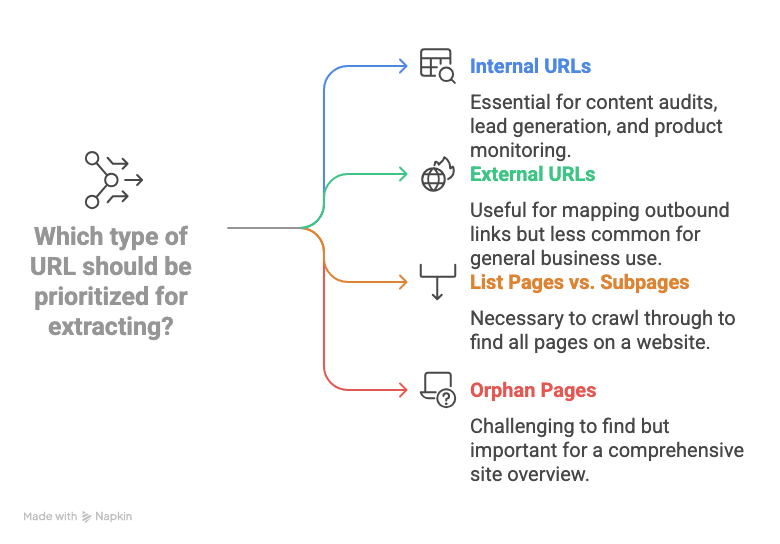

- URL internes : ce sont des liens qui pointent vers des pages du même domaine (comme /about-us ou /products/widget-123). Pour la plupart des usages métiers — audits de contenu, génération de leads, suivi de produits — ce sont les URL internes qui comptent le plus.

- URL externes : des liens qui renvoient vers d’autres sites web. En général, vous n’en avez pas besoin, sauf si vous cartographiez les liens sortants.

- Pages de liste vs sous-pages : de nombreux sites ont des pages « hub » ou de liste (par exemple : catégories, archives de blog, annuaires) qui renvoient vers des pages détaillées (comme des fiches produit ou des profils). Pour vraiment trouver toutes les pages d’un site web, vous devez parcourir ces listes et récupérer chaque sous-page liée.

- Pages orphelines : ce sont des pages qui ne sont reliées nulle part de manière évidente. Parfois, on peut les repérer via les sitemaps ou la recherche interne, mais elles sont faciles à manquer.

Donc, quand nous parlons de trouver toutes les URL d’un domaine, nous voulons dire : récupérer chaque URL de page interne, de la page d’accueil jusqu’au produit ou à l’article le plus profond, idéalement dans un format exploitable comme un tableur.

Les méthodes traditionnelles pour trouver toutes les URL d’un domaine

Il existe quelques méthodes à l’ancienne pour s’y attaquer, mais chacune apporte son lot de tracas :

Copier-coller manuel et outils de navigateur

C’est l’approche « à la force brute » : cliquer sur chaque lien, copier chaque URL, la coller dans un tableur et espérer ne rien oublier. Certaines personnes utilisent des extensions de navigateur pour récupérer tous les liens de la page en cours, mais il faut quand même recommencer sur chaque page, et vous êtes seul face à la pagination ou aux sections cachées. Ça passe pour un site de cinq pages — beaucoup moins pour un site plus vaste.

Utiliser la recherche du site et les sitemaps

- Recherche Google avec

site:: tapezsite:votredomaine.comdans Google, et vous verrez un certain nombre de pages indexées. Mais Google n’affiche que ce qu’il a indexé (souvent plafonné à environ 1 000 résultats), donc vous manquerez les pages nouvelles, cachées ou de faible qualité. elle-même admet que ce n’est pas une solution complète. - Sitemaps XML : de nombreux sites disposent d’un

/sitemap.xmlqui répertorie les URL importantes. Très bien — si le sitemap est à jour et contient toutes les pages. Mais tous les sites n’en ont pas, et certains répartissent leurs sitemaps en plusieurs fichiers. Les pages orphelines n’y figurent souvent pas.

Les crawlers techniques et les scripts

- Outils SEO (comme Screaming Frog) : ils parcourent un site comme un moteur de recherche et produisent une liste d’URL. Ils sont puissants, mais nécessitent une configuration, et parfois une licence payante pour les grands sites.

- Scripts Python (comme Scrapy) : les développeurs peuvent écrire des scripts pour explorer et extraire des URL. Mais soyons réalistes : si vous n’êtes pas à l’aise avec le code, ce n’est pas envisageable. En plus, les scripts cassent dès que la mise en page du site change, donc vous êtes constamment en train de rattraper le retard.

En résumé : les méthodes traditionnelles sont soit trop manuelles, soit trop incomplètes, soit trop techniques pour la plupart des utilisateurs métiers. Il y a une raison pour laquelle tant de gens abandonnent à mi-parcours.

Pourquoi les modèles d’IA génériques ne peuvent pas automatiser complètement l’extraction d’URL

Vous vous dites peut-être : « Je ne peux pas simplement demander à ChatGPT ou à Claude de trouver toutes les pages d’un site web pour moi ? » J’aimerais que ce soit si simple. En réalité :

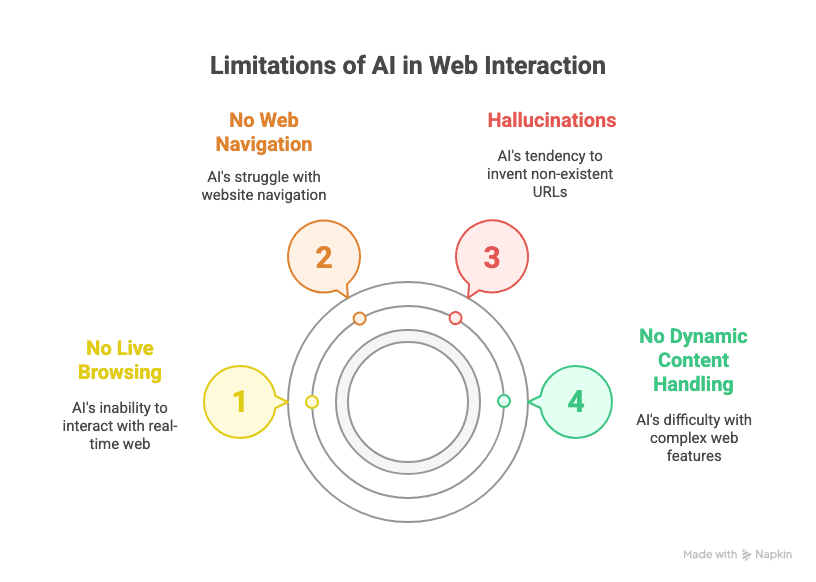

- Pas de navigation en direct : les modèles d’IA généralistes comme GPT ou Claude ne peuvent pas réellement naviguer sur le web en temps réel. Ils ne « voient » pas l’état actuel d’un site web — ils fonctionnent à partir de leurs données d’entraînement ou de ce que vous leur collez.

- Pas de navigation web : même avec des plugins ou la navigation activée, les LLM ne savent pas cliquer sur « Suivant », gérer le défilement infini ou suivre systématiquement chaque lien d’un site.

- Hallucinations : demandez à une IA générique toutes les URL d’un domaine, et elle inventera souvent des liens qui semblent plausibles mais n’existent pas vraiment. (J’ai déjà vu un modèle inventer des pages

/about-uspour des sites qui n’en avaient jamais eu.) - Gestion insuffisante du contenu dynamique : les sites qui chargent leur contenu avec JavaScript, exigent une connexion ou utilisent une navigation complexe sont hors de portée des LLM généralistes.

Comme le dit : « Si vous voulez extraire des centaines ou des milliers de pages… ChatGPT seul ne suffit pas. » Il vous faut un outil conçu spécialement pour cela.

Les agents IA verticaux sont l’avenir (et pourquoi c’est important)

C’est ici que mon expérience en SaaS et en automatisation entre en jeu : les agents IA verticaux — des outils d’IA conçus pour un domaine précis, comme l’extraction de données web — sont la seule manière d’obtenir des résultats fiables et évolutifs pour des tâches métier. Pourquoi ?

- Les LLM généralistes sont excellents pour la rédaction ou la recherche, mais ils sont sujets aux « hallucinations » et ne gèrent pas bien les workflows répétables en plusieurs étapes avec la stabilité dont les entreprises ont besoin.

- Les outils SaaS d’entreprise doivent automatiser beaucoup de tâches répétitives et structurées. C’est là que les agents IA verticaux brillent : ils sont conçus pour faire une chose, et la faire bien, avec un minimum d’erreurs.

- Les exemples ne manquent pas dans tous les secteurs : Thunderbit pour l’extraction de données web, Devin AI pour le développement logiciel, Alta pour l’automatisation commerciale, IL VISTA d’Infinity Learn pour l’éducation, Rippling pour les RH, Harvey pour le juridique… la liste continue.

En bref : si vous voulez trouver toutes les pages d’un site web de manière fiable, il vous faut un agent IA vertical conçu pour cette tâche — pas un chatbot généraliste.

Découvrez Thunderbit : l’extraction d’URL par IA, pour tout le monde

C’est là qu’intervient . En tant qu’extension Chrome d’Extracteur Web IA, Thunderbit est conçue pour les utilisateurs métiers — pas de code, pas de configuration technique, juste des résultats. Voici ce qui le distingue :

- Interface en langage naturel : décrivez simplement ce que vous voulez (« Listez toutes les URL des pages de ce site »), et l’IA de Thunderbit comprend comment l’extraire.

- Suggestion de champs par IA : Thunderbit analyse la page et suggère automatiquement des noms de colonnes (comme « URL de la page ») — pas besoin de manipuler des sélecteurs CSS ou XPath.

- Gestion de la pagination et du défilement infini : Thunderbit peut cliquer automatiquement sur « Suivant » ou faire défiler la page, afin que vous ne ratiez aucune page.

- Navigation vers les sous-pages : besoin d’aller plus en profondeur ? Thunderbit peut aussi suivre les liens vers les sous-pages et en extraire les données.

- Export structuré : exportez vos résultats directement vers Google Sheets, Excel, Notion, Airtable ou CSV — gratuitement et en un clic.

- Aucune compétence en code requise : si vous savez naviguer sur un site web, vous pouvez utiliser Thunderbit. C’est aussi simple que ça.

Et comme Thunderbit est un agent IA vertical, il est conçu pour la stabilité et la répétabilité — parfait pour les utilisateurs métiers qui doivent automatiser les mêmes tâches encore et encore.

Étape par étape : comment trouver toutes les URL d’un domaine avec Thunderbit

Prêt à voir comment cela fonctionne ? Voici un guide non technique pour extraire chaque URL dont vous avez besoin.

1. Installez l’extension Chrome Thunderbit

Commençons par le commencement : . Il fonctionne sur Chrome, Edge, Brave et les autres navigateurs Chromium. Épinglez-le à votre barre d’outils pour y accéder facilement.

2. Ouvrez votre page de liste ou d’annuaire cible

Accédez au site à partir duquel vous souhaitez extraire des URL. Cela peut être la page d’accueil, un sitemap, un annuaire ou n’importe quelle page de liste qui renvoie vers les pages qui vous intéressent.

3. Lancez Thunderbit et configurez vos champs

Cliquez sur l’icône Thunderbit pour ouvrir l’extension. Créez un nouveau modèle de Scraper. C’est ici que la magie opère :

- Cliquez sur « Suggestion de champs par IA ». L’IA de Thunderbit analysera la page et proposera des colonnes — repérez-en une intitulée « URL de la page », « Lien » ou quelque chose de similaire.

- Si vous ne voyez pas exactement le champ voulu, ajoutez simplement une colonne nommée « URL de la page » (ou tout autre intitulé pertinent). L’IA de Thunderbit est entraînée à reconnaître ces termes et à les associer aux bonnes données.

4. Activez la pagination ou le défilement si nécessaire

Si votre page cible comporte plusieurs pages (comme « Page 1, 2, 3… » ou un bouton « Charger plus »), activez la pagination dans Thunderbit :

- Passez en mode « Pagination par clic » pour les sites avec des boutons « Suivant », ou en mode « Défilement infini » pour les sites qui chargent davantage de contenu au fur et à mesure que vous descendez.

- Thunderbit vous demandera de sélectionner le bouton « Suivant » ou la zone de défilement — cliquez simplement dessus, et l’IA s’occupe du reste.

5. Lancez l’extraction et vérifiez vos résultats

Cliquez sur le bouton « Extraire ». Thunderbit parcourra toutes les pages et collectera chaque URL trouvée. Vous verrez les résultats apparaître dans un tableau directement dans l’extension. Pour les grands sites, cela peut prendre quelques minutes, mais c’est toujours bien plus rapide que de le faire à la main.

6. Exportez votre liste d’URL

Une fois l’extraction terminée, cliquez sur Exporter. Vous pouvez envoyer vos données directement vers :

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Les exports sont gratuits et conservent toute votre mise en forme. Finies les galères de copier-coller.

Comparer Thunderbit à d’autres solutions d’extraction d’URL

| Méthode | Facilité d’utilisation | Précision et couverture | Évolutivité | Options d’export |

|---|---|---|---|---|

| Copier-coller manuel | Pénible | Faible (on en manque facilement) | Aucune | Manuel (Excel, etc.) |

| Extracteurs de liens du navigateur | OK pour 1 page | Moyenne | Faible | Manuel |

Recherche Google site: | Facile | Moyenne (non exhaustive) | Plafonnée à environ 1 000 | Manuel |

| Sitemap XML | Facile (s’il existe) | Bonne (s’il est à jour) | Bonne | Manuel/Script |

| Outils SEO (Screaming Frog) | Technique | Élevée | Élevée (payant) | CSV, Excel |

| Scripts Python (Scrapy, etc.) | Très technique | Élevée | Élevée | Personnalisé |

| Thunderbit | Très facile | Très élevée | Élevée | Google Sheets, CSV, etc. |

Thunderbit vous offre la précision et l’échelle d’un crawler professionnel avec la simplicité d’une extension de navigateur. Pas de code, pas de configuration, juste des résultats.

Bonus : extraire bien plus que des URL avec Thunderbit

Et là, ça devient vraiment intéressant. Thunderbit ne sert pas qu’aux URL — vous pouvez extraire :

- Les titres

- Les emails

- Les numéros de téléphone

- Les images

- Toutes les données structurées de la page

Par exemple, si vous constituez une liste de prospects, vous pouvez demander à Thunderbit de récupérer l’URL du profil, le nom, l’email et le numéro de téléphone de chaque entrée d’annuaire — le tout en un seul passage. Si vous faites un audit produit, vous pouvez extraire l’URL du produit, son nom, son prix et son statut de stock. Thunderbit prend même en charge , ce qui lui permet de cliquer sur chaque lien et d’en extraire les détails.

Et oui, les extracteurs d’emails et de numéros de téléphone de Thunderbit sont totalement gratuits. C’est un vrai plus pour les équipes commerciales et marketing.

Points clés à retenir : comment trouver toutes les pages d’un site web avec l’IA

Récapitulons :

- Extraire toutes les URL d’un domaine est difficile avec des outils manuels ou génériques.

- Les modèles d’IA génériques comme GPT ne peuvent pas gérer la navigation web, la pagination ou le contenu dynamique.

- Les agents IA verticaux comme Thunderbit sont conçus spécifiquement pour l’extraction de données web — stables, répétables et faciles à utiliser pour les utilisateurs métiers.

- Thunderbit simplifie tout : installez l’extension, utilisez l’IA pour suggérer les champs, activez la pagination, extrayez, puis exportez. Aucun code, aucun tracas.

- Vous pouvez extraire bien plus que des URL : titres, emails, numéros de téléphone, et plus encore — parfait pour la génération de leads, les audits ou la recherche.

Si vous en avez assez du copier-coller de liens ou de vous battre avec des crawlers techniques, . Il existe une offre gratuite, pour que vous puissiez constater par vous-même combien de temps — et de santé mentale — vous allez gagner.

Et si vous êtes curieux d’autres façons dont Thunderbit peut vous aider — comme , ou — consultez le pour plus de guides et de conseils.

Prêt à reprendre le contrôle de votre temps sur la collecte manuelle de données ? L’avenir de l’extraction de données web, ce sont les agents IA verticaux — et Thunderbit ouvre la voie. Essayez-le, et faites de votre prochain audit, de votre prochaine liste de prospects ou de votre prochain projet de recherche le plus simple de tous.

Lire aussi

P.-S. Si un jour vous êtes tenté de copier-coller 1 000 URL à la main, souvenez-vous simplement qu’il existe désormais une IA pour ça. Vos poignets — et votre patron — vous remercieront.