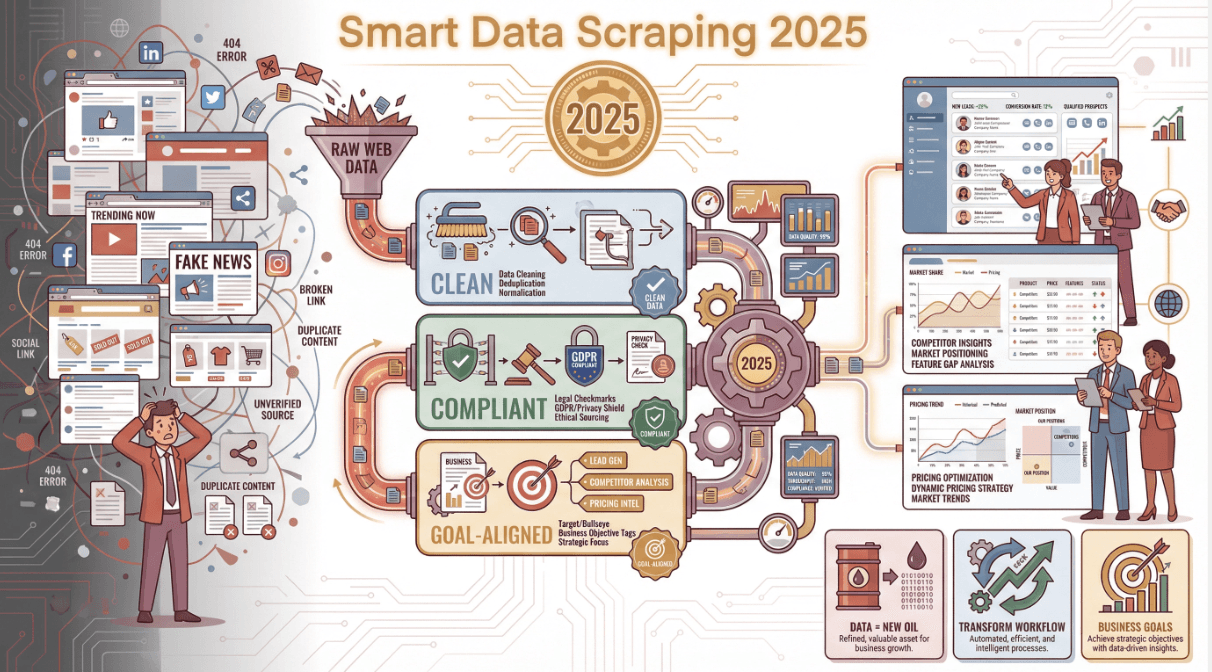

Les données, c’est un peu le pétrole de notre époque, mais franchement, qui a envie de perdre ses journées à fouiller dans des océans d’infos inutiles ? En 2025, le data scraping s’est imposé comme l’allié incontournable pour toutes les équipes qui veulent transformer le web en vraie mine d’or, et pas juste en bruit de fond. J’ai vu de mes propres yeux comment une bonne stratégie de scraping peut complètement changer la donne pour une équipe—que ce soit pour trouver de nouveaux clients, surveiller la concurrence ou ajuster ses prix en temps réel. Mais attention, le scraping, ce n’est pas juste ramasser des données à la pelle. Il faut le faire proprement, dans les règles, et toujours en gardant en tête tes objectifs business.

Si tu en as marre de passer ta vie à faire des copier-coller ou que tu te demandes pourquoi ton tableau Excel « scrapé » ressemble à un gruyère plein de trous et de doublons, ce guide est fait pour toi. Je vais partager ici les astuces que j’ai apprises (parfois à mes dépens !), t’aider à éviter les pièges classiques, et te montrer comment des outils comme rendent le data scraping accessible à tout le monde—même si tu n’as jamais tapé une ligne de code.

Pourquoi le Data Scraping Est-il Devenu Incontournable pour les Entreprises ?

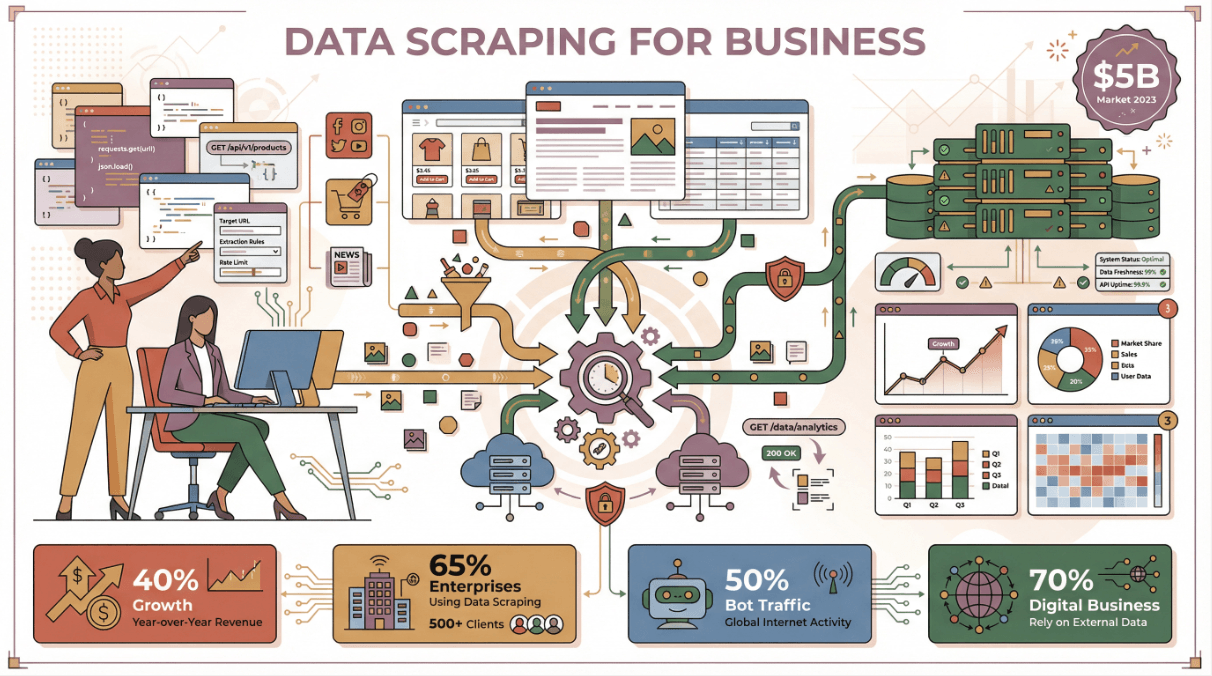

Commençons par le début : pourquoi le data scraping est-il devenu un must pour les équipes aujourd’hui ? Les chiffres sont sans appel. Le marché mondial des logiciels d’extraction de données web a dépassé les , avec une croissance annuelle de plus de 40%. Près de s’appuient désormais sur les données publiques du web pour leur veille stratégique, et environ utilisent un extracteur de données. En vrai, près de la moitié du trafic internet en 2023 venait de robots—scrapers et crawlers, pas d’humains.

Mais ce n’est pas qu’une question de quantité. Ce qui compte vraiment, c’est ce que tu fais de ces données :

| Département | Application du scraping | Impact business (ROI) |

|---|---|---|

| Ventes & Marketing | Extraire des leads depuis des annuaires/réseaux sociaux | Remplit le pipeline avec des prospects qualifiés, réduit le temps de prospection de 30–40% (scrapingapi.ai) |

| Opérations E-commerce | Surveiller les prix/produits des concurrents | Permet une tarification dynamique, augmente les ventes (John Lewis a constaté une hausse de 4% browsercat.com) |

| Études de marché | Agréger avis, notes, tendances | Détecte plus vite les tendances et le ressenti client qu’une étude classique |

| Finance & Stratégie | Collecter actualités, dépôts, jeux de données publics | Fournit aux décideurs des informations à jour |

Quand le scraping est bien fait, tu ne gagnes pas juste du temps—tu prends de meilleures décisions, plus vite. Des boîtes comme John Lewis ou ASOS ont vu leur chiffre d’affaires grimper en automatisant la veille concurrentielle et en personnalisant leurs campagnes grâce aux données extraites ().

Bonnes Pratiques de Data Scraping Selon les Scénarios

Le data scraping, ce n’est pas du prêt-à-porter. La meilleure technique dépend de ton objectif—que tu fasses de la veille, de la génération de leads ou des études de marché. Voici ce qui marche selon chaque cas.

Scraping pour les Études de Marché

Pour les études de marché, il faut voir large. L’astuce, c’est d’agréger des données de sources variées : avis produits, réseaux sociaux, forums, pages de prix. Par exemple, les marques de mode scrutent les discussions en ligne et les sites de vente pour flairer les tendances avant tout le monde ().

Conseils pour le scraping d’études de marché :

- Multiplie les sources : Ne te limite pas à un seul site—croise avis, notes et discussions de forums.

- Structure tes données : Récupère aussi les métadonnées (date, note, catégorie) pour mieux les exploiter.

- Suis l’évolution : Programme des extractions régulières (chaque semaine ou chaque mois) pour repérer les tendances.

Exemple : Une marque de cosmétiques surveille les réseaux sociaux et les sites e-commerce pour repérer une montée des mentions « acide hyaluronique », et ajuste sa com’ avant la concurrence.

Scraping pour la Génération de Leads

Pour les commerciaux, le scraping, c’est le turbo de la prospection—à condition de bien cibler. Il faut viser des sources fiables et publiques (annuaires, LinkedIn, listes d’assos) et privilégier la qualité à la quantité.

Bonnes pratiques :

- Valide les contacts : Utilise des vérificateurs d’email/téléphone, vire les doublons, vérifie les formats.

- Sois carré sur la conformité : Ne scrape que des données publiques et pros. Évite les infos perso sans base légale ().

- Teste avant d’automatiser : Fais un essai sur un petit volume, corrige les bugs, puis passe à l’échelle.

Erreur à éviter : Une boîte de génération de leads a scrapé des données perso sans précaution—résultat : galères de conformité et perte de temps (). Scrape intelligemment et de façon responsable.

Scraping pour la Veille Concurrentielle

Envie de savoir ce que trament tes concurrents ? Le scraping permet de surveiller les prix, stocks, lancements de produits ou même les recrutements. Le secret, c’est de définir précisément ce que tu veux suivre (SKU, prix, avis, offres d’emploi) et d’automatiser la navigation sur les sous-pages pour avoir une vue complète.

Bonnes pratiques :

- Automatise le scraping des sous-pages : Utilise des outils capables de suivre les liens (comme la fonction « Scraper les sous-pages » de Thunderbit) pour récupérer les détails produits ou offres d’emploi.

- Planifie des vérifications régulières : La fréquence compte—tous les jours pour les prix, chaque semaine pour les articles de blog.

- Export et comparaison : Garde l’historique pour repérer les tendances et réagir vite.

Astuce pro : Utilise des extracteurs web basés navigateur (comme l’extension Chrome de Thunderbit) pour simuler un comportement humain et éviter les blocages anti-bot ().

Éviter les Pièges Classiques du Data Scraping pour Garder des Données Propres

Même la meilleure stratégie peut partir en vrille si tu tombes dans ces pièges courants. Voici comment les éviter et garder des données clean.

Gérer les Pages Web Dynamiques

Les sites modernes adorent le JavaScript, le scroll infini et les boutons « Charger plus ». Un scraper basique ne verra qu’une partie des infos.

Comment s’en sortir :

- Utilise des extracteurs web basés navigateur ou IA qui exécutent le JavaScript et attendent le chargement complet ().

- Cherche les API cachées—parfois les données sont chargées en arrière-plan et accessibles direct.

- Vérifie toujours tes résultats—si tu attends 100 éléments et n’en obtiens que 10, y’a un souci.

Thunderbit, par exemple, charge les pages comme un vrai navigateur et gère le contenu dynamique sans prise de tête.

Contourner les Mesures Anti-Scraping

Les sites sont de plus en plus malins pour bloquer les robots—CAPTCHA, blocage d’IP, limitation de fréquence. Si ton scraper s’arrête net, c’est souvent la cause.

Bonnes pratiques :

- Ralentis tes requêtes : Espace-les, varie les intervalles, évite de surcharger le site.

- Utilise le mode navigateur pour les sites sensibles : Le mode navigateur de Thunderbit imite ta navigation réelle, ce qui limite les blocages.

- Regarde le robots.txt et les CGU : Si un site interdit le scraping, réfléchis ou demande l’autorisation ().

Garantir l’Exhaustivité et la Fiabilité des Données

Des données fausses, c’est pire que pas de données du tout. Ne fais pas confiance aveuglément à ton scraper—valide, nettoie, vérifie tout.

Checklist :

- Valide les formats : Les emails sont-ils valides ? Les prix sont-ils des chiffres ? Les dates sont-elles cohérentes ?

- Vire les doublons : Supprime les répétitions à partir d’ID ou d’URL uniques.

- Gère les données manquantes : Signale les champs vides, complète si possible ou relance le scraping.

- Contrôles réguliers : Vérifie un échantillon à chaque extraction. Si quelque chose cloche, corrige avant que ça ne s’aggrave.

Une mauvaise qualité de données peut coûter aux entreprises, alors ne zappe pas cette étape.

Comment Thunderbit Rend le Data Scraping Simple pour les Équipes

Voyons comment simplifier tout ça. Chez Thunderbit, on a conçu notre pour les pros qui veulent des résultats sans prise de tête technique. Voilà comment Thunderbit change la donne :

Le Workflow IA de Thunderbit

- Suggestion de champs par l’IA : Va sur n’importe quelle page, clique sur « Suggestion IA de champs » et Thunderbit analyse le site pour te proposer les meilleures colonnes à extraire—aucune config, zéro code.

- Scraping en 2 clics : Ajuste les champs si besoin, puis lance l’extraction. Thunderbit récupère tout, gère la pagination et va même chercher les sous-pages si besoin.

- Export instantané : Envoie tes données direct vers Excel, Google Sheets, Airtable ou Notion—fini le copier-coller ou le nettoyage à la main.

J’ai vu des collègues pas du tout techniques passer de « Je ne sais pas par où commencer » à « Je viens d’extraire 500 prix concurrents » en moins de cinq minutes.

Scraping Multi-Sources et Multilingue

Thunderbit ne s’arrête pas aux sites web. Tu peux extraire des données depuis des PDF, images ou documents—grâce à l’OCR et à l’IA intégrés. Et avec la prise en charge de 34 langues, c’est l’outil parfait pour les équipes internationales ou les données multilingues.

Exemple : Besoin d’extraire le catalogue d’un fournisseur japonais ? Thunderbit peut extraire et traduire les données en temps réel, prêtes à être analysées.

Nettoyage et Préparation des Données : Transformer le Brut en Or

Le scraping, c’est juste la première étape. Les données brutes sont souvent en vrac—doublons, formats bizarres, infos manquantes. La vraie valeur, c’est quand tu nettoies, étiquettes et structures ces données pour l’entreprise.

Automatiser l’Étiquetage et la Catégorisation des Données

Le Field AI Prompt de Thunderbit automatise une bonne partie du boulot :

- Catégorise les produits : « Classe chaque article en Électronique, Vêtements ou Maison selon son nom. »

- Traduis les champs : Convertis instantanément le texte extrait en anglais (ou dans l’une des 34 langues).

- Formate et valide : Standardise les dates, prix ou numéros de téléphone dès l’extraction.

Checklist de nettoyage des données :

- Repère les problèmes évidents (colonnes décalées, erreurs d’encodage).

- Supprime les doublons.

- Uniformise les formats (dates, prix, catégories).

- Gère les valeurs manquantes (complète, signale ou supprime).

- Valide selon les règles métier (ex : plages de prix).

- Enrichis si besoin (secteur, région, etc.).

- Documente ton process pour plus de transparence.

En automatisant ces étapes, tu transformes un export brut en jeu de données prêt à l’analyse—sans y passer des heures sur Excel.

Aspects Légaux et Éthiques du Data Scraping

Un point crucial : ce n’est pas parce que tu peux extraire des données que tu dois le faire—surtout sans réfléchir à la vie privée, au droit d’auteur et à la conformité.

Réglementations à Garder en Tête

- RGPD/CCPA : Si tu extrais des données qui peuvent identifier une personne, il te faut une base légale. Reste sur les données publiques et pros, évite les infos sensibles.

- Conditions d’utilisation : Beaucoup de sites interdisent le scraping dans leurs CGU. Vérifie toujours avant de te lancer.

- Droit d’auteur : Les faits ne sont pas protégés, mais la présentation des données peut l’être. N’extrais ni ne republie d’articles ou de contenus créatifs sans autorisation.

Bonnes pratiques :

- Ne collecte que l’essentiel (minimisation des données).

- Respecte le robots.txt et les règles du site.

- Sois transparent sur tes sources.

- Anonymise ou sécurise toute donnée perso extraite.

- Mets en place une politique interne pour que toute l’équipe connaisse les règles.

En cas de doute, demande l’autorisation ou utilise une API officielle. Mieux vaut perdre un peu de données que de se retrouver dans la galère juridique.

Amélioration Continue : Suivre et Optimiser tes Projets de Data Scraping

Les sites changent, les besoins évoluent, et ce qui marchait hier peut ne plus marcher demain. Le scraping, c’est un process vivant :

- Surveille la qualité des données : Suis l’exhaustivité, la précision et la fraîcheur. Mets des alertes si ton scraper récupère soudainement moins de données ou des résultats bizarres.

- Relie aux objectifs business : Mesure l’impact des données extraites sur tes KPIs—leads générés, ventes, ajustements de prix.

- Optimise la fréquence : N’extrais pas plus souvent que nécessaire (c’est mieux pour le site et pour toi).

- Reste agile : Sois prêt à adapter ton scraper quand les sites changent. Note ce qui marche pour corriger plus vite la prochaine fois.

Les meilleures équipes voient le scraping comme un pipeline de données, pas juste un projet ponctuel. Plus tu itères, plus tu crées de valeur.

Conclusion : Les Points Clés pour un Data Scraping qui Cartonne

On résume :

- Pars de ton objectif business : Ne scrape pas juste pour scraper—sache ce que tu veux obtenir.

- Choisis le bon outil : Les extracteurs web IA comme permettent à tout le monde d’obtenir vite des données de qualité.

- Adapte ta méthode : Chaque cas (étude de marché, prospection, veille) demande une stratégie différente.

- Mets la qualité en priorité : Valide, nettoie et structure tes données avant de les utiliser.

- Sois conforme et éthique : Respecte la vie privée, le droit d’auteur et les règles des sites.

- Améliore en continu : Surveille, optimise et adapte-toi au fil du temps.

Prêt à faire du data scraping un vrai atout pour ton équipe ? et découvre à quel point il est simple de transformer le web en moteur d’intelligence business. Pour aller plus loin, va jeter un œil au pour des conseils, guides et exemples concrets.

FAQ

1. C’est quoi le data scraping et pourquoi c’est important pour les équipes business ?

Le data scraping, c’est l’extraction automatisée d’infos depuis des sites web, PDF ou documents. C’est crucial pour les équipes car ça transforme les données publiques en infos actionnables pour la vente, le marketing ou l’opérationnel—et ça accélère la prise de décision.

2. Quelles sont les erreurs les plus fréquentes en data scraping ?

Les pièges classiques : rater le contenu dynamique (scroll infini), ignorer les mesures anti-scraping (blocages), ou zapper la validation/nettoyage (doublons, erreurs). Utilise toujours des outils adaptés aux sites dynamiques et intègre des étapes de validation.

3. Comment Thunderbit simplifie-t-il le data scraping pour les non-techniciens ?

Thunderbit utilise l’IA pour suggérer les champs, gérer le contenu dynamique et automatiser le scraping des sous-pages. En deux clics, tu extrais des données structurées et tu les exportes vers Excel, Google Sheets, Airtable ou Notion—sans code ni config.

4. Comment s’assurer que mon data scraping est légal et éthique ?

Reste sur les données publiques et non sensibles, respecte les lois sur la vie privée (RGPD/CCPA) et vérifie toujours les conditions d’utilisation du site. N’extrais pas d’identifiants perso sans base légale, et privilégie les API officielles si possible.

5. Que faire après avoir extrait des données pour les rendre utiles ?

Nettoie, déduplique et structure tes données. Utilise des outils IA (comme le Field AI Prompt de Thunderbit) pour étiqueter, traduire et catégoriser les champs. Valide toujours tes résultats avant de les exploiter.

Pour aller plus loin