Le web regorge de données — et en 2026, les projets de web scraping sont devenus l’ingrédient secret de tout, de l’analytique métier à la détection des tendances, en passant par les percées en recherche. J’ai pu constater de près comment les projets de web scraping en Python sont passés du statut de petit bonus sympathique à celui de moteur essentiel de l’innovation. Que vous soyez data scientist, développeur ou simple bidouilleur curieux, la bonne idée de projet (et le bon outil) peut vous ouvrir des insights qui resteraient autrement enfouis dans le foin numérique. Et le meilleur dans tout ça ? Avec des solutions propulsées par l’IA comme , même les tâches de scraping les plus complexes sont désormais à votre portée — sans doctorat en regex.

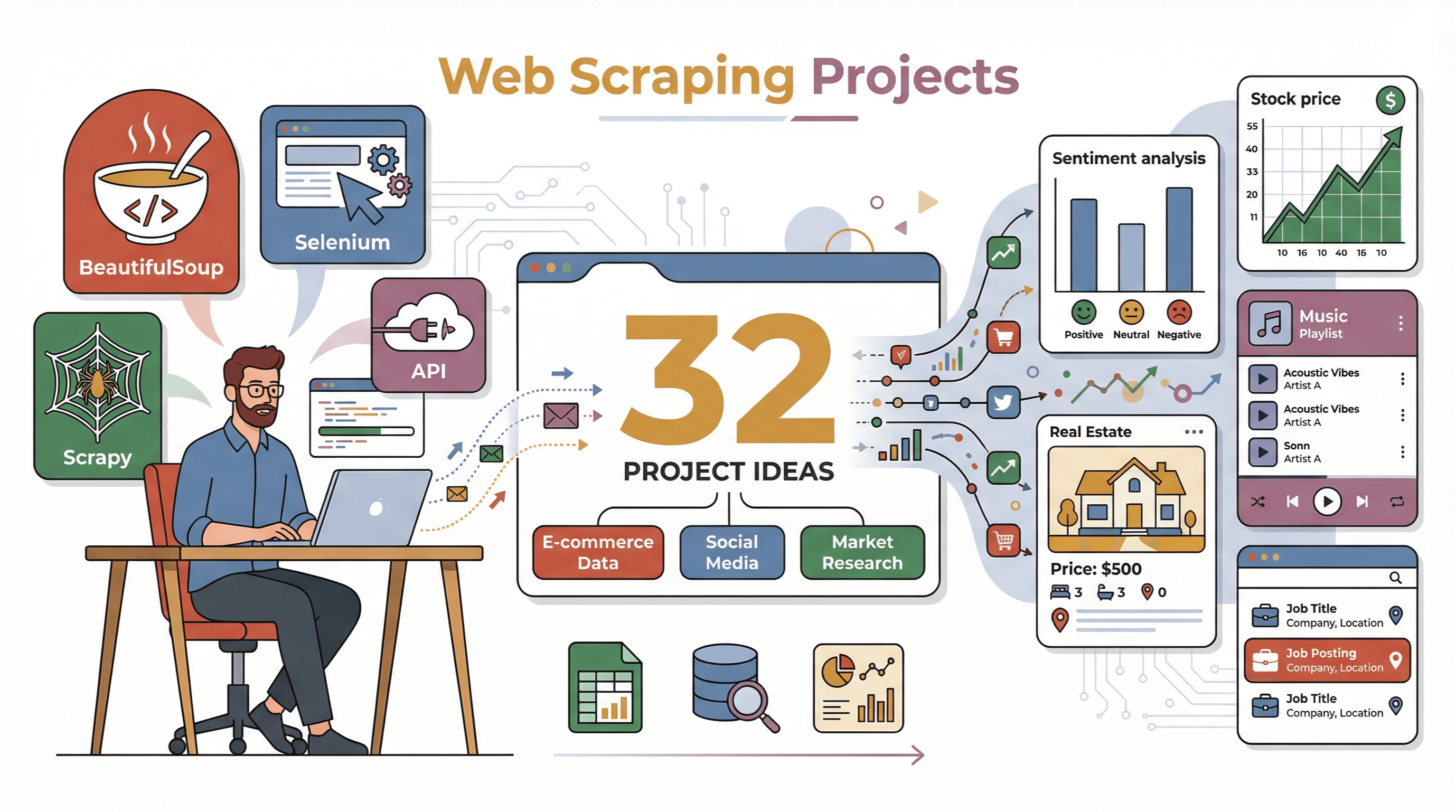

Prêt à passer au niveau supérieur et à construire quelque chose qui a un vrai impact ? J’ai réuni 32 idées de projets Python de web scraping, créatives, avancées et concrètes — chacune associée aux meilleurs outils (de BeautifulSoup à Scrapy en passant par Thunderbit), avec des conseils sur la complexité, l’automatisation et l’impact réel. Plongeons-nous dedans et voyons jusqu’où votre prochain projet fondé sur les données peut vous mener.

Pourquoi les projets de web scraping en Python sont essentiels à l’innovation pilotée par les données

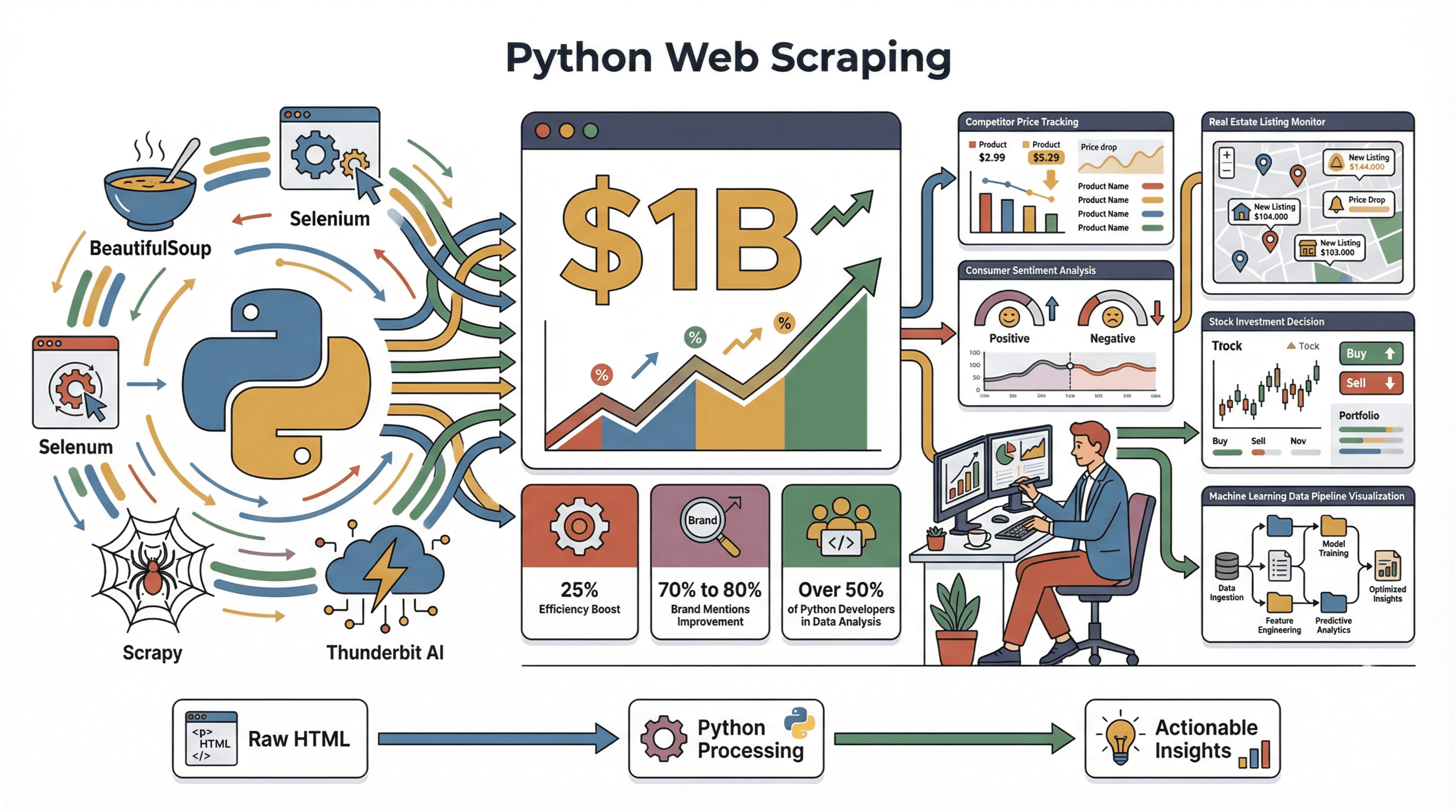

Le web scraping est devenu une industrie de 1 milliard de dollars en 2026, et ce n’est qu’un début (). Les entreprises utilisent des pipelines de scraping pour suivre les prix des concurrents, surveiller l’évolution du sentiment des consommateurs et même automatiser des décisions d’investissement. Une étude a montré que le scraping en temps réel de données financières améliorait l’efficacité des décisions d’investissement de 25 % (). Par ailleurs, les marques qui analysent activement les avis en ligne et les réseaux sociaux ont vu la part des mentions positives passer de 70 % à 80 % en cinq ans ().

Python est le langage de référence pour ces projets, et il est facile de comprendre pourquoi. En 2026, plus de la moitié des développeurs Python déclarent travailler dans l’analyse et le traitement de données (), et l’écosystème Python — pensez à BeautifulSoup, Selenium, Scrapy, et désormais à des outils pilotés par l’IA comme — permet de passer facilement du HTML brut à des insights exploitables. Que vous récupériez des avis produits pour une analyse de sentiment, que vous suiviez des annonces immobilières ou que vous construisiez un jeu de données personnalisé pour le machine learning, les projets de web scraping en Python sont la colonne vertébrale de l’innovation moderne fondée sur les données.

Comment choisir la bonne idée de projet de web scraping

Avec autant de possibilités, comment choisir un projet qui vaille vraiment votre temps ? Voici ma méthode :

- Commencez par votre objectif : Quelle décision ou quel processus ces données vont-elles éclairer ? Si vous cherchez de l’intelligence concurrentielle, récupérez les prix ou les gammes de produits des concurrents. Si vous voulez mieux comprendre vos clients, regardez les avis ou les réseaux sociaux.

- Vérifiez la disponibilité des données : Les données sont-elles publiques, derrière une connexion, ou accessibles via une API ? Les sites publics et statiques sont plus simples ; les sites dynamiques ou protégés demandent des outils plus avancés.

- Adaptez l’outil à la tâche : Pour les pages statiques, BeautifulSoup est excellent. Pour le contenu dynamique, Selenium ou Playwright peuvent être nécessaires. Pour les données complexes ou multi-formats (comme des PDF ou des images), des outils propulsés par l’IA comme peuvent vous faire gagner des heures.

- Pensez à l’évolutivité et à l’automatisation : Devez-vous exécuter ce projet une seule fois, ou selon un calendrier ? Le scraping planifié et l’export simple (vers Google Sheets, Excel, etc.) sont indispensables pour les projets récurrents.

Les meilleurs projets équilibrent valeur métier et faisabilité technique. Et si vous n’êtes pas un as du code, pas d’inquiétude — des outils d’IA comme Thunderbit rendent le scraping avancé accessible à tout le monde.

Comparaison des outils de web scraping en Python : de BeautifulSoup à Thunderbit

Voyons les principaux outils que vous voudrez avoir dans votre boîte à outils :

| Outil | Idéal pour | Gère JavaScript ? | Évolutivité | Facilité d’utilisation | Maintenance |

|---|---|---|---|---|---|

| BeautifulSoup | Pages statiques, tâches rapides | Non | Faible | Élevée | Manuelle |

| Selenium | Sites dynamiques, très riches en JS | Oui | Moyenne | Moyenne | Modérée |

| Scrapy | Exploration structurée à grande échelle | Non (mais extensible) | Élevée | Moyenne | Modérée |

| Thunderbit | Données complexes et mixtes, propulsées par l’IA | Oui | Élevée | Très élevée | Faible |

- BeautifulSoup est parfait pour les petits sites statiques — pensez aux blogs ou aux annuaires simples.

- Selenium brille quand il faut interagir avec du contenu dynamique, des connexions ou du défilement infini.

- Scrapy est conçu pour le crawling industriel et les exports structurés, mais sa prise en main est plus exigeante.

- Thunderbit apporte l’IA à la table, en gérant tout, de la navigation entre sous-pages à l’extraction de PDF/images, et en suggérant même les meilleurs champs à extraire. C’est mon choix de référence lorsque la vitesse, la robustesse et la simplicité d’utilisation sont prioritaires.

Pour aller plus loin dans le choix d’un outil, consultez .

Matrice de complexité des projets et recommandation d’outil

Voici une matrice de référence rapide pour associer chaque idée de projet au bon outil et estimer sa complexité :

Voici une matrice de référence rapide pour associer chaque idée de projet au bon outil et estimer sa complexité :

| Idée de projet | Outil(s) recommandé(s) | Complexité | Résultat clé |

|---|---|---|---|

| Analyse de sentiment des avis Amazon | BeautifulSoup + NLP | Moyenne | Avis + scores de sentiment |

| Scores e-sport en direct | Selenium | Élevée | Statistiques en temps réel |

| Quora Q&A tendance | Selenium | Moyenne à élevée | Jeu de données Q&A |

| Données de playlists Spotify | API Spotify | Faible | Titres de playlists, métriques |

| Notes des attractions touristiques | BeautifulSoup | Moyenne | Notes, avis, cartographie |

| Tendances du box-office cinéma | API ou BeautifulSoup | Faible à moyenne | Série temporelle du box-office |

| Tendances et contenus Twitter | Selenium/API | Moyenne | Sujets tendance, sentiment |

| Zhihu Q&A | Selenium | Élevée | Jeu de données Q&A chinois |

| Suivi immobilier en temps réel (Thunderbit) | Thunderbit | Faible à moyenne | Annonces, tendances de prix |

| Analyse des best-sellers d’ebooks | Selenium/API | Moyenne | Classements, avis |

| Suivi des prix e-commerce | Scrapy + proxies | Élevée | Historique des prix, alertes |

| Analyse des sujets sur les subreddits Reddit | API Reddit | Moyenne | Intensité des sujets, engagement |

| Suivi des données boursières | yfinance/API | Faible | Prix historiques, indicateurs |

| Offres d’emploi (Scrapy) | Scrapy | Moyenne | Annonces d’emploi, salaires |

| Avis Google Play | API/Selenium | Moyenne | Avis, notes, résumé NLP |

| Agrégation de blogs concurrents | RSS + BeautifulSoup | Moyenne | Base de contenu, clusters de sujets |

| Retours sur les cours en ligne | Selenium/API | Moyenne | Notes de cours, retours |

| Nettoyage d’un annuaire d’entreprises | Scrapy + Python | Moyenne | Liste d’entreprises nettoyée et dédupliquée |

| Sorties et tendances des podcasts | API + NLP | Moyenne | Podcasts en tendance, données d’épisodes |

| Extraction de fichiers avec Thunderbit | Thunderbit | Faible | Données structurées issues de PDF/images |

| Tendances des citations académiques | API + parsing | Moyenne | Comptes de citations, courbes de tendance |

| Données de jeux web via OCR | Selenium + OCR | Élevée | Statistiques de jeu à partir d’images |

| Analyse des avis de détaillants | Scrapy + NLP | Moyenne à élevée | Base d’avis consommateurs, synthèse |

| Actualités en direct avec Selenium | Selenium + planification | Moyenne | Titres d’actualité en temps réel |

| Suivi des tendances et styles de mode | Scrapy + analyse d’images | Moyenne | Styles populaires, données de tendance |

| Export de produits concurrents (Thunderbit) | Thunderbit | Faible | Liste de produits, attributs clés |

| Analyse multimédia Tumblr | API/Selenium | Moyenne | Publications, tags, liens média |

| Données d’avis sur les entreprises logistiques | BeautifulSoup + NLP | Moyenne | Sentiment des avis de service |

| Exposition de marque sportive | API sociale + scraping | Élevée | Indicateurs d’exposition régionale |

| Commentaires produits YouTube | API YouTube + NLP | Moyenne | Sentiment des commentaires, mentions de fonctionnalités |

| Fréquence des promotions e-commerce | Scrapy | Moyenne | Calendrier promotionnel, analyse de fréquence |

| Données de séries multilingues | Scrapy + API de traduction | Élevée | Descriptions multilingues |

Passons maintenant aux choses sérieuses — 32 idées de projets, chacune avec une méthode rapide, des conseils d’outils et des insights de niveau avancé.

1. Analyse de sentiment des avis produits Amazon (BeautifulSoup)

Récupérez les avis produits Amazon et appliquez une analyse de sentiment pour découvrir ce que pensent vraiment les clients. Utilisez BeautifulSoup pour extraire le texte des avis, les notes en étoiles et les métadonnées des évaluateurs. Gérez la pagination pour constituer un jeu de données solide, puis appliquez des bibliothèques NLP Python (comme VADER ou TextBlob) pour attribuer un score de sentiment et faire ressortir les thèmes récurrents. Pour de meilleurs résultats, espacez vos requêtes afin d’éviter les CAPTCHA ().

2. Scores et statistiques d’e-sport en direct (Selenium)

Vous voulez suivre les scores d’e-sport en direct ? Utilisez Selenium pour extraire des tableaux de scores dynamiques, rendus en JavaScript, depuis des sites comme ESL ou Liquipedia. Selenium vous permet d’automatiser les actions dans le navigateur, de gérer les connexions et d’extraire des statistiques en temps réel pour des jeux comme League of Legends ou CS:GO. Astuce pro : inspectez les appels réseau du navigateur pour repérer des points d’API cachés et accélérer l’extraction ().

3. Extraction de données Quora tendance

Collectez les questions et réponses tendance de Quora avec Selenium pour gérer le défilement infini et les contraintes de connexion. Analysez le texte des questions, le contenu des réponses, les votes positifs et les informations sur les auteurs. Pour une analyse plus poussée, cliquez sur les boutons « Read More » afin d’obtenir les réponses complètes et filtrez les publicités ou contenus sponsorisés content content ().

4. Collecte de données de playlists Spotify avec Python

Utilisez l’API Web Spotify (avec la bibliothèque spotipy) pour récupérer les titres de playlists, les métadonnées et les caractéristiques audio. Analysez les tendances des playlists, la popularité des morceaux et même des attributs comme le tempo ou l’énergie. Idées de visualisation : répartition par genre, réseaux d’artistes ou taux de renouvellement des morceaux ().

5. Web scraping des notes d’attractions touristiques

Récupérez les notes et avis d’attractions touristiques sur des plateformes comme TripAdvisor à l’aide de BeautifulSoup. Extrayez le nom des attractions, les emplacements, les notes moyennes et le nombre d’avis. Nettoyez et géocodez les données pour la cartographie, puis analysez les tendances par ville ou par saison ().

6. Données du box-office cinéma et visualisation des tendances

Récupérez des données historiques du box-office à partir de sources comme Box Office Mojo via leur API ou BeautifulSoup. Visualisez les tendances avec des bibliothèques Python comme Matplotlib ou Plotly — par exemple l’évolution du chiffre d’affaires dans le temps, la répartition par genre ou les pics saisonniers ().

7. Analyse des sujets tendance et du contenu utilisateur sur Twitter

Surveillez les tendances Twitter via l’API (si vous y avez accès) ou avec des outils comme snscrape et Selenium. Extrayez les hashtags tendance, collectez les tweets et analysez le sentiment ou la cooccurrence des hashtags. Pour les contenus très lourds en JavaScript, l’automatisation du navigateur est indispensable ().

8. Extraction de données Q&A interactives depuis Zhihu

Extrayez les questions et réponses tendance de Zhihu avec Selenium (et des cookies de connexion si nécessaire). Récupérez le texte des questions, le contenu des réponses, les votes positifs et l’engagement des utilisateurs. Pour l’analyse de texte chinois, utilisez des bibliothèques comme Jieba ou SnowNLP.

9. Suivi en temps réel du marché immobilier (Thunderbit)

Avec , vous pouvez suivre les annonces immobilières et les prix en seulement quelques clics. Utilisez « AI Suggest Fields » pour détecter automatiquement les données du bien, exploitez le scraping des sous-pages pour obtenir les détails et mettez en place des extractions programmées pour des mises à jour quotidiennes. Exportez tout vers Google Sheets ou Airtable — sans écrire une ligne de code ().

10. Analyse des classements de best-sellers sur les plateformes d’ebooks

Récupérez les listes de best-sellers et les avis depuis Amazon Kindle ou Goodreads avec Selenium ou via des API. Suivez l’évolution des classements dans le temps, analysez les tendances par genre et corrélez les avis avec le rang des ventes ().

11. Analyse des fluctuations de prix dans l’e-commerce

Utilisez Scrapy (avec des proxies) pour suivre les prix des produits sur les sites e-commerce. Collectez les données selon un calendrier, construisez une base historique des prix et mettez en place des alertes en cas de baisse importante. Analysez les schémas de tarification dynamique et les stratégies des concurrents ().

12. Analyse de l’intensité des discussions sur les subreddits Reddit

Extrayez les publications et les commentaires des subreddits à l’aide de l’API Reddit (PRAW). Analysez la fréquence des publications, les votes positifs et le volume des commentaires pour identifier les sujets chauds et les tendances d’engagement. Visualisez-les avec des cartes de chaleur ou des diagrammes en barres.

13. Suivi historique des actions et indicateurs financiers

Récupérez les cours boursiers et les indicateurs financiers via yfinance ou d’autres API de finance. Construisez des séries temporelles, tracez les tendances et corrélez-les avec les indicateurs économiques ().

14. Scraping d’offres d’emploi avec Scrapy

Utilisez Scrapy pour parcourir les sites d’offres d’emploi, extraire les intitulés de poste, les entreprises, les lieux et les salaires. Gérez la pagination et exportez des données structurées pour l’analyse — par exemple les distributions de salaires, la demande en compétences ou les tendances de recrutement ().

15. Script de scraping des avis et notes d’applications Google Play

Extrayez les avis d’applications sur Google Play via l’API ou Selenium. Récupérez le texte des avis, les notes et les métadonnées, puis utilisez le NLP pour synthétiser les retours utilisateurs et le sentiment ().

16. Agrégation de contenus de blogs techniques concurrents

Regroupez les articles de blogs concurrents à l’aide de flux RSS et de BeautifulSoup. Organisez le contenu, dédupliquez-le et utilisez le clustering de sujets pour repérer les tendances et les lacunes de contenu.

17. Scraping des retours et notes de cours sur les plateformes d’e-learning

Extrayez les notes et les retours de cours depuis des plateformes comme Coursera ou Udemy avec Selenium ou des API. Visualisez la popularité des cours, la satisfaction et les thèmes de feedback récurrents.

18. Organisation des données d’annuaires d’entreprises et des Pages Jaunes

Extrayez les fiches d’entreprises depuis des annuaires comme les Pages Jaunes avec Scrapy. Normalisez les adresses, dédupliquez les entrées et construisez une base d’entreprises propre ().

19. Collecte des dernières sorties et des contenus populaires sur les plateformes de podcasts

Utilisez l’API iTunes ou Spotify pour récupérer les métadonnées des podcasts, les sorties d’épisodes et les indicateurs de popularité. Analysez les sujets émergents et les tendances de publication.

20. Importer des fichiers dans Thunderbit pour une extraction de données personnalisée

Importez des PDF ou des images dans et laissez son OCR propulsé par l’IA extraire des données structurées — sans saisie manuelle ni regex. Parfait pour numériser des cartes de visite, des factures ou des listes de participants ().

21. Analyse des tendances de citations académiques

Extrayez les données de citation depuis des bases académiques via des API (comme CrossRef). Analysez l’évolution des citations dans le temps pour repérer les tendances de recherche émergentes.

22. Extraction de données de jeux web via OCR

Combinez Selenium et des bibliothèques OCR (comme pytesseract) pour extraire des statistiques de jeux web fondés sur des images. Utile pour les jeux qui affichent les scores ou les données sous forme d’images.

23. Extraction et analyse d’avis de consommateurs sur les sites de vente en ligne

Extrayez les avis clients des sites e-commerce avec Scrapy. Appliquez le NLP pour scorer le sentiment, résumer les principaux avantages et inconvénients des produits, et comparer les produits concurrents.

24. Scraping de titres et résumés d’actualités en temps réel (Selenium)

Utilisez Selenium pour extraire les titres et les résumés d’actualités en direct depuis des sites d’information dynamiques. Planifiez des extractions régulières pour obtenir des mises à jour en temps réel.

25. Suivi des tendances et des styles sur les sites de mode

Extrayez des sites de mode les produits et styles tendance avec Scrapy. En option, utilisez l’analyse d’images pour détecter les couleurs ou motifs populaires.

26. Export de listes de produits concurrents avec Thunderbit

Avec , exportez en quelques minutes les listes de produits concurrents et leurs attributs. Utilisez les suggestions de champs IA et le scraping des sous-pages pour obtenir des données approfondies, puis exportez directement vers votre outil de tableur préféré.

27. Analyse de contenus multimédias Tumblr

Extrayez des publications multimédias depuis Tumblr via l’API ou Selenium. Analysez les images, vidéos et tags pour repérer les tendances de contenu.

28. Extraction de données d’avis sur les entreprises de logistique

Extrayez les avis et notes des entreprises de logistique sur des plateformes comme Trustpilot avec BeautifulSoup. Reliez les retours à des améliorations opérationnelles grâce à l’analyse textuelle.

29. Statistiques d’exposition régionale des marques sportives

Collectez et analysez les données d’exposition de marché des marques sportives à l’aide des API des réseaux sociaux et du web scraping. Suivez les mentions, la présence en rayon et les tendances régionales.

30. Analyse de l’expérience via les commentaires produits YouTube

Extrayez les commentaires YouTube via l’API, puis utilisez le NLP pour en tirer le sentiment et les mentions de fonctionnalités liées à l’expérience produit.

31. Suivi de la fréquence et du ratio des promotions e-commerce

Suivez les événements promotionnels sur les plateformes e-commerce avec Scrapy. Agrégez les données d’événements et visualisez les tendances dans le temps.

32. Scraping de descriptions de séries sur plusieurs plateformes et dans plusieurs langues

Créez des scripts avec Scrapy et des API de traduction pour collecter et standardiser les descriptions de séries provenant de plusieurs plateformes de streaming et de différentes langues.

Vue d’ensemble : tableau comparatif des projets

| # | Idée de projet | Outil(s) | Complexité | Résultat clé |

|---|---|---|---|---|

| 1 | Analyse de sentiment des avis Amazon | BeautifulSoup + NLP | Moyenne | Avis + sentiment |

| 2 | Scores e-sport en direct | Selenium | Élevée | Statistiques en temps réel |

| 3 | Quora Q&A tendance | Selenium | Moyenne à élevée | Jeu de données Q&A |

| 4 | Données de playlists Spotify | API Spotify | Faible | Titres de playlists, métriques |

| 5 | Notes d’attractions touristiques | BeautifulSoup | Moyenne | Notes, avis, cartographie |

| 6 | Tendances du box-office cinéma | API/BeautifulSoup | Faible à moyenne | Série temporelle du box-office |

| 7 | Tendances et contenus Twitter | Selenium/API | Moyenne | Sujets tendance, sentiment |

| 8 | Zhihu Q&A | Selenium | Élevée | Jeu de données Q&A chinois |

| 9 | Suivi immobilier (Thunderbit) | Thunderbit | Faible à moyenne | Annonces, tendances de prix |

| 10 | Analyse des best-sellers d’ebooks | Selenium/API | Moyenne | Classements, avis |

| 11 | Suivi des prix e-commerce | Scrapy + proxies | Élevée | Historique des prix, alertes |

| 12 | Analyse des subreddits Reddit | API Reddit | Moyenne | Intensité des sujets, engagement |

| 13 | Suivi des données boursières | yfinance/API | Faible | Prix historiques, indicateurs |

| 14 | Offres d’emploi (Scrapy) | Scrapy | Moyenne | Annonces d’emploi, salaires |

| 15 | Avis Google Play | API/Selenium | Moyenne | Avis, notes, résumé NLP |

| 16 | Agrégation de blogs concurrents | RSS + BeautifulSoup | Moyenne | Base de contenu, clusters de sujets |

| 17 | Retours sur les cours en ligne | Selenium/API | Moyenne | Notes de cours, retours |

| 18 | Nettoyage d’annuaire d’entreprises | Scrapy + Python | Moyenne | Liste d’entreprises propre et dédupliquée |

| 19 | Sorties et tendances des podcasts | API + NLP | Moyenne | Podcasts tendance, données d’épisodes |

| 20 | Extraction de fichiers Thunderbit | Thunderbit | Faible | Données structurées issues de PDF/images |

| 21 | Tendances de citations académiques | API + parsing | Moyenne | Comptes de citations, courbes de tendance |

| 22 | Données de jeux web via OCR | Selenium + OCR | Élevée | Statistiques de jeu à partir d’images |

| 23 | Analyse des avis de détaillants | Scrapy + NLP | Moyenne à élevée | Base d’avis consommateurs, synthèse |

| 24 | Actualités en direct avec Selenium | Selenium + planification | Moyenne | Titres d’actualité en temps réel |

| 25 | Suivi des tendances de mode | Scrapy + analyse d’images | Moyenne | Styles populaires, données de tendance |

| 26 | Export de produits concurrents (Thunderbit) | Thunderbit | Faible | Liste de produits, attributs clés |

| 27 | Analyse multimédia Tumblr | API/Selenium | Moyenne | Publications, tags, liens média |

| 28 | Avis d’entreprises de logistique | BeautifulSoup + NLP | Moyenne | Sentiment des avis de service |

| 29 | Exposition de marque sportive | API sociale + scraping | Élevée | Indicateurs d’exposition régionale |

| 30 | Commentaires produits YouTube | API YouTube + NLP | Moyenne | Sentiment des commentaires, mentions de fonctionnalités |

| 31 | Fréquence des promos e-commerce | Scrapy | Moyenne | Calendrier promotionnel, analyse de fréquence |

| 32 | Données de séries multilingues | Scrapy + traduction | Élevée | Descriptions multilingues |

Conclusion : ouvrir de nouvelles possibilités avec les projets de web scraping en Python

Le web scraping avec Python est bien plus qu’un simple exercice technique : c’est un tremplin vers des percées fondées sur les données. Que vous construisiez des tableaux de bord, alimentiez des modèles de machine learning ou satisfassiez simplement votre curiosité, ces 32 idées de projets prouvent que la seule limite est votre imagination. Et avec des outils comme , vous n’avez pas besoin d’être un expert du code pour relever même les défis de scraping les plus difficiles.

Alors choisissez un projet, configurez votre environnement Python et commencez à expérimenter. Le web est votre terrain de jeu de données — lancez-vous et construisez quelque chose d’exceptionnel, puis laissez les insights affluer.

Pour aller plus loin et découvrir des guides pratiques, consultez le .

FAQ

1. Quel est le meilleur outil Python pour des projets de web scraping ?

Cela dépend de votre projet. Pour les pages statiques, BeautifulSoup est simple et efficace. Pour les sites dynamiques ou interactifs, Selenium est un excellent choix. Pour un scraping à grande échelle ou planifié, Scrapy est idéal. Pour un scraping sans code et propulsé par l’IA (y compris les PDF et les images), est un choix de premier plan.

2. Comment éviter d’être bloqué lors du scraping de sites web ?

Utilisez des user agents réalistes, ajoutez des délais entre les requêtes et respectez robots.txt. Pour les sites à haute fréquence ou sensibles, envisagez des proxies rotatifs et l’automatisation du navigateur pour imiter un comportement humain.

3. Puis-je utiliser le web scraping pour des projets commerciaux ?

Oui, mais vérifiez toujours les conditions d’utilisation et les restrictions légales du site cible. Beaucoup de sites autorisent le scraping à des fins personnelles ou de recherche, mais l’usage commercial peut nécessiter une autorisation ou un accès via API.

4. Comment Thunderbit simplifie-t-il les tâches complexes de web scraping ?

Thunderbit utilise l’IA pour détecter automatiquement les champs, gérer les sous-pages et extraire des données depuis des sites dynamiques, des PDF et des images. Il propose des invites en langage naturel et exporte directement les données vers Google Sheets, Excel, Airtable ou Notion — sans aucun code.

5. Quelle est la meilleure façon de démarrer avec des projets de web scraping en Python ?

Choisissez une idée de projet qui vous enthousiasme, installez les bibliothèques nécessaires (BeautifulSoup, Selenium, Scrapy ou Thunderbit) et commencez petit — extrayez une page, puis passez à l’échelle. Expérimentez, itérez et n’hésitez pas à essayer des outils propulsés par l’IA pour accélérer votre flux de travail.

Bon scraping — et que vos données soient toujours fraîches, structurées et riches en insights.

En savoir plus