Le web déborde de données, et en 2026, la course pour transformer ce chaos en or pour les entreprises n’a jamais été aussi intense. J’ai vu des équipes commerciales, e-commerce et opérations transformer leurs workflows en automatisant ce qui prenait autrefois des heures de copier-coller épuisant. Aujourd’hui, si vous n’utilisez pas de logiciel d’extraction de données web, vous ne prenez pas seulement du retard — vous êtes probablement encore coincé dans le purgatoire des tableurs pendant que vos concurrents en sont déjà à leur deuxième café.

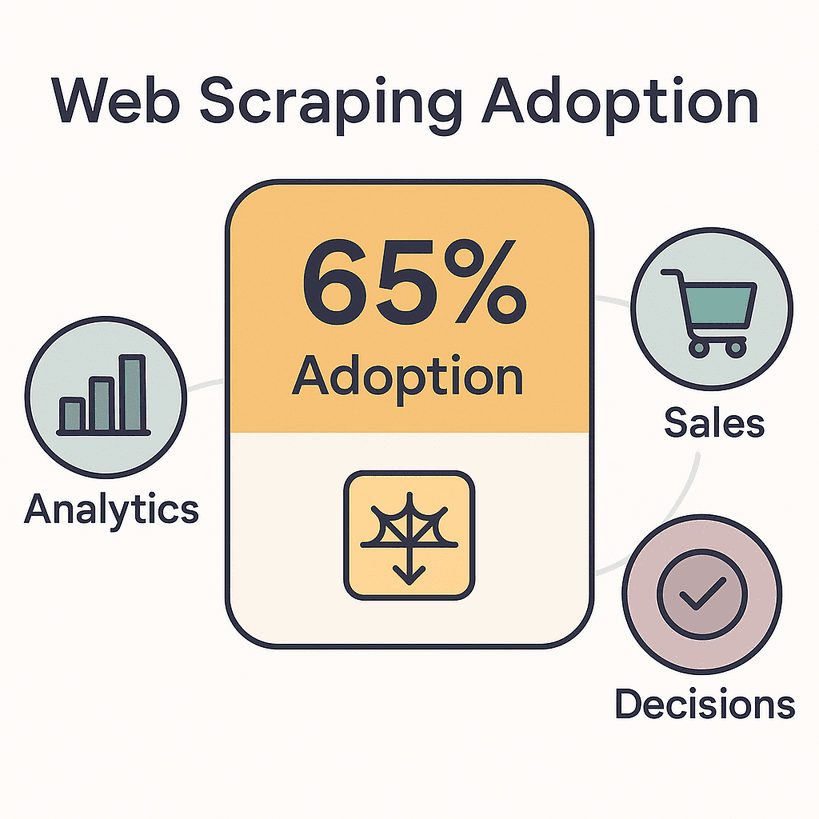

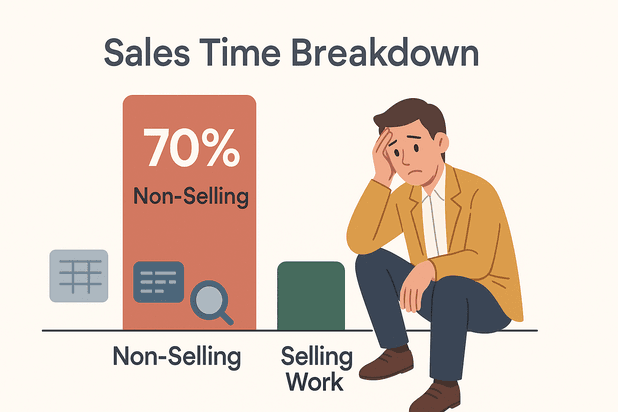

Voici la réalité : pour alimenter leurs analyses, leurs ventes et leurs décisions. Le marché mondial de l’extraction de données web pèse déjà , et sa taille devrait doubler d’ici 2030. Les commerciaux passent jusqu’à sur des tâches qui ne sont pas de la vente, comme la saisie de données et la recherche. C’est énormément de temps qui pourrait être consacré à conclure des affaires — ou, au moins, à profiter d’une vraie pause déjeuner.

Alors, quel est le meilleur logiciel d’extraction de données web en 2026 ? J’ai passé au crible les cinq meilleurs outils qui changent la donne pour des équipes de toutes tailles et de tous niveaux techniques. Que vous soyez un non-développeur qui veut simplement cliquer et lancer, ou un développeur en quête d’une flexibilité maximale, vous trouverez forcément votre bonheur ici.

Qu’est-ce qui fait le meilleur logiciel d’extraction de données web ?

Soyons clairs : tous les extracteurs Web ne se valent pas. Le meilleur logiciel d’extraction de données web en 2026 se distingue par sa capacité à rendre l’extraction de données rapide, fiable et accessible à tout le monde — pas seulement à celles et ceux qui pensent en Python.

Voici les critères clés que je regarde (et ce qui compte le plus pour les utilisateurs métier) :

- Facilité d’utilisation : des utilisateurs non techniques peuvent-ils configurer une extraction en quelques minutes ? Pour la plupart des équipes, une interface sans code et pilotée par l’IA est indispensable.

- Flexibilité des sources de données : l’outil gère-t-il les pages web, les PDF, les images et les contenus dynamiques (comme le défilement infini ou l’AJAX) ? Plus il prend en charge de sources, mieux c’est.

- Automatisation et planification : peut-on programmer des extractions récurrentes, gérer la pagination et automatiser la navigation entre sous-pages ? L’automatisation fait la différence entre « on configure et on oublie » et « on configure et on surveille ».

- Intégration et export : exporte-t-il directement vers Excel, Google Sheets, Notion, Airtable ou via API ? Moins il y a de manipulations manuelles, plus votre équipe y gagne.

- Compétences techniques requises : l’outil est-il vraiment sans code, ou faut-il ressortir vos notions de regex ? Les meilleurs outils s’adressent à la fois aux non-développeurs et aux utilisateurs avancés.

- Passage à l’échelle : peut-il extraire des centaines ou des milliers de pages sans broncher ?

- Support et communauté : la documentation est-elle solide, le support réactif, et la base d’utilisateurs active ?

Ces critères ne sont pas de simples bonus : ce sont eux qui distinguent les outils qui vous font gagner des heures de ceux qui vous en coûtent des jours. En 2026, avec , disposer du bon extracteur est un véritable avantage concurrentiel.

Passons maintenant au top 5.

Les 5 meilleurs logiciels d’extraction de données web en 2026

- pour une extraction sans code, alimentée par l’IA et multi-sources

- pour des pipelines de données intégrés au niveau entreprise

- pour une flexibilité open source pilotée par les développeurs

- pour une extraction visuelle sans code avec planification

- pour une extraction de données conviviale en mode clic-clac

1. Thunderbit : le logiciel d’extraction de données web IA le plus simple

est ma recommandation de référence pour toute personne qui veut extraire des données web sans écrire une seule ligne de code. Et oui, j’ai un peu de parti pris — j’ai contribué à le construire. Mais laissez-moi vous expliquer : Thunderbit est conçu pour les utilisateurs métier qui veulent des résultats, pas des prises de tête.

Qu’est-ce qui distingue Thunderbit ?

- Champs suggérés par l’IA : il suffit de cliquer sur « Champs suggérés par l’IA » et l’IA de Thunderbit lit la page, recommande quoi extraire et configure l’extracteur pour vous. Pas de sélecteurs, pas de modèles, pas de drame.

- Extraction multi-sources : extrayez non seulement des pages web, mais aussi des PDF et des images. Thunderbit peut récupérer du texte, des liens, des e-mails, des numéros de téléphone et des images — le tout en deux clics.

- Automatisation des sous-pages et de la pagination : besoin de récupérer les détails de chaque fiche produit ou profil ? L’extraction de sous-pages de Thunderbit suit les liens, récupère les informations supplémentaires et les fusionne dans votre tableau. Il gère aussi le défilement infini et la pagination comme un chef.

- Extraction par lots et planifiée : collez une liste d’URL, programmez des tâches récurrentes et laissez Thunderbit faire le gros du travail — qu’il s’agisse d’un suivi quotidien des prix ou d’une mise à jour hebdomadaire des leads.

- Export instantané : exportez directement vers Excel, Google Sheets, Airtable, Notion, CSV ou JSON. Fini les marathons de copier-coller.

- Prompts IA personnalisés : vous voulez catégoriser, traduire ou étiqueter les données pendant l’extraction ? Ajoutez une instruction personnalisée et l’IA de Thunderbit s’en charge.

- Mode cloud ou navigateur : lancez les extractions dans le cloud pour plus de vitesse (50 pages à la fois) ou en local pour les sites qui exigent une connexion.

Thunderbit est utilisé par plus de , des équipes commerciales aux agents immobiliers en passant par les boutiques e-commerce indépendantes. L’offre gratuite vous permet d’extraire jusqu’à 6 pages (ou 10 avec un bonus d’essai), et vous ne payez que ce que vous utilisez — un crédit par ligne de sortie.

Pourquoi je l’adore : Thunderbit est le seul outil que j’ai vu où un utilisateur non technique peut passer de « j’ai besoin de ces données » à « voici mon tableur » en moins de cinq minutes. L’interface est vraiment agréable à utiliser (on y a mis beaucoup d’obsession), et l’IA s’adapte aux changements de site web, ce qui vous évite de réparer sans cesse des extracteurs cassés.

Idéal pour : les équipes commerciales, e-commerce, opérations, et toute personne qui veut une extraction sans code, pilotée par l’IA, sans maintenance.

Découvrez le pour plus de guides.

2. Import.io : extraction et intégration de données web au niveau entreprise

est le champion des poids lourds pour les entreprises qui ont besoin de données web à grande échelle — et qui veulent les connecter directement à leurs systèmes métier.

Ce qui distingue Import.io :

- Pipelines prêts pour l’entreprise : Import.io n’est pas seulement un extracteur ; c’est une véritable plateforme d’intégration de données web. Pensez « data-as-a-service » avec des flux continus et automatisés.

- IA auto-réparatrice : si un site change, l’IA d’Import.io tente de remapper automatiquement les champs pour que vos pipelines ne cassent pas du jour au lendemain.

- Automatisation robuste : planifiez des extractions à l’heure, à la journée ou selon des intervalles personnalisés. Recevez des alertes si quelque chose se passe mal ou si les données semblent bizarres.

- Flux de travail interactifs : gérez les sites avec connexion, formulaires ou navigation en plusieurs étapes. Import.io peut enregistrer et rejouer des séquences complexes.

- Conformité et gouvernance : détection automatisée des données personnelles, masquage et journaux d’audit — essentiel pour les secteurs réglementés.

- API et intégration : diffusez les données directement dans Google Sheets, Excel, Tableau, Power BI, des bases de données ou vos propres applications via API.

Import.io est utilisé par des marques comme Unilever, Volvo et RedHat. C’est l’outil de référence pour des cas d’usage comme le suivi des prix sur des milliers de sites e-commerce, l’intelligence marché ou l’alimentation de modèles IA/ML avec des données web fraîches.

Tarifs : Import.io est une solution premium, à partir d’environ 299 $/mois pour les offres en self-service. Un essai gratuit est disponible, mais pas d’offre gratuite à long terme. Si les données web sont critiques pour votre activité, le retour sur investissement est là.

Idéal pour : les entreprises et les organisations centrées sur la donnée qui ont besoin de fiabilité, d’échelle, de conformité et d’une intégration poussée.

3. Scrapy : framework open source d’extraction web pour développeurs

est la référence open source pour les développeurs qui veulent une flexibilité et un contrôle absolus. Si vous savez coder en Python — vous ou votre équipe — Scrapy est le couteau suisse de l’extraction web.

Pourquoi les développeurs aiment Scrapy :

- Personnalisation totale : écrivez des spiders (scripts) pour crawler, parser et traiter les données exactement comme vous le souhaitez. Gérez des parcours multipages, une logique personnalisée et un nettoyage de données complexe.

- Asynchrone et rapide : l’architecture de Scrapy est conçue pour la vitesse et le passage à l’échelle — extrayez des centaines de pages par minute, ou des millions avec des crawlers distribués.

- Extensible : vaste écosystème de plugins et de middlewares pour les proxies, les navigateurs headless (Splash/Playwright) et les intégrations.

- Gratuit et open source : aucun frais de licence. Exécutez-le sur votre propre matériel ou dans le cloud, et dimensionnez-le à la hauteur de vos besoins.

- Support communautaire : plus de 55 000 étoiles sur GitHub et une immense base d’utilisateurs. Si vous bloquez, quelqu’un a probablement déjà résolu le problème.

À savoir : Scrapy nécessite des compétences en Python et une aisance avec la ligne de commande. Pas d’interface graphique en glisser-déposer ici — on est dans le code avant tout. Mais pour les projets sur mesure, les données d’entraînement pour l’IA ou les gros crawls, difficile de faire mieux.

Idéal pour : les organisations avec des développeurs en interne, des pipelines de données personnalisés ou des besoins d’extraction complexes à grande échelle.

4. Octoparse : l’extraction visuelle de données web en toute simplicité

est très apprécié des non-développeurs qui veulent une extraction puissante avec une interface visuelle, en mode clic-clac.

Pourquoi Octoparse est populaire :

- Créateur de flux de travail visuel : cliquez sur des éléments dans un navigateur intégré, et Octoparse détecte automatiquement les patterns. Pas de code, juste cliquer et extraire.

- Gestion des contenus dynamiques : extrait des sites AJAX, à défilement infini et protégés par connexion. Simule les clics, les défilements et l’envoi de formulaires.

- Extraction cloud et planification : exécutez les tâches dans le cloud (plus rapide, parallélisé) et programmez des tâches récurrentes pour des données toujours à jour.

- Modèles prédéfinis : des centaines de modèles pour des sites populaires (Amazon, Twitter, Zillow, etc.) vous permettent de démarrer immédiatement.

- Export et API : téléchargez les résultats en CSV, Excel, JSON, ou récupérez les données via API. Intégrez avec Google Sheets ou des bases de données.

Octoparse est souvent décrit comme « super facile à utiliser, même pour les débutants ». L’offre gratuite est limitée, mais les formules payantes (à partir d’environ 83 $/mois) débloquent les exécutions cloud, la planification et plus de vitesse.

Idéal pour : les utilisateurs non techniques, les marketeurs, les chercheurs et les petites équipes qui ont besoin d’une collecte de données régulière et automatisée sans coder.

5. ParseHub : une extraction de données simple et accessible au quotidien

est un autre favori du sans-code, surtout pour les petites entreprises et les freelances qui veulent automatiser leurs tâches quotidiennes de données.

Ce qui fait la force de ParseHub :

- Simplicité du cliquer-sélectionner : choisissez les données en cliquant sur les éléments dans une vue navigateur. Construisez vos workflows visuellement — aucun codage requis.

- Gestion des sites JS et dynamiques : extrait des pages riches en JavaScript, du contenu à défilement infini et des navigations en plusieurs étapes.

- Exécutions cloud et locales : lancez les extractions sur votre ordinateur ou dans le cloud. Programmez des tâches récurrentes et accédez aux résultats via API (sur les formules supérieures).

- Options d’export : téléchargez les données en CSV, Excel ou JSON. Accès API pour l’automatisation.

- Multi-plateforme : disponible sur Windows, Mac et Linux.

Le plan gratuit de ParseHub est limité (200 pages par exécution), mais les formules payantes (à partir d’environ 189 $/mois) débloquent davantage de puissance, de vitesse et l’accès à l’API.

Idéal pour : les petites entreprises, les freelances et les équipes ayant des besoins d’extraction simples qui veulent un outil fiable et visuel.

Tableau comparatif : les meilleurs logiciels d’extraction de données web en un coup d’œil

| Outil | Facilité d’utilisation | Sources de données | Automatisation et planification | Intégration et export | Compétences techniques | Tarifs |

|---|---|---|---|---|---|---|

| Thunderbit | Sans code, piloté par l’IA | Web, PDF, images | Sous-pages, pagination, planifié, par lots | Excel, Sheets, Notion, Airtable, CSV, JSON | Aucune | Freemium (paiement par ligne) |

| Import.io | Interface clic-clac | Web (statique/dynamique, connexion) | Auto-réparation, planifié, alertes | API, outils BI, Sheets, Excel, BD | Faible à moyen | 299 $+/mois |

| Scrapy | Code requis | Web, API, (JS via modules additionnels) | Automatisation complète via le code | Tout (via le code) | Développeurs Python | Gratuit (open source) |

| Octoparse | Visuel, sans code | Web (dynamique, connexion) | Planification cloud, modèles | CSV, Excel, JSON, API | Aucune | 83 $+/mois |

| ParseHub | Visuel, sans code | Web (JS, dynamique) | Cloud/local, planifié | CSV, Excel, JSON, API | Aucune | 189 $+/mois |

Comment choisir le meilleur logiciel d’extraction de données web pour votre entreprise

Vous hésitez encore ? Voici ma fiche mémo :

- Utilisateurs non techniques, résultats rapides : optez pour ou . Thunderbit est imbattable pour une extraction instantanée, pilotée par l’IA, et pour la prise en charge de sources multiples (web, PDF, images). Octoparse est excellent pour des extractions visuelles et planifiées.

- Intégration entreprise, conformité et passage à l’échelle : est votre meilleur choix. Il est conçu pour des pipelines de données continus, fiables et profondément intégrés.

- Développeurs, projets sur mesure ou crawls massifs : est la voie à suivre. Il faut maîtriser Python, mais en échange vous obtenez une flexibilité illimitée.

- Petites entreprises, freelances ou tâches du quotidien : est une solution solide et conviviale pour une extraction en mode clic-clac et une automatisation modérée.

Conseils pour choisir le bon outil :

- Faites correspondre l’outil aux compétences techniques de votre équipe et à vos besoins en données.

- Tenez compte de la complexité des sites à extraire (contenu dynamique ? connexion ?).

- Réfléchissez à la façon dont vous utiliserez les données — export direct vers Sheets ou intégration API poussée ?

- Commencez par un essai gratuit ou une offre freemium pour tester des cas réels.

- Ne sous-estimez pas la valeur d’un bon support et d’une bonne documentation.

Conclusion : libérer de la valeur métier avec le meilleur logiciel d’extraction de données web

Les données web sont le carburant de décisions métier plus intelligentes en 2026. Le bon logiciel d’extraction de données web peut vous faire gagner des heures, réduire les erreurs et donner à votre équipe un vrai avantage — que vous construisiez des listes de prospects, surveilliez les concurrents ou alimentiez votre moteur analytique.

En résumé :

- Thunderbit est l’extracteur sans code le plus simple et piloté par l’IA pour les utilisateurs métier.

- Import.io est la solution de niveau entreprise pour des pipelines de données continus et intégrés.

- Scrapy est la boîte à outils open source pour les développeurs qui veulent un contrôle total.

- Octoparse et ParseHub rendent l’extraction visuelle sans code accessible à tout le monde.

La plupart de ces outils proposent des essais gratuits ou des offres freemium — alors testez-les. Automatisez les tâches ennuyeuses, débloquez de nouveaux insights et laissez votre équipe se concentrer sur ce qui compte vraiment.

Bonne extraction — et que vos données soient toujours fraîches, structurées et prêtes à l’action.

FAQ

1. À quoi sert un logiciel d’extraction de données web ?

Un logiciel d’extraction de données web automatise le processus de récupération d’informations depuis des sites web, des PDF et des images. Il est utilisé pour la génération de leads, le suivi des prix, la veille marché, l’agrégation de contenu, et bien plus encore.

2. L’extraction de données web est-elle légale ?

L’extraction web est légale lorsqu’elle concerne des données publiquement accessibles et qu’elle respecte les conditions d’utilisation du site ainsi que les lois sur la vie privée. Vérifiez toujours les politiques du site et utilisez les données de manière responsable.

3. Dois-je savoir coder pour utiliser un logiciel d’extraction de données web ?

Pas nécessairement ! Des outils comme Thunderbit, Octoparse et ParseHub sont conçus pour les non-développeurs. Pour des projets plus complexes ou personnalisés, des outils pour développeurs comme Scrapy peuvent être nécessaires.

4. Comment exporter des données extraites vers Excel ou Google Sheets ?

La plupart des extracteurs modernes (Thunderbit, Octoparse, ParseHub) proposent un export en un clic vers Excel, Google Sheets, CSV, ou même une intégration directe avec Notion et Airtable.

5. Un logiciel d’extraction de données web peut-il gérer des sites dynamiques ou avec connexion ?

Oui — les meilleurs outils comme Import.io, Octoparse et ParseHub peuvent gérer les contenus dynamiques (AJAX, défilement infini) et les sites protégés par connexion. Thunderbit prend également en charge l’extraction depuis des pages dynamiques et des sous-pages.

Vous voulez voir à quoi ressemble l’extraction web moderne ? ou explorez le pour davantage de conseils, tutoriels et analyses approfondies sur l’extraction de données alimentée par l’IA.