Temu touche désormais plus de dans plus de 50 marchés. Son catalogue produit va des gadgets de cuisine aux accessoires pour animaux, en passant par les bandes LED. Si vous travaillez dans l’e-commerce, le dropshipping ou la veille concurrentielle, vous avez sans doute déjà voulu récupérer des données Temu dans un tableur — avant de découvrir que Temu ne veut vraiment, vraiment pas vous laisser faire.

J’ai passé beaucoup de temps à rechercher et tester des outils de scraping pour des sites e-commerce protégés. Temu est l’une des cibles les plus délicates qui soient. La plupart des guides en ligne vous donnent soit un tutoriel Python qui casse en une semaine, soit des API d’entreprise plus chères que votre budget publicitaire mensuel.

En pratique, la plupart des utilisateurs métier — dropshippers, indépendants, équipes marketing — veulent simplement un tableur propre avec les noms de produits, les prix, les images, les notes et les informations vendeur. Ils ne veulent pas déboguer des scripts Playwright à 2 h du matin.

Ce guide comble précisément ce manque : un comparatif pratique, organisé par niveau, des meilleurs extracteurs Temu qui fonctionnent réellement en 2026, ainsi que les bonnes pratiques qui transforment un simple scrape en veille concurrentielle continue. Que vous soyez débutant complet ou développeur en train de construire un pipeline de données, vous trouverez ici une section adaptée.

Pourquoi extraire Temu ? Les principaux cas d’usage pour les équipes métier

Les données Temu ne sont pas seulement intéressantes : elles sont stratégiquement utiles.

La plateforme est devenue un acteur qui tire les prix vers le bas dans les catégories de produits à faible et moyen ticket. Même si vous ne vendez pas sur Temu, vos clients comparent vos prix à ceux qu’ils y voient. Voici comment différentes équipes utilisent les données Temu :

| Cas d’usage | Données nécessaires | Pourquoi c’est important |

|---|---|---|

| Recherche de produits pour dropshipping | Titre, prix, image, note, nombre d’avis, nombre d’unités vendues, variantes | Repère des produits à faible coût avec des signaux de demande, à comparer sur Amazon, Shopify, AliExpress, TikTok Shop |

| Tarification concurrentielle | Prix actuel, prix initial, pourcentage de remise, devise, expédition, horodatage | Établit une base pour la stratégie tarifaire et la planification promotionnelle |

| Approvisionnement produit | Caractéristiques, images, variantes, vendeur/boutique, ID produit, catégorie | Identifie les types de produits et les annonces de type fournisseur qui méritent une vérification approfondie |

| Analyse des tendances du marché | Mot-clé de recherche, catégorie, nombre d’unités vendues, nombre d’avis, note | Montre quels produits gagnent du terrain selon les catégories |

| Marketing et recherche créative | Titre, image, nombre d’avis, note, descriptions, libellés de catégorie | Révèle les messages, accroches visuelles, bundles et promesses utilisés par les annonces à fort volume |

| Suivi des stocks et des disponibilités | URL du produit, disponibilité, estimation d’expédition, prix, horodatage | Détecte les ruptures, les changements d’entrepôt local et les variations de prix dans le temps |

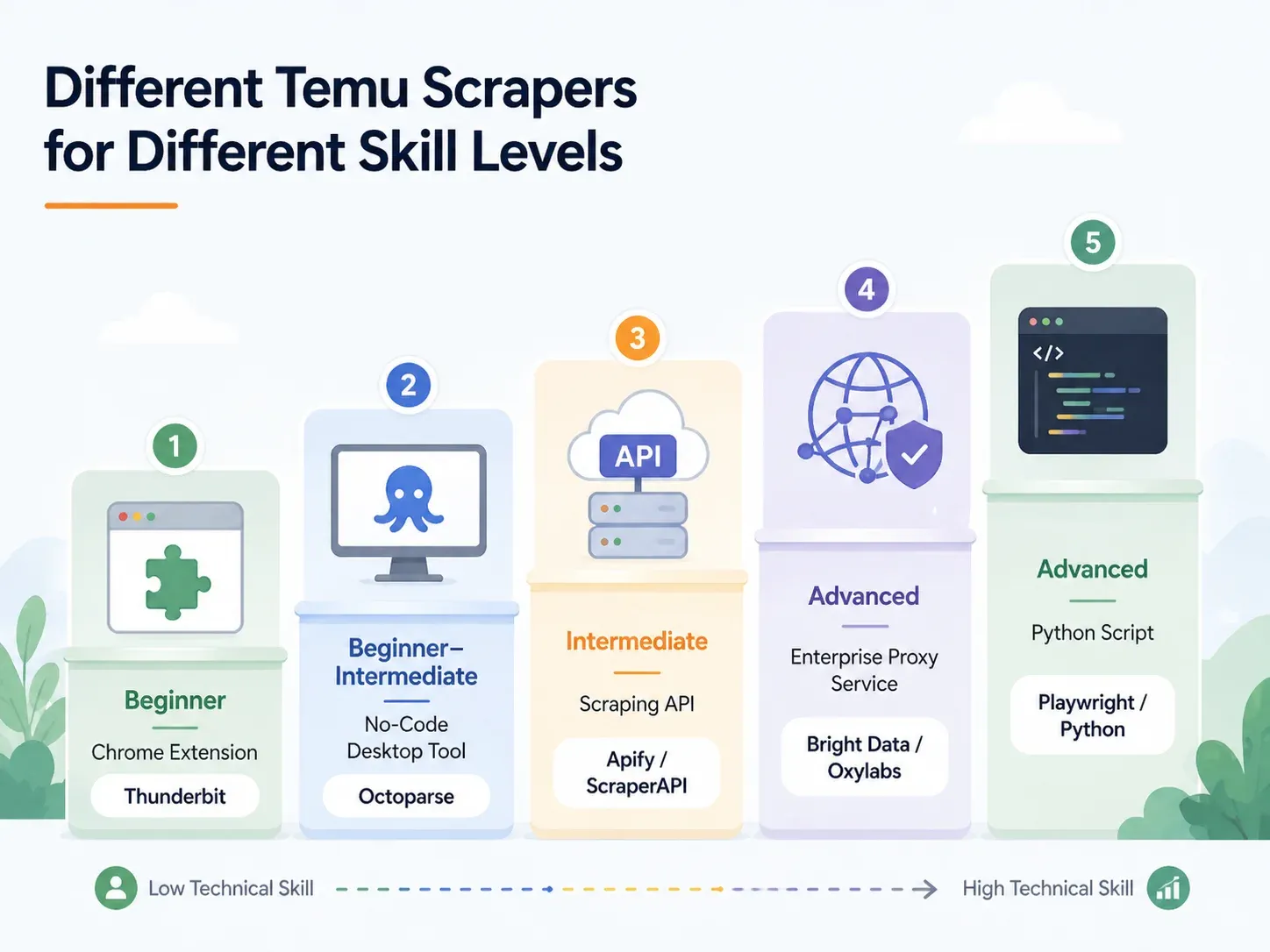

Le public qui cherche les « meilleurs extracteurs Temu » se divise généralement en trois groupes. Les utilisateurs non techniques veulent une extension Chrome qui exporte vers un tableur. Les opérateurs semi-techniques veulent un outil visuel avec des modèles et de la planification. Les développeurs veulent une API, un script Playwright et une stratégie de proxy.

Cet article couvre les trois — mais il commence par le plus grand groupe : ceux qui ont besoin de données, pas de code.

Ce qui distingue les meilleurs extracteurs Temu en 2026

Un extracteur qui fonctionne pour Amazon ou Shopify ne survivra pas forcément sur Temu. Les critères d’évaluation utilisés dans cet article sont :

- Fiabilité sur Temu — renvoie-t-il vraiment des données propres, ou est-il bloqué, renvoie-t-il des lignes vides, ou casse-t-il après un changement de mise en page ?

- Facilité d’utilisation — un utilisateur métier non technique peut-il démarrer sans écrire de code ?

- Complétude des données — prend-il en charge l’enrichissement des sous-pages (visite de chaque page de détail produit pour les caractéristiques, variantes, infos vendeur) ?

- Charge de maintenance — s’adapte-t-il quand Temu modifie sa structure de page ?

- Planification et supervision — peut-il exécuter des extractions récurrentes et exporter vers une destination de données vivante ?

- Destinations d’export — CSV, Excel, Google Sheets, Airtable, Notion, JSON ?

- Lisibilité des coûts — combien coûte réellement, par mois, un flux de scraping Temu réaliste ?

Les retours de la communauté sur décrivent régulièrement Temu comme l’un des sites e-commerce les plus difficiles à extraire. Un utilisateur a écrit qu’il « n’arrive même pas à obtenir un prix en tant qu’acheteur », tandis qu’un autre a noté que Temu et Shopee disposent d’équipes qui renforcent en continu leurs mécanismes anti-bot. Il n’existe pas de benchmark public du taux d’échec spécifique à Temu, mais le a constaté que le trafic automatisé avait dépassé le trafic humain, les bots représentant de tout le trafic Internet. C’est l’environnement contre lequel Temu se défend.

Défenses anti-bot de Temu : pourquoi la plupart des extracteurs échouent

La plupart des articles sur le scraping de Temu se contentent d’une phrase sur les mesures anti-bot : « Temu utilise de l’anti-bot ». Ce n’est pas utile.

Si vous choisissez un outil, vous devez savoir quelles défenses Temu utilise et quelles capacités de l’outil contournent chacune d’elles. Voici la carte pratique :

| Défense Temu | Ce que cela fait | Capacité requise de l’outil | Exemples d’outils |

|---|---|---|---|

| Cloudflare WAF / contrôles du navigateur | Bloque les user-agents automatisés, identifie les bots par empreinte, renvoie des pages de vérification | Infrastructure cloud avec rotation d’IP résidentielles et empreintes de navigateur réelles | Thunderbit (scraping cloud), Bright Data, Oxylabs, ScraperAPI |

| Rendu JavaScript intensif | Les données produit se chargent via JS ; le HTML brut est vide | Navigateur headless ou rendu navigateur complet | Thunderbit (mode scraping navigateur), Playwright, Selenium, ParseHub, acteurs navigateur Apify |

| Sélecteurs CSS dynamiques | Les noms de classe changent entre déploiements, ce qui casse les extracteurs basés sur CSS | Détection de champs par IA (sans dépendre de sélecteurs fixes) | Thunderbit (l’IA lit la page à neuf à chaque fois), générateur d’extracteur IA Bright Data |

| Limitation de débit | Ralentit les requêtes séquentielles rapides | Requêtes cloud concurrentes avec limitation intelligente | Thunderbit (jusqu’à 50 pages à la fois via le cloud), ScraperAPI, Bright Data |

| Défis CAPTCHA | Interrompt les sessions après un comportement suspect | Résolution CAPTCHA intégrée ou stratégie à faible déclenchement | Bright Data, Oxylabs, ScraperAPI premium/ultra-premium |

| Défilement infini / chargement paresseux | Seuls les premiers produits apparaissent sans interaction | Défilement intelligent, détection de pagination, automatisation des interactions | Pagination Thunderbit, défilement intelligent Apify, constructeur de workflow Octoparse |

Cloudflare WAF et blocage d’IP

La porte d’entrée de Temu est protégée par des contrôles d’intégrité du navigateur de type Cloudflare. Les requêtes HTTP basiques — du genre d’un simple requests.get() Python — sont défiées, renvoyées en 403 ou servies incomplètes.

Les outils qui fonctionnent ici ont besoin d’IP résidentielles ou mobiles en rotation et d’empreintes de navigateur réelles. La a indiqué que les bots non IA avaient commencé 2025 en représentant environ la moitié des requêtes de pages HTML. C’est l’échelle de l’automatisation contre laquelle des plateformes comme Temu se défendent.

Rendu JavaScript et sélecteurs dynamiques

C’est là que la plupart des extracteurs débutants échouent silencieusement.

Si vous consultez le code source de la page Temu, vous trouverez souvent une coquille vide — les cartes produits, les prix et les images réels sont injectés par JavaScript après le chargement de la page. Un extracteur qui ne lit que le HTML brut ne renverra rien d’utile. En plus, les noms de classes CSS et les structures DOM de Temu changent d’un déploiement à l’autre. Un extracteur reposant sur un sélecteur CSS fixe comme .product-card__price fonctionnera aujourd’hui et renverra des colonnes vides demain.

Les extracteurs basés sur l’IA (comme ) lisent la page de manière sémantique à chaque fois, donc ils ne dépendent pas du maintien de noms de classes spécifiques.

Limitation de débit et défis CAPTCHA

Allez trop vite ou trop souvent sur Temu depuis une même IP, et vous déclencherez des limites de débit ou des CAPTCHA. Certains outils gèrent cela avec une limitation intelligente et une résolution CAPTCHA intégrée. D’autres vous laissent vous débrouiller — ce qui, pour un utilisateur non technique, revient pratiquement à une impasse.

Pour le scraping cloud, l’essentiel est d’avoir des requêtes concurrentes réparties sur des IP propres, avec une logique de réessai automatique.

Meilleurs extracteurs Temu par niveau de compétence : analyse complète

Trouvez votre ligne et allez directement à la section qui vous correspond :

| Approche | Niveau | Temps de configuration | Gestion anti-bot | Idéal pour |

|---|---|---|---|---|

| Extension Chrome IA (ex. Thunderbit) | Débutant | < 2 min | Pris en charge (cloud ou navigateur) | Dropshippers, marketeurs, équipes e-commerce |

| Outil de bureau no-code (ex. Octoparse, ParseHub) | Débutant–Intermédiaire | 10–60 min | Partielle (configuration de proxy nécessaire) | Extraction régulière avec modèles |

| API/service de scraping (ex. ScraperAPI, Apify) | Intermédiaire | 15–45 min | Intégrée | Développeurs intégrant des pipelines |

| Proxy géré/entreprise (ex. Bright Data, Oxylabs) | Avancé/Entreprise | Heures–jours | Infrastructure complète | Gros volumes, livraison vers entrepôt de données |

| Script Python personnalisé (Playwright/Selenium) | Avancé | 1–4 h+ | Manuelle (proxy + CAPTCHA à configurer) | Contrôle total, personnalisation de cas particuliers |

Thunderbit : le meilleur extracteur Temu pour les utilisateurs non techniques

est une extension Chrome propulsée par l’IA, conçue pour les utilisateurs métier — équipes commerciales, opérateurs e-commerce, dropshippers, marketeurs — qui ont besoin de données structurées issues de sites web sans écrire de code. Je travaille chez Thunderbit, donc je connais bien le produit. Je vais être direct sur ce qu’il fait et sur sa place dans l’écosystème.

Le flux principal tient en deux clics : ouvrez une page Temu, cliquez sur AI Suggest Fields, vérifiez les colonnes suggérées (nom du produit, prix, image, note, etc.), puis cliquez sur Scrape.

L’IA de Thunderbit lit la structure de la page et propose automatiquement les noms de colonnes ainsi que les types de données. Elle ne dépend pas de sélecteurs CSS fixes, donc lorsque Temu change ses noms de classes ou la disposition de ses cartes, l’extracteur s’adapte.

Fonctionnalités clés pour Temu :

- Mode de scraping cloud : plus rapide pour les pages publiques, traite jusqu’à 50 pages à la fois. Idéal pour les pages de catégorie, les résultats de recherche et les listes de produits qui ne nécessitent pas de connexion.

- Mode de scraping navigateur : utilise votre session Chrome actuelle, y compris les cookies, la locale et l’état de connexion. Idéal lorsque la région, les popups ou le contenu connecté influencent ce que la page affiche.

- Scrape Subpages : après l’extraction d’une page de listing, cliquez sur « Scrape Subpages » pour visiter chaque page de détail produit et ajouter des colonnes comme la description complète, les variantes, les informations vendeur, l’estimation d’expédition et les caractéristiques — sans configuration supplémentaire.

- Field AI Prompts : catégorisez, traduisez ou reformatez les données pendant l’extraction. Par exemple : « Classez ce produit dans Ustensiles de cuisine, Petit électroménager, Rangement ou Autre. »

- Scraping programmé : définissez un planning en langage naturel (« tous les lundis à 9 h »), saisissez les URL et Thunderbit exécute l’extraction dans le cloud puis exporte vers Google Sheets, Airtable ou une autre destination.

- Exports gratuits : Excel, CSV, Google Sheets, Airtable, Notion, JSON — aucun paywall sur l’export. Les images sont exportées comme de vraies pièces jointes dans Airtable et Notion.

Tarification : offre gratuite jusqu’à 6 pages (ou 10 avec un boost d’essai) ; les formules payantes commencent autour de pour 500 crédits, avec 1 crédit = 1 ligne de sortie.

Comparaison directe : Thunderbit vs script Python sur la même page Temu

Le contraste est net :

| Tâche | Thunderbit | Python (Playwright) |

|---|---|---|

| Ouvrir une page catégorie Temu | Ouvrir la page dans Chrome | Configurer l’environnement Python, installer Playwright, installer les navigateurs |

| Identifier les champs | Cliquer sur « AI Suggest Fields » | Inspecter le DOM, les appels réseau, les payloads JSON |

| Gérer le chargement dynamique | Mode navigateur/cloud + pagination | Écrire la logique de scroll/attente, intercepter les requêtes |

| Gérer les blocages | Essayer le mode cloud ou navigateur | Ajouter des proxies, des en-têtes, du fingerprinting, des réessais, le CAPTCHA |

| Extraire les champs de listing | Cliquer sur « Scrape » | Écrire des sélecteurs ou une logique d’analyse d’API |

| Enrichir les pages produit | Cliquer sur « Scrape Subpages » | Construire un crawler PDP séparé |

| Exporter | Cliquer sur Sheets/Airtable/Notion/Excel | Écrire du code d’intégration CSV/JSON/Sheets |

| Configuration typique pour un utilisateur métier | Moins de 2 minutes | 1–4 heures minimum ; maintenance continue |

Un prototype Playwright minimal pour Temu pourrait ressembler à ceci (pseudocode — pas prêt pour la production) :

1from playwright.sync_api import sync_playwright

2with sync_playwright() as p:

3 browser = p.chromium.launch(headless=False)

4 page = browser.new_page()

5 page.goto("https://www.temu.com/search_result.html?search_key=kitchen+organizer")

6 page.wait_for_load_state("networkidle")

7 for _ in range(8):

8 page.mouse.wheel(0, 2000)

9 page.wait_for_timeout(1200)

10 cards = page.locator("[data-product-id], a[href*='goods.html']")

11 # Le code de production nécessite encore des sélecteurs, des proxies, des réessais,

12 # la gestion du CAPTCHA, le crawling des PDP et la logique d’export.

13 print(cards.count())Cela fait déjà plus de 10 lignes avant même d’avoir extrait un seul champ, et vous n’avez pas encore abordé les proxies, le CAPTCHA, l’enrichissement PDP ni l’export. Pour un utilisateur non technique, Thunderbit compresse tout ce flux en quelques clics. Pour un développeur, la voie Python offre plus de contrôle — mais à un coût de maintenance bien plus élevé.

Octoparse et ParseHub : extracteurs Temu no-code de bureau

Si vous voulez plus de contrôle qu’une extension Chrome sans vouloir écrire de code, Octoparse et ParseHub sont les principales options.

Octoparse propose un modèle public Temu Details Scraper. Son exemple de sortie inclut les IDs produits, titres, prix, données vendeur/boutique, URL d’images, remises, URL de boutique et spécifications détaillées. C’est un vrai avantage : vous pouvez démarrer avec un modèle plutôt que de construire un workflow de zéro. Octoparse prend aussi en charge l’extraction cloud, la planification et la création visuelle de workflows.

Les réserves pour Temu :

- Les modules anti-bot additionnels (proxies résidentiels à , résolution CAPTCHA à 1–1,50 $ par mille) peuvent vite faire grimper la facture.

- Les modèles peuvent casser lorsque Temu change sa mise en page. Vous devrez peut-être mettre à jour les sélecteurs ou attendre qu’Octoparse maintienne le modèle.

- La configuration prend de 10 à 60 minutes selon la complexité de la page.

Tarification Octoparse : plan gratuit avec 10 tâches et 50 000 exportations mensuelles de données ; Standard autour de 75 $/mois en annuel ; Professional autour de 108 $/mois en annuel. Les add-ons pour proxies, CAPTCHA et services gérés sont en supplément.

ParseHub est un extracteur visuel de bureau/web qui gère bien les pages dynamiques (il exécute un navigateur Chromium complet). En revanche, les formules payantes commencent à 189 $/mois, ce qui est élevé pour un indépendant. Je n’ai pas trouvé de modèle Temu public particulièrement solide lors de mes recherches. ParseHub convient mieux aux équipes déjà à l’aise avec la création de projets de scraping visuels.

| Outil | Atouts pour Temu | Faiblesses sur Temu | Tarification |

|---|---|---|---|

| Octoparse | Modèle Temu public, workflow visuel, extraction cloud, planification | Maintenance des modèles, add-ons anti-bot qui augmentent le coût | Gratuit ; ~75 $/mois Standard annuel ; ~108 $/mois Pro annuel ; add-ons en plus |

| ParseHub | Gestion des pages dynamiques, constructeur de workflows projet, rotation d’IP sur les formules payantes | Prix d’entrée plus élevé, aucun modèle Temu public trouvé | Formules payantes à partir de 189 $/mois |

APIs de scraping : ScraperAPI, Apify et Bright Data pour Temu

Les services de scraping basés sur API gèrent les proxies, le rendu et la logique anti-bot afin que les développeurs puissent se concentrer sur l’analyse et le stockage des données. Ils sont adaptés quand vous construisez un pipeline, pas quand vous faites un export ponctuel vers un tableur.

ScraperAPI est une API développeur pour la rotation de proxy et le rendu. Sa page tarifaire indique un essai de 7 jours avec 5 000 crédits, Hobby à 49 $/mois pour 100 000 crédits, puis des paliers supérieurs. Le point délicat pour Temu : le rendu JavaScript et les pools de proxy premium coûtent de 10 à 75 crédits par requête selon le palier. Cette multiplication des crédits signifie que votre coût réel par ligne peut être bien plus élevé que le prix affiché.

Apify est une plateforme avec une place de marché d’« actors » (extracteurs) prêts à l’emploi. Plusieurs actors Temu existent. Un Temu Scraper maintenu par la communauté affiche une tarification au paiement par événement d’environ 5 $ pour 1 000 produits sur le niveau gratuit. Un autre Temu Products Scraper affiche 4 $ pour 1 000 résultats. Le risque : la qualité des actors varie, la maintenance dépend de la communauté et certains actors peuvent être obsolètes ou casser lorsque Temu est mis à jour. Vérifiez toujours la date de dernière modification et les notes des utilisateurs avant de vous engager.

Bright Data est l’option entreprise. Sa page dédiée au scraper Temu indique que les tâches tournent sur l’infrastructure Bright Data avec rotation de proxy, géociblage, logique CAPTCHA/déblocage et autoscaling. Les formats de sortie incluent JSON, CSV, Parquet, ainsi qu’une livraison directe vers S3, GCS, Azure Blob, BigQuery et Snowflake. Les comparatifs sectoriels indiquent une tarification Web Scraper API en paiement à l’usage autour de 2,5 $ pour 1 000 enregistrements, avec des plans engagés à partir d’environ 499 $/mois. Puissant, mais tarifé pour des équipes avec de vrais budgets.

Oxylabs dispose aussi d’une page dédiée Temu Scraper API. Les plans commencent à 49 $/mois, avec un essai gratuit allant jusqu’à 2 000 résultats. C’est une solide alternative à Bright Data pour les équipes de développement qui veulent des données Temu structurées via API.

| API/Plateforme | Preuve spécifique à Temu | Point fort | Point faible | Idéal pour |

|---|---|---|---|---|

| ScraperAPI | Aucune page spécifique Temu trouvée, mais des fonctions anti-bot e-commerce sont documentées | Point d’entrée simple, rendu JS, proxies premium | Multiplication des crédits pour les fonctions premium ; les développeurs doivent analyser les données | Pipelines développeur |

| Apify | Plusieurs actors Temu dans la marketplace | Le chemin le plus rapide pour les développeurs si l’actor correspond et est maintenu | Qualité des actors variable ; certains obsolètes | Développeurs voulant une marketplace d’actors + planification |

| Bright Data | Page dédiée au scraper Temu | Infrastructure entreprise, déblocage, livraison vers entrepôt de données | Cher ; des notions de web scraping restent nécessaires | Équipes data à l’échelle entreprise |

| Oxylabs | Page dédiée Temu Scraper API | Tarification claire par résultat, gestion JS, promesses d’IP/CAPTCHA | Workflow d’API développeur | Équipes de développement ayant besoin d’un accès API Temu |

Scripts Python personnalisés (Playwright/Selenium) : contrôle total, effort élevé

Les extracteurs Python personnalisés offrent une flexibilité maximale — c’est leur avantage. Playwright est généralement un meilleur point de départ que Selenium pour Temu, grâce à son modèle d’attente automatique et à sa meilleure gestion des pages riches en JavaScript.

Mais le compromis est rude.

Un prototype prend 1 à 4 heures. Un extracteur de production a besoin de rotation de proxy, d’empreintes navigateur réalistes, d’une stratégie CAPTCHA, de réessais, de validation de schéma, de stockage des sorties, de supervision, d’alertes et d’un examen juridique.

Et il casse. Les communautés de scraping sur Reddit décrivent régulièrement le scraping e-commerce moderne comme instable lorsque les sites utilisent Cloudflare, le rendu JavaScript et des empreintes anti-bot.

| Mode d’échec | Cause typique | Atténuation | |---|---|---|---| | HTML vide / produits manquants | Le JS charge les cartes produits après le HTML initial | Utiliser Playwright, attendre le réseau et le DOM | | Seuls les premiers produits apparaissent | Défilement infini / chargement paresseux | Boucle de scroll, attentes réseau inactif, seuils de nombre de cartes | | Prix manquants ou incohérents | État région/session/devise ou réponse anti-bot | Définir la locale, les cookies, un proxy géociblé | | 403 / défi / CAPTCHA | Réputation IP, empreinte headless, rythme des requêtes | Proxies résidentiels, navigateur furtif, rythme réduit | | Rupture des sélecteurs | Changements DOM/classe, tests A/B | Extraction sémantique ou analyse d’API si disponible |

Les scripts personnalisés ne sont pas l’option « gratuite ». Ils déplacent les coûts des abonnements vers le temps développeur, les factures de proxy, les coûts CAPTCHA et le risque de maintenance. Si vous avez un ingénieur scraping en interne et que vous avez besoin d’une logique atypique, c’est la bonne voie. Pour tous les autres, c’est en pratique l’option la plus coûteuse.

Bonne pratique : scraping des sous-pages pour des données produit Temu complètes

C’est la bonne pratique la plus impactante de cet article — et presque aucun autre guide ne la couvre.

Une page de catégorie ou de recherche Temu vous donne les bases : titre, miniature, prix, note approximative. Mais les champs qui rendent vraiment une ligne exploitable — descriptions détaillées, liste des variantes, nombre complet d’avis, estimations d’expédition, noms des vendeurs, tableaux de spécifications — se trouvent sur la page de détail produit (PDP).

Si vous ne scrapez que la page de listing, vous travaillez avec un jeu de données partiel.

Le flux en deux étapes :

- Étape 1 — Extraire la page de listing (PLP) : récupérer le nom du produit, le prix, la miniature et la note depuis une page de recherche ou de catégorie Temu.

- Étape 2 — Enrichir via le scraping des sous-pages : visiter chaque PDP produit et ajouter des colonnes comme la description complète, le nombre d’avis, les options de variantes, le délai d’expédition et les informations vendeur.

Voici à quoi ressemblent les données avant et après :

| Champ | Depuis la PLP (Étape 1) | Ajouté depuis la PDP (Étape 2) |

|---|---|---|

| Titre du produit | ✅ | — |

| Prix | ✅ | ✅ (vérifié / % de remise) |

| Miniature | ✅ | — |

| Note étoiles | ✅ | ✅ (avec nombre d’avis) |

| Description complète | ❌ | ✅ |

| Variantes (tailles, couleurs) | ❌ | ✅ |

| Nom du vendeur | ❌ | ✅ |

| Estimation d’expédition | ❌ | ✅ |

| Caractéristiques détaillées | ❌ | ✅ |

Dans Thunderbit, c’est un seul clic : après votre première extraction, cliquez sur « Scrape Subpages ». L’IA visite chaque URL produit et ajoute les colonnes supplémentaires — sans configuration supplémentaire, sans spider séparé, sans maintenance de sélecteurs. Le modèle Temu Details d’Octoparse et l’actor Temu d’Apify prennent aussi en charge les champs au niveau PDP, mais avec davantage de configuration et de maintenance. En Python, il faudrait construire un crawler PDP séparé, maintenir ses sélecteurs et gérer la pagination à l’intérieur des pages de détail — un investissement additionnel important.

Bonne pratique : scraping Temu programmé pour le suivi continu des prix et des stocks

Les extractions ponctuelles sont utiles pour la découverte produit. La veille concurrentielle exige une observation répétée.

Les prix changent, les produits sont en rupture, de nouveaux articles apparaissent chaque jour et la profondeur des remises varie avec les promotions. Une extraction hebdomadaire ou quotidienne crée un tableau d’historique sur lequel votre équipe peut réellement agir.

Trois cas d’usage qu’il vaut la peine d’automatiser :

- Suivi des prix : suivez chaque semaine les 50 principaux SKU Temu d’un concurrent. Recevez les prix mis à jour automatiquement dans Google Sheets pour les comparer en un coup d’œil à vos propres prix.

- Suivi des stocks et des disponibilités : détectez lorsqu’un produit tendance est en rupture, qu’une nouvelle variante apparaît ou que les délais d’expédition changent.

- Détection de nouveaux produits/tendances : programmez une extraction quotidienne de la section « Nouveautés » de Temu ou d’une page de catégorie prioritaire. Triez par nombre d’unités vendues ou d’avis pour repérer tôt les produits en hausse.

Dans Thunderbit, vous configurez cela en décrivant l’intervalle en langage naturel (« tous les lundis à 9 h »), en saisissant vos URL cibles et en cliquant sur « Schedule ». L’extraction s’exécute dans le cloud et exporte vers la destination choisie. Comme l’IA relit la page à chaque fois, les extractions programmées s’adaptent automatiquement aux changements de mise en page de Temu — vous n’avez pas besoin de mettre à jour les sélecteurs lorsque Temu redessine une carte produit.

L’alternative : mettre en place une tâche cron, maintenir un script Python, configurer la rotation de proxy, construire un pipeline de sortie et corriger les sélecteurs à chaque changement de mise en page de Temu. Pour une équipe non technique, c’est exclu. Pour un développeur, c’est une charge permanente. Apify et Bright Data prennent aussi en charge les exécutions planifiées, mais avec une configuration plus technique et un coût plancher plus élevé.

Bonne pratique : flux Temu de bout en bout (extraire → nettoyer → exporter → agir)

La plupart des guides de scraping s’arrêtent au « téléchargement du CSV ».

Mais les utilisateurs métier ont besoin des données dans les outils qu’ils utilisent vraiment — Google Sheets pour la collaboration, Airtable pour les bases produit, Notion pour les tableaux de bord d’équipe. La vraie bonne pratique, c’est un flux de bout en bout :

| Étape du workflow | Ce qui se passe | Capacité Thunderbit |

|---|---|---|

| Extraire | Récupérer les données des pages Temu | AI Suggest Fields → Scrape (2 clics) |

| Enrichir | Visiter la page de détail de chaque produit | Scrape Subpages (1 clic) |

| Nettoyer et étiqueter | Catégoriser les produits, normaliser les prix, traduire les titres | Field AI Prompt — étiqueter, formater, traduire pendant l’extraction |

| Exporter | Envoyer les données vers les outils métier | Export gratuit vers Excel, Google Sheets, Airtable, Notion ; téléchargement CSV/JSON |

| Surveiller | Suivre les changements dans le temps | Scheduled Scraper avec intervalles en langage naturel |

Voici un exemple concret : vous extrayez 200 produits de cuisine Temu. Pendant l’extraction, un Field AI Prompt classe automatiquement chaque produit dans « Ustensiles / Petit électroménager / Rangement / Nettoyage / Décoration ». Les prix sont normalisés en valeurs numériques USD. Les titres de produits chinois sont traduits en anglais. Les données sont exportées directement vers une base Airtable avec les images produit intactes (pas seulement des URL — de vraies pièces jointes d’image, comme décrit dans ). Une extraction programmée rafraîchit ensuite les données chaque semaine.

Voici quelques instructions utiles de Field AI Prompt pour les données Temu :

- « Classez ce produit dans l’une de ces catégories : Ustensiles de cuisine, Petit électroménager, Rangement, Nettoyage, Décoration, Autre. Retournez uniquement la catégorie. »

- « Traduisez le titre du produit en anglais concis tout en conservant les noms de marque, quantités, tailles et numéros de modèle. »

- « Normalisez le prix en un nombre sans symbole monétaire. »

- « Évaluez la demande comme Forte, Moyenne ou Faible en fonction de la note, du nombre d’avis et du nombre d’unités vendues. Si une donnée manque, renvoyez Inconnu. »

Ce workflow transforme un simple scrape en une base vivante d’intelligence produit — sans qu’un développeur ait à construire un pipeline ETL séparé.

Comparatif des meilleurs extracteurs Temu : tableau côte à côte

| Outil | Niveau | Temps de configuration | Gestion anti-bot | Scraping des sous-pages | Planification | Options d’export | Tarif | Idéal pour |

|---|---|---|---|---|---|---|---|---|

| Thunderbit | Débutant | Minutes | Mode navigateur, mode cloud, détection de champs par IA | Oui (Scrape Subpages) | Oui (plannings en langage naturel) | Excel, CSV, Google Sheets, Airtable, Notion, JSON | 6 pages gratuites ; payant dès ~9–15 $/mois pour 500 crédits | Équipes e-commerce non techniques, dropshippers |

| Octoparse | Débutant–Intermédiaire | 10–60 min | Extraction cloud, add-ons proxy/CAPTCHA | Oui (workflows modèle) | Oui (formules payantes/cloud) | Excel, CSV, JSON, HTML, XML, base de données, Google Sheets | Gratuit ; ~75 $/mois Standard annuel ; add-ons en plus | Opérateurs voulant des workflows visuels + un modèle Temu |

| ParseHub | Débutant–Intermédiaire | 30–60 min | Rendu dynamique, rotation d’IP payante | Oui (flux de projet) | Formules payantes | CSV/JSON, Dropbox/S3 sur les formules payantes | Payant à partir de 189 $/mois | Équipes construisant des projets visuels pour des sites dynamiques |

| ScraperAPI | Développeur | Heures | Rotation de proxy, rendu JS, pools premium | Code personnalisé | DataPipeline/planificateur | HTML/JSON/CSV | Essai 5K crédits ; Hobby 49 $/mois ; paliers supérieurs disponibles | Développeurs construisant des pipelines Temu personnalisés |

| Apify | Intermédiaire | 10–30 min si l’actor convient | Logique navigateur/proxy spécifique à l’actor | Dépend de l’actor | Oui | JSON, CSV, Excel, API/ensembles de données | Plateforme gratuite ; actors Temu ~4–5 $/1K produits | Développeurs/opérateurs capables d’évaluer la qualité des actors |

| Bright Data | Avancé/Entreprise | Heures–jours | Proxies complets, CAPTCHA, déblocage, autoscaling | Via scraper/API personnalisé | Oui | JSON, CSV, Parquet, S3, GCS, Azure, BigQuery, Snowflake | ~2,5 $/1K enregistrements PAYG ; engagé à partir d’environ 499 $/mois | Équipes data entreprise, extraction à gros volume |

| Oxylabs | Avancé | Heures | Gestion JS, promesses d’IP/CAPTCHA | Via API personnalisé | Oui | JSON/sortie API | À partir de 49 $/mois ; essai jusqu’à 2K résultats | Équipes de développement ayant besoin d’un accès API Temu |

| Python personnalisé (Playwright) | Avancé | 1–4 h+ ; maintenance continue | Proxies manuels, CAPTCHA, empreintes | Entièrement personnalisé | Cron/file d’attente/manuel | Personnalisé | Temps dev + coûts proxy/CAPTCHA/hébergement | Cas particuliers, équipes avec ingénieurs scraping |

Quel extracteur Temu choisir ? Recommandations rapides

- Dropshipper qui a besoin d’une recherche produit rapide ? Commencez par . C’est le chemin le plus rapide entre « je veux des données Temu » et « j’ai un tableur ». Si cela fonctionne sur vos pages cibles (et cela devrait pour la plupart des pages publiques de catégorie et de produit), c’est réglé.

- Opérateur qui veut un contrôle visuel et des modèles réutilisables ? Octoparse dispose d’un modèle public Temu Details et d’un constructeur de workflow visuel. Comptez 10 à 30 minutes de configuration et un peu de paramétrage proxy/CAPTCHA.

- Développeur qui construit un pipeline de données ou un outil interne ? ScraperAPI ou Apify vous donnent des workflows API/actor intégrables au code et aux tâches planifiées. Vérifiez soigneusement les actors Apify — regardez leur état de maintenance et les notes des utilisateurs.

- Équipe entreprise ayant besoin de gros volumes de données Temu et d’une livraison vers entrepôt ? Bright Data est l’option infrastructure. Cher, mais gère l’échelle, le déblocage et la livraison vers S3/BigQuery/Snowflake.

- Ingénieur scraping ayant besoin d’une logique atypique ? Playwright/Selenium personnalisé vous donne un contrôle total. Prévoyez simplement la maintenance continue, les coûts de proxy et la gestion du CAPTCHA.

Pour la plupart des utilisateurs métier non techniques, je recommande de tester d’abord la version gratuite de Thunderbit. La question immédiate est toujours : « puis-je obtenir les lignes dont j’ai besoin à partir de cette page Temu précise ? » — et vous pouvez y répondre en moins de deux minutes sans rien dépenser. Pour les développeurs, établissez un benchmark du coût par ligne réussie entre Apify, ScraperAPI et un petit prototype Playwright avant d’engager un budget.

FAQ sur l’extraction de Temu

Est-il légal d’extraire Temu ?

Cela dépend de la juridiction, des données que vous collectez, de votre méthode d’accès et de l’usage que vous faites des données. Les de Temu restreignent explicitement l’accès automatisé, y compris le crawling, le scraping ou le spidering de pages ou de données. Les tribunaux américains ont offert certains précédents favorables pour l’accès à des données publiquement accessibles (la décision hiQ v. LinkedIn de la Ninth Circuit), mais ont aussi confirmé des actions pour rupture de contrat et intrusion. En bref : l’extraction de données produit publiquement accessibles à des fins de recherche peut être défendable dans certains contextes, mais les conditions d’utilisation, le droit à la vie privée, le droit d’auteur et l’usage des données comptent tous. Ceci n’est pas un avis juridique — consultez un conseil pour un usage commercial.

À quelle fréquence Temu modifie-t-il la mise en page de son site ?

Aucun rythme public n’a été documenté. Les retours de la communauté et l’écosystème d’outils traitent Temu comme une cible dynamique, fréquemment mise à jour. Considérez que les sélecteurs CSS peuvent casser à tout moment, et privilégiez l’extraction IA/sémantique ou des modèles activement maintenus plutôt que des sélecteurs codés en dur.

Puis-je extraire Temu sans être bloqué ?

Pour des pages publiques limitées et avec un rythme raisonnable, oui — surtout avec des outils qui disposent d’un vrai rendu navigateur, du support de session et d’un mécanisme de limitation. Aucun outil ne doit être considéré comme une garantie universelle. Le scraping cloud avec IP rotatives fonctionne bien pour les pages de catalogue publiques ; le scraping navigateur avec votre session actuelle fonctionne mieux lorsque la région, la connexion ou des popups influencent les données.

Quelles données puis-je extraire des pages produit Temu ?

Les champs publics courants incluent le titre du produit, l’URL, le prix actuel, le prix initial, le pourcentage de remise, les URL d’image, la note étoiles, le nombre d’avis, le nombre d’unités vendues, le nom du vendeur/boutique, les informations d’expédition, la catégorie, les spécifications produit, les variantes (couleurs, tailles) et l’horodatage du scrape. Les champs exacts disponibles dépendent du type de page (listing vs détail) et de la région.

Ai-je besoin de proxys pour extraire Temu ?

Pour une petite extraction manuelle en mode navigateur (quelques pages à la fois), pas forcément. Pour une collecte cloud, planifiée ou à fort volume, des proxys ou une infrastructure gérée anti-blocage sont généralement nécessaires. Des outils comme Thunderbit, Bright Data et ScraperAPI intègrent la gestion des proxies dans leur plateforme, ce qui vous évite de la configurer séparément.

Si vous souhaitez approfondir des sujets connexes, consultez nos guides sur , , et . Vous pouvez aussi regarder des tutoriels sur la .

En savoir plus