Le web change à une vitesse folle, presque aussi vite que je descends mes cafés du matin — et crois-moi, c’est pas rien ! En 2026, l’extraction de données en ligne n’est plus réservée aux pros de la data : c’est devenu un passage obligé pour l’intelligence économique, l’entraînement de l’IA et l’automatisation. Que tu veuilles surveiller les tendances du marché, nourrir ton prochain LLM ou juste garder un œil sur les prix de tes concurrents, avoir accès à des données web structurées et fraîches, c’est devenu vital. Et au centre de cette ruée vers la data ? Python, bien sûr. Avec son écosystème ultra-riche et sa syntaxe abordable, Python reste le top du top pour le web scraping, que tu fasses un petit script ou que tu montes une usine à données.

Mais voilà, le vrai casse-tête, c’est de choisir les bons packages Python pour le scraping web. J’ai vu des équipes galérer des jours entiers à cause d’un mauvais outil anti-bot, ou perdre un temps fou à décortiquer du HTML mal fichu alors qu’une bibliothèque plus futée aurait plié le truc en deux temps trois mouvements. Après des années à bosser dans le SaaS, l’automatisation et l’IA (et après avoir lancé pour rendre le scraping accessible à tous), j’ai fait le tri et sélectionné les 12 meilleures bibliothèques Python pour l’extraction web en 2026 — chacune avec ses points forts, ses particularités et ses cas d’usage préférés. Prêt à dégoter l’outil parfait pour ton prochain projet data ? On y va !

Pourquoi bien choisir son package Python pour le scraping web, c’est crucial

Soyons clairs : tous les projets de scraping ne se ressemblent pas. Parfois, tu veux juste choper quelques prix sur une page statique. D’autres fois, tu dois dompter un site blindé de JavaScript, aussi coriace qu’un chat qu’on essaie de laver. Le bon package peut te faire gagner un temps fou, éviter les galères et t’épargner les pièges classiques comme les blocages anti-bot ou le HTML tout cassé.

Si Python cartonne autant dans le web scraping, c’est pas pour rien. Des bibliothèques comme requests et urllib3 dépassent le , et la plupart des outils majeurs sont pensés d’abord pour Python. Mais ce super-pouvoir implique de bien choisir : un mauvais outil, et ton projet va ramer comme un vieux modem. Fais le bon choix, et tu auras des données propres et structurées avant même que ton café ne refroidisse.

Comment j’ai sélectionné les meilleures bibliothèques Python pour le scraping web

Je n’ai pas tiré au sort sur PyPI ! Voilà mes critères pour chaque package :

- Performance & Concurrence : Est-ce que ça peut extraire des centaines ou milliers de pages vite fait ?

- Facilité d’utilisation : Accessible aux débutants ou réservé aux experts ?

- Puissance de parsing HTML : Est-ce que ça gère le HTML mal fichu, supporte XPath/CSS, facilite l’extraction ?

- Gestion du contenu dynamique : Ça gère les sites blindés de JavaScript ou juste les pages statiques ?

- Communauté & Documentation : Y a-t-il une grosse base d’utilisateurs et des docs béton ?

- Cas d’usage idéal : C’est fait pour des scripts rapides, des robots à grande échelle ou un usage entre les deux ?

J’ai aussi pris en compte les retours de devs, les benchmarks récents et mes propres (parfois douloureuses) expériences. Allez, on passe aux outils sélectionnés.

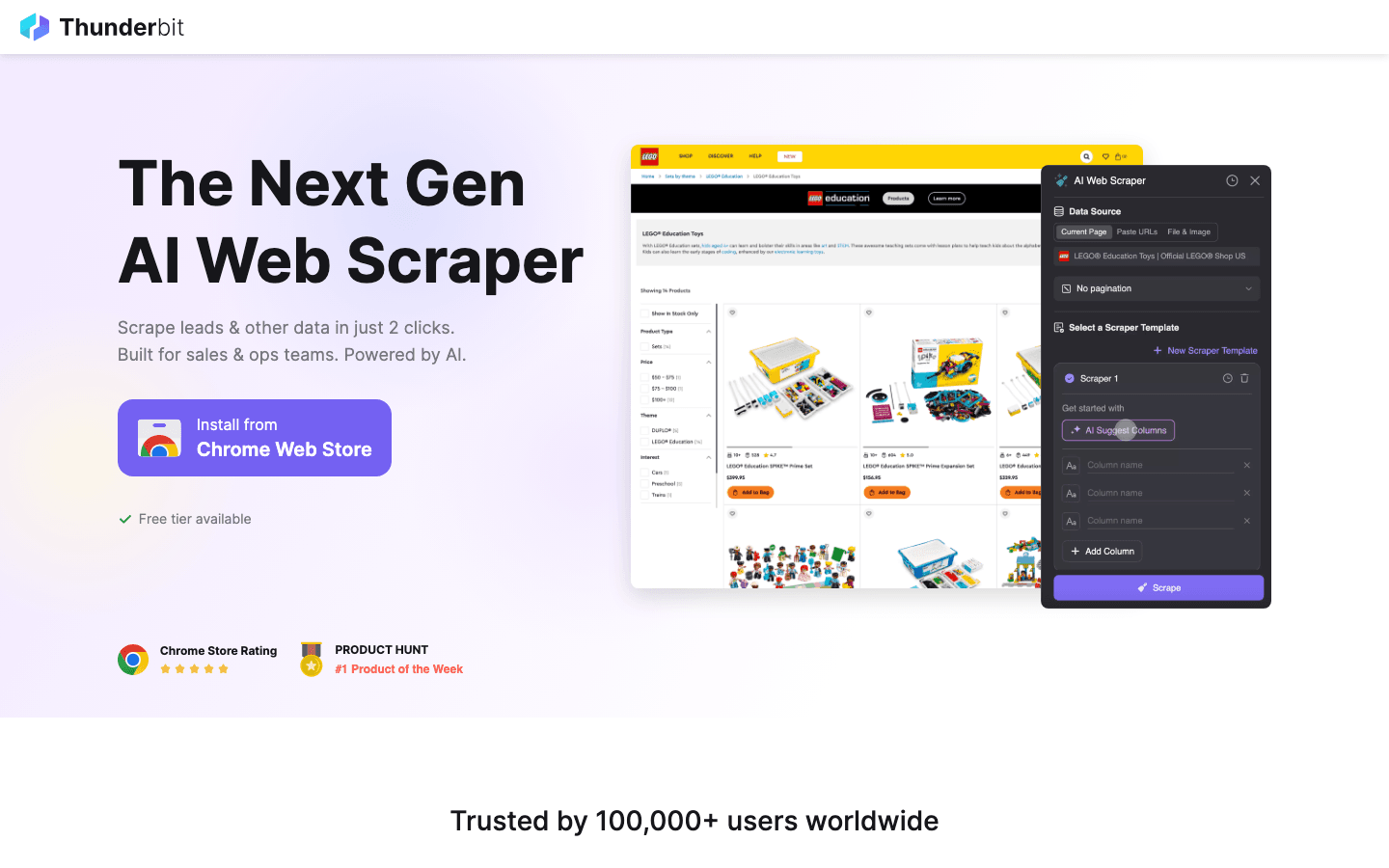

1. Thunderbit

n’est pas une bibliothèque Python classique : c’est une extension Chrome boostée à l’IA qui change la donne, surtout pour les devs Python qui veulent aller vite, viser juste et automatiser à fond. Son truc en plus ? Tu donnes tes instructions en langage naturel, l’IA pige ce que tu veux extraire et s’occupe de tout : suggestions de champs, navigation sur les sous-pages, gestion de la pagination, export direct vers Excel, Google Sheets, Notion ou Airtable…

n’est pas une bibliothèque Python classique : c’est une extension Chrome boostée à l’IA qui change la donne, surtout pour les devs Python qui veulent aller vite, viser juste et automatiser à fond. Son truc en plus ? Tu donnes tes instructions en langage naturel, l’IA pige ce que tu veux extraire et s’occupe de tout : suggestions de champs, navigation sur les sous-pages, gestion de la pagination, export direct vers Excel, Google Sheets, Notion ou Airtable…

Thunderbit, c’est l’allié parfait pour extraire des données complexes ou mal rangées — annuaires en vrac, listes de produits, ou sites où le HTML ressemble à un tableau de Picasso. Sa fonction Suggestion de champs IA lit la page et te propose les colonnes les plus pertinentes, pendant que le scraping de sous-pages enrichit tes données en allant chercher les infos sur les pages de détail. Et si tu en as marre des blocages anti-bot, Thunderbit propose le scraping via navigateur ou dans le cloud.

Les devs Python adorent Thunderbit pour le prototypage rapide, la génération de leads et l’analyse de marché. Tu peux intégrer ses exports direct dans tes pipelines Python, ou automatiser tes workflows grâce à son API. Ce n’est pas une bibliothèque de code classique, mais c’est vite devenu un must pour ceux qui veulent passer moins de temps à coder et plus à analyser.

Points forts :

- Suggestions de champs et extraction de données pilotées par l’IA

- Gère les sous-pages, la pagination, les PDF/images

- Exporte vers CSV, Excel, Google Sheets, Notion, Airtable

- Zéro code requis — parfait pour les non-tech comme pour les devs Python pressés

- Offre gratuite dispo ; formules payantes évolutives

Idéal pour : Génération de leads, études de marché, prototypage rapide, extraction de données web complexes ou désordonnées.

2. Beautiful Soup

c’est la star historique du parsing HTML en Python. Si tu débutes ou que tu veux extraire des données de pages statiques, c’est l’outil parfait. Beautiful Soup est imbattable pour naviguer et analyser du HTML mal fichu (« tag soup »), ce qui en fait le sauveur des sites qui ne respectent pas les standards.

c’est la star historique du parsing HTML en Python. Si tu débutes ou que tu veux extraire des données de pages statiques, c’est l’outil parfait. Beautiful Soup est imbattable pour naviguer et analyser du HTML mal fichu (« tag soup »), ce qui en fait le sauveur des sites qui ne respectent pas les standards.

L’API est super simple — .find(), .select(), .text — et se marie parfaitement avec requests pour récupérer les pages. Sous le capot, tu peux choisir différents parseurs (genre lxml pour la vitesse ou html5lib pour la compatibilité). La doc est top et la communauté énorme.

Points forts :

- API intuitive et « pythonique » pour naviguer dans le HTML/XML

- Gère sans souci le HTML cassé ou incohérent

- Compatible avec plusieurs parseurs pour la vitesse ou la compatibilité

- Communauté très active et plein de tutos

Idéal pour : Scripts rapides, extraction de pages statiques, débutants qui veulent une prise en main facile.

3. Scrapy

c’est le mastodonte du crawling automatisé à grande échelle. Si tu dois extraire des centaines ou milliers de pages, gérer des pipelines ou planifier des tâches récurrentes, Scrapy est la solution. Basé sur le moteur Twisted, il est ultra-rapide, supporte le crawling asynchrone, le nettoyage des données et l’export vers JSON, CSV ou bases de données.

c’est le mastodonte du crawling automatisé à grande échelle. Si tu dois extraire des centaines ou milliers de pages, gérer des pipelines ou planifier des tâches récurrentes, Scrapy est la solution. Basé sur le moteur Twisted, il est ultra-rapide, supporte le crawling asynchrone, le nettoyage des données et l’export vers JSON, CSV ou bases de données.

Scrapy est super extensible, avec des plugins pour les proxys, le cache, et même le rendu JavaScript (via Splash ou Selenium). La courbe d’apprentissage est un peu plus raide que Beautiful Soup, mais pour le scraping à grande échelle, c’est la référence.

Points forts :

- Crawling asynchrone et super performant

- Pipelines intégrés pour nettoyer et stocker les données

- Export vers plein de formats (JSON, CSV, DB)

- Grosse communauté et écosystème de plugins

Idéal pour : Projets de scraping récurrents à grande échelle, pipelines de données, besoins de rapidité et fiabilité.

4. Selenium

c’est l’outil incontournable pour extraire des sites dynamiques ou interactifs. Il automatise de vrais navigateurs (Chrome, Firefox, etc.), ce qui permet de simuler des actions utilisateur comme les clics, le scroll ou la saisie de formulaires. Si les données n’apparaissent qu’après exécution de JavaScript, Selenium saura les récupérer.

c’est l’outil incontournable pour extraire des sites dynamiques ou interactifs. Il automatise de vrais navigateurs (Chrome, Firefox, etc.), ce qui permet de simuler des actions utilisateur comme les clics, le scroll ou la saisie de formulaires. Si les données n’apparaissent qu’après exécution de JavaScript, Selenium saura les récupérer.

Le revers ? Selenium est lent et gourmand en ressources, car il lance un navigateur complet à chaque extraction. Mais pour les cas où rien d’autre ne marche, Selenium est indispensable.

Points forts :

- Automatisation complète du navigateur (Chrome, Firefox, Edge, etc.)

- Gère le contenu généré par JavaScript et les éléments interactifs

- Mode headless pour un scraping plus rapide sans interface graphique

- Grosse communauté et doc ultra-complète

Idéal pour : Extraction de sites dynamiques, automatisation de connexions, gestion de CAPTCHAs ou d’interactions complexes.

5. PyQuery

apporte la syntaxe jQuery à Python, ce qui est top si tu viens du monde JavaScript. Il s’appuie sur le parseur rapide

apporte la syntaxe jQuery à Python, ce qui est top si tu viens du monde JavaScript. Il s’appuie sur le parseur rapide lxml et permet d’utiliser des sélecteurs CSS comme $('div.classname') pour cibler les éléments.

PyQuery est parfait pour le prototypage rapide et pour les devs qui veulent un code concis et lisible. Il est plus rapide que Beautiful Soup pour les requêtes complexes et s’intègre facilement avec des outils asynchrones ou Selenium pour des workflows avancés.

Points forts :

- Syntaxe et sélecteurs jQuery en Python

- Parsing rapide grâce à lxml

- Idéal pour les devs venant de JavaScript

- Supporte le chaînage et les requêtes concises

Idéal pour : Prototypage, fans de jQuery, ceux qui veulent écrire moins de code pour le parsing HTML.

6. LXML

c’est le boss de la vitesse pour le parsing HTML et XML en Python. Basé sur les bibliothèques C

c’est le boss de la vitesse pour le parsing HTML et XML en Python. Basé sur les bibliothèques C libxml2 et libxslt, il est réputé pour ses perfs et son support avancé de XPath et des sélecteurs CSS. Pour les gros volumes ou les requêtes complexes, lxml est imbattable.

Tu peux l’utiliser seul ou comme moteur pour Beautiful Soup ou PyQuery. L’API est un peu plus technique, mais la rapidité et la flexibilité sont au rendez-vous pour les gros besoins.

Points forts :

- Parsing le plus rapide dispo en Python

- Support complet de XPath et des sélecteurs CSS

- Gère super bien les documents volumineux et complexes

- Utilisable seul ou comme parseur pour d’autres bibliothèques

Idéal pour : Parsing haute performance, scraping à grande échelle, projets avec des requêtes avancées.

7. Requests

c’est la référence pour faire des requêtes HTTP en Python. Son API claire et intuitive permet de récupérer des pages web en une ligne (

c’est la référence pour faire des requêtes HTTP en Python. Son API claire et intuitive permet de récupérer des pages web en une ligne (requests.get(url)). Il gère cookies, sessions et même le décodage JSON nativement.

Requests est synchrone (chaque requête attend la fin de la précédente), mais il est parfait pour les scripts simples et le scraping à petite échelle. À combiner avec Beautiful Soup ou lxml pour un workflow classique.

Points forts :

- API simple et « pythonique » pour les requêtes HTTP

- Gère cookies, sessions et redirections

- S’intègre parfaitement avec les bibliothèques de parsing

- Communauté et doc énormes

Idéal pour : Scripts simples, extraction de pages statiques, débutants qui veulent démarrer vite.

8. MechanicalSoup

est une bibliothèque légère qui automatise les interactions simples avec le navigateur — genre remplir des formulaires ou naviguer dans des étapes de connexion — sans lancer de navigateur complet. Elle s’appuie sur

est une bibliothèque légère qui automatise les interactions simples avec le navigateur — genre remplir des formulaires ou naviguer dans des étapes de connexion — sans lancer de navigateur complet. Elle s’appuie sur requests et Beautiful Soup, ce qui la rend bien plus rapide et légère que Selenium pour les sites pas trop dynamiques.

Si tu dois te connecter, soumettre des formulaires ou cliquer sur quelques pages (et que le site n’est pas trop dynamique), MechanicalSoup est un super compromis.

Points forts :

- Automatisation du remplissage de formulaires et de la navigation

- Basé sur Requests et Beautiful Soup

- Léger et rapide (pas de navigateur à lancer)

- Facile à utiliser pour une interactivité modérée

Idéal pour : Sites nécessitant une connexion ou la soumission de formulaires, automatisations simples, ceux qui veulent éviter la lourdeur de Selenium.

9. Aiohttp

c’est la référence asynchrone pour des requêtes web ultra-rapides et concurrentes. Si tu dois extraire des centaines de pages en un temps record, aiohttp permet d’envoyer des requêtes en parallèle, ce qui fait gagner un temps fou. Dans un benchmark, extraire 50 pages a pris seulement 3 secondes avec aiohttp, contre 16 secondes en mode synchrone ().

c’est la référence asynchrone pour des requêtes web ultra-rapides et concurrentes. Si tu dois extraire des centaines de pages en un temps record, aiohttp permet d’envoyer des requêtes en parallèle, ce qui fait gagner un temps fou. Dans un benchmark, extraire 50 pages a pris seulement 3 secondes avec aiohttp, contre 16 secondes en mode synchrone ().

Aiohttp demande d’écrire du code async def et d’utiliser await, mais le gain de vitesse vaut l’effort pour les gros volumes.

Points forts :

- Framework HTTP client/serveur asynchrone

- Supporte sessions, cookies et HTTP/2

- Accélération énorme pour les requêtes concurrentes

- S’intègre avec les bibliothèques de parsing asynchrones

Idéal pour : Scraping à grande vitesse, extraction concurrente, collecte d’API, devs à l’aise avec l’asynchrone.

10. Twisted

c’est le moteur réseau événementiel qui propulse Scrapy. Ce n’est pas une bibliothèque de scraping à proprement parler, mais les utilisateurs avancés peuvent l’utiliser directement pour créer des crawlers sur-mesure, gérer des protocoles non-HTTP ou implémenter des spiders hyper-concurrents.

c’est le moteur réseau événementiel qui propulse Scrapy. Ce n’est pas une bibliothèque de scraping à proprement parler, mais les utilisateurs avancés peuvent l’utiliser directement pour créer des crawlers sur-mesure, gérer des protocoles non-HTTP ou implémenter des spiders hyper-concurrents.

Twisted est puissant mais demande une vraie expertise. Il s’adresse aux scénarios très personnalisés ou à la création de frameworks maison.

Points forts :

- Réseau événementiel pour HTTP, WebSockets, SSH, etc.

- Supporte SSL, la concurrence et les protocoles personnalisés

- Moteur asynchrone de Scrapy

- Ultra-flexible pour les cas avancés

Idéal pour : Protocoles sur-mesure, création de frameworks de scraping, utilisateurs experts qui veulent tout contrôler.

11. Grab

c’est la boîte à outils tout-en-un pour le scraping : requêtes HTTP, parsing, automatisation, rotation de proxy, gestion des CAPTCHAs… Il se rapproche de Scrapy mais vise la simplicité, avec le support natif des proxys, du cache et des spiders asynchrones.

c’est la boîte à outils tout-en-un pour le scraping : requêtes HTTP, parsing, automatisation, rotation de proxy, gestion des CAPTCHAs… Il se rapproche de Scrapy mais vise la simplicité, avec le support natif des proxys, du cache et des spiders asynchrones.

Son gros plus : le système Grab:Spider, capable de lancer des milliers de requêtes en parallèle grâce à multicurl. Si tu veux une solution complète avec moins de configuration que Scrapy, Grab vaut le détour.

Points forts :

- Support natif des proxys, rotation d’user-agent, cache

- Système de spiders asynchrones pour la haute concurrence

- Parsing XPath et architecture modulaire

- Utilisé en production pour le scraping à grande échelle

Idéal pour : Projets tout-en-un, tâches avec beaucoup de proxys/CAPTCHAs, utilisateurs qui veulent la puissance sans la complexité de Scrapy.

12. Urllib3

c’est le moteur HTTP bas niveau qui propulse plein de clients Python, dont Requests. Il gère les connexions, la sécurité multithread, les retries et offre un contrôle fin sur les connexions HTTP. La plupart des devs l’utilisent sans le savoir, mais urllib3 est incontournable pour la perf ou la création de bibliothèques haut niveau.

c’est le moteur HTTP bas niveau qui propulse plein de clients Python, dont Requests. Il gère les connexions, la sécurité multithread, les retries et offre un contrôle fin sur les connexions HTTP. La plupart des devs l’utilisent sans le savoir, mais urllib3 est incontournable pour la perf ou la création de bibliothèques haut niveau.

Moins accessible que Requests, il est pourtant ultra-fiable et éprouvé.

Points forts :

- Pooling de connexions et sécurité multithread

- Contrôle précis des connexions HTTP

- Base de nombreuses autres bibliothèques

- Haute performance pour les requêtes répétées

Idéal pour : Clients HTTP personnalisés, crawlers multithread, devs qui bossent sur la stack HTTP Python.

Tableau comparatif : panorama des packages Python pour le scraping web

| Package | Facilité d’utilisation | Performance | Contenu dynamique | Puissance de parsing | Communauté/Docs | Idéal pour |

|---|---|---|---|---|---|---|

| Thunderbit | ★★★★☆ (GUI/IA) | Rapide (cloud/local) | Oui (via IA) | Champs auto, sous-pages | Croissante (tendance IA) | Génération de leads, études de marché, no-code |

| Beautiful Soup | ★★★★★ (très facile) | Moyen | Non | HTML/XML, tolérant | Énorme | Pages statiques, débutants |

| Scrapy | ★★☆☆☆ (apprentissage) | ★★★★★ (très élevé) | Plugins uniquement | CSS/XPath, pipelines | Large, active | Scraping récurrent à grande échelle |

| Selenium | ★★☆☆☆ (moyen) | ★☆☆☆☆ (lent) | Oui (complet) | DOM complet, JS | Mature | Sites dynamiques, interactifs |

| PyQuery | ★★★★☆ (jQuery) | Rapide (lxml) | Non* | Sélecteurs jQuery | Modérée | Prototypage, devs jQuery |

| LXML | ★★★☆☆ (avancé) | ★★★★★ (le plus rapide) | Non | XPath/CSS, XML | Modérée | Gros volumes, requêtes avancées |

| Requests | ★★★★★ (très facile) | ★★☆☆☆ (synchrone) | Non | HTTP, JSON | Massive | Scripts simples, pages statiques |

| MechanicalSoup | ★★★★☆ (facile) | ★★☆☆☆ (synchrone) | Non | Formulaires, navigation | Petite | Connexions, automatisation de formulaires |

| Aiohttp | ★★☆☆☆ (asynchrone) | ★★★★★ (concurrent) | Non | HTTP asynchrone | Large (async) | Scraping rapide, concurrent |

| Twisted | ★☆☆☆☆ (complexe) | ★★★★★ (personnalisé) | Non | Réseau, protocoles | Niche | Frameworks sur-mesure, utilisateurs avancés |

| Grab | ★★★☆☆ (modulaire) | ★★★★☆ (async) | Non | Proxys, XPath | Petite | Tout-en-un, proxy/CAPTCHA intensif |

| Urllib3 | ★★★★☆ (bas niveau) | ★★★★☆ (pooling) | Non | HTTP, pooling | Massive | Clients personnalisés, crawlers multithread |

*PyQuery peut être combiné à Selenium pour les sites dynamiques.

Comment choisir le bon package Python pour ton projet de scraping web

Alors, tu choisis quoi ? Voici mon pense-bête :

- Pages statiques, petits besoins ou débutant : Commence avec Requests + Beautiful Soup.

- Scraping à grande échelle, récurrent ou en prod : Scrapy ou Grab (pour une solution tout-en-un).

- Sites dynamiques ou interactifs : Selenium (ou Thunderbit pour un scraping IA sans code).

- Scraping rapide et concurrent : Aiohttp (si tu maîtrises l’asynchrone).

- Automatisation de formulaires ou connexions : MechanicalSoup (pour les sites simples), Selenium (pour le JS complexe).

- Parsing avancé ou gros volumes : LXML ou PyQuery.

- Protocoles personnalisés ou réseau avancé : Twisted.

- Prototypage rapide, génération de leads ou données non structurées : Thunderbit.

N’hésite pas à mixer ces outils pour plus d’efficacité. Par exemple, utilise Selenium pour rendre une page, puis parse le HTML avec Beautiful Soup ou PyQuery.

Conclusion : Passe à la vitesse supérieure avec les bons outils Python pour le scraping web

Le web scraping en 2026, c’est plus puissant — et plus indispensable — que jamais. Avec les bons packages Python, tu peux transformer le chaos du web en données exploitables pour ton business, tes recherches ou ta prochaine idée de génie. Que tu sois dev confirmé ou simple curieux, il y a un outil dans cette liste fait pour toi.

Envie de tester le scraping sans code et boosté à l’IA ? . Pour encore plus d’astuces, de guides et de tutos, va faire un tour sur le pour tout savoir sur le scraping, l’automatisation et les workflows data.

Bon scraping — que tes sélecteurs soient toujours précis, tes proxys fiables et tes données aussi clean que ton code !

FAQ

1. Quel est le meilleur package Python pour débuter le scraping web ?

Pour la plupart des débutants, le combo et est le plus simple pour se lancer. Les deux ont des APIs intuitives, plein de tutos et couvrent la majorité des besoins sur pages statiques.

2. Comment extraire des sites riches en JavaScript avec Python ?

Utilise pour automatiser un vrai navigateur, ou tente pour un scraping IA sans code qui gère le contenu dynamique. Pour les gros volumes, Scrapy peut être combiné à Splash ou Selenium.

3. Quel package choisir pour du scraping à grande échelle et haute vitesse ?

est fait pour le crawling asynchrone à grande échelle. Si tu veux encore plus de vitesse et que tu maîtrises l’asynchrone, est top pour les requêtes concurrentes.

4. Peut-on combiner ces packages dans un même workflow ?

Carrément ! Beaucoup de devs utilisent Requests ou Selenium pour récupérer les pages, puis Beautiful Soup, lxml ou PyQuery pour le parsing. Les exports de Thunderbit peuvent aussi être intégrés dans des scripts Python pour analyse.

5. Thunderbit est-il une bibliothèque Python ou un outil indépendant ?

Thunderbit est une extension Chrome et une plateforme boostée à l’IA, pas une bibliothèque Python classique. Mais ses exports (CSV, Excel, Sheets, Notion, Airtable) s’intègrent nickel dans les pipelines Python, ce qui en fait un allié puissant pour les devs.

Tu veux rester à la pointe du web scraping ? Abonne-toi à la et suis le pour plus de guides, comparatifs et astuces d’automatisation.

Pour aller plus loin